使用Isaac Gym來(lái)強(qiáng)化學(xué)習(xí)mycobot抓取任務(wù)

2023-04-11 14:57:12 5339

5339

什么是深度強(qiáng)化學(xué)習(xí)? 眾所周知,人類擅長(zhǎng)解決各種挑戰(zhàn)性的問(wèn)題,從低級(jí)的運(yùn)動(dòng)控制(如:步行、跑步、打網(wǎng)球)到高級(jí)的認(rèn)知任務(wù)。

2023-07-01 10:29:50 1002

1002

Facebook近日推出ReAgent強(qiáng)化學(xué)習(xí)(reinforcement learning)工具包,首次通過(guò)收集離線反饋(offline feedback)來(lái)實(shí)現(xiàn)策略評(píng)估(policy evaluation)。

2019-10-19 09:38:41 1347

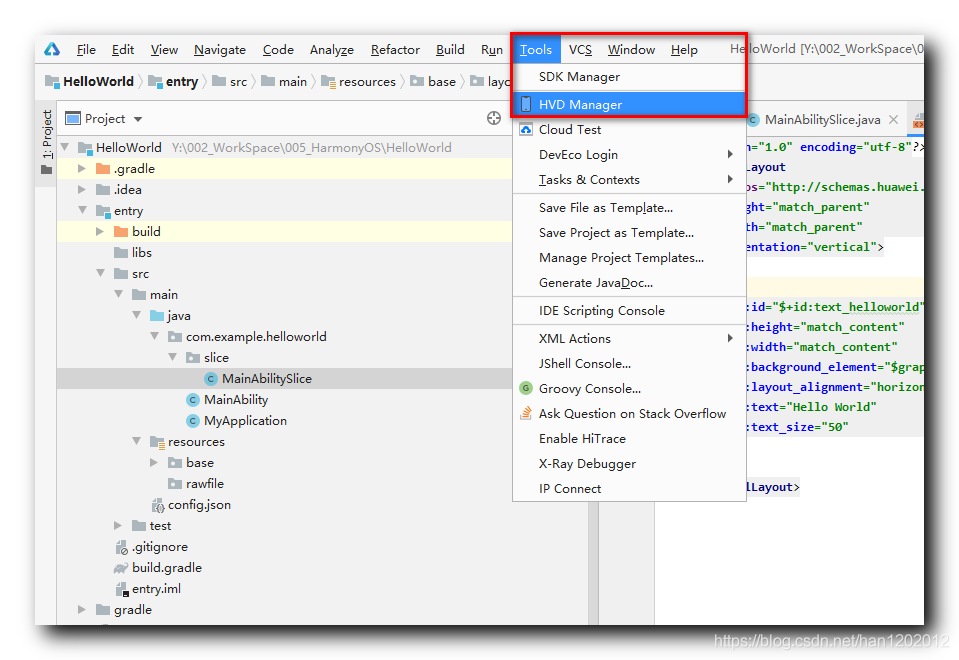

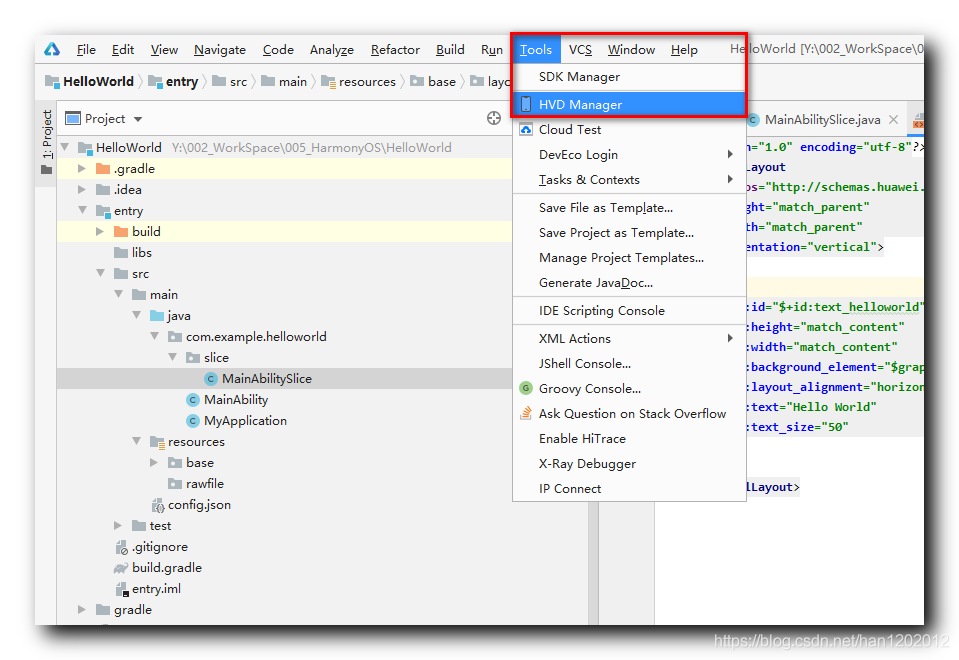

1347 本項(xiàng)目Gitee倉(cāng)地址:深入淺出eTs學(xué)習(xí): 帶大家深入淺出學(xué)習(xí)eTs (gitee.com)一、需求分析本章節(jié)不再以案例做介紹,而是教大家怎么運(yùn)行一些在預(yù)覽器里面看不到的東西,選擇使用遠(yuǎn)端模擬器

2022-12-29 13:56:58

啟用斷點(diǎn)。我看不出有什么其他辦法能使它們失效,那又有什么問(wèn)題呢?這是模擬器中的bug還是我錯(cuò)過(guò)了某個(gè)設(shè)置?衷心感謝您的幫助!考慮到

2020-03-13 09:24:09

速度相當(dāng)緩慢。我在AWS上運(yùn)行C4.xBug的模擬器,并且僅用新的Relic報(bào)告了大約70%的CPU使用最大值。有什么方法可以給MPLABX一個(gè)小推* *,所以它試圖拉更多的系統(tǒng)資源,以提高我的模擬器

2018-09-06 16:23:53

的幫助,它提到了在MCU配置下查看內(nèi)存映射,但我似乎找不到這個(gè)對(duì)話框,也沒(méi)有提到如何導(dǎo)航到這個(gè)對(duì)話框。還有其他人遇到過(guò)這個(gè)問(wèn)題嗎?任何人都可以幫我解決這個(gè)問(wèn)題嗎?謝謝 #STVD寫保護(hù)模擬器以上來(lái)自于谷歌

2018-11-15 10:56:49

海,我在verilog中真的很新。當(dāng)我模擬我的程序時(shí),我得到了錯(cuò)誤:模擬器:904 - 無(wú)法刪除以前的模擬文件isim / cache_memorytest_isim_beh.exe.sim

2020-04-03 08:47:23

(模擬器),玩上幾把小時(shí)候最喜歡玩的游戲,而nes模擬器正是不二之選,通過(guò)制作模擬器我們能學(xué)習(xí)到軟硬件各方面的知識(shí),可謂是很多程序員走向編程開(kāi)發(fā)道路上不可缺少的一環(huán)。來(lái)和我一起做出屬于自己的游

2022-01-12 08:20:15

,點(diǎn)擊左下角的Refresh按鈕即可獲取遠(yuǎn)程模擬器設(shè)備。可能cookie跨域被瀏覽器禁止:請(qǐng)點(diǎn)擊瀏覽器地址欄中的按鈕,檢查op.hicloud.com是否設(shè)置為允許,如果被禁止,請(qǐng)?jiān)O(shè)置為允許。當(dāng)前用戶

2020-09-17 18:20:57

Morello指令模擬器(Morello IE)是一個(gè)軟件開(kāi)發(fā)人員和研究人員想要試驗(yàn)Morello體系結(jié)構(gòu)的工具。它允許您在非Morello環(huán)境中的AArch64Linux系統(tǒng)上運(yùn)行用戶空間

2023-08-08 07:55:41

Noxim從https://github.com/davidepatti/noxim下載這是由卡塔尼亞大學(xué)(意大利)開(kāi)發(fā)的片上網(wǎng)絡(luò)模擬器。 Noxim仿真器是使用SystemC(一種基于C

2021-07-27 06:31:40

μVision調(diào)試器支持用于實(shí)施用戶定義外設(shè)的模擬器接口。

該接口稱為高級(jí)通用模擬器接口(AGSI)。

AGSI提供了一種靈活、簡(jiǎn)單的方法,可將新的用戶定義的外設(shè)直接添加到μVision。

它提供了

2023-09-04 08:14:11

強(qiáng)化學(xué)習(xí)的另一種策略(二)

2019-04-03 12:10:44

在實(shí)際的外場(chǎng)試飛過(guò)程中是不可能實(shí)現(xiàn)的,這也是雷達(dá)信號(hào)模擬器對(duì)場(chǎng)外試飛的一大優(yōu)勢(shì)。FPGA作為高性能數(shù)字信號(hào)處理系統(tǒng)中的關(guān)鍵部件,在雷達(dá)信號(hào)模擬和雷達(dá)信號(hào)采集等方面有著巨大的開(kāi)發(fā)潛能,采用這些技術(shù)對(duì)雷達(dá)

2019-07-15 06:48:33

( DDC) 技術(shù)。所以數(shù)字下變頻技術(shù)在寬帶短波信道模擬器的數(shù)字化和軟件化過(guò)程中起到了重要的作用。FPGA 具有較高的處理速度和很強(qiáng)的穩(wěn)定性,而且設(shè)計(jì)靈活、易于修改和維護(hù),同時(shí)可以根據(jù)不同的系統(tǒng)要求,采用不同的結(jié)構(gòu)來(lái)完成相應(yīng)的功能,大大提高系統(tǒng)的適用性及可擴(kuò)展性。因此,F(xiàn)PGA 逐漸成為實(shí)現(xiàn)DDC 的首選。

2019-07-22 06:27:47

汽車駕駛模擬器單片機(jī)系統(tǒng)的設(shè)計(jì)思路是什么?怎么實(shí)現(xiàn)汽車駕駛模擬器單片機(jī)系統(tǒng)的設(shè)計(jì)?

2021-05-12 07:07:21

汽車駕駛模擬器控制系統(tǒng)的原理是什么?汽車駕駛模擬器控制系統(tǒng)的功能有哪些?怎樣去設(shè)計(jì)一種汽車駕駛模擬器控制系統(tǒng)?

2021-05-17 06:36:41

。

通過(guò)以上對(duì)本地模擬器的介紹,不難看出本地模擬器具有以下優(yōu)勢(shì):

直接運(yùn)行在用戶本地計(jì)算機(jī)上,不需要登錄授權(quán),零延遲,也不受使用時(shí)長(zhǎng)限制,擁有和真機(jī)一樣的性能。

提供audio、battery

2022-02-17 16:58:49

提示學(xué)習(xí),學(xué)習(xí)正確的操作順序。被動(dòng)駕駛文件實(shí)行全自動(dòng)配置,只要教練在模擬器上操作一遍后,系統(tǒng)自動(dòng)錄制并配置相應(yīng)的提示聲音。 網(wǎng)絡(luò)互動(dòng):通過(guò)中央控制臺(tái)可以最多連接30臺(tái)駕駛艙,實(shí)現(xiàn)聯(lián)網(wǎng)訓(xùn)練,場(chǎng)景中可以

2012-09-06 17:48:26

汽車的技術(shù)性能指標(biāo),從而可以節(jié)省大量的自然資源,具有很高的經(jīng)濟(jì)價(jià)值[2]。 在汽車駕駛模擬器中,傳感控制系統(tǒng)的性能直接影響到整個(gè)汽車駕駛模擬系統(tǒng)的交互性和實(shí)時(shí)性,是衡量汽車駕駛模擬器實(shí)用性能的重要

2019-07-29 07:28:21

一:深度學(xué)習(xí)DeepLearning實(shí)戰(zhàn)時(shí)間地點(diǎn):1 月 15日— 1 月18 日二:深度強(qiáng)化學(xué)習(xí)核心技術(shù)實(shí)戰(zhàn)時(shí)間地點(diǎn): 1 月 27 日— 1 月30 日(第一天報(bào)到 授課三天;提前環(huán)境部署 電腦

2021-01-10 13:42:26

安卓作為全球用戶最多的智能手機(jī)系統(tǒng),有很多好玩兒的應(yīng)用。如果你還沒(méi)有安卓手機(jī),又想買一部試試,可是價(jià)格都不便宜,買來(lái)不適合自己怎么辦?那么可以先在電腦上安裝一個(gè)安卓模擬器,因?yàn)樗梢栽陔娔X上模擬出安

2012-09-10 11:56:33

`飛行模擬器,顧名思義也就是模擬飛行器飛行的設(shè)備。用來(lái)應(yīng)對(duì)真實(shí)世界在飛行過(guò)程中會(huì)遇到的空氣動(dòng)力、氣象、地理環(huán)境、飛行系統(tǒng)等,并且將仿真操控和飛行感官反饋給用戶。飛行模擬器對(duì)飛機(jī)駕駛艙各個(gè)部位進(jìn)行了

2020-09-07 17:20:34

模擬器作為嵌入式系統(tǒng)研究的基礎(chǔ)研發(fā)工具,可輔助系統(tǒng)體系結(jié)構(gòu)調(diào)優(yōu)、軟硬件協(xié)同設(shè)計(jì)。本文實(shí)現(xiàn)了具有良好配置性及可擴(kuò)展性的ArmSim 模擬器,該模擬器是針對(duì)ARM 處理器的全

2009-08-10 10:12:22 34

34 汽車駕駛模擬器新一代實(shí)時(shí)場(chǎng)景系統(tǒng)的開(kāi)發(fā):本論文總結(jié)了汽車駕駛模擬器新一代實(shí)時(shí)場(chǎng)景系統(tǒng)的設(shè)計(jì)和開(kāi)發(fā)工作。汽車駕駛模擬器新一代實(shí)時(shí)場(chǎng)景系統(tǒng)是汽車駕駛模擬器的重要組

2009-08-23 23:10:33 55

55 為了適應(yīng)航天器的發(fā)展需求,需要研制小型輕量化的多星模擬器。提出了采用Sony公司的LCX023CMT液晶光閥為核心的多星模擬器構(gòu)成方案。設(shè)計(jì)了相應(yīng)的LCD顯示驅(qū)動(dòng)電路和光學(xué)系統(tǒng)。所

2010-08-02 16:40:56 0

0 基于DSP的某型供輸彈系統(tǒng)訓(xùn)練模擬器設(shè)計(jì)_葛玉

2017-03-19 11:45:23 0

0 強(qiáng)化學(xué)習(xí)在RoboCup帶球任務(wù)中的應(yīng)用_劉飛

2017-03-14 08:00:00 0

0 與監(jiān)督機(jī)器學(xué)習(xí)不同,在強(qiáng)化學(xué)習(xí)中,研究人員通過(guò)讓一個(gè)代理與環(huán)境交互來(lái)訓(xùn)練模型。當(dāng)代理的行為產(chǎn)生期望的結(jié)果時(shí),它得到正反饋。例如,代理人獲得一個(gè)點(diǎn)數(shù)或贏得一場(chǎng)比賽的獎(jiǎng)勵(lì)。簡(jiǎn)單地說(shuō),研究人員加強(qiáng)了代理人的良好行為。

2018-07-13 09:33:00 24319

24319

深度強(qiáng)化學(xué)習(xí)DRL自提出以來(lái), 已在理論和應(yīng)用方面均取得了顯著的成果。尤其是谷歌DeepMind團(tuán)隊(duì)基于深度強(qiáng)化學(xué)習(xí)DRL研發(fā)的AlphaGo,將深度強(qiáng)化學(xué)習(xí)DRL成推上新的熱點(diǎn)和高度,成為人工智能歷史上一個(gè)新的里程碑。因此,深度強(qiáng)化學(xué)習(xí)DRL非常值得研究。

2018-06-29 18:36:00 27596

27596 薩頓在專訪中(再次)科普了強(qiáng)化學(xué)習(xí)、深度強(qiáng)化學(xué)習(xí),并談到了這項(xiàng)技術(shù)的潛力,以及接下來(lái)的發(fā)展方向:預(yù)測(cè)學(xué)習(xí)

2017-12-27 09:07:15 10856

10856 針對(duì)路徑規(guī)劃算法收斂速度慢及效率低的問(wèn)題,提出了一種基于分層強(qiáng)化學(xué)習(xí)及人工勢(shì)場(chǎng)的多Agent路徑規(guī)劃算法。首先,將多Agent的運(yùn)行環(huán)境虛擬為一個(gè)人工勢(shì)能場(chǎng),根據(jù)先驗(yàn)知識(shí)確定每點(diǎn)的勢(shì)能值,它代表最優(yōu)

2017-12-27 14:32:02 0

0 本文提出了一種LCS和LS-SVM相結(jié)合的多機(jī)器人強(qiáng)化學(xué)習(xí)方法,LS-SVM獲得的最優(yōu)學(xué)習(xí)策略作為L(zhǎng)CS的初始規(guī)則集。LCS通過(guò)與環(huán)境的交互,能更快發(fā)現(xiàn)指導(dǎo)多機(jī)器人強(qiáng)化學(xué)習(xí)的規(guī)則,為強(qiáng)化學(xué)習(xí)系統(tǒng)

2018-01-09 14:43:49 0

0 在風(fēng)儲(chǔ)配置給定前提下,研究風(fēng)電與儲(chǔ)能系統(tǒng)如何有機(jī)合作的問(wèn)題。核心在于風(fēng)電與儲(chǔ)能組成混合系統(tǒng)參與電力交易,通過(guò)合作提升其市場(chǎng)競(jìng)爭(zhēng)的能力。針對(duì)現(xiàn)有研究的不足,在具有過(guò)程化樣本的前提下,引入強(qiáng)化學(xué)習(xí)算法

2018-01-27 10:20:50 2

2 傳統(tǒng)上,強(qiáng)化學(xué)習(xí)在人工智能領(lǐng)域占據(jù)著一個(gè)合適的地位。但強(qiáng)化學(xué)習(xí)在過(guò)去幾年已開(kāi)始在很多人工智能計(jì)劃中發(fā)揮更大的作用。

2018-03-03 14:16:56 3923

3923 ,能夠?qū)崿F(xiàn)對(duì)處理器設(shè)計(jì)的驗(yàn)證。處理器體系結(jié)構(gòu)模擬器在處理器研究和設(shè)計(jì)領(lǐng)域具有重要作用。 處理器體系結(jié)構(gòu)模擬器按照模擬層次可以劃分為系統(tǒng)級(jí)模擬器和用戶級(jí)模擬器。系統(tǒng)級(jí)模擬器支持操作系統(tǒng)運(yùn)行,并且允許用戶在操作系

2018-03-12 16:13:22 0

0 讓我們?cè)?b class="flag-6" style="color: red">強(qiáng)化學(xué)習(xí)社區(qū)感興趣的問(wèn)題上應(yīng)用隨機(jī)搜索。深度強(qiáng)化學(xué)習(xí)領(lǐng)域一直把大量時(shí)間和精力用于由OpenAI維護(hù)的、基于MuJoCo模擬器的一套基準(zhǔn)測(cè)試中。這里,最優(yōu)控制問(wèn)題指的是讓一個(gè)有腿機(jī)器人

2018-04-01 09:35:00 4193

4193

用強(qiáng)化學(xué)習(xí)方法教機(jī)器人(模擬器里的智能體),能學(xué)會(huì)的動(dòng)作花樣繁多,細(xì)致到拿東西、豪放到奔跑都能搞定,還可以給機(jī)器人設(shè)置一個(gè)明確的目的。但是,總難免上演一些羞恥或驚喜play。

2018-04-13 11:00:32 9513

9513 強(qiáng)化學(xué)習(xí)是智能系統(tǒng)從環(huán)境到行為映射的學(xué)習(xí),以使獎(jiǎng)勵(lì)信號(hào)(強(qiáng)化信號(hào))函數(shù)值最大,強(qiáng)化學(xué)習(xí)不同于連接主義學(xué)習(xí)中的監(jiān)督學(xué)習(xí),主要表現(xiàn)在教師信號(hào)上,強(qiáng)化學(xué)習(xí)中由環(huán)境提供的強(qiáng)化信號(hào)是對(duì)產(chǎn)生動(dòng)作的好壞作一種評(píng)價(jià)

2018-05-30 06:53:00 1234

1234 當(dāng)我們使用虛擬的計(jì)算機(jī)屏幕和隨機(jī)選擇的圖像來(lái)模擬一個(gè)非常相似的測(cè)試時(shí),我們發(fā)現(xiàn),我們的“元強(qiáng)化學(xué)習(xí)智能體”(meta-RL agent)似乎是以類似于Harlow實(shí)驗(yàn)中的動(dòng)物的方式在學(xué)習(xí),甚至在被顯示以前從未見(jiàn)過(guò)的全新圖像時(shí)也是如此。

2018-05-16 09:03:39 4475

4475

自動(dòng)駕駛汽車首先是人工智能問(wèn)題,而強(qiáng)化學(xué)習(xí)是機(jī)器學(xué)習(xí)的一個(gè)重要分支,是多學(xué)科多領(lǐng)域交叉的一個(gè)產(chǎn)物。今天人工智能頭條給大家介紹強(qiáng)化學(xué)習(xí)在自動(dòng)駕駛的一個(gè)應(yīng)用案例,無(wú)需3D地圖也無(wú)需規(guī)則,讓汽車從零開(kāi)始在二十分鐘內(nèi)學(xué)會(huì)自動(dòng)駕駛。

2018-07-10 09:00:29 4676

4676

強(qiáng)化學(xué)習(xí)是人工智能基本的子領(lǐng)域之一,在強(qiáng)化學(xué)習(xí)的框架中,智能體通過(guò)與環(huán)境互動(dòng),來(lái)學(xué)習(xí)采取何種動(dòng)作能使其在給定環(huán)境中的長(zhǎng)期獎(jiǎng)勵(lì)最大化,就像在上述的棋盤游戲寓言中,你通過(guò)與棋盤的互動(dòng)來(lái)學(xué)習(xí)。

2018-07-15 10:56:37 17104

17104

這些具有一定難度的任務(wù) OpenAI 自己也在研究,他們認(rèn)為這是深度強(qiáng)化學(xué)習(xí)發(fā)展到新時(shí)代之后可以作為新標(biāo)桿的算法測(cè)試任務(wù),而且也歡迎其它機(jī)構(gòu)與學(xué)校的研究人員一同研究這些任務(wù),把深度強(qiáng)化學(xué)習(xí)的表現(xiàn)推上新的臺(tái)階。

2018-08-03 14:27:26 4303

4303 結(jié)合 DL 與 RL 的深度強(qiáng)化學(xué)習(xí)(Deep Reinforcement Learning, DRL)迅速成為人工智能界的焦點(diǎn)。

2018-08-09 10:12:43 5789

5789 強(qiáng)化學(xué)習(xí)作為一種常用的訓(xùn)練智能體的方法,能夠完成很多復(fù)雜的任務(wù)。在強(qiáng)化學(xué)習(xí)中,智能體的策略是通過(guò)將獎(jiǎng)勵(lì)函數(shù)最大化訓(xùn)練的。獎(jiǎng)勵(lì)在智能體之外,各個(gè)環(huán)境中的獎(jiǎng)勵(lì)各不相同。深度學(xué)習(xí)的成功大多是有密集并且有效的獎(jiǎng)勵(lì)函數(shù),例如電子游戲中不斷增加的“分?jǐn)?shù)”。

2018-08-18 11:38:57 3361

3361 強(qiáng)化學(xué)習(xí)(RL)研究在過(guò)去幾年取得了許多重大進(jìn)展。強(qiáng)化學(xué)習(xí)的進(jìn)步使得 AI 智能體能夠在一些游戲上超過(guò)人類,值得關(guān)注的例子包括 DeepMind 攻破 Atari 游戲的 DQN,在圍棋中獲得矚目的 AlphaGo 和 AlphaGo Zero,以及在 Dota2 對(duì)戰(zhàn)人類職業(yè)玩家的Open AI Five。

2018-08-31 09:20:49 3497

3497 強(qiáng)化學(xué)習(xí)是一種非常重要 AI 技術(shù),它能使用獎(jiǎng)勵(lì)(或懲罰)來(lái)驅(qū)動(dòng)智能體(agents)朝著特定目標(biāo)前進(jìn),比如它訓(xùn)練的 AI 系統(tǒng) AlphaGo 擊敗了頂尖圍棋選手,它也是 DeepMind 的深度

2018-09-03 14:06:30 2653

2653 強(qiáng)化學(xué)習(xí)是一種訓(xùn)練主體最大化獎(jiǎng)勵(lì)的學(xué)習(xí)機(jī)制,對(duì)于目標(biāo)條件下的強(qiáng)化學(xué)習(xí)來(lái)說(shuō)可以將獎(jiǎng)勵(lì)函數(shù)設(shè)為當(dāng)前狀態(tài)與目標(biāo)狀態(tài)之間距離的反比函數(shù),那么最大化獎(jiǎng)勵(lì)就對(duì)應(yīng)著最小化與目標(biāo)函數(shù)的距離。

2018-09-24 10:11:00 6779

6779 之前接觸的強(qiáng)化學(xué)習(xí)算法都是單個(gè)智能體的強(qiáng)化學(xué)習(xí)算法,但是也有很多重要的應(yīng)用場(chǎng)景牽涉到多個(gè)智能體之間的交互。

2018-11-02 16:18:15 21015

21015 本文作者通過(guò)簡(jiǎn)單的方式構(gòu)建了強(qiáng)化學(xué)習(xí)模型來(lái)訓(xùn)練無(wú)人車算法,可以為初學(xué)者提供快速入門的經(jīng)驗(yàn)。

2018-11-12 14:47:39 4568

4568 OpenAI 近期發(fā)布了一個(gè)新的訓(xùn)練環(huán)境 CoinRun,它提供了一個(gè)度量智能體將其學(xué)習(xí)經(jīng)驗(yàn)活學(xué)活用到新情況的能力指標(biāo),而且還可以解決一項(xiàng)長(zhǎng)期存在于強(qiáng)化學(xué)習(xí)中的疑難問(wèn)題——即使是廣受贊譽(yù)的強(qiáng)化算法在訓(xùn)練過(guò)程中也總是沒(méi)有運(yùn)用監(jiān)督學(xué)習(xí)的技術(shù)。

2019-01-01 09:22:00 2122

2122

強(qiáng)化學(xué)習(xí)(RL)能通過(guò)獎(jiǎng)勵(lì)或懲罰使智能體實(shí)現(xiàn)目標(biāo),并將它們學(xué)習(xí)到的經(jīng)驗(yàn)轉(zhuǎn)移到新環(huán)境中。

2018-12-24 09:29:56 2949

2949 在一些情況下,我們會(huì)用策略函數(shù)(policy, 總得分,也就是搭建的網(wǎng)絡(luò)在測(cè)試集上的精度(accuracy),通過(guò)強(qiáng)化學(xué)習(xí)(Reinforcement Learning)這種通用黑盒算法來(lái)優(yōu)化。然而,因?yàn)?b class="flag-6" style="color: red">強(qiáng)化學(xué)習(xí)本身具有數(shù)據(jù)利用率低的特點(diǎn),這個(gè)優(yōu)化的過(guò)程往往需要大量的計(jì)算資源。

2019-01-28 09:54:22 4704

4704 一個(gè)觀察結(jié)果后在GPU上調(diào)用該批處理。 一旦動(dòng)作返回,模擬器再次步驟,依此類推,系統(tǒng)共享內(nèi)存陣列提供了動(dòng)作服務(wù)器和模擬器進(jìn)程之間的快速通信。

2019-02-13 09:31:19 2667

2667

仿真模擬器可以模擬在目標(biāo)終端上運(yùn)行bada應(yīng)用的效果.讓我們能夠在發(fā)布到真機(jī)上運(yùn)行前在本地模擬環(huán)境中對(duì)我們的應(yīng)用進(jìn)行充分調(diào)試,測(cè)試.仿真模擬器使用本地調(diào)試器,使我們能夠很好

2019-04-02 14:35:11 420

420 近日,Reddit一位網(wǎng)友根據(jù)近期OpenAI Five、AlphaStar的表現(xiàn),提出“深度強(qiáng)化學(xué)習(xí)是否已經(jīng)到達(dá)盡頭”的問(wèn)題。

2019-05-10 16:34:59 2313

2313 該強(qiáng)化學(xué)習(xí)環(huán)境的核心是一種先進(jìn)的足球游戲模擬,稱為“足球引擎”,它基于一個(gè)足球游戲版本經(jīng)大量修改而成。根據(jù)兩支對(duì)方球隊(duì)的輸入動(dòng)作,模擬了足球比賽中的常見(jiàn)事件和場(chǎng)景,包括進(jìn)球、犯規(guī)、角球和點(diǎn)球、越位等。

2019-06-15 10:33:18 3946

3946 在谷歌最新的論文中,研究人員提出了“非政策強(qiáng)化學(xué)習(xí)”算法OPC,它是強(qiáng)化學(xué)習(xí)的一種變體,它能夠評(píng)估哪種機(jī)器學(xué)習(xí)模型將產(chǎn)生最好的結(jié)果。數(shù)據(jù)顯示,OPC比基線機(jī)器學(xué)習(xí)算法有著顯著的提高,更加穩(wěn)健可靠。

2019-06-22 11:17:08 3372

3372 強(qiáng)化學(xué)習(xí)非常適合實(shí)現(xiàn)自主決策,相比之下監(jiān)督學(xué)習(xí)與無(wú)監(jiān)督學(xué)習(xí)技術(shù)則無(wú)法獨(dú)立完成此項(xiàng)工作。

2019-12-10 14:34:57 1092

1092 惰性是人類的天性,然而惰性能讓人類無(wú)需過(guò)于復(fù)雜的練習(xí)就能學(xué)習(xí)某項(xiàng)技能,對(duì)于人工智能而言,是否可有基于惰性的快速學(xué)習(xí)的方法?本文提出一種懶惰強(qiáng)化學(xué)習(xí)(Lazy reinforcement learning, LRL) 算法。

2020-01-16 17:40:00 745

745 本文檔的主要內(nèi)容詳細(xì)介紹的是深度強(qiáng)化學(xué)習(xí)的筆記資料免費(fèi)下載。

2020-03-10 08:00:00 0

0 強(qiáng)化學(xué)習(xí)(RL)是現(xiàn)代人工智能領(lǐng)域中最熱門的研究主題之一,其普及度還在不斷增長(zhǎng)。 讓我們看一下開(kāi)始學(xué)習(xí)RL需要了解的5件事。

2020-05-04 18:14:00 3117

3117

深度學(xué)習(xí)DL是機(jī)器學(xué)習(xí)中一種基于對(duì)數(shù)據(jù)進(jìn)行表征學(xué)習(xí)的方法。深度學(xué)習(xí)DL有監(jiān)督和非監(jiān)督之分,都已經(jīng)得到廣泛的研究和應(yīng)用。強(qiáng)化學(xué)習(xí)RL是通過(guò)對(duì)未知環(huán)境一邊探索一邊建立環(huán)境模型以及學(xué)習(xí)得到一個(gè)最優(yōu)策略。強(qiáng)化學(xué)習(xí)是機(jī)器學(xué)習(xí)中一種快速、高效且不可替代的學(xué)習(xí)算法。

2020-06-13 11:39:40 5526

5526 近期,有不少報(bào)道強(qiáng)化學(xué)習(xí)算法在 GO、Dota 2 和 Starcraft 2 等一系列游戲中打敗了專業(yè)玩家的新聞。強(qiáng)化學(xué)習(xí)是一種機(jī)器學(xué)習(xí)類型,能夠在電子游戲、機(jī)器人、自動(dòng)駕駛等復(fù)雜應(yīng)用中運(yùn)用人工智能。

2020-07-27 08:50:15 714

714 Viet Nguyen就是其中一個(gè)。這位來(lái)自德國(guó)的程序員表示自己只玩到了第9個(gè)關(guān)卡。因此,他決定利用強(qiáng)化學(xué)習(xí)AI算法來(lái)幫他完成未通關(guān)的遺憾。

2020-07-29 09:30:16 2428

2428 強(qiáng)化學(xué)習(xí)屬于機(jī)器學(xué)習(xí)中的一個(gè)子集,它使代理能夠理解在特定環(huán)境中執(zhí)行特定操作的相應(yīng)結(jié)果。目前,相當(dāng)一部分機(jī)器人就在使用強(qiáng)化學(xué)習(xí)掌握種種新能力。

2020-11-06 15:33:49 1552

1552 深度強(qiáng)化學(xué)習(xí)是深度學(xué)習(xí)與強(qiáng)化學(xué)習(xí)相結(jié)合的產(chǎn)物,它集成了深度學(xué)習(xí)在視覺(jué)等感知問(wèn)題上強(qiáng)大的理解能力,以及強(qiáng)化學(xué)習(xí)的決策能力,實(shí)現(xiàn)了...

2020-12-10 18:32:50 374

374 RLax(發(fā)音為“ relax”)是建立在JAX之上的庫(kù),它公開(kāi)了用于實(shí)施強(qiáng)化學(xué)習(xí)智能體的有用構(gòu)建塊。。報(bào)道:深度強(qiáng)化學(xué)習(xí)實(shí)驗(yàn)室作者:DeepRL ...

2020-12-10 18:43:23 499

499 本文主要介紹深度強(qiáng)化學(xué)習(xí)在任務(wù)型對(duì)話上的應(yīng)用,兩者的結(jié)合點(diǎn)主要是將深度強(qiáng)化學(xué)習(xí)應(yīng)用于任務(wù)型對(duì)話的策略學(xué)習(xí)上來(lái)源:騰訊技術(shù)工程微信號(hào)

2020-12-10 19:02:45 781

781 強(qiáng)化學(xué)習(xí)( Reinforcement learning,RL)作為機(jī)器學(xué)習(xí)領(lǐng)域中與監(jiān)督學(xué)習(xí)、無(wú)監(jiān)督學(xué)習(xí)并列的第三種學(xué)習(xí)范式,通過(guò)與環(huán)境進(jìn)行交互來(lái)學(xué)習(xí),最終將累積收益最大化。常用的強(qiáng)化學(xué)習(xí)算法分為

2021-04-08 11:41:58 11

11 深度強(qiáng)化學(xué)習(xí)(DRL)作為機(jī)器學(xué)習(xí)的重要分攴,在 Alphago擊敗人類后受到了廣泛關(guān)注。DRL以種試錯(cuò)機(jī)制與環(huán)境進(jìn)行交互,并通過(guò)最大化累積獎(jiǎng)賞最終得到最優(yōu)策略。強(qiáng)化學(xué)習(xí)可分為無(wú)模型強(qiáng)化學(xué)習(xí)和模型

2021-04-12 11:01:52 9

9 當(dāng)機(jī)器人遇見(jiàn)強(qiáng)化學(xué)習(xí),會(huì)碰出怎樣的火花? 一名叫 Cassie 的機(jī)器人,給出了生動(dòng)演繹。 最近,24 歲的中國(guó)南昌小伙李鐘毓和其所在團(tuán)隊(duì),用強(qiáng)化學(xué)習(xí)教 Cassie 走路 ,目前它已學(xué)會(huì)蹲伏走路

2021-04-13 09:35:09 2164

2164

利用深度強(qiáng)化學(xué)習(xí)技術(shù)實(shí)現(xiàn)路口信號(hào)控制是智能交通領(lǐng)域的硏究熱點(diǎn)。現(xiàn)有硏究大多利用強(qiáng)化學(xué)習(xí)來(lái)全面刻畫交通狀態(tài)以及設(shè)計(jì)有效強(qiáng)化學(xué)習(xí)算法以解決信號(hào)配時(shí)問(wèn)題,但這些研究往往忽略了信號(hào)燈狀態(tài)對(duì)動(dòng)作選擇的影響以及

2021-04-23 15:30:53 21

21 移動(dòng)群智感知系統(tǒng)需要為用戶提供個(gè)性化隱私保護(hù),以吸引更多用戶參與任務(wù)。然而,由于惡意攻擊者的存在,用戶提升隱私保護(hù)力度會(huì)導(dǎo)致位置可用性變差,降低任務(wù)分配效率。針對(duì)該問(wèn)題,提出了一種基于強(qiáng)化學(xué)習(xí)的用戶

2021-05-08 15:12:17 2

2 目前壯語(yǔ)智能信息處理研究處于起步階段,缺乏自動(dòng)詞性標(biāo)注方法。針對(duì)壯語(yǔ)標(biāo)注語(yǔ)料匱乏、人工標(biāo)注費(fèi)時(shí)費(fèi)力而機(jī)器標(biāo)注性能較差的現(xiàn)狀,提出一種基于強(qiáng)化學(xué)習(xí)的壯語(yǔ)詞性標(biāo)注方法。依據(jù)壯語(yǔ)的文法特點(diǎn)和中文賓州

2021-05-14 11:29:35 14

14 壓邊力控制策略的

學(xué)習(xí)優(yōu)化。基于深度

強(qiáng)化學(xué)習(xí)的壓邊力優(yōu)化算法,利用深度神經(jīng)網(wǎng)絡(luò)處理巨大的狀態(tài)空間,避免了

系統(tǒng)動(dòng)力學(xué)的擬合,并且使用一種新的網(wǎng)絡(luò)結(jié)構(gòu)來(lái)構(gòu)建策略網(wǎng)絡(luò),將壓邊力策略劃分為全局與局部?jī)刹糠郑岣吡藟哼?/div>

2021-05-27 10:32:39 0

0 一種新型的多智能體深度強(qiáng)化學(xué)習(xí)算法

2021-06-23 10:42:47 36

36 基于深度強(qiáng)化學(xué)習(xí)的無(wú)人機(jī)控制律設(shè)計(jì)方法

2021-06-23 14:59:10 46

46 基于強(qiáng)化學(xué)習(xí)的虛擬場(chǎng)景角色乒乓球訓(xùn)練

2021-06-27 11:34:33 62

62 使用Matlab進(jìn)行強(qiáng)化學(xué)習(xí)電子版資源下載

2021-07-16 11:17:09 0

0 強(qiáng)化學(xué)習(xí) (Reinforcement Learning) 是一種指導(dǎo)機(jī)器人在現(xiàn)實(shí)世界完成導(dǎo)航和執(zhí)行操作的熱門方法,其本身可以簡(jiǎn)化并表示為剛性物體 [1](即受外力作用時(shí)不會(huì)變形的固體物理對(duì)象)之間

2021-08-24 11:06:58 3585

3585 突破.由于融合了深度學(xué)習(xí)強(qiáng)大的表征能力和強(qiáng)化學(xué)習(xí)有效的策略搜索能力,深度強(qiáng)化學(xué)習(xí)已經(jīng)成為實(shí)現(xiàn)人工智能頗有前景的學(xué)習(xí)范式.然而,深度強(qiáng)化學(xué)習(xí)在多Agent 系統(tǒng)的研究與應(yīng)用中,仍存在諸多困難和挑戰(zhàn),以StarCraft II 為代表的部分觀測(cè)環(huán)境下的多Agent學(xué)習(xí)仍然很難達(dá)到理想效果.本文簡(jiǎn)要介紹了深度Q

2022-01-18 10:08:01 1226

1226

本文主要內(nèi)容是如何用Oenflow去復(fù)現(xiàn)強(qiáng)化學(xué)習(xí)玩 Flappy Bird 小游戲這篇論文的算法關(guān)鍵部分,還有記錄復(fù)現(xiàn)過(guò)程中一些踩過(guò)的坑。

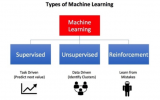

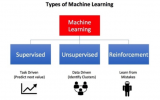

2022-01-26 18:19:34 2

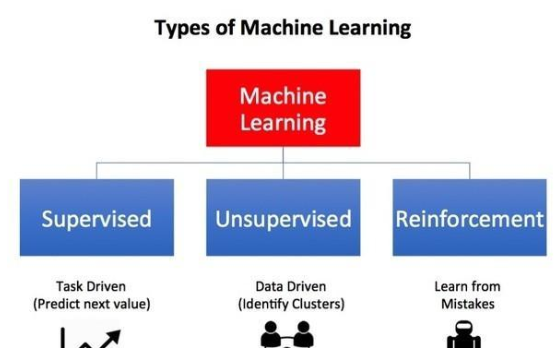

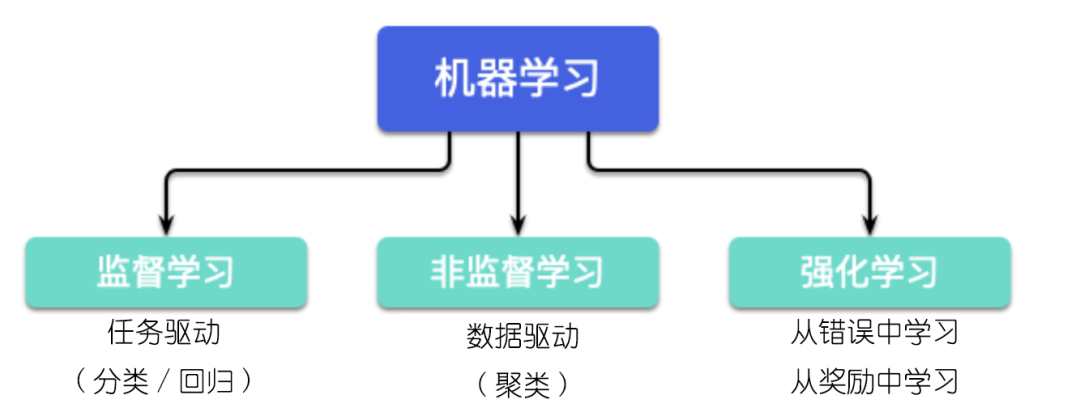

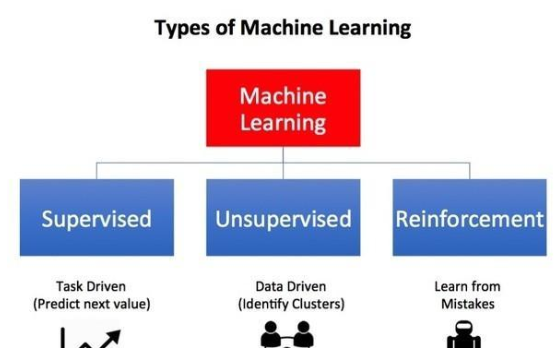

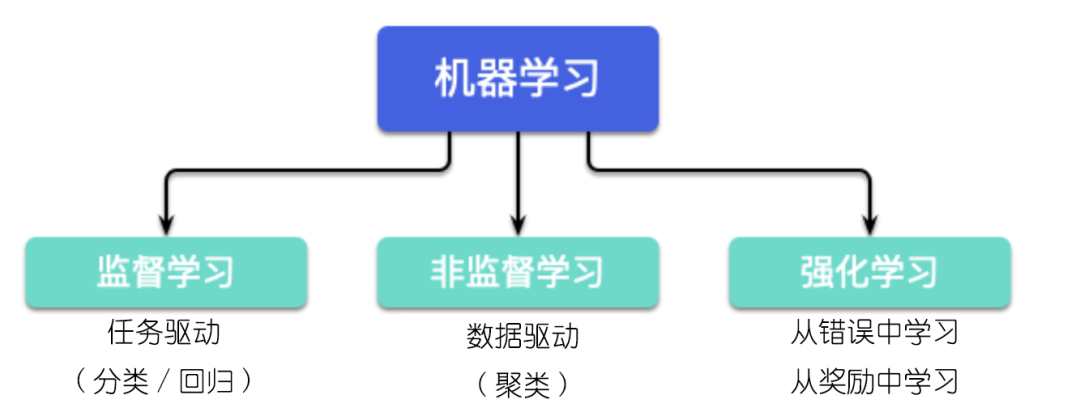

2 來(lái)源:DeepHub IMBA 強(qiáng)化學(xué)習(xí)的基礎(chǔ)知識(shí)和概念簡(jiǎn)介(無(wú)模型、在線學(xué)習(xí)、離線強(qiáng)化學(xué)習(xí)等) 機(jī)器學(xué)習(xí)(ML)分為三個(gè)分支:監(jiān)督學(xué)習(xí)、無(wú)監(jiān)督學(xué)習(xí)和強(qiáng)化學(xué)習(xí)。 監(jiān)督學(xué)習(xí)(SL) : 關(guān)注在給

2022-12-20 14:00:02 827

827 電子發(fā)燒友網(wǎng)站提供《ESP32上的深度強(qiáng)化學(xué)習(xí).zip》資料免費(fèi)下載

2022-12-27 10:31:45 0

0 作者:Siddhartha Pramanik 來(lái)源:DeepHub IMBA 目前流行的強(qiáng)化學(xué)習(xí)算法包括 Q-learning、SARSA、DDPG、A2C、PPO、DQN 和 TRPO。這些算法

2023-02-03 20:15:06 744

744 本文介紹了強(qiáng)化學(xué)習(xí)與智能駕駛決策規(guī)劃。智能駕駛中的決策規(guī)劃模塊負(fù)責(zé)將感知模塊所得到的環(huán)境信息轉(zhuǎn)化成具體的駕駛策略,從而指引車輛安全、穩(wěn)定的行駛。真實(shí)的駕駛場(chǎng)景往往具有高度的復(fù)雜性及不確定性。如何制定

2023-02-08 14:05:16 1440

1440 用于用戶開(kāi)放接口的 SM+ 系統(tǒng)模擬器 (U18212CA2V0UM00)

2023-04-28 19:35:03 0

0 用于用戶開(kāi)放接口的 SM+ 系統(tǒng)模擬器 (U18212EJ2V0UM00)

2023-05-04 19:19:12 0

0 強(qiáng)化學(xué)習(xí)(RL)是人工智能的一個(gè)子領(lǐng)域,專注于決策過(guò)程。與其他形式的機(jī)器學(xué)習(xí)相比,強(qiáng)化學(xué)習(xí)模型通過(guò)與環(huán)境交互并以獎(jiǎng)勵(lì)或懲罰的形式接收反饋來(lái)學(xué)習(xí)。

2023-06-09 09:23:23 355

355 來(lái)源:DeepHubIMBA強(qiáng)化學(xué)習(xí)的基礎(chǔ)知識(shí)和概念簡(jiǎn)介(無(wú)模型、在線學(xué)習(xí)、離線強(qiáng)化學(xué)習(xí)等)機(jī)器學(xué)習(xí)(ML)分為三個(gè)分支:監(jiān)督學(xué)習(xí)、無(wú)監(jiān)督學(xué)習(xí)和強(qiáng)化學(xué)習(xí)。監(jiān)督學(xué)習(xí)(SL):關(guān)注在給定標(biāo)記訓(xùn)練數(shù)據(jù)

2023-01-05 14:54:05 419

419

電子發(fā)燒友網(wǎng)站提供《人工智能強(qiáng)化學(xué)習(xí)開(kāi)源分享.zip》資料免費(fèi)下載

2023-06-20 09:27:28 1

1 摘要:基于強(qiáng)化學(xué)習(xí)的目標(biāo)檢測(cè)算法在檢測(cè)過(guò)程中通常采用預(yù)定義搜索行為,其產(chǎn)生的候選區(qū)域形狀和尺寸變化單一,導(dǎo)致目標(biāo)檢測(cè)精確度較低。為此,在基于深度強(qiáng)化學(xué)習(xí)的視覺(jué)目標(biāo)檢測(cè)算法基礎(chǔ)上,提出聯(lián)合回歸與深度

2023-07-19 14:35:02 0

0 訊維模擬矩陣在深度強(qiáng)化學(xué)習(xí)智能控制系統(tǒng)中的應(yīng)用主要是通過(guò)構(gòu)建一個(gè)包含多種環(huán)境信息和動(dòng)作空間的模擬矩陣,來(lái)模擬和預(yù)測(cè)深度強(qiáng)化學(xué)習(xí)智能控制系統(tǒng)在不同環(huán)境下的表現(xiàn)和效果,從而優(yōu)化控制策略和提高系統(tǒng)的性能

2023-09-04 14:26:36 295

295

強(qiáng)化學(xué)習(xí)是機(jī)器學(xué)習(xí)的方式之一,它與監(jiān)督學(xué)習(xí)、無(wú)監(jiān)督學(xué)習(xí)并列,是三種機(jī)器學(xué)習(xí)訓(xùn)練方法之一。 在圍棋上擊敗世界第一李世石的 AlphaGo、在《星際爭(zhēng)霸2》中以 10:1 擊敗了人類頂級(jí)職業(yè)玩家

2023-10-30 11:36:40 1047

1047

于測(cè)試和評(píng)估光伏電池的性能,并幫助開(kāi)發(fā)、優(yōu)化和驗(yàn)證光伏系統(tǒng)的設(shè)計(jì)。 光伏模擬器主要由光源、天線、模擬電源、測(cè)量裝置、數(shù)據(jù)采集和控制系統(tǒng)等組成。它可以產(chǎn)生與太陽(yáng)光譜相似的光照,并通過(guò)模擬電源提供不同電壓和電流給

2023-11-10 15:57:06 635

635 ; ? 在 HUAWEI DevEco Studio 開(kāi)發(fā)和環(huán)境中彈出如下對(duì)話框 , 點(diǎn)擊 Agree 同意 ; ? 此時(shí)會(huì)彈出如下模擬器對(duì)話框 : ? 選擇 P40 手機(jī)設(shè)備 , 雙擊該條目

2024-01-26 15:02:51 742

742

已全部加載完成

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論