卷積是信號處理的一個基本概念,它的體現(xiàn)最重要的一個方面,也許就是下面這句話了:時域的卷積對應(yīng)頻域的相乘。這句話,或者說,這個概念,在很多應(yīng)用會得到充分的體現(xiàn),比如頻域均衡,比如信道估計,比如濾波分析等等。

2013-12-24 15:35:24 2245

2245 ▼關(guān)注公眾號: 工程師看海▼ ? 差分線是PCB設(shè)計中非常重要的一部分信號線,因此我們對差分信號的處理要求相當嚴謹。 (差分信號原理圖示) 差分信號 與 單端信號 的區(qū)別 單端信號 指的是

2023-09-05 08:46:52 1148

1148

簡 介: 根據(jù)信號與系統(tǒng)答疑過程中,學(xué)生對于三角形信號卷積結(jié)果的疑惑,給出了相應(yīng)的數(shù)值、理論、以及頻譜分析的解答。特別是后面頻譜分析部分也是由另外參加答疑的同學(xué)提出的。之所以這個題目會產(chǎn)生

2023-12-18 16:19:03 711

711

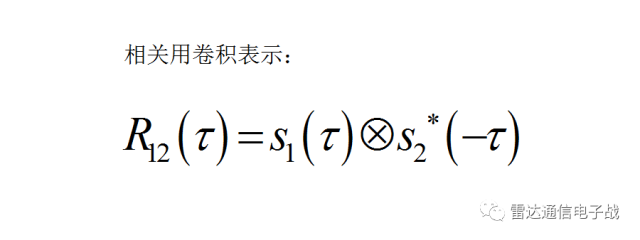

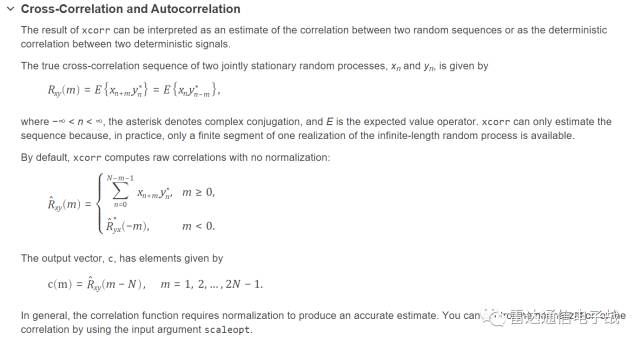

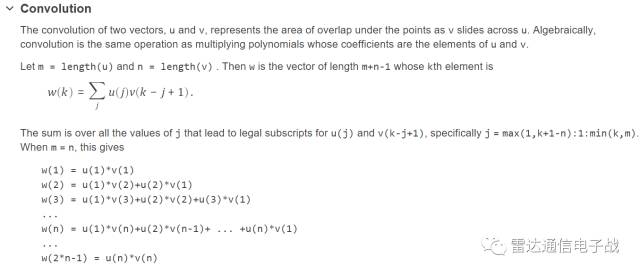

在信號處理、視覺處理或者其他工程/科學(xué)領(lǐng)域中應(yīng)用廣泛的技術(shù)。在深度學(xué)習(xí)中,有一種模型架構(gòu),叫做Convolution Neural Network。深度學(xué)習(xí)中的卷積本質(zhì)上就是信號處理中的Cross-correlation。當然,兩者之間也存在細微的差別。 在信號/圖像處理中,卷積定義如下: 由上公式可以看出,卷

2020-10-08 23:59:00 6426

6426

卷積特性(卷積定理).ppt

2017-10-03 23:09:02

卷積特性(卷積定理).zip

2017-10-04 11:36:30

的QPSK OFDM編碼光信號,并成功地在標準單模光纖中傳輸了200 km,和沒有采用卷積碼的相比,系統(tǒng)的誤碼性能獲得明顯提高。在誤碼率10-3時,可節(jié)省1 dBm左右的光功率。實驗結(jié)果表明,卷積碼可應(yīng)用

2010-04-23 11:30:18

。本文就以一維卷積神經(jīng)網(wǎng)絡(luò)為例談?wù)勗趺磥磉M一步優(yōu)化卷積神經(jīng)網(wǎng)絡(luò)使用的memory。文章(卷積神經(jīng)網(wǎng)絡(luò)中一維卷.

2021-12-23 06:16:40

卷積神經(jīng)網(wǎng)絡(luò)為什么適合圖像處理?

2022-09-08 10:23:10

網(wǎng)絡(luò) GhostNet。由于卷積神經(jīng)網(wǎng)絡(luò)的一系列突破性研究成果, 并根據(jù)不同的任務(wù)需求不斷改進,使其在目標檢測、 語義分割、自然語言處理等不同的任務(wù)中均獲得了 成功的應(yīng)用。基于以上認識,本文首先概括性

2022-08-02 10:39:39

復(fù)雜數(shù)據(jù)中提取特征的強大工具。例如,這包括音頻信號或圖像中的復(fù)雜模式識別。本文討論了 CNN 相對于經(jīng)典線性規(guī)劃的優(yōu)勢。后續(xù)文章“訓(xùn)練卷積神經(jīng)網(wǎng)絡(luò):什么是機器學(xué)習(xí)?——第2部分”將討論如何訓(xùn)練CNN

2023-02-23 20:11:10

過程則是:4*0 + 0*0 + 0*0 + 0*0 + 0*1 + 0*1 + 0*0 + 0*1 + -4*2 = -8圖像上的卷積在下圖對應(yīng)的計算過程中,輸入是一定區(qū)域大小(width*height

2018-10-17 10:15:50

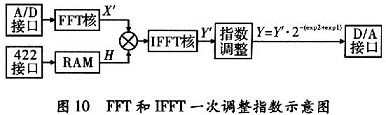

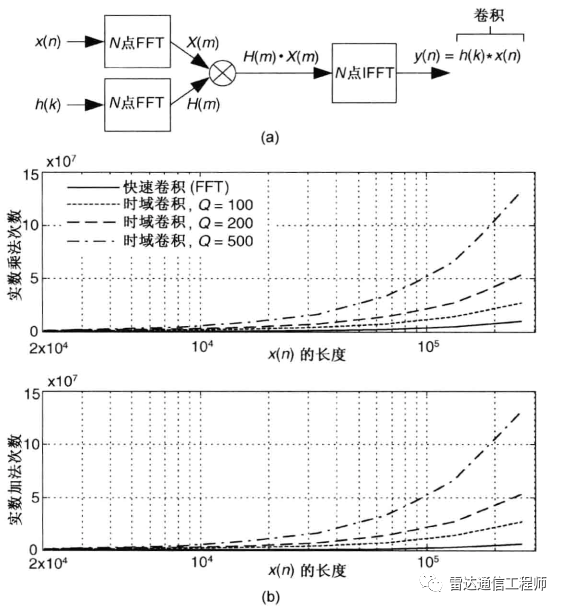

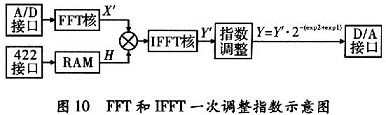

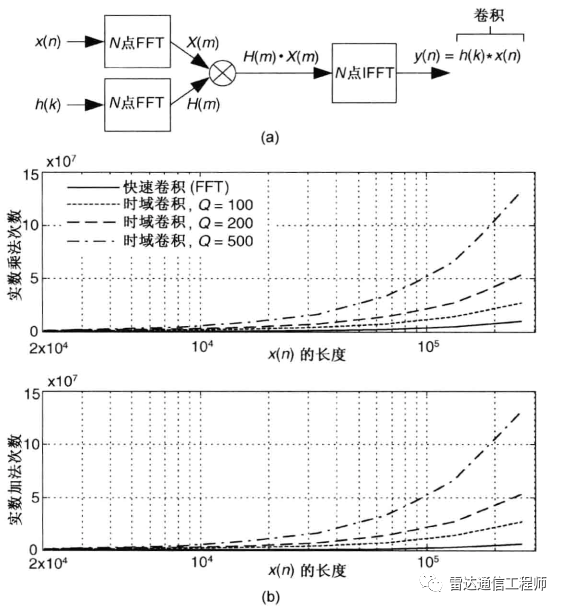

實現(xiàn)線性卷積的原理二 實驗內(nèi)容及要求1.對N=2048或4096點的離散時間信號x(n),試用Matlab語言編程分別以DFT和FFT計算N個頻率樣值X(k), 比較兩者所用時間的大小。 2.對N/2點

2011-12-29 21:52:49

. “信號處理實驗室”是由NI開發(fā),針對信號處理、信號與系統(tǒng)、通訊原理等課程量身訂做的課程套件,其中包括了卷積、混疊、窗函數(shù)分析、柵欄效應(yīng)、IIR、FIR、AM/FM調(diào)制、倒譜等等50多個從基礎(chǔ)到高級的信號處理知識點的演示程序。有

2014-09-01 21:31:41

額外 im2col 開銷? 在 Co 維度上進行向量化? Winograd:? 降低卷積計算量,常用于 3×3、5×5 的卷積? 減小卷積中的累加維度,增加額外的并行維度? 需要額外的前后轉(zhuǎn)換計算

2022-03-31 11:51:33

為什么要進行交織處理?大多數(shù)編碼都是基于信道差錯滿足統(tǒng)計獨立的特性設(shè)計的,但實際信道往往是突發(fā)錯誤和隨機錯誤并存的組合信道,在這些信道中直接使用糾隨機錯誤碼效果不好。另外,上面也講過,卷積碼經(jīng)過

2008-05-30 16:13:49

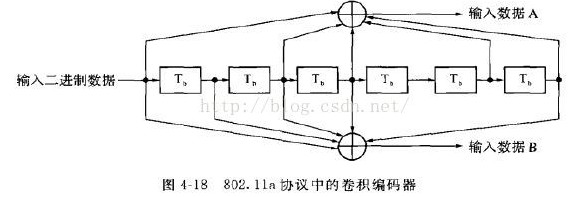

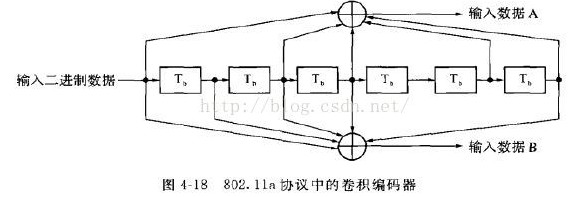

小。與分組碼不同,卷積碼編碼后的n 個碼元不僅與當前段的k 個信息元有關(guān),還與前面的N ?1段信息有關(guān),各碼字間不再是相互獨立的,碼字中互相關(guān)聯(lián)的碼元個數(shù)為n ? N 。同樣,在譯碼過程中不僅

2008-05-30 16:06:52

全連接神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

2019-06-06 14:21:42

本帖最后由 煒君子 于 2017-7-24 19:05 編輯

做了一個簡單的“卷積和相關(guān)分析模塊”,當信號均為低頻時,卷積、反卷積、自相關(guān)、互相關(guān)運算都很正常;但是當頻率達到10^4級

2017-07-24 19:05:04

反卷積deconvolution引起的棋盤效應(yīng)?kernel size無法被stride整除的原因?解決反卷積deconvolution存在的弊端的思路?反卷積deconvolution如何實現(xiàn)更好的采樣 ?

2020-11-04 08:08:00

。● 卷積神經(jīng)網(wǎng)絡(luò) (CNN)基于 DNN 的 KWS 的一大主要缺陷是無法為語音功能中的局域關(guān)聯(lián)性、時域關(guān)聯(lián)性、頻域關(guān)聯(lián)性建模。CNN 則可將輸入時域和頻域特征當作圖像處理,并且在上面執(zhí)行 2D

2021-07-26 09:46:37

本帖最后由 藍劍威 于 2017-5-29 14:31 編輯

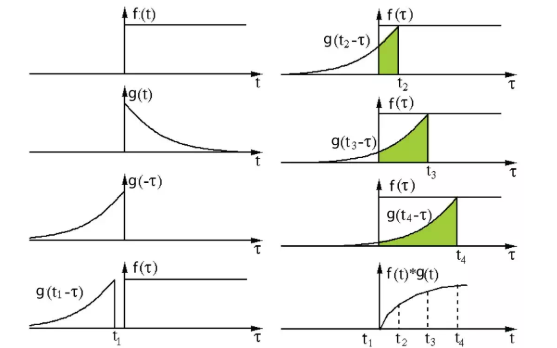

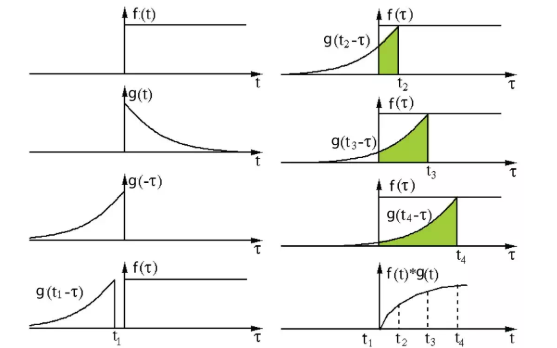

圖解卷積積分圖解卷積積分

2017-05-09 11:18:46

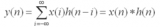

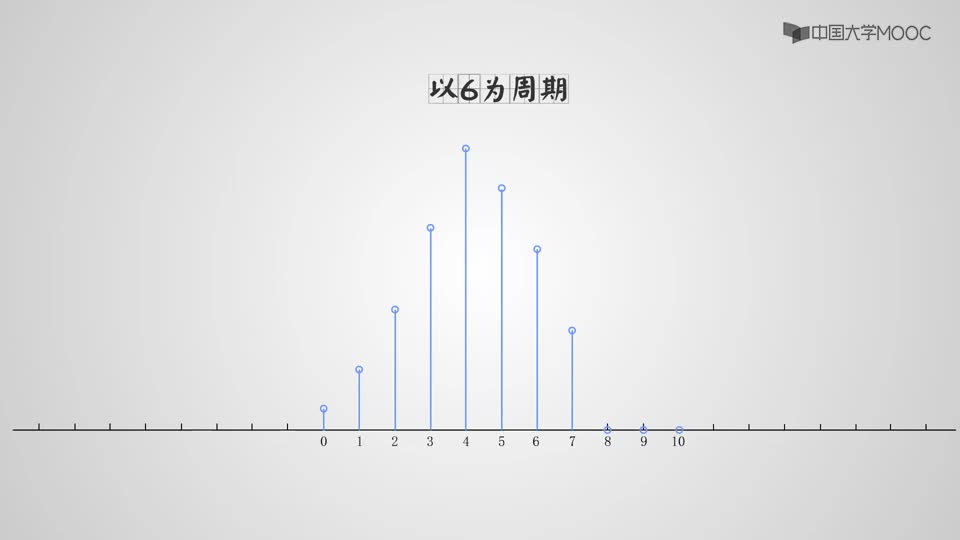

在數(shù)字信號處理領(lǐng)域,離散時間系統(tǒng)的輸出響應(yīng),可以直接由輸入信號與系統(tǒng)單位沖激響應(yīng)的離散卷積得到。離散卷積在電子通信領(lǐng)域應(yīng)用廣泛,是工程應(yīng)用的基礎(chǔ)。

2019-10-16 07:52:21

就是信號與系統(tǒng)里面的相關(guān)運算,比如卷積什么的可以用labview做嗎?

2013-03-09 14:33:51

的各個領(lǐng)域。采用INMOS公司的IMS A100級聯(lián)型信號處理器為模板,以FIR濾波器設(shè)計為核心,用FPGA技術(shù)開發(fā)設(shè)計級聯(lián)型信號處理器,能夠應(yīng)用于數(shù)字FIR濾波、高速自適應(yīng)濾波、相關(guān)和卷積、離散

2019-07-30 07:22:48

卷積層實現(xiàn)在上一篇文章中,我解釋了卷積層是對圖像的過濾過程,但是并沒有解釋輸入輸出通道如何處理,過濾時圖像的邊緣處理等。由于本文旨在實現(xiàn)層面的理解,因此我將詳細介紹這些要點。處理 I/O 通道在圖像

2023-02-24 15:41:16

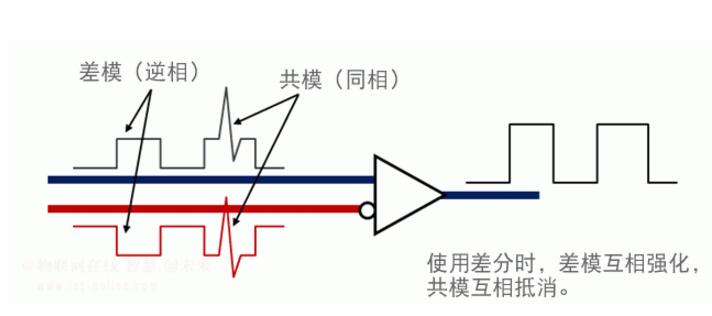

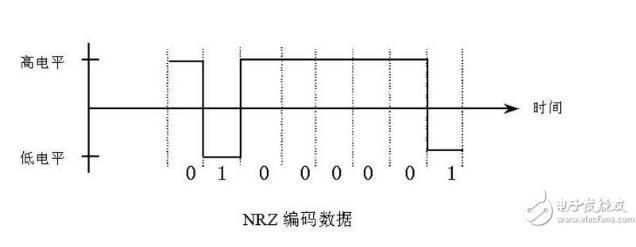

什么是差分信號差分信號與單端信號的區(qū)別差分信號的優(yōu)點差分信號在做pcb設(shè)計時的處理方法

2021-03-03 07:09:27

什么是差分信號差分信號與單端信號的區(qū)別差分信號的優(yōu)點差分信號在做pcb設(shè)計時的處理方法

2021-01-28 06:01:01

怎樣才能對示波器的兩個通道進行實時的反卷積,通道是混沌信號,求大神

2016-01-05 19:36:25

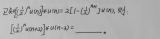

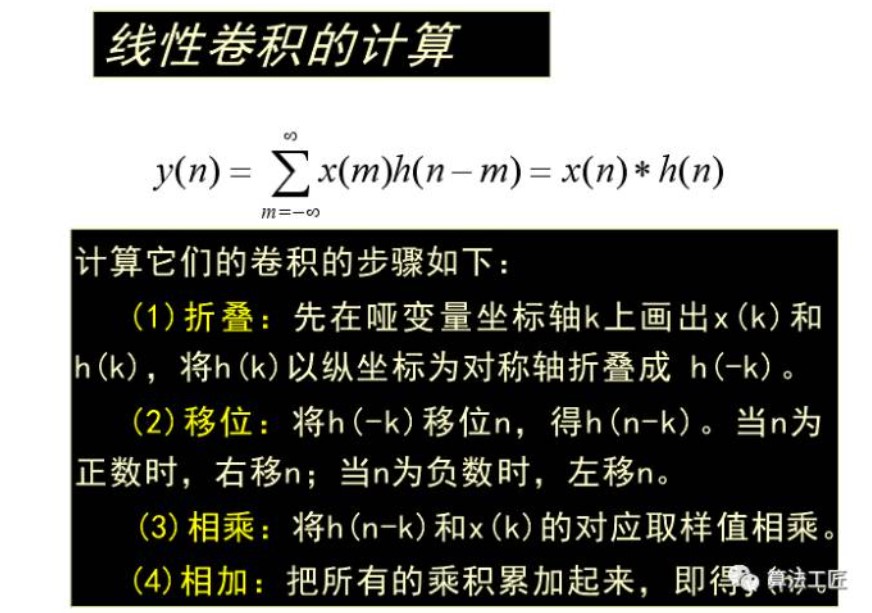

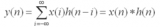

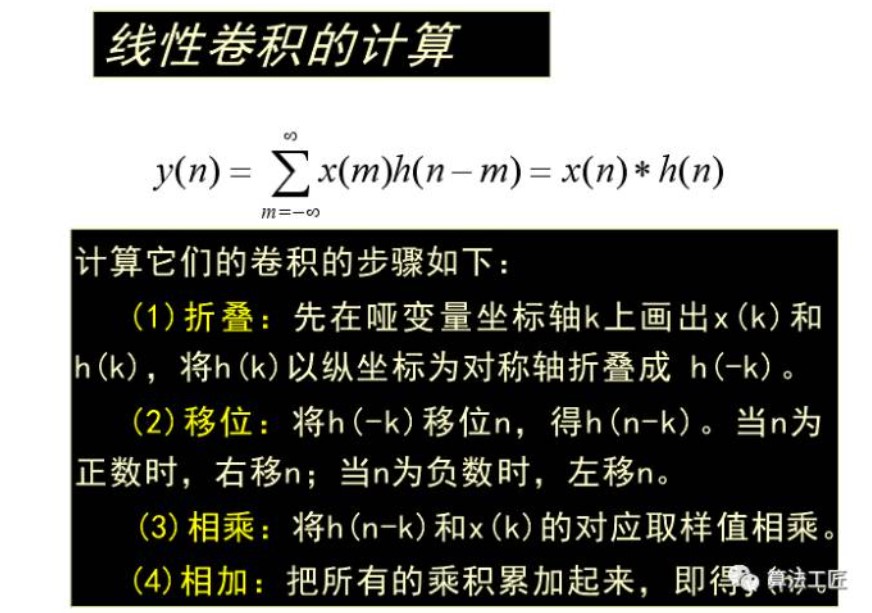

y(n) =x(n)* h(n)上式的運算關(guān)系稱為卷積運算,式中 代表兩個序列卷積運算。兩個序列的卷積是一個序列與另一個序列反褶后逐次移位乘積之和,故稱為離散卷積,也稱兩序列的線性卷積。其計算的過程

2012-10-31 22:29:00

振動信號的處理和預(yù)處理之間有什么區(qū)別?我用labview對振動信號進行預(yù)處理算處理嗎?

2014-10-08 15:33:19

與解調(diào)、反卷積、SVD、獨立分量分析及同太民濾波等)、平穩(wěn)隨機信號的基本概念、經(jīng)典功率譜估計、參數(shù)模型功率譜估計、數(shù)字信號處理中的有限字長問題及數(shù)字信號處理的硬件實現(xiàn)等內(nèi)容。書中介紹了數(shù)字信號處理中所

2023-09-19 08:01:36

版)》根據(jù)實際工程應(yīng)用和具體實例,詳細介紹了數(shù)字信號處理(DSP)領(lǐng)域內(nèi)的基本概念和相關(guān)技術(shù)。全書共分為14章,首先講解了DSP的基本概念及其應(yīng)用,并從實際的例子出發(fā),闡述了DSP的一些基本內(nèi)容,如信號

2013-10-28 12:36:05

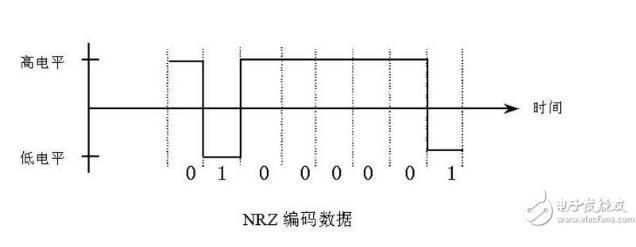

數(shù)字信號和模擬信號的區(qū)別詳解 很多人就不懂模擬信號和數(shù)字的信號的區(qū)別,數(shù)字信號和模擬信號都是一樣的傳輸方法。只是模擬信號是連續(xù)不斷的傳輸,數(shù)字信號是一直斷續(xù)的閃斷式傳輸。數(shù)字信號的這個名字主要

2017-06-05 16:54:38

工程中經(jīng)常會遇到某個輸入序列具有較長持續(xù)時間的情況,從而無法達到信號實時處理的要求。在這種情況下,分段卷積是一種有效的解決方案。本論文設(shè)計了分段卷積的快速算法模塊,分段卷積又可以用兩種方法實現(xiàn),即重疊

2012-12-25 13:43:20

Paserval定理成立就是保范映射(就是能量不變的映射)。

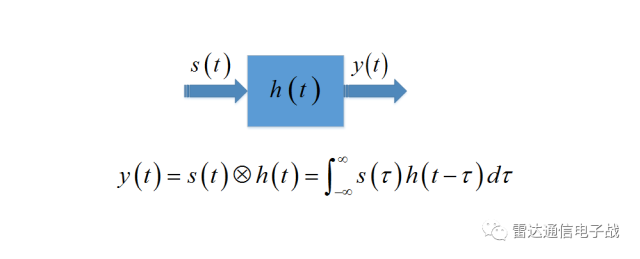

信號處理中如何出現(xiàn)卷積的。假設(shè)B是一個系統(tǒng),其t時刻的輸入為x(t),輸出為y(t),系統(tǒng)的響應(yīng)函數(shù)為h(t),按理說,輸出與輸入的關(guān)系應(yīng)該

2023-05-25 18:08:24

設(shè)計小Tips》全系列章節(jié): 1 信號與信息 2 數(shù)學(xué)到底有什么用?有多大用? 3 信號處理應(yīng)用所必須掌握的三大基石 4 最最常用的幾個信號,兼談信號與系統(tǒng) 5 卷積 6 相關(guān)和它的極其廣泛

2013-12-04 22:18:39

定理的分析過程中,起著非常重要的作用。用它可以表示連續(xù)信號的等間隔數(shù)字采樣過程,從而推導(dǎo)出了采樣速率不小于信號兩倍帶寬的重要結(jié)論。下期開講——精通信號處理設(shè)計小Tips(5):卷積,敬請關(guān)注!聲明:電子

2013-12-17 09:47:03

和觀察卷積公式,也許就沒有那么不直觀的感覺了。下期開講——精通信號處理設(shè)計小Tips(7):相關(guān)極其廣泛的應(yīng)用,敬請關(guān)注!聲明:電子發(fā)燒友網(wǎng)版權(quán)所有,謝絕轉(zhuǎn)載!`

2013-12-28 15:00:52

和觀察卷積公式,也許就沒有那么不直觀的感覺了。下期開講——精通信號處理設(shè)計小Tips(7):相關(guān)極其廣泛的應(yīng)用,敬請關(guān)注!聲明:電子發(fā)燒友網(wǎng)版權(quán)所有,謝絕轉(zhuǎn)載!往期回顧精通信號處理設(shè)計小Tips(1

2013-12-31 13:38:36

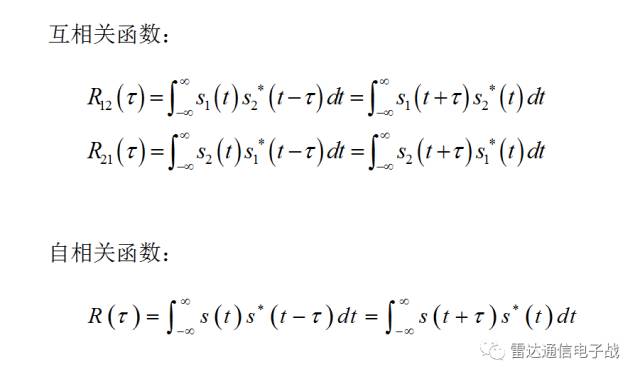

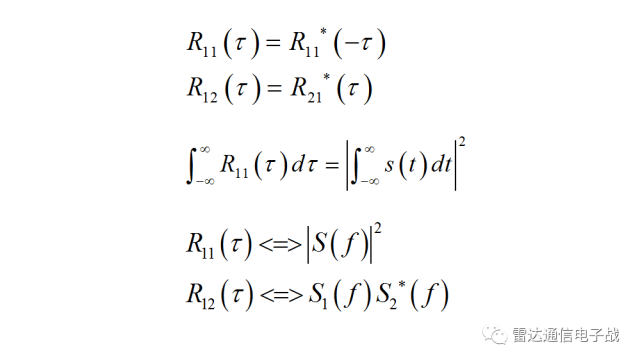

信號的相關(guān)函數(shù)與功率譜為一對傅立葉變換)。信號的相關(guān)矩陣更是很多信號處理算法研究、分析和處理的對象。相關(guān)不僅是一個非常有理論價值的概念,而且是一個在實踐中應(yīng)用極為廣泛的處理方法和有效的處理手段。在通信

2013-12-31 13:39:17

《數(shù)字信號處理》要做課程設(shè)計,題目是:線性卷積在DSP芯片上的實現(xiàn)。要求:給出算法原理,寫出主程序。

2011-10-08 16:12:58

數(shù)字信號處理C語言程序集內(nèi)容有數(shù)字信號的產(chǎn)生,快速傅立葉變換,快速離散正交變換,快速卷積與相關(guān),數(shù)字濾波的時域和頻域響應(yīng),IIR數(shù)字濾波器的設(shè)計等內(nèi)容。

2008-10-30 10:51:23 98

98 定點數(shù)字信號處理器(DSP)技術(shù)與應(yīng)用

數(shù)字信號處理器(DSP)的應(yīng)用領(lǐng)域•通用數(shù)字信號處理(數(shù)字濾波、卷積、相關(guān)、變換等)•通信(高效調(diào)制/解調(diào)、編/解碼

2010-04-07 10:30:36 23

23 基站側(cè)信號處理,比如交織、復(fù)用后同原來相比什么區(qū)別

基站信號處理,發(fā)射方向的信號處理過程有編碼、擴頻和調(diào)制。編碼包括:對M

2009-06-15 09:48:12 1311

1311 卷積碼,卷積碼是什么意思

卷積碼在一個二進制分組碼(n,k)當中,包含k個信息位,碼組長度為n,每個碼組的(n-k)個校驗位僅與本碼組的k個信息

2010-03-19 16:46:24 1656

1656 卷積碼,什么是卷積碼

卷積碼在一個二進制分組碼(n,k)當中,包含k個信息位,碼組長度為n,每個碼組的(n-k)個校驗位僅與本碼組的k個信息位

2010-04-03 12:11:06 6923

6923 在數(shù)字信號處理領(lǐng)域,離散時間系統(tǒng)的輸出響應(yīng),可以直接由輸入信號與系統(tǒng)單位沖激響應(yīng)的離散卷積得到。離散卷積在電子通信領(lǐng)域應(yīng)用廣泛,是工程應(yīng)用的基礎(chǔ)。如果直

2010-12-02 10:46:34 4601

4601

模擬電子的相關(guān)知識學(xué)習(xí)教材資料——數(shù)字信號與模擬信號的區(qū)別

2016-09-20 16:10:29 0

0 卷積的定義 卷積是兩個變量在某范圍內(nèi)相乘后求和的結(jié)果。 如果卷積的變量是序列x(n)和h(n),則卷積的結(jié)果 ,其中星號*表示卷積。 當時序n=0時,序列h(-i)是h(i)的時序i取反的結(jié)果;時序

2017-11-28 17:54:53 154025

154025

針對現(xiàn)有的時域模態(tài)參數(shù)識別方法大多存在難定階和抗噪性差的問題,提出一種無監(jiān)督學(xué)習(xí)的卷積神經(jīng)網(wǎng)絡(luò)(CNN)的振動信號模態(tài)識別方法。該算法在卷積神經(jīng)網(wǎng)絡(luò)的基礎(chǔ)上進行改進。首先,將應(yīng)用于二維圖像處理的卷積

2017-12-05 14:39:13 5

5 卷積特性(卷積定理)

2017-12-06 14:28:42 0

0 目前DSP和EDA兩者都應(yīng)用廣泛,二者之間有什么不同呢?本文帶來數(shù)字信號處理器DSP與EDA的區(qū)別介紹。

2018-01-03 10:33:19 5824

5824 本文開始闡述了電平信號什么意思以及電平信號的產(chǎn)生,其次對TTL電平的相關(guān)定義進行了介紹,最后闡述了電平信號和脈沖信號區(qū)別以及闡述了電平和電壓的區(qū)別。

2018-03-13 10:02:07 67341

67341

本文開始闡述了什么叫共模信號,其次介紹了共模信號產(chǎn)生的原因共模信號主權(quán),最后介紹了共模和差模兩只之間的區(qū)別。

2018-03-19 17:12:46 132575

132575

由于計算機視覺的大紅大紫,二維卷積的用處范圍最廣。因此本文首先介紹二維卷積,之后再介紹一維卷積與三維卷積的具體流程,并描述其各自的具體應(yīng)用。

2018-05-08 10:29:00 4150

4150

圖像處理中濾波和卷積是常用到的操作。兩者在原理上相似,但是在實現(xiàn)的細節(jié)上存在一些區(qū)別。這篇博文主要敘述這兩者之間的區(qū)別。

2018-07-09 10:30:37 7331

7331

卷積編碼是現(xiàn)代數(shù)字通信系統(tǒng)中常見的一種前向糾錯碼,區(qū)別于常規(guī)的線性分組碼,卷積編碼的碼字輸出不僅與當前時刻的信息符號輸入有關(guān),還與之前輸入的信息符號有關(guān)。

2018-08-21 10:26:04 7945

7945

卷積碼是1955年由Elias等人提出的,是一種非常有前途的編碼方法。

2018-08-21 11:07:25 29023

29023

在數(shù)字信號處理當中,常用到了運算內(nèi)容有:卷積運算、差分方程計算、功率譜密度計算、復(fù)頻率變換及模數(shù)和數(shù)值轉(zhuǎn)換、矩陣運算、對數(shù)指數(shù)運算、相關(guān)系數(shù)運算、離散傅里葉變換計算等運算內(nèi)容。事實上,很多的數(shù)字信號處理當中的問題,都可以使用這些或還有其他相關(guān)的運算,通過適當進行組合來實現(xiàn)。

2018-10-29 10:23:56 7269

7269 為提高分層卷積相關(guān)濾波視覺跟蹤算法的實時性能,提出一種稀疏卷積特征的實時目標跟蹤算法。首先,在分析不同層卷積特征的基礎(chǔ)上,采用等間隔采樣的方式提取每個卷積層的稀疏卷積特征;然后,對每個卷積層特征

2019-01-17 15:12:44 1

1 在信號處理、圖像處理和其它工程/科學(xué)領(lǐng)域,卷積都是一種使用廣泛的技術(shù)。在深度學(xué)習(xí)領(lǐng)域,卷積神經(jīng)網(wǎng)絡(luò)(CNN)這種模型架構(gòu)就得名于這種技術(shù)。但是,深度學(xué)習(xí)領(lǐng)域的卷積本質(zhì)上是信號/圖像處理領(lǐng)域內(nèi)的互相關(guān)(cross-correlation)。這兩種操作之間存在細微的差別。

2019-02-26 10:01:05 3093

3093

大家好,之前有文章說到信號處理,說到卷積,那今天咱們來聊一聊卷積。關(guān)于卷積,之前在大學(xué)時候?qū)W信號與系統(tǒng)的時候就感覺理解的不是很深刻,我于是心想一定要把卷積完全搞明白。經(jīng)過一段時間的思考之后,有一些

2019-11-01 17:35:48 4089

4089 本文檔的主要內(nèi)容詳細介紹的是數(shù)字信號處理教程之卷積與濾波的詳細課件說明包括了:1 卷積基礎(chǔ),2 差分方程與卷積,3 滑動平均濾波器

2019-11-13 14:48:11 19

19 差分線是PCB設(shè)計中非常重要的一部分信號線,信號處理要求也是相當嚴謹,今天為大家介紹下差分信號的原理以及其在PCB設(shè)計中的處理方法。 什么是差分信號 差分傳輸是一種信號傳輸?shù)募夹g(shù),區(qū)別于傳統(tǒng)的一根

2020-03-09 09:54:38 1741

1741

因此,實際上, 都是要根據(jù)我們需要待處理的信號形式, 來設(shè)計所謂的系統(tǒng)傳遞函數(shù),那么這個系統(tǒng)的傳遞函數(shù)和輸入信號,在數(shù)學(xué)上的形式就是所謂的卷積關(guān)系。卷積關(guān)系最重要的一種情況,就是在信號與線性系統(tǒng)

2020-08-14 15:54:00 12

12 卷積是將兩個信號組合成第三個信號的數(shù)學(xué)方法。它是數(shù)字信號處理中最重要的技術(shù)之一。利用脈沖分解策略,系統(tǒng)由一個稱為脈沖響應(yīng)的信號來描述,卷積是很重要的,因為它涉及三個感興趣的信號:輸入信號、輸出信號

2020-10-21 17:40:57 6

6 電子發(fā)燒友網(wǎng)為你提供信號處理繞不過去的坎:相關(guān)與卷積資料下載的電子資料下載,更有其他相關(guān)的電路圖、源代碼、課件教程、中文資料、英文資料、參考設(shè)計、用戶指南、解決方案等資料,希望可以幫助到廣大的電子工程師們。

2021-04-19 08:46:00 6

6 卷積計算的效率。基于軟硬件協(xié)同設(shè)計思想,構(gòu)建包含RISCⅤ處理器和卷積加速器的SoC系統(tǒng),RISC-V處理器基于開源的指令集標準,可以根據(jù)具體的設(shè)計需求擴展指令功能。將該SoC系統(tǒng)部署在 Xilinx ZCU102開發(fā)板上ISC-V處理器和卷積加速器分別工作在100M

2021-06-02 15:08:22 29

29 “卷積”是信號與系統(tǒng)時域分析中的一個重要內(nèi)容。本文對此知識點進行了詳細的分析和總結(jié),并給出了多道例題及詳細解答。 (一)常用信號的卷積表 首先,將常用信號的卷積、以及卷積的性質(zhì)整理成表格,這些信號

2021-09-29 17:28:14 30863

30863

本文首發(fā)于 GiantPandaCV :深入理解神經(jīng)網(wǎng)絡(luò)中的反(轉(zhuǎn)置)卷積作者:梁德澎本文主要是把之前在知乎上的回答:反卷積和上采樣+卷積的區(qū)別...

2022-02-07 11:17:57 0

0 在泛函分析中,卷積、旋積或摺積(英語:Convolution)是通過兩個函數(shù)f 和g 生成第三個函數(shù)的一種數(shù)學(xué)算子,表征函數(shù)f 與g經(jīng)過翻轉(zhuǎn)和平移的重疊部分的面積。

2022-10-14 09:04:26 1105

1105

從技術(shù)上講,信號處理中的去卷積是卷積運算的逆運算。但這里卻不是這種運算。因此,某些作者強烈反對將轉(zhuǎn)置卷積稱為去卷積。

2023-07-01 10:24:32 491

491

信號與系統(tǒng)基礎(chǔ)之卷積定理:頻域乘積相當于時域卷積,千萬不要問我什么,可以去看看教材上的公式推導(dǎo)。

2023-07-04 11:42:18 1440

1440

卷積神經(jīng)網(wǎng)絡(luò)的應(yīng)用 卷積神經(jīng)網(wǎng)絡(luò)通常用來處理什么 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,簡稱CNN)是一種在神經(jīng)網(wǎng)絡(luò)領(lǐng)域內(nèi)廣泛應(yīng)用的神經(jīng)網(wǎng)絡(luò)模型。相較于傳統(tǒng)

2023-08-21 16:41:45 3484

3484 和高效的處理方式,CNN已經(jīng)成為圖像識別、語音識別和自然語言處理等領(lǐng)域中的優(yōu)選技術(shù)。CNN對于處理基于網(wǎng)格結(jié)構(gòu)的數(shù)據(jù)具有天然的優(yōu)勢,因此在處理圖像和視頻等視覺數(shù)據(jù)時,具有獨特的優(yōu)越性能。 CNN的特點 1. 卷積操作:CNN最重要的操作是卷積操作,這也是CNN得名的來源。CNN的卷積操

2023-08-21 16:41:48 1659

1659 、視頻等信號數(shù)據(jù)的處理和分析。卷積神經(jīng)網(wǎng)絡(luò)就是一種處理具有類似網(wǎng)格結(jié)構(gòu)的數(shù)據(jù)的神經(jīng)網(wǎng)絡(luò),其中每個單元只處理與之直接相連的神經(jīng)元的信息。本文將對卷積神經(jīng)網(wǎng)絡(luò)的模型以及包括的層進行詳細介紹。 卷積神經(jīng)網(wǎng)絡(luò)模型 卷積神經(jīng)網(wǎng)絡(luò)模型主要包括以下幾個部分: 輸入層:輸

2023-08-21 16:41:52 1305

1305 是一種基于圖像處理的神經(jīng)網(wǎng)絡(luò),它模仿人類視覺結(jié)構(gòu)中的神經(jīng)元組成,對圖像進行處理和學(xué)習(xí)。在圖像處理中,通常將圖像看作是二維矩陣,即每個像素點都有其對應(yīng)的坐標和像素值。卷積神經(jīng)網(wǎng)絡(luò)采用卷積操作實現(xiàn)圖像的特征提取,具有“局部感知”的特點。 從直覺上理解,卷積神

2023-08-21 16:49:32 3045

3045 卷積神經(jīng)網(wǎng)絡(luò)層級結(jié)構(gòu) 卷積神經(jīng)網(wǎng)絡(luò)的卷積層講解 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)是一種基于深度學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò)模型,在許多視覺相關(guān)的任務(wù)中表現(xiàn)出色,如圖

2023-08-21 16:49:42 3757

3757 的深度學(xué)習(xí)算法。CNN模型最早被提出是為了處理圖像,其模型結(jié)構(gòu)中包含卷積層、池化層和全連接層等關(guān)鍵技術(shù),經(jīng)過多個卷積層和池化層的處理,CNN可以提取出圖像中的特征信息,從而對圖像進行分類。 一、卷積神經(jīng)網(wǎng)絡(luò)算法 卷積神經(jīng)網(wǎng)絡(luò)算法最早起源于圖像處理領(lǐng)域。它是一種深

2023-08-21 16:49:46 1229

1229 卷積神經(jīng)網(wǎng)絡(luò)主要包括哪些 卷積神經(jīng)網(wǎng)絡(luò)組成部分 卷積神經(jīng)網(wǎng)絡(luò)(CNN)是一類廣泛應(yīng)用于計算機視覺、自然語言處理等領(lǐng)域的人工神經(jīng)網(wǎng)絡(luò)。它具有良好的空間特征學(xué)習(xí)能力,能夠處理具有二維或三維形狀的輸入數(shù)據(jù)

2023-08-21 17:15:22 936

936 時鐘信號和脈沖信號有區(qū)別嗎? 時鐘信號和脈沖信號雖然在某些方面可能有相似之處,但它們在本質(zhì)上是不同的。本文將深入探討這兩種信號的特點、應(yīng)用和區(qū)別。 1.時鐘信號 時鐘信號是一種用于同步處理

2023-09-15 16:28:12 1767

1767 數(shù)字信號處理系列課程(信號與系統(tǒng)——數(shù)字信號處理——隨機信號分析——現(xiàn)代數(shù)字信號處理)輔導(dǎo),鞏固基礎(chǔ)與進一步提高相結(jié)合。

2023-11-14 10:53:16 218

218

數(shù)字信號處理與信號與系統(tǒng)是兩個很重要的概念。雖然它們都涉及到信號的處理和分析,但在很多方面有著不同的特點和應(yīng)用。本文將詳細探討數(shù)字信號處理與信號與系統(tǒng)的區(qū)別。 首先,讓我們來了解一下信號與系統(tǒng)的概念

2024-01-18 09:30:47 636

636

電子發(fā)燒友App

電子發(fā)燒友App

評論