從主機廠的自動駕駛技術搭載情況來看,其感知技術方案大致可分為兩類:一種是基于視覺的自動駕駛系統,另一種是基于雷達+視覺的自動駕駛系統。后者主要使用雷達傳感器來檢測物體,而視覺系統則完全基于攝像頭。從當初傳統的tier1(如博世、大陸等)傾向于搭載簡單低成本的毫米波雷達系統用于實現基礎的輔助駕駛功能。而諸如特斯拉這類高尖端的主機廠更是從最初的視覺方案到后面引入雷達傳感器,再到放棄雷達回歸純視覺方案,經歷了多次反復。包括國內很多主機廠也將很大程度的研發精力放在了對視覺感知上。通過利用計算機視覺系統檢測、識別物體,利用不同的神經網絡模型檢測不同的對象模型,一旦判斷失誤,就會導致事故。基于視覺的自動駕駛系統需要強大的軟件算法能力,以及大量數據對AI模型的長期訓練。這顯然不是一朝一夕可以實現的。

然而,除了感知軟件這一難題外,我們對于感知前端的攝像頭硬件模組又了解多少呢?本文將系統的介紹攝像頭前端感知模組的相關技術參數及評價指標。

攝像頭模組相關選型介紹

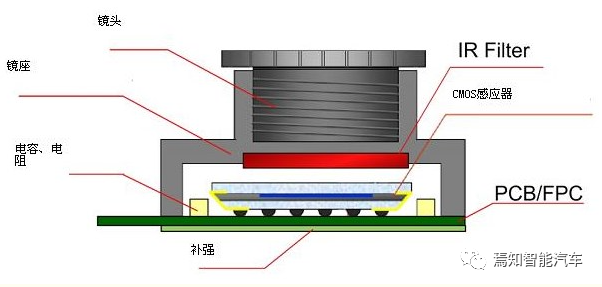

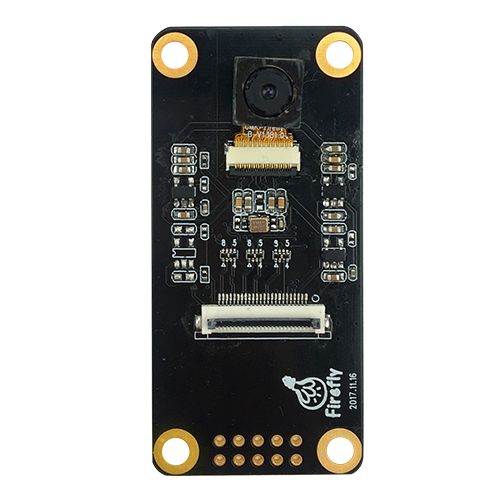

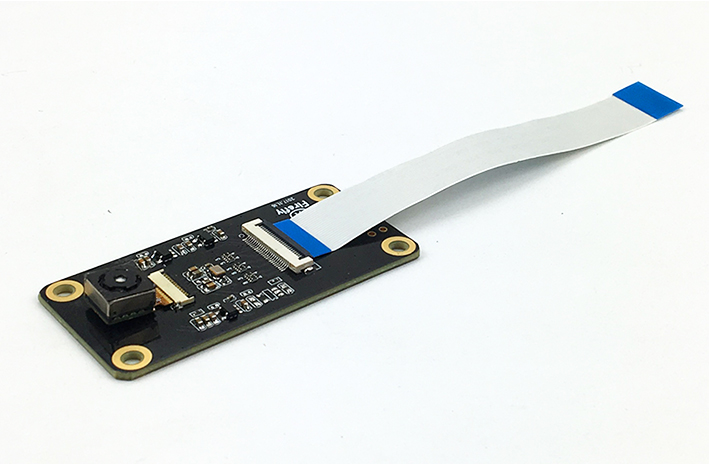

攝像頭模組CCM主要由鏡頭(lens)、鏡座、紅外濾光片(IR Filter)、傳感器(Sensor)、PCB板、FPC柔性電路板等結構組成,是影像捕捉至關重要的電子器件。

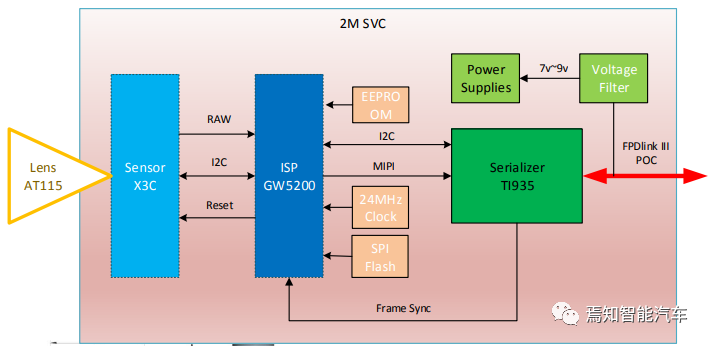

基本原理是通過外部光線照射在物體上,經過反射、折射后穿過鏡頭(Lens),再經過濾光片濾波投射到圖像傳感器(Sensor)感光面上。其基礎原理是通過Sensor將Lens上傳導過來的光線轉換為電信號,經過內部圖像處理器(ISP)轉換成數字圖像信號輸出到數字信號處理器(DSP)加工處理,轉換成標準的GRB、YUV等格式圖像信號。若Sensor內部未集成ISP,則通過DVP的方式傳輸到圖像處理器,此時的數據格式為RAW RGB(原始數據)。

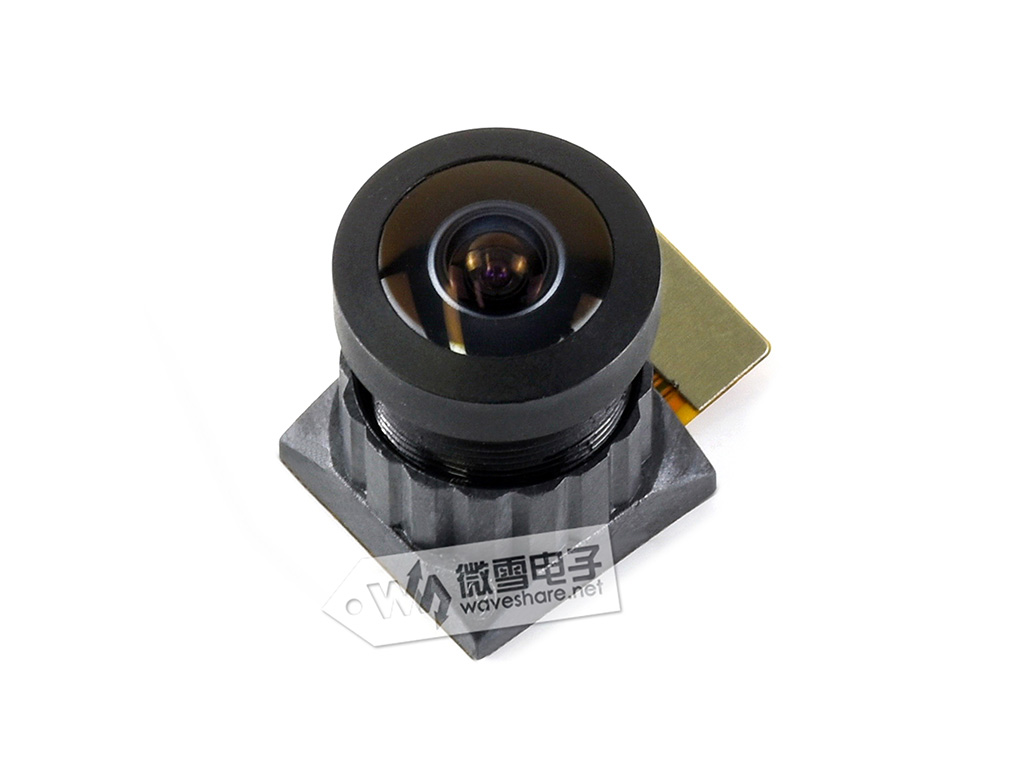

1)鏡頭(lens)

鏡頭相當于人眼中的晶狀體,利用透鏡的折射原理,景物光線透過鏡頭在聚焦平面上形成清晰的像。Camera的鏡頭結構一般是有幾片透鏡組成的,透鏡分為塑膠透鏡(Plastic)以及玻璃透鏡(Glass),常用的鏡頭結構有:1P、2P、1G1P、1G3P、2G2P等。

透鏡越多,成本越高,成像效果也越好(光線更均勻、更細致;對光線的選通更豐富;成像畸變更小,但是會導致鏡頭變長,光通量變小),玻璃透鏡的透光率、感光性比塑膠透鏡的要好,但價格也更貴。

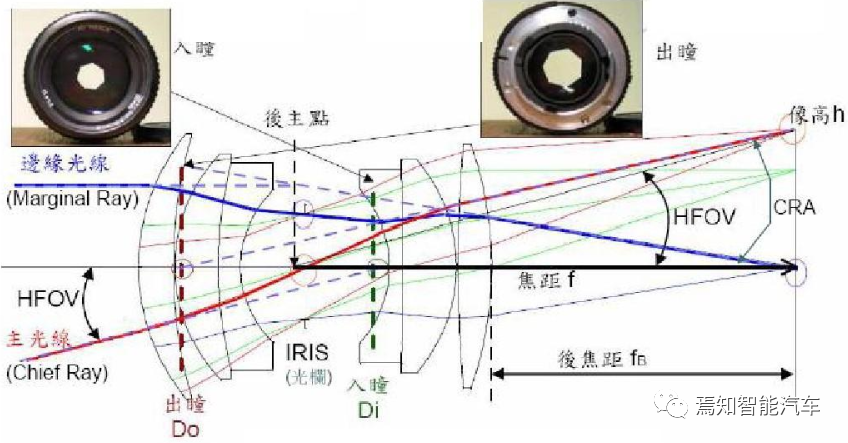

鏡頭的關鍵指標就是鏡頭的焦距,通常根據鏡頭焦距的不同,進行不同的分類。鏡頭的焦距決定了該鏡頭拍攝的物體在Sensor上所形成影像的大小,焦距越短,拍攝范圍就越大,也就越接近廣角鏡頭;焦距越長,鏡頭的視角越小,拍攝到景物的范圍也就越小,也就越接近窄角攝像頭。通常會把短焦距、視場角大于50°(如f=3mm左右)的鏡頭,稱為廣角鏡頭,如前視120°攝像頭;把更短焦距(如f=2.8mm)的鏡頭叫走超廣角鏡頭,如環視攝像頭;而把焦距很長(如f>80mm)的鏡頭稱為望遠鏡頭,如智駕域經常用到的30°遠攝攝像頭。介于短焦與長焦之間的鏡頭就叫做標準鏡頭,如智駕域的側視攝像頭。

鏡頭的焦距、視場大小及鏡頭到被攝取物體的距離計算公式如下:

f?= w*D / W????? f = h*D / H

其中:f—鏡頭焦距,w—圖像的寬度(被攝物體在Sensor靶面上的成像寬度),W—被攝物體寬度,D—被攝物體距離鏡頭的距離,h—圖像高度(被攝物體在Sensor靶面上的成像高度),H—被攝物體的高度。

鏡頭尺寸

一般可分為25.4mm(1inch)、16.9mm(2/3inch) 、12.7mm(1/2inch) 、 8.47mm(1/3inch)和 6.35mm(1/4inch)等幾種規格 。選用鏡頭時,應使鏡頭尺寸與攝像機的靶面尺寸大小相吻合,并注意這樣一個原則,即小尺寸靶面的圖像Sensor可使用大尺寸的鏡頭,反之則不行。如1/2”的Sensor采用1/3”的鏡頭,則進光量會變小,色彩會變差,甚至圖像也會缺損;反之,則進光量會變大,色彩會變好。

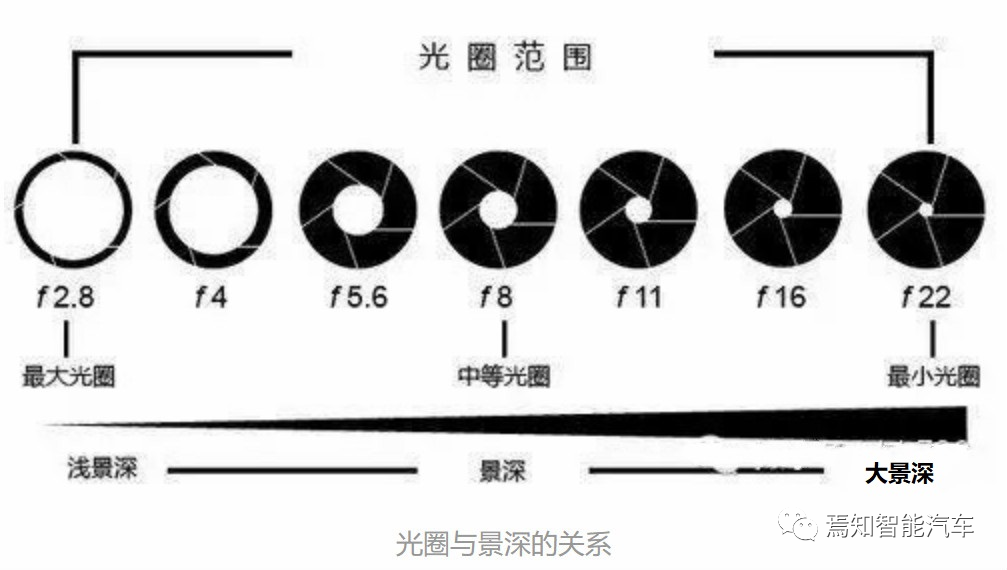

此外,我們還比較關心的是鏡頭通光孔徑大小對鏡頭的影響。通常,通光孔徑越大,通過的光量越大,但我們關心的是到達Sensor的光量。焦距越長,意味著Sensor離鏡頭中心越遠,相應的光就越弱,所以,標準光圈大小的參數應該與兩個變量有關:即孔徑,焦距。

可以定義光圈的相對孔徑等于鏡頭的有效孔徑與鏡頭焦距之比,鏡頭的相對孔徑表征了鏡頭的通光能力,相對孔徑越大,通光越多。

光圈系數F = 焦距(f) / 鏡頭有效孔徑 (D)

光圈相對孔徑 = 鏡頭有效孔徑 (D)? /? 焦距(f)

即F = 1 / 光圈相對孔徑

所以,選用相對孔徑大的鏡頭,可以降低對景物照明條件的要求。

最后,對于攝像頭來說,主要還涉及到相關的鏡頭接口。常規的接口鏡頭主要包括 C接口鏡頭(C-Mount)與CS(CS-Mount)接口鏡頭。兩者最明顯的區別就是鏡頭與攝像機接觸至攝像機感光元器件(CCD/COMS傳感器)的位置(焦平面)的距離不同。這個距離專業的術語叫做法蘭焦距。C接口的法蘭焦距為17.5mm,CS接口的法蘭焦距為12.5mm。在鏡頭的使用過程中,通常是C型標準攝像機接C接口鏡頭,CS鏡頭接CS型攝像機。但是在使用的過程中C接口鏡頭可以加裝一個5mm厚的延長環與CS型攝像機搭配使用,C接口鏡頭不加延長圈則會導致鏡頭碰到傳感器靶面,造成傳感器損壞。CS型鏡頭與C型攝像機無法配合,CS鏡頭與C型攝像機不能組合使用的原因是鏡頭成像面與CCD受光面距離太遠,不能得到聚焦的圖像。

2)紅外濾光片(IR Filter)

紅外濾光片的主要作用是透過人眼可見光波段(380~700nm),濾除掉入鏡頭中的紅外光,這是因為人眼看不到紅外光,但是sensor卻能感受到紅外光,所以需要將光線中的紅外光濾掉,防止Sensor產生偏色、波紋,以提高色彩還原度,使圖像更接近人眼看到的效果。但對于夜視系統,Sensor需要接收物體發出或反射的紅外光線進行成像,此時鏡頭模組中就不需要紅外濾光片了。

3)圖像傳感器(Sensor)

Sensor是攝像頭的核心,負責將通過Lens的光信號轉換為電信號,再經過內部AD轉換為數字信號。每個pixel像素點只能感受R、G、B中的一種,因此每個像素點中存放的數據是單色光,所以我們智駕系統常用的200萬像素或者800萬像素,表示的就是有200萬或800萬個感光點,每個感光點只能感應一種光,這些最原始的感光數據也就是我們常常叫做的RAW Data。

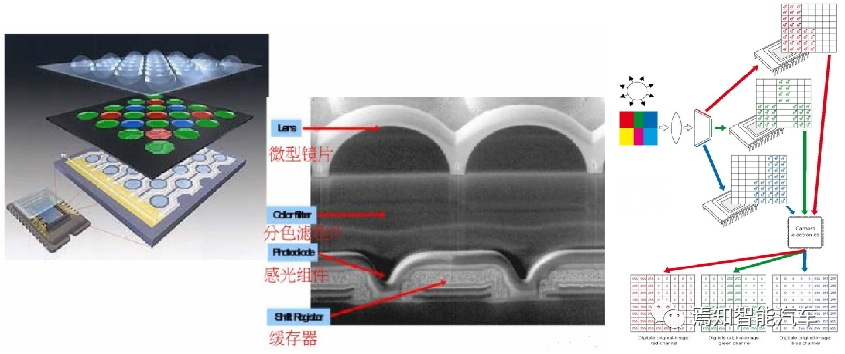

圖像傳感器的像素單元都分為四部分:微透鏡、濾色片、感光片(光電二極管)、電荷存儲區。光線照射到Sensor感光組件(光電二極管)上,光強就轉換為電荷,并緩存于電荷存儲區。

目前的Sensor有兩種基本的類型:

CCD傳感器:

電荷耦合器件傳感器:使用一種高感光度的半導體材料制成,能把光線轉變成電荷,通過模數轉換器芯片轉換成電信號。CCD由許多獨立的感光單位組成,通常以百萬像素為單位。當CCD表面受到光照時,每個感光單位都會將電荷反映在組件上,所有的感光單位產生的信號加在一起,就構成了一幅完整的圖像。

CMOS傳感器:

互補性氧化金屬半導體:主要是利用硅和鍺做成的半導體,使其在CMOS上共存著帶N(-)和P(+)級的半導體,這兩個互補效應所產生的電流可以被處理芯片記錄并解讀成影像。

由于結構原因,CCD Sensor只有一個ADC;而CMOS sensor有一行的ADC。這樣在數據輸出上,CMOS可以做到很高的幀率,而CCD卻很難做到高像素和高幀率。

由此,在面向智駕系統更高幀率和高分辨率的前提下,對CMOS應用場景將越來越大。我們在對傳感器Sensor選型過程中通常需要考慮如下幾個重要參數:

| 參數 | 說明 |

| 傳感器尺寸 | 尺寸越大,則捕獲光子越多,感光性能越好,信噪比越低。常見有1inch、2/3inch、1/2inch、1/3inch、1/4inch等。 |

| 有效像素 | 有效像素陣列是指在sensor的水平H和垂直V方向上,分別含有的有效像素點的個數,很多時候,并不是所有感應器上的像素都能被運用。通常其余部分被用來表示黑色,H與V的乘積一般等于或大于分辨率數值。 |

| 動態范圍 | 為輸出信號峰值電壓與均方根噪聲電壓之比,用dB表示,表征Sensor在一幅圖像里面能夠同時體現高光和陰影部分內容的能力。 |

| 靈敏度 | Sensor被光均勻的照射時,當照度是1LUX(勒克斯:照度單位)時,在1s內,光電轉換器所能達到的電壓幅值的最大值。 |

| 分辨率 | Sensor分辨率即指在單位面積上,像素的個數,數值越大,則代表像素點越多,捕獲的圖像細節越多,或者說圖像更清晰。 |

| 信噪比 | 即信號和噪聲的比例,反映了Sensor抑制噪聲的能力,單位一般是dB,數值越大,說明Sensor抑制噪聲的能力越強。 |

| 光譜響應特性 | 信號電壓Vs、信號電流Is為入射光波長的函數,該特性反應了傳感器的響應能力隨波長的變化關系,決定了Sensor的光譜范圍。 |

?

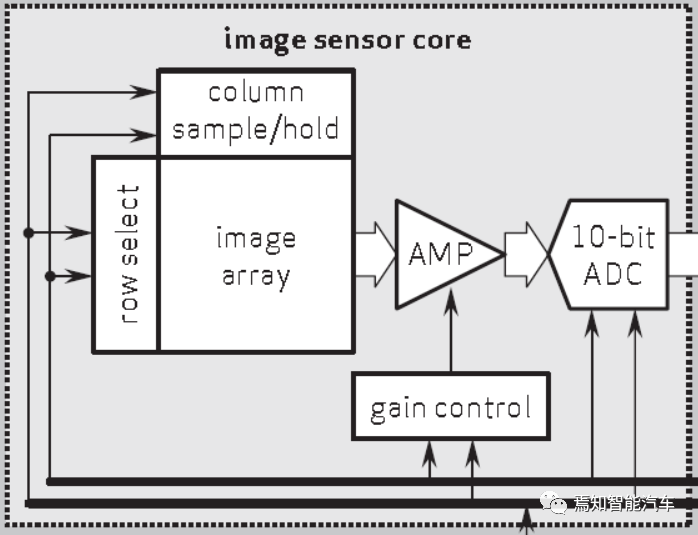

4)傳感器核心

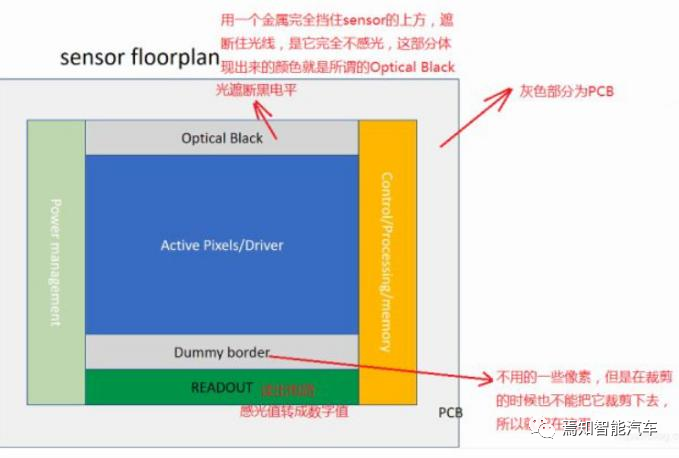

典型的圖像傳感器核心主要由image array(圖像陣列)、AMP放大器)以及ADC組成。其中圖像陣列Image array是模擬電路,很難做到很先進的工藝,比如40nm這種水平,而且并不是工藝越先進越好(要保證像素感光面的大小)。但是sensor的數字部分(比如內部的圖像處理和接口邏輯)是純數字邏輯,這部分卻可以做到很先進的工藝比如16nm。 ? 如下圖a)表示了一個典型的sensor的版圖如下: ?

?

? 像素陣列可以分為Optical Black(光學黑體)區域、Active Pixel(有效像素)區域以及Dummy boarder(虛擬邊界)區域。 ? 一般一個sensor的圖像陣列點數會大于實際成像的圖像。比如一個1920x1080的sensor,可能實際的Image array的點數是1948x1108。這是由于圖線陣列角落的進光量很少,一般會去掉一部分角落的像素點,保證成像質量,從而增加一些功能性的區域,比如Optical Black區域用來作為暗電流的對照(用于黑電平校正),留下虛擬邊界作為后續數字處理的時間余量和傳遞一些額外信息。

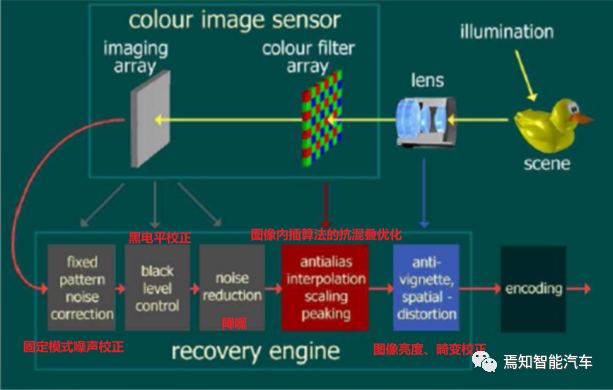

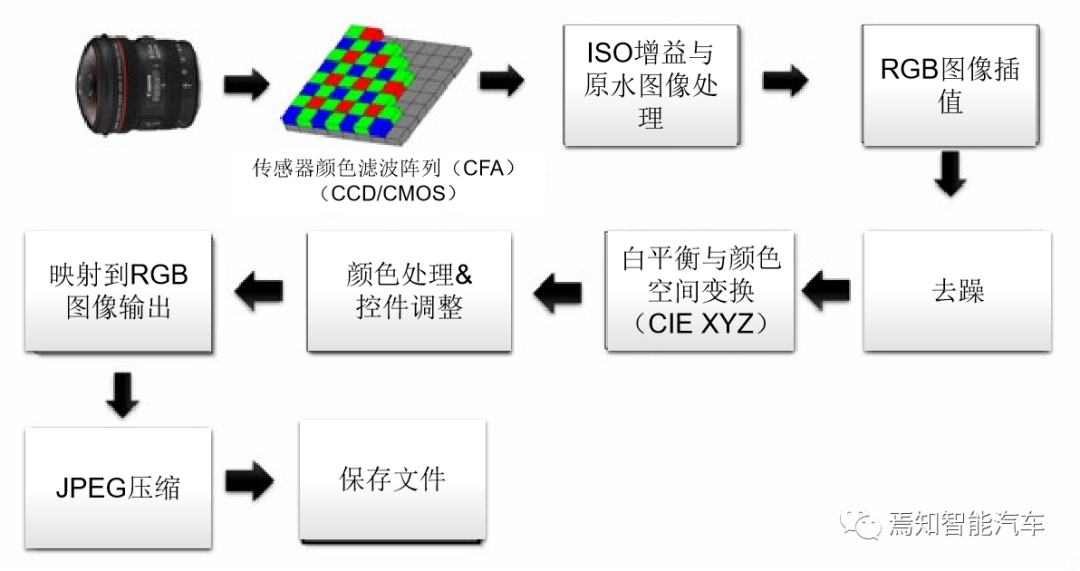

? 5)ISP圖像處理過程

? ISP(Image Signal Processor),作為攝像頭中一種典型的前端處理單元,主要是對圖像傳感器輸出的信號做前期處理。ISP的功能比較雜,基本上跟圖像效果有關的它都有份。它內部包含多個圖像算法處理模塊,其中比較有代表性的是:扣暗電流(去掉電流噪聲),線性化(解決數據非線性問題),shading(解決鏡頭帶來的亮度衰減與顏色變化),去壞點(去掉sensor中壞點數據),去噪(去除噪聲),demosaic(raw數據轉為RGB數據),3A(自動白平衡,自動對焦,自動曝光),gamma(亮度映射曲線,優化局部與整體對比度),旋轉(角度變化),銳化(調整銳度),縮放(放大縮小),色彩空間轉換(轉換到不同色彩空間進處理),顏色增強(可選,調整顏色),膚色增強(可選,優化膚色表現)等。 ?

? 依賴于ISP才能在不同的光學條件下都能較好的還原現場細節,ISP技術在很大程度上決定了攝像機的成像質量。負責接收感光元件(Sensor)的原始信號數據,可以理解為整個相機拍照、錄像的第一步處理流程,對圖像質量起著非常重要的作用。

? 攝像頭模組影像測評 ? 了解了攝像頭在各方面的性能指標后,就需要采用一定的評價指標對攝像頭整個模組的選型進行有效的評價,以方便對攝像頭的運算能力進行全方位評估。 ? 從如上分析影響攝像頭成像能力的主要因素來說,關于攝像頭模組的顯像測評主要包括如下幾個重要的指標。 ?

(1)解像力 ? 解像力這個指標主要是通過對相機鏡頭的還原能力進行測試,測試的方法是用相機拍攝逐漸變細的條紋,然后在電腦中使用10倍~50倍甚至更高倍數的放大倍率來觀察所拍攝的畫面。解像力值是用底片上視覺可區別的1mm上的極限線條數表示的。 ? 例如,在一個區域中畫100條黑線,有的鏡頭拍出來的影像只能辨認出10條線,有的鏡頭拍出來的影像則能辨認出100條線,這樣就可以認為后者的解像力比前者高。可以看出解像力主要是針對鏡頭而言的。 ?

(2)雜光、鬼影 ? ?由強光造成的照片發白、形成光暈的現象稱作“眩光(Flare)”。當太陽光或點光源進入鏡頭時,鏡片表面會反射5%左右的入射光線。各枚鏡片表面反射的光線會在鏡頭和相機內部多次反射,在光源的相對位置形成之清晰亮點,有如幽靈一般,稱之為鬼影(鬼影算是光斑的一種)。 ? 這里需要說明的是,很多如果采用純攝像頭方案實現的AEBFCTB這類安全性功能可能會由于檢測到類似鬼影而進行誤制動。

? (3)畸變 ? 相機內參由傳感器和鏡頭在模組內的安裝位置決定,其標定的主要目的是建立成像幾何模型并矯正透鏡畸變。透鏡畸變主要分為徑向畸變和切向畸變,徑向畸變由透鏡形狀的制造工藝導致,切向畸變由透鏡和CMOS或者CCD的安裝位置誤差導致。 ? 在進行畸變性能評價時,通常是采用對攝像頭內參矩陣做整體維度的評價。通常在對攝像頭安裝到車上時,需要提前對攝像頭的內參矩陣進行矯正。相機內參標定通過拍攝空間中不同位置處的標定板,標定光心位置和畸變系數。 ?

(4)視場角 ? 在光學儀器中,以光學儀器的鏡頭為頂點,以被測目標的物像可通過鏡頭的最大范圍的兩條邊緣構成的夾角,稱為視場角。視場角的大小決定了光學儀器的視野范圍,視場角越大,視野就越大,光學倍率就越小。這也是我們在做攝像頭鏡頭模組選擇時最常用于評價的性能指標。 ?

(5)亮度均勻性 ? 光亮度均勻性,是指最亮與最暗部分的差異值,就是所拍攝的畫面四個角落的亮度與中心點亮度的比值,一般將中間定義為100%。理想的均勻度是100%,均勻度越高,畫面的亮度一致性越好。 ?

(6)色彩均勻性 ? 色彩均勻性的測量方法:即至少選擇兩種顏色RGB級數進行比較。如:R/B和R/G。以確認模組周邊與中心色彩一致性是否符合要求。分別測出R/B、R/G、G/B的max以及min值,并用min/max(各組)從而得到需求值,取其中的最小值,從而可以很好的評價傳感器的色差能力。 ?

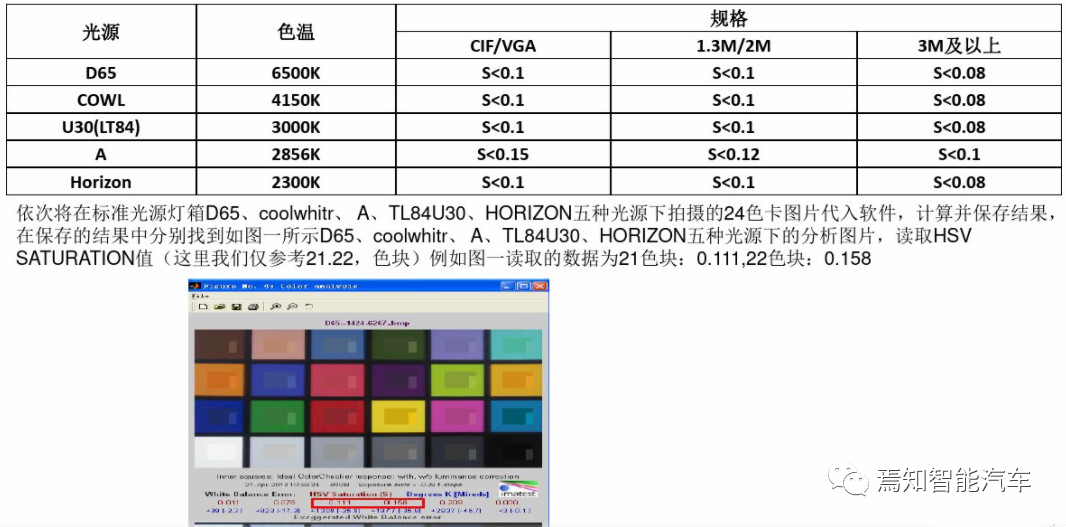

(7)?色彩飽和度 ? 飽和度(Saturation)指的是色彩純度。是色彩的構成要素之一。純度越高,表現越鮮明,純度較低,表現則較黯淡。

? (8)信噪比 ? 信噪比是信號均值與背景標準偏差的比值,衡量一幅圖片質量好壞的重要指標。信噪比越大,圖像畫面就干凈,看不到“顆粒”、“雪花”。若信噪比小,則可能滿是“雪花”,嚴重影響圖像質量。

? (9)白平衡 ? 白平衡就是拍照時相機會分析我們拍攝場景的光線環境,并且盡力還原白色,光的色調是通過色溫來實現的,色溫會告訴相機這些光是暖色調還是冷色調。色溫說的是光線的溫度,比如暖光或者冷光,色溫從低到高,顏色也由偏黃的暖光(色溫低)到偏藍的冷光(色溫高)。白平衡的目的是要求在不同光源下(晴天、陰天、白熾燈等)拍攝的圖像能獲得與人眼觀察相符的彩色,并確認是否出現偏色及其他顏色摻雜。 ?

? (11) 灰階 ? 灰階就是指將最亮和最暗之間的亮度變化區分為不同的層級,每一級就表示一個亮度變化,這里的中間層級越多,那么呈現出來的畫面效果也就會越細膩。灰階層級越多,明暗對比和黑白顏色過渡方面的表現優異圖像越清晰,過渡越自然越好。 ?

(12)動態范圍 ? 動態范圍是用來描述畫面中從最暗的陰影部分到最亮的高光部分的光量強度分布范圍。動態范圍越大,說明圖像中能被捕捉下來的層次越豐富。 ? 只要場景中從最亮到最暗的部分所跨越的動態范圍在相機感光元件的動態范圍之內,那么就能夠同時把最亮和最暗部分的細節記錄下來。舉例來說,如果一臺相機的動態范圍是8擋,而場景中最亮和最暗部分的曝光相差6擋,那么你就能夠記錄下場景中所有的細節。不過,如果場景或者拍攝對象的動態范圍超過了相機感光元件的動態范圍,那么你的照片必然會出現陰影是完全的黑色,或者高光“溢出”變成完全的白色——有時兩種情況會同時出現。 ?

(13)其他評價指標 ? 此外,從綜合場景的評價角度上講,其相應的評價標準還可以是測試人員可以通過目測拍攝場景的銳利清晰度、輪廓分明度、動態范圍效果以及色彩失真度來判定整體場景的優劣。如果應用到車上,還需要考慮是否存在類似鏡頭加熱等附加功能。因為攝像機加熱的主要目的是保證攝像機能正常啟動以及正常工作。因為一般電子元器件的工作溫度范圍是-5℃到45℃左右,所以基于北方冬天能達到零下二三十度的低溫,一些元器件就會停止工作,所以應用于北方的攝像機需要FPC電熱膜/FPC加熱膜進行加熱處理,以保證攝像機能正常工作,從而確保整個加熱單元會影響到整體的功能輸出。

編輯:黃飛

?

電子發燒友App

電子發燒友App

評論