時(shí)尚總在引領(lǐng)潮流。

在人工智能、增強(qiáng)現(xiàn)實(shí)、可穿戴、虛擬試妝等技術(shù)的加持下,時(shí)尚行業(yè)特別是在線時(shí)尚行業(yè)獲得了飛速的發(fā)展。為了吸引客戶更多的目光、更棒的視覺體驗(yàn)、更好地展現(xiàn)商品,高清大圖、模特多角度擺拍已經(jīng)成了服裝、箱包、鞋類、美妝等線上商家的宣傳標(biāo)配。在網(wǎng)上購物時(shí),大家都想看看模特衣服在各種角度姿勢下的樣子,但是越多越全面的姿勢擺拍也就意味著越大的投入。為了降低宣傳成本,很多研究開始聚焦于如何合成高質(zhì)量的逼真圖像。

在這篇文章中來自北卡羅來納大學(xué)、JD和OPPO的研究人員們提出了一種姿勢引導(dǎo)的時(shí)尚圖像生成模型,可以基于模特當(dāng)前姿勢,生成出其他各種不同姿勢下的相同著裝的新圖像!也許在這樣技術(shù)的幫助下,模特再也不用辛苦一分鐘拍二十個(gè)動(dòng)作了~

生成新姿勢下的時(shí)尚圖像

研究人員的主要目的在于訓(xùn)練一個(gè)生成模型,將模特在當(dāng)前姿勢上的圖像遷移到其他的目標(biāo)姿勢上去,實(shí)現(xiàn)對(duì)于衣著等商品的全面展示。

這一模型主要由生成器和判別器構(gòu)成,與先前工作不同的是這一模型架構(gòu)中包含了兩個(gè)不同的判別器!其中生成器由兩個(gè)編碼器構(gòu)成,分別用于從圖像和對(duì)應(yīng)的動(dòng)作關(guān)鍵點(diǎn)特征圖進(jìn)行編碼,而解碼器則用于從動(dòng)作和衣著的特征中合成目標(biāo)圖像。對(duì)于判別器來說,除了判定生成圖像是否逼真外、還需要判定動(dòng)作與生成圖像的連續(xù)性以保證生成圖像動(dòng)作的連續(xù)性和魯棒性。

模型的主要架構(gòu),生成器的編碼器包含了對(duì)于圖像的編碼器Ei和對(duì)動(dòng)作的編碼器Ep,基于U-Net和bi-LSTM共同構(gòu)建而成,而兩個(gè)判別器分別用于判定圖像的真?zhèn)尾⒈WC生成圖像與動(dòng)作間的連續(xù)性。

時(shí)尚圖像生成器

生成器中主要包含了兩個(gè)編碼器和一個(gè)解碼器用于處理圖像和對(duì)應(yīng)姿勢,生成器探索了輸入圖像的視覺語義特征和位姿信息,并生成對(duì)應(yīng)姿勢下的新圖像。圖像編碼器:圖像編碼器的目標(biāo)是從單張或多張圖像中湖區(qū)語義編碼信息。研究人員首先使用了ResNet作為主干網(wǎng)絡(luò)抽取不同尺度的特征,包括紋理、顏色、邊緣線條信息等。隨后將這些特征輸入到雙邊長短時(shí)記憶網(wǎng)絡(luò)(bc-LSTM)中用于從相同衣著不同視角的模特圖像中抽取共同的特征,將不同種類的圖像特征進(jìn)行轉(zhuǎn)換,同時(shí)對(duì)不同特征下的背景和噪聲進(jìn)行處理。最終得到了可以表達(dá)圖像視覺語義信息的編碼Ci,用于后續(xù)圖像的生成。位姿編碼器:模型同時(shí)需要位姿數(shù)據(jù)來為生成圖像進(jìn)行引導(dǎo),研究人員利用了18個(gè)關(guān)鍵點(diǎn)來表示人體位姿,用不同顏色的直線相連并以RGB的格式進(jìn)行表示。通過U-Net的架構(gòu)和3*3的卷積從位姿圖中抽取高層次語義特征Cp并在解碼過程中通過跳接層連接進(jìn)行特征共享。解碼器:其主要目的是通過圖像編碼Ci 和動(dòng)作編碼Cp重建出逼真的圖像。首先將圖像編碼與位姿編碼的編碼拼接在一起,并基于U-Net架構(gòu)和跳接層將視覺語義信息與動(dòng)作編碼信息匹配起來,進(jìn)行有效的圖像生成。判別器:其主要目標(biāo)是引導(dǎo)模型生成比先前模型更逼真圖像。在訓(xùn)練過程中研究人員利用兩個(gè)判別器來同時(shí)進(jìn)行對(duì)抗訓(xùn)練,主要采用了與PatchGAN類似的實(shí)現(xiàn)。其中Di用于判別生成圖像是否逼真,與先前的模型類似;而Dp則用于判定生成圖像與對(duì)應(yīng)動(dòng)作的連續(xù)性。Dp的輸出是真實(shí)圖像與對(duì)應(yīng)位姿和這一位姿下生成的圖像,用于判定圖像是否與位姿匹配,它對(duì)于生成與位姿對(duì)應(yīng)的時(shí)尚圖像具有重要的作用,能幫助網(wǎng)絡(luò)生成更為復(fù)雜的動(dòng)作姿勢,同時(shí)保持連續(xù)性和魯棒性。

結(jié)果展示

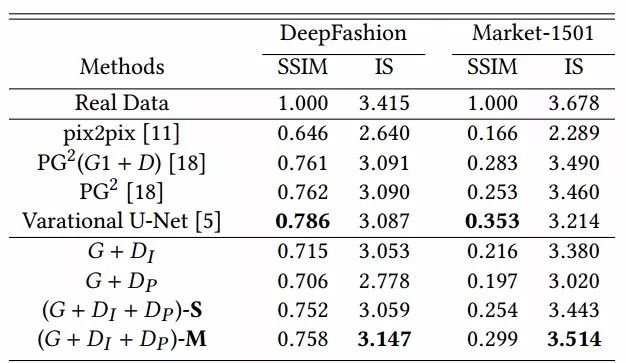

通過DeepFashion和Market-1501數(shù)據(jù)的訓(xùn)練后研究人員得到了不錯(cuò)的結(jié)果。

Deep Fasion 數(shù)據(jù)集

Market-1501數(shù)據(jù)集

生成的結(jié)果與先前方法的比較,其中S和M代表了單張和多張圖像輸入的生成結(jié)果:

在數(shù)據(jù)集上的表現(xiàn)還不錯(cuò),從源圖像生成了新的姿勢:

-

解碼器

+關(guān)注

關(guān)注

9文章

1113瀏覽量

40453 -

圖像

+關(guān)注

關(guān)注

2文章

1076瀏覽量

40281 -

模型

+關(guān)注

關(guān)注

1文章

3032瀏覽量

48374

原文標(biāo)題:從姿勢到圖像——基于人體姿勢引導(dǎo)的時(shí)尚圖像生成算法

文章出處:【微信號(hào):thejiangmen,微信公眾號(hào):將門創(chuàng)投】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評(píng)論請先 登錄

相關(guān)推薦

一種圖像語義分層處理框架,可以實(shí)現(xiàn)像素級(jí)別的圖像語義理解和操縱

美國普渡大學(xué)和哈佛大學(xué)的研究人員推出了一項(xiàng)新發(fā)明 新...

研究人員提出了一種柔性可拉伸擴(kuò)展的多功能集成傳感器陣列

特倫托大學(xué)與Inria合作:使用GAN生成人體的新姿勢圖像

OpenAI的研究者們提出了一種新的生成模型,能快速輸出高清、真實(shí)的圖像

以色列研究人員開發(fā)出了一種能夠識(shí)別不同刺激的新型傳感系統(tǒng)

研究人員們提出了一系列新的點(diǎn)云處理模塊

Facebook的研究人員提出了Mesh R-CNN模型

研究人員推出了一種新的基于深度學(xué)習(xí)的策略

研究人員開發(fā)出了一種稱為LB-WayPtNav-DH的機(jī)器人導(dǎo)航新框架

研究人員開發(fā)了一種新穎的機(jī)器學(xué)習(xí)管道

微軟亞洲研究院的研究員們提出了一種模型壓縮的新思路

一種基于改進(jìn)的DCGAN生成SAR圖像的方法

MIT研究人員提出了一種制造軟氣動(dòng)執(zhí)行器的新方法

JD和OPPO的研究人員們提出了一種姿勢引導(dǎo)的時(shí)尚圖像生成模型

JD和OPPO的研究人員們提出了一種姿勢引導(dǎo)的時(shí)尚圖像生成模型

評(píng)論