基于深度神經(jīng)網(wǎng)絡(luò)的仿真面對(duì)面對(duì)話系統(tǒng)

近日,CloudMinds和北京航空航天大學(xué)的研究人員基于深度學(xué)習(xí)提出了一種新的仿真面對(duì)面對(duì)話系統(tǒng)。CloudMinds是一家在機(jī)器人和云服務(wù)領(lǐng)域的領(lǐng)軍企業(yè),致力于成為針對(duì)各種機(jī)器人模型需求的供應(yīng)商。

該會(huì)話系統(tǒng)包括用于收聽(tīng)和說(shuō)話的兩個(gè)序列到序列模型以及基于虛擬代理合成器的生成性對(duì)抗網(wǎng)絡(luò)(GAN)模型。

當(dāng)虛擬代理與人通信時(shí),語(yǔ)音音頻和面部圖像被輸入到系統(tǒng)中。面部圖像由面部解析模塊處理,產(chǎn)生面部動(dòng)作和姿勢(shì)。然后將生成的信息傳遞到基于序列到序列的收聽(tīng)模型中。當(dāng)虛擬代理在收聽(tīng)時(shí),輸出被饋送到合成器中以產(chǎn)生逼真的面部圖像作為非語(yǔ)言反應(yīng)。

語(yǔ)音識(shí)別模型將語(yǔ)音音頻變換為文本,然后傳遞到會(huì)話模塊中以生成響應(yīng)語(yǔ)句,該響應(yīng)語(yǔ)句被傳遞到文本到語(yǔ)音(TTS)模塊以合成語(yǔ)音。響應(yīng)語(yǔ)句被傳遞到序列到序列的說(shuō)話模型,其輸出也被輸入到虛擬合成器中以產(chǎn)生逼真的面部圖像,從而呼應(yīng)語(yǔ)音內(nèi)容。頭像合成器則用于在整個(gè)對(duì)話期間收聽(tīng)和說(shuō)話。

本文顯著改進(jìn)了傳統(tǒng)的基于3D模型的成果。為了訓(xùn)練模型,研究人員收集了大約700個(gè)ESPN視頻,其中包含來(lái)自YouTube的面對(duì)面對(duì)話場(chǎng)景。

與傳統(tǒng)3D模型的生成結(jié)果相比,該模型所生成的面部圖像更接近現(xiàn)實(shí)。毋庸置疑的是,在使得會(huì)話更加逼真自然的領(lǐng)域上,該系統(tǒng)還有很大的潛力可供挖掘,未來(lái)它還可用于實(shí)現(xiàn)個(gè)性化表情會(huì)話。

原文:

https://arxiv.org/abs/1908.07750

使用DISCo方法改進(jìn)鈣成像分析

本文中,德國(guó)海德堡大學(xué)跨學(xué)科科學(xué)計(jì)算中心(IWR)的研究人員介紹了DISCo方法,這是一種使用深度學(xué)習(xí),實(shí)例分割和相關(guān)性研究的新方法,可用于鈣成像分析中的細(xì)胞分割步驟。

DISCo將深度學(xué)習(xí)網(wǎng)絡(luò)的優(yōu)勢(shì)與最先進(jìn)的實(shí)例分割程序相結(jié)合,允許直接提取單元實(shí)例而無(wú)需任何復(fù)雜的后處理步驟。他們還以非常有效的方式利用鈣成像視頻的時(shí)間背景來(lái)計(jì)算像素之間的分段相關(guān)性。然后以摘要圖像的形式將此時(shí)間信息與基于形狀的信息相結(jié)合。

DISCo的最大優(yōu)勢(shì)在于能夠結(jié)合相關(guān)性和圖像特征,而不只依賴(lài)于其中一種方法。因此,DISCo可以通過(guò)在Neurofinder數(shù)據(jù)集上僅使用單個(gè)模型來(lái)使神經(jīng)研究人員獲得良好的整體性能。此外,當(dāng)在幾個(gè)數(shù)據(jù)集系列上訓(xùn)練單個(gè)網(wǎng)絡(luò)時(shí),研究人員能夠超越在Neurofinder數(shù)據(jù)集上訓(xùn)練的所有其他方法。

原文:

https://arxiv.org/abs/1908.07957

用于科研教育的低成本開(kāi)源機(jī)器人賽車(chē)平臺(tái)

華盛頓大學(xué)保羅G.艾倫計(jì)算機(jī)科學(xué)與工程學(xué)院的研究人員最近介紹了MuSHR,即多代理的非完整賽車(chē)系統(tǒng)。MuSHR是一個(gè)低成本、開(kāi)源的機(jī)器人賽車(chē)平臺(tái),致力于教育和研究,由MuSHR的個(gè)人機(jī)器人實(shí)驗(yàn)室開(kāi)發(fā),旨在促進(jìn)機(jī)器人領(lǐng)域的公民化。作為一個(gè)低成本的平臺(tái),參與者可以通過(guò)說(shuō)明,開(kāi)源文檔和動(dòng)手教程參與其中。

賽車(chē)的硬件設(shè)計(jì)基于一系列現(xiàn)成的組件,這些組件可以從世界各地的線上和線下硬件商店中輕松地找到,而軟件架構(gòu)則是在個(gè)人機(jī)器人實(shí)驗(yàn)室中開(kāi)發(fā)的。該平臺(tái)為華盛頓大學(xué)的移動(dòng)機(jī)器人課程開(kāi)發(fā)了一套演示系統(tǒng)和許多寶貴的實(shí)踐經(jīng)驗(yàn),是機(jī)器人平臺(tái)開(kāi)發(fā)的里程碑。

MuSHR的低成本開(kāi)發(fā)模式和綜合的文檔記錄是寶貴的機(jī)器人研究資源。該平臺(tái)向?qū)W術(shù)研究實(shí)驗(yàn)室,機(jī)器人研究者及機(jī)器人愛(ài)好者等展示各種機(jī)器人研究項(xiàng)目提供了一個(gè)出色的測(cè)試平臺(tái)。

MuSHR具有開(kāi)源指令和教程帶領(lǐng)用戶完成硬件開(kāi)發(fā)。文檔托管在Github上,免費(fèi)供一般公眾下載使用。

代碼:

https://github.com/prl-mushr

原文:

https://arxiv.org/abs/1908.08031

三維掃描與CAD對(duì)象的聯(lián)合嵌入

近日,慕尼黑工業(yè)大學(xué)、斯坦福大學(xué)以及 Facebook 人工智能研究所共同提出了一種學(xué)習(xí)三維掃描和CAD之間的聯(lián)合嵌入空間的技術(shù)。而在這兩者中有很多聯(lián)系緊密且十分相似的事物。這一學(xué)習(xí)方法基于一種全新的3D CNN 技術(shù),通過(guò)學(xué)習(xí)聯(lián)合嵌入空間中事物的相似性來(lái)實(shí)現(xiàn)嵌入。

為了學(xué)習(xí)一個(gè)掃描對(duì)象和CAD模型可以相互交織的共享空間,研究人員提出使用堆疊沙漏的方式將前景、背景與掃描對(duì)象分開(kāi),并將其轉(zhuǎn)換為完整的類(lèi)CAD表示,以此將它整合到共享嵌入空間中。這樣操作得到的嵌入空間可以用于CAD模型檢索。為了更好地完成這一任務(wù),研究人員引入了一個(gè)全新數(shù)據(jù)集,其中包括了掃描CAD相似性注釋。在這一數(shù)據(jù)集的幫助下,他們能夠?qū)AD模型檢索進(jìn)行細(xì)粒度的評(píng)估,并對(duì)雜亂、嘈雜部分進(jìn)行掃描。

這一新型學(xué)習(xí)方式比現(xiàn)有的CAD模型在實(shí)例檢索上的準(zhǔn)確率高出10% 以上。

因此,它在CAD模型檢索方面的表現(xiàn)比原有模型更好。學(xué)習(xí)這樣的聯(lián)合掃描- CAD嵌入空間不僅為CAD模型檢索提供了新的解決方案,也為這兩個(gè)領(lǐng)域之間的知識(shí)映射提供了新的可能性。

當(dāng)然,雖然這個(gè)技術(shù)在掃描與學(xué)習(xí)CAD對(duì)象空間方面非常有效,但它仍然有很多局限性——目前研究人員僅考慮了掃描和CAD對(duì)象領(lǐng)域中對(duì)象的幾何形狀;而這篇論文中未提及的顏色信息可能是聯(lián)合嵌入或CAD模型檢索的另一強(qiáng)大信號(hào)。

原文:

https://arxiv.org/abs/1908.06989

Google發(fā)布Turbo,可視化工具的里程碑式突破

Turbo 是由Google研究人員提出的一種著色工具,它既有Jet的優(yōu)勢(shì)功能,同時(shí)也解決了Jet的一些短板,例如細(xì)節(jié)錯(cuò)誤、條帶、和顏色混淆等。

在開(kāi)發(fā)人員的精心調(diào)試下,Turbo的強(qiáng)大性能能夠勝任各種可視化任務(wù)。在開(kāi)發(fā)過(guò)程中,研究人員們制作了一個(gè)簡(jiǎn)單的交互界面,在其中他們能夠使用7節(jié)立方條來(lái)調(diào)整RGB曲線,同時(shí)將樣本結(jié)果與其他知名彩繪程序的結(jié)果進(jìn)行比較。

Turbo可以作為順序和發(fā)散的可視化工具,因此它很適合開(kāi)發(fā)人員保存在自己的“工具箱”中。它用于解決均勻性不那么重要的數(shù)據(jù)可視化任務(wù)非常有效,尤其是在需要展現(xiàn)強(qiáng)烈對(duì)比的情況下。

Google的團(tuán)隊(duì)將這個(gè)工具用于實(shí)現(xiàn)視差貼圖、誤差貼圖以及許多其他標(biāo)量的可視化中。您可以在下方鏈接中找到在Python和C/C++ 中的使用這幾技術(shù)的方法,以及多項(xiàng)式逼近的方法——用于可能查表查詢不太方便的情況中。

Python:

https://gist.github.com/mikhailov-work/ee72ba4191942acecc03fe6da94fc73f

C/C++:

https://gist.github.com/mikhailov-work/6a308c20e494d9e0ccc29036b28faa7a

Polynomial approximation:

https://gist.github.com/mikhailov-work/0d177465a8151eb6ede1768d51d476c7

原文:

https://ai.googleblog.com/2019/08/turbo-improved-rainbow-colormap-for.html

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4764瀏覽量

100545 -

AI

+關(guān)注

關(guān)注

87文章

30172瀏覽量

268439

原文標(biāo)題:狗還是機(jī)器人?誰(shuí)在屏幕后和你對(duì)話?新研究開(kāi)發(fā)仿真面對(duì)面對(duì)話系統(tǒng) | 一周AI最火論文

文章出處:【微信號(hào):BigDataDigest,微信公眾號(hào):大數(shù)據(jù)文摘】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

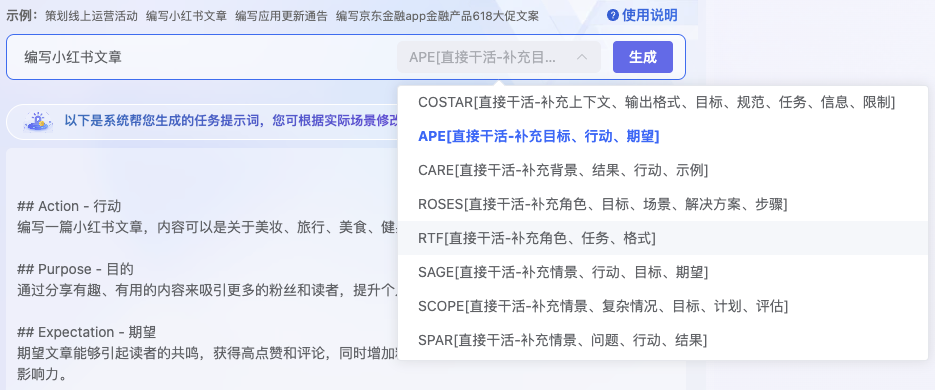

AI對(duì)話魔法 Prompt Engineering 探索指南

ChatGPT:為未來(lái)的個(gè)人和企業(yè)提供革命性的對(duì)話解決方案

大研智造廠家面對(duì)面 關(guān)于激光焊錫機(jī)、錫球焊設(shè)備高頻問(wèn)題QA,你想知道的都在這!

ChatGPT 在游戲開(kāi)發(fā)中的創(chuàng)新應(yīng)用

這些電源常用仿真軟件,你都知道嗎?

與家電大咖面對(duì)面,這幾項(xiàng)關(guān)鍵半導(dǎo)體技術(shù)輕松get!

esp32-lyrat接DuerOS有了對(duì)話功能之后,是否還可以進(jìn)行錄音?

基于微機(jī)電系統(tǒng)的智能手表

Mode Maison利用基于OpenUSD的高保真數(shù)字孿生推動(dòng)零售業(yè)創(chuàng)新

蘋(píng)果WWDC24將于6月10日至14日召開(kāi)

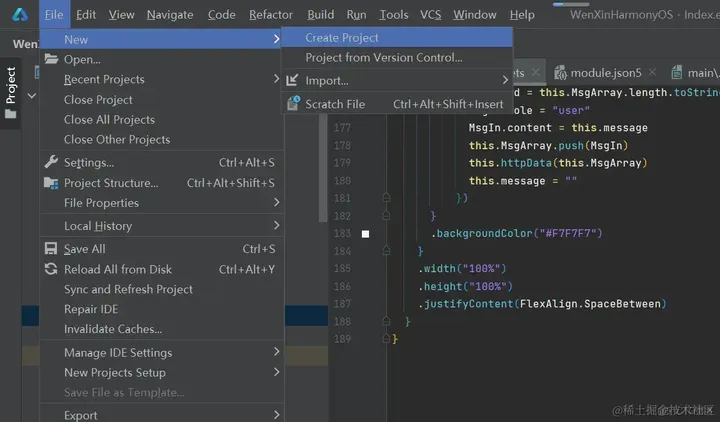

鴻蒙開(kāi)發(fā)實(shí)戰(zhàn)-手寫(xiě)文心一言AI對(duì)話APP

你知道屏幕后是誰(shuí)在和你對(duì)話嗎?新研究開(kāi)發(fā)仿真面對(duì)面對(duì)話系統(tǒng)

你知道屏幕后是誰(shuí)在和你對(duì)話嗎?新研究開(kāi)發(fā)仿真面對(duì)面對(duì)話系統(tǒng)

評(píng)論