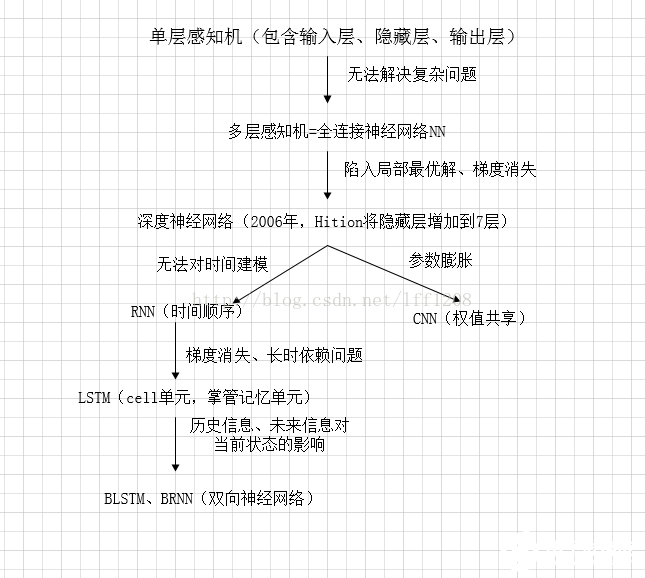

感知機

包含有輸入層、輸出層和一個隱藏層。輸入的特征向量通過隱藏層變換到達輸出層,由輸出層得到分類結果。

問題:它對稍微復雜一些的函數都無能為力

多層感知機

使用sigmoid或tanh等連續函數模擬神經元對激勵的響應,在訓練算法上則使用Werbos發明的反向傳播BP算法。這就是現在所說的神經網絡NN。

問題:

其一,隨著神經網絡層數的加深,優化函數越來越容易陷入局部最優解,并且這個“陷阱”越來越偏離真正的全局最優。利用有限數據訓練的深層網絡,性能還不如較淺層網絡。

其二,隨著網絡層數增加,“梯度消失”現象更加嚴重。(具體來說,我們常常使用sigmoid作為神經元的輸入輸出函數。對于幅度為1的信號,在BP反向傳播梯度時,每傳遞一層,梯度衰減為原來的0.25。層數一多,梯度指數衰減后低層基本上接受不到有效的訓練信號。)

DNN形成

為了克服梯度消失,ReLU、maxout等傳輸函數代替了sigmoid,形成了如今DNN的基本形式。

問題:全連接DNN(見下圖)的結構里下層神經元和所有上層神經元都能夠形成連接,從而導致參數數量膨脹。

CNN

共享卷積核,對高維數據處理無壓力。圖像通過卷積操作后仍然保留原先的位置關系。

RNN

DNN無法對時間序列上有變化的情況進行處理。然而,樣本出現的時間順序對于自然語言處理、語音識別、手寫體識別等應用非常重要。因此出現了——循環神經網絡RNN。

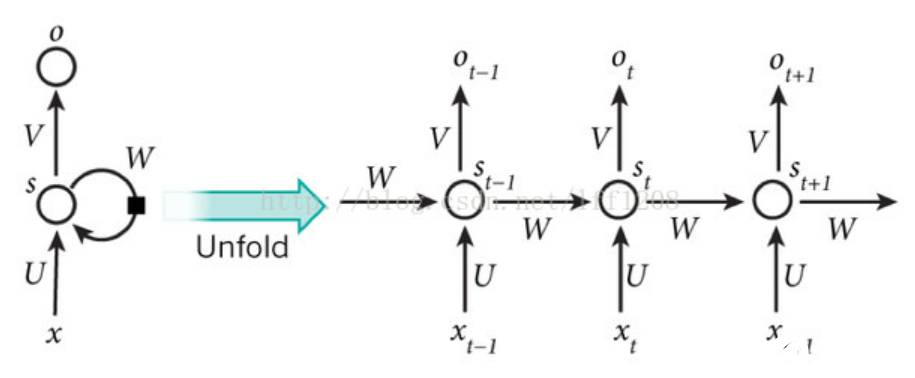

在普通的全連接網絡或CNN中,每層神經元的信號只能向上一層傳播,樣本的處理在各個時刻獨立,因此又被成為前向神經網絡(Feed-forward Neural Networks)。而在RNN中,神經元的輸出可以在下一個時間段直接作用到自身,即第i層神經元在m時刻的輸入,除了(i-1)層神經元在該時刻的輸出外,還包括其自身在(m-1)時刻的輸出!(如下圖)

(t+1)時刻網絡的最終結果O(t+1)是該時刻輸入和所有歷史共同作用的結果!

但是出現了一個問題——“梯度消失”現象又要出現了,只不過這次發生在時間軸上。

所以RNN存在無法解決長時依賴的問題。為解決上述問題,提出了LSTM(長短時記憶單元),通過cell門開關實現時間上的記憶功能,并防止梯度消失.

-

神經網絡

+關注

關注

42文章

4762瀏覽量

100535 -

cnn

+關注

關注

3文章

351瀏覽量

22169

發布評論請先 登錄

相關推薦

CNN和RNN結合與對比,實例講解

一文帶你了解(神經網絡)DNN、CNN、和RNN

CNN、RNN、DNN的內部網絡結構有什么區別?

基于FPGA進行DNN設計的經驗總結

DNN CNN和RNN有什么區別

DNN CNN和RNN有什么區別

評論