(文章來源:比特網(wǎng))

去年美國馬薩諸塞州大學(xué)阿默斯特分校的研究人員曾表示,訓(xùn)練一臺(tái)大型AI機(jī)器產(chǎn)生的碳,平均是一個(gè)人終其一生駕駛汽車制造的排放量5倍。除此之外,還存在很多其他方面的能源消耗。因此AI未來如何實(shí)現(xiàn)可持續(xù)發(fā)展,仍是亟需解決的問題。

近期,在麻省理工一篇最新論文中顯示,其提出了一種比以前更環(huán)保的方式來訓(xùn)練和運(yùn)行AI模型的系統(tǒng)。論文中顯示,該方案被稱為是種“一勞永逸”的網(wǎng)絡(luò),它訓(xùn)練一個(gè)大型模型,該模型由許多不同大小的預(yù)訓(xùn)練子模型組成,這些子模型可以在不需要再訓(xùn)練的情況下針對(duì)一系列平臺(tái)進(jìn)行定制。每個(gè)子模型都可以在推理時(shí)獨(dú)立運(yùn)行而無需重新訓(xùn)練,系統(tǒng)根據(jù)與目標(biāo)硬件的功率和速度限制相關(guān)的精度和延遲權(quán)衡來確定最佳子模型。

“漸進(jìn)收縮”算法有效地訓(xùn)練大模型,同時(shí)支持所有子模型。先訓(xùn)練大模型,再利用大模型訓(xùn)練較小的子模型,使其同時(shí)學(xué)習(xí),最后所有子模型都得到了支持。

在實(shí)驗(yàn)中,研究人員發(fā)現(xiàn),用他們的方法訓(xùn)練一個(gè)包含超過10個(gè)五分之一建筑環(huán)境的計(jì)算機(jī)視覺模型,最終比花幾個(gè)小時(shí)訓(xùn)練每個(gè)子網(wǎng)絡(luò)要有效得多。此外,它并沒有影響模型的準(zhǔn)確性或效率——當(dāng)使用通用基準(zhǔn)(ImageNet)進(jìn)行測(cè)試時(shí),該模型在移動(dòng)設(shè)備上達(dá)到了理想準(zhǔn)確性,在推理方面比領(lǐng)先的分類系統(tǒng)快1.5到2.6倍。

也許更令人印象深刻的是,研究人員聲稱,與當(dāng)今流行的模型搜索技術(shù)相比,計(jì)算機(jī)視覺模型在訓(xùn)練時(shí)需要大約1/1300的碳排放量。IBM研究員、麻省理工學(xué)院沃森人工智能實(shí)驗(yàn)室成員談到這項(xiàng)研究時(shí)表示:“如果人工智能要繼續(xù)快速發(fā)展,我們就需要減少其對(duì)環(huán)境的影響。”

(責(zé)任編輯:fqj)

-

AI

+關(guān)注

關(guān)注

87文章

30146瀏覽量

268421 -

碳排放

+關(guān)注

關(guān)注

0文章

17瀏覽量

9637

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

麻省理工學(xué)院研發(fā)全新納米級(jí)3D晶體管,突破性能極限

麻省理工學(xué)院推出新型機(jī)器人訓(xùn)練模型

24M開發(fā)出新隔離膜可降低電動(dòng)汽車電池火災(zāi)風(fēng)險(xiǎn)

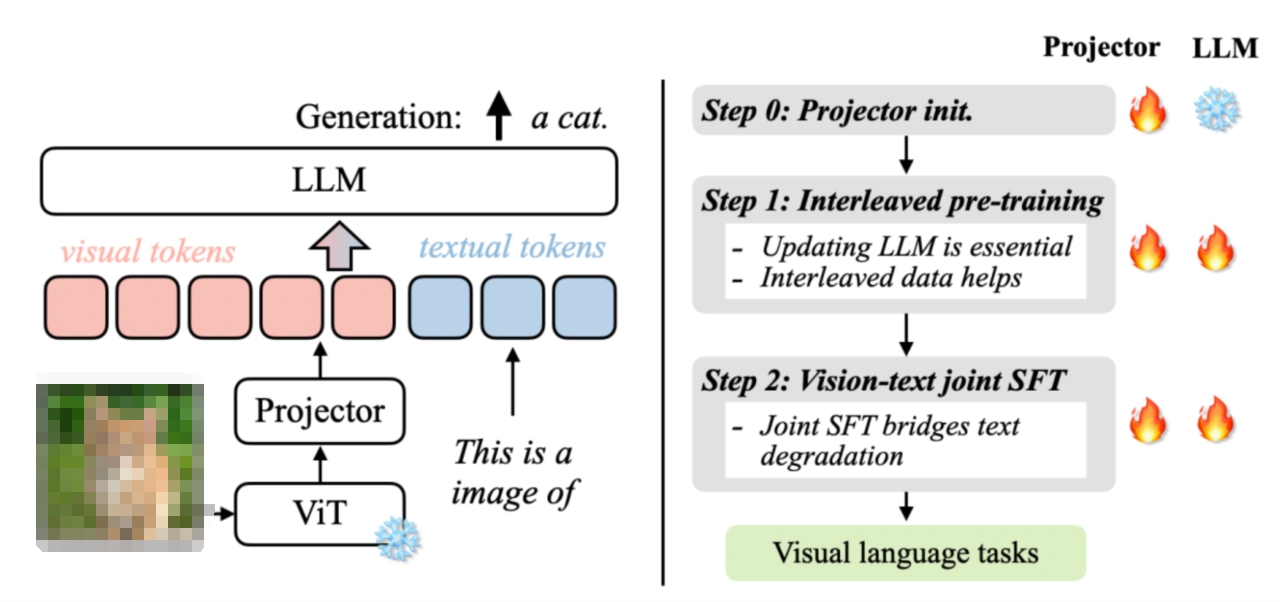

VILA與其他模型在提供邊緣AI 2.0方面的表現(xiàn)

美國佐治亞理工學(xué)院一行蒞臨達(dá)實(shí)智能調(diào)研

貴州理工學(xué)院采購南京大展的DZ-STA200同步熱分析儀

麻省理工學(xué)院研發(fā)RoboGrocery系統(tǒng),雜貨店自動(dòng)化裝袋新篇章

感謝東莞理工學(xué)院對(duì)我司導(dǎo)熱系數(shù)測(cè)試儀的認(rèn)可

蘇黎世聯(lián)邦理工學(xué)院報(bào)告:Rowhammer攻擊對(duì)高端RISC-V CPU的潛在風(fēng)險(xiǎn)

一種用于化學(xué)和生物材料識(shí)別的便攜式拉曼光譜解決方案

麻省理工與Adobe新技術(shù)DMD提升圖像生成速度

霍尼韋爾與南方泵業(yè)開展戰(zhàn)略合作,四川成都一家紅外熱成像專用圖像處理芯片服務(wù)商完成A+輪融資

瑞士蘇黎世聯(lián)邦理工學(xué)院新型四足機(jī)器人單腿完成開關(guān)門、移動(dòng)任務(wù)

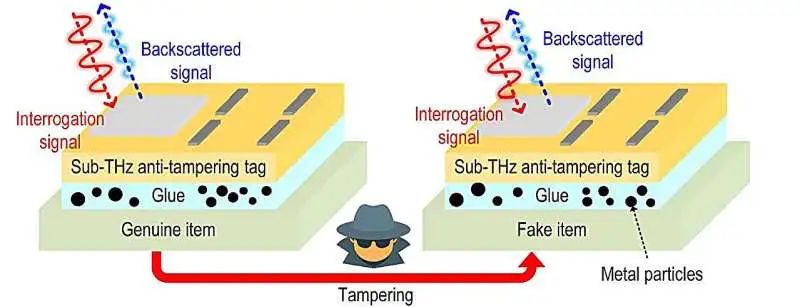

麻省理工學(xué)院開發(fā)出新的RFID標(biāo)簽防篡改技術(shù)

Innovusion駛?cè)氤掷m(xù)增長快車道,消息稱中國特供版英偉達(dá) H20 AI 芯片推遲到明年一季度發(fā)布

麻省理工學(xué)院提出環(huán)保AI訓(xùn)練方式,降低碳排放

麻省理工學(xué)院提出環(huán)保AI訓(xùn)練方式,降低碳排放

評(píng)論