剛剛,IBM宣布達到了量子計算新的里程碑,目前最高的64量子體積。與去年相比,其量子計算機的性能又提高了一倍。

就在幾個月前,霍尼韋爾宣稱已經研發出世界最強大的量子計算機。

此次,IBM宣布的最新進展直接對飚霍尼韋爾,量子計算領域的競爭逐漸白熱化。

霍尼韋爾放狠話,IBM不Care,量子計算誰最強

早在今年3月,霍尼韋爾就「放狠話」:在接下來的三個月,我們將推出世界上性能最高的量子計算機。

可能谷歌、IBM和英特爾也沒想到,6月18日會殺出這樣一個勁敵。

霍尼韋爾宣布:「我們建造了目前世界上性能最好的量子計算機」。

其最新量子計算機的量子體積得分達到64,是IBM和谷歌競爭對手的兩倍。2019年,IBM的量子體積達到了32。

霍尼韋爾這個「最好」可不是自夸的,這是基于IBM的量子計算機衡量基準而得到的結果。

「量子體積」這一概念最先由IBM提出,量子體積是用于度量量子計算機性能的指標,而不是僅僅以量子比特(Quantum Bit)數量作為度量標準,這一指標的提出旨在擺脫該行業原有相對過時的評估方法。

量子體積的影響因素包括量子比特數、門和測量誤差、設備交叉通信、以及設備連接和電路編譯效率等。量子體積越大,量子計算機就越強大,對時間和空間復雜性的處理能力越好。

量子體積能更全面地度量量子計算機的能力,包括度量可解決問題的復雜程度等。

要更好地理解IBM和霍尼韋爾的量子計算孰優孰劣,首先要知道,他們采用的是兩種完全不同的技術路線。

三英戰呂布 : 超導量子計算VS離子阱

目前量子計算主要分為固態器件和光學路線兩大類路線,谷歌、IBM、英特爾這三家公司屬于「固態器件路線派」,霍尼韋爾的離子阱走的技術路線則屬于的是「光學器件派」。

光學路線的離子阱在相干時間上就有優勢,但是其可操控性上很弱,而且與經典計算很難實現兼容。

目前世界上80%以上的量子計算機都采用了固態器件的路線,在與經典計算兼容等方面固態器件都具有明顯優勢,離子阱等光學路線更多是在科研上用的比較多。

目前量子計算的主要技術路線(數據來源:華為、賽迪)

超導量子計算是目前進展最快最好的一種固態量子計算實現方法。

超導量子電路的能級可以通過外加電磁場進行干預 ,電路更容易實現定制化開發,而且現在的集成電路工藝已經十分成熟,超導量子電路的可擴展性優勢明顯。

但是也有些問題存在,由于量子體系的不可封閉性,環境噪聲、磁通偏置噪聲等大量不受控的因素存在,經常會導致量子耗散和相干弱化。此外,超導量子系統工作對物理環境要求極為苛刻,比如,超低溫是超導量子計算實現過程中不可避免的問題。

除了IBM,谷歌和英特爾等企業也在積極開展超導量子研究。谷歌量子人工智能實驗室發布的Bristlecone量子芯片,可實現 72 個量子比特長度上的單比特門操縱,單量子比特門最佳保真度達到了99.9%。

此前,曾有專家表示,霍尼韋爾聲稱擁有世界上最快量子計算機有炒作嫌疑,因為沒有解決世界上任何問題,只是參數上的進步。

霍尼韋爾的離子阱是利用電荷與電磁場間的交互作用力牽制帶電粒子的運動,將受限離子的基態和激發態兩個能級作為量子比特。

量子態被存儲在單個離子阱中,并從其中讀取信息。量子比特可以通過它們在阱中的運動直接相互作用,也可以通過光和微波的發射和吸收相互作用。

盡管離子阱技術本身的發展可以追溯到 1980 年,但是利用離子阱技術實現量子計算由奧地利的量子科學家 Circa 和 Zoller 于 1995 年首次提出。

2003年,該實驗室實現利用失諧激光束照射和激光冷卻控制非門,同年該實驗室第一次成功地利用離子阱技術實現了 Deutsch-Jozsa 算法。

離子阱量子計算具有量子比特品質高,相干時間長、量子比特制備和讀寫效率高的優點。

然而,離子阱技術也面臨不少問題,由于外加激光不穩定,電磁場噪聲導致量子比特相干性弱化,而且離子阱難以多條離子鏈共存,可擴展性差。

霍尼韋爾之所以能在離子阱量子計算方面實現飛躍,部分原因是其在2015年突破了一項目關鍵技術,能夠使用激光捕獲處于疊加狀態的帶電粒子。

自2017年以來,IBM的量子體積每年都翻一番。在2019年,IBM表示,其名為Raleigh的量子計算機的量子體積達到32,而一年前只有16。

有分析指,霍尼韋爾的離子阱更學院派,IBM的方案更有實用價值。

量子計算:超低溫也能加熱人工智能

盡管量子計算仍處于早期階段,但已經有了許多創新和突破。那它在人工智能領域將發揮著什么樣的作用呢?

數據增強變的簡單易行

現在的生成模型是不僅限于回答問題,還能夠輸出圖像、音樂、視頻等等。

假設你有很多人臉照,但其中很多不是正面照,生成模型可以幫你從中創建更精確的「正臉」

將量子處理單元插入經典框架可能會大幅度提高生成圖像的質量。

這如何幫助我們提升經典機器學習模型?如果你嘗試使用少量的人臉數據集訓練經典的人臉檢測模型,但性能并不是很好,可以使用量子增強的生成模型來增強數據集,從而顯著改善模型性能。

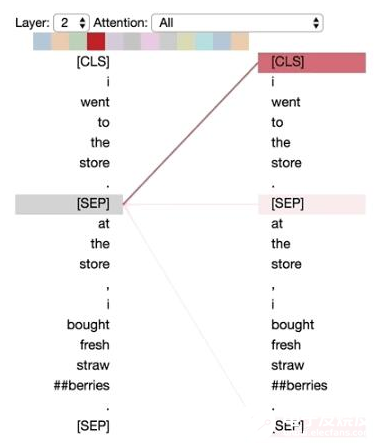

自然語言處理更懂「人話」

自然語言處理(NLP)算法將在量子計算上取得「意義感知」的突破。

「意義感知」是指計算機實際上可以理解整個句子,不僅僅是單詞,并且可以將其感知能力擴展到整個短語,甚至整篇文章。而BERT等語言模型的進一步提升,有賴于量子計算的強大算力。

隨著量子計算機發展,自然語言處理的應用將更加廣泛。

執行效率更高,新的算法設計成為可能

AI和ML是基于過去的經驗學習解決方案的好方法。

比如,告訴計算機什么是貓可能會有點兒挑戰,因為它學不會。如果你用足夠多的「貓片」訓練神經網絡,計算機就能夠正確識別出其他的貓。

將這些數據放在量子計算機上運行,就可以大大提升AI和ML算法的執行效率。

對于某些算法,甚至可達到指數級增長。量子計算機不只是執行任務更快,而且它能夠執行以前不可能完成的任務。

讓金融模型更智能

當前,人工智能在金融領域的應用也越來越廣泛。

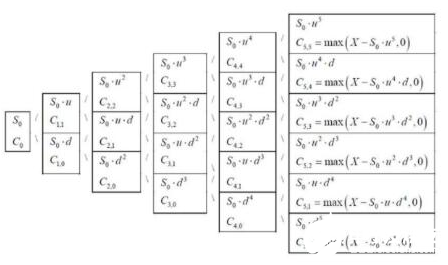

量子物理學是概率論,金融市場預測某種程度上也是,量子計算機可以無限制地建立候選模型,有潛力更好地預測分布,從而得出更準確的答案。

基本思想就是,一些問題是需要AI生成新的數據才能做出決定。解決此問題可能需要提出一個潛在的模型來解決未知狀況下的概率分布問題,而這是量子計算的強項。

量子計算和經典計算是協同而非競爭

就機器學習而言,經典計算和量子計算有著協同工作的潛力,可以利用云計算的彈性,以及量子計算強大的計算能力來協同工作。

經典計算和量子計算兩者都有優勢,量子計算目前的發展使其成為解決方案的一部分。隨著時間的流逝,這兩種計算方式都將繼續發展。

在傳統GPU和ASIC上加速工作負載的能力的同時還利用量子計算的能力,能夠讓量子計算更快,結果更可靠。

在不久的將來,也許我們能用上量子計算,用它的無限算力來降低這個世界的復雜性。

-

IBM

+關注

關注

3文章

1749瀏覽量

74631 -

量子

+關注

關注

0文章

478瀏覽量

25482 -

量子計算

+關注

關注

4文章

1081瀏覽量

34910

發布評論請先 登錄

相關推薦

IBM與日本AIST攜手,共創量子計算新紀元

IBM擴展全面的量子軟件堆棧Qiskit

【量子計算機重構未來 | 閱讀體驗】 跟我一起漫步量子計算

【量子計算機重構未來 | 閱讀體驗】+量子計算機的原理究竟是什么以及有哪些應用

【量子計算機重構未來 | 閱讀體驗】+ 初識量子計算機

國產順磁共振譜儀發展里程碑!國儀量子EPR實現全球交付100臺

全球開啟量子計算芯片技術競賽 IBM發布旗艦量子處理器Heron

IBM宣布量子計算新的里程碑:最高量子體積已達到64

IBM宣布量子計算新的里程碑:最高量子體積已達到64

評論