SoC設(shè)計(jì)與應(yīng)用技術(shù)領(lǐng)導(dǎo)廠商Socionext Inc.(以下“Socionext”,或“公司”)宣布,聯(lián)合大阪大學(xué)數(shù)據(jù)能力科學(xué)研究所長(zhǎng)原教授研究小組共同開發(fā)新型深度學(xué)習(xí)算法,該算法無需制作龐大的數(shù)據(jù)集,只需通過融合多個(gè)模型便可在極度弱光的條件下進(jìn)行精準(zhǔn)檢測(cè)物體及圖像識(shí)別。Socionext笹川幸宏先生和大阪大學(xué)長(zhǎng)原教授在8月23日至28日(英國夏令時(shí)間)舉辦的歐洲計(jì)算機(jī)視覺國際會(huì)議(ECCV 2020)上報(bào)告了這一研究成果。

近年來盡管計(jì)算機(jī)視覺技術(shù)取得了飛速發(fā)展,但在低照度環(huán)境下車載攝像頭、安防系統(tǒng)等獲取的圖像質(zhì)量仍不理想,圖像辨識(shí)性能較差。不斷提升低照度環(huán)境下圖像識(shí)別性能依舊是目前計(jì)算機(jī)視覺技術(shù)面臨的主要課題之一。CVPR2018中一篇名為《Learning to See in the Dark》[1]的論文曾介紹過利用圖像傳感器的RAW圖像數(shù)據(jù)的深度學(xué)習(xí)算法,但這種算法需要制作超過200,000張圖像和150多萬個(gè)批注 [2]數(shù)據(jù)集才能進(jìn)行端到端學(xué)習(xí),既費(fèi)時(shí)又費(fèi)錢,難以實(shí)現(xiàn)商業(yè)化落地(如下圖1)。

圖1:《Learning to See in the Dark》及RAW 圖像識(shí)別課題

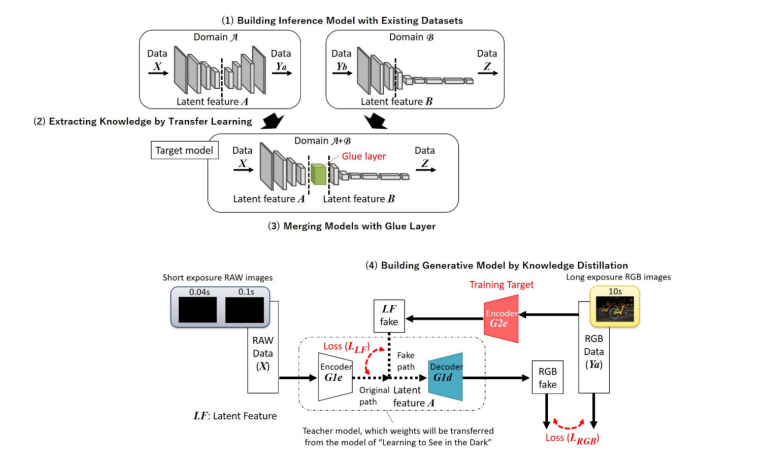

為解決上述課題,Socionext與大阪大學(xué)聯(lián)合研究團(tuán)隊(duì)通過遷移學(xué)習(xí)(Transfer Learning)和知識(shí)蒸餾(Knowledge Distillation)等機(jī)器學(xué)習(xí)方法,提出采用領(lǐng)域自適應(yīng)(Domain Adaptation)的學(xué)習(xí)方法,即利用現(xiàn)有數(shù)據(jù)集來提升目標(biāo)域模型的性能,具體內(nèi)容如下(如圖2):

(1)使用現(xiàn)有數(shù)據(jù)集構(gòu)建推理模型;

(2)通過遷移學(xué)習(xí)從上述推理模型中提取知識(shí);

(3)利用Glue layer合并模型;

(4)通過知識(shí)蒸餾建立并生成模型。

圖2:本次開發(fā)的領(lǐng)域適應(yīng)方法(Domain Adaptation Method)

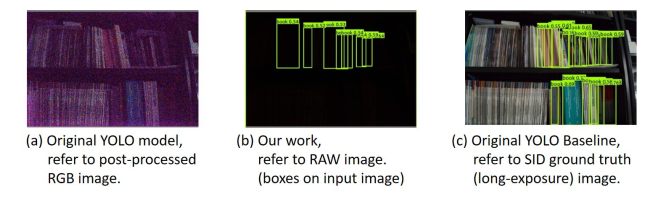

此外,結(jié)合領(lǐng)域自適應(yīng)方法和物體檢測(cè)YOLO模型[3],并利用在極端弱光條件下拍攝的RAW圖像還可構(gòu)建“YOLO in the Dark”檢測(cè)模型。YOLO in the Dark模型可僅通過現(xiàn)有數(shù)據(jù)集實(shí)現(xiàn)對(duì)RAW圖像的對(duì)象檢測(cè)模型的學(xué)習(xí)。針對(duì)那些通過使用現(xiàn)有YOLO模型,校正圖像亮度后仍無法檢測(cè)到圖像的(如下圖a),則可以通過直接識(shí)別RAW圖像確認(rèn)到物體被正常檢測(cè)(如下圖b)。同時(shí)測(cè)試結(jié)果發(fā)現(xiàn),YOLO in the Dark模型識(shí)別處理時(shí)所需的處理量約為常規(guī)模型組合(如下圖c)的一半左右。

圖3:《YOLO in the Dark》效果圖

本次利用領(lǐng)域自適應(yīng)法所開發(fā)的“直接識(shí)別RAW圖像”可不僅應(yīng)用于極端黑暗條件下的物體檢測(cè),還可應(yīng)用于車載攝像頭、安防系統(tǒng)和工業(yè)等多個(gè)領(lǐng)域。未來,Socionext還計(jì)劃將該技術(shù)整合到公司自主研發(fā)的圖像信號(hào)處理器(ISP)中開發(fā)下一代SoC,并基于此類SoC開發(fā)全新攝像系統(tǒng),進(jìn)一步提升公司產(chǎn)品性能,助力產(chǎn)業(yè)再升級(jí)。

歐洲計(jì)算機(jī)視覺國際會(huì)議(ECCV 2020)

日期:8月23~28日(英國夏令時(shí)間)

地點(diǎn):線上會(huì)議

演講主題:YOLO in the Dark - Domain Adaptation Method for Merging Multiple Models -

演講人:Socionext Inc. 笹川幸宏先生

大阪大學(xué) 長(zhǎng)原教授

鏈接:https://eccv2020.eu/

注釋:

[1]“Learning to See in the Dark” : CVPR2018, Chen et al.

[2] MS COCO dataset as an example (https://cocodataset.org/)

[3] YOLO (You Only Look Once): One of the deep learning object detection methods

關(guān)于Socionext

Socionext Inc.是一家全球性創(chuàng)新型企業(yè),其業(yè)務(wù)內(nèi)容涉及片上系統(tǒng)(System-on-chip)的設(shè)計(jì)、研發(fā)和銷售。公司專注于以消費(fèi)、汽車和工業(yè)領(lǐng)域?yàn)楹诵牡氖澜缦冗M(jìn)技術(shù),不斷推動(dòng)當(dāng)今多樣化應(yīng)用發(fā)展。Socionext集世界一流的專業(yè)知識(shí)、經(jīng)驗(yàn)和豐富的IP產(chǎn)品組合,致力于為客戶提供高效益的解決方案和客戶體驗(yàn)。公司成立于2015年,總部設(shè)在日本橫濱,并在日本、亞洲、美國和歐洲設(shè)有辦事處,領(lǐng)導(dǎo)其產(chǎn)品開發(fā)和銷售。

-

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5492瀏覽量

120976 -

Socionext

+關(guān)注

關(guān)注

2文章

74瀏覽量

16600

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

豐田與NTT合作開發(fā)自動(dòng)駕駛軟件

FPGA做深度學(xué)習(xí)能走多遠(yuǎn)?

深度識(shí)別算法包括哪些內(nèi)容

PyTorch深度學(xué)習(xí)開發(fā)環(huán)境搭建指南

深度學(xué)習(xí)算法在嵌入式平臺(tái)上的部署

深度學(xué)習(xí)算法在集成電路測(cè)試中的應(yīng)用

利用Matlab函數(shù)實(shí)現(xiàn)深度學(xué)習(xí)算法

深度學(xué)習(xí)的基本原理與核心算法

深度學(xué)習(xí)模型訓(xùn)練過程詳解

豐田、日產(chǎn)和本田將合作開發(fā)下一代汽車的AI和芯片

深度解析深度學(xué)習(xí)下的語義SLAM

三星電子已開始與Naver合作開發(fā)下一代AI芯片Mach-2

【技術(shù)科普】主流的深度學(xué)習(xí)模型有哪些?AI開發(fā)工程師必備!

目前主流的深度學(xué)習(xí)算法模型和應(yīng)用案例

深度學(xué)習(xí)在人工智能中的 8 種常見應(yīng)用

Socionext聯(lián)手大阪大學(xué)合作開發(fā)新型深度學(xué)習(xí)算法

Socionext聯(lián)手大阪大學(xué)合作開發(fā)新型深度學(xué)習(xí)算法

評(píng)論