還在為圖像加載犯愁嗎? 最新的好消息是,谷歌團隊采用了一種GANs與基于神經網絡的壓縮算法相結合的圖像壓縮方式HiFiC,在碼率高度壓縮的情況下,仍能對圖像高保真還原。

GAN(Generative Adversarial Networks,生成式對抗網絡)顧名思義,系統讓兩個神經網絡相互「磨煉」,一個神經網絡負責生成接近真實的數據,另一個神經網絡負責區分真實數據與生成的數據。

簡單來說,就是一個神經網絡「造假」,另一個神經網絡「打假」,而當系統達到平衡時,生成的數據看起來便會非常接近真實數據,達到「以假亂真」的效果。

下面是這種算法展現出來的圖像與JPG格式圖像的對比。 可見,在圖像大小接近的情況下(HiFiC大小74kB,JPG圖像大小78kB),算法所展現出來的圖像壓縮效果要好得多。

而在與原圖進行對比時,HiFiC所展現出來的還原效果仍然非常優秀。(真的不是在原圖中間畫了條線嗎?)

目前處于特殊時期,大量國外網友仍在家中隔離,Netflix和油管的播放量暴增,一些視頻網站甚至不得不被迫降低視頻在線播放的清晰度,以適應激增的數據量。

但看慣了高清視頻的網友們,面對突如其來的「模糊打擊」自然怨聲載道。

用一位網友的話來說,如果視頻行業也能被應用類似的技術,相信Netflix和油管會特別高興,畢竟這種高清低碼率的圖像復原實在太誘惑。

哇,如果他們可以對視頻做同樣的事情的話,我相信Netflix和YouTube會很高興的。

事實上,在了解HiFiC算法的原理后,會發現它的確不難實現。

接近原圖的圖像重構算法

此前,相關研究已有采用神經網絡進行圖像壓縮的算法,而隨著近年來生成式對抗網絡興起,采用GANs生成以假亂真圖像的算法也不在少數。

如果能有辦法將二者結合,圖像壓縮的效果是不是會更好、更接近于人類的感知?

這次圖像壓縮的模型便是基于二者的特性設計,在基于神經網絡的壓縮圖像算法基礎上,采用GANs進一步讓生成的圖片更接近于人類視覺,在圖像大小和視覺感知間達到一個平衡。

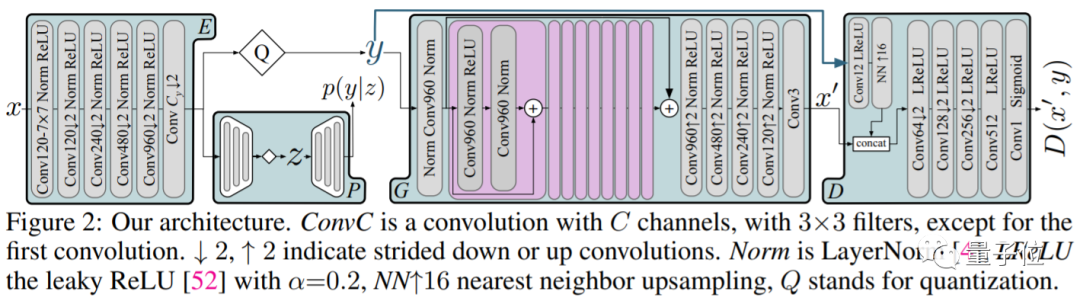

可以看見,HiFiC的架構被分成了4個主要部分,其中E為編碼器,G為生成器,D為判別器,而P則是E的輸出E(x)的概率模型(這里用y表示),也就是P用于模擬y的概率分布。

GANs運作的核心思想在于,需要讓架構中的生成器G通過某種方法,「欺騙」判別器D判定樣本為真。

而概率模型P,則是達成這步操作的條件。

然后,將E、G、P參數化為卷積神經網絡,這樣就可以通過率失真優化的條件,對這些網絡進行共同訓練。

同時,研究者也對已有的幾種GANs算法架構進行了微調,使其更適于HiFiC架構。

研究發現,將GANs與深度學習相結合的HiFiC算法取得了意想不到的效果。

模型評估

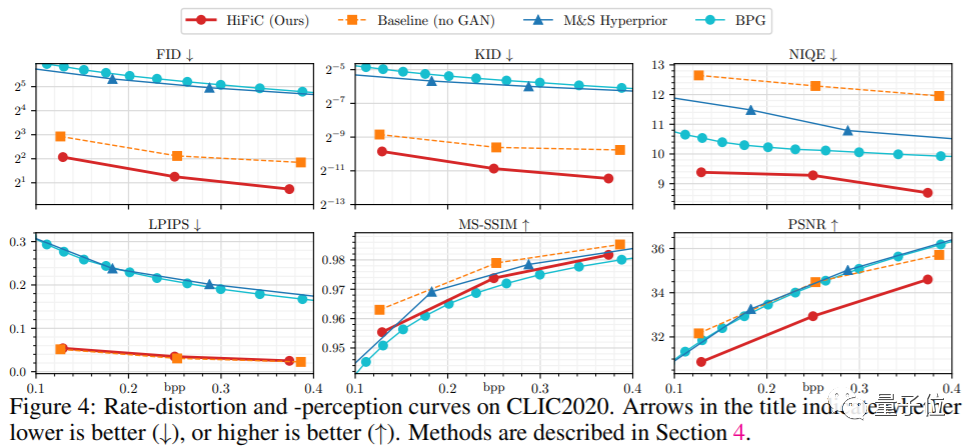

下圖是采用目前幾種主流圖像質量評估標準,對幾種前沿的圖像壓縮算法與HiFiC算法進行比較的結果。

在圖中,評估標準后面自帶的箭頭,表示數據更低(↓)或數據更高(↑)表示圖像質量更好。

為了更好地對比,結果分別采用了HiFiC算法(圖中紅點連線)、不帶GANs的對比算法(圖中橙方連線)、目前較為前沿的M&S算法(圖中藍方連線)和BPG算法(圖中藍點連線)。

從結果來看,HiFiC算法在FID、KID、NIQE、LPIPS幾種評估標準均為最優,而在MS-SSIM和PSNR標準中表現一般。

由評估標準間的差異可見,各項圖像質量標準不一定是判斷壓縮技術的最好辦法。

用戶評測對比

畢竟,圖像是用來看的,最終的判斷權還得交回用戶手里。

圖像究竟是否「清晰」,某種程度上得通過人眼的判斷來決定。

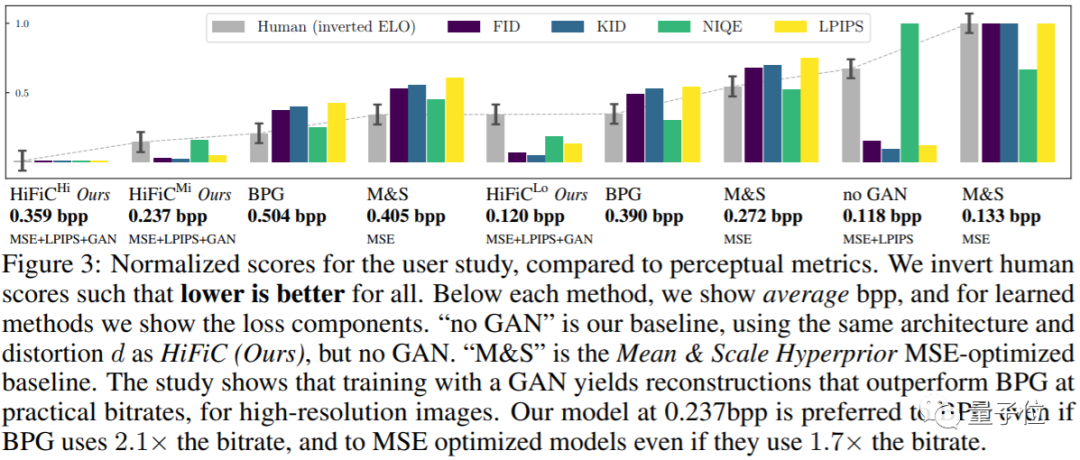

出于這個考慮,團隊采取了調研模式,讓一部分志愿者參與算法的比較。

他們先展示一張測試圖片的隨機裁切圖樣,當志愿者對其中某張裁切圖樣感興趣時,便用這一部分來進行所有算法的對比。

志愿者將原圖與經過算法處理后的圖像對比后,選出他們認為「視覺上」更接近于原圖的壓縮算法。

在所有算法經過選取后,將會出現一個排名,以衡量HiFiC的實際效果。(其中,HiFiC的角標Hi、Mi和Lo分別為設置由高至低3種不同碼率閾值時的算法)

上圖中,評分越低,則代表圖像在用戶眼中「越清晰」。從圖中來看,HiFiC(Mi)在0.237bpp的壓縮效果下,甚至比兩倍碼率的0.504bpp的BPG算法在用戶眼里還要更好。

即使壓縮效果達到了0.120bpp,也比0.390bpp的BPG算法更好。

這項研究再次推動了圖像壓縮技術的發展,正如網友所說,隨著圖像壓縮技術的發展,在線看4k電影也許真能實現。

-

谷歌

+關注

關注

27文章

6142瀏覽量

105109 -

神經網絡

+關注

關注

42文章

4764瀏覽量

100542

發布評論請先 登錄

相關推薦

谷歌采用GANs與神經網絡打造圖像壓縮新算法

谷歌采用GANs與神經網絡打造圖像壓縮新算法

評論