前言

AI芯片(這里只談FPGA芯片用于神經網絡加速)的優化主要有三個方面:算法優化,編譯器優化以及硬件優化。算法優化減少的是神經網絡的算力,它確定了神經網絡部署實現效率的上限。編譯器優化和硬件優化在確定了算力的基礎上,盡量最大化硬件的計算和帶寬性能。經歷了一年多的理論學習,開始第一次神經網絡算法優化的嘗試。之所以從一個FPGA開發者轉向算法的學習,有幾個原因:

第一是神經網絡在AI芯片上的部署離不開算法的優化。一個浮點數的計算(加法或者乘法)和定點數的計算消耗的資源差距很大,對于FPGA這樣邏輯資源有限的芯片而言,定點計算更加友好,而且能夠提升幾倍于浮點計算的性能。

第二是神經網絡量化壓縮需要密切的結合FPGA硬件的特點,需要考慮到FPGA的存儲資源,計算符號是否能夠被FPGA友好的實現等。在AI加速器項目中,算法和FPGA都有各自的開發者,FPGA會對算法組提出要求,比如激活函數量化,normalization如何做等,然后算法組在這些特定要求下去進行算法優化。如果一個人對FPGA和算法都比較熟悉的話,那么就會更容易發現算法優化的點。

第三是FPGA開發方式的趨勢是多樣化。使用RTL語言仍然是主要的開發方法,需要一個人有一定的數字電路基礎。這種開發方式最底層,所以最靈活,可以更好的去調優。但是同時,FPGA一直渴望去突破固有的開發方式,讓一個不懂得硬件的軟件開發人員也可以很容易的上手,同時能夠縮短開發周期,比如HLS。我相信,隨著HLS的發展和FPGA芯片的演進,使用這種方式的開發者會越來越多。在那些算法復雜,更新較快的項目中,HLS更有優勢,而在一些對資源,時序,功耗要求更高的項目中,RTL更有優勢。當硬件平臺逐漸軟件化后,必然會對FPGA開發者的算法能力提出更高的要求。

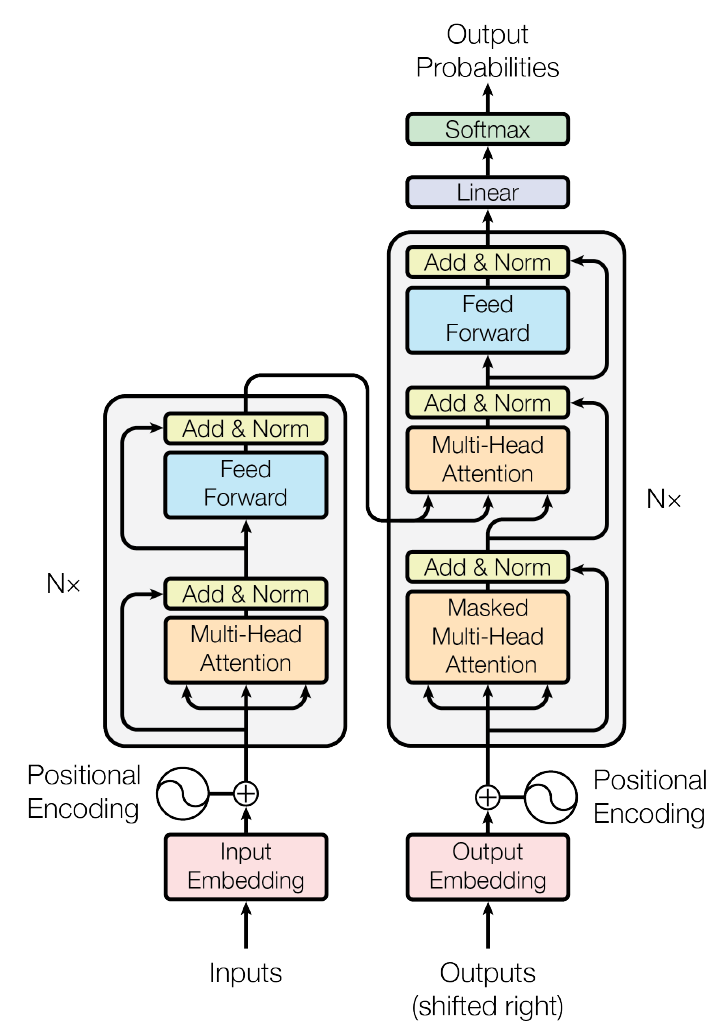

Google在《Attention is all your need》的文章中,提出了使用全attention結構替代LSTM的transformer模型,在翻譯任務上取得了更好的成績。這個網絡結構計算量大,計算符號相對簡單,有一定的應用,所以適合用于網絡加速的展示。結構整體模型如下:

1 embedding

包含了input和output的embedding層,完成詞匯到網絡輸入向量的轉化,embedding的矩陣大小取決于詞匯量的多少,對于翻譯來講,通常都是巨大的,所以其不適合放在FPGA上進行加速,沒有量化的必要。Input和output以及softmax前的linear層都共享相同的參數,這樣做的目的,是因為共享input和output權重能夠降低word level perplexity,當然也降低了參數存儲量。最后的linear使用embedding的權重是為了將網絡向量轉化為詞語出現的logits。

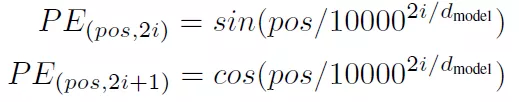

2 positional encoding

Transformer是沒有循環網絡,為了獲取詞匯位置關系信息,對詞匯進行位置編碼。其實就是給每個詞匯加上位置偏移,位置偏移函數選擇了sin和cos函數:

Pos是詞匯位置,i是詞匯向量的維度位置。

3 encoder

由多層的multi-head attention和linear組成,multi-headattention和linear之間由norm和add,add是一個residual連接。

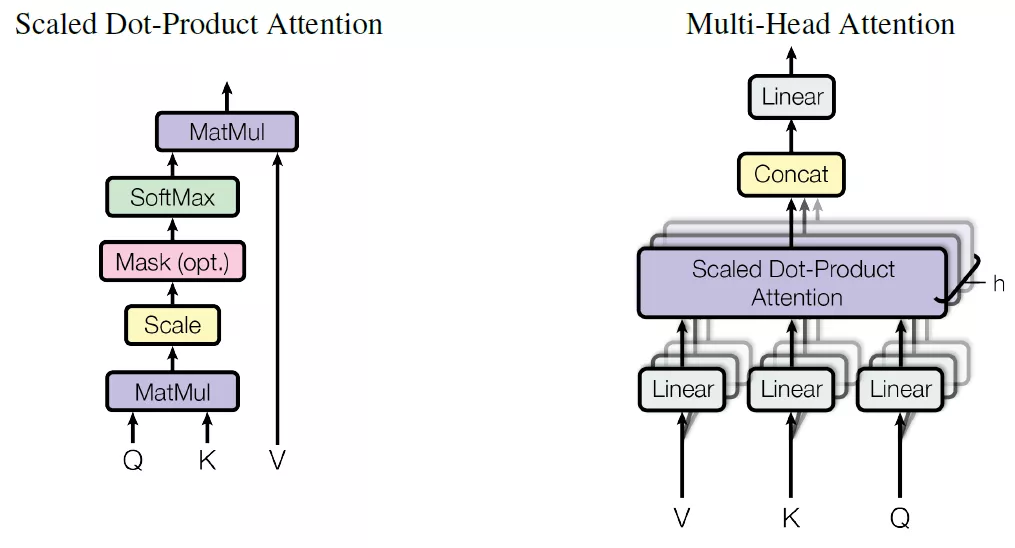

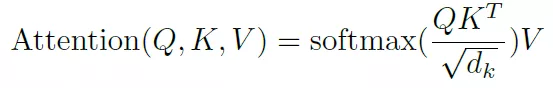

Multi-head attention結構如下:

Q,K,V分別是query,key和value,這是attention機制中抽象出來的三個重要變量,通過計算q和k的相似度,得到每個k對應的v的權重系數,然后對value進行加權求和就得到了attention值。這個是attention機制的本質思想。Transformer中使用softmax函數來描述相似度,當然還有很多其它方法來描述。

這里添加了一個scale1/squart(dk),這其實是一個參數的調節,防止矩陣乘法得到結果太大而導致softmax函數的梯度太小。

這里還要注意transformer網絡沒有對Q,K,V直接進行單一的attention計算,而是對這三個變量進行了拆分,平行計算拆分后的變量,得到的attention值最后在拼接在一起。

4 decoder

Decoder和encoder也有類似的結構,不同的是,在decoder中由三層:mask-multi-head attention,multi-head attention以及FC構成。帶mask的multi-head是為了屏蔽target句子詞之后的詞,因為對句子的翻譯應該是由前向后進行的,后邊的詞語不應該出現在前邊詞語的預測之中。

量化方法

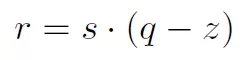

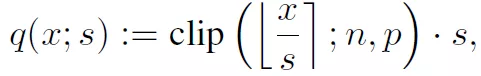

量化實際是一個仿射變換:

Clip操作是在最小值n和最大值p之間獲得x/s的向下整數值,如果x/s向下整數值超過n或者p就取n和p。

S的值通過訓練獲得,為了保證能夠很好的在FPGA上計算,s的值最好可以取得2的冪次。

由于s和x都是需要訓練的參數,所以我們需要求得他們的梯度值,梯度值比較簡單,對q(x, s)的x和x進行求導,有:

對x的梯度使用的是hinton提出的strait-through estimator,這樣做是因為可以消除量化引入的噪聲,更快的訓練。

實踐

transformer中有dense,matmul等操作,需要量化的數據有dense中的權重,matmul中的Q,V,K變量。第一次沒有什么經驗,還是一點點來。首先選擇其中一個dense進行量化。從github上下載了一個transformer的實現源碼https://github.com/Kyubyong/transformer,這個代碼寫的很簡潔,容易看懂。官方的實現代碼比較復雜,需要安裝的庫較多,曾經也嘗試過,因為某些庫無法安裝成功,所以放棄了。在使用Kyubyong的transformer的時候,也遇到了一個問題,訓練可以完成,但是在eval的時候,報了維度的錯誤,后來找到是在positional encoding的embedding中,經過查找,源碼中存在一個bug,就是eval的數據集的maxlen是設置了10000,但是在embedding中傳入的查找表維度是從hparams傳入的,兩者不相同。不知道作者為什么會有這個bug。經過改正可以正常完成eval了。

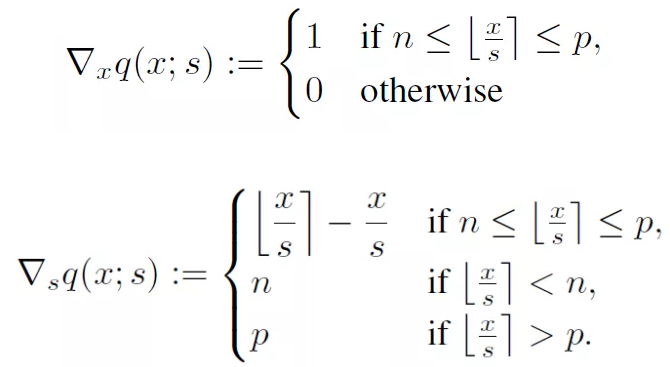

量化第一步是需要將量化插入到tensorflow的圖結構中,即在要量化的權重數據之后。這需要重新定義op和梯度,tensorflow中提供了tf.custom_gradient裝飾函數來對梯度和op進行定義,所以我定義了如下梯度:

其中STE_clip中的y計算了對x的量化值,grad函數是對x和s進行梯度計算。X和s分別是傳入的(d, d)權重和scale。dy是傳入的上一個節點的梯度,所以完成和STE_cllip節點梯度的乘積,這是由函數梯度計算的傳遞性質決定的。這里需要注意的是,s是一個標量,q(x,s)對s梯度是一個矩陣向量,需要和dy進行點積和。

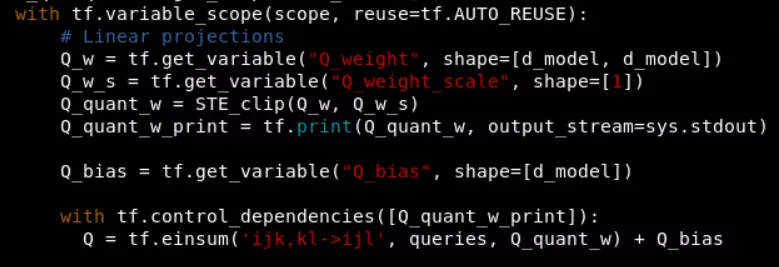

在tensorflow圖構建中,將這個節點插入如下:

這里還添加了tf.print用于打印量化后的數據。

語法錯誤修正:

1 定義的custom_gradient函數中報NoneType object is not iterable,因為函數沒有返回值,默認返回none。

2 TypeError: Input 'e' of 'Select' Op has type float32 that does not match type int32 of argument 't'. 因為使用tf.greater(x, y)x和y應該有相同數據類型。

3 ValueError: Shapes must be equal rank,tf.greater中數據必須具有相同的rank,即維度。

4 ValueError: Shape must be rank 1 but is rank 2,tf.tile(x, axis)中x必須是具有維度的,不能夠是0維。

5 ValueError: Shape must be rank 2 but is rank 3,tf.matmul中兩個矩陣維度必須相同。

6 TypeError: Failed to convert object of type

7 TypeError: Expected int32, got None of type '_Message' instead. 這是因為輸入為[N, T, d_model],其中N開始是none的,所以當使用tf.constant([N,1,1])的時候就會出現錯誤,因為N是none類型。

8 Incompatible shapes between op input and calculated input gradient。輸入的數據和對該輸入數據的梯度維度不一致。

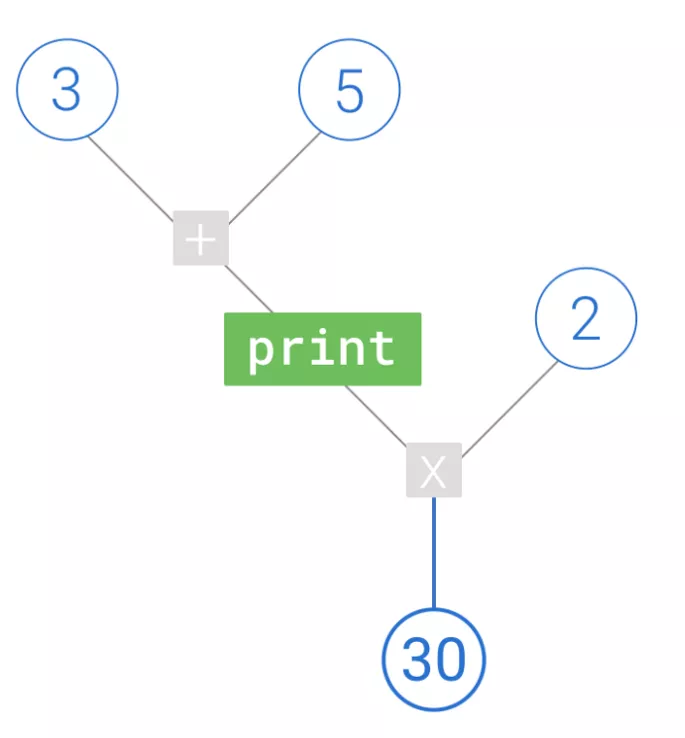

9 使用tf.print無法打印出數據。這是因為print是tensorflow中的一個節點,需要將這個節點加入圖中,然后才能輸出。而且只有計算流經這個print節點,其才會發揮作用。形象的描述應該是:

功能問題:

1 首先就是發現在訓練過程中scale和量化數據都沒有更新,一直保持不變,而且量化值和權重數據以及scale計算的數據不相同。目前還在查找當中。

引用文獻

1 Learning Accurate Integer Transformer Machine-Translation Models,Ephrem Wu

2 Trained uniform quantization for accurate and efficient neural network inference on fixedpoint hardware,Sambhav R. Jain, Albert Gural, Michael Wu, and Chris Dick

3 Attention Is All You Need,Ashish Vaswani,Noam Shazeer,Niki Parmar

4 Quantized Neural Networks: Training Neural Networks with Low Precision Weights and Activations,Itay Hubara,Matthieu Courbariaux,Daniel Soudry

-

FPGA

+關注

關注

1626文章

21678瀏覽量

602040 -

神經網絡

+關注

關注

42文章

4765瀏覽量

100568 -

算法優化

+關注

關注

0文章

4瀏覽量

6261 -

AI芯片

+關注

關注

17文章

1860瀏覽量

34919

發布評論請先 登錄

相關推薦

FPGA芯片用于神經網絡算法優化的設計實現方案

FPGA芯片用于神經網絡算法優化的設計實現方案

評論