根據英偉達官方的消息,在 AWS 運行 NVIDIA GPU 十周年之際,AWS 發布了采用全新 A100 的 Amazon EC2 P4d 實例。

IT之家了解到,現在已全面上市的全新 AWS P4d 實例采用最新 NVIDIA A100 Tensor Core GPU。A100 計算卡采用了 7nm 工藝的 GA100 GPU,這款 GPU 擁有 6912 CUDA 核心和 432 張量核心。GPU 封裝尺寸為 826mm2,集成了 540 億個晶體管。

英偉達表示,全新的 P4d 實例,為機器學習訓練和高性能計算應用提供 AWS 上性能與成本效益最高的 GPU 平臺。與默認的 FP32 精度相比,全新實例將 FP16 機器學習模型的訓練時間減少多達 3 倍,將 TF32 機器學習模型的訓練的時間減少多達 6 倍。

這些實例還提供出色的推理性能。NVIDIA A100 GPU 在最近的 MLPerf Inference 基準測試中一騎絕塵,實現了比 CPU 快 237 倍的性能。

每個 P4d 實例均內置八個 NVIDIA A100 GPU,通過 AWS UltraClusters,客戶可以利用 AWS 的 Elastic Fabric Adapter(EFA)和 Amazon FSx 提供的可擴展高性能存儲,按需、可擴展地同時訪問多達 4,000 多個 GPU。P4d 提供 400Gbps 網絡,通過使用 NVLink、NVSwitch、NCCL 和 GPUDirect RDMA 等 NVIDIA 技術,進一步加速深度學習訓練的工作負載。EFA 上的 NVIDIA GPUDirect RDMA 在服務器之間可通過 GPU 傳輸數據,無需通過 CPU 和系統內存,從而確保網絡的低延遲。

責任編輯:PSY

-

cpu

+關注

關注

68文章

10824瀏覽量

211140 -

gpu

+關注

關注

28文章

4700瀏覽量

128697 -

機器學習

+關注

關注

66文章

8377瀏覽量

132406 -

英偉達

+關注

關注

22文章

3743瀏覽量

90831 -

A100

+關注

關注

0文章

27瀏覽量

7785

發布評論請先 登錄

相關推薦

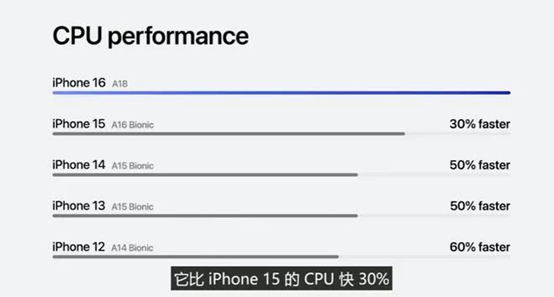

蘋果 A18 芯片發布:CPU 提升 30%、GPU 提升 40%

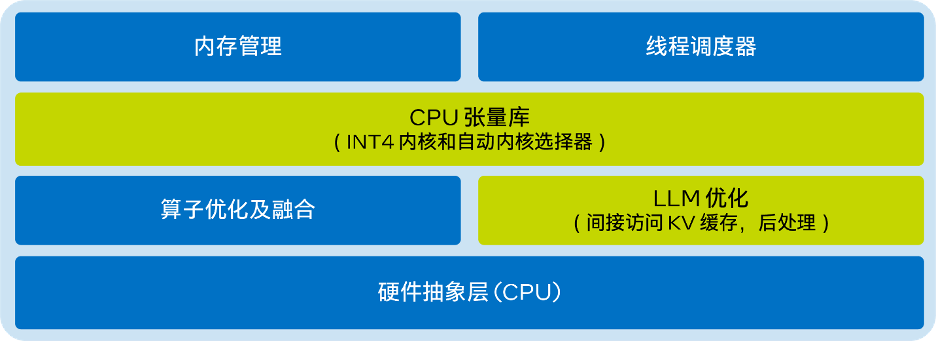

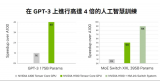

開箱即用,AISBench測試展示英特爾至強處理器的卓越推理性能

英偉達將全面轉向開源GPU內核模塊

成都匯陽投資關于英偉達 GB200+終端快速放量,這一材料需求快速提升

進一步解讀英偉達 Blackwell 架構、NVlink及GB200 超級芯片

英偉達縮短AI GPU交付周期,持續推進算力產業鏈發展

英偉達和華為/海思主流GPU型號性能參考

用上這個工具包,大模型推理性能加速達40倍

英偉達 A100 GPU 全面上市,推理性能比 CPU 快 237 倍

英偉達 A100 GPU 全面上市,推理性能比 CPU 快 237 倍

評論