近年來,各類短視頻、視頻應用如雨后春筍般涌現, “AI+ 視頻"的模式也是近期的熱點方向。奇觀是愛奇藝原創推出的 AI 創新應用產品,它融合了多模態人物識別、卡通角色識別、臺詞實體抽取、BGM 識別等 AI 技術,支持用戶在觀影過程中識別視頻中的明星人物、卡通角色、背景音樂和臺詞梗等視頻內信息。

為了進一步了解愛奇藝在“AI+ 視頻”方向上的探索,在 QCon 上海站前夕,InfoQ 有幸采訪了愛奇藝技術總監朱俊敏,聽他分享愛奇藝奇觀如何融合了多模態人物識別、卡通角色識別、BGM 識別、臺詞實體抽取等多種 AI 技術來挖掘視頻的周邊內容。

愛奇藝在“AI+ 視頻”上的探索

作為視頻平臺,愛奇藝一直致力于人工智能與視頻、娛樂產業的結合,并陸續推出了針對內容創作、用戶推薦等方面的智能產品。奇觀 是愛奇藝原創推出的 AI 創新應用產品,截至今年 7 月,奇觀功能累計使用量已超 20 億次。

據愛奇藝技術總監朱俊敏介紹,作為一款融合了多模態人物識別、卡通角色識別、臺詞實體抽取、BGM 識別等 AI 技術的產品,奇觀的萌芽需求來源于用戶。當時愛奇藝在分析用戶的彈幕時發現,有一定比例的用戶都在詢問“當前的演員是誰?”, “背景音樂是啥?” 等跟視頻強相關的問題。原來用戶獲取該類問題的答案路徑是通過愛奇藝搜索或者百度搜索,但是效果并不是很好,造成這一結果的原因主要有兩方面:一方面是因為用戶需要打破原來沉浸式的觀影體驗;另一方面在于搜索無法做到海量內容實時索引,內容熱播的時候一般是無法搜索到用戶想要的結果的。

為了解決上述問題,愛奇藝于 2019 年首先在 TV 端進行了一些嘗試。用戶在觀影時(當時的名字叫 AI 雷達),可以通過遙控上鍵識別視頻中的明星,奇觀產品推出后得到用戶的一致好評,功能滲透率超出團隊的預期。

后來,研發團隊又將該功能擴展到移動端,通過雙指雙擊的簡單手勢觸達更多的用戶群體,滿足用戶了解內容背后知識的需求。識別能力也逐漸從原來的明星識別, 擴展到背景音樂識別,臺詞實體知識,卡通角色識別等。

對紛繁復雜的明星、背景音樂、卡通角色等元素的精準識別并不是件容易事。就拿多模態人物識別來說,愛奇藝針對視頻中人物身份識別的難點進行了全方位的優化改進,利用人臉質量模型顯著減低了誤檢、差臉的干擾,綜合利用人臉、人頭、人體、聲紋等多維度特征信息,通過局部加全局聚類的方式,對視頻中的人物進行識別,大幅度提高了識別精度和召回。同時,團隊還提供人臉的多維度屬性標簽,如年齡、男女、顏值等,并將屬性標簽和人臉識別模型進行整合,在保證精度的情況下,顯著降低資源開銷、提高資源利用效率。目前線上模型包含 10+ 個屬性,相較于工業界的其他模型更加全面。愛奇藝人臉識別與屬性模型十五合一,一個模型可以同時識別身份屬性,且各項屬性的識別精度也比較高。目前線上奇觀服務的明星識別準確率達 99.5%。

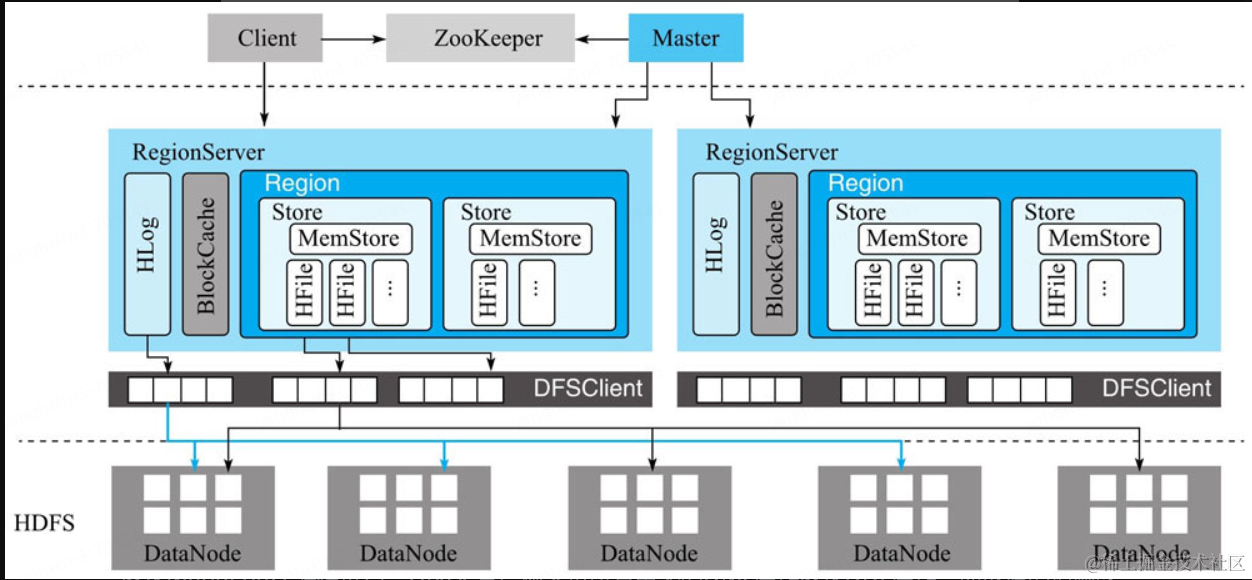

多模態人物識別技術的技術實現框圖如下:

朱俊敏坦言,為了達到 99.5% 的明星識別準確率,算法團隊付出了諸多努力。首先,他們分別訓練了人臉、人頭、人體和聲紋特征的提取模型。再在人臉的幀級特征上增加了一個 NetVLAD 模塊,將幀級特征轉換成視頻維度的特征,這樣可以充分利用幀級人臉信息,提高特征的表達能力。在特征融合層,為了充分利用多模態特征,并且降低了噪聲的干擾,團隊還創新性地提出了 Multi-model Attention 模塊來自適應地對各個模態分配不同的權重,并基于這些權重來進行多模態特征的融合,顯著提高了算法的魯棒性,大幅度提高了視頻人物識別的精度。

下面的表格是研發團隊從人臉特征開始逐漸增加多模態特征信息、NetVLAD 和 MMA 模塊的精度收益情況,從表中可以得出,隨著多模態信息的增加,愛奇藝的人臉識別精度穩定提升,這充分驗證了愛奇藝多模態人物識別方法的有效性。

這樣一項識別準確度高、廣受好評的產品,其實它的研發周期并沒有十分漫長。朱俊敏表示,多年來,愛奇藝在 NLP、聲音和視覺的 AI 能力方面有深厚的積累,得益于愛奇藝長期對算法團隊的投入,當決定做奇觀產品時,大部分的算法和基礎設施已經比較成熟。團隊只需從用戶需求出發,根據實際場景對算法和方案進行策略調整,快速實現產品化。朱俊敏稱:

如果將奇觀比喻為一棟房子,多模態人物識別、卡通角色識別、BGM 識別等 AI 技術就是地基。正是因為對 AI 長期的投入,有堅實的地基以支撐愛奇藝蓋出更漂亮的房子。

識別方案如何從云遷移到端

從奇觀萌生開始,研發團隊就決定采用純云端的識別方案,之所以會做出這樣的決定,朱俊敏介紹,主要是考慮到算法的復雜度,在客戶端既要播放視頻(需要處理解碼和上屏),又要處理 AI 算法,芯片性能可能跟不上,而且手機的散熱和電池問題也會比較突出,所以奇觀一開始定方案的時候是采用純云端的識別方案。

后來,隨著算法的優化和解耦,以人物識別為例,實現檢測和識別的解耦,而且人臉檢測的算法做到足夠輕量級,實現 CPU 可流暢推理。團隊開始尋求實現云 + 端的模式, 把算法解耦,檢測部署在端上,識別部署在云端。這樣做的好處是:一方面,在端上做檢測,可以過濾很多無人物的情況,減少網絡傳輸和云端識別的計算資源浪費;另一方面,端上做檢測,在用戶交互體驗可以更優,實現人物區域可跟蹤。

端上的識別方案不是云端方案的簡單復刻,朱俊敏提到,在實現“云 + 端”的過程中,其難點主要在于兩方面:一方面是芯片的適配,原來云端 GPU 的算法,考慮到客戶端上 GPU 的參差不齊,需要把算法改造成 CPU 推理模式。另一方面,算法模型遷移到客戶端,需要考慮到客戶端本身的限制,不能顯著增加整體 app 安裝包的大小。所以為了適配客戶端,算法本身需要做 CPU 遷移,并通過蒸餾壓縮模型大小,同時還需要客戶端的工程師配合集成相應的算法 runtime,同時建立模型動態加載的機制,盡可能地減少客戶端的包的大小。

“云 + 端”模式將更快普及和應用

隨著 5G 的逐步發展,朱俊敏認為,“云 + 端”這種模式會得到更快的普及和應用。5G 將作為一種全新的網絡架構,提供 10Gbps 以上的峰值速率、更佳的移動性能、毫秒級時延和超高密度連接。而且客戶端的性能越來越強,前面提到的云 + 端難點將不再是問題。這樣可以給算法部署和應用更多的靈活性,業務可以根據自己場景和用戶體驗來決定是否將更多的算法部署到客戶端。

而且 5G 網絡的特性,決定其更加去中心化,需要在網絡邊緣部署小規模或者便攜式數據中心,進行終端請求的本地化處理,也就是人們所說的邊緣計算,將來的服務可能會進一步從“云 + 端”過度到“云 + 邊 + 端”的模式上。

除了在“云 + 端”模式上繼續發力外,奇觀下一步的重點會繼續擴展識別的品類。比如:動植物的百科實體類識別;電子產品和汽車等標準品的識別;以及各類穿著垂類商品的識別。另一方面會繼續優化現有的識別體驗,提高整體有結果率,目標是實現應有盡有的識別。

因為身處在內容行業,朱俊敏還表示,他會繼續關注 AI 在聲音和視覺上的算法創新,探索交互方面的新場景,未來,希望看到 AI 在內容創意和創作方面也能發揮上賦能提效的作用。

嘉賓介紹:

朱俊敏,愛奇藝技術總監。上海交通大學碩士,擁有 3 篇美國專利, 8 篇中國專利。2015 年加入愛奇藝,負責 AI 產品落地和創新應用開發,先后孵化了 HomeAI(智能語音交互平臺), 奇觀(智能識別平臺),逗芽(表情生產和分發平臺) 等創新應用。

本文轉自 公眾號:AI前線 ,作者李冬梅,點擊閱讀原文

審核編輯:符乾江

-

人工智能

+關注

關注

1791文章

46859瀏覽量

237579 -

深度學習

+關注

關注

73文章

5492瀏覽量

120978

發布評論請先 登錄

相關推薦

從TMS320VC5509遷移到TMS320VC5509A

從TMS320DM6467遷移到TMS320DM6467T

從TMS320DM6446 594MHz遷移到810MHz

IT資源遷移到云服務器的關鍵因素

華納云:企業遷移到云端的主要原因是什么?

龍智Atlassian ITSM解決方案、云遷移解決方案詳解:高速ITSM實施+端到端的云遷移服務

愛奇藝技術總監:奇觀識別方案從云遷移到端的探索和實踐

愛奇藝技術總監:奇觀識別方案從云遷移到端的探索和實踐

評論