Deepfake是一種換臉技術(shù),可以將圖片或視頻中A的臉換到B的頭上。其名字由深度機器學習(deep machine learning)和假照片(fake photo)組合而成。這項技術(shù)不需要操作者具備深厚的專業(yè)知識,只要收集到足夠素材,AI就可以完成。Deepfake換臉效果逼真,讓人難以分辨真假,這也引發(fā)了眾多倫理和隱私問題。

史泰龍和施瓦辛格兩位好萊塢頂級流量功夫巨星最近一次合體出現(xiàn)在大銀幕上,還是在2013年上映的《金蟬脫殼》中,這讓不少影迷意猶未盡。11月22日,一篇報道稱,國外視頻網(wǎng)站上一部名為《Step Brother》的電影短片,借助Deepfake技術(shù),把兩位巨星的面部替換到了兩名小眾演員臉上,而且人臉表情自然,毫無痕跡,這讓不少網(wǎng)友驚嘆:太恐怖。此外,在最近的國內(nèi)熱播劇《了不起的兒科醫(yī)生》中也使用了這種AI換臉技術(shù)。

根據(jù)安全分析公司Sensity最新調(diào)查結(jié)果,自2018年12月以來,Deepfake在線造假視頻的數(shù)量大約每6個月翻一番,而截至2020年6月,造假視頻已經(jīng)多達49081個,比2019年7月增長了330%。

Deepfake技術(shù)讓視頻換臉變得越來越簡單,如何打假“李鬼”,讓其避免成為假視頻的“幫兇”已成為當務之急。

用視頻“大變活人”分幾步

Deepfake這種技術(shù)堪稱現(xiàn)代網(wǎng)絡“易容術(shù)”,是比PS強大很多的動態(tài)換臉技術(shù)。“目前Deepfake技術(shù)已經(jīng)很成熟了,主要技術(shù)分為兩個部分,自動編碼器和生成對抗網(wǎng)絡。”天津大學智能與計算學部教授翁仲銘介紹。

自動編碼器是一種神經(jīng)網(wǎng)絡技術(shù),就是把一個人的照片特征抓取出來,然后用數(shù)字代表。但是抓取一個人的面部特征時,不可能抓取所有狀態(tài)下的特征,比如說話、哭和笑等,那么就必須將沒有的表情用數(shù)字模擬的方式展現(xiàn)出來。通過訓練,就可以找出一個最好的用數(shù)學方式來呈現(xiàn)照片特征的編碼器。

有編碼器就需要解碼器,解碼器會把一串串數(shù)字再還原成照片。不同解碼器可以在演員身上還原不同照片,比如史泰龍解碼器可以還原史泰龍照片,而還原施瓦辛格照片則需要施瓦辛格的解碼器。具體操作是先使用編碼器分別抽取小眾演員和史泰龍的特征,而后再使用史泰龍的解碼器還原,從而得到史泰龍的臉和小眾演員的表情。

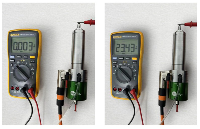

“Deepfake就是在設計、訓練精準的編碼器和解碼器。”翁仲銘介紹,因為編碼器是抓取照片的特征,所以基本上只需要一套就可以了。可是解碼器就需要訓練很久,因為把一連串的數(shù)字特征,拼接到小眾演員身上,而且要變得很像,就需要長時間訓練。以換成史泰龍的臉為例,這個過程需要輸入史泰龍600—3000張照片并經(jīng)過48—72小時來訓練深度模型。

“自動編碼器做出的照片是否自然真實還需要去判別把關(guān),這就需要生成對抗網(wǎng)絡技術(shù)。”翁仲銘解釋,這包括兩個機器學習模型,分別為生成網(wǎng)絡和辨別網(wǎng)絡。生成網(wǎng)絡扮演“造假者”,在模型訓練后產(chǎn)生偽造影片;而辨別網(wǎng)絡則扮演“檢測者”,不斷地檢視假影片,直至它再辨別不了結(jié)果是假的。數(shù)據(jù)越多,效果越理想,假影片越真實。

換臉門檻越來越低

其實這種動態(tài)換臉技術(shù)最早是被用于影視后期制作,但是以前影視作品中的人臉交換操作起來非常復雜,只有專業(yè)視頻剪輯師和公共網(wǎng)關(guān)接口專家才能完成,并且需要花費大量時間和精力。

但隨著Deepfake這樣公開且輕量化技術(shù)的出現(xiàn),這個技術(shù)的使用門檻也越來越低了。特別是設計架構(gòu)Deepfake技術(shù)的“大神”將代碼上傳到了一個自由共享代碼的網(wǎng)站Github,讓這項技術(shù)更容易獲得。

利用Deepfake技術(shù),即使是一個對視頻剪輯一竅不通的外行,也只需一個強大的GPU(圖形處理器)和上百張人物樣圖,輸入至少一個算法,就能完成人臉交換,并且可以制作出非常逼真的視頻效果。“普通人在經(jīng)過一段時間的學習以后,完全能夠掌握這項技術(shù)。”翁仲銘感嘆。

“雖然現(xiàn)在這項技術(shù)操作起來簡便,但是原來要用軟件實現(xiàn)這個過程是非常艱難的。”翁仲銘解釋,視頻中人是動態(tài)的,比如一個60幀(fps)的視頻中,每秒鐘畫面更新60次,如果是PS的話需要處理60張靜態(tài)圖片,然后將其前后連接起來形成一個動態(tài)圖。一個短視頻動輒數(shù)分鐘,甚至十多分鐘,如果按照一分鐘處理3600張計算,一個幾分鐘的短片也要處理多達上萬張照片,所以需要強大算力的GPU來支撐。

翁仲銘認為,近些年隨著GPU的發(fā)展,其算力越來越強大,也使得Deepfake技術(shù)處理照片越來越輕松,使用越來越方便。這可能也是2018年12月以來,造假視頻成倍增長的原因之一。

以技制技打假“李鬼”還不夠

如此強大的“黑科技”采用了最先進的人工智能技術(shù),通過比較簡單的運算,就有可能生成以假亂真的視頻。但是Deepfake技術(shù)在運行幾天之后,就遭到了唾棄,被全球封禁,還被世人稱為“最邪惡”的技術(shù)。

因為太過以假亂真,其破壞力不可估量。事實證明,人們的擔心并非杞人憂天。Deepfake第一次亮相就是將《神奇女俠》蓋爾·加朵的臉,嫁接到了一部成人電影女主角身上。此外由Deepfake制作的假視頻已引發(fā)多起刑事案件,甚至卷入政治紛爭。

不過再完美的技術(shù)也不是無懈可擊的,專家們提出了幾種辨識Deepfake換臉視頻的方法:比如眨眼率,通過Deepfake制作的對象的眨眼率少于正常人;語音和嘴唇運動的同步狀況;情緒不符合;模糊的痕跡、畫面停頓或變色。不過翁仲銘表示,這些方法,Deepfake通過加強對樣本的學習,都可以解決,遲早會有人可以通過Deepfake技術(shù)制造出人類用肉眼無法識別的“假臉”。

“也有不少人想到以AI對抗AI。”翁仲銘介紹,美國國防部研發(fā)了全球首款“反AI變臉刑偵檢測工具”,專門用于檢測AI變臉或換臉造假技術(shù)。不過,人工智能基金會的研究副主席戴利普承認,現(xiàn)時Deepfake檢測算法的準確率,即使可高達97%,但鑒于互聯(lián)網(wǎng)規(guī)模非常大,余下的3%仍然極具破壞力。

目前還有一個識別Deepfake換臉的新思路,叫作“活體取證”,該技術(shù)主要是根據(jù)分辨率、三維信息、眼動等來區(qū)分真假,因為翻拍的照片分辨率和直接從真人上采集的照片在質(zhì)量、分辨率上比都有差別。

“整個算法遵循的觀察規(guī)律是:生物信號還沒有保存在假視頻中,這些信號在生成噪聲時也產(chǎn)生了不同的標識。”翁仲銘解釋,換句話說,假視頻中顯示的“人”不會表現(xiàn)出與真實視頻中的人相似的心跳模式,通過這種方法可以找到每個生成模型的唯一簽名(標識)。值得一提的是,無論遮擋、照明條件如何變化,這些標識在真實視頻中是不存在的。利用這些標識可以找到假視頻背后的生成模型,然后反過來提高整體的假視頻檢測精度。

“道高一尺魔高一丈,利用Deepfake技術(shù)的人也在不斷改進換臉的水平,因此從長遠來看,我們必須尋求更有力的方法來維護和證明社交媒體信息的真實性。目前幾乎沒有任何工具可以幫助讀者確信其在網(wǎng)上看到的信息來源可靠,且沒有被篡改。”翁仲銘強調(diào),改善這種情況需要從視頻發(fā)布源頭進行管理,比如實名制,同時加強立法,增加網(wǎng)絡警察巡邏等,嚴厲打擊這種造假行為。

責任編輯:tzh

-

gpu

+關(guān)注

關(guān)注

28文章

4701瀏覽量

128705 -

AI

+關(guān)注

關(guān)注

87文章

30146瀏覽量

268418 -

機器學習

+關(guān)注

關(guān)注

66文章

8377瀏覽量

132409

發(fā)布評論請先 登錄

相關(guān)推薦

AI模型部署和管理的關(guān)系

什么是換電系統(tǒng)?驅(qū)動電動汽車未來的“能源驛站”

AI即服務平臺的安全性分析

OPA615做峰值保持,輸出一直有1v的門檻電壓,為什么?

“AI換臉”掠走數(shù)百萬美金,跨境支付企業(yè)如何應對深度偽造風險?

壓縮空氣儲能發(fā)電國家制止嗎

自動換刀主軸應用領(lǐng)域有哪些?

滴滴與寧德時代成立換電公司

SycoTec 4033 AC氣動自動換刀與電動自動換刀技術(shù)詳解

AI換臉門檻漸低,如何制止走向墮落?

AI換臉門檻漸低,如何制止走向墮落?

評論