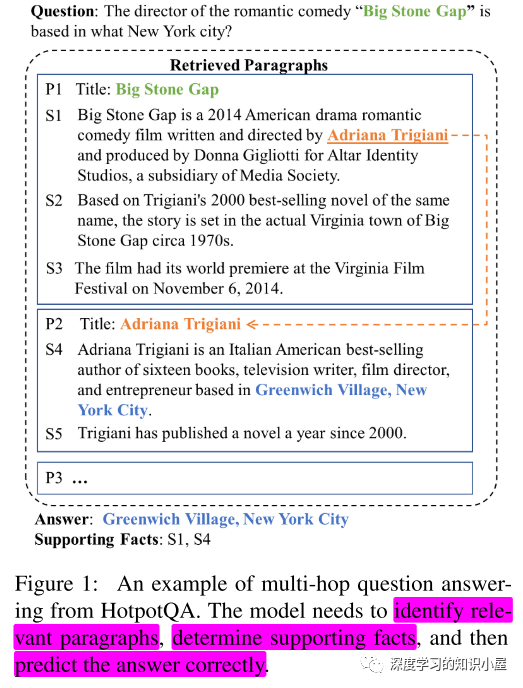

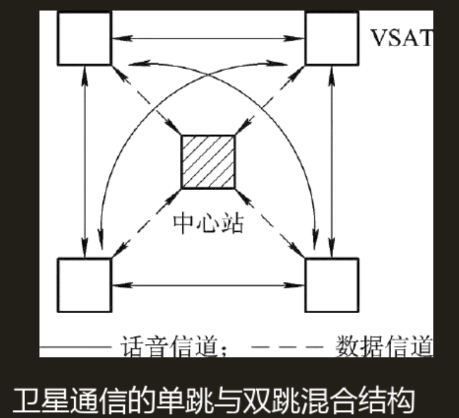

這是一篇關于多跳問答(multi-hop QA)任務的論文,不同于單跳QA,multi-hop QA任務下問題的答案需要對多個段落或篇章進行多跳推理。

然而,現(xiàn)有的相關工作仍舊存在一些挑戰(zhàn)與困難需要被進一步研究:

現(xiàn)有工作會使用類似信息檢索的思想來查找問題相關的段落,然后用MRC任務中類似的方法來找到問題的答案,但存在的問題是: 怎么將散落在不同語義粒度(段落、句子、實體)的信息聚合起來,用于問題答案和支撐事實發(fā)現(xiàn)的聯(lián)合預測;

為了更好地利用文中用于answer發(fā)現(xiàn)的evidence, 一些工作通過構建實體級別的圖結構來進行推理;然而,基于實體圖的方法能夠用于預測問題的答案,卻不能用于支撐事實的發(fā)現(xiàn)。

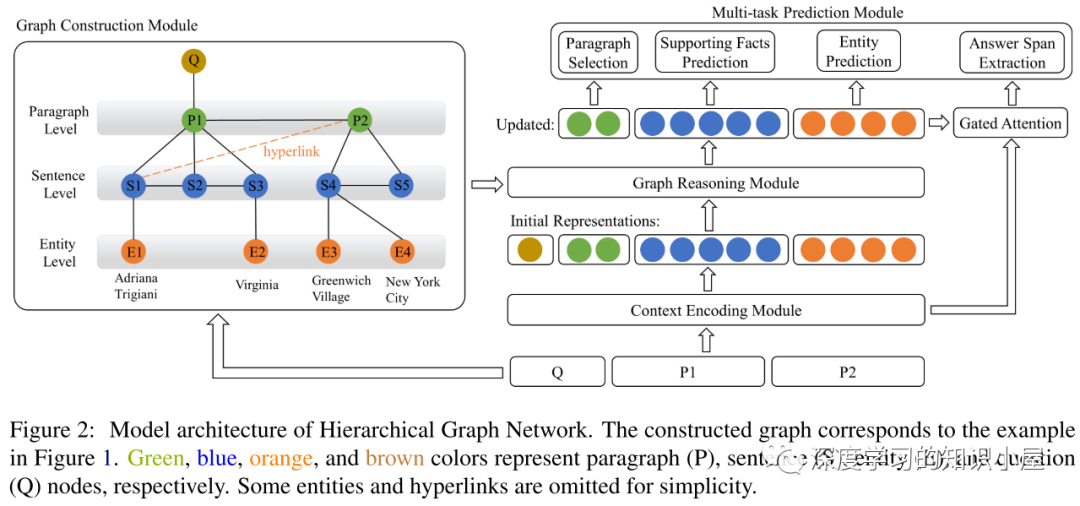

基于以上問題,作者設計了Hierarchical Graph Network (HGN)來進行multi-hop QA 任務,較之以往工作,它有以下三個特點:

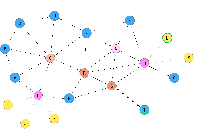

具有四種類型的節(jié)點,分別是問題節(jié)點、段落節(jié)點、句子節(jié)點 和 實體節(jié)點,不同類型的節(jié)點可分別用于multi-hop QA下的不同步驟下的子任務中;

引入預訓練語言模型來學習文本的上下文表示,并得到節(jié)點的初始化表示,再通過圖網絡進一步更新節(jié)點表示;

由于問題的答案不一定是一個實體,因此在答案預測時引入 span prediction 來發(fā)現(xiàn)非實體的問題答案。

具體地,HGN模型由如下部分構成:

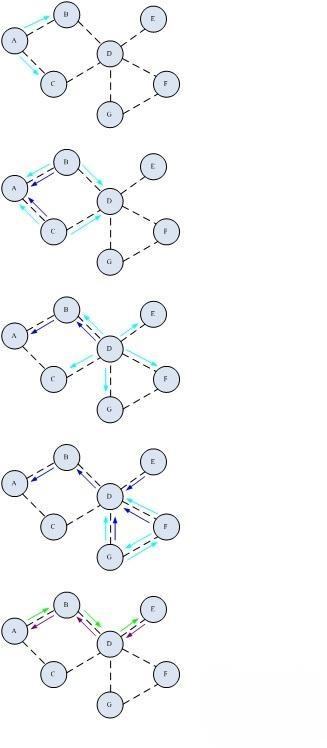

Graph Construction Module: 分層圖構建模塊,包括三個步驟: 通過title matching 選擇與問題相關的段落、發(fā)現(xiàn)段落中能夠提供指向其他段落證據(jù)的實體、句子,基于以上兩邊得到了圖中所需的節(jié)點,再根據(jù)規(guī)則在節(jié)點之間添加上連邊。

Context Encoding Module:使用Roberta和BiLSTM對文本進行編碼,得到問題節(jié)點、段落節(jié)點、句子節(jié)點的初始表示。

Graph Reasoning Module:使用圖注意力機制在節(jié)點之間進行信息傳遞,更新節(jié)點的表示。

Multi-task Prediction Module:分步進行如下三個子任務: 基于段落節(jié)點的段落選擇、基于句子節(jié)點的支撐事實預測、以及基于實體節(jié)點答案預測 以及基于上下文表示和span prediction的非entity答案預測。

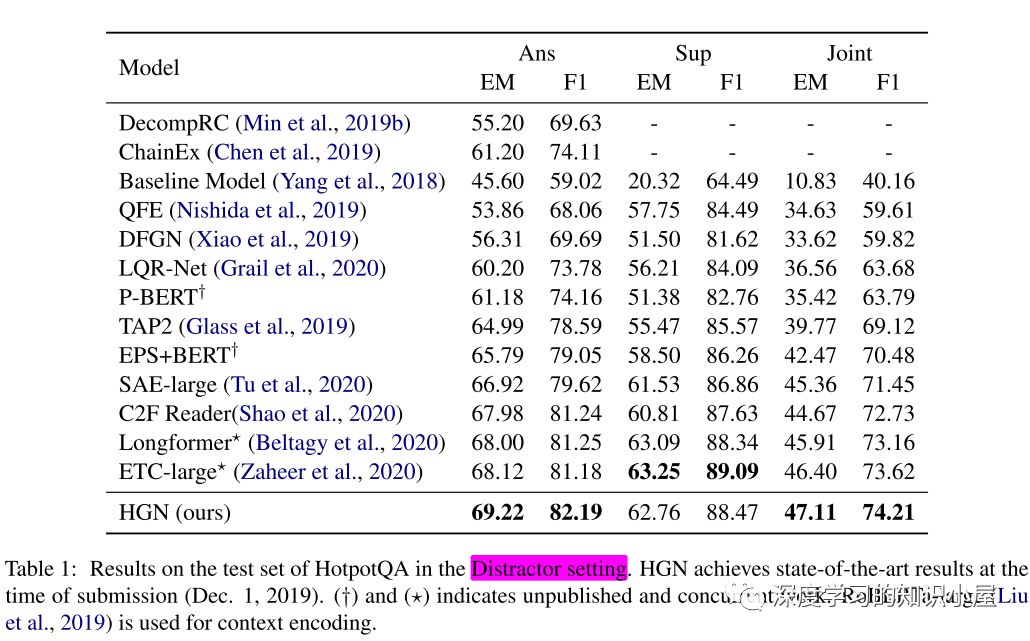

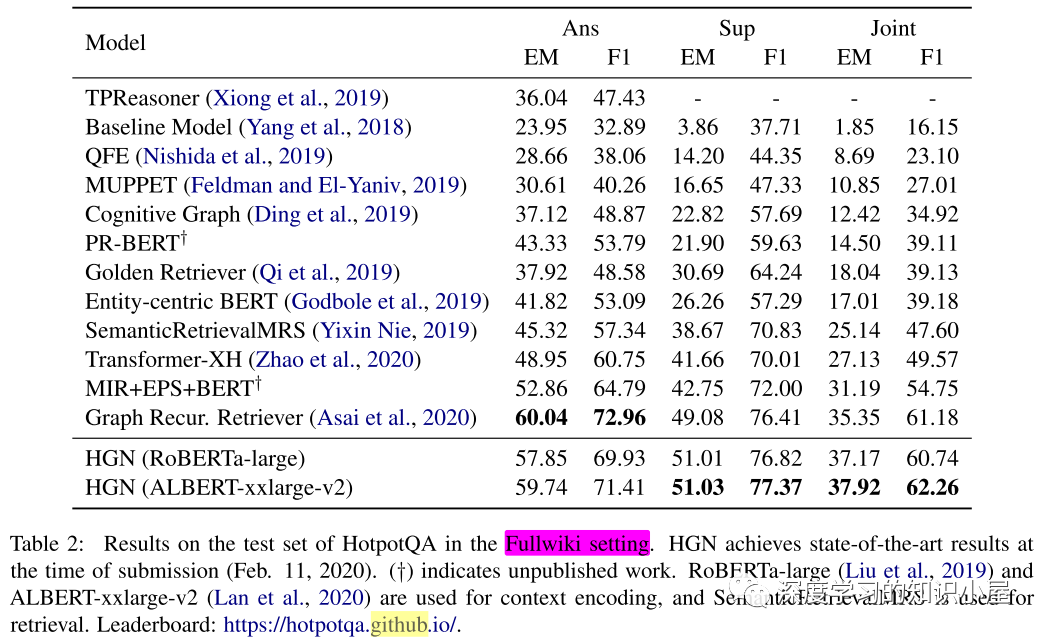

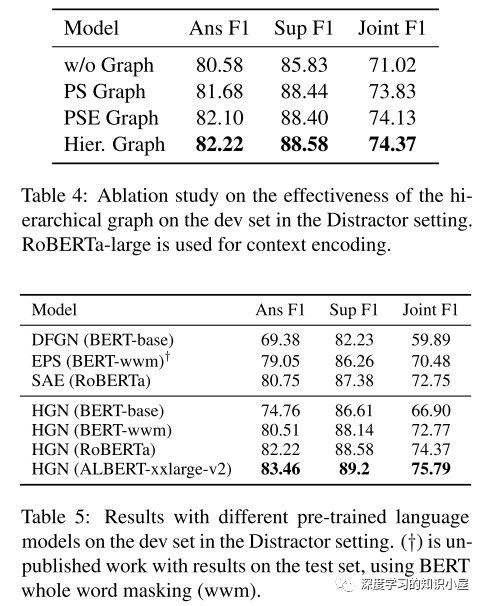

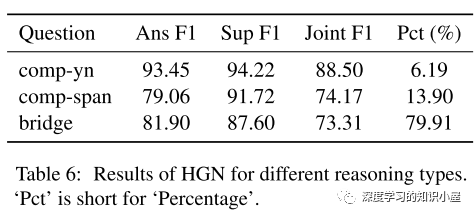

作者使用HGN模型在HotpotQA 數(shù)據(jù)集上進行實驗,在兩種任務設置下,都在Answer Prediction與Support Fact Prediction的聯(lián)合任務上都取得了sota效果。

最后,作者又進行了一系列的分析,包括誤差分析、消融實驗、不同預訓練模型對實驗結果的影響以及HGN在不同推理類型下的性能。

責任編輯:xj

原文標題:【每日一讀】EMNLP2020: 面向多跳問答的分層圖網絡

文章出處:【微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

-

網絡

+關注

關注

14文章

7519瀏覽量

88638 -

分層圖

+關注

關注

0文章

2瀏覽量

5696 -

深度學習

+關注

關注

73文章

5493瀏覽量

120983

原文標題:【每日一讀】EMNLP2020: 面向多跳問答的分層圖網絡

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

藍牙Mesh模塊多跳大數(shù)據(jù)量高帶寬傳輸數(shù)據(jù)方法

跳頻濾波器的工作原理及優(yōu)勢是什么

商湯科技與海通證券攜手發(fā)布金融行業(yè)首個多模態(tài)全棧式大模型

緩跳式和突跳式溫控開關區(qū)別大揭秘

關于多跳通信和單跳通信兩種方式有什么區(qū)別

NVIDIA 知乎精彩問答甄選 | 探索 AI 如何推動工作流升級相關精彩問答

WiMinet 評說1.2:多跳無線網絡的困境

WiMinet評說1.2:多跳無線網絡的困境

WiMinet 評說1.1:多跳無線網絡的現(xiàn)狀

低成本擴大輸入分辨率!華科大提出Monkey:新的多模態(tài)大模型

NVIDIA 知乎精彩問答甄選 | 查看關于 NVIDIA Omniverse 的相關精彩問答

多跳問答任務:面向多跳問答的分層圖網絡

多跳問答任務:面向多跳問答的分層圖網絡

評論