發布人:Google Research 軟件工程師 Candice Schumann 和 Susanna Ricco

2016 年,我們推出了 Open Images。此協作版本包含約 900 萬張含有標簽的圖像,涵蓋數千個對象類別和 600 個類的邊界框注釋。從那之后,我們進行了多次更新,如將眾包數據發布到 Open Images Extended 合集,以此提高對象注釋的多樣性。

更新

https://ai.googleblog.com/2019/05/announcing-open-images-v5-and-iccv-2019.html

Open Images Extended

https://storage.googleapis.com/openimages/web/extended.html

雖然這些數據集提供的標簽擴展性很強,但此類標簽并沒有關注人物的敏感屬性,這些屬性對于許多機器學習 (ML) 公平性任務(例如公平性評估和偏見緩解)至關重要。事實上,找到包含徹底標記此類敏感屬性的數據集是很困難的,尤其是在計算機視覺領域。

公平性任務

https://developers.google.com/machine-learning/crash-course/fairness/video-lecture

今天,我們在 Open Images Extended 合集中引入了更具包容性的人物注釋 (MIAP) 數據集。此合集包含更多完整的邊界框注釋,用于包含 10 萬張人物圖像中的的人物類層級結構。每個注釋還帶有可感知到的性別呈現和年齡范圍等公平相關屬性的標簽。作為 Responsible AI 研究的一部分,越來越多的人開始關注如何減少不公平偏見,我們希望這些注釋能夠激勵已經在使用 Open Images 的研究者,將公平分析納入他們的研究中。

Responsible AI 研究

https://ai.google/principles/

交叉描述通過為現有圖像-描述對和輔助描述添加語義相似度人工評分來擴展 MS-COCO 評估集(實線),并通過為新的圖像-描述、描述-描述和圖像-圖像對添加人工評分來提高評分密度(虛線)*

Open Images 中的注釋

原始 Open Images 數據集中的每個圖像都包含圖像級注釋(寬泛地描述圖像)和包圍特定對象的邊界框。為了避免對同一個對象繪制多個邊界框,我們從標簽候選集中臨時刪減了具體性較弱的類,我們將這一過程稱為層級去重。舉個例子,若一個圖像的標簽包括動物、 貓,和洗衣機則該圖像的注釋邊界框為貓和洗衣機,而不會注釋多余的類 ——動物。

圖像級注釋

https://cloud.google.com/vision/docs/labels

邊界框

https://cloud.google.com/vision/docs/object-localizer

MIAP 數據集可用于原始 Open Images 數據,集中人物 層級包含的五個類:人物、男人、女人、男孩、女孩。由于這些標簽的存在,Open Images 數據集對于推進 Responsible AI 的研究具有獨特的價值,能夠幫助開發者訓練通用的人物檢測器,訪問性別和年齡范圍特定的標簽,以實現公平分析和偏見緩解。

Responsible AI

https://ai.google/responsibilities/responsible-ai-practices/

人物檢測器

https://cloud.google.com/video-intelligence/docs/people-detection

然而,我們發現結合了層級去重和女人/女孩與男人/男孩之間的社會性區別后,原始注釋會受到限制。舉個例子,如果要求注釋器針對女孩這一分類繪制邊界框,它們便不會在圖像中的男孩周圍繪制邊界框。注釋器可能會也可能不會在某位女性周圍繪制邊界框,這取決于其對個人年齡的評估以及對女孩這一概念的文化性理解。此類判斷在不同圖像中可能會存在不一致,這取決于單獨的注釋器的文化背景、圖像人物的外表和場景的上下文。因此,某些圖像中的邊界框注釋會不完整,一些較為顯眼的人物沒有得到注釋。

MIAP 中的注釋

新的 MIAP 注釋旨在解決這些限制,實現讓 Open Images 成為推動機器學習公平性研究取得新進展的數據集的保障。我們不要求注釋器為層級結構中最具體的類(例如,女孩)繪制邊界框,而是將此程序反過來,要求它們為性別和年齡未知的人物分類繪制邊界框。

所有人物邊界框屆時都將獲得感知到的性別呈現(很大可能是女性、很大可能是男性,或未知)以及年齡呈現(青年、中年、老年,或未知)等標簽。我們認識到性別不是二元的,個人的性別認同可能與其感知或預期的性別呈現不符,為了緩解無意識偏見對注釋的影響,這里提示:注釋器,與性別呈現相關的規范因文化而異,且會隨時間的推移而變化。

這個過程添加了大量先前丟失的邊界框。

在包含人物的 10 萬張圖像中,人物邊界框的數量從 35.8 萬左右增加到 45.4 萬左右。各個感知性別呈現和感知年齡呈現的邊界框數量持續增加。這些新注釋為人物檢測器的訓練提供了更完整的基本事實,并提供了更準確的子組標簽,以將公平性納入計算機視覺研究。

預期用例

我們為人物邊界框的感知年齡范圍和性別呈現納入了注釋,因為我們認為有必要添加此類注釋,以便提高能力,實現更好的理解以及努力緩解并消除圖像理解領域,受保護子組之間的不公平偏見或不同性能。

我們注意到,標簽捕獲的性別和年齡范圍是第三方僅根據視覺線索,而不是個人的自我認知性別或實際年齡評估出來的。我們不支持也不容忍構建或部署根據這些注釋訓練的性別或年齡呈現分類器,因為我們認為在公平性研究之外使用這些技術的相關風險大于任何潛在好處。

風險

https://dl.acm.org/doi/10.1145/3173574.3173582

致謝

這項研究背后的核心團隊成員包括 Utsav Prabhu、Vittorio Ferrari 和 Caroline Pantofaru。同時,我們還要感謝 Alex Hanna、Reena Jana、Alina Kuznetsova、Matteo Malloci、Stefano Pellegrini、Jordi Pont-Tuset 和 Mahima Pushkarna 對本項目的貢獻。

編輯:jq

-

AI

+關注

關注

87文章

30146瀏覽量

268414 -

計算機視覺

+關注

關注

8文章

1696瀏覽量

45927 -

機器學習

+關注

關注

66文章

8377瀏覽量

132409 -

數據集

+關注

關注

4文章

1205瀏覽量

24644

原文標題:最新進展:將包容性人物注釋納入 Open Image Extended 數據集

文章出處:【微信號:yingjiansanrenxing,微信公眾號:硬件三人行】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

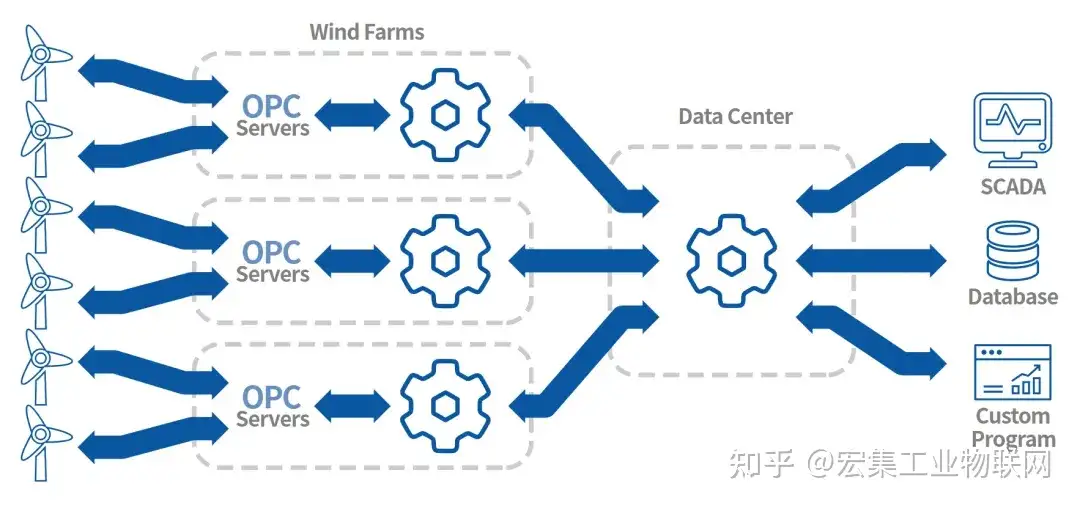

宏集Cogent DataHub: 高效實現風電場數據集中管理與自動化

TIDP.SAA接口怎么實現I2C Read Extended功能?

求助,為什么噪聲很小的信號通過一階有源低通濾波器后反而引入了高頻噪聲?

PyTorch如何訓練自己的數據集

超級電容器在集中器中的應用

語音數據集:推動智能語音技術發展的關鍵驅動力

做項目沒靈感?一起來看看Build2gether包容性創新挑戰賽的創意吧!

Open Images Extended合集中引入了更具包容性的人物注釋MIAP數據集

Open Images Extended合集中引入了更具包容性的人物注釋MIAP數據集

評論