2022年3月16日,美國(guó)國(guó)家標(biāo)準(zhǔn)與技術(shù)研究院(NIST)發(fā)布了《邁向識(shí)別和管理人工智能偏見(jiàn)的標(biāo)準(zhǔn)》(以下簡(jiǎn)稱《標(biāo)準(zhǔn)》),《標(biāo)準(zhǔn)》的目的是分析人工智能偏見(jiàn)這一具有挑戰(zhàn)性的領(lǐng)域中有爭(zhēng)議的問(wèn)題,并為制定識(shí)別和管理人工智能偏見(jiàn)的詳細(xì)社會(huì)技術(shù)指導(dǎo)提供路線圖上的第一步。NIST表示,《標(biāo)準(zhǔn)》是支持可信賴和負(fù)責(zé)任的人工智能開(kāi)發(fā)的一部分,為NIST正在開(kāi)發(fā)的AI風(fēng)險(xiǎn)管理框架(AI RMF)提供了相關(guān)的指導(dǎo)。

《標(biāo)準(zhǔn)》重點(diǎn)提出三部分內(nèi)容:

描述了人工智能中偏見(jiàn)的利害關(guān)系和挑戰(zhàn),并舉例說(shuō)明了偏見(jiàn)破壞公眾信任的原因和方式;

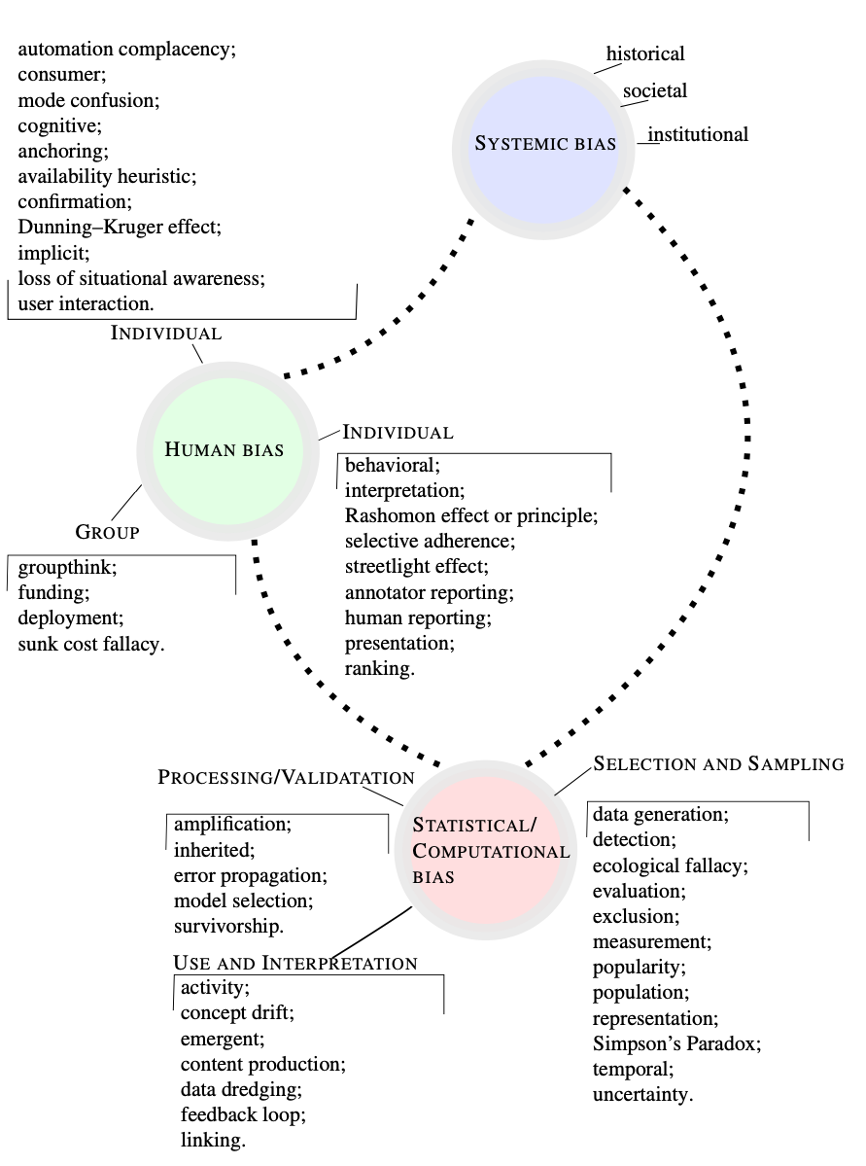

識(shí)別人工智能中的三類偏見(jiàn)(即系統(tǒng)性,統(tǒng)計(jì)性和人類偏見(jiàn)),并描述它們對(duì)社會(huì)產(chǎn)生負(fù)面影響的方式;

描述了減輕人工智能偏見(jiàn)的三大挑戰(zhàn),包括數(shù)據(jù)集,測(cè)試和評(píng)估、驗(yàn)證和核實(shí)以及人為因素,并對(duì)解決這些問(wèn)題給出建議。

如何理解人工智能偏見(jiàn)

人工智能風(fēng)險(xiǎn)管理旨在最大限度地減少人工智能的負(fù)面影響,包括對(duì)公民自由和權(quán)利的威脅等。而在談?wù)撊斯ぶ悄茱L(fēng)險(xiǎn)時(shí),“偏見(jiàn)”是一個(gè)重要話題。雖然人工智能偏見(jiàn)并不總是負(fù)面的,如通過(guò)自動(dòng)化系統(tǒng)決策為公眾提供生活便利。然而,人工智能模型和系統(tǒng)中表現(xiàn)出的某些偏見(jiàn)也可能對(duì)個(gè)人、組織和社會(huì)造成永久化和放大的負(fù)面影響。

《標(biāo)準(zhǔn)》指出,偏見(jiàn)與社會(huì)透明度和公平性息息相關(guān)。對(duì)于大多數(shù)人來(lái)說(shuō),算法很少透明,因?yàn)榉羌夹g(shù)受眾很難了解和理解公司用于設(shè)計(jì)、開(kāi)發(fā)和部署的代碼及用于決策的復(fù)雜人工智能網(wǎng)絡(luò)。此外,很多人受到人工智能技術(shù)和系統(tǒng)的困擾,如未經(jīng)本人的同意,在申請(qǐng)大學(xué)、租賃房屋甚至互聯(lián)網(wǎng)搜索時(shí),個(gè)人數(shù)據(jù)被人工智能技術(shù)和系統(tǒng)輸入等。這些情形都導(dǎo)致個(gè)人對(duì)“失控”和“失去隱私”的恐懼,以及對(duì)人工智能的信任下降。

人工智能偏見(jiàn)的類別

《標(biāo)準(zhǔn)》中,人工智能分為系統(tǒng)性偏見(jiàn)、統(tǒng)計(jì)性偏見(jiàn)和人類偏見(jiàn)三大類別,具體來(lái)看:

系統(tǒng)性偏見(jiàn)

系統(tǒng)性偏見(jiàn),也被稱為機(jī)構(gòu)或歷史偏見(jiàn),是由特定機(jī)構(gòu)的程序和做法造成,導(dǎo)致某些社會(huì)群體處于有利地位或受到青睞,而其他社會(huì)群體則處于不利地位或受到貶低。它們普遍存在于人工智能使用的數(shù)據(jù),人工智能生命周期的流程中以及文化和社會(huì)中的機(jī)構(gòu)規(guī)范、實(shí)踐和流程中。這不一定是有意識(shí)偏見(jiàn)或歧視,而是大多數(shù)人遵循現(xiàn)有規(guī)則或規(guī)范造成的。最為典型的是種族主義和性別歧視,在日常基礎(chǔ)設(shè)施中未能考慮殘疾人的無(wú)障礙環(huán)境等。

統(tǒng)計(jì)性偏見(jiàn)

統(tǒng)計(jì)性偏見(jiàn)來(lái)自于系統(tǒng)性錯(cuò)誤而非隨機(jī)性錯(cuò)誤,在沒(méi)有偏見(jiàn)、偏袒或歧視性意圖的情況下也會(huì)發(fā)生。在人工智能系統(tǒng)中,這些偏見(jiàn)存在于開(kāi)發(fā)人工智能應(yīng)用的數(shù)據(jù)集和算法過(guò)程中,當(dāng)算法在一種類型的數(shù)據(jù)上訓(xùn)練而不能超越這些數(shù)據(jù)進(jìn)行推斷時(shí),偏見(jiàn)就會(huì)出現(xiàn)。

人類偏見(jiàn)

人類偏見(jiàn)是人類思維的基本部分,反映了人類思維中的系統(tǒng)性錯(cuò)誤。此類偏見(jiàn)往往是隱性的,并與個(gè)人或群體通過(guò)自動(dòng)化信息進(jìn)行決策有關(guān),廣泛存在于整個(gè)人工智能生命周期的機(jī)構(gòu)、團(tuán)體和個(gè)人決策過(guò)程中,以及在人工智能應(yīng)用部署后的使用過(guò)程中。

人工智能偏見(jiàn)對(duì)社會(huì)的影響

由于人工智能技術(shù)與社會(huì)緊密聯(lián)系,其相比傳統(tǒng)技術(shù)對(duì)社會(huì)的影響更大。各個(gè)部門都普遍部署人工智能的應(yīng)用程序用于決策支持,從而代替人類做出具有高度影響力的決策。但目前,對(duì)這些應(yīng)用程序的負(fù)面影響和其他結(jié)果進(jìn)行驗(yàn)證的方法并不精確,也不全面。

雖然機(jī)器學(xué)習(xí)(ML)系統(tǒng)能夠?qū)?fù)雜的現(xiàn)象進(jìn)行建模,但其是否能夠按照人類的社會(huì)價(jià)值觀進(jìn)行學(xué)習(xí)和操作,仍值得關(guān)注。系統(tǒng)性偏見(jiàn)(如種族偏見(jiàn)),可以通過(guò)訓(xùn)練中使用的數(shù)據(jù),機(jī)構(gòu)政策以及基礎(chǔ)實(shí)踐(如何被委托、開(kāi)發(fā)、部署和使用),在人工智能模型中比較常見(jiàn)。而統(tǒng)計(jì)性偏見(jiàn)、人類偏見(jiàn)普遍存在于工程和建模過(guò)程中,只有當(dāng)正確驗(yàn)證模型性能的不確定性時(shí),這些偏見(jiàn)才會(huì)顯現(xiàn)。

可以發(fā)現(xiàn),開(kāi)發(fā)和運(yùn)用人工智能的團(tuán)隊(duì)往往對(duì)技術(shù)的使用方式和人類的監(jiān)督有不準(zhǔn)確的預(yù)期,或應(yīng)用結(jié)果不符合設(shè)計(jì)原意,也會(huì)導(dǎo)致人工智能偏見(jiàn)。這些偏見(jiàn)放大和強(qiáng)化了歧視,從而對(duì)個(gè)人和社會(huì)產(chǎn)生負(fù)面影響,并且其速度和規(guī)模遠(yuǎn)遠(yuǎn)超過(guò)了傳統(tǒng)的歧視性做法(如種族歧視、性別歧視、年齡歧視或能力歧視)。

減輕人工智能偏見(jiàn)面臨的挑戰(zhàn)和建議

《標(biāo)準(zhǔn)》探索了克服人工智能偏見(jiàn)的措施和治理過(guò)程,描述了其過(guò)程中的三大挑戰(zhàn),包括數(shù)據(jù)集、測(cè)試和評(píng)估以及人為因素,并為解決這些問(wèn)題提出建議。

1、數(shù)據(jù)集挑戰(zhàn)

人工智能的設(shè)計(jì)和開(kāi)發(fā)實(shí)踐依賴于大規(guī)模的數(shù)據(jù)集來(lái)驅(qū)動(dòng)ML過(guò)程。一方面,研究人員、開(kāi)發(fā)人員和從業(yè)人員更關(guān)注數(shù)據(jù)集的可用性或可獲得性,而不是最合適性。因此,這些過(guò)程中使用的數(shù)據(jù)可能不具有代表性。而這些數(shù)據(jù)卻經(jīng)常在訓(xùn)練ML應(yīng)用中使用。另一方面,當(dāng)對(duì)一個(gè)過(guò)程或現(xiàn)象的社會(huì)技術(shù)背景沒(méi)有足夠的了解或認(rèn)識(shí)時(shí),這些在ML應(yīng)用程序中所使用的屬性,也可能不適用于對(duì)不同社會(huì)群體或文化的分析。

建議:開(kāi)發(fā)和部署人工智能系統(tǒng)需要注意的關(guān)鍵問(wèn)題:是否存在適合或適用于人工智能系統(tǒng)所開(kāi)發(fā)和部署的各種應(yīng)用、工作和任務(wù)的數(shù)據(jù)集?不僅ML系統(tǒng)的預(yù)測(cè)行為是由數(shù)據(jù)決定的,數(shù)據(jù)也在很大程度上決定了機(jī)器學(xué)習(xí)任務(wù)本身。所以,解決數(shù)據(jù)集的適用性問(wèn)題需要注意三個(gè)因素:

統(tǒng)計(jì)因素:解決人工智能偏見(jiàn)的一個(gè)主要趨勢(shì)是關(guān)注建模過(guò)程中使用的數(shù)據(jù)集的平衡統(tǒng)計(jì)代表性。使用統(tǒng)計(jì)現(xiàn)象分析可檢測(cè)數(shù)據(jù)集中的偏見(jiàn),有時(shí)有助于克服人工智能偏見(jiàn)。

社會(huì)技術(shù)因素:在ML應(yīng)用中,使用數(shù)據(jù)集必須進(jìn)行調(diào)整,要全面考慮其所處環(huán)境的全部社會(huì)技術(shù)因素。

人類和數(shù)據(jù)集的相互作用因素:在建立人工智能應(yīng)用基礎(chǔ)模型時(shí),數(shù)據(jù)集中存在的系統(tǒng)性偏見(jiàn)是由人工智能設(shè)計(jì)和開(kāi)發(fā)團(tuán)隊(duì)關(guān)于使用哪些數(shù)據(jù)集的決定和假設(shè)所造成。

2、TEVV(測(cè)試和評(píng)估、驗(yàn)證和核實(shí))挑戰(zhàn)

TEVV(測(cè)試和評(píng)估、驗(yàn)證和核實(shí))是減輕人工智能偏見(jiàn)所面臨的另一個(gè)挑戰(zhàn)。作為一種工程結(jié)構(gòu),TEVV旨在事后檢測(cè)和修復(fù)問(wèn)題,而并不等同于科學(xué)方法的全面應(yīng)用。一方面,結(jié)構(gòu)有效性在人工智能系統(tǒng)開(kāi)發(fā)中尤為重要,另一方面,在許多人工智能項(xiàng)目中,結(jié)構(gòu)化數(shù)據(jù)收集、最小化確認(rèn)偏差的可靠實(shí)驗(yàn)設(shè)計(jì)技術(shù)等都在被淡化,這一變化也導(dǎo)致人工智能偏見(jiàn)的增長(zhǎng)。

建議:為了減輕認(rèn)知和不確定性帶來(lái)的風(fēng)險(xiǎn),模型開(kāi)發(fā)人員應(yīng)該與部署它們的組織密切合作。團(tuán)隊(duì)?wèi)?yīng)努力確保定期更新模型,并在更新的代表性數(shù)據(jù)集上測(cè)試和重新校準(zhǔn)模型參數(shù)以滿足業(yè)務(wù)目標(biāo),同時(shí)保持在預(yù)期的性能目標(biāo)和可接受的偏差水平內(nèi)。

3、人為因素挑戰(zhàn)

隨著ML算法在準(zhǔn)確性和精確性方面的發(fā)展,計(jì)算系統(tǒng)已經(jīng)轉(zhuǎn)變?yōu)橛扇祟愄峁┯邢掭斎氲淖詣?dòng)決策。算法決策系統(tǒng)的發(fā)展和普及的同時(shí),由于算法模型會(huì)產(chǎn)生和放大不公正結(jié)果,公眾對(duì)人工智能的信任感也隨之下降。嵌入在算法模型中的系統(tǒng)性偏見(jiàn)也將造成災(zāi)難性的傷害。在沒(méi)有評(píng)估和管理這些風(fēng)險(xiǎn)的情況下,貿(mào)然部署人工智能模型和系統(tǒng)的組織不僅會(huì)傷害其用戶,還會(huì)損害其聲譽(yù)。

建議:制定算法影響評(píng)估,提供一個(gè)高層次的結(jié)構(gòu),使組織能夠確定每個(gè)算法的風(fēng)險(xiǎn)。

組織多方利益相關(guān)者參與:讓各種利益相關(guān)者參與進(jìn)來(lái),利用他們的各種經(jīng)驗(yàn)來(lái)應(yīng)對(duì)核心挑戰(zhàn),即在人工智能系統(tǒng)將部署的特定環(huán)境中識(shí)別有害結(jié)果和環(huán)境變化。

保證多元化、公平與包容:使能夠反映各種背景、觀點(diǎn)和專業(yè)知識(shí)的不同個(gè)人群體發(fā)揮作用,這也有助于拓寬人工智能系統(tǒng)設(shè)計(jì)師和工程師的視野。

改進(jìn)實(shí)踐:采用生命周期方法確定一些關(guān)鍵點(diǎn),在這些關(guān)鍵點(diǎn)上,完善的指導(dǎo)、擔(dān)保和治理流程可以幫助多利益相關(guān)者協(xié)作整合流程,減少偏見(jiàn)。

優(yōu)化人類與人工智能配置:利用人和機(jī)器智能來(lái)創(chuàng)建機(jī)器學(xué)習(xí)模型——“人在回路”(人們參與到一個(gè)良性循環(huán)中,在這個(gè)循環(huán)中他們訓(xùn)練、調(diào)整和測(cè)試特定的算法)的方法,考慮到廣泛的社會(huì)技術(shù)因素,可以優(yōu)化人類與人工智能的配置。

提高制度和程序透明度:人工智能系統(tǒng)需要更多的解釋和可以很好地被解釋,可以使用數(shù)據(jù)表和模型卡等工具。

讓人類成為人工智能設(shè)計(jì)的中心:以人為中心的設(shè)計(jì)(HCD)可開(kāi)發(fā)可靠、安全和值得信賴的人工智能系統(tǒng),有助于提高用戶有效使用產(chǎn)品的能力。

人工智能偏見(jiàn)的治理

人工智能偏見(jiàn)的治理過(guò)程幾乎影響到管理過(guò)程的各個(gè)方面,不僅要關(guān)注技術(shù)工件(如人工智能系統(tǒng)),還要關(guān)注組織流程和文化能力,這些都直接影響到參與培訓(xùn)、部署和監(jiān)測(cè)此類系統(tǒng)的群體。

《標(biāo)準(zhǔn)》指出,對(duì)于人工智能偏見(jiàn)治理可從八方面著手:

監(jiān)測(cè):人工智能系統(tǒng)一旦部署,其性能可能與預(yù)期不同,導(dǎo)致不同群體受到不同的待遇。控制該風(fēng)險(xiǎn)的關(guān)鍵措施是部署額外的系統(tǒng)來(lái)監(jiān)測(cè)潛在的偏見(jiàn)問(wèn)題。

追訴渠道:系統(tǒng)終端用戶可以通過(guò)反饋渠道標(biāo)記出不正確或潛在危害結(jié)果,并對(duì)錯(cuò)誤或危害進(jìn)行追訴。

政策和程序:政策和程序可以實(shí)現(xiàn)統(tǒng)一的開(kāi)發(fā)和測(cè)試實(shí)踐,這有助于確保人工智能系統(tǒng)結(jié)果的可重復(fù)性,相關(guān)風(fēng)險(xiǎn)可以得到統(tǒng)一的映射、測(cè)量和管理。

文本標(biāo)準(zhǔn)化:明確的文件可以幫助系統(tǒng)地執(zhí)行政策和程序,使組織的偏見(jiàn)管理過(guò)程在每個(gè)階段的實(shí)施和記錄標(biāo)準(zhǔn)化。文件還可以作為重要信息的單一儲(chǔ)存庫(kù),不僅支持對(duì)人工智能系統(tǒng)和相關(guān)業(yè)務(wù)流程的內(nèi)部監(jiān)督,還可以加強(qiáng)系統(tǒng)維護(hù),并作為糾正或調(diào)試處理活動(dòng)的寶貴資源。

問(wèn)責(zé)制:?jiǎn)栘?zé)制需要對(duì)人工智能系統(tǒng)本身的作用進(jìn)行明確評(píng)估,其任務(wù)應(yīng)嵌入到參與培訓(xùn)和部署人工智能系統(tǒng)的各個(gè)團(tuán)隊(duì)中,不能由一個(gè)人承擔(dān)。

文化與實(shí)踐:為了使治理有效,人工智能需要嵌入到一個(gè)組織的整個(gè)文化中來(lái)強(qiáng)調(diào)信仰、規(guī)范和價(jià)值觀。風(fēng)險(xiǎn)管理文化和實(shí)踐可以作為一種強(qiáng)大的技術(shù),從社會(huì)技術(shù)系統(tǒng)的角度出發(fā)來(lái)識(shí)別整個(gè)人工智能生命周期中的偏見(jiàn)。

風(fēng)險(xiǎn)緩解、風(fēng)險(xiǎn)分類和激勵(lì)結(jié)構(gòu):有效的人工智能偏見(jiàn)治理重點(diǎn)在于明確承認(rèn)減輕風(fēng)險(xiǎn),而不是避免風(fēng)險(xiǎn)。這有助于確保偏見(jiàn)風(fēng)險(xiǎn)在實(shí)踐中得到迅速減輕并被明確分類,從而使組織能夠?qū)⒂邢薜馁Y源集中在最重要的偏見(jiàn)風(fēng)險(xiǎn)上。調(diào)整各團(tuán)隊(duì)的薪酬和晉升激勵(lì)機(jī)制,從而使風(fēng)險(xiǎn)緩解機(jī)制的參與者真正被激勵(lì)使用健全的開(kāi)發(fā)方法,進(jìn)行嚴(yán)格測(cè)試和徹底審計(jì)。

信息共享:共享網(wǎng)絡(luò)威脅信息有助于組織改善自身和其他組織的安全態(tài)勢(shì)。確定內(nèi)部機(jī)制,讓團(tuán)隊(duì)分享有關(guān)人工智能的偏見(jiàn)事件或有害影響信息,有助于提升對(duì)人工智能風(fēng)險(xiǎn)的重視,并為團(tuán)隊(duì)提供信息以避免過(guò)去失敗的設(shè)計(jì)。

于Imagination IP的產(chǎn)品已在全球數(shù)十億人的電話、汽車、家庭和工作場(chǎng)所中使用。獲取更多物聯(lián)網(wǎng)、智能穿戴、通信、汽車電子、圖形圖像開(kāi)發(fā)等前沿技術(shù)信息,歡迎關(guān)注 Imagination Tech!

審核編輯 :李倩

-

互聯(lián)網(wǎng)

+關(guān)注

關(guān)注

54文章

11105瀏覽量

103016 -

人工智能

+關(guān)注

關(guān)注

1791文章

46859瀏覽量

237577

原文標(biāo)題:人工智能也存在偏見(jiàn)?探究人工智能偏見(jiàn)的識(shí)別和管理

文章出處:【微信號(hào):Imgtec,微信公眾號(hào):Imagination Tech】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

探究人工智能偏見(jiàn)的識(shí)別和管理

探究人工智能偏見(jiàn)的識(shí)別和管理

評(píng)論