作者:許勝寶,鄭飂默,袁德成

布匹缺陷檢測(cè)任務(wù)的難點(diǎn)可能有以下幾個(gè)方面:小目標(biāo)問(wèn)題,缺陷具有極端的寬高比,樣本不均衡。在MS COCO數(shù)據(jù)集[1]中,面積小于32×32像素的物體被認(rèn)為是小目標(biāo)。小目標(biāo)具有分辨率低,圖像模糊,攜帶的信息少的特點(diǎn),導(dǎo)致其特征表達(dá)能力弱,也就是在提取特征過(guò)程中,能提取到的特征非常少,不利于其檢測(cè);布匹疵點(diǎn)由于生產(chǎn)工藝的原因常常具有極端的寬高比,例如斷經(jīng)、斷緯等,給其邊界框的預(yù)測(cè)增添了難度;樣本不均衡是指部分疵點(diǎn)擁有大量的訓(xùn)練樣本,而另一部分疵點(diǎn)則只有少數(shù)的樣本,讓分類器學(xué)習(xí)起來(lái)很困難。 針對(duì)小目標(biāo)問(wèn)題,Hu等[2]認(rèn)為小目標(biāo)在ROI池化之后會(huì)破壞小尺度目標(biāo)的結(jié)構(gòu),導(dǎo)致物體結(jié)構(gòu)失真,于是提出了新的場(chǎng)景感知ROI池化層,維持場(chǎng)景信息和小目標(biāo)的原始結(jié)構(gòu),可以在不增加額外時(shí)間復(fù)雜度的前提下提升檢測(cè)精度;Li等[3]提出了Perceptual GAN網(wǎng)絡(luò)來(lái)生成小目標(biāo)的超分表達(dá),Perceptual GAN利用大小目標(biāo)的結(jié)構(gòu)相關(guān)性來(lái)增強(qiáng)小目標(biāo)的表達(dá),使其與其對(duì)應(yīng)大目標(biāo)的表達(dá)相似,從而提升小目標(biāo)檢測(cè)的精度。 針對(duì)布匹缺陷極端的長(zhǎng)寬比,陳康等[4]提出了通過(guò)增加錨定框的尺寸和比例來(lái)增加錨定框的數(shù)量,最終提升了對(duì)多尺度目標(biāo)的檢測(cè)。孟志青等[5]提出基于快速搜索密度頂點(diǎn)的聚類算法的邊框生成器,結(jié)合真實(shí)框的分布特征分區(qū)間對(duì)聚類中心進(jìn)行加權(quán)融合,使區(qū)域建議網(wǎng)絡(luò)生成的邊界框更符合布匹疵點(diǎn)特征。 針對(duì)樣本不均衡,Chawla等[6]提出了人工少數(shù)類過(guò)采樣法,非簡(jiǎn)單地對(duì)少數(shù)類別進(jìn)行重采樣,而是通過(guò)設(shè)計(jì)算法來(lái)人工合成一些新的少數(shù)樣本,減少隨機(jī)過(guò)采樣引起的過(guò)度擬合問(wèn)題,因?yàn)樯傻氖呛铣墒纠皇菍?shí)例的復(fù)制,也不會(huì)丟失有用的信息;Yang等[7]通過(guò)半監(jiān)督和自監(jiān)督這兩個(gè)不同的視角去嘗試?yán)斫夂屠貌黄胶獾臄?shù)據(jù),并且驗(yàn)證了這兩種框架均能提升類別不均衡的長(zhǎng)尾學(xué)習(xí)問(wèn)題。 針對(duì)布匹疵點(diǎn)小目標(biāo)多,極端長(zhǎng)寬比的問(wèn)題,本文提出一種改進(jìn)的Cascade R-CNN[8]布匹疵點(diǎn)檢測(cè)方法,為適應(yīng)布匹疵點(diǎn)的極端長(zhǎng)寬比,在特征提取網(wǎng)絡(luò)的后三個(gè)階段采用了可變形卷積(DCN)v2[9],在RCNN部分采用了在線難例挖掘(OHEM)[10]來(lái)提高小目標(biāo)的檢測(cè)效果,并采用完全交并比損失函數(shù)(CIoU Loss)[11]進(jìn)一步提升目標(biāo)邊界框的回歸精度。

改進(jìn)Cascade R-CNN的面料疵點(diǎn)檢測(cè)方法

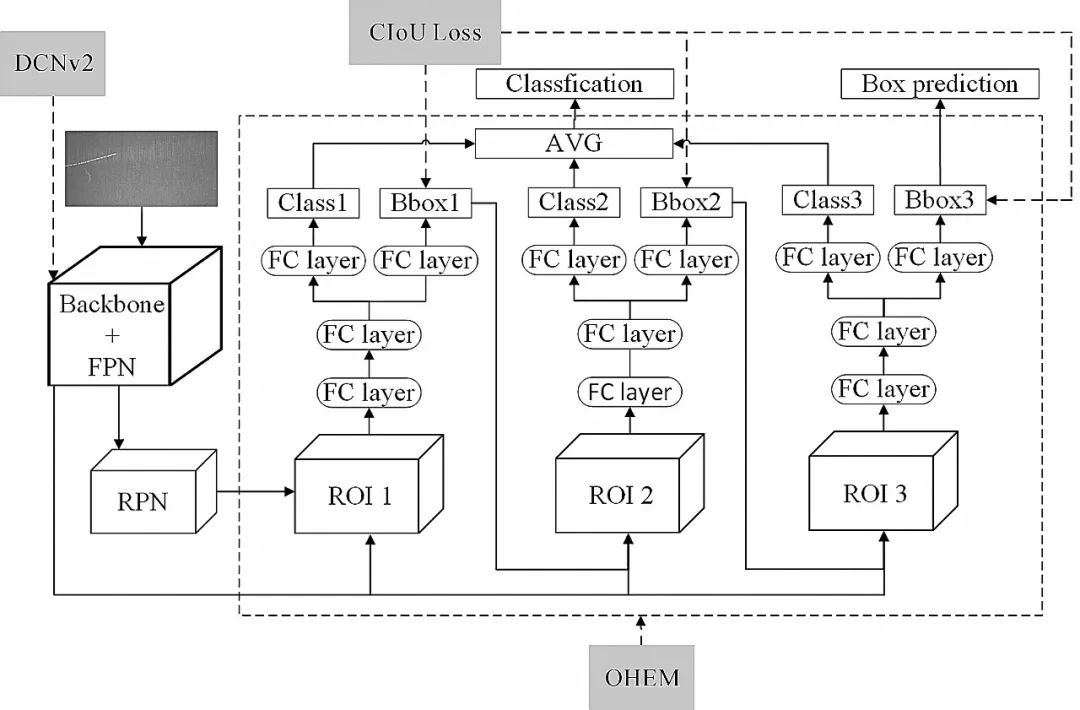

Faster R-CNN[12]的單一閾值訓(xùn)練出的檢測(cè)器效果有限,本文采用了Cascade R-CNN網(wǎng)絡(luò)結(jié)構(gòu),如圖1所示。其在Faster R-CNN的基礎(chǔ)上通過(guò)級(jí)聯(lián)的方式逐階段提高IoU的閾值,從而使得前一階段重新采樣過(guò)的建議框能夠適應(yīng)下一個(gè)有更高閾值的階段。工業(yè)場(chǎng)景下目標(biāo)面積小,特征微弱,通過(guò)多級(jí)調(diào)整,可以使網(wǎng)絡(luò)集中于低占比的缺陷目標(biāo),最終獲得更為精確的檢測(cè)框。

圖1 Cascade R-CNN網(wǎng)絡(luò)結(jié)構(gòu)

Fig.1 Architecture of the Cascade R-CNN network

考慮到實(shí)驗(yàn)環(huán)境的顯存和算力,骨干網(wǎng)絡(luò)主要采用了ResNet50[作為特征提取網(wǎng)絡(luò)來(lái)進(jìn)行對(duì)比實(shí)驗(yàn),并接入特征金字塔網(wǎng)絡(luò)進(jìn)行多尺度的特征融合,提升對(duì)小目標(biāo)的檢測(cè)效果。

1.1 在線難例挖掘采樣

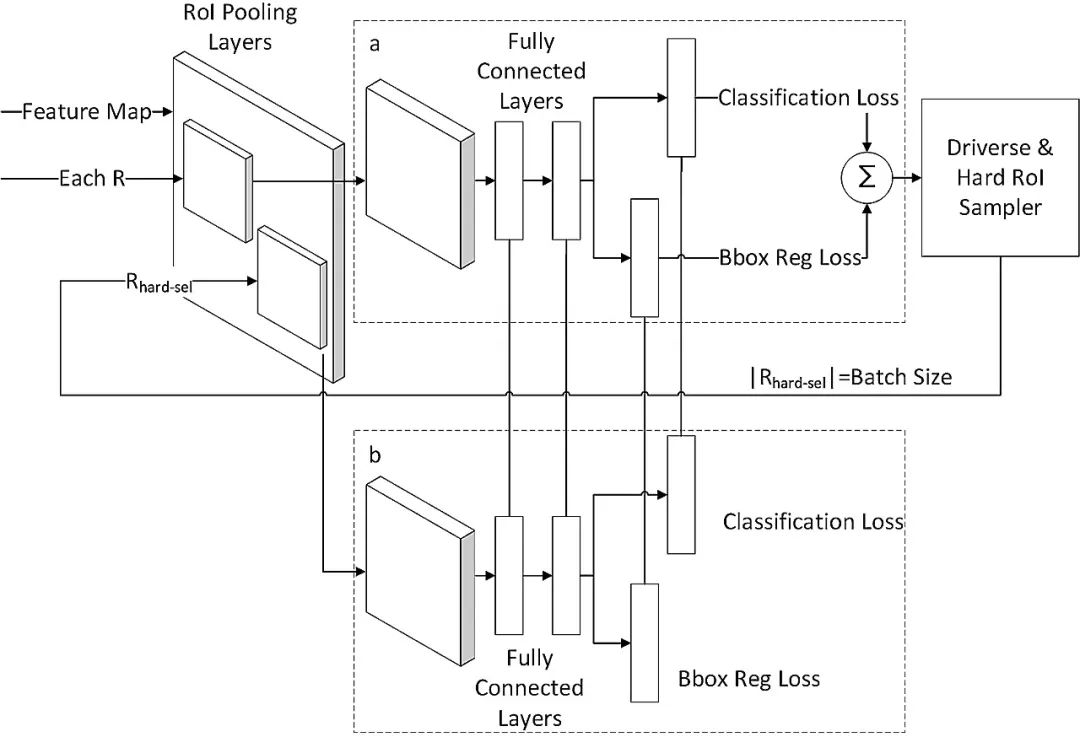

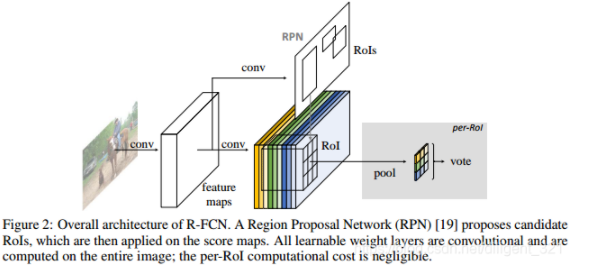

在兩階段的目標(biāo)檢測(cè)模型中,區(qū)域建議網(wǎng)絡(luò)會(huì)產(chǎn)生大量的建議框,但一張圖片的目標(biāo)數(shù)量有限,絕大部分建議框是沒(méi)有目標(biāo)的,為了減少計(jì)算量,避免網(wǎng)絡(luò)的預(yù)測(cè)值少數(shù)服從多數(shù)而向負(fù)樣本靠攏,需要調(diào)整正負(fù)樣本之間的比例。 目前常規(guī)的解決方式是對(duì)兩種樣本進(jìn)行隨機(jī)采樣,以使正負(fù)樣本的比例保持在1∶3,這一方式緩解了正負(fù)樣本之間的比例不均衡,也被大多數(shù)兩階段目標(biāo)檢測(cè)方法所使用,但隨機(jī)選出來(lái)的建議框不一定是易出錯(cuò)的框,這就導(dǎo)致對(duì)易學(xué)樣本產(chǎn)生過(guò)擬合。 在線難例挖掘就是多找一些困難負(fù)樣本加入負(fù)樣本集進(jìn)行訓(xùn)練,如圖2所示,b部分是a部分的復(fù)制,a部分只用于尋找困難負(fù)例,b部分用來(lái)反向傳播,然后把更新的參數(shù)共享到a部分,a部分正常的前向傳播后,獲得每個(gè)建議框的損失值,在非極大值抑制后對(duì)剩下的建議框按損失值進(jìn)行排序,然后選用損失較大的前一部分當(dāng)作輸入再進(jìn)入b部分進(jìn)行訓(xùn)練。

圖2 在線難例挖掘結(jié)構(gòu)

Fig.2 Architecture of online hard example mining

布匹疵點(diǎn)中的小目標(biāo)疵點(diǎn)往往難以檢測(cè),小目標(biāo)常常被劃分為難例,在Cascade R-CNN的每個(gè)級(jí)聯(lián)層引入在線難例挖掘采樣之后,提高了整個(gè)網(wǎng)絡(luò)的短版,防止了網(wǎng)絡(luò)針對(duì)大量易學(xué)樣本過(guò)擬合,有利于提升面料疵點(diǎn)的檢測(cè)精度。訓(xùn)練集越大越困難,在線難例挖掘在訓(xùn)練中所選擇的難例就越多,訓(xùn)練就更有針對(duì)性,效果就越好。而布匹疵點(diǎn)恰好小目標(biāo)多,寬高比方差大,難例較多,更適合在線難例挖掘的應(yīng)用,通過(guò)讓網(wǎng)絡(luò)花更多的精力學(xué)習(xí)難樣本,進(jìn)一步提高了檢測(cè)的精度。

1.2 可變形卷積v2

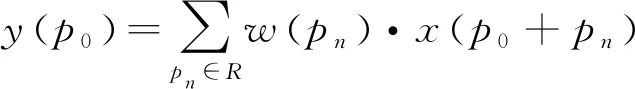

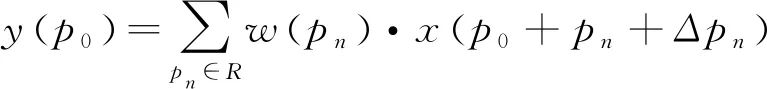

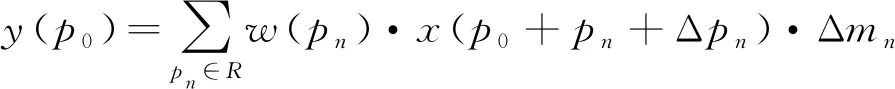

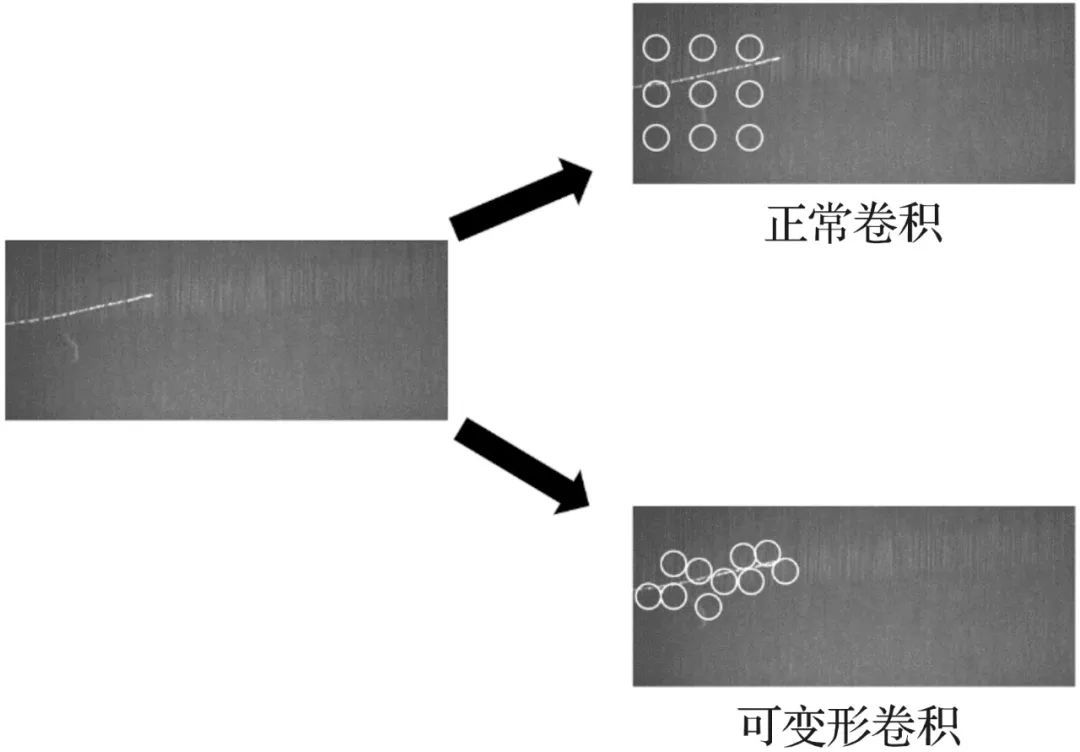

可變形卷積v2由可變形卷積[15]演變而來(lái)。可變形卷積顧名思義就是卷積的位置是可變形的,并非在傳統(tǒng)的N×N的網(wǎng)格上做卷積,傳統(tǒng)卷積僅僅只能提取到矩形框的特征,可變形卷積則能更準(zhǔn)確地提取到復(fù)雜區(qū)域內(nèi)的特征。以N×N卷積為例,每個(gè)輸出y(p0),都要從中心位置x(p0)上采樣9個(gè)位置,(-1,-1)代表x(p0)的左上角,(1,1)代表x(p0)的右下角。傳統(tǒng)的卷積輸出如式(2),R為規(guī)格網(wǎng)格,而可變形卷積如式(3),在傳統(tǒng)卷積操作上加入了一個(gè)偏移量Δpn,使采樣點(diǎn)擴(kuò)散成非網(wǎng)格的形狀。

R={(-1,-1),(-1,0)...,(0,1),(1,1)}(1)

(2)

(2)

(3)

(3)

而可變形卷積v2如式(4),在可變形卷積的基礎(chǔ)上加上了每個(gè)采樣點(diǎn)的權(quán)重Δmn,這樣增加了更大的變形自由度,對(duì)于某些不想要的采樣點(diǎn)可以將權(quán)重設(shè)置為0,提高了網(wǎng)絡(luò)適應(yīng)幾何變化的能力。

(4)

(4)

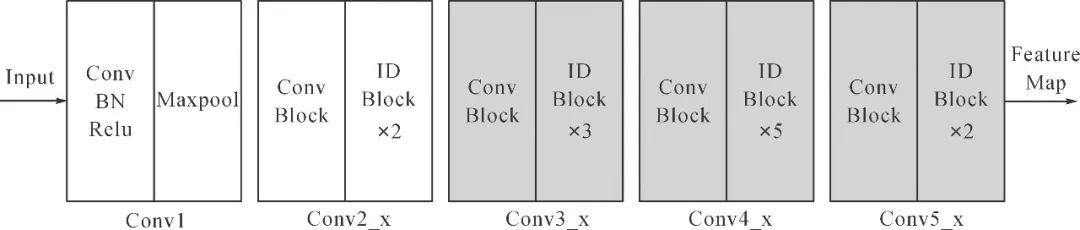

ResNet網(wǎng)絡(luò)共有5個(gè)階段,如圖3所示,第一階段為對(duì)圖像的預(yù)處理,結(jié)構(gòu)較為簡(jiǎn)單,后4個(gè)階段結(jié)構(gòu)類似,包含不可串聯(lián)的Conv Block和可串聯(lián)的Identity Block。本文在ResNet50骨干網(wǎng)絡(luò)的最后3個(gè)階段采用可變形卷積v2,能夠計(jì)算每個(gè)點(diǎn)的偏移和權(quán)重,從最合適的地方取特征進(jìn)行卷積,以此來(lái)適應(yīng)不同形狀的瑕疵,緩解了傳統(tǒng)卷積規(guī)格格點(diǎn)采樣無(wú)法適應(yīng)目標(biāo)的幾何形變問(wèn)題,如圖4所示,改進(jìn)后的骨干網(wǎng)絡(luò)更能適應(yīng)布匹疵點(diǎn)的極端長(zhǎng)寬比,有利于疵點(diǎn)的精確檢測(cè)。

圖3 Resnet骨干網(wǎng)絡(luò)結(jié)構(gòu)

Fig.3 Architecture of Resnet backbone network

圖4 可變形卷積示意

Fig.4 Diagram of deformable convolution

1.3 完全交并比損失函數(shù)

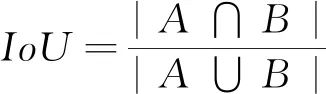

目標(biāo)檢測(cè)中常用的邊界框回歸損失函數(shù)有L1 Loss,L2 Loss,Smooth L1 Loss,上述3種損失在計(jì)算時(shí),先獨(dú)立地求出邊界框4個(gè)頂點(diǎn)的損失,然后相加得到最終的邊界框回歸損失,這種計(jì)算方法的前提是假設(shè)4個(gè)點(diǎn)是相互獨(dú)立的,但實(shí)際它們是相關(guān)的。而評(píng)價(jià)邊界框的指標(biāo)是IoU,如式(5)所示,即預(yù)測(cè)邊界框和真實(shí)邊界框的交并比。

(5)

(5)

但上述3種損失和IoU并不等價(jià),多個(gè)邊界框可能損失大小相同,但I(xiàn)oU差異較大,因此就有了IoU Loss[16],如式(6)所示。

IoU Loss=-ln(IoU)(6)

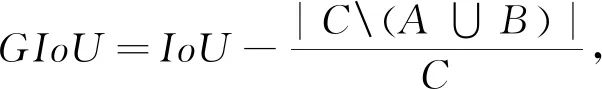

IoU Loss直接把IoU作為損失函數(shù),但它無(wú)法解決預(yù)測(cè)框和真實(shí)框不重合時(shí)IoU為0的問(wèn)題,由此產(chǎn)生了GIoU Loss[17],GIoU如式(7),對(duì)于兩個(gè)邊界框A和B,要找到一個(gè)最小的封閉形狀C,讓C將A和B包圍在里面,然后計(jì)算C中沒(méi)有覆蓋A和B的面積占C總面積的比例,最后用A和B的IoU值減去這個(gè)比值。

(7)

(7)

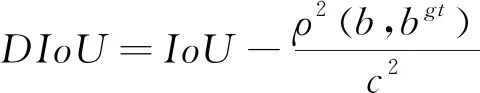

但是當(dāng)目標(biāo)框完全包含預(yù)測(cè)框時(shí),GIoU退化為IoU,IoU和GIoU的值相等,無(wú)法區(qū)分其相對(duì)位置關(guān)系,由此產(chǎn)生了DIoU和CIoU。DIoU將真實(shí)框與預(yù)測(cè)框之間的距離,重疊率以及尺度都考慮進(jìn)去,如式(8):

(8)

(8)

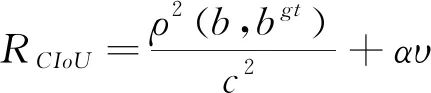

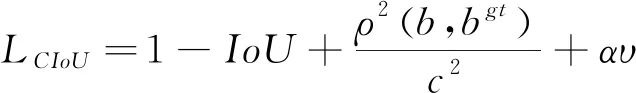

式中:b,b??分別代表預(yù)測(cè)框和真實(shí)框的中心點(diǎn),ρ表示計(jì)算兩個(gè)中心點(diǎn)之間的歐式距離,c表示包含預(yù)測(cè)框和真實(shí)框的最小外界矩形的對(duì)角線長(zhǎng)度。 CIoU考慮到邊界框回歸中的長(zhǎng)寬比還沒(méi)被考慮到計(jì)算中,在DIoU懲罰項(xiàng)的基礎(chǔ)上添加了影響因子αv,如式(9):

(9)

(9)

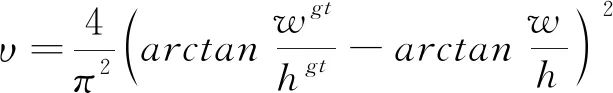

式中:α是權(quán)重函數(shù), v表示長(zhǎng)寬比的相似性,如式(10):

(10)

(10)

式中:w、w??分別代表預(yù)測(cè)框和真實(shí)框的寬度,h、hgt分別代表預(yù)測(cè)框和真實(shí)框的高度。 最終CIoU的損失定義如式(11):

(11)

(11)

本文將原始模型中的邊界框回歸損失選為CIoU Loss,CIoU能夠?qū)⒅丿B面積,中心點(diǎn)距離,長(zhǎng)寬比這3個(gè)幾何因素都考慮進(jìn)去,相比其他邊界框損失函數(shù),其收斂的精度更高,從而可以提升布匹疵點(diǎn)檢測(cè)時(shí)的定位準(zhǔn)確度。

實(shí)驗(yàn)結(jié)果與對(duì)比分析

2.1 實(shí)驗(yàn)數(shù)據(jù)集

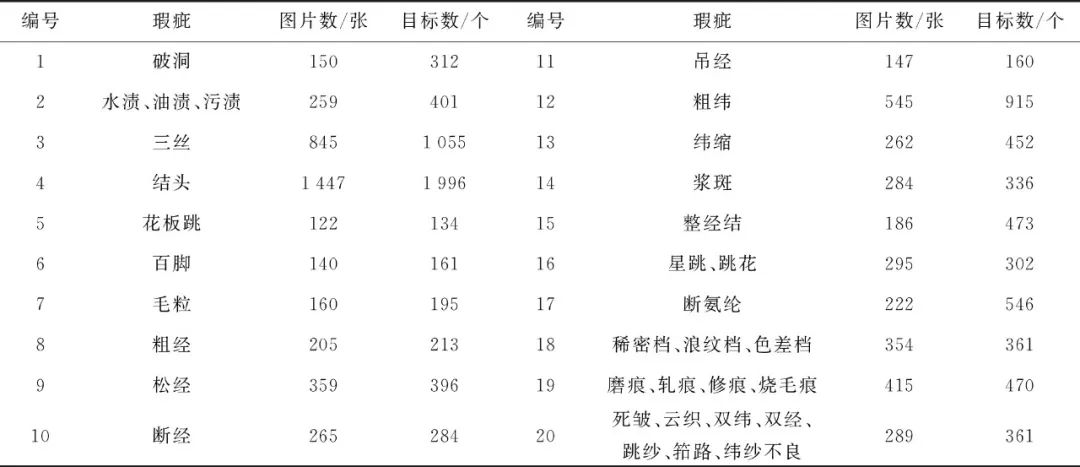

本文使用天池布匹疵點(diǎn)數(shù)據(jù)集,包含約9 600張大小為2 446×1 000的純色布匹圖像,其中正常圖片約3 600張,瑕疵圖片約6 000張,每張圖片包含一種或多種瑕疵的一個(gè)或幾個(gè),共9 523個(gè)疵點(diǎn),包含了紡織業(yè)中常見(jiàn)的34類布匹瑕疵,將某些類別合并后,最終分為20個(gè)類別。各類疵點(diǎn)的分類及數(shù)量見(jiàn)表1,其中6百腳、9松經(jīng)、10斷經(jīng)、11吊經(jīng)、14漿斑等屬于寬高比比較極端的疵點(diǎn),3三絲、4結(jié)頭、7毛粒、12粗緯、13緯縮等屬于小目標(biāo)的疵點(diǎn)。

表1 布匹瑕疵的分類與數(shù)量

Tab.1 Classification and quantity of fabric defects

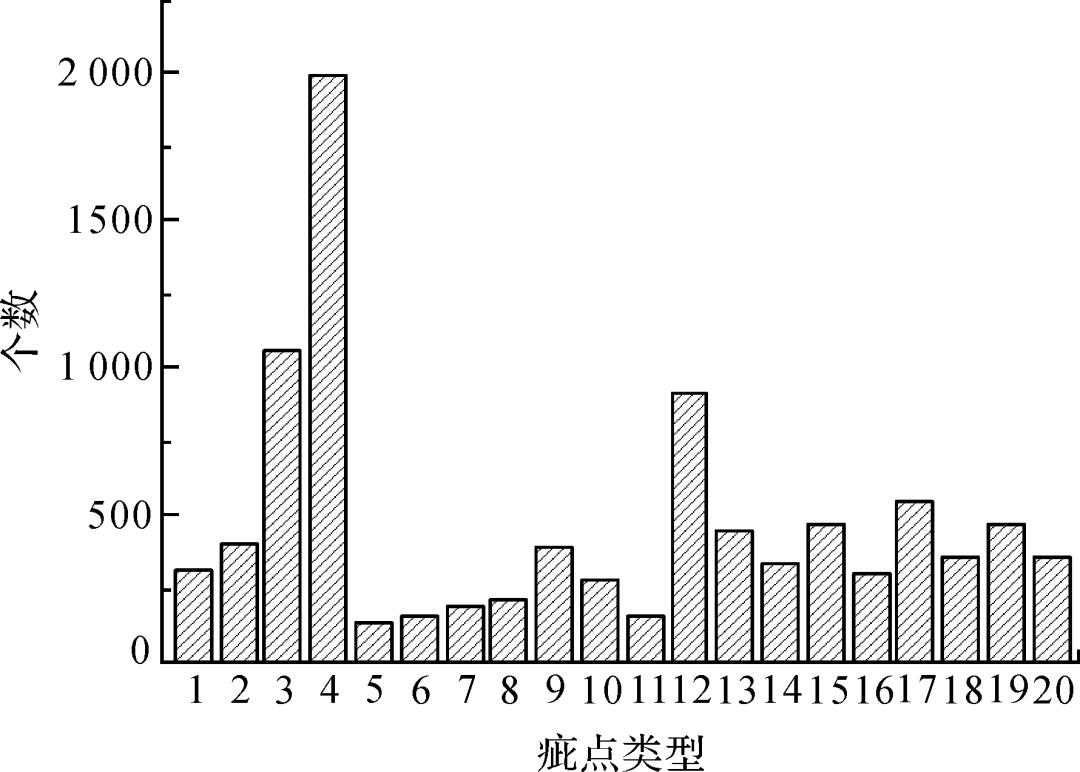

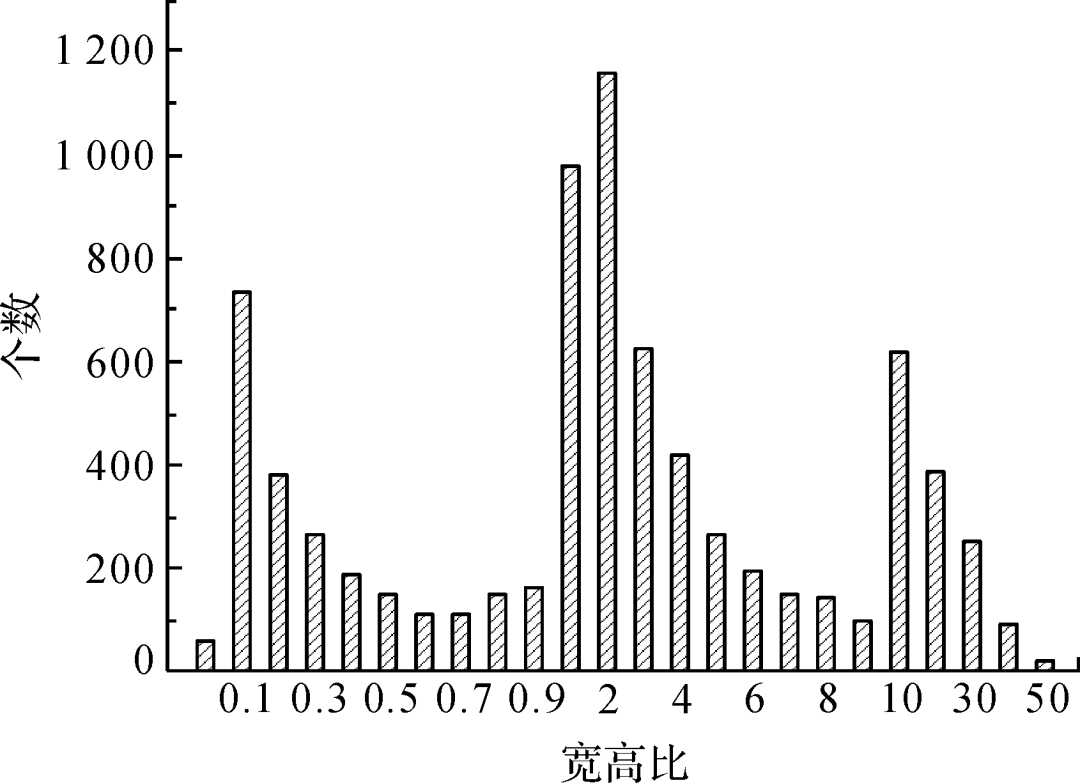

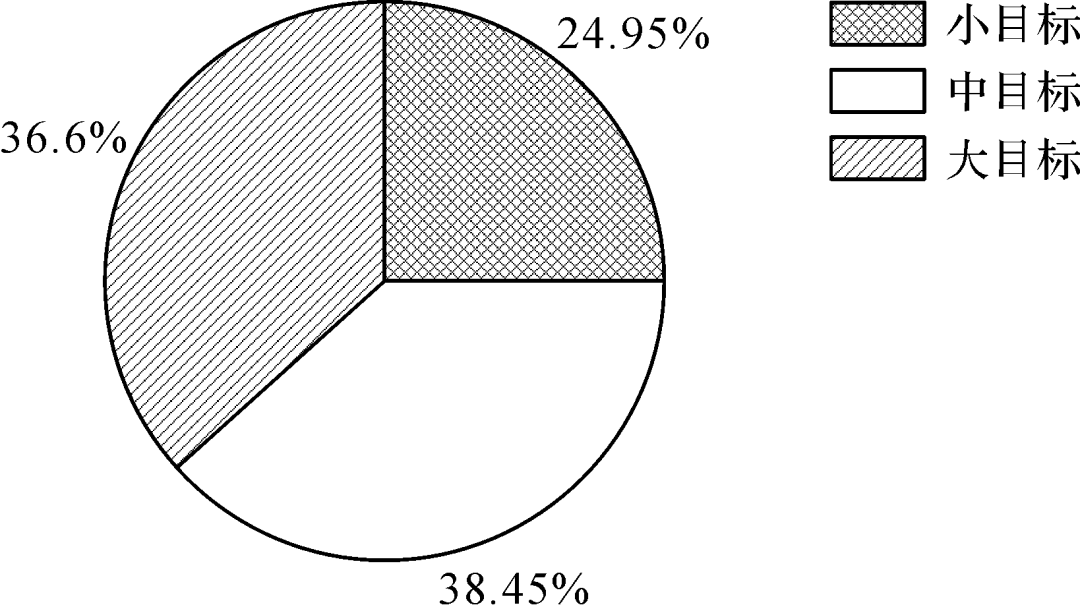

圖5為數(shù)據(jù)集中不同類型疵點(diǎn)的目標(biāo)數(shù)統(tǒng)計(jì),不同疵點(diǎn)間數(shù)目差異巨大,種類分布嚴(yán)重不均,例如結(jié)頭近2 000個(gè)樣本,而花板跳只有134個(gè)樣本,這容易產(chǎn)生過(guò)擬合,使訓(xùn)練出的模型泛化能力較差;圖6 展示了不同類型疵點(diǎn)的寬高比,從零點(diǎn)零幾到五十,疵點(diǎn)尺寸差異較大;圖7展示了典型的寬高比懸殊的疵點(diǎn);圖8為不同面積目標(biāo)的數(shù)量占比,其中小目標(biāo)占比較高,約四分之一,這些都給布匹疵點(diǎn)的檢測(cè)帶來(lái)了困難。

圖5 不同類別目標(biāo)數(shù)統(tǒng)計(jì)

Fig.5 Statistics of target number of different categories

圖6 目標(biāo)寬高比統(tǒng)計(jì)

Fig.6 Statistics of target aspect ratio

圖7 典型疵點(diǎn)

Fig.7 Typical defects

圖8 目標(biāo)面積統(tǒng)計(jì)

Fig.8 Statistics of target area

由于數(shù)據(jù)尺度固定,也不涉及自然場(chǎng)景,非常適合通過(guò)上下反轉(zhuǎn)等操作來(lái)進(jìn)行數(shù)據(jù)增強(qiáng)。為減少過(guò)擬合,降低疵點(diǎn)種類分布不均的影響,本文對(duì)樣本數(shù)小于200的四類疵點(diǎn)進(jìn)行了水平翻轉(zhuǎn)和垂直翻轉(zhuǎn)的線下增強(qiáng),對(duì)樣本數(shù)在200~300之間的三類疵點(diǎn)進(jìn)行了水平翻轉(zhuǎn)的線下增強(qiáng),最終將數(shù)據(jù)集擴(kuò)充到約 10 000 張瑕疵圖片。

2.2 實(shí)驗(yàn)環(huán)境及配置

實(shí)驗(yàn)運(yùn)行的環(huán)境為英特爾i9 10900X,GeForce RTX3080,32G內(nèi)存,Ubuntu18.04操作系統(tǒng)。 為盡可能地利用實(shí)驗(yàn)數(shù)據(jù),訓(xùn)練集中只使用瑕疵圖片,隨機(jī)選1000張正常圖片進(jìn)行兩等分,分別放于驗(yàn)證集和測(cè)試集,并向驗(yàn)證集和測(cè)試集中加入瑕疵圖片,最終訓(xùn)練集、驗(yàn)證集和測(cè)試集比例約為60%、20%和20%。對(duì)于所提出的Cascade R-CNN卷積神經(jīng)網(wǎng)絡(luò),選擇交叉熵作為分類損失函數(shù)。為了加快收斂速度,使用了COCO的預(yù)訓(xùn)練權(quán)重,并設(shè)置了梯度裁剪來(lái)穩(wěn)定訓(xùn)練過(guò)程,避免產(chǎn)生梯度爆炸或梯度消失。 考慮到樣本的寬高比差異較大,而Cascade R-CNN 網(wǎng)絡(luò)原始的邊界框比例是根據(jù)COCO數(shù)據(jù)集設(shè)計(jì)的,原始的[0.5,1.0,2.0]的比例并不能滿足布匹疵點(diǎn)的需要,因此將邊界框比例設(shè)計(jì)為[0.02,0.05,0.1,0.5,1.0,2.0,10.0,20.0,50.0]來(lái)提高檢測(cè)精度。 用Soft-NMS[18]代替了原模型中NMS[19],Soft-NMS沒(méi)有將其重合度較高的邊界框直接刪除,而是通過(guò)重合度對(duì)邊界框的置信度進(jìn)行衰減,最終得到的結(jié)果并非一定是全局最優(yōu)解,但比NMS更泛化,能有效避免面料疵點(diǎn)丟失,且不會(huì)增加算法的復(fù)雜度[20]。

2.3 實(shí)驗(yàn)結(jié)果對(duì)比

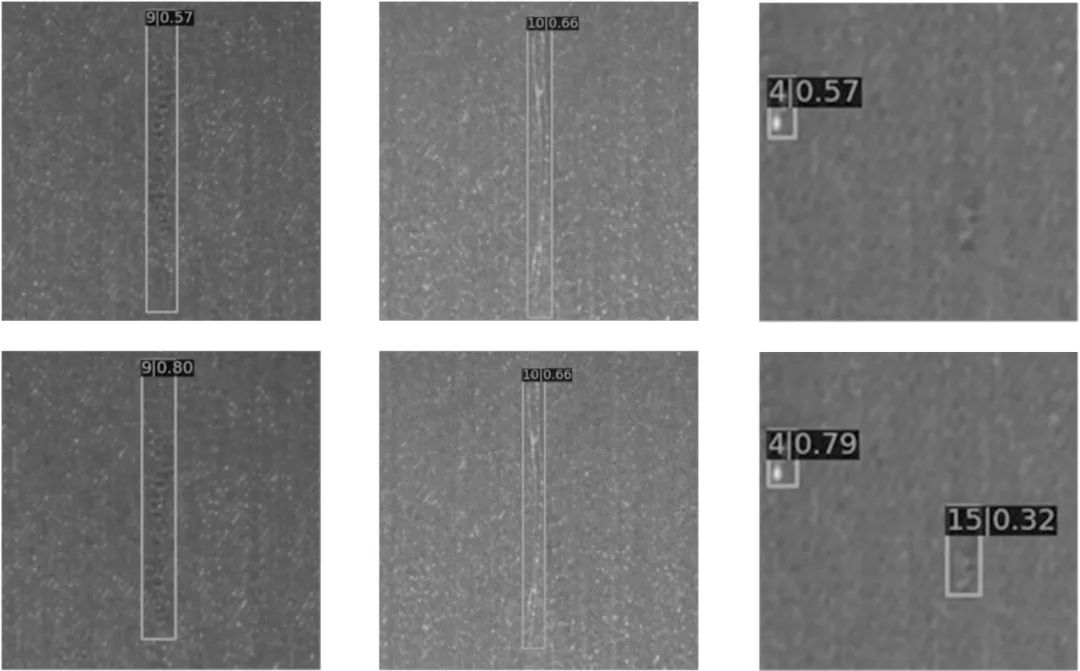

在進(jìn)行數(shù)據(jù)擴(kuò)增前,數(shù)量多的樣本能夠最先被識(shí)別出來(lái),而且最終的平均精確度較高,而數(shù)量少的樣本,識(shí)別出來(lái)的較晚,且最終的平均精確度較低,模型明顯過(guò)擬合,偏向于數(shù)量較多的樣本,通過(guò)對(duì)類別少的數(shù)據(jù)進(jìn)行數(shù)據(jù)擴(kuò)增,有效的緩解了這一問(wèn)題,且最終的檢測(cè)精度也有提升。 模型改進(jìn)前后的檢測(cè)效果對(duì)比如圖9所示,改進(jìn)前后的效果按照上下分布,改進(jìn)后的模型對(duì)目標(biāo)的邊界識(shí)別更加精準(zhǔn),對(duì)小目標(biāo)的檢出能力更強(qiáng),疵點(diǎn)檢測(cè)效果更好。

圖9 模型改進(jìn)前后的檢測(cè)效果對(duì)比

Fig.9 The Comparison of detection effect before and after model improvement

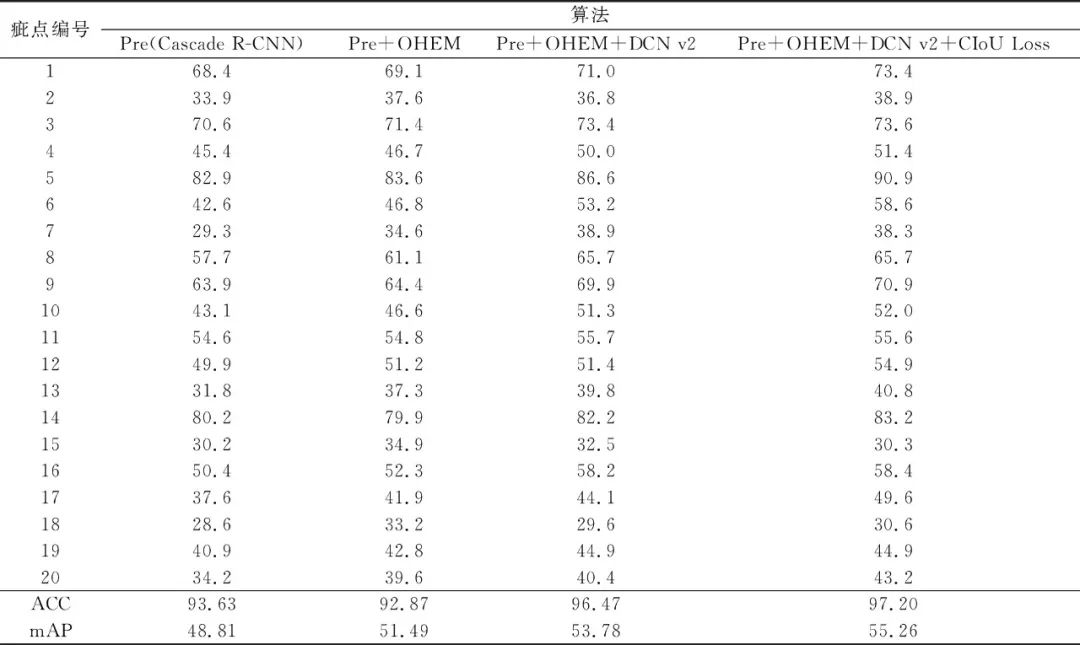

為了對(duì)比模型的性能,本文以準(zhǔn)確率ACC和平均精確度均值mAP[21]作為評(píng)價(jià)指標(biāo),ACC是有瑕疵或無(wú)瑕疵的二分類指標(biāo),評(píng)估瑕疵檢出能力。mAP是所有類別的平均精確度的均值,參照PASCALVOC的評(píng)估標(biāo)準(zhǔn)[22]進(jìn)行計(jì)算。模型改進(jìn)前后的評(píng)價(jià)參數(shù)如表2所示,在線難例挖掘采樣對(duì)2、7、13、15、17、18、20等類別的提升較大,這些類型本身的AP較低,可以歸為難例,證明了在線難例挖掘采樣的有效性。引入OHEM后,雖然模型準(zhǔn)確率略微下降,但平均精確度均值還是有較為明顯的提升。綜合來(lái)看,改進(jìn)后的模型在準(zhǔn)確率和平均精確度均值上分別提升了3.57%和6.45%,證明了上述3種方法的有效性。

表2 模型改進(jìn)前后的評(píng)價(jià)參數(shù)

Tab.2 Evaluation parameter before and after model improvement %

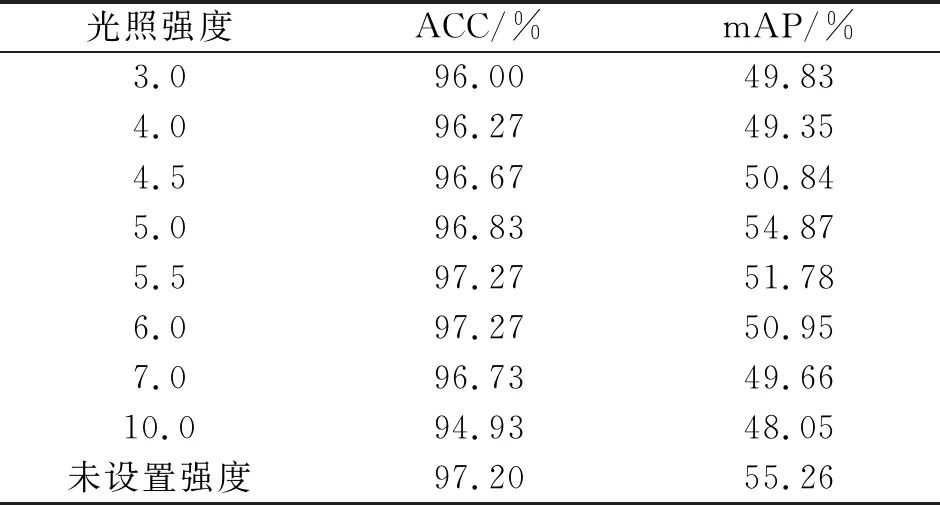

影響小目標(biāo)檢測(cè)效果的因素有輸入圖像的尺度、小目標(biāo)的數(shù)量、特征融合、邊界框的設(shè)計(jì)和光照強(qiáng)度等,為了獲得更好的檢測(cè)效果,在訓(xùn)練出模型后,再在不同的光強(qiáng)下對(duì)測(cè)試集進(jìn)行測(cè)試,本文使用了mmdetection框架的線上調(diào)整亮度的方式,將亮度劃分為0~10之間的小數(shù)范圍,對(duì)比實(shí)驗(yàn)結(jié)果如表3所示,不同光強(qiáng)下的平均精確度均值差異較大,驗(yàn)證了光強(qiáng)對(duì)布匹疵點(diǎn)的識(shí)別影響較大,但本文未能找到統(tǒng)一的最佳的光照強(qiáng)度,后通過(guò)比較數(shù)據(jù)集發(fā)現(xiàn),本文數(shù)據(jù)源于實(shí)際工業(yè)場(chǎng)景,不同數(shù)據(jù)已有明顯不同的光強(qiáng),且布匹顏色并不一致,不同顏色的布匹最合適的光強(qiáng)可能并不一致,因此本文的后續(xù)實(shí)驗(yàn)不再調(diào)整統(tǒng)一的光照強(qiáng)度,采用原始數(shù)據(jù)集的亮度。

表3 不同光照強(qiáng)度下測(cè)試集的對(duì)比

Tab.3 The comparison of the proposed algorithm under different light intensities on test sets

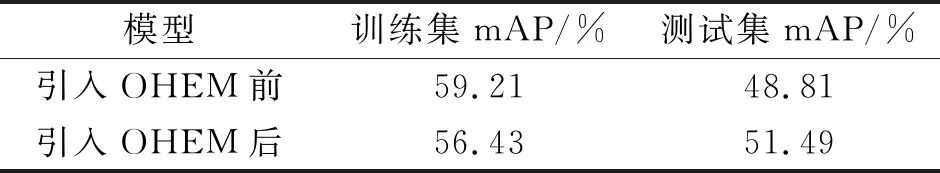

表4為引入在線難例挖掘采樣前后的模型性能對(duì)比,在引入在線難例挖掘之后,測(cè)試集上的性能明顯提升,而訓(xùn)練集上的性能反而下降,證明了在線難例挖掘采樣能夠減輕模型的過(guò)擬合,同時(shí)對(duì)于模型的性能提升也是有效的。

表4 引入OHEM前后的對(duì)比

Tab.4 The comparison before and after the introduction of OHEM

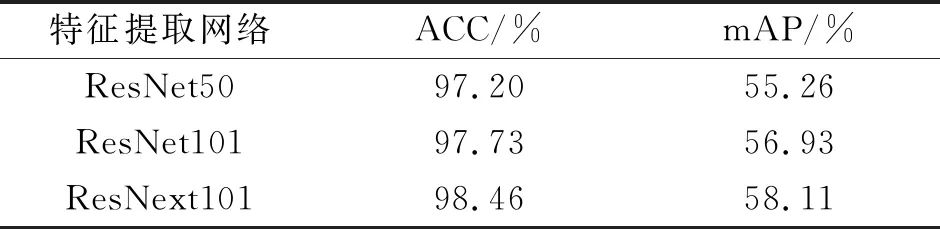

除ResNet50外,本文還選用了不同的特征提取網(wǎng)絡(luò)進(jìn)行對(duì)比實(shí)驗(yàn),如表5所示,改進(jìn)后的算法分別采用了ResNet50,ResNet101,ResNext101骨干網(wǎng)絡(luò)進(jìn)行對(duì)比,結(jié)果表明本文算法對(duì)這幾種骨干網(wǎng)絡(luò)都適用,在相同算法下,ResNext101的性能優(yōu)于ResNet101和ResNet50,準(zhǔn)確率和平均精確度均值分別達(dá)到了98.46%和58.11%,相比原來(lái)的ResNet50分別提升了1.26%和2.74%,平均精確度均值相比準(zhǔn)確率有著更為明顯的提升。

表5 算法在不同特征提取網(wǎng)絡(luò)上的對(duì)比

Tab.5 The comparison of algorithms on different feature extraction networks

結(jié)論

針對(duì)布匹疵點(diǎn)具有極端的寬高比,而且小目標(biāo)較多的問(wèn)題,提出了基于Cascade R-CNN的布匹檢測(cè)算法,根據(jù)布匹疵點(diǎn)的形狀特點(diǎn),用可變形卷積v2替代傳統(tǒng)的卷積方式進(jìn)行特征提取,并使用在線難例挖掘采樣的方法提升對(duì)小目標(biāo)疵點(diǎn)的檢測(cè)效果,用CIoU Loss提升邊界框的精度。結(jié)果表明,本文提出的方法比原始模型擁有更高的準(zhǔn)確率和平均精確度均值,疵點(diǎn)檢出能力更強(qiáng),精度更高。此外,由于實(shí)驗(yàn)環(huán)境算力的限制,本文未采用更多的擴(kuò)增數(shù)據(jù),也并沒(méi)有進(jìn)行模型融合去提升最終的模型評(píng)價(jià)指標(biāo)。實(shí)驗(yàn)過(guò)程中發(fā)現(xiàn),邊界框?qū)捀弑龋琋MS閾值,IoU閾值等一些超參數(shù)的設(shè)置,對(duì)模型的性能有極大的影響。例如小目標(biāo)尺度小,邊界框的交并比更低,在相同閾值下難以得到足夠的正樣本[23],因此,如何更深的理解布匹疵點(diǎn)數(shù)據(jù)特性,選擇最適合布匹疵點(diǎn)特性的超參數(shù)列表,以此來(lái)提高目標(biāo)檢測(cè)的性能,將是未來(lái)的一個(gè)研究方向。

審核編輯:郭婷

-

檢測(cè)器

+關(guān)注

關(guān)注

1文章

860瀏覽量

47652 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1205瀏覽量

24644

原文標(biāo)題:基于改進(jìn)級(jí)聯(lián)R-CNN的面料疵點(diǎn)檢測(cè)方法

文章出處:【微信號(hào):vision263com,微信公眾號(hào):新機(jī)器視覺(jué)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

基于深度學(xué)習(xí)的目標(biāo)檢測(cè)算法解析

PowerPC小目標(biāo)檢測(cè)算法怎么實(shí)現(xiàn)?

基于YOLOX目標(biāo)檢測(cè)算法的改進(jìn)

基于碼本模型的運(yùn)動(dòng)目標(biāo)檢測(cè)算法

介紹目標(biāo)檢測(cè)工具Faster R-CNN,包括它的構(gòu)造及實(shí)現(xiàn)原理

Mask R-CNN:自動(dòng)從視頻中制作目標(biāo)物體的GIF動(dòng)圖

什么是Mask R-CNN?Mask R-CNN的工作原理

手把手教你操作Faster R-CNN和Mask R-CNN

一種新的帶有不確定性的邊界框回歸損失,可用于學(xué)習(xí)更準(zhǔn)確的目標(biāo)定位

基于改進(jìn)Faster R-CNN的目標(biāo)檢測(cè)方法

基于深度學(xué)習(xí)的目標(biāo)檢測(cè)算法

深度學(xué)習(xí)在目標(biāo)檢測(cè)中的應(yīng)用

常見(jiàn)經(jīng)典目標(biāo)檢測(cè)算法:R-CNN、SPP-Ne

PyTorch教程-14.8。基于區(qū)域的 CNN (R-CNN)

無(wú)Anchor的目標(biāo)檢測(cè)算法邊框回歸策略

基于Cascade R-CNN的布匹檢測(cè)算法提高目標(biāo)檢測(cè)性能

基于Cascade R-CNN的布匹檢測(cè)算法提高目標(biāo)檢測(cè)性能

評(píng)論