【導讀】人的大腦和自監督學習模型的相似度有多高?

我們都知道,人類的大腦90%都是自監督學習的,生物會不斷對下一步發生的事情做出預測。

自監督學習,就是不需要外部干預也能做出決策。

只有少數情況我們會接受外部反饋,比如老師說:「你搞錯了」。

而現在有學者發現,大型語言模型的自監督學習機制,像極了我們的大腦。

知名科普媒體Quanta Magazine近日報道,越來越多的研究發現,自監督學習模型,尤其是大型語言模型的自學方式,與我們的大腦的學習模式非常類似。

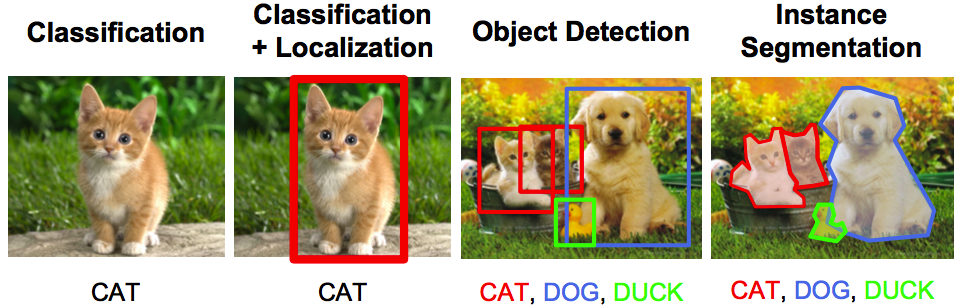

過去常見的AI系統都是使用大量標記數據進行訓練的。

例如,圖像可能被標記為「虎斑貓」或「虎貓」,用以訓練人工神經網絡來正確區分虎斑和虎。

這種「自監督」訓練需要人工費力地標記數據,而神經網絡通常會走捷徑,學習將標簽與最少、有時甚至是膚淺的信息聯系起來。

例如,神經網絡可能會使用草的存在來識別奶牛的照片,因為奶牛通常是在田野中拍攝的。

加州大學伯克利分校的計算機科學家阿列克謝·埃弗羅斯 (Alexei Efros) 說:

我們正在培養的算法,就像是一整個學期都沒來上課的本科生,雖然他們并沒有系統學習這些材料,但他們在考試中表現出色。

此外,對于對動物智能和機器智能的交叉感興趣的研究人員來說,這種「監督學習」可能僅限于它對生物大腦的揭示。

許多動物,包括人類不使用標記數據集來學習。在大多數情況下,他們自己探索環境,并且通過這樣做,他們對世界獲得了豐富而深刻的理解。

現在,一些計算神經科學家已經開始探索使用很少或沒有人工標記數據進行訓練的神經網絡。

最近的研究結果表明,使用自我監督學習模型構建的動物視覺和聽覺系統的計算模型比監督學習模型更接近大腦功能。

對一些神經科學家來說,人工神經網絡似乎開始揭示用大腦來類比機器學習的途徑。

有缺陷的監督

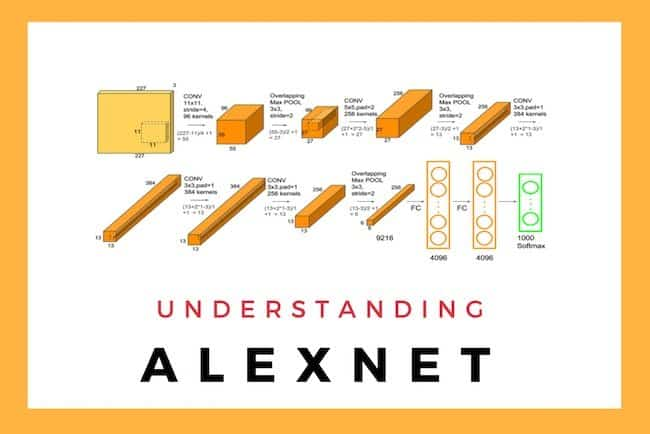

大約10年前,受人工神經網絡啟發的大腦模型開始出現,同時一個名為AlexNet的神經網絡徹底改變了對未知圖像進行分類的任務。

這項成果在Alex Krizhevsky、Ilya Sutskever和Geoffrey E. Hinton 的論文「ImageNet Classification with Deep Convolutional Neural Networks」中發表。

論文地址:https://dl.acm.org/doi/10.1145/3065386

與所有神經網絡一樣,該網絡由多層人工神經元組成,其中不同神經元之間連接的權重不同。

如果神經網絡未能正確分類圖像,學習算法會更新神經元之間連接的權重,以降低在下一輪訓練中錯誤分類的可能性。

該算法重復此過程多次,調整權重,直到網絡的錯誤率低到可以接受的程度。

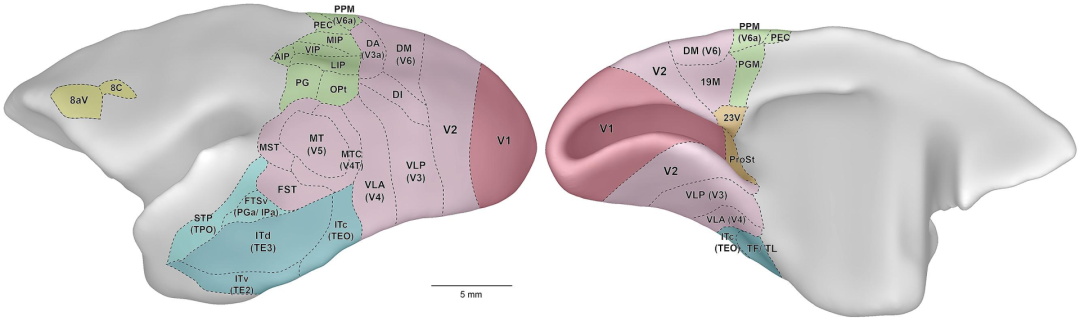

之后,神經科學家使用AlexNet開發了第一個靈長類視覺系統(Primate Visual System)的計算模型。

當猴子和人工神經網絡顯示相同的圖像時,真實神經元和人工神經元的活動顯示出類似的反應。

在聽覺和氣味檢測的人工模型上也取得了相似的結果。

但隨著該領域的發展,研究人員意識到自監督訓練的局限性。

2017年,德國蒂賓根大學的計算機科學家Leon Gatys和他的同事拍攝了一張福特T型車的照片,然后在照片上覆蓋了豹皮圖案。

而人工智能神經網絡將原始圖像正確分類為Model T,但將修改后的圖像視為豹子。

原因是它只專注于圖像紋理,不了解汽車(或豹子)的形狀。

自監督學習模型旨在避免此類問題。

瑞士巴塞爾弗里德里希·米歇爾生物醫學研究所的計算神經科學家弗里德曼·岑克 (Friedemann Zenke) 說,

在這種方法中,人類不會標記數據,相反,標簽來自數據本身。自監督算法本質上是在數據中創建空白,并要求神經網絡填補空白。

例如,在所謂的大型語言模型中,訓練算法將向神經網絡顯示句子的前幾個單詞,并要求它預測下一個單詞。

當使用從互聯網收集的大量文本進行訓練時,該模型似乎可以學習語言的句法結構,展示出令人印象深刻的語言能力——所有這些都沒有外部標簽或監督。

計算機視覺方面也正在進行類似的努力。

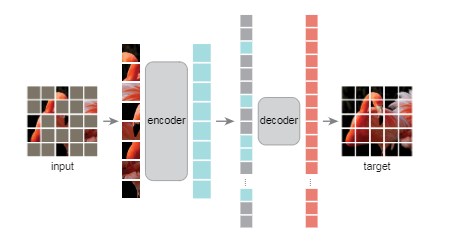

2021年底,何愷明及其同事展示了著名的掩碼自動編碼器研究「Masked Auto-Encoder」(MAE)。

論文地址:https://arxiv.org/abs/2111.06377

MAE將未掩碼部分轉換為潛在表示——壓縮的數學描述,其中包含有關對象的重要信息。

在圖像的情況下,潛在表示可能是一種數學描述,其中包括圖像中對象的形狀。然后解碼器將這些表示轉換回完整的圖像。

大腦也是「自監督」的

在這樣的系統中,一些神經科學家認為,我們的大腦實際上也是自監督學習的。

麥吉爾大學和魁北克人工智能研究所(Mila)的計算神經科學家布萊克-理查茲(Blake Richards)說:「我認為毫無疑問,大腦所做的90%都是自監督學習。」

生物大腦被認為是在不斷地預測,例如,一個物體在移動時的未來位置,或一句話中的下一個詞,就像自我監督學習算法試圖預測圖像或一段文字的間隙一樣。

理查茲和他的團隊創建了一個自監督模型,暗示了一個答案。他們訓練了一個結合兩種不同神經網絡的人工智能。

第一個,稱為ResNet架構,是為處理圖像而設計的;第二個,稱為遞歸網絡,可以跟蹤先前的輸入序列,對下一個預期輸入進行預測。

為了訓練聯合AI,該團隊從一連串的視頻開始,比如說10幀,讓ResNet逐一處理。

然后,遞歸網絡預測了第11幀的潛在表示,而不是簡單地匹配前10幀。自監督學習算法將預測值與實際值進行比較,并指示神經網絡更新其權重,以使預測效果更好。

為了進一步測試,研究人員向AI展示了一組視頻,西雅圖艾倫腦科學研究所的研究人員以前曾向小鼠展示過這些視頻。與靈長類動物一樣,小鼠的大腦區域專門用于靜態圖像和運動。艾倫研究人員在小鼠觀看視頻時記錄了小鼠視覺皮層的神經活動。

理查茲的團隊發現了AI和活體大腦對視頻的反應方式的相似之處。在訓練過程中,人工神經網絡中的一條途徑變得與小鼠大腦的腹側、物體探測區域更加相似,而另一條途徑則變得與注重運動的背側區域相似。

這些結果表明,我們的視覺系統有兩條專門的通路,因為它們有助于預測視覺的未來;單一的通路是不夠好的。

人類聽覺系統的模型講述了一個類似的故事。

6月,由Meta AI的研究科學家Jean-Rémi King領導的團隊訓練了一個名為Wav2Vec 2.0的人工智能,它使用一個神經網絡將音頻轉化為潛在的表征。研究人員對這些表征中的一些進行了屏蔽,然后將其送入另一個稱為轉化器的組件神經網絡。

在訓練過程中,轉化器預測被屏蔽的信息。在這個過程中,整個人工智能學會了將聲音轉化為潛在的表征,同樣,不需要標簽。

該團隊使用了大約600小時的語音數據來訓練網絡。「這大約是一個孩子在前兩年的經驗中得到的東西。」金說。

Meta AI的讓-雷米-金幫助訓練了一種人工智能,它以模仿大腦的方式處理音頻--部分是通過預測下一步應該發生什么

一旦該系統被訓練出來,研究人員給它播放英語、法語和普通話的有聲讀物部分,然后將AI的表現與412人的數據進行了比較(這些人都是以這三種語言為母語的人),他們在核磁共振掃描對自己的大腦進行成像時,聽了同樣長的一段音頻。

結果顯示,盡管fMRI圖像有噪音且分辨率不高,但AI神經網絡和人類的大腦「不僅相互關聯,而且還以系統的方式關聯」。

AI早期層的活動與初級聽覺皮層的活動一致,而AI最深層的活動則與大腦中較高層的活動相一致,比如前額葉皮層。

「這是非常漂亮的數據,雖然算不上是決定性的,但算得上是令人信服的證據,表明我們學習語言的方式在很大程度上是在預測接下來會說的話。」

有人不同意:模擬大腦?模型、算法都差的遠

當然,也并非所有人都認同這種說法。

MIT的計算神經科學家喬希-麥克德莫特(Josh McDermott)曾使用監督和自監督學習研究視覺和聽覺的模型。他的實驗室設計了一些人工合成的音頻和視覺信號,對于人類來說,這些信號只是難以捉摸的噪音。

然而,對于人工神經網絡來說,這些信號似乎與真實語言和圖像沒有區別。這表明,在神經網絡的深層形成的表征,即使是自監督學習,也與我們大腦中的表征不一樣。

麥克德莫特說:「這些自我監督的學習方法是一種進步,因為你能夠學習能夠支持很多識別行為的表征,而不需要所有標簽。但仍然有很多監督模型的特征。」

算法本身也需要更多改進。比如在Meta AI的Wav2Vec 2.0模型中,AI只預測了幾十毫秒的聲音的潛在表征,比人發出一個噪音音節的時間還要短,更不用說預測一個詞了。

要真正實現讓AI模型和人類大腦相類似,我們還有很多事情要做,金說。

如果目前發現的大腦和自我監督學習模型之間的相似性在其他感官任務中也成立,將更有力地表明,無論我們的大腦有什么神奇的能力,都需要以某種形式進行自監督學習。

審核編輯 :李倩

-

AI

+關注

關注

87文章

30146瀏覽量

268421 -

人工智能

+關注

關注

1791文章

46859瀏覽量

237579 -

模型

+關注

關注

1文章

3172瀏覽量

48714

原文標題:人腦90%都是自監督學習,AI大模型離模擬大腦還有多遠?

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

時空引導下的時間序列自監督學習框架

【《大語言模型應用指南》閱讀體驗】+ 基礎知識學習

神經網絡如何用無監督算法訓練

深度學習中的無監督學習方法綜述

全球首款基于文心大模型的學習機—小度學習機Z30重磅發布

優必選宣布人形機器人Walker S接入百度文心大模型

OpenAI推出Sora:AI領域的革命性突破

2024年AI領域將會有哪些新突破呢?

使用自監督學習重建動態駕駛場景

大規模語言模型的基本概念、發展歷程和構建流程

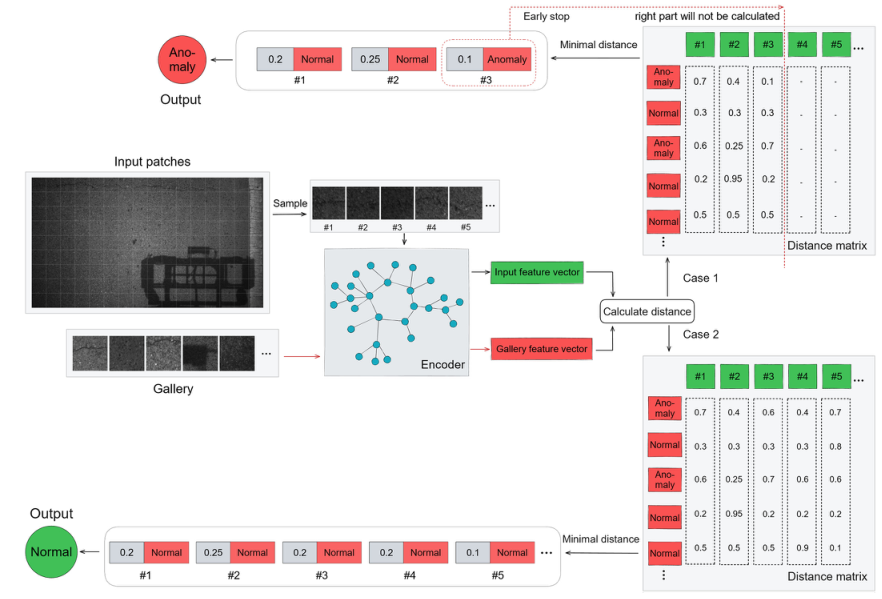

基于transformer和自監督學習的路面異常檢測方法分享

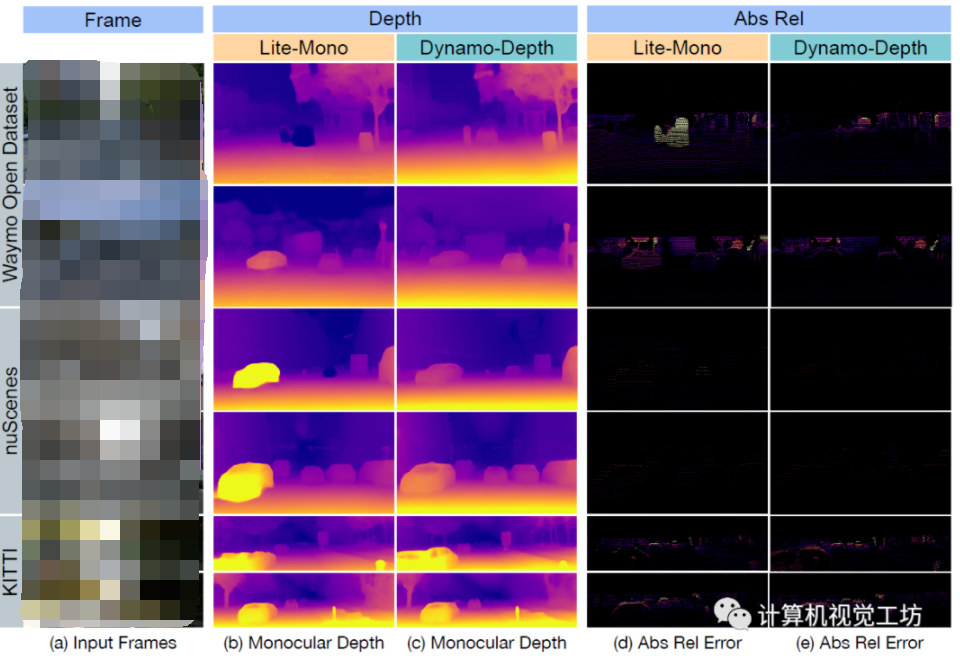

動態場景下的自監督單目深度估計方案

人的大腦和自監督學習模型的相似度有多高?

人的大腦和自監督學習模型的相似度有多高?

評論