01

Introduction-現(xiàn)有什么問題、怎么解決

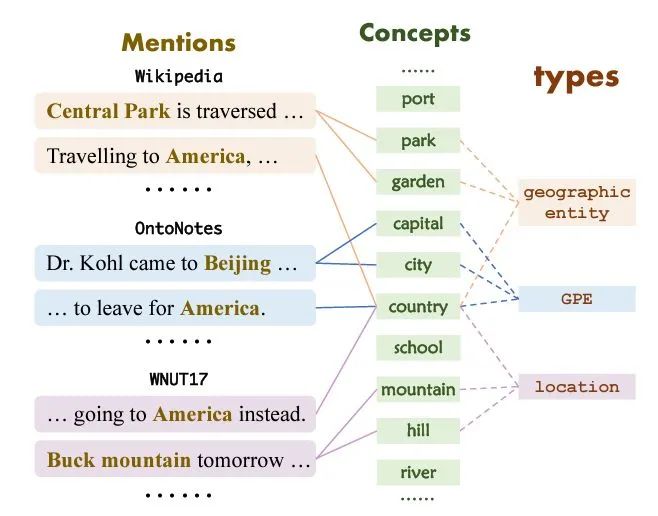

此部分著重介紹了兩個(gè)few-shot NER中的challenge:limited information challenge和knowledge mismatch challenge。前者主要是指樣本數(shù)少,后者是指不同的數(shù)據(jù)集中同一個(gè)實(shí)體可能被分成了不同的類別標(biāo)簽。(比如“America”在Wikipedia被分為geographic , 在 OntoNotes中被分為GPE, 在WNUT17被分為location )

本文最重要的思想基于這樣一個(gè)假設(shè):不論是否是未知的實(shí)體類別,都可以用一個(gè)概念集中的若干概念來(lái)描述(all entity types can be described using the same set of concepts)。這樣可以解決knowledge mismatch challenge,而且在給了幾個(gè)少樣本后,可以根據(jù)這幾個(gè)少樣本構(gòu)建新實(shí)體類別到概念集的映射,這樣可以直接用映射后的若干概念識(shí)別實(shí)體,進(jìn)而解決limited information challenge。下圖是實(shí)體類別到概念集的映射舉例。

02

SDNet: Self-describing Networks for FS-NER

2.1 SDNet核心部分: Mention describing、Entity generation

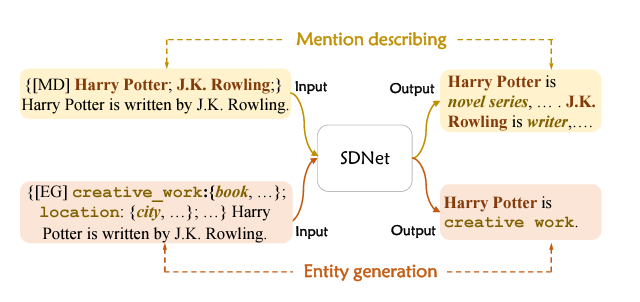

這部分將主要介紹SDNet怎么進(jìn)行命名實(shí)體識(shí)別的,主要包括:Mention describing(從給的sentence構(gòu)建該實(shí)體的concept description)和Entity generation(根據(jù)給的實(shí)體類型逐個(gè)生成句子中的實(shí)體詞)。

以下圖為例,輸入一個(gè)sentence(以[MD]作為起始符),SDNet將輸出novel series這樣的concept description。輸入一個(gè)以[EG]作為起始符、實(shí)體類別名+相關(guān)的concept description以及待識(shí)別的sentence作為內(nèi)容的文本,SDNet將輸出Harry Potter is creative work.這樣的回答。這兩個(gè)過程分別對(duì)應(yīng)Mention describing和Entity generation。

2.2 模型工作流程

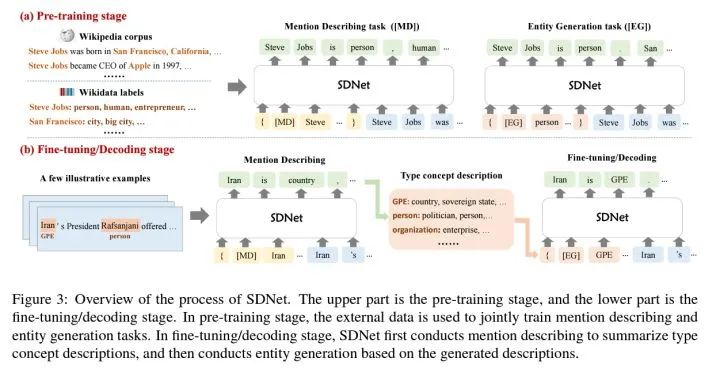

a、預(yù)訓(xùn)練階段

左上角的維基百科上有大量的句子,句子中的人物、地點(diǎn)、公司等都有相應(yīng)的維基百科給的標(biāo)簽和描述。預(yù)訓(xùn)練階段根據(jù)2.1部分介紹的模板,進(jìn)行[MD]和[EG]兩個(gè)任務(wù)的Seq2Seq任務(wù)的訓(xùn)練。

b、微調(diào)與解碼階段

這部分對(duì)應(yīng)于Few-shot NER的少樣本階段。給了一些帶標(biāo)注的少量樣本句子,我們知道了這些句子中那些單詞是實(shí)體部分,把這些實(shí)體部分添加到以[MD]開頭的模板并輸入到SDNet中,模型會(huì)生成這些實(shí)體部分描述,并將生成的描述加入到新類別的概念描述集中,并在預(yù)測(cè)階段輸入添加了新類別的[EG]開頭的模板,根據(jù)生成的結(jié)果判斷待預(yù)測(cè)的句子中哪些單詞部分是該類別的實(shí)體。

以上圖中為例,給的少樣本中Iran是GPE類別的實(shí)體,SDNet先用[MD]開頭的模板生成了Iran是country的描述,將country加入到屬于GPE這個(gè)新類別的概念描述集合中,在預(yù)測(cè)階段用[EG]開頭的模板輸入GPE這個(gè)類別名、其包含的概念描述以及待識(shí)別的句子,生成屬于GPE的實(shí)體詞,完成實(shí)體識(shí)別。

c、Filtering Strategy

在眾多下游任務(wù)中,SDNet可能會(huì)遇到難以生成新實(shí)體類別描述的情況(或者或生成不準(zhǔn)確的描述),因此SDNet在訓(xùn)練階段可以對(duì)于那些不去確定的instance生成other的描述詞。如果給少量樣本生成的描述詞中有0.5以上的other,將在最后的decode階段直接使用新實(shí)體類別名(如GPE)。(實(shí)驗(yàn)部分可以看到這個(gè)策略帶來(lái)了一定的提升)

具體實(shí)現(xiàn)過程將不再贅述,可以看原文的第4部分,有對(duì)預(yù)訓(xùn)練和fintune階段的詳細(xì)介紹。

03

實(shí)驗(yàn)部分

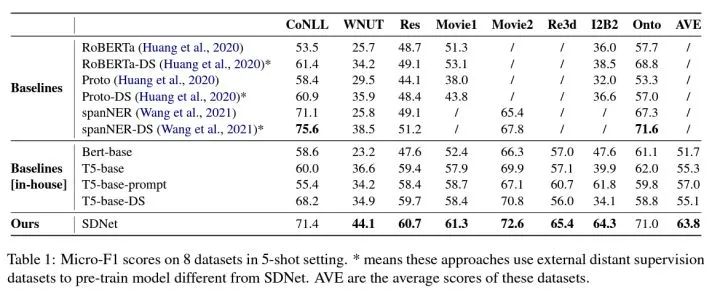

這種借助先驗(yàn)知識(shí)的方式,在6個(gè)數(shù)據(jù)集上都取得了很好的效果,尤其是對(duì)一些之前的識(shí)別效果一直很差的(比如I2B2),這說(shuō)明這種通用的實(shí)體概念集合在各種類別間是通用的。

04

評(píng)價(jià)

優(yōu)點(diǎn):

為少樣本NER引用外部知識(shí)提供了新思路,且提供了可直接使用的,通用的預(yù)訓(xùn)練模型,可以為后來(lái)的研究工作提供參考。

可能的缺陷:

在很多新領(lǐng)域下(尤其涉及到domain transfer)的,可能會(huì)出現(xiàn)很多無(wú)法描述成概念集合的實(shí)體類別,出現(xiàn)大量的other,這時(shí)只能用實(shí)體類別名了,在完全不重疊的領(lǐng)域之間可能效果會(huì)不佳。

另外,預(yù)訓(xùn)練階段使用的維基百科,大量的是事件人物地點(diǎn)等這些廣泛且常用的,面對(duì)實(shí)際應(yīng)用中的非常見實(shí)體類別時(shí),可能做不到很好的描述。

在大量的語(yǔ)料中進(jìn)行訓(xùn)練,可能出現(xiàn)了“泄露”,當(dāng)然這只是一個(gè)猜測(cè)。

審核編輯:劉清

-

SDNet

+關(guān)注

關(guān)注

0文章

4瀏覽量

5622

原文標(biāo)題:ACL2022 | 基于自描述網(wǎng)絡(luò)的小樣本命名實(shí)體識(shí)別

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

ad如何設(shè)置兩個(gè)元器件的距離

觸發(fā)器的兩個(gè)穩(wěn)定狀態(tài)分別是什么

雙穩(wěn)態(tài)觸發(fā)器的兩個(gè)基本性質(zhì)是什么

兩個(gè)銅片可以形成原電池嗎

為什么在交流電橋中至少需要兩個(gè)可調(diào)參數(shù)?

原電池中的兩個(gè)電極能是相同的嗎?

arcgis中如何關(guān)聯(lián)兩個(gè)屬性表

兩個(gè)電位器兩地控制一個(gè)變頻器,如何接線?

兩個(gè)機(jī)器的時(shí)鐘怎么同步?

ADXRS453能同時(shí)檢測(cè)兩個(gè)方向嗎?

如何給C語(yǔ)言中的函數(shù)定義兩個(gè)不同的名字?

如何設(shè)置兩個(gè)路由器使用同一個(gè)Wi-Fi網(wǎng)絡(luò)?

兩個(gè)硬盤2個(gè)系統(tǒng)開機(jī)切換

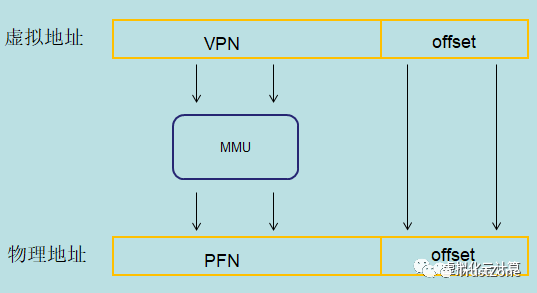

MMU包含兩個(gè)模塊是什么

介紹兩個(gè)few-shot NER中的challenge

介紹兩個(gè)few-shot NER中的challenge

評(píng)論