導讀:隨著社交網絡的飛速發(fā)展,人們在以微博、Twitter為代表的社交平臺上發(fā)表的內容逐漸趨于多模態(tài)化,比如用戶常以圖文并茂的方式來表達自己的態(tài)度和情感。因此,如何結合社交媒體上的圖片、視頻等富文本信息來分析用戶的情感傾向給傳統(tǒng)的單模態(tài)文本情感分析帶來了新的挑戰(zhàn)。

一方面,不同于傳統(tǒng)的文本情感分析,多模態(tài)情感分析需要利用不同網絡結構對多種模態(tài)內容進行基于情感的表示學習。另一方面,相比于單一的文本數據,多模態(tài)數據包含了多種不同信息,這些信息之間往往一一對應、互為補充,如何對齊不同模態(tài)的內容并提出有效的多模態(tài)融合機制是一個十分棘手的問題。

01 社交媒體分析的背景與發(fā)展趨勢

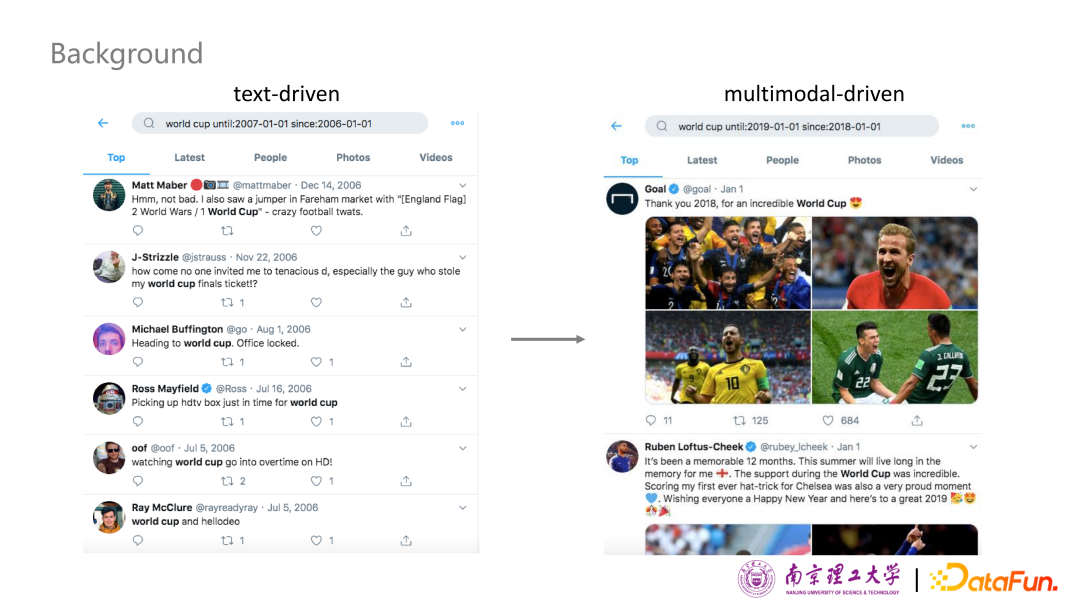

將近10年前,社交媒體才剛剛興起,社交媒體上的用戶內容都是以純文本為主。就以我們在Twitter上搜索 world cup 這個關鍵詞為例,并把時間定在2006 年到 2007 年之間,檢索出來的內容幾乎都是以文本內容為主。但是把時間定在 2018 年到 2019 年之間,檢索出來的用戶發(fā)帖大多都是以圖文并茂的方式呈現(xiàn)出來。

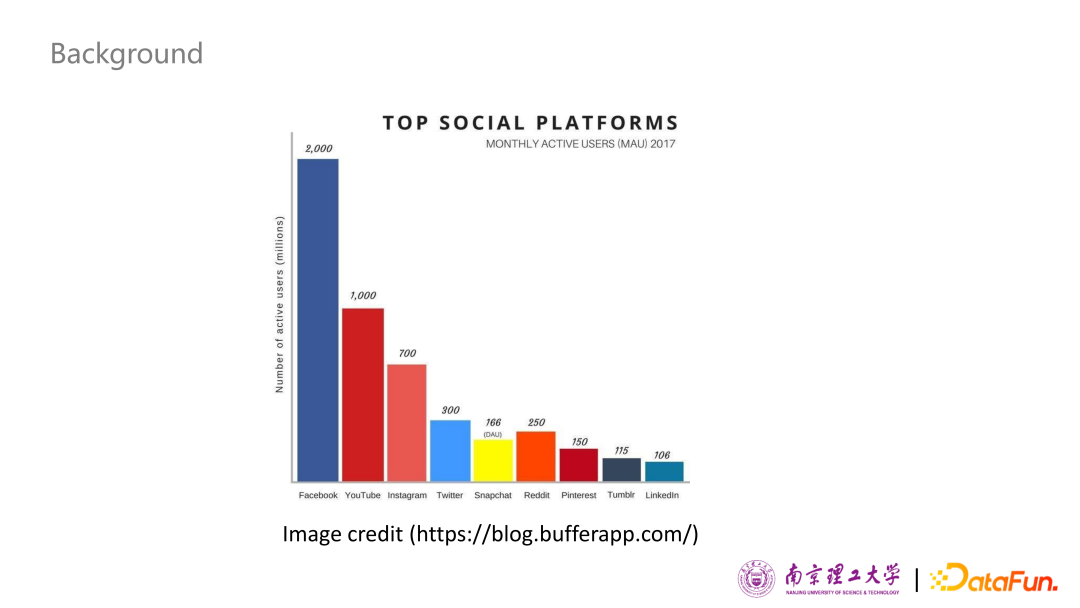

在2017年,對北美比較流行的社交媒體網站的月活躍用戶數量進行了統(tǒng)計,圖中橫坐標是各大社交媒體網站,縱坐標是月活躍用戶數量,單位是百萬。我們可以看到前五位中有三個社交媒體網站(YouTube、Instagram、Snapchat)是圖像或視頻內容為主、文本內容為輔的多模態(tài)形式。而其中以純文本的內容為主的傳統(tǒng)社交媒體Facebook 和Twitter 也慢慢轉變到了多模態(tài)形式上來。

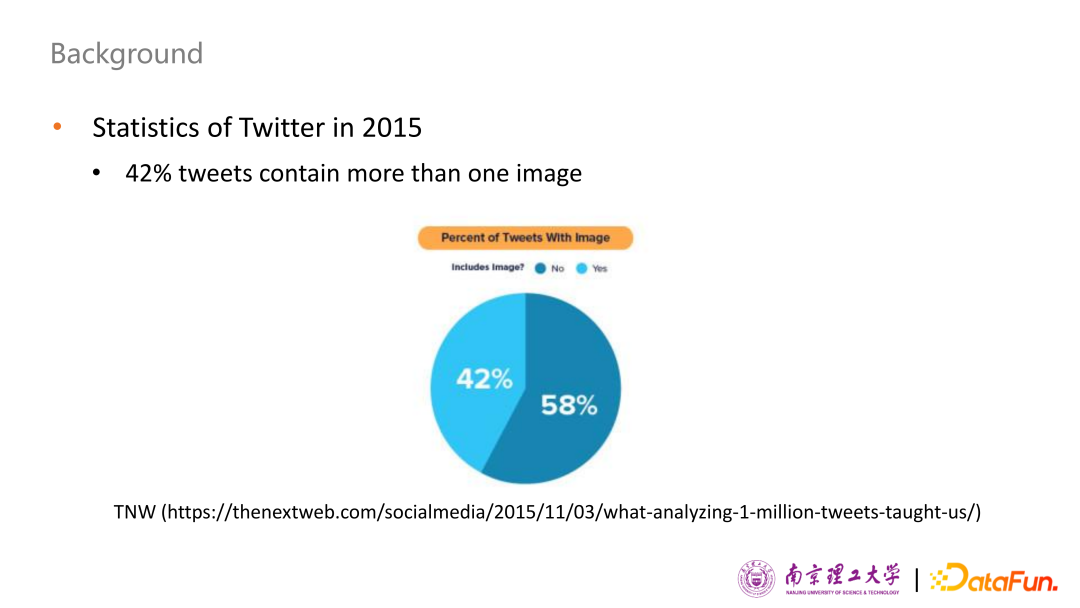

一個研究團隊對2015年的Twitter 用戶推文進行了統(tǒng)計分析,發(fā)現(xiàn)約 42% 的用戶推文包含至少一張圖片。因此在日趨快速發(fā)展的網絡時代,人們更加傾向于利用圖文結合或視頻的形式表達自己的觀點和情緒,社交媒體內容的多模態(tài)性(文本、圖片等)讓傳統(tǒng)的單模態(tài)情感分析方法面臨許多局限,多模態(tài)情感分析技術對跨模態(tài)內容的理解與分析具有重大的理論價值。

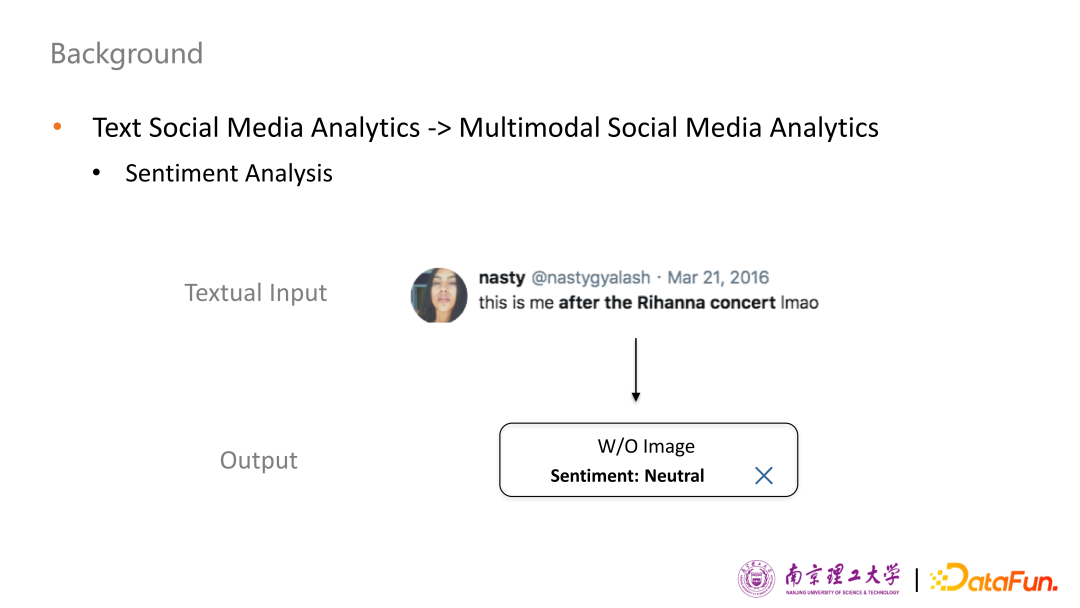

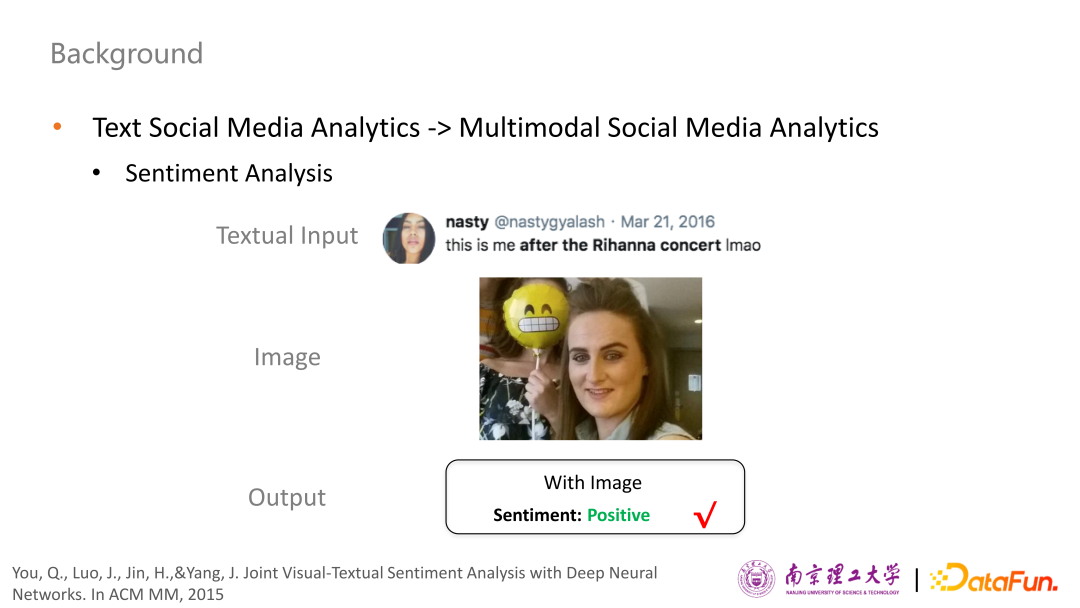

情感分析是自然語言處理的一項核心任務,旨在識別對觀點、情感和評價的情感極性。由于社交媒體信息具有多樣性,為了提高針對社交媒體的情感分析的準確性,綜合考慮文本和圖像信息進行多模態(tài)情感分析具有重要意義,接下來看幾個不同的多模態(tài)情感分析子任務。

首先來看第一個子任務,判斷用戶所表達情感傾向是正向、負向還是中立。如果只考慮純文本內容“this is me after the Rihanna concert”,很難判斷用戶的真實情感。對于機器而言,大概率判斷用戶情感是中立。但是加入圖片中的笑臉信息,我們可以輕松地判斷用戶表達了比較正面的情感。

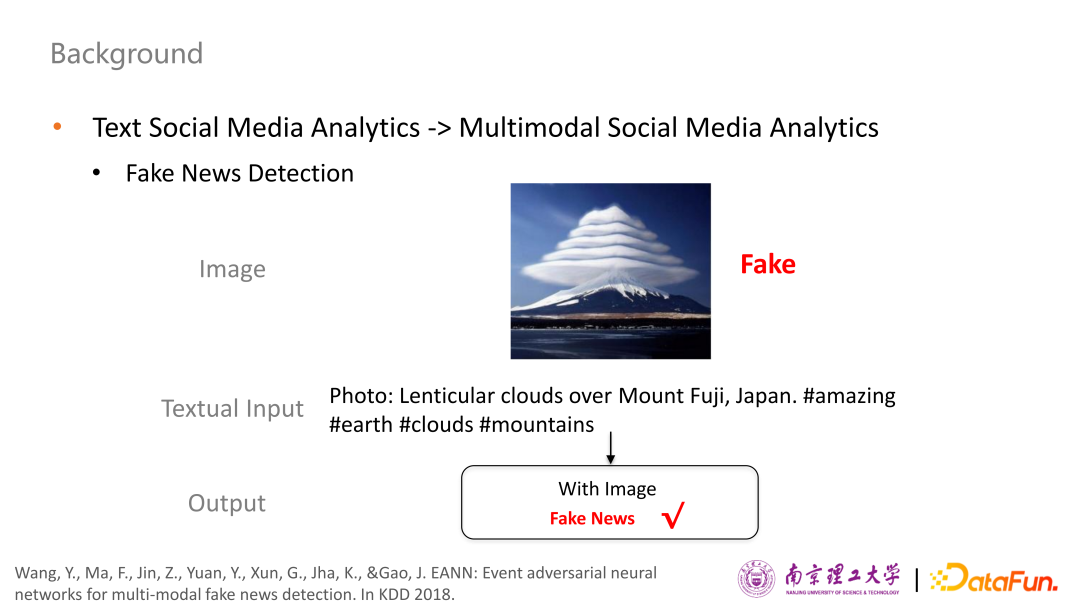

第二個任務是虛假新聞檢測。如果只看純文本內容,意思是日本的富士山上有多層云,我們無法判斷用戶推文的真?zhèn)涡浴5斘覀儼褕D片信息加入,可以明顯看出圖片中的云是經過人為 PS 過的,從而輕松地判斷出用戶發(fā)帖內容是虛假的。

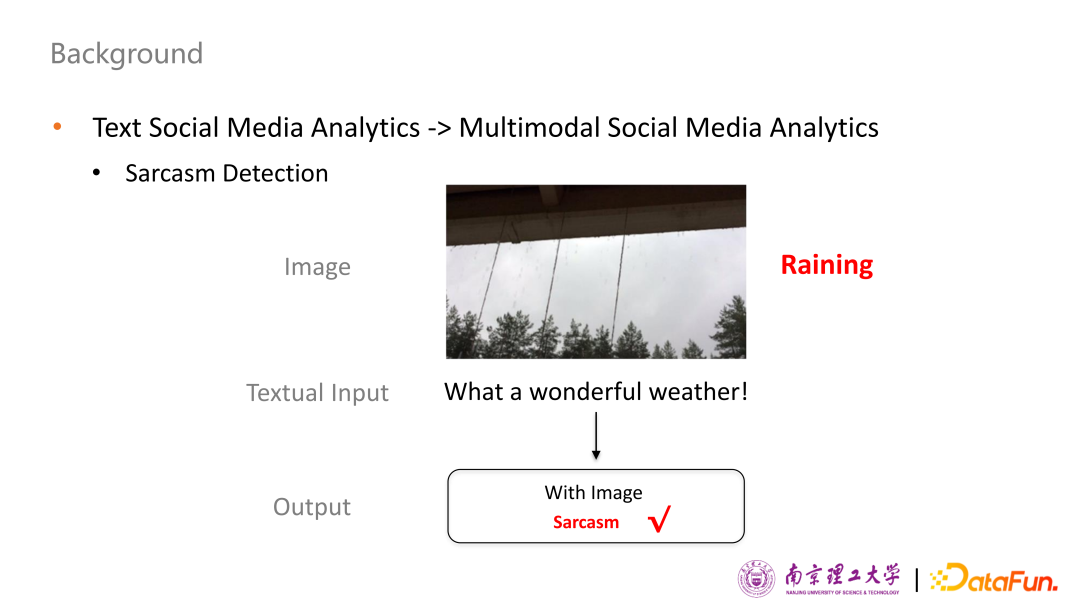

最后一個子任務叫做反諷識別,也稱為諷刺檢測。同樣地,只以純文本內容“what wonderful weather!”看,無法判斷出用戶對天氣是否存在反諷的意思。但引入下雨的圖片之后,文本內容和圖片內容形成了鮮明的對比,因此用戶其實在諷刺天氣非常糟糕。

綜上所述,社交媒體的不同多模態(tài)信息能夠提供非常重要的線索,還會對提升子任務識別檢測性能起到關鍵性的作用。因此與單模態(tài)相比,通過對社交媒體的數據進行多模態(tài)分析,有效地利用視覺信息和文本信息之間的關系及影響,不僅有利于學者準確地了解人們在現(xiàn)實世界中的生活態(tài)度與生活習慣,更能把握人們在醫(yī)療保健、政治話題、電視電影及線上購物等領域的選擇。

02

多模態(tài)屬性級情感分析任務劃分與定義

針對上述背景,本節(jié)聚焦于多模態(tài)屬性級情感分析任務,該任務主要包含三個子任務:多模態(tài)屬性抽取/多模態(tài)命名實體識別、多模態(tài)屬性情感分類任務、多模態(tài)屬性情感聯(lián)合抽取。

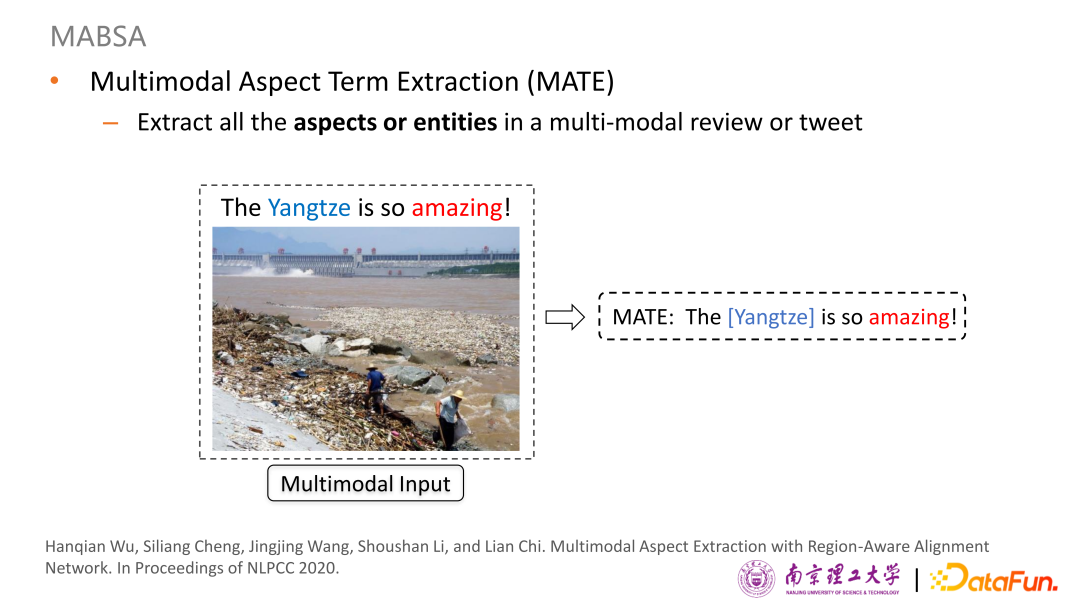

多模態(tài)屬性抽取(MATE):給定一段多模態(tài)產品評論或者用戶推文,抽取文本中提到的屬性詞。

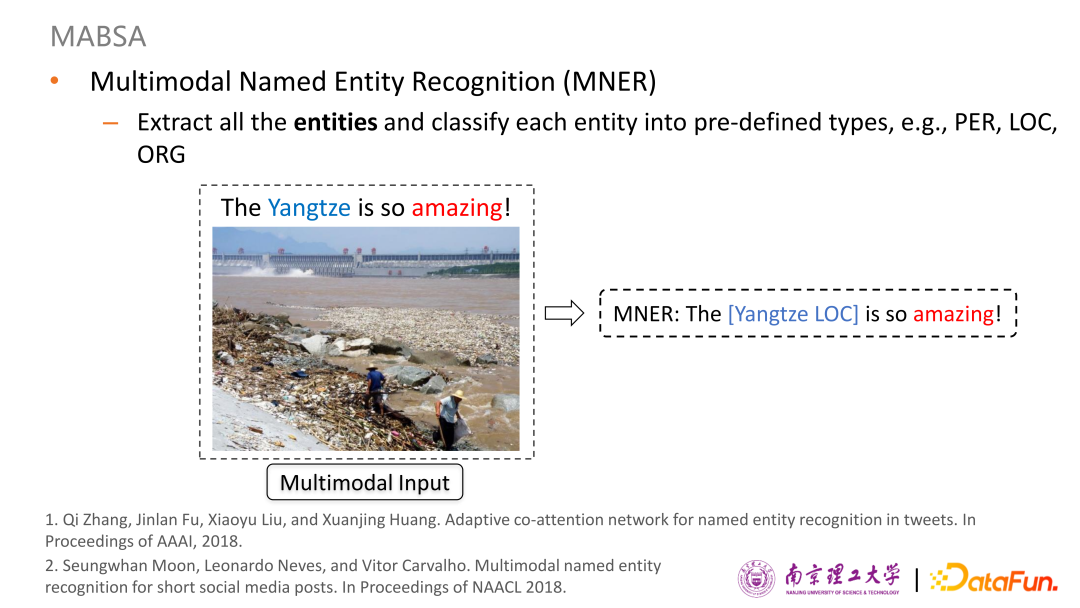

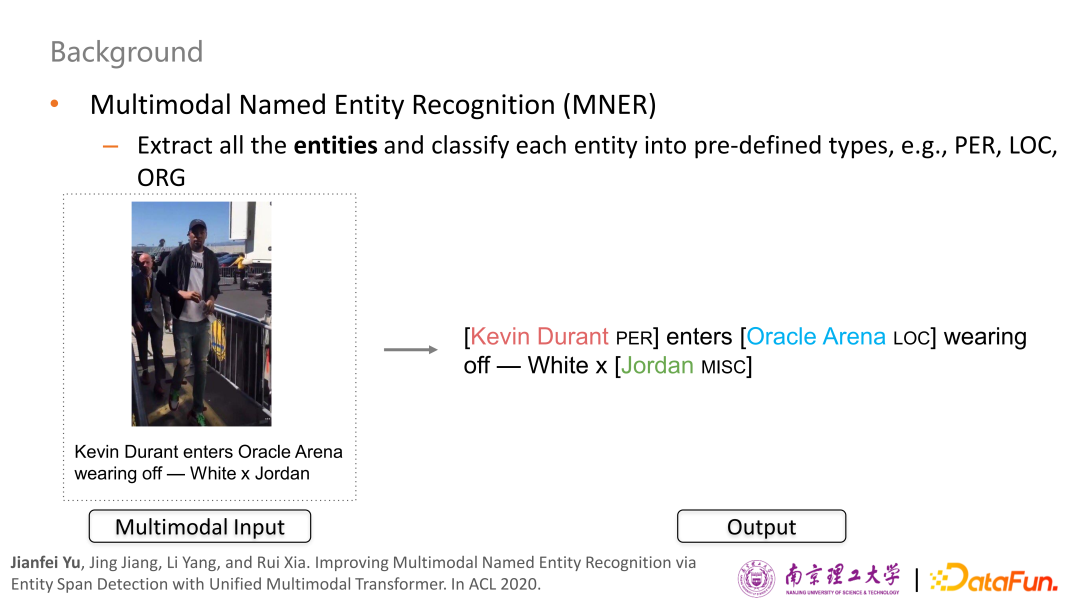

多模態(tài)命名實體識別(MNER):進一步判斷出抽取屬性詞的類別,利用圖像來提高推文命名實體識別的準確性,類別是提前預定義的,如人名、地名等。

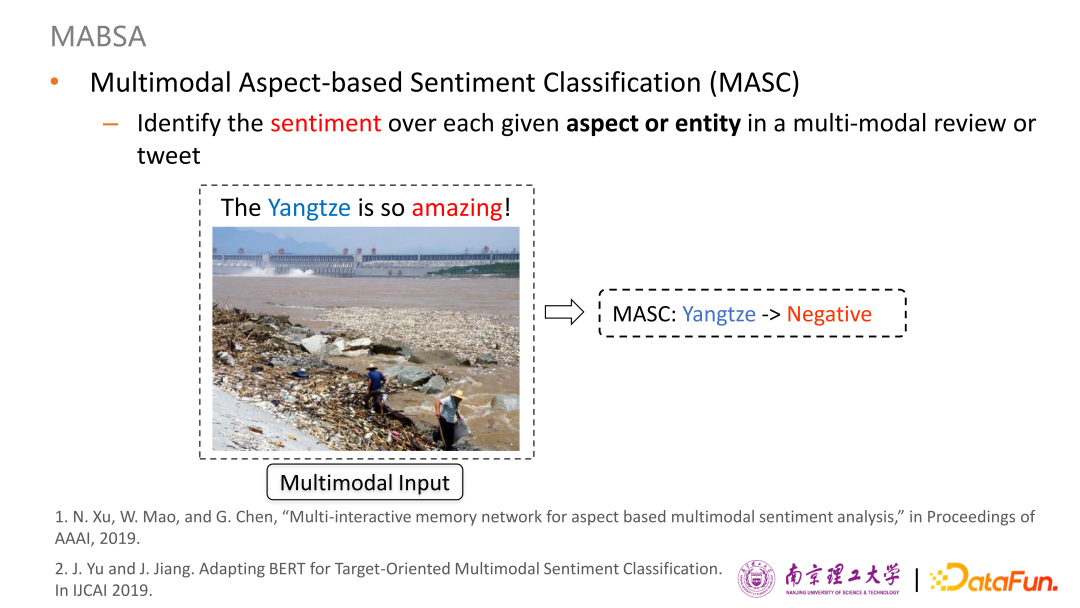

多模態(tài)屬性情感分類任務(MASC):對每一個抽取的屬性詞進行情感分類。

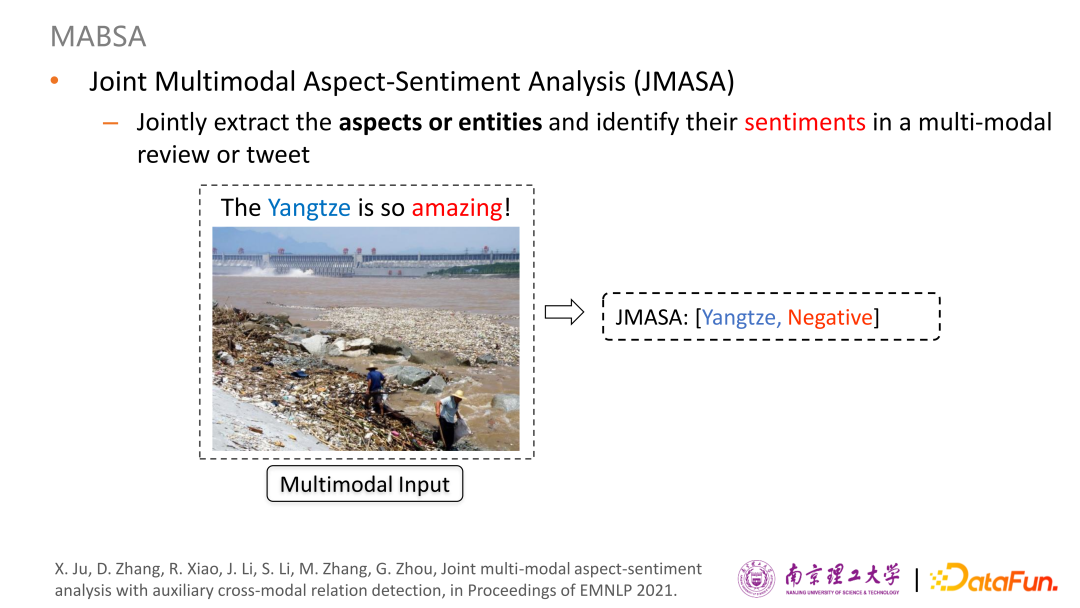

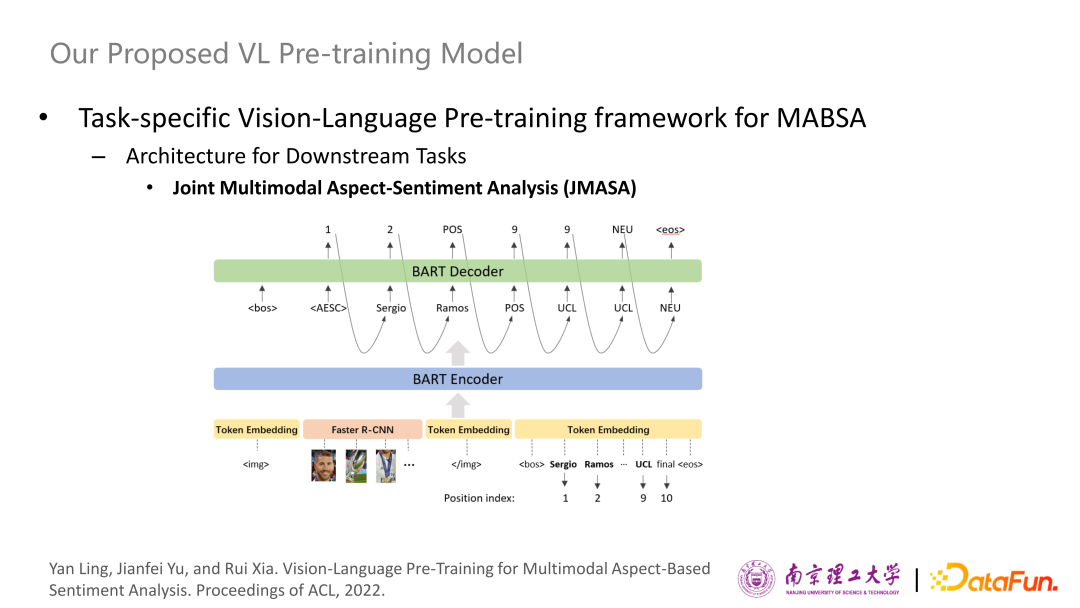

多模態(tài)屬性情感聯(lián)合抽取(JMASA):旨在同時抽取屬性詞極其相對應的情感詞(成對抽取),識別出所有的屬性-情感詞對。

多模態(tài)屬性抽取這個子任務的目標是從多模態(tài)輸入中抽取屬性詞。例如推文“The Yangtze is so amazing! ”加上一張配圖,抽取出推文中的屬性詞是Yangtze。

接下來需進一步判斷出屬性詞的類別是什么,比如人名類型、地名類型、機構名類型等,同樣以長江這個例子來看,判斷出Yangtze是一個地名類型的實體。

MASC子任務是對每一個抽取的屬性詞進行情感分類,以長江這個例子來判斷用戶表達的情感,單從文本內容“The Yangtze is so amazing!”,大概率會覺得用戶表達了正面的情感,但是從配圖中很多垃圾可以看出,用戶其實在反諷長江的環(huán)境污染問題比較嚴重,對長江表達的是負面情感,也可以看出圖像信息對于情感識別任務的重要性。

最后一個子任務是多模態(tài)屬性情感聯(lián)合抽取,旨在同時抽取多模態(tài)輸入中的屬性詞和其所對應的情感。還是以長江這個例子來看,抽取結果是:[Yangtze, Negative]。

03

相關研究工作

接下來這部分主要介紹,近幾年在多模態(tài)屬性情感分析任務的代表性研究工作。

首先是社交媒體帖子的多模態(tài)命名實體識別(MNER),在 ACL 2020 上提出了一個 Unified Multimodal Transformer 的模型。

具體論文參考: Jianfei Yu, Jing Jiang, Li Yang, and Rui Xia. Improving Multimodal Named Entity Recognition via Entity Span Detection with Unified Multimodal Transformer. In ACL 2020.

為什么提出這個模型?我們可以看一個例子,給定多模態(tài)用戶推文“Kevin Durant enters Oracle Arena wearing off- White x Jordan”和配圖,識別出Kevin Durant是一個人名類型的實體,Oracle Arena是一個地名類型的實體,Jordan是一個雜類類型的實體。

實際上,在大多數社交媒體帖子中,相關圖像往往只突出句子中的一兩個實體,而沒有提到其他實體。Kevin Durant可以從這個圖片當中判斷出是一個人名,但是Oracle Arena 在這個圖片中沒有得到任何體現(xiàn),如果過分強調這個圖片信息,會導致給圖片當中沒有出現(xiàn)的那部分實體帶來一定的噪音,可能會導致實識別性能變差。這就是提出Unified Multimodal Transformer模型的一個重要動機。

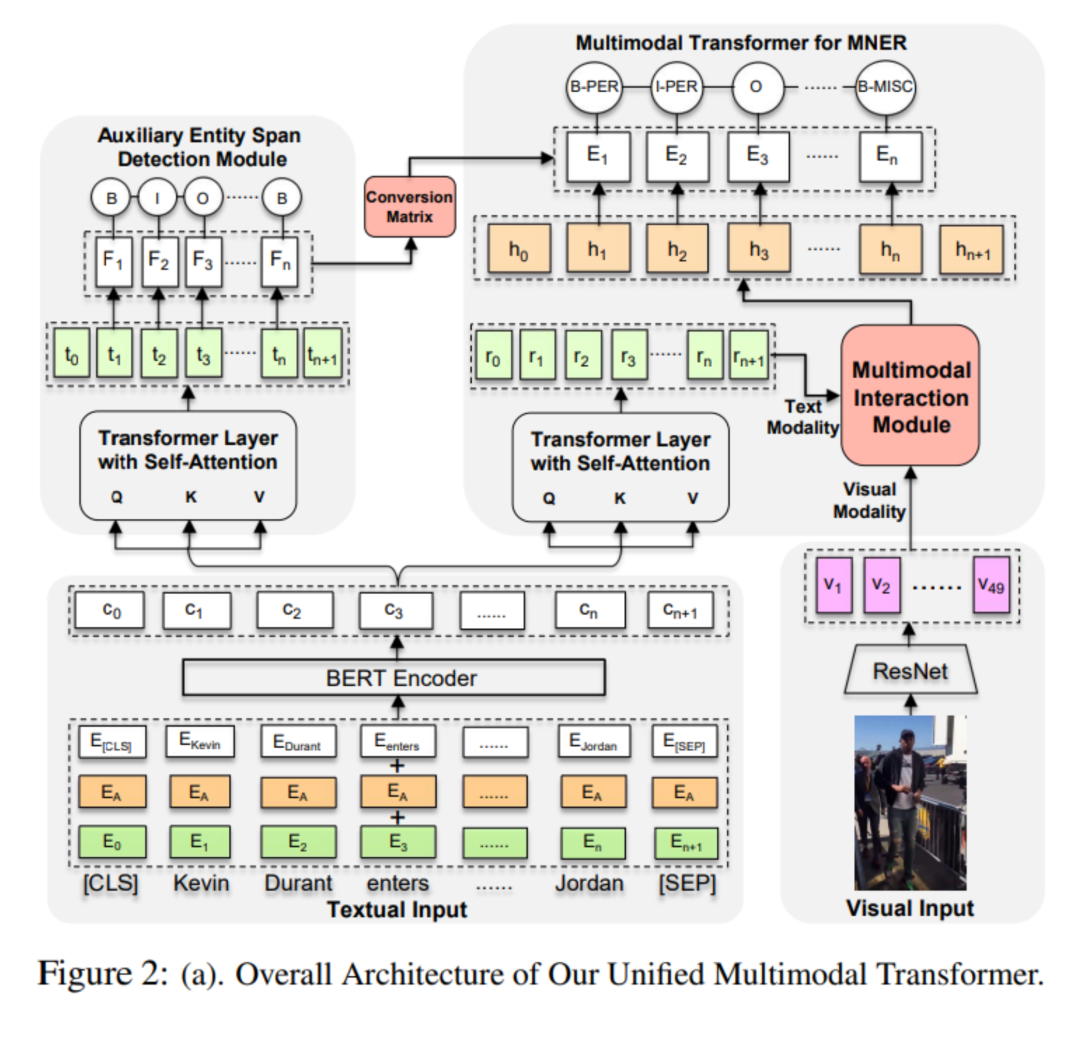

圖a是提出Unified Multimodal Transformer模型的總覽的框架圖,UMT的總體架構包含三個主要組件:

(1)單模態(tài)輸入的表示學習

(2)用于MNER的多模態(tài) Transformer

(3)具有輔助實體跨度檢測(ESD)模塊的統(tǒng)一結構

單模態(tài)輸入的表示學習包含文本輸入和圖像輸入。左下角表示文本輸入,選取BERT作為句子編碼器,每個輸入句子插入兩個特殊標記,[CLS]在開始,[SEP]在結尾。右下角表示圖像輸入端,選取CNN圖像識別模型之一的ResNet作為圖像編碼器,提取輸入圖像在其深層中有意義的特征表示。

右上方是用于MNER的多模態(tài) Transformer,首先BERT編碼器得到的C上添加一個標準Transformer層,以獲得每個詞的文本隱藏表示R= (r0,r1,...,rn+1),為捕獲文本到圖像以及圖像到文本之間的雙向交互,提出了一個多模態(tài)交互(MMI)模塊來學習圖像感知的詞表示和每個詞的詞感知的視覺表示。

除此之外,為了緩解學習模型過分強調圖像突出顯示的實體而忽略剩余實體的偏差,附加了一個實體范圍識別的任務作為auxiliary任務,即具有輔助實體跨度檢測(ESD)模塊的統(tǒng)一結構,使用純文本的ESD來指導我們的主要任務MNER的最終預測。

BERT編碼器得到的C使用另一個Transformer層來獲得其特定的隱藏表示T,然后將其送到CRF層,因為ESD與MNER這兩個任務是高度相關的,每個ESD標簽應該對應于MNER中的標簽子集,引入一個轉移矩陣來約束兩邊預測出來的實體位置保持一致。具體說,就是修改了MNER的CRF層,將實體跨度信息從ESD納入MNER任務的預測中。

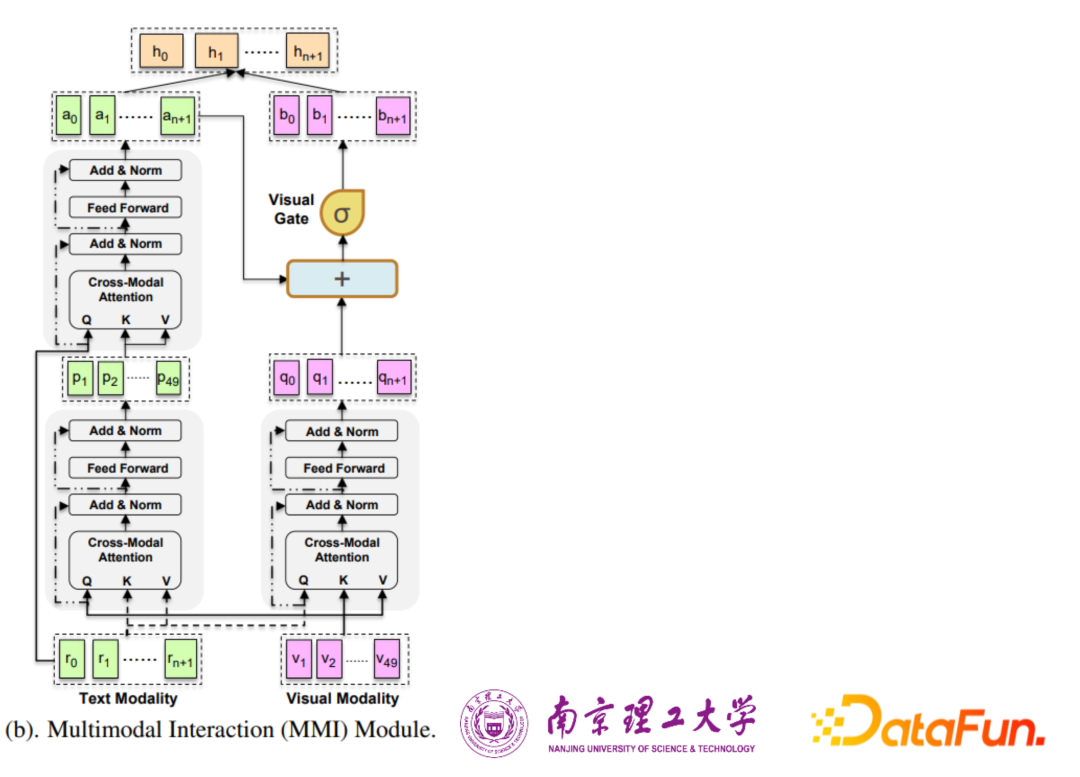

多模態(tài)交互(MMI)模塊,使用統(tǒng)一的Transformer結構來進行多模態(tài)信息的交互。使用三個cross transformer分別獲得圖像指導的文本表示、文本指導的圖像表示以及文本模態(tài)內部的交互表示,在兩個模態(tài)信息交互的過程中通過一個Visual Gate動態(tài)控制兩個模態(tài)之間的交互,為了合并詞表示和視覺表示,將A和B連接起來,以獲得最終的隱藏表示H;然后,將H送到標準CRF層,進行最終的序列標注任務。

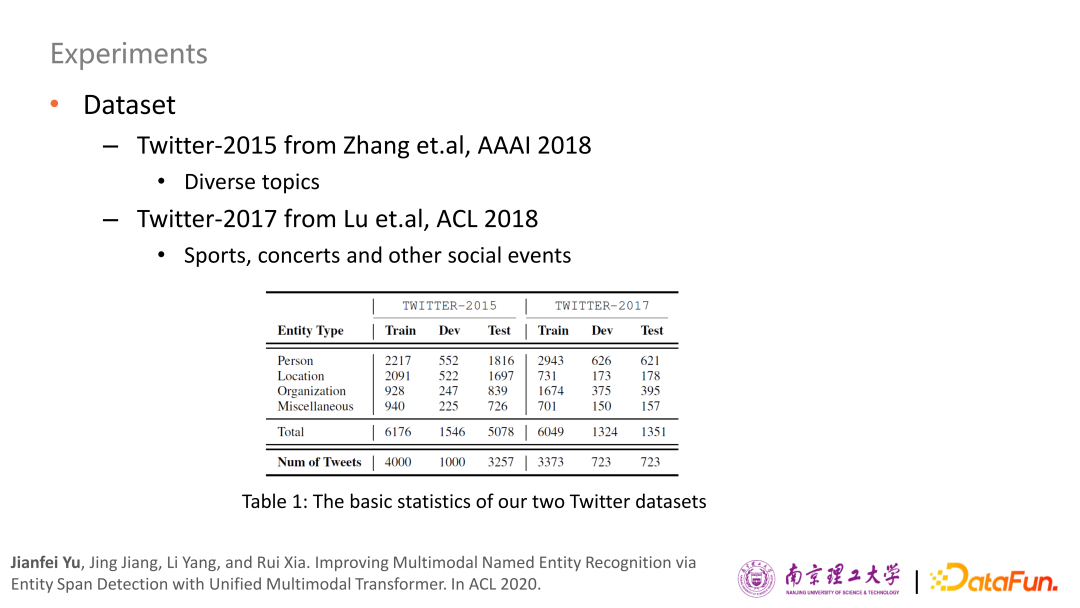

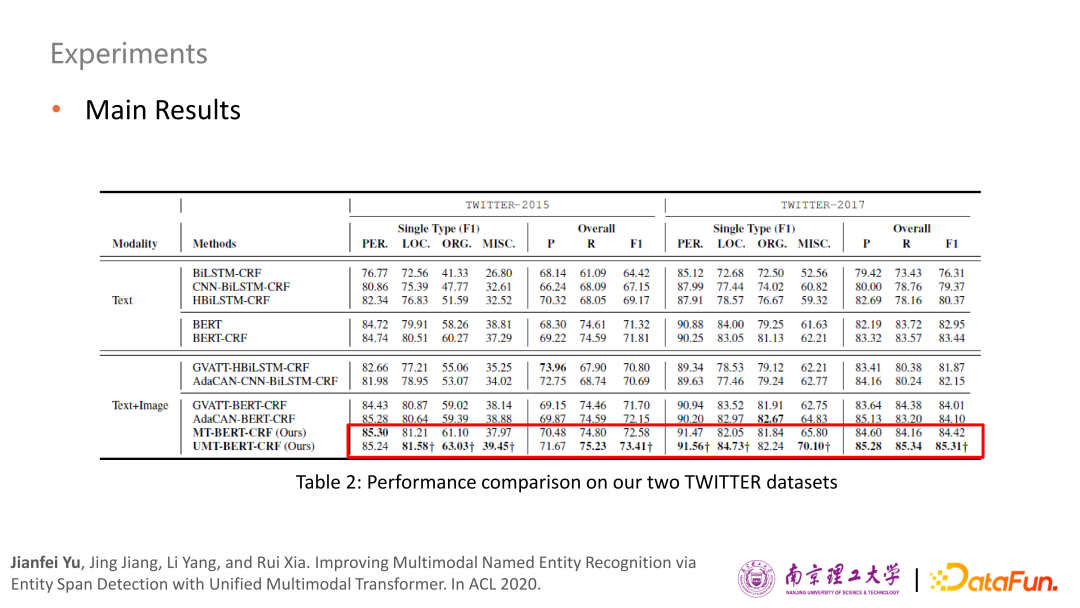

在兩個標準的 Twitter 數據集(Twitter15、Twitter17)進行了實驗,其中倒數第二行是把Unified Multimodal Transformer模型左上角輔助任務去掉的結果,相較于之前的一些研究模型都有非常明顯地提升,最后一行是Unified Multimodal Transformer模型的結果相較于沒有輔助任務的結果大概有一個點的性能提升。

小結:

第一個提出使用統(tǒng)一的Transformer結構來進行多模態(tài)信息的交互。

提出基于文本的具有輔助實體跨度檢測(ESD)模塊。

在兩個標準的 Twitter 數據集上都獲得了較先進的結果。

為其他團隊后來工作奠定了基礎。

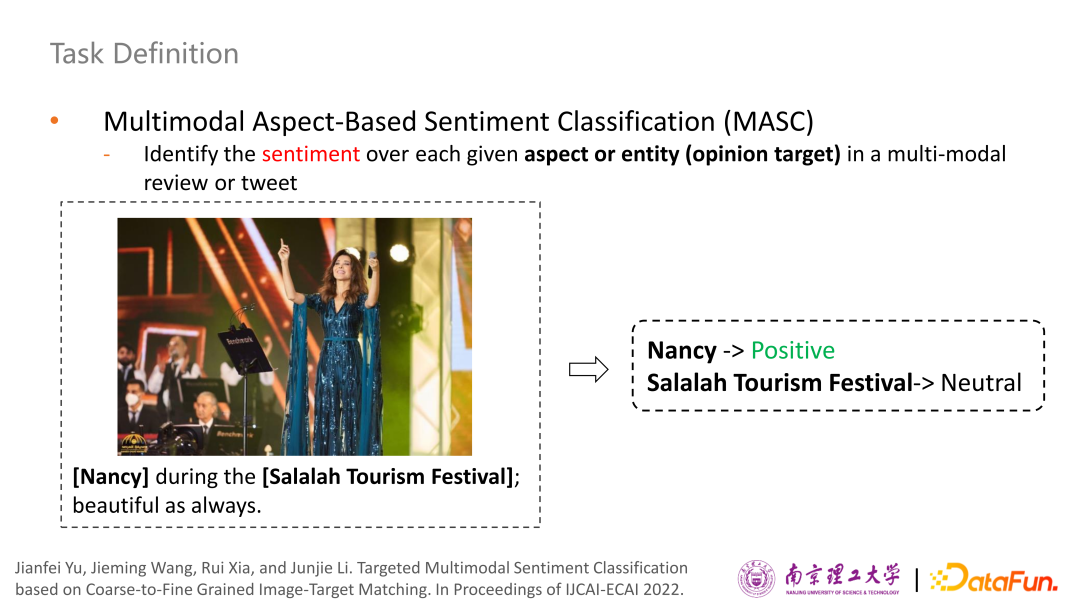

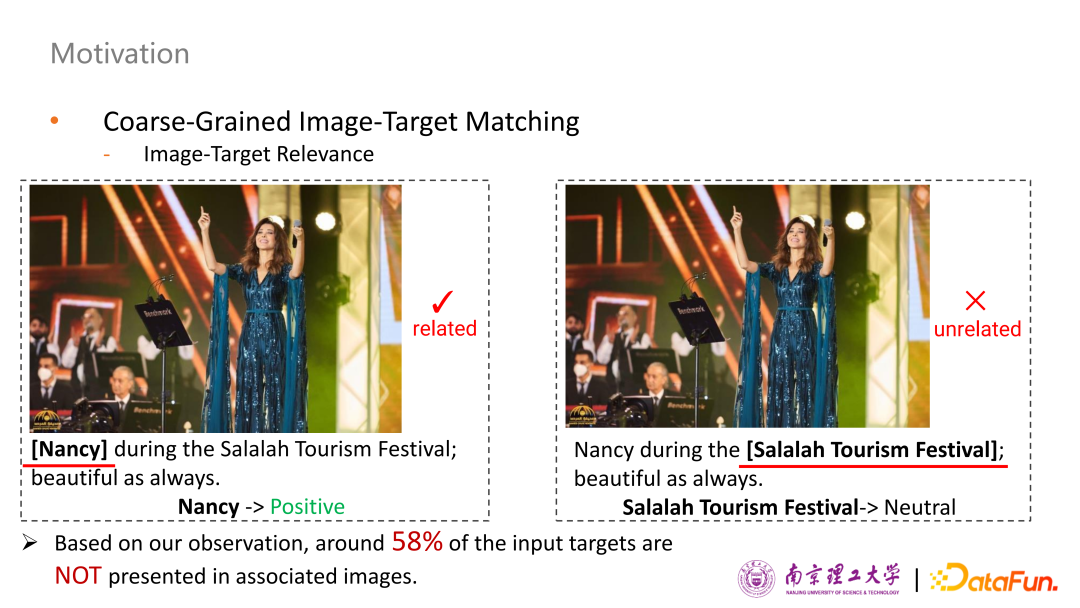

接下來,第二個是今年提出的一個從粗粒度到細粒度的圖像和評價對象匹配的網絡,在這篇文章中的多模態(tài)屬性級情感分析任務具體是在給定評價對象的前提下,識別出用戶對這個評價對象表達了什么樣的情感,正面、負面還是中立?例如,在這個多模態(tài)推文中,提前給定了兩個評價對象 Nancy 和 Salalah Tourism Festival,根據圖文信息可以判斷出用戶對于 Nancy是正面的情感,而對于Salalah Tourism Festival表達了中立的情感。

具體論文參考: Jianfei Yu, Jieming Wang, Rui Xia, and Junjie Li. Targeted Multimodal Sentiment Classification based on Coarse-to-Fine Grained Image-Target Matching. In Proceedings of IJCAI-ECAI 2022.

為什么要做這個工作?對于這個多模態(tài)屬性級情感分類而言,目前大部分的研究工作都沒有對評價對象和圖像的匹配關系進行顯示的建模。根據對benchmark數據集的觀察,發(fā)現(xiàn)其實大部分評價對象和圖片之間是完全不相關的。例如,Nancy 作為輸入的評價對象時,是和圖片是相關的,同時圖中笑臉在判斷用戶正向情感提供了重要的支撐。但對于Salalah Tourism Festival來說,圖片中沒有任何體現(xiàn),因此這個評價對象和圖片其實是不相關的。基于此發(fā)現(xiàn),就對benchmark數據集進行了人工標注,從而發(fā)現(xiàn)約 58% 的評價對象和相應圖片都是不相關的。

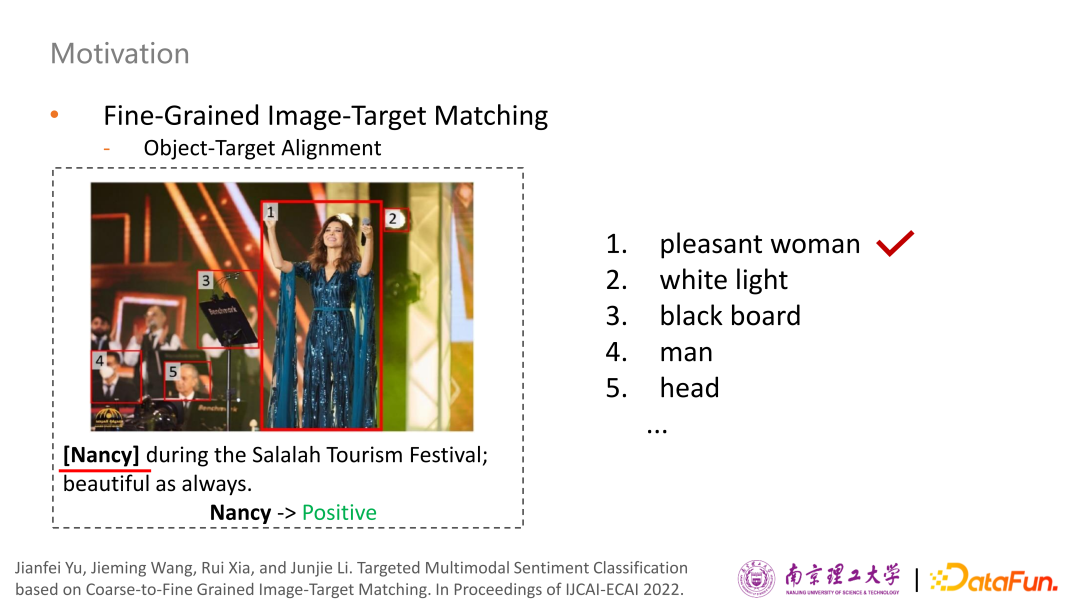

由于每張圖片包含很多的對象,可以標注出不同區(qū)域框,例如之前圖片當中,可以標注出 5 個比較明顯的對象,用數字去標識。只有第一個框和評價對象 Nancy 是相關的,而其他的框都是完全無關的,第一個框中的笑臉信息可以幫助快速判斷正向情感。因此對于那些和圖片相關的評價對象,需要進一步判斷圖中哪個對象或區(qū)域和評價對象是相關的,否則會引入一些無關對象,給情感識別帶來一定的噪音。

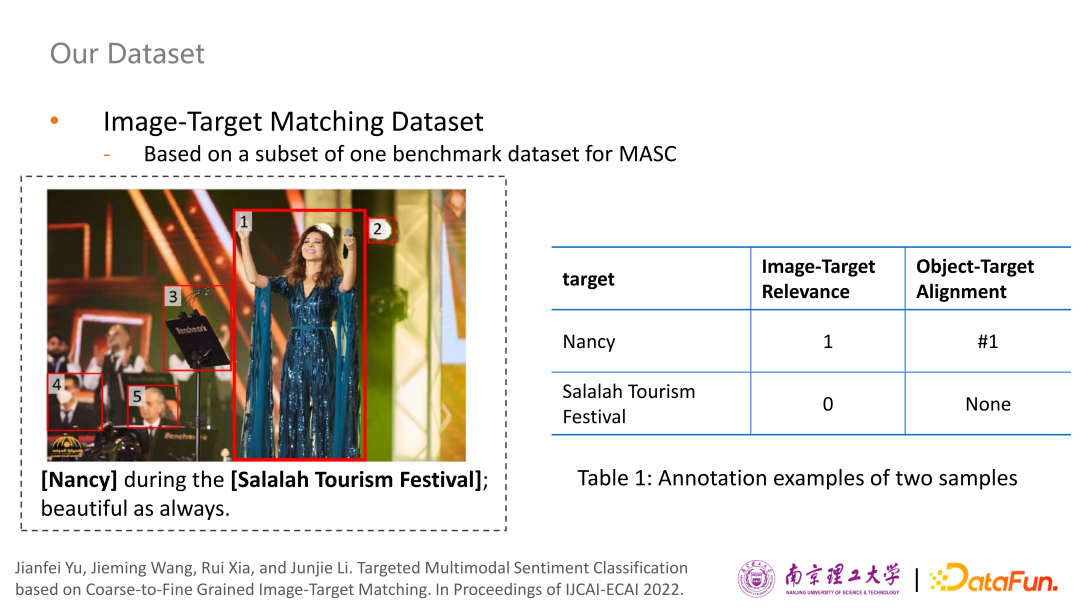

基于兩個問題,對benchmark數據集進行了人工標注,它是一個小規(guī)模的Twitter數據集。具體流程是標注給定評價對象是否和對應圖像相關,并進一步標注評價對象與圖像中的哪一個區(qū)域相關,也把框標注出來。

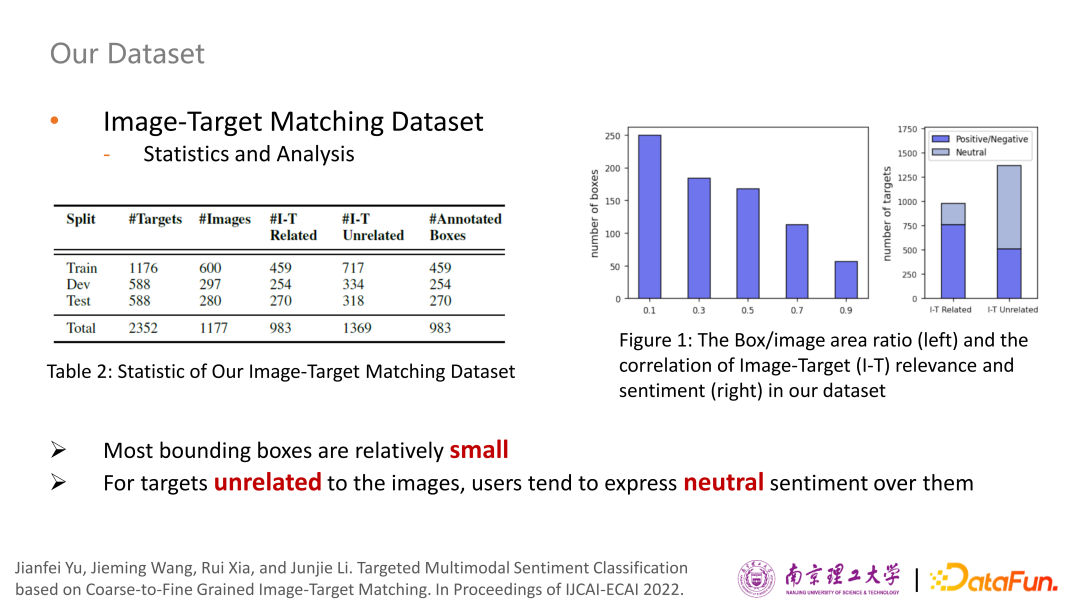

根據統(tǒng)計,大概標注了1200個,從中發(fā)現(xiàn)用戶對大部分和圖片相關的評價對象表達的情感不是正向就是負向,很少表達中立的情感,而對那些和圖像不相關的評價對象,都傾向于表達中立的情感。這也符合我們的直觀感覺,圖像一般都反映用戶比較感興趣的對象,而用戶不感興趣的對象一般都不會放到圖像上。

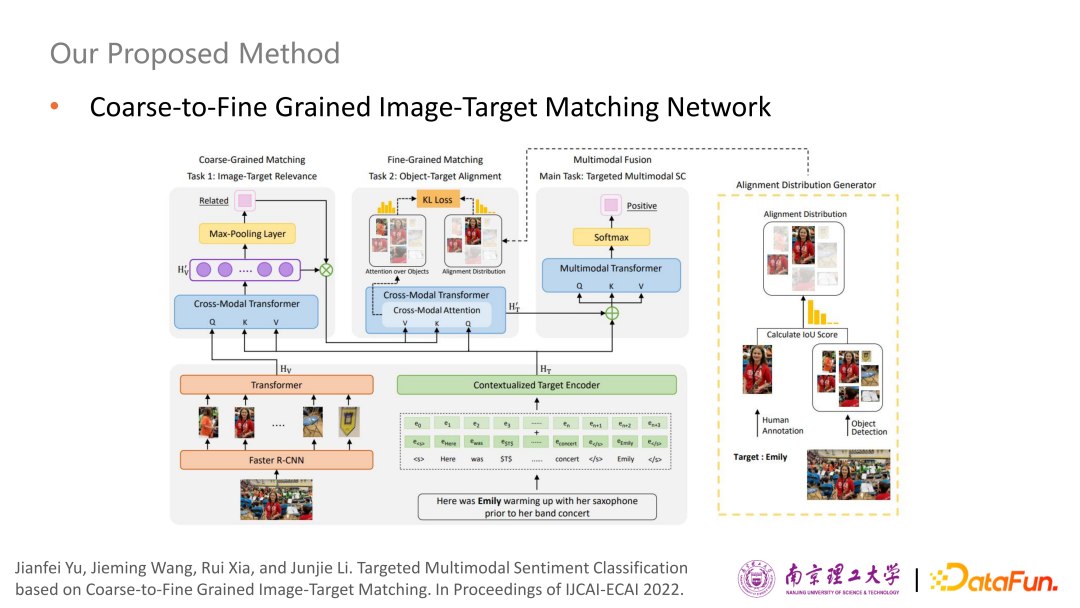

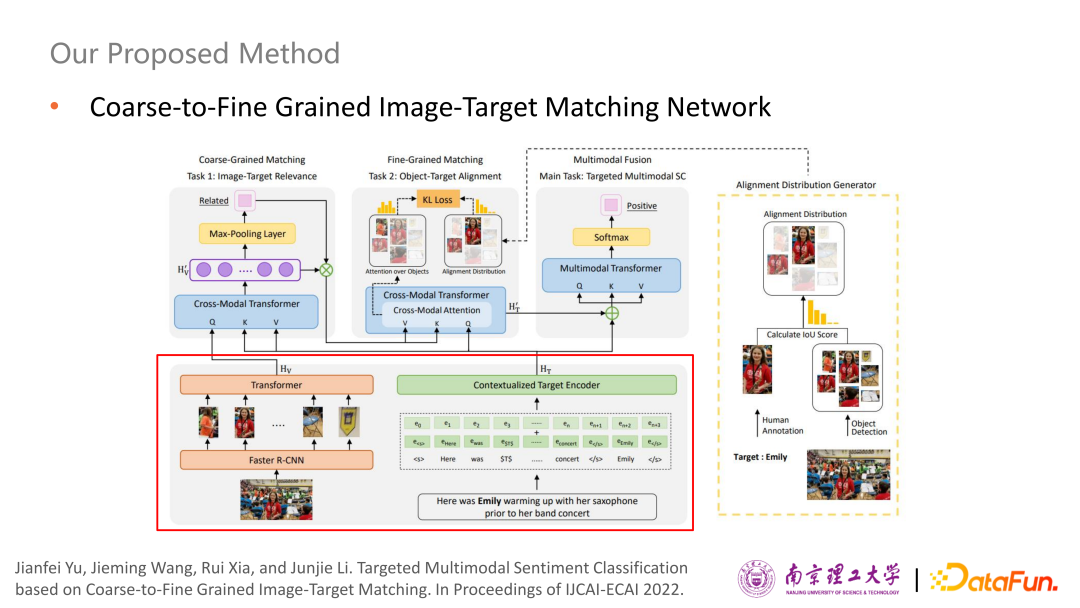

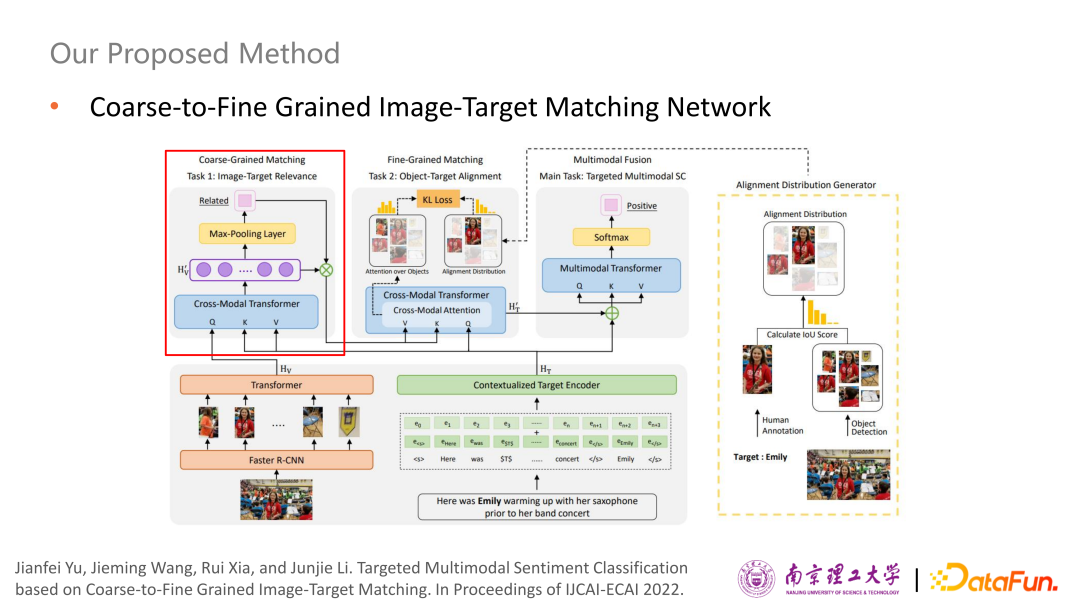

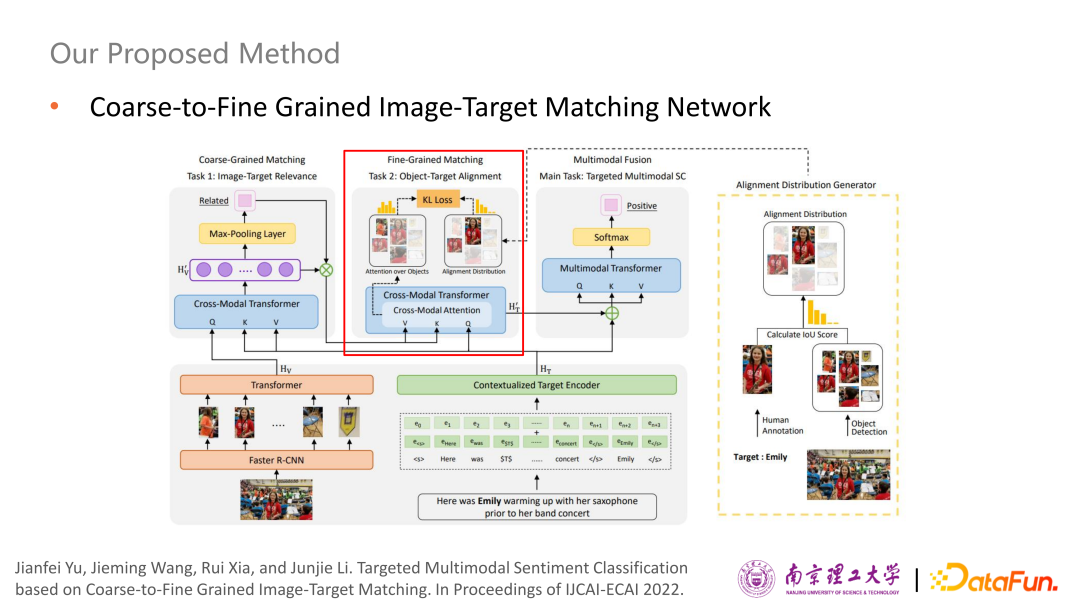

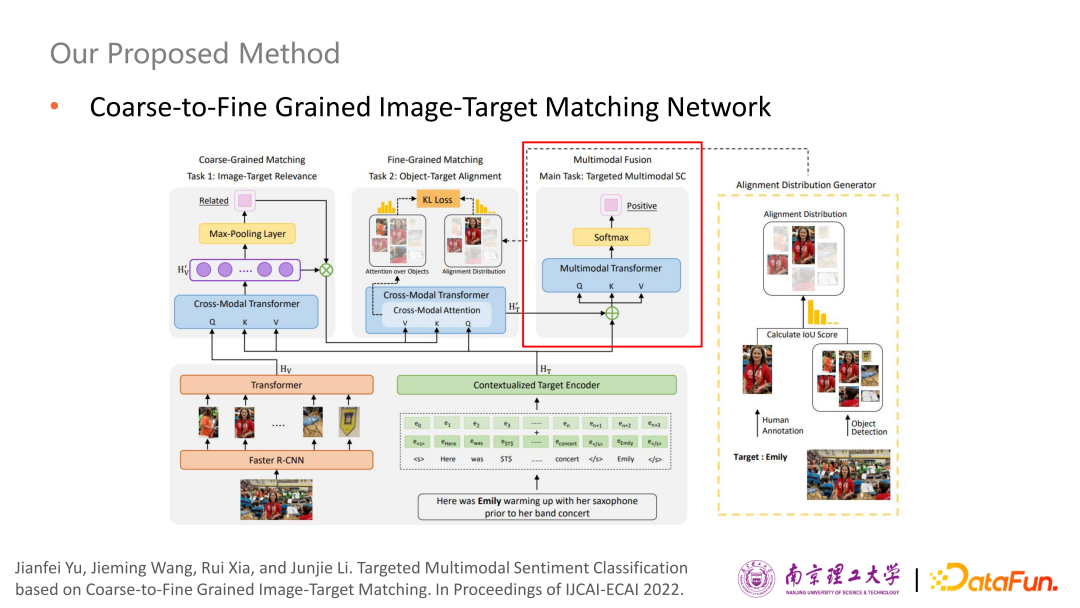

基于這個數據集,設計了一個從粗粒度到細粒度的圖像和評價對象的匹配網絡。這是整個網絡的架構圖。

首先,分別使用文本編碼器和圖像編碼器來對輸入文本和圖像進行編碼。值得注意的是,給定了評價對象如Emily,需對文本輸入進行一個特殊處理,把Emily作為第二個句子放最后,然后把原句中的Emily用一個特殊指令$T$來代替,就得到一個帶有上下文和評價對象的文本輸入。左邊是圖像輸入,由于要判斷圖像中哪塊區(qū)域與評價對象是相關的,使用了一個廣泛使用的目標檢測模型Faster R-CNN。

經過編碼后,得到圖像和文本的表示Hv與HT,送到左上角的 Cross-Model Transformer 進行交互,使用簡單的二分類來判斷粗粒度的圖像和評價對象是否相關,再把概率乘回融合之后的圖像表示上,如果不相關的話概率比較小,基本上會把圖像信息過濾掉。

上一步得到的結果進一步送到中間模塊進行細粒度的匹配,也就是評價對象和相關object 進行對齊模塊。評價對象的表示和過濾后的圖像表示送到另外一個Cross-Model Transformer進行多模態(tài)信息的交互,這時候利用人工標注的圖片里對應的區(qū)域與Faster R-CNN提取出來的區(qū)域進行交并比計算,得到IOU Score,如果IOU Score 大于0.5,認為是一個有效的檢測,否則屬于無效的匹配,從而得到一個Ground Truth分布,作為監(jiān)督信號。最后使用Cross-Model Transformer中的Cross-Model Attention的分布來逼近Ground Truth 分布,這樣會使得與評價對象相關的區(qū)域Attention位置會比較大,而與評價對象不相關的區(qū)域Attention位置就會比較小。

最后可以得到經過多模態(tài)融合之后的表示,把它和原始的純文本表示拼起來送到一個 Multimodal Transformer進行情感分類。

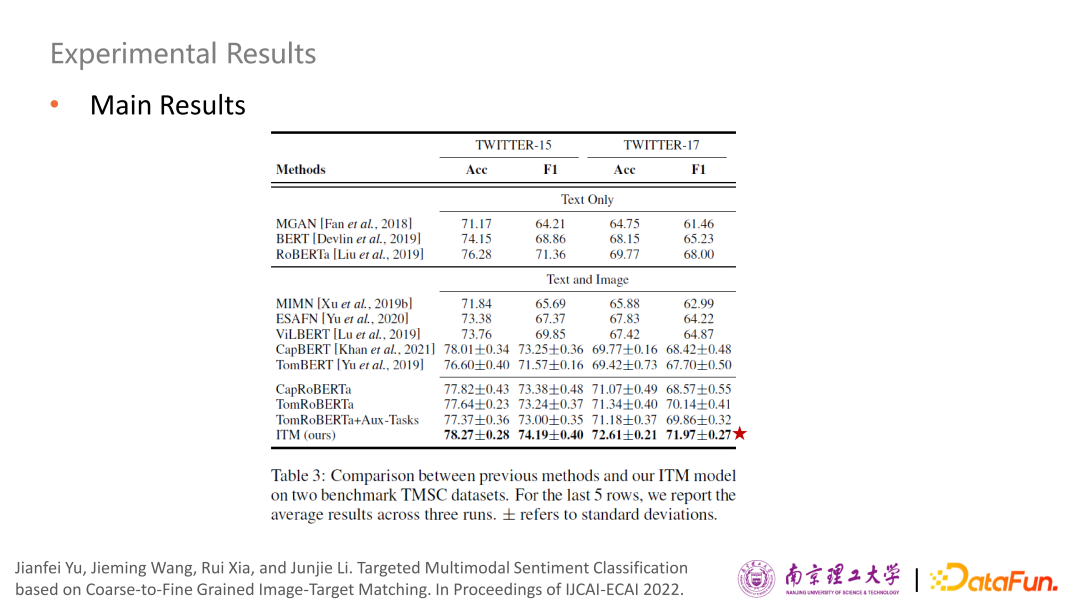

在Twitter 15 和 Twitter 17 的這兩個標準數據集上進行了實驗,可以發(fā)現(xiàn)此方法有非常顯著地提升。還對TomBERT和CapBERT做了一些變形,并把輔助任務加到里面,做了一些探索實驗,可以看到此方法相比于這些變形系統(tǒng)也有一個明顯的提升。

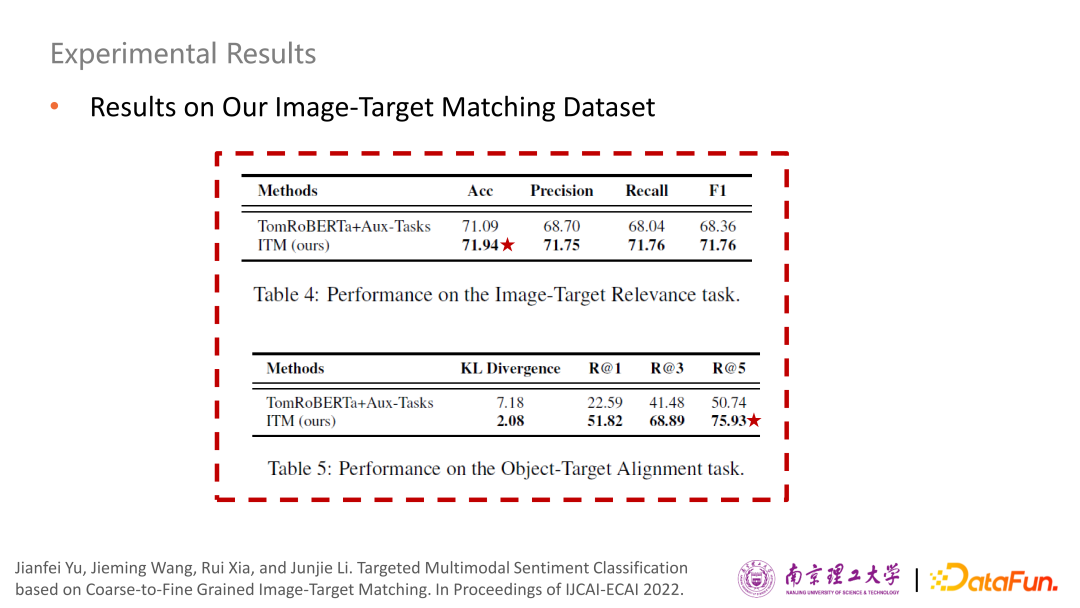

下面是使用兩個輔助任務的性能,一個是圖文粗粒度匹配,另一個是細粒度的圖像區(qū)域和評價對象的對齊。這兩個任務我們提出的模型相比于基礎方法都有較明顯的性能提升。

小結:

人工標注了一個圖像和評價對象匹配的數據集。

提出了一個新的圖像和評價對象匹配模型,主要是一個從粗粒度到細粒度進行匹配的網絡結構。

實驗結果也表明這個模型取得了較先進的效果。

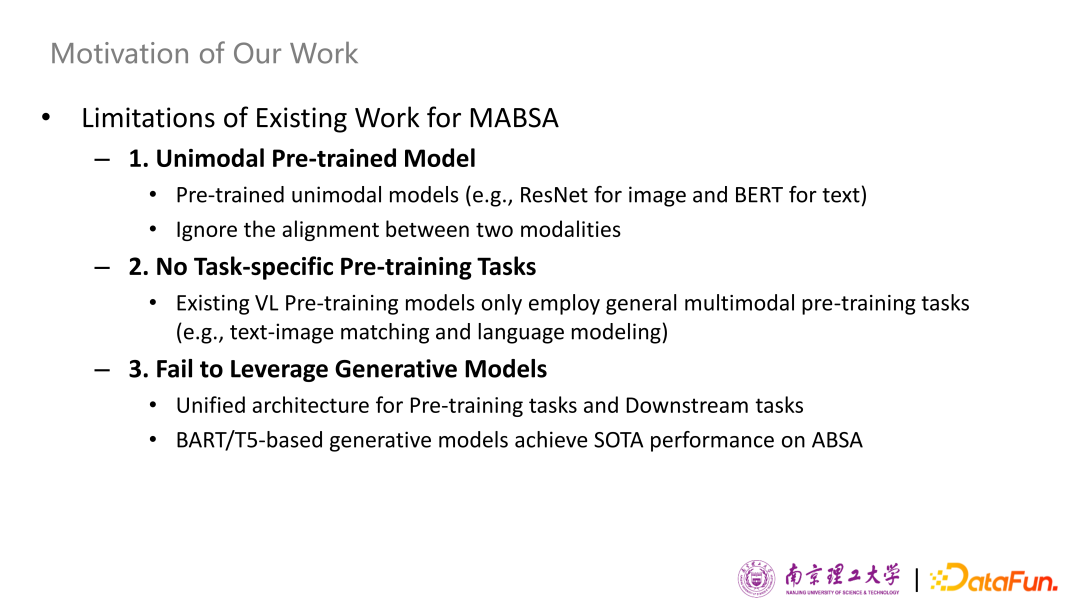

近些年,多模態(tài)情感分析任務(MABSA任務又叫做Target-Oriented Multimodal Sentiment Analysis 或 Entity-Based Multimodal Sentiment Analysis)發(fā)展迅猛。之前大多數MABSA研究存在以下不足:

采用單模態(tài)預訓練模型來獲得文本的表示和圖像的表示,忽略兩個模態(tài)之間的對齊和交互。

使用通用的預訓練任務,和下游任務無相關性,不足以識別細粒度的屬性、情感及其跨模態(tài)的對齊。

未能充分利用生成型模型。

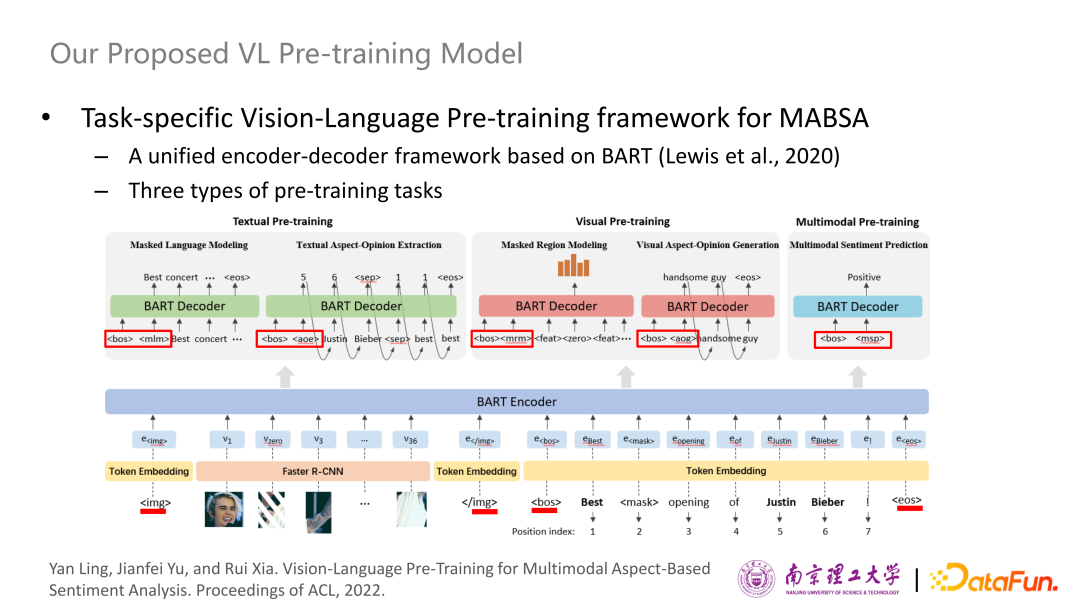

為了解決這些不足,針對MABSA任務,我們在今年的 ACL 上提出了一個特定任務的視覺-文本(vision-language)預訓練框架,這是一個通用的基于預訓練的 BERT 模型的編碼、解碼框架,適用于所有的預訓練和下游任務。此外,針對文本、視覺和多模態(tài),分別設計了5個預訓練任務:

MLM:類似BERT的做法,以15%的概率隨機遮蔽輸入文本的tokens,目標是基于圖像和文本上下文預測出遮蔽的文本內容。

AOE:目標是根據文本生成出其中包含的所有aspect和opinion。模型需要輸出一個序列,包含分隔符和終止符的token,以及每條aspect和每條opinion在原文本token序列中的位置編號。aspect的ground-truth采用的是NER工具對原文本提取出的所有實體,opinion的ground-truth采用的是SentiWordNet情感詞典[4]對原文本提取出的所有情感詞。

MRM:類似UNITER中的MRM-kl的做法,以15%的概率隨機遮蔽image regions并替換為零向量,預測每個遮蔽掉的region的語義類別分布,將模型預測的分布與Faster R-CNN對該region預測的類別分布兩者的KL散度作為該任務的損失值。

AOG:目標是從輸入圖像中生成所有的aspect-opinion pair。將DeepSentiBank對輸入圖像提取出的置信度最高的ANP(形容詞-名詞對)作為ground-truth。模型需要預測出一個序列,包含一個這樣的ANP以及終止符token。

MSP:將MVSA-Multi提供的粗粒度情感標簽作為監(jiān)督信號。根據兩個模態(tài)的信息,預測出圖文對的情感類別。

對于下游任務來講,建模和預訓練的框架是一樣的,使用了一個BART-based的生成框架,為了區(qū)分不同的輸入,我們使用表示圖片特征的開始,使用表示圖片特征的結束,使用

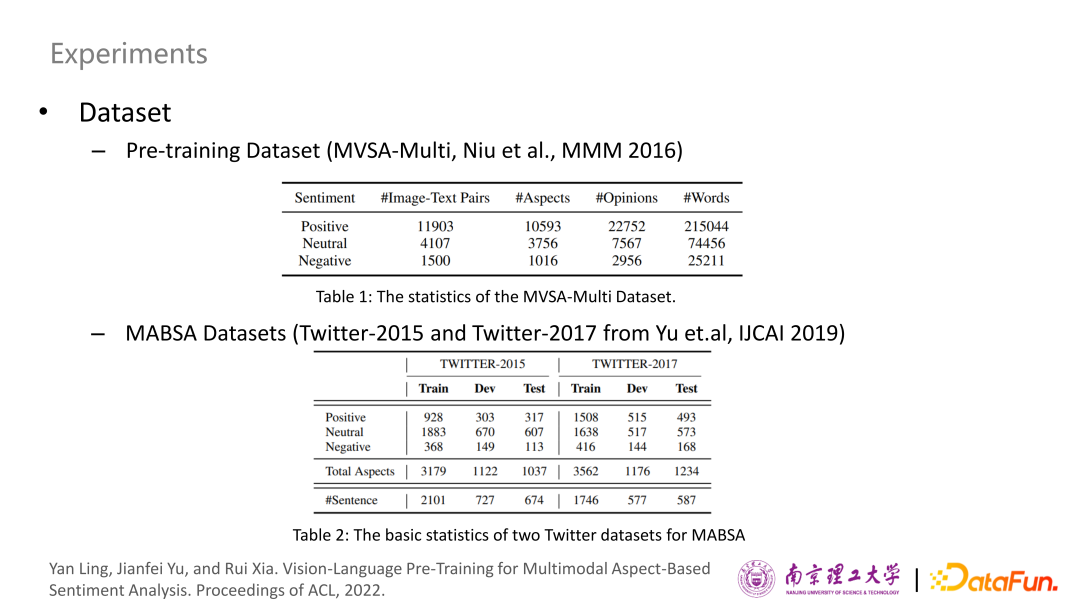

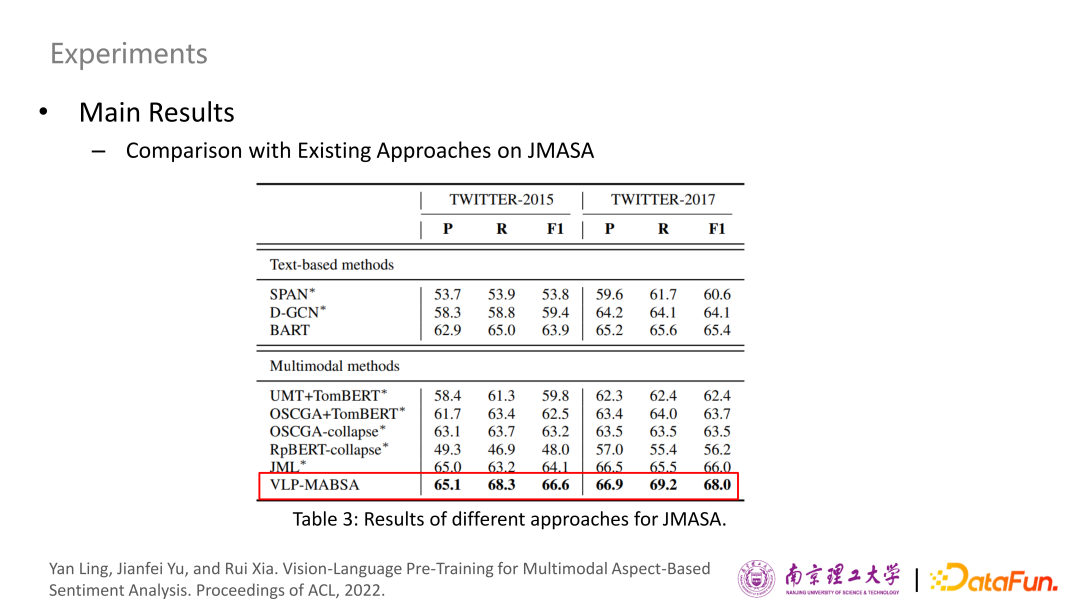

利用帶有粗粒度情感標注的MVSA-Multi數據集進行預訓練,這個數據集提供了文本-圖片成對輸入,以及關于其的粗粒度情感。在TWITTER-2015和TWITTER-2017兩個細粒度視覺語言情感數據集上進行了實驗,在各下游任務上基本都能勝過其它SOTA方法的表現(xiàn)。

進一步的實驗和分析表明在所有的方法中,VLP-MABSA在兩個數據集中,性能都最優(yōu)。

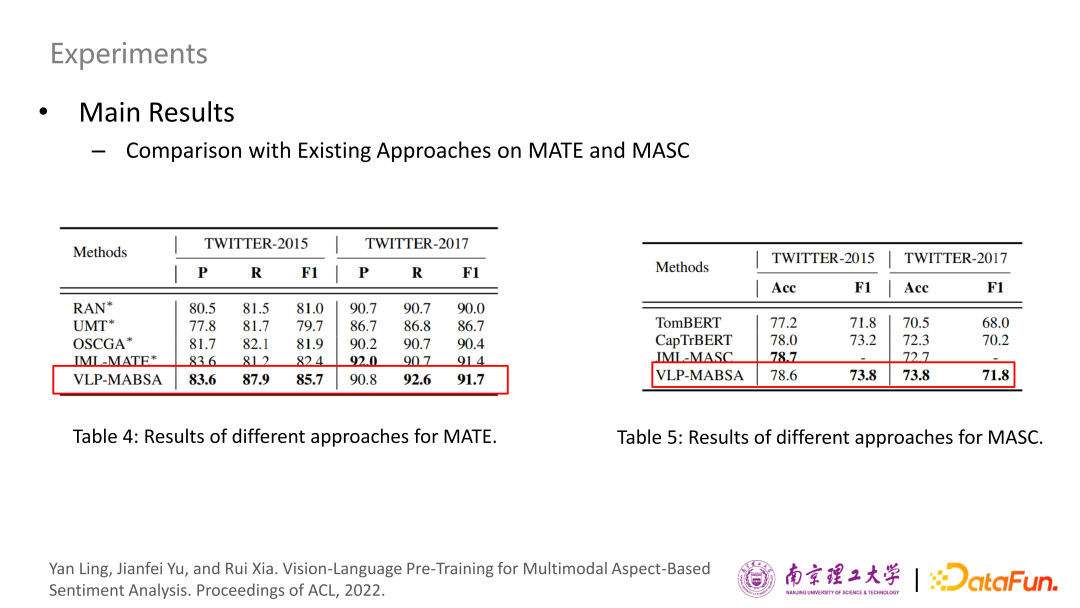

以下分別是MATE和MAS任務的結果,與JMASA子任務的趨勢相似,我們可以清楚地觀察到,VLP-MABSA方法通常在兩個數據集上取得最好的性能,除了twitter-2015的準確性度量,進一步證明了我們提出的預訓練方法的一般有效性。

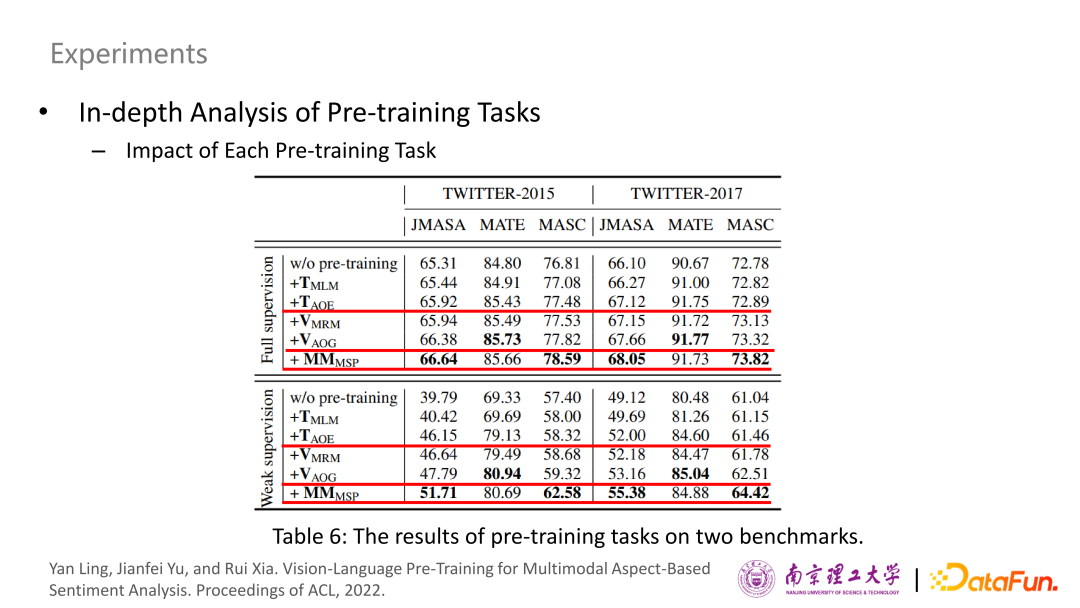

為了探究每個預訓練任務的影響,使用完整訓練數據集和弱監(jiān)督設置下僅隨機選擇200個訓練樣本的全監(jiān)督設置上進行了訓練。可以看到兩個比較通用的預訓練任務 MLM 和 MRM,它們的提升都非常有限,說明這種比較通用的預訓練任務對于下游任務的幫助并不大。但是反觀與下游息息相關的預訓練任務,都對提升模型的表現(xiàn)有所幫助,提升的效果很顯著。

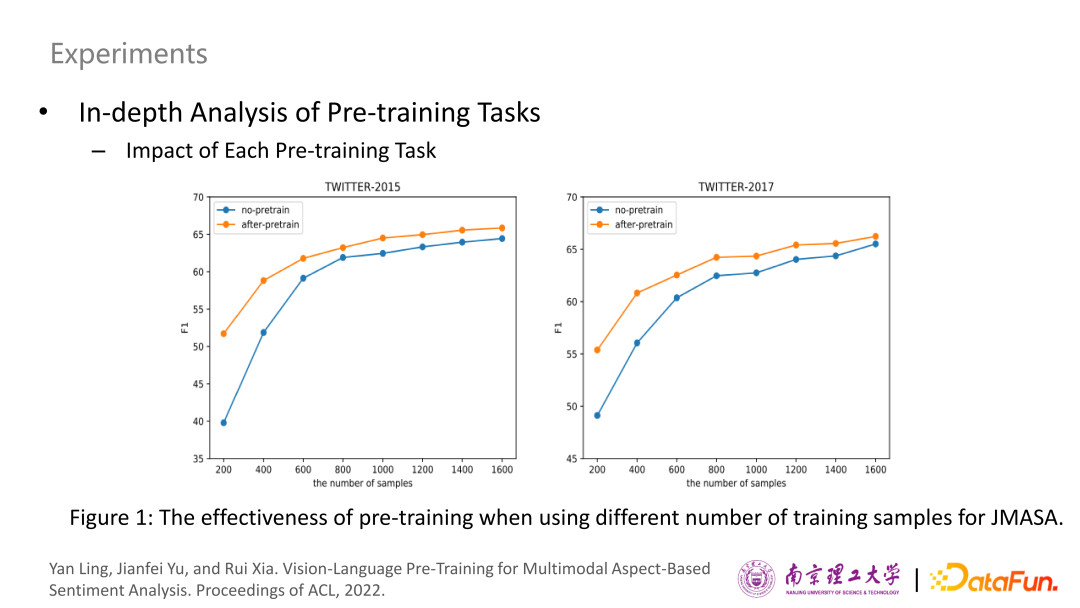

在采用不同數量的樣本進行下游訓練時,比較了有和沒有預訓練的結果,使用JMASA任務作為例子來觀察其影響。如圖所示,當樣本量較小時,預訓練可以帶來巨大的改進。相比之下,當樣本量增大時,預訓練帶來的改進相對較小。這進一步說明了預訓練方法的魯棒性和有效性,特別是在小樣本的場景中。

小結:

提出了一個特定任務的視覺-文本(vision-language)預訓練框架,生成一個基于BART的生成式框架多模態(tài)模型。

針對文本、視覺、和多模態(tài),分別設計了三種特定任務的預訓練任務。

實驗證明了預訓練方法在三個不同的子任務上都取得到非常好的性能。

04 總結

04 總結

以上主要介紹了針對多模態(tài)屬性級情感分析三個不同的子任務,并介紹了這幾年在每個子任務上的一個代表性工作。第一個聚焦于多模態(tài)交互和視覺偏差,第二個聚焦于圖像和文本之間的細粒度和粗粒度的對齊,第三個聚焦于任務特定的視覺語言的預訓練。

展望未來工作,第一個點是多模態(tài)屬性級情感分析模型的可解釋性,一個方面可以通過可視化的方式來分析模型學到的知識正確性,另一方面是進行對抗攻擊,把測試集中圖像和文本進行隨機替換和變化,看模型預測的變化。第二個點是相關多模態(tài)任務的擴展,比如說多模態(tài)的信息抽取、多模態(tài)的實體鏈接、多模態(tài)的實體消歧、多模態(tài)的關系或者事件抽取以及多模態(tài)的知識圖譜的構建和補全。

審核編輯:劉清

-

ACL

+關注

關注

0文章

61瀏覽量

11964 -

多模態(tài)組網

+關注

關注

0文章

3瀏覽量

2373 -

Mate

+關注

關注

2文章

53瀏覽量

4699

原文標題:面向社交媒體的多模態(tài)屬性級情感分析研究

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

基于LSTM神經網絡的情感分析方法

soc在人工智能中的創(chuàng)新應用

高通與智譜推動多模態(tài)生成式AI體驗的終端側部署

利用OpenVINO部署Qwen2多模態(tài)模型

云知聲推出山海多模態(tài)大模型

鴻蒙ArkTS聲明式開發(fā):跨平臺支持列表【半模態(tài)轉場】模態(tài)轉場設置

商湯科技與海通證券攜手發(fā)布金融行業(yè)首個多模態(tài)全棧式大模型

商湯科技聯(lián)合海通證券發(fā)布業(yè)內首個面向金融行業(yè)的多模態(tài)全棧式大模型

李未可科技正式推出WAKE-AI多模態(tài)AI大模型

云手機海外社交媒體監(jiān)測:洞悉輿論,把握商機

什么是多模態(tài)?多模態(tài)的難題是什么?

從Google多模態(tài)大模型看后續(xù)大模型應該具備哪些能力

語音識別技術最新進展:視聽融合的多模態(tài)交互成為主要演進方向

人工智能領域多模態(tài)的概念和應用場景

大模型+多模態(tài)的3種實現(xiàn)方法

面向社交媒體的多模態(tài)屬性級情感分析

面向社交媒體的多模態(tài)屬性級情感分析

評論