您需要1080p視頻圖像嗎?到達那里需要許多部件,包括昂貴的新鏡頭,相機,存儲等。但是,如果您在路徑中有H.264或H.265等壓縮,則不會獲得您支付的費用。原因如下。

高清錄像機通常使用壓縮來減小視頻剪輯文件大小,以適應小型存儲。如果您的相機(源)和錄像機、存儲或顯示器(目標)相距超過 500 英尺,則可能會使用壓縮來傳輸視頻。實際上,壓縮會損害源圖像的許多方面。分辨率是另一種降級效果。

MPEG H.264 和 H.265 壓縮編碼器分析視頻序列中的每個圖像,以創建參考幀和差分幀,以滿足系統所連接的傳輸或存儲容量的比特率限制。所有框架基本上都分為不同大小的塊的馬賽克。塊大小取決于每個鑲嵌區域中影像的細節內容。參考系被劃分為宏塊。每個宏塊由一系列圖像樣本組成 - 亮度(亮度)和色度(顏色) - 由相機使用正在使用的采樣系統(例如4:2:2)提供。塊大小為 8×8、16×16 和 32×32。H.265 編碼器還可以合并大型低細節區域中相鄰的宏塊。該工具有助于H.265的50%壓縮效率。編碼器用于確定塊大小以及塊是否可以合并的標準是特定編碼器的功能,不受任何標準的控制。這就是為什么人們可以看到符合H.264和H.265規范的編碼器之間的圖像質量差異的部分原因。

然而,圖像被劃分為宏塊,每個塊都通過離散余弦變換(DCT)。DCT基本上將宏觀塊的空間輪廓轉換為二維(2D)頻率陣列。左上角代表“DC” - 即具有一定亮度的無輪廓區域。右下角表示數組中可以表示的最高頻率等值線。DCT 提供了一個系數,在應用此數組的每個元素來重建宏塊的原始輪廓時,可以使用該系數。零值不使用 元素。系數可以是任何值,正負值,并且是DCT的輸出。

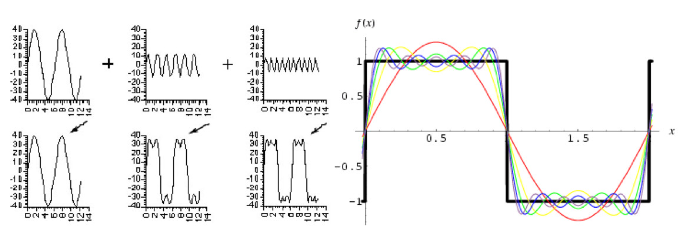

在單維空間中,這種方法在概念上類似于如何將時域信號(波形)轉換為頻域。使用從方波的傅里葉變換(振幅和相位)得出的系數,可以將原型正弦波陣列相加以重建時域波形(圖)。由于離散變換不是連續頻譜,因此無論陣列的大小如何,重建中都內置了量化誤差(所示的元素提供了256個元素,可用于重建8×8像素陣列的亮度輪廓)。

[圖3|使用從方波的傅里葉變換導出的系數,可以將原型正弦波陣列相加以重建時域波形式。

顏色樣品(鉻和Cb)的處理方式相同。大多數攝像機可提供 4:2:2 采樣圖像。這樣做的困難是圖像樣本是矩形的(兩個亮度樣本共享一個色度樣本)而不是正方形。為了簡化處理,大多數編碼器會將傳入的 4:2:2 采樣轉換為 4:2:0 采樣,其中 4 個亮度樣本共享一個色度樣本。這樣做時,會出現一些細節損失和顏色偏移。這在直接比較信號時可以觀察到。從 4:2:2 轉換為 4:2:0 采樣可有效地將像素位深度從 20 位減少到 15 位。數字圖像分辨率為三維、行數、每行像素數和位深度。雖然每行的像素數和行數保持不變,但位深度減少了,這已被證明可以通過限制動態范圍來減少精細的圖像細節。也就是說,高對比度區域將遭受最大的細節損失。

編碼器(壓縮器)還負責管理輸出比特率,以確保視頻和數據流可以可靠地傳輸到其最終目的地。一個工具是管理宏塊大小。影像的區域(如天空)將沒有太多的輪廓,因此 DCT 的許多系數將等于或接近于零。可以使這些區域越大,零系數就越多。長時間的零系數可以很好地壓縮而不會丟失數據(熵編碼階段)。零系數越大,可以實現的熵壓縮就越多。

門檻

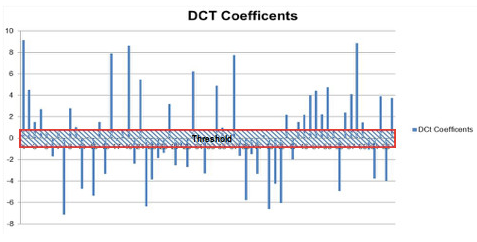

編碼器可用的另一個工具是調整值閾值,其中任何低于某個值的絕對幅度的 DCT 系數都設置為零。這里的策略是,解碼反向DCT數組中具有小系數的元素將在生成的宏塊重建輪廓中引入小誤差。由于可用的傳輸比特率受到限制,編碼器可以增加系數閾值,從而產生更多的零值,從而增加熵相位壓縮比。

圖 4 模擬了 8×8 宏塊陣列(64 個元素)中圖像系數的直方圖。有些系數非常小。編碼器可以根據數組系數的值調整閾值以消除數組的元素。這些元素是重建宏塊輪廓的小貢獻者。當然,隨著此閾值的增加,源宏塊輪廓與重建輪廓之間的誤差也會增加。該效應類似于前面所示的方波的頻率到時域重建。也就是說,如果頻率從總和中下降,則波紋出現在正方形的頂部,并且上升和下降斜率偏離原始輸入。

[圖4|8x8 宏塊數組中圖像系數的直方圖。

輪廓因宏塊而異,因此效果隨輪廓而變化。在具有復雜等值線的宏塊中,采樣的有效帶寬通常會降低(零系數)。從視覺上看,這可以將宏塊中的精細細節轉換為模糊。但是,閾值設置到什么級別取決于傳送視頻和數據流所需的總比特率。因此,編碼器將根據DCT階段后圖像流的聚合比特率來設置閾值。在任何宏塊中,閾值可以消除很少(如果有的話)數組點;在其他情況下,它可能會消除許多。在圖5中的圖像序列中,中間圖像是最左側圖像的重建。在此示例中,請注意背景中的樂譜。在這種情況下,閾值消除了宏塊陣列中足夠多的高頻分量,以支持傳輸比特率,即樂譜上的細節被抹去(比較區域用紅色圈出)。壓縮完成后,此信息將永久丟失。

隨著宏塊大小的增加,重新創建樂譜的輪廓的復雜性也會增加。然而,與打印它的紙張的直流水平和陰影相比,這些元素產生的DCT系數更小。防止這種信息丟失的唯一方法是減小目標距離處宏塊的大小,以降低輪廓的復雜性。這可以通過減小宏塊本身的大小(32×32到16×16或8×8)或增加放大倍率來實現。增加放大倍率可以減小宏塊在圖像中覆蓋的目標區域。

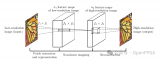

表示 64 個原始視頻像素的 8×8 數組被替換為按閾值濾波的 DCT 系數。MPEG標準定義了如何將這些信息傳達給解碼器。解碼器現在只有要執行的濾波數據,并反轉DCT來重新創建像素陣列輪廓。解碼后的圖像是這些重新創建的輪廓(宏塊)縫合在一起的馬賽克。在這里,可以將算法應用于解碼的馬賽克以隱藏接縫。該算法沒有標準化,通常是解碼器供應商與主觀圖像質量相關的差異化因素。

在圖 5 中,從左到右是原始圖像,從漸變宏塊的馬賽克重新創建的解碼圖像,以及去塊后的相同馬賽克,其中馬賽克元素的邊緣被弄臟。

除了丟失的細節之外,還會對宏塊周圍的區域進行著色以隱藏邊界。此過程進一步修改原始圖像數據。當作為單個圖像捕獲時,修改是永久性的。污跡本身可能因解碼器而異,并導致站點之間的精細細節差異,圖像捕獲與圖像捕獲。

您如何將所有這些與分辨率丟失聯系起來?當反向DCT陣列的高頻元件被移除時,邊緣細節變得模糊。模糊性可以被認為是隨著高頻元件被移除以滿足比特率限制而逐漸散焦鏡頭。

但是,哪些細節受到損害?它重要嗎?答案是規模問題。在 1080×1920 圖像中,我們知道 16×16 宏塊像素在圖像幀上占的百分比,但更重要的是宏塊輪廓的復雜性。復雜性在很大程度上取決于目標范圍內宏塊的圖像區域中的內容。

為了說明比例影響,圖6模擬了目標處的微距區域,鏡頭變焦位置會影響微距區域中的細節。左側表示任意鏡頭設置。右圖表示以較窄的視場 (FOV) 查看同一區域。如您所見,左圖中突出顯示的宏塊(紅色)的復雜性遠遠大于FOV較小的同一宏塊的復雜性。在左圖中,閾值的增加將沖刷掉男人眼睛周圍的細節。在右圖中,同一宏塊的輪廓不太復雜。在DCT完成后,它將產生較少的有效系數,因此在解碼過程中保留了大部分細節。

[圖6|鏡頭變焦位置會影響微距區域的細節。

什么是分辨率損失?答案很復雜:它依賴于圖像,宏塊縮放依賴于比特率。影響哪些細節還取決于宏塊中的內容。話雖如此,人們可以將其與宏塊大小以及可用比特率和存儲容量相關聯,可用比特率越低,宏塊區域必須在目標圖像處表示越小,以保留來自源的原始像素提供的相同或幾乎相同的細節。

需要更多的變焦和更好的光學元件來提供解碼器側具有相似細節的圖像,這會導致在此過程中圖像分辨率損失。分辨率損失是不可恢復的,因為由編碼側的DCT創建的2D元素在編碼過程中永遠丟失,這些元素被歸零以滿足比特率限制。

假設一個1080p相機被用來查看500英尺外的物體。如果將 1000 mm 鏡頭與 25 mm 傳感器一起使用,則 FOV 約為 1.5 度。目標范圍內覆蓋的水平距離約為160英寸(13英尺)。此范圍內的每個像素將覆蓋 0.08 英寸或大約 0.007 英寸2.8×8 宏塊覆蓋約 0.43 英寸2.0.007英寸圖像的復雜程度是多少2與 0.43 英寸相比2圖像區域?顯然,宏塊覆蓋的區域越小,細節損失就越低。相反,為了補償壓縮編碼器的細節損失,比特率越低,所需的放大倍率就越大。在指定視頻傳送路徑中包含壓縮的系統時,要求必須考慮這些效果。如果魔鬼在細節中,那么細節就很重要。全分辨率單幀照片是分析或證據保留的一個組成部分。隨著視頻記錄儀器(VRI)的最新創新,現在可以捕獲未壓縮的HD-SDI視頻,零色移,量化誤差或DCT系數損失。

審核編輯:郭婷

-

顯示器

+關注

關注

21文章

4954瀏覽量

139836 -

編碼器

+關注

關注

45文章

3600瀏覽量

134182

發布評論請先 登錄

相關推薦

HDMI接口支持哪些視頻分辨率

視頻處理器的分辨率是如何管理的

視頻處理器分辨率怎么調

頻譜儀分辨率帶寬和視頻帶寬的關系

EVAL_PASCO2_SENSOR為什么無法從較低的分辨率高速獲得更高的分辨率?

編碼器分辨率是什么意思 編碼器分辨率和脈沖數的關系

分辨率是什么設備的主要性能

什么是DSR(動態超級分辨率)?DSR是做什么的?如何開啟DSR技術?

淺談相機的圖像分辨率

adc電路的分辨率怎么算

峰峰值分辨率與有效分辨率的區別

視頻壓縮:圖像分辨率丟失

視頻壓縮:圖像分辨率丟失

評論