作者:Mehul Gupta

來源:DeepHub IMBA

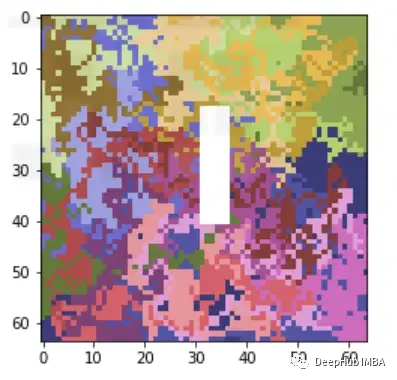

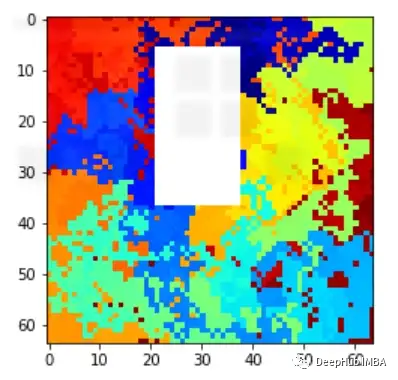

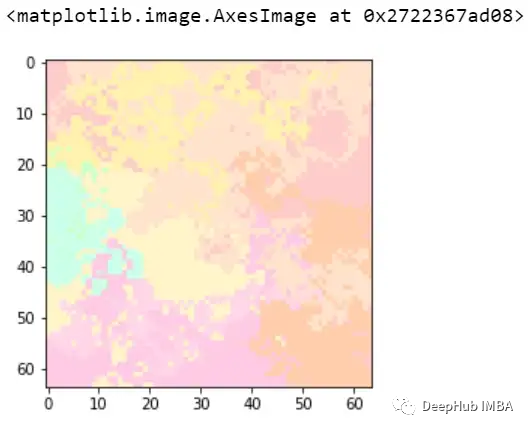

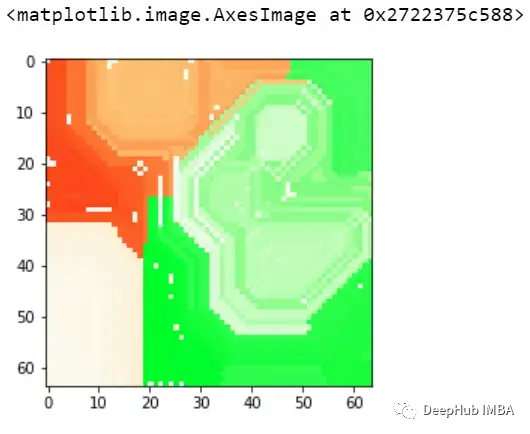

圖像與表格數據集有很大不同(顯然)。如果你還記得,在之前我們討論過的任何解釋方法中,我們都是根據特征重要性,度量或可視化來解釋模型的。比如特征“A”在預測中比特征“B”有更大的影響力。但在圖像中沒有任何可以命名的特定特征,那么怎么進行解釋呢?

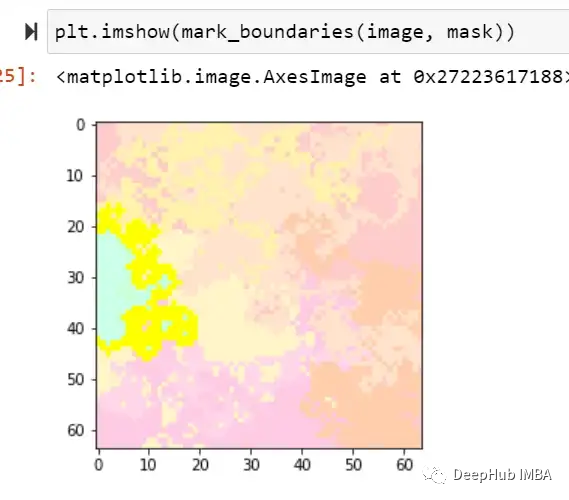

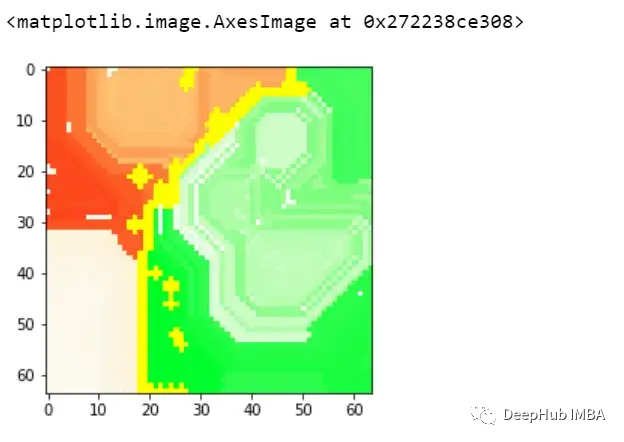

一般情況下我們都是用突出顯示圖像中模型預測的重要區域的方法觀察可解釋性,這就要求了解如何調整LIME方法來合并圖像,我們先簡單了解一下LIME是怎么工作的。

LIME在處理表格數據時為訓練數據集生成摘要統計:

使用匯總統計生成一個新的人造數據集

從原始數據集中隨機提取樣本

根據與隨機樣本的接近程度為生成人造數據集中的樣本分配權重

用這些加權樣本訓練一個白盒模型

解釋白盒模型

%matplotlib inline

import matplotlib.pyplot as plt

from sklearn.model_selection import train_test_split

from keras.layers import Input, Dense, Embedding, Flatten

from keras.layers import SpatialDropout1D

from keras.layers.convolutional import Conv2D, MaxPooling2D

from keras.models import Sequential

from randimage import get_random_image, show_array

import random

import pandas as pd

import numpy as np

import lime

from lime import lime_image

from skimage.segmentation import mark_boundaries

#preparing above dataset artificially

training_dataset = []

training_label = []

for x in range(200):

img_size = (64,64)

img = get_random_image(img_size)

a,b = random.randrange(0,img_size[0]/2),random.randrange(0,img_size[0]/2)

c,d = random.randrange(img_size[0]/2,img_size[0]),random.randrange(img_size[0]/2,img_size[0])

value = random.sample([True,False],1)[0]

if value==False:

img[a:c,b:d,0] = 100

img[a:c,b:d,1] = 100

img[a:c,b:d,2] = 100

training_dataset.append(img)

training_label.append(value)

#training baseline CNN model

training_label = [1-x for x in training_label]

X_train, X_val, Y_train, Y_val = train_test_split(np.array(training_dataset).reshape(-1,64,64,3),np.array(training_label).reshape(-1,1), test_size=0.1, random_state=42)

epochs = 10

batch_size = 32

model = Sequential()

model.add(Conv2D(32, kernel_size=3, padding='same', activation='relu'))

model.add(MaxPooling2D(pool_size=2))

model.add(Flatten())

# Output layer

model.add(Dense(32,activation='relu'))

model.add(Dense(1, activation='sigmoid'))

model.compile(loss='binary_crossentropy', optimizer='adam', metrics=['accuracy'])

model.fit(X_train, Y_train, validation_data=(X_val, Y_val), epochs=epochs, batch_size=batch_size, verbose=1)

x=10

explainer = lime_image.LimeImageExplainer(random_state=42)

explanation = explainer.explain_instance(

X_val[x],

model.predict,top_labels=2)

)

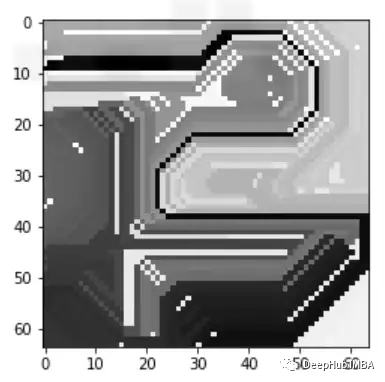

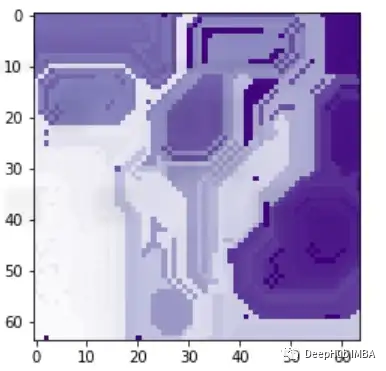

image, mask = explanation.get_image_and_mask(0, positives_only=True,

hide_rest=True)

這樣我們就可以理解模型導致錯誤分類的實際問題是什么,這就是為什么可解釋和可解釋的人工智能如此重要。

END

(添加請備注公司名和職稱)

Imagination 基于 O3DE 引擎的光線追蹤 Demo 詳解

Imagination Technologies是一家總部位于英國的公司,致力于研發芯片和軟件知識產權(IP),基于Imagination IP的產品已在全球數十億人的電話、汽車、家庭和工作場所中使用。獲取更多物聯網、智能穿戴、通信、汽車電子、圖形圖像開發等前沿技術信息,歡迎關注 Imagination Tech!

原文標題:使用LIME解釋CNN

文章出處:【微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

-

imagination

+關注

關注

1文章

570瀏覽量

61281

原文標題:使用LIME解釋CNN

文章出處:【微信號:Imgtec,微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

使用LIME解釋CNN

使用LIME解釋CNN

評論