前言

在CV領域,我們需要熟練掌握最基本的知識就是各種卷積神經網絡CNN的模型架構,不管我們在圖像分類或者分割,目標檢測,NLP等,我們都會用到基本的CNN網絡架構。

CNN從最初的2012年AlexNet橫空出世到2014年VGG席卷世界以及2015年ResNet奠定了該領域的霸主地位,網絡模型變得越變越深,而且也得到證明,越深的網絡擬合效果越好,但網絡相應的參數量計算量都極速增加,不利于技術的推廣和應用。

因此,一些輕量級的網絡結構也慢慢隨之出現,比如MobileNet系列,ShuffleNet系列,以及ResNext、DenseNet、EfficenceNet等模型,他們都互相吸取彼此的優點,不但降低了參數量或者計算量,同時分類精度更高,因而受到了更多的關注。接下來我們就對CNN的各種網絡結構以及他們的優缺點進行一次詳細的解讀!

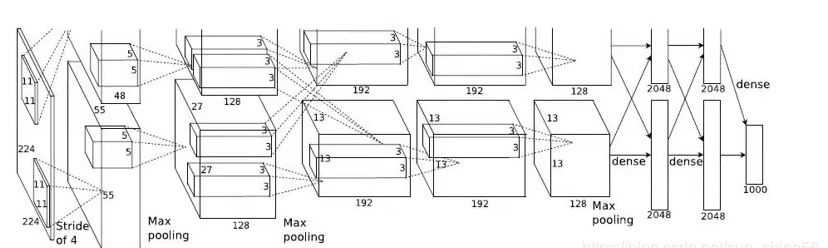

AlexNet(2012)

1、增加了relu非線性激活函數,增強了模型的非線性表達能力。成為以后卷積層的標配。

2、dropout層防止過擬合,成為以后fc層的標配。

3、通過數據增強,來減少過擬合。

4、引入標準化層(Local Response Normalization):通過放大那些對分類貢獻較大的神經元,抑制那些對分類貢獻較小的神經元,通過局部歸一的手段,來達到作用。

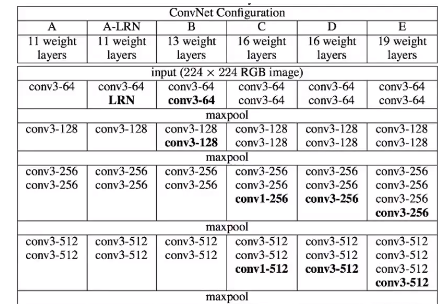

VGG(2014)

論文的主要創新點在于:

1、用3x3小卷積核代替了5x5或者7x7的卷積核 2、基于ALexnet加深了網絡深度,證明了更深的網絡,能更好的提取特征。

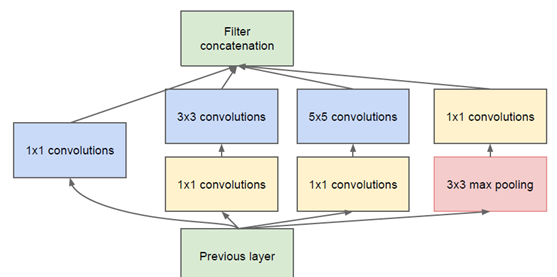

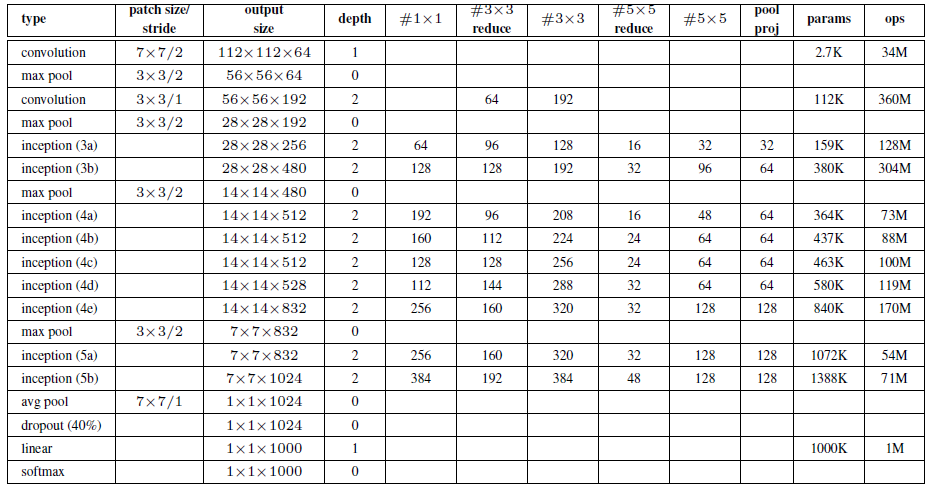

GoogleNet(2014)

在設計網絡結構時,不僅僅考慮網絡的深度,也會考慮網絡的寬度,并將這種結構定義為Inception結構。

1、引入1x1卷積的主要目的是為了減少維度,還用于修正線性激活(ReLU)

2、網絡最后采用了average pooling(平均池化)來代替全連接層

后面的Inception v2/v3都是基于v1的這種方法在擴展,主要目標有:

1、參數量降低,計算量減少。

2、網絡變深,網絡非線性表達能力更強

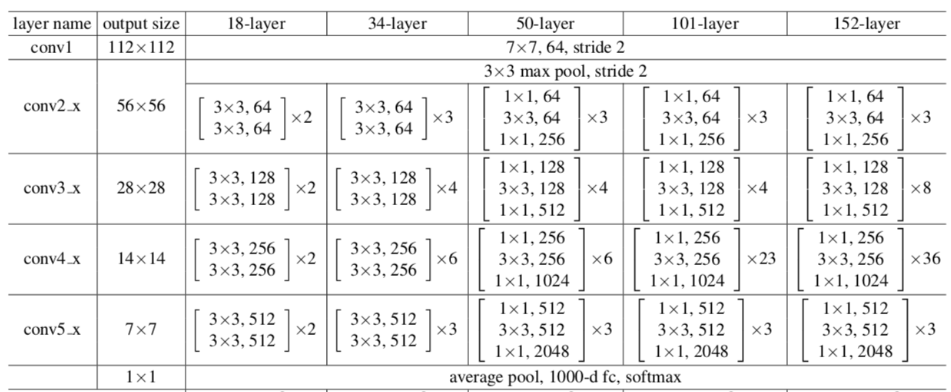

ResNet(2015)

問題:

1、增加深度帶來的首個問題就是梯度爆炸/消散的問題,這是由于隨著層數的增多,在網絡中反向傳播的梯度會隨著連乘變得不穩定,變得特別大或者特別小。這其中經常出現的是梯度消散的問題。

2、為了克服梯度消散也想出了許多的解決辦法,如使用BatchNorm,將激活函數換為ReLu,使用Xaiver初始化等,可以說梯度消散已經得到了很好的解決

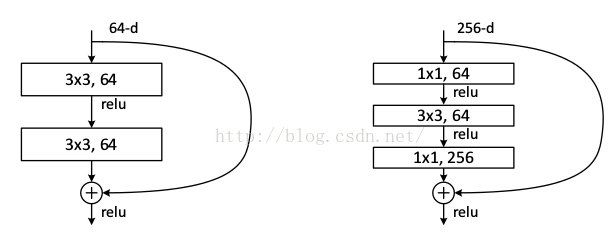

已知有網絡degradation的情況下,不求加深度能提高準確性,能不能至少讓深度網絡實現和淺層網絡一樣的性能,即讓深度網絡后面的層至少實現恒等映射的作用,根據這個想法,作者提出了residual模塊來幫助網絡實現恒等映射。

ResNet的設計特點:

1、核心單元模塊化,可進行簡單堆疊。 2、Shortcut方式解決網絡梯度消失問題。 3、Average Pooling層代替fc層。 4、引入BN層加快網絡訓練速度和收斂時的穩定性。 5、加大網絡深度,提高模型的特征抽取能力。

MobileNet v1

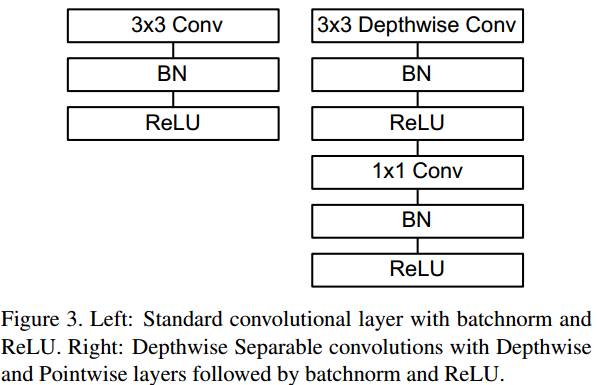

谷歌在2017年提出專注于移動端或者嵌入式設備中的輕量級CNN網絡:MobileNet。最大的創新點是深度可分離卷積。

通過將標準卷積分解為深度卷積核逐點卷積,能夠顯著的降低參數量和計算量。引入Relu6激活函數。

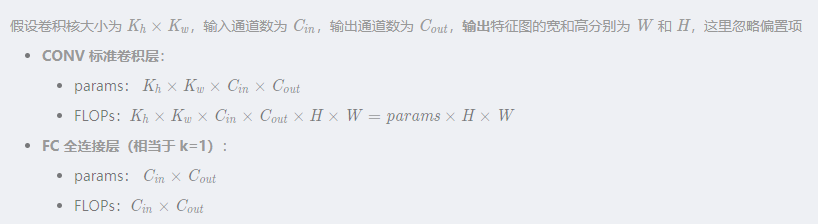

參數量計算量的計算:

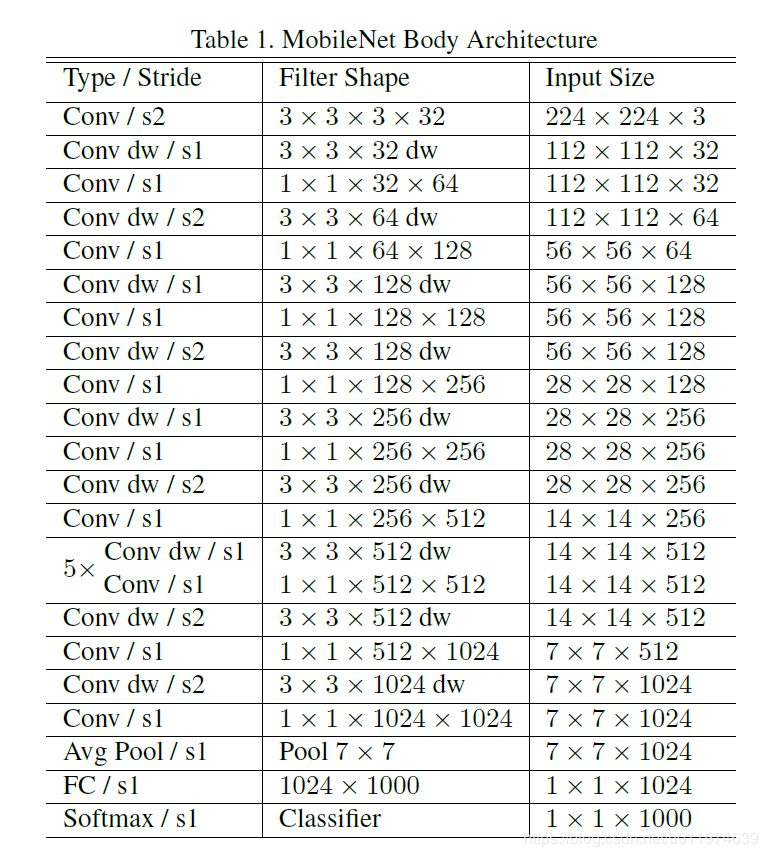

網絡結構如下:

MobileNet v2

改進點主要有以下幾個方面:

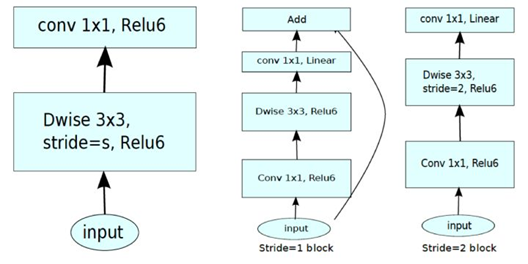

1、引入殘差結構,先升維再降維,增強梯度的傳播,顯著減少推理期間所需的內存占用

Inverted Residuals:

殘差模塊:輸入首先經過1x1的卷積進行壓縮,然后使用3x3的卷積進行特征提取,最后在用1x1的卷積把通道數變換回去。整個過程是“壓縮-卷積-擴張”。這樣做的目的是減少3x3模塊的計算量,提高殘差模塊的計算效率。

倒殘差模塊:輸入首先經過1x1的卷積進行通道擴張,然后使用3x3的depthwise卷積,最后使用1x1的pointwise卷積將通道數壓縮回去。整個過程是“擴張-卷積-壓縮”。

對低維度做ReLU運算,很容易造成信息的丟失。而在高維度進行ReLU運算的話,信息的丟失則會很少。

Linear Bottleneck:

這個模塊是為了解決一開始提出的那個低維-高維-低維的問題,即將最后一層的ReLU6替換成線性激活函數,而其他層的激活函數依然是ReLU6。

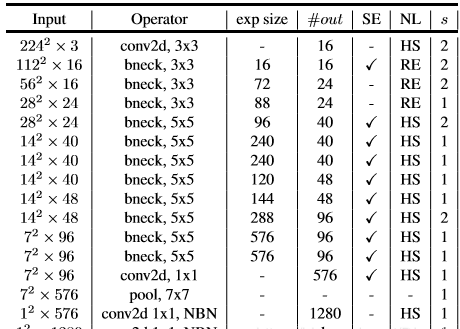

MobileNet v3

V3結合了V1的深度可分離卷積,V2的Inverted Residuals 和 Linear Bottleneck,以及加入SE模塊、利用NAS(神經結構的搜索)來搜索網絡參數。

互補搜索技術 —— NAS & NetAdapt

h-swish激活函數

out = F.relu6(x + 3., self.inplace) / 6. return out * x

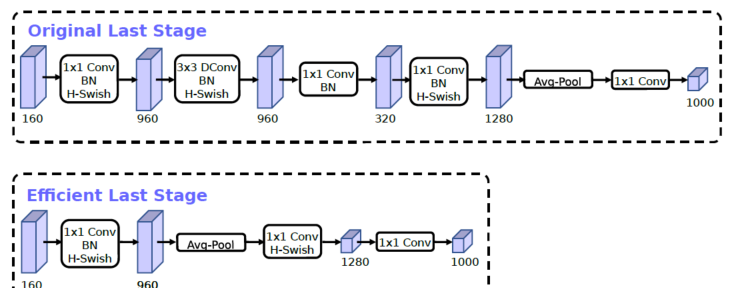

改進一:下圖是MobileNet-v2的整理模型架構,可以看到,網絡的最后部分首先通過1x1卷積映射到高維,然后通過GAP收集特征,最后使用1x1卷積劃分到K類。所以其中起抽取特征作用的是在7x7分辨率上做1x1卷積的那一層。

而V3是先進行池化然后再進行1x1卷積提取特征,V2是先1X1卷積提取特征再池化。

ShuffleNet

組卷積

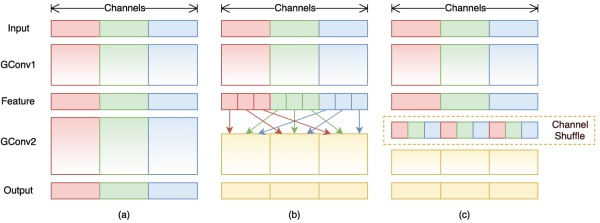

Group convolution是將輸入層的不同特征圖進行分組,然后采用不同的卷積核再對各個組進行卷積,這樣會降低卷積的計算量。

因為一般的卷積都是在所有的輸入特征圖上做卷積,可以說是全通道卷積,這是一種通道密集連接方式(channel dense connection),而group convolution相比則是一種通道稀疏連接方式(channel sparse connection)。

depthwise convolution,這是一種比較特殊的group convolution,此時分組數恰好等于通道數,意味著每個組只有一個特征圖。

分組卷積的會帶來一個矛盾就是特征通信。group convolution層另一個問題是不同組之間的特征圖需要通信。所以MobileNet等網絡采用密集的1x1 pointwise convolution,因為要保證group convolution之后不同組的特征圖之間的信息交流。

為達到特征通信目的,我們不采用dense pointwise convolution,考慮其他的思路:channel shuffle

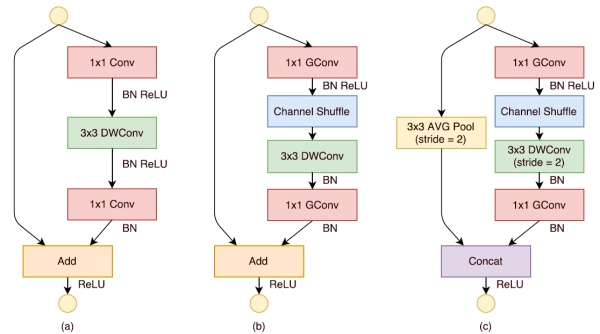

ShuffleNet的核心是采用了兩種操作:pointwise group convolution和channel shuffle,這在保持精度的同時大大降低了模型的計算量。其基本單元則是在一個殘差單元的基礎上改進而成。

-

cnn

+關注

關注

3文章

351瀏覽量

22178 -

卷積神經網絡

+關注

關注

4文章

366瀏覽量

11853 -

resnet

+關注

關注

0文章

12瀏覽量

3156

原文標題:卷積神經網絡的發展及各模型的優缺點

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

卷積神經網絡的發展及各模型的優缺點

卷積神經網絡的發展及各模型的優缺點

評論