給畫畫AI加個buff,畫起圖像就像開了掛。

加個人體骨骼綁定buff,Stable Diffusion直接快進到生成3D動漫:

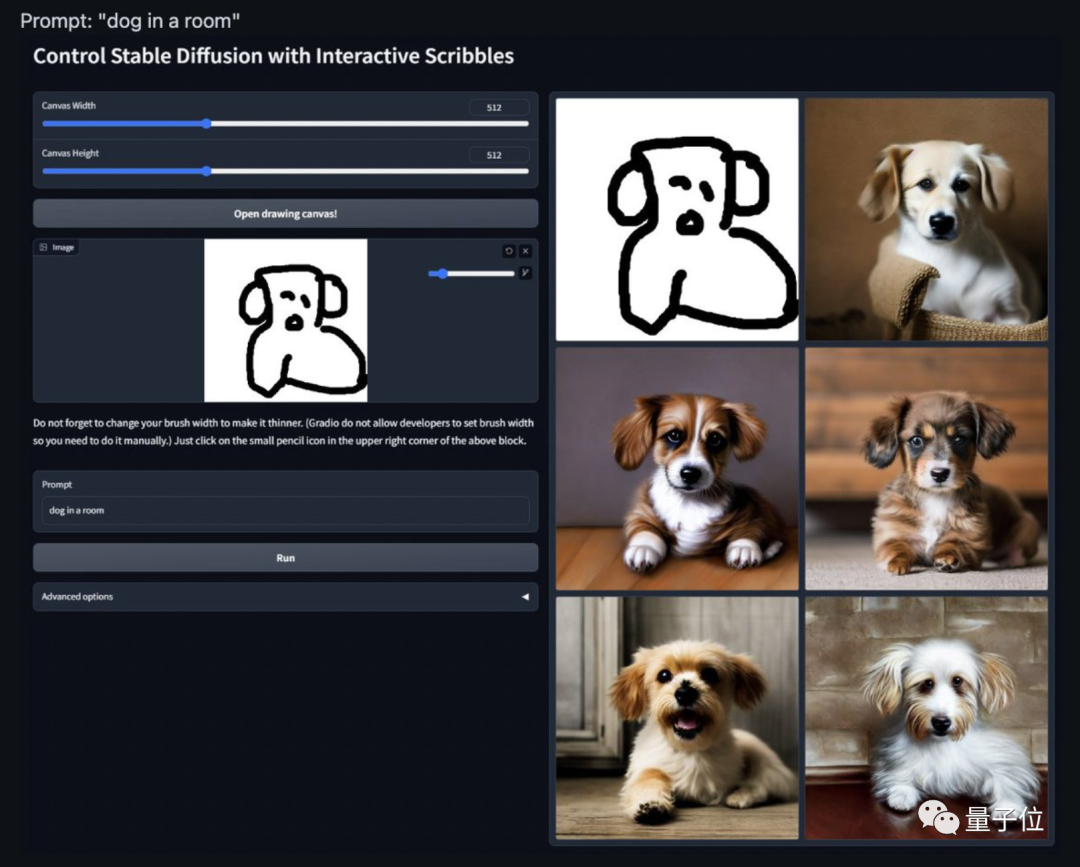

加個抽象到爆的草圖buff,AI變著風格生成“完全一致”的狗子:

就連號稱“AI殺手”的手部細節,也能在控制之下畫得惟妙惟肖:

這個名叫ControlNet的新AI插件,可以說是給畫畫AI來了最后的“臨門一腳”——

原本AI無法控制的手部細節、整體架構,有了它之后,加上Stable Diffusion這樣的擴散模型,足以生成任何人們想要的圖像。

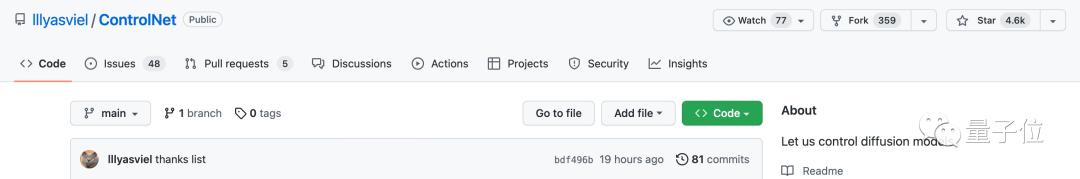

發出不到兩天,ControlNet就在GitHub上火了,目前已經狂攬4.6k星:

△“讓我們控制擴散模型”

各種效果圖更是在推特上爆火,試玩過的網友直呼:

游戲結束!

所以,這個ControlNet究竟給擴散模型加了什么buff?

給AI畫畫模型加buff

ControlNet的原理,本質上是給預訓練擴散模型增加一個額外的輸入,控制它生成的細節。

這里可以是各種類型的輸入,作者給出來的有8種,包括草圖、邊緣圖像、語義分割圖像、人體關鍵點特征、霍夫變換檢測直線、深度圖、人體骨骼等。

那么,讓大模型學會“按輸入條件生成圖片”的原理是什么呢?

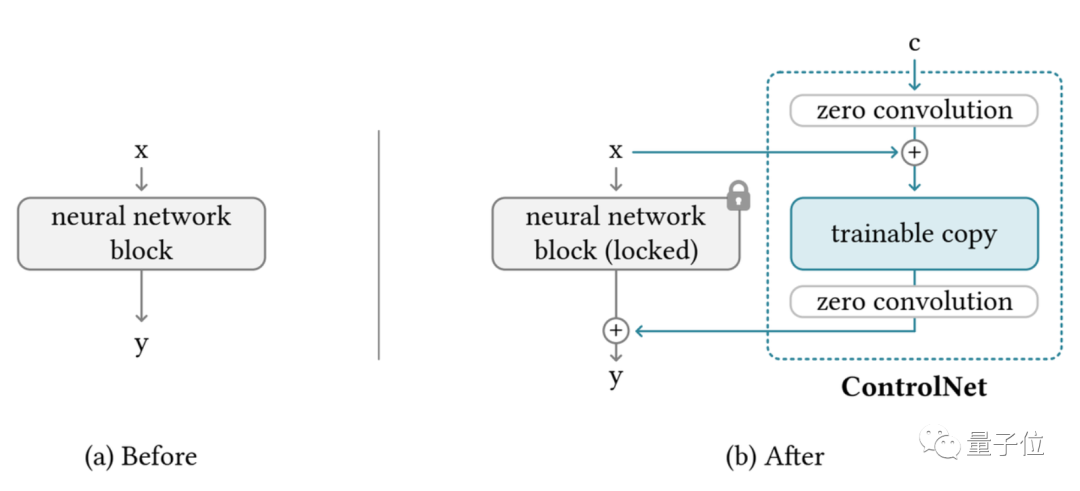

ControlNet整體思路和架構分工如下:

具體來說,ControlNet先復制一遍擴散模型的權重,得到一個“可訓練副本”(trainable copy)。

相比之下,原擴散模型經過幾十億張圖片的預訓練,因此參數是被“鎖定”的。而這個“可訓練副本”只需要在特定任務的小數據集上訓練,就能學會條件控制。

據作者表示,即使數據量很少(不超過5萬張圖片),模型經過訓練后條件控制生成的效果也很好。

“鎖定模型”和“可訓練副本”通過一個1×1的卷積層連接,名叫“0卷積層”。

0卷積層的權重和偏置初始化為0,這樣在訓練時速度會非常快,接近微調擴散模型的速度,甚至在個人設備上訓練也可以。

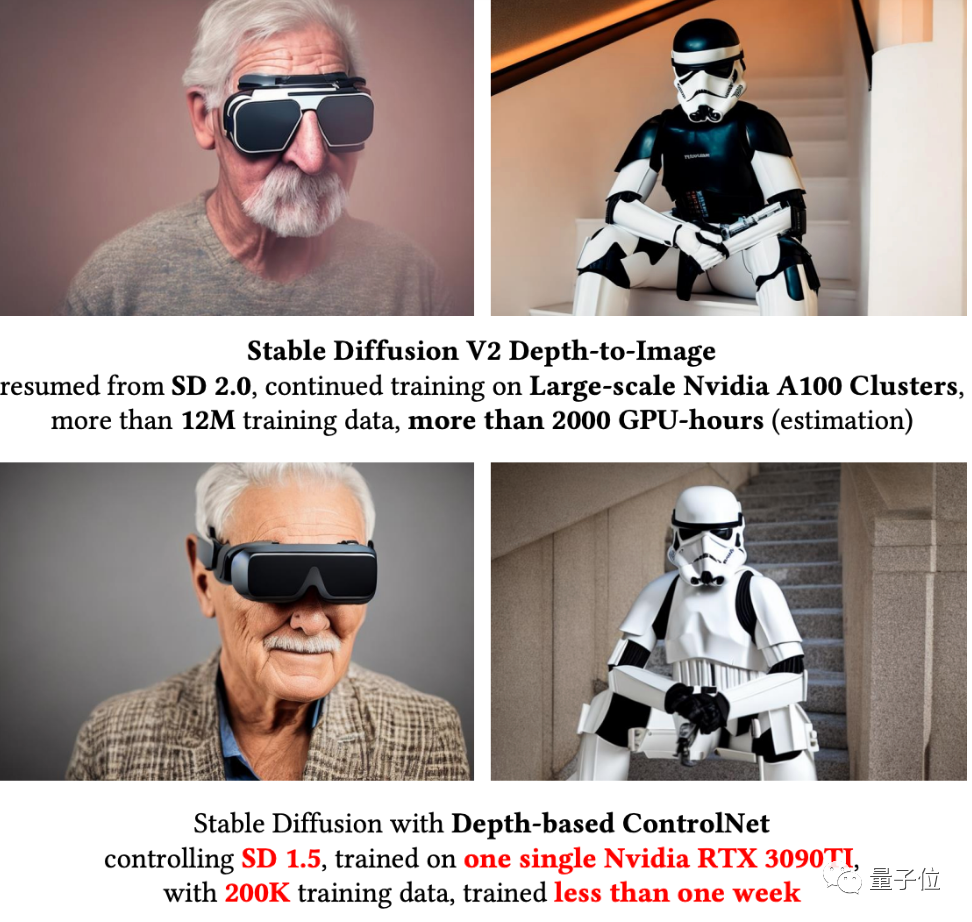

例如一塊英偉達RTX 3090TI,用20萬張圖像數據訓練的話只需要不到一個星期:

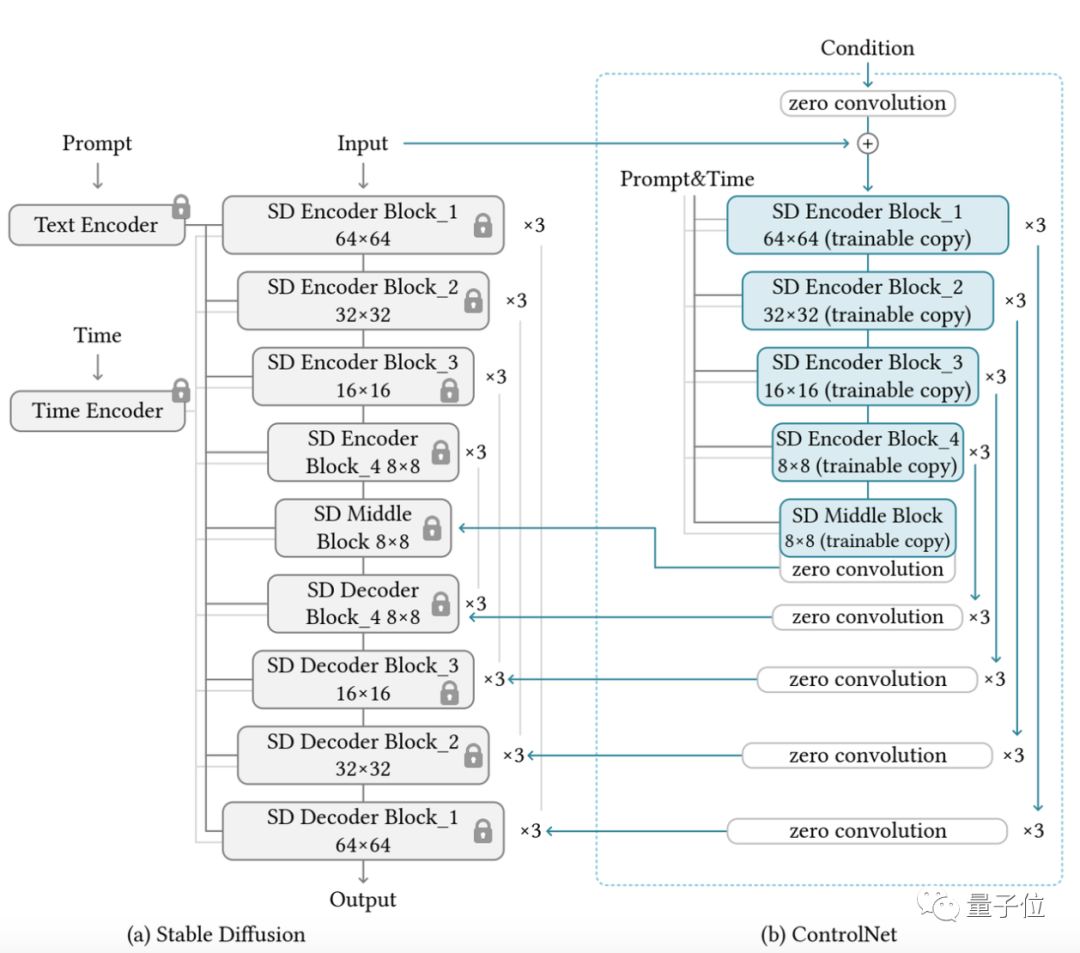

作者基于當前大火的Stable Diffusion進行了具體實現,主要架構如下:

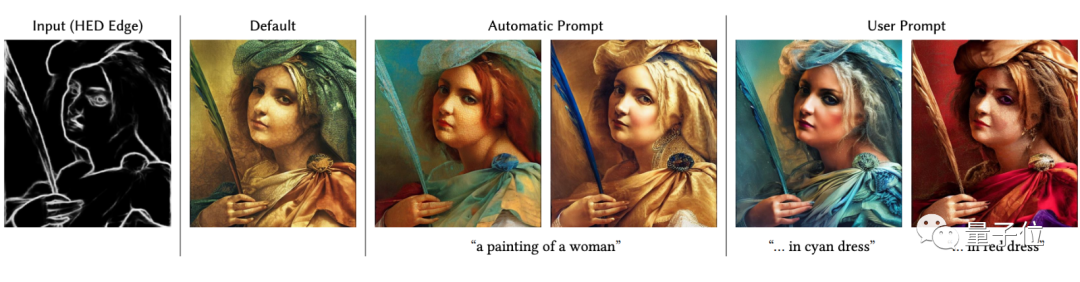

針對不同的輸入,作者也給出了對應不同的模型,生成效果也都不錯。

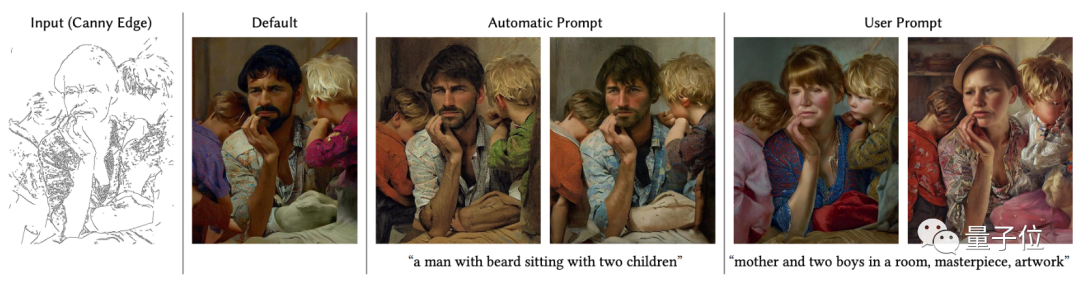

例如這是采用Canny邊緣檢測算法檢測出的邊緣,用于生成圖像:

這是基于霍夫變換的直線檢測算法生成的直線草圖,用于生成各種風格的室內設計:

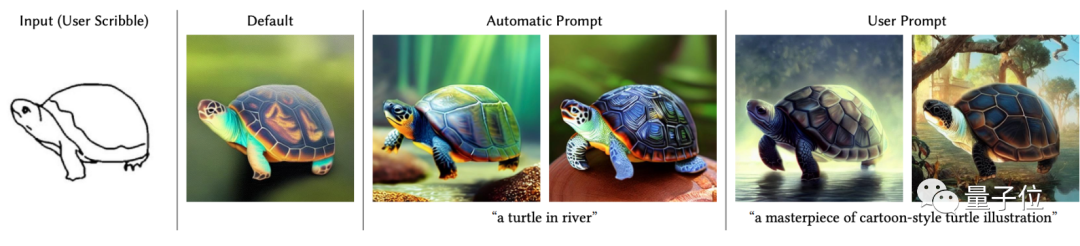

當然,自己作畫也可以,例如這是基于用戶草圖生成的小龜:

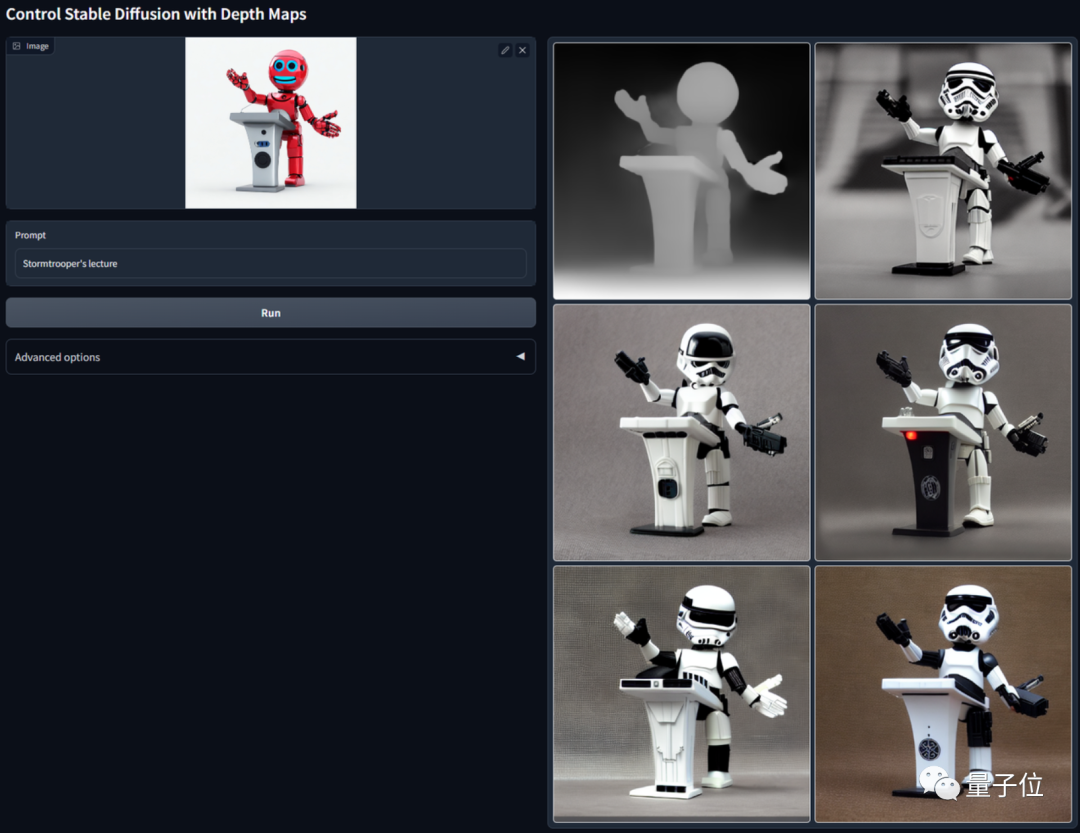

提取深度圖,并讓AI生成一幅相似的圖像,直接舉一反五:

語義分割下的游泳池圖像,不僅水里有倒影細節,建筑也變化多樣:

不過目前來看,最受歡迎的還是基于人體姿態估計算法,控制動漫人物的動作生成:

看到這里,是不是已經有了大膽的想法?(手動狗頭)

曾開發爆火AI上色插件

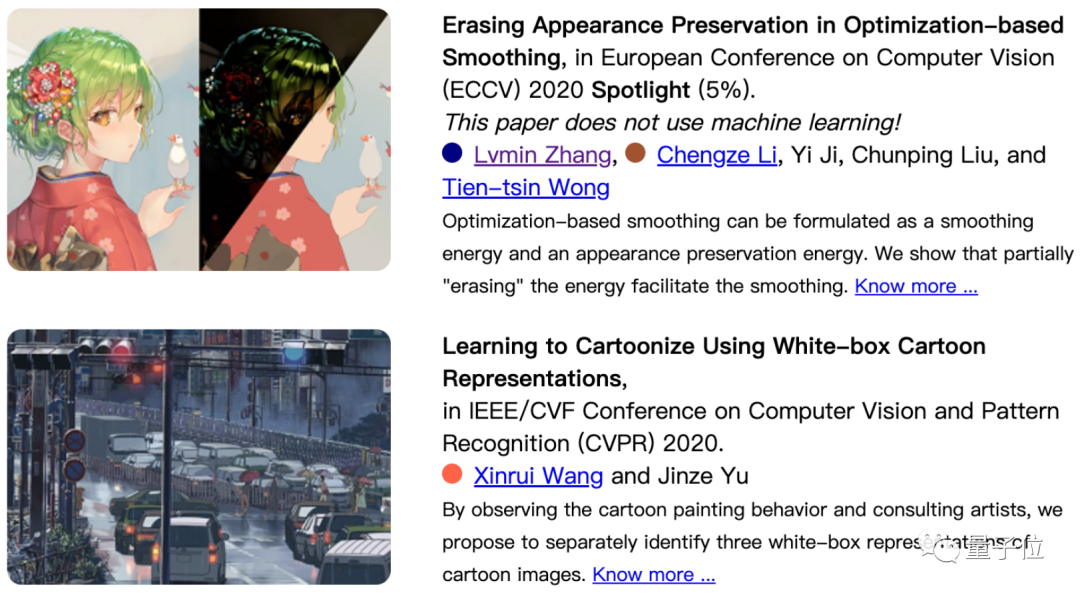

這個項目的作者Lvmin Zhang,2021年本科畢業于東吳大學,目前在斯坦福大學讀博。

他最出名的項目之一,是2017年開發的AI上色插件style2paints,目前GitHub上已經有15.9k星。

style2paints也經過了好幾次迭代,目前即將更新到第五版。

這是第四版的效果,只需要線稿,AI就能自動給你的圖像完成上色:

除了這個項目以外,他也是CV頂會的常客了。

One More Thing

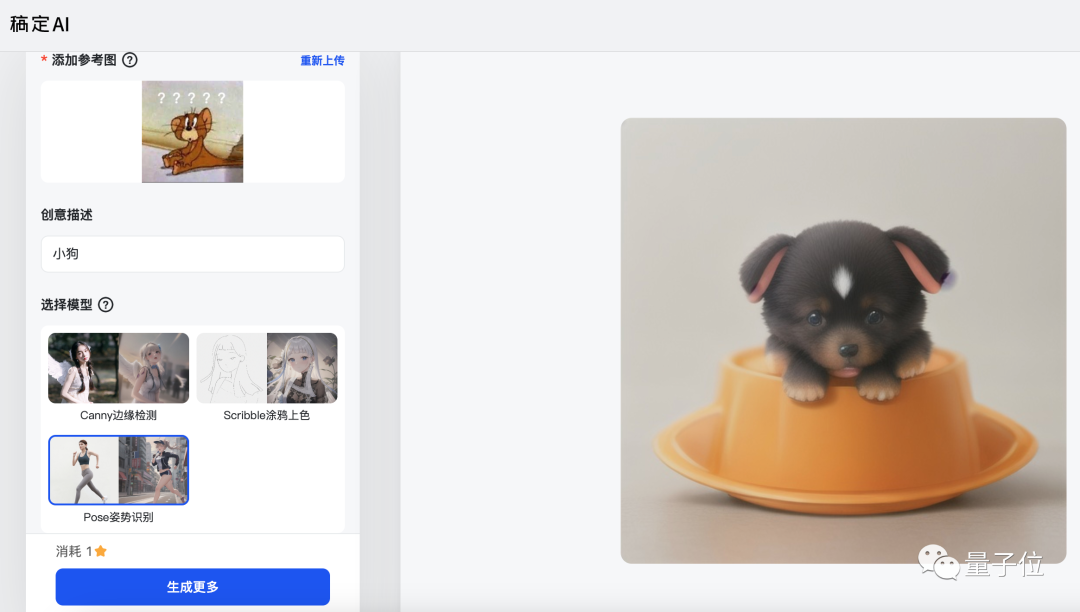

值得一提的是,現在已經有基于ControlNet的國內產品上線了。

這個產品名叫稿定AI,包含照片轉插畫、插畫線稿上色、插畫優化翻新等功能,正是基于ControlNet打造。

作畫效果大概是醬嬸的:

感興趣的小伙伴們可以去試玩一波了~

項目地址: https://github.com/lllyasviel/ControlNet

參考鏈接: [1]https://lllyasviel.github.io/Style2PaintsResearch/ [2]https://twitter.com/search?q=controlnet&src=typed_query [3]https://www.gaoding.com/ai

審核編輯 :李倩

-

AI

+關注

關注

87文章

30146瀏覽量

268414 -

數據集

+關注

關注

4文章

1205瀏覽量

24644

原文標題:讓AI學會畫手的方法來了,給輸入加個buff就能控制生成細節,華人小哥出品丨GitHub 4.6k星

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

生成式AI如何在智能家居中落地?

舒心貼進駐《機會來了》科技庫,4大黑科技讓你安全高效告別疼痛

如何通過使用gm/Id的方法來簡化設計運放?

可以通過哪些方法來改善MCU掃描附近AP時出現的故障

給qmail郵件服務器加個病毒防火墻

AI給安防行業帶來了翻天覆地的變化 視頻監控是安防最重要的部分

西安交大畢業生讓機械手學會寫字

AI算法5秒鐘就能克隆你的聲音

在線研討會 | 9 月 19 日,利用 GPU 加速生成式 AI 圖像內容生成

讓AI學會畫手的方法來了,給輸入加個buff就能控制生成細節

讓AI學會畫手的方法來了,給輸入加個buff就能控制生成細節

評論