電子發(fā)燒友網(wǎng)報(bào)道(文/李彎彎)近日,百度飛槳總架構(gòu)師于佃海公開談到,AI預(yù)訓(xùn)練大模型是深度學(xué)習(xí)崛起以來,最重要的一次技術(shù)變革。

大模型不只是模型參數(shù)規(guī)模大,同時(shí)也對應(yīng)著學(xué)習(xí)機(jī)制和AI開發(fā)應(yīng)用范式的改變。自監(jiān)督學(xué)習(xí)模式突破了數(shù)據(jù)標(biāo)注的困境,可以從海量數(shù)據(jù)中學(xué)習(xí)到豐富的通用知識。

基于大模型,只需要通過模型的微調(diào)或提示等方式,就可以在廣泛的下游任務(wù)中取得優(yōu)異的效果,極大的降低了AI開發(fā)和應(yīng)用的成本。

大語言模型的涌現(xiàn)能力

在自然語言處理領(lǐng)域,過去這些年模型的規(guī)模越來越多。之前模型參數(shù)大概在千萬級別、億級別,現(xiàn)在已經(jīng)跳到了千億級別。基本上游研究這些大模型的使一些計(jì)算資源比較豐富的企業(yè)和機(jī)構(gòu),有了這些預(yù)訓(xùn)練模型之后,下游可以把它放在一些自然語言處理的任務(wù)中。

在全球人工智能開發(fā)者先鋒大會(huì)上,復(fù)旦大學(xué)計(jì)算機(jī)學(xué)院教授邱錫鵬在《ChatGPT能力分析與應(yīng)用》主題演講中表示,大型語言模型是ChatGPT的基座。

邱錫鵬教授談到,當(dāng)模型從小規(guī)模發(fā)展到大規(guī)模的時(shí)候,當(dāng)發(fā)展到一定階段,它會(huì)涌現(xiàn)出一些之前在小模型上觀測不到的能力,也就是大家說的能力涌現(xiàn)。比如給幾個(gè)樣例,讓模型學(xué)習(xí)這個(gè)任務(wù),一個(gè)百億級別參數(shù)規(guī)模的模型和一個(gè)千億級別參數(shù)的模型,這兩個(gè)模型的能力差異會(huì)相當(dāng)大,邱錫鵬教授認(rèn)為,從百億到千億參數(shù)規(guī)模,模型發(fā)生了能力的突變。

考察大模型的幾個(gè)能力:數(shù)學(xué)建模能力、多任務(wù)理解的能力、上下文的學(xué)習(xí)理解能力,在百億規(guī)模之后,就會(huì)發(fā)生突變。它的能力不再是線性增長。

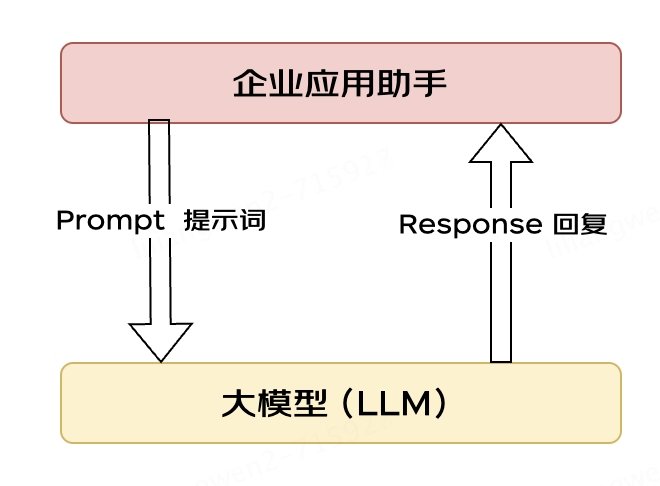

模型使用的方式也發(fā)生了變換,因?yàn)橛辛舜竽P椭螅{(diào)參非常難,它的使用范式也會(huì)發(fā)生變化。比如,早期使用預(yù)訓(xùn)練,調(diào)它的參數(shù);現(xiàn)在語言模型很大的時(shí)候,要做什么任務(wù),就是提示,告訴它要做什么,變成了另外一種使用范式。

舉個(gè)例子,我們把要完成的任務(wù),用一句話描述出來,輸入給語言模型,語言模型就按產(chǎn)生下一句話的方式,生成你要的答案。這就是大型語言模型的使用方式。邱錫鵬教授認(rèn)為,在Transformer這種架構(gòu)下,大型語言模型標(biāo)志性的分水嶺是百億規(guī)模參數(shù)。

以ChatGPT為例,在大模型下,ChatGPT涌現(xiàn)出的三種能力:情景學(xué)習(xí)、思維鏈和指令學(xué)習(xí)。這三個(gè)能力對ChatGPT最終的成功起到了重要作用。

情景學(xué)習(xí):大模型調(diào)參不是很方便,如果要它在一個(gè)上下文語境中完成學(xué)習(xí),這就叫情景學(xué)習(xí)。也就是給它一個(gè)任務(wù),再給它幾個(gè)例子,讓它學(xué)習(xí)。情景學(xué)習(xí)賦予了大模型非常強(qiáng)的交互能力,情景學(xué)習(xí)也可以大幅降低下游的開發(fā)成本。

思維鏈:思維鏈的關(guān)鍵是打破了Scaling Law,一般而言,模型規(guī)模的放大通常會(huì)帶來能力的提升。而思維鏈的出現(xiàn),使得在一定規(guī)模之后,可以通過思維鏈繼續(xù)放大模型的能力,而不需要進(jìn)一步擴(kuò)大參數(shù)規(guī)模。

指令學(xué)習(xí):大模型達(dá)到一定規(guī)模之后,只需要給它少數(shù)的指令,它就學(xué)會(huì)了,對于沒見過的指令,它也會(huì)。這些就是大模型的涌現(xiàn)能力,它的泛化能力會(huì)變得非常強(qiáng)。

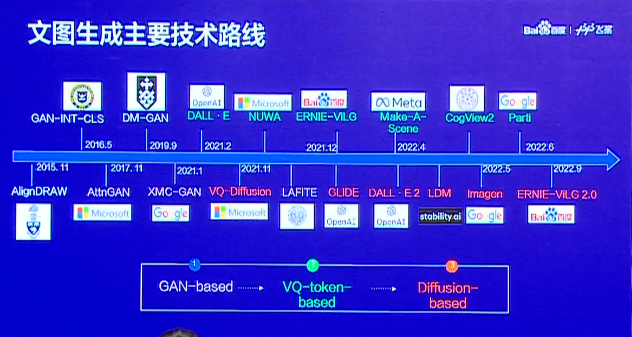

文圖生成主要技術(shù)路線

在ChatGPT出現(xiàn)之前,大模型最火的應(yīng)用就是AI作畫,也就是文圖生成。事實(shí)上,文圖生成技術(shù)從2015年到現(xiàn)在,一直在不斷演進(jìn)。據(jù)百度深圳自然語言處理部技術(shù)總監(jiān)何徑舟在上述大會(huì)上介紹,這之間,文圖生成技術(shù)大概經(jīng)歷了三個(gè)技術(shù)流派。

第一個(gè)是以對抗生成網(wǎng)絡(luò)GAN-based為主的早期技術(shù);第二個(gè)是序列生成 VQ-token-based這種方式 ;第三個(gè)是從去年開始大熱的Diffusion-based擴(kuò)散網(wǎng)絡(luò)這種方案。現(xiàn)在常見的、在很多產(chǎn)品中使用的,都是這三個(gè)技術(shù)流派的延續(xù)或結(jié)合。

基于GAN的文本-圖像生成模型,是四五年前最火的文圖生成技術(shù)。它的優(yōu)點(diǎn)是,整個(gè)模型的生成過程很快,在當(dāng)時(shí)來看,生成的圖像質(zhì)量相當(dāng)不錯(cuò);然而它致命的缺點(diǎn)是,網(wǎng)絡(luò)特別難訓(xùn)練,稍不小心就會(huì)訓(xùn)練壞,或者難以得到理想的效果。因此在之后的工作中,大家就不太實(shí)用了。

基于圖像量化的序列建模。它是把圖像基于離散化的方式,壓縮成離散視覺token的序列,這樣可以跟文本用類似的方式基于Transformer自回歸生成,建模文本序列和圖像序列間的關(guān)系。通過這樣的方式,做文圖轉(zhuǎn)換,也可以做圖像文本的生成。何徑舟表示,文心大模型ERNIE-ViLG第一個(gè)版本就是基于VQ-token-based這種方式做的,在當(dāng)時(shí)ERNIE-ViLG能夠完成雙向的生成和建模。

基于擴(kuò)散模型的文本-圖像生成模型,是現(xiàn)在文圖生成技術(shù)的主流。它是把一個(gè)圖像通過加高斯噪聲的方式,一直到純隨機(jī)序列高斯噪音的分布。再通過UNet,不斷反復(fù)調(diào)用它,把這個(gè)圖像還原回來。這時(shí)候可以把文本的encoder加進(jìn)去,指導(dǎo)圖像還原過程。這樣就實(shí)現(xiàn)了從文本到圖像的生成過程。這是現(xiàn)在絕大多數(shù)最新產(chǎn)品和技術(shù)都采用的方案,效果非常好。

小結(jié)

過去這些年,國內(nèi)外在大模型技術(shù)的研究方面不斷取得突破,最近ChatGPT的出現(xiàn)及其體現(xiàn)出的驚人能力,更是讓人們體會(huì)到了大模型對于人工智能發(fā)展的重要意義。從種種跡象來看,疊加情景學(xué)習(xí)、指令微調(diào)、人類反饋、強(qiáng)化學(xué)習(xí)等機(jī)制,可以使大模型實(shí)現(xiàn)超出想象的能力涌現(xiàn),讓人們期待的通用人工智能的實(shí)現(xiàn)加速。

大模型不只是模型參數(shù)規(guī)模大,同時(shí)也對應(yīng)著學(xué)習(xí)機(jī)制和AI開發(fā)應(yīng)用范式的改變。自監(jiān)督學(xué)習(xí)模式突破了數(shù)據(jù)標(biāo)注的困境,可以從海量數(shù)據(jù)中學(xué)習(xí)到豐富的通用知識。

基于大模型,只需要通過模型的微調(diào)或提示等方式,就可以在廣泛的下游任務(wù)中取得優(yōu)異的效果,極大的降低了AI開發(fā)和應(yīng)用的成本。

大語言模型的涌現(xiàn)能力

在自然語言處理領(lǐng)域,過去這些年模型的規(guī)模越來越多。之前模型參數(shù)大概在千萬級別、億級別,現(xiàn)在已經(jīng)跳到了千億級別。基本上游研究這些大模型的使一些計(jì)算資源比較豐富的企業(yè)和機(jī)構(gòu),有了這些預(yù)訓(xùn)練模型之后,下游可以把它放在一些自然語言處理的任務(wù)中。

在全球人工智能開發(fā)者先鋒大會(huì)上,復(fù)旦大學(xué)計(jì)算機(jī)學(xué)院教授邱錫鵬在《ChatGPT能力分析與應(yīng)用》主題演講中表示,大型語言模型是ChatGPT的基座。

邱錫鵬教授談到,當(dāng)模型從小規(guī)模發(fā)展到大規(guī)模的時(shí)候,當(dāng)發(fā)展到一定階段,它會(huì)涌現(xiàn)出一些之前在小模型上觀測不到的能力,也就是大家說的能力涌現(xiàn)。比如給幾個(gè)樣例,讓模型學(xué)習(xí)這個(gè)任務(wù),一個(gè)百億級別參數(shù)規(guī)模的模型和一個(gè)千億級別參數(shù)的模型,這兩個(gè)模型的能力差異會(huì)相當(dāng)大,邱錫鵬教授認(rèn)為,從百億到千億參數(shù)規(guī)模,模型發(fā)生了能力的突變。

考察大模型的幾個(gè)能力:數(shù)學(xué)建模能力、多任務(wù)理解的能力、上下文的學(xué)習(xí)理解能力,在百億規(guī)模之后,就會(huì)發(fā)生突變。它的能力不再是線性增長。

模型使用的方式也發(fā)生了變換,因?yàn)橛辛舜竽P椭螅{(diào)參非常難,它的使用范式也會(huì)發(fā)生變化。比如,早期使用預(yù)訓(xùn)練,調(diào)它的參數(shù);現(xiàn)在語言模型很大的時(shí)候,要做什么任務(wù),就是提示,告訴它要做什么,變成了另外一種使用范式。

舉個(gè)例子,我們把要完成的任務(wù),用一句話描述出來,輸入給語言模型,語言模型就按產(chǎn)生下一句話的方式,生成你要的答案。這就是大型語言模型的使用方式。邱錫鵬教授認(rèn)為,在Transformer這種架構(gòu)下,大型語言模型標(biāo)志性的分水嶺是百億規(guī)模參數(shù)。

以ChatGPT為例,在大模型下,ChatGPT涌現(xiàn)出的三種能力:情景學(xué)習(xí)、思維鏈和指令學(xué)習(xí)。這三個(gè)能力對ChatGPT最終的成功起到了重要作用。

情景學(xué)習(xí):大模型調(diào)參不是很方便,如果要它在一個(gè)上下文語境中完成學(xué)習(xí),這就叫情景學(xué)習(xí)。也就是給它一個(gè)任務(wù),再給它幾個(gè)例子,讓它學(xué)習(xí)。情景學(xué)習(xí)賦予了大模型非常強(qiáng)的交互能力,情景學(xué)習(xí)也可以大幅降低下游的開發(fā)成本。

思維鏈:思維鏈的關(guān)鍵是打破了Scaling Law,一般而言,模型規(guī)模的放大通常會(huì)帶來能力的提升。而思維鏈的出現(xiàn),使得在一定規(guī)模之后,可以通過思維鏈繼續(xù)放大模型的能力,而不需要進(jìn)一步擴(kuò)大參數(shù)規(guī)模。

指令學(xué)習(xí):大模型達(dá)到一定規(guī)模之后,只需要給它少數(shù)的指令,它就學(xué)會(huì)了,對于沒見過的指令,它也會(huì)。這些就是大模型的涌現(xiàn)能力,它的泛化能力會(huì)變得非常強(qiáng)。

文圖生成主要技術(shù)路線

在ChatGPT出現(xiàn)之前,大模型最火的應(yīng)用就是AI作畫,也就是文圖生成。事實(shí)上,文圖生成技術(shù)從2015年到現(xiàn)在,一直在不斷演進(jìn)。據(jù)百度深圳自然語言處理部技術(shù)總監(jiān)何徑舟在上述大會(huì)上介紹,這之間,文圖生成技術(shù)大概經(jīng)歷了三個(gè)技術(shù)流派。

第一個(gè)是以對抗生成網(wǎng)絡(luò)GAN-based為主的早期技術(shù);第二個(gè)是序列生成 VQ-token-based這種方式 ;第三個(gè)是從去年開始大熱的Diffusion-based擴(kuò)散網(wǎng)絡(luò)這種方案。現(xiàn)在常見的、在很多產(chǎn)品中使用的,都是這三個(gè)技術(shù)流派的延續(xù)或結(jié)合。

基于GAN的文本-圖像生成模型,是四五年前最火的文圖生成技術(shù)。它的優(yōu)點(diǎn)是,整個(gè)模型的生成過程很快,在當(dāng)時(shí)來看,生成的圖像質(zhì)量相當(dāng)不錯(cuò);然而它致命的缺點(diǎn)是,網(wǎng)絡(luò)特別難訓(xùn)練,稍不小心就會(huì)訓(xùn)練壞,或者難以得到理想的效果。因此在之后的工作中,大家就不太實(shí)用了。

基于圖像量化的序列建模。它是把圖像基于離散化的方式,壓縮成離散視覺token的序列,這樣可以跟文本用類似的方式基于Transformer自回歸生成,建模文本序列和圖像序列間的關(guān)系。通過這樣的方式,做文圖轉(zhuǎn)換,也可以做圖像文本的生成。何徑舟表示,文心大模型ERNIE-ViLG第一個(gè)版本就是基于VQ-token-based這種方式做的,在當(dāng)時(shí)ERNIE-ViLG能夠完成雙向的生成和建模。

基于擴(kuò)散模型的文本-圖像生成模型,是現(xiàn)在文圖生成技術(shù)的主流。它是把一個(gè)圖像通過加高斯噪聲的方式,一直到純隨機(jī)序列高斯噪音的分布。再通過UNet,不斷反復(fù)調(diào)用它,把這個(gè)圖像還原回來。這時(shí)候可以把文本的encoder加進(jìn)去,指導(dǎo)圖像還原過程。這樣就實(shí)現(xiàn)了從文本到圖像的生成過程。這是現(xiàn)在絕大多數(shù)最新產(chǎn)品和技術(shù)都采用的方案,效果非常好。

小結(jié)

過去這些年,國內(nèi)外在大模型技術(shù)的研究方面不斷取得突破,最近ChatGPT的出現(xiàn)及其體現(xiàn)出的驚人能力,更是讓人們體會(huì)到了大模型對于人工智能發(fā)展的重要意義。從種種跡象來看,疊加情景學(xué)習(xí)、指令微調(diào)、人類反饋、強(qiáng)化學(xué)習(xí)等機(jī)制,可以使大模型實(shí)現(xiàn)超出想象的能力涌現(xiàn),讓人們期待的通用人工智能的實(shí)現(xiàn)加速。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請聯(lián)系本站處理。

舉報(bào)投訴

-

AI

+關(guān)注

關(guān)注

87文章

30239瀏覽量

268475 -

大模型

+關(guān)注

關(guān)注

2文章

2339瀏覽量

2500

發(fā)布評論請先 登錄

相關(guān)推薦

嵌入式和人工智能究竟是什么關(guān)系?

與人工智能的結(jié)合,無疑是科技發(fā)展中的一場革命。在人工智能硬件加速中,嵌入式系統(tǒng)以其獨(dú)特的優(yōu)勢和重要性,發(fā)揮著不可或缺的作用。通過深度學(xué)習(xí)和神經(jīng)網(wǎng)絡(luò)等算法,嵌入式系統(tǒng)能夠高效地處理大量數(shù)據(jù),從而

發(fā)表于 11-14 16:39

《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第6章人AI與能源科學(xué)讀后感

幸得一好書,特此來分享。感謝平臺,感謝作者。受益匪淺。

在閱讀《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》的第6章后,我深刻感受到人工智能在能源科學(xué)領(lǐng)域中的巨大潛力和廣泛應(yīng)用。這一章詳細(xì)

發(fā)表于 10-14 09:27

AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第4章-AI與生命科學(xué)讀后感

。

4. 對未來生命科學(xué)發(fā)展的展望

在閱讀這一章后,我對未來生命科學(xué)的發(fā)展充滿了期待。我相信,在人工智能技術(shù)的推動(dòng)下,生命科學(xué)將取得更加顯著的進(jìn)展。例如,在藥物研發(fā)領(lǐng)域,AI技術(shù)將幫助

發(fā)表于 10-14 09:21

《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第二章AI for Science的技術(shù)支撐學(xué)習(xí)心得

非常高興本周末收到一本新書,也非常感謝平臺提供閱讀機(jī)會(huì)。

這是一本挺好的書,包裝精美,內(nèi)容詳實(shí),干活滿滿。

關(guān)于《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第二章“AI

發(fā)表于 10-14 09:16

《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第一章人工智能驅(qū)動(dòng)的科學(xué)創(chuàng)新學(xué)習(xí)心得

,無疑為讀者鋪設(shè)了一條探索人工智能(AI)如何深刻影響并推動(dòng)科學(xué)創(chuàng)新的道路。在閱讀這一章后,我深刻感受到了人工智能技術(shù)在科學(xué)領(lǐng)域的廣泛應(yīng)用潛力以及其帶來的革命性變化,以下是我個(gè)人的學(xué)習(xí)

發(fā)表于 10-14 09:12

人工智能ai 數(shù)電 模電 模擬集成電路原理 電路分析

人工智能ai 數(shù)電 模電 模擬集成電路原理 電路分析 想問下哪些比較容易學(xué) 不過好像都是要學(xué)的

發(fā)表于 09-26 15:24

人工智能ai4s試讀申請

目前人工智能在繪畫對話等大模型領(lǐng)域應(yīng)用廣闊,ai4s也是方興未艾。但是如何有效利用ai4s工具助力科研是個(gè)需要研究的課題,本書對ai4s基本

發(fā)表于 09-09 15:36

名單公布!【書籍評測活動(dòng)NO.44】AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新

!

《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》 這本書便將為讀者徐徐展開AI for Science的美麗圖景,與大家一起去了解:

人工智能究竟幫科學(xué)家做了什么?

發(fā)表于 09-09 13:54

報(bào)名開啟!深圳(國際)通用人工智能大會(huì)將啟幕,國內(nèi)外大咖齊聚話AI

8月28日至30日,2024深圳(國際)通用人工智能大會(huì)暨深圳(國際)通用人工智能產(chǎn)業(yè)博覽會(huì)將在深圳國際會(huì)展中心(寶安)舉辦。大會(huì)以“魅力AI·無限未來”為主題,致力于打造全球通用人工智能

發(fā)表于 08-22 15:00

阿丘科技成功入選“北京市通用人工智能產(chǎn)業(yè)創(chuàng)新伙伴計(jì)劃”,AI+工業(yè)視覺實(shí)力再獲肯定

成式AI技術(shù)、垂直行業(yè)視覺大模型等創(chuàng)新探索,成功入選“應(yīng)用伙伴”。聚焦AI+工業(yè)場景,入選應(yīng)用伙伴“北京市通用人工智能產(chǎn)業(yè)創(chuàng)新伙伴計(jì)劃”由北京市經(jīng)濟(jì)和信息化局、北京

人工智能模型有哪些

人工智能(Artificial Intelligence, AI)作為21世紀(jì)最具影響力的技術(shù)之一,正以前所未有的速度改變著我們的生活、工作乃至整個(gè)社會(huì)結(jié)構(gòu)。AI

九章云極DataCanvas公司入選北京市通用人工智能產(chǎn)業(yè)創(chuàng)新伙伴計(jì)劃

作為北京市標(biāo)桿人工智能企業(yè),九章云極DataCanvas公司將持續(xù)發(fā)揮產(chǎn)業(yè)優(yōu)勢,繼續(xù)堅(jiān)持將自主創(chuàng)新的AI技術(shù)注入產(chǎn)業(yè),以大模型應(yīng)用為終極服務(wù)目標(biāo),通過包括大

大模型應(yīng)用之路:從提示詞到通用人工智能(AGI)

鋪平道路。 基于AI大模型的推理功能,結(jié)合了RAG(檢索增強(qiáng)生成)、智能體(Agent)、知識庫、向量數(shù)據(jù)庫、知識圖譜等先進(jìn)技術(shù),我們向實(shí)現(xiàn)真正的AGI(

燧原科技發(fā)布“燎原”生態(tài)合作計(jì)劃,共建通用人工智能產(chǎn)業(yè)化聯(lián)盟

AIGC生成式內(nèi)容為代表的通用人工智能正在重塑商業(yè)模式,技術(shù)創(chuàng)新催生了大量的新產(chǎn)業(yè)、新范式,也蘊(yùn)含著極具潛力的商業(yè)機(jī)遇。通用人工智能應(yīng)用的落地,需要將算力、智算中心、算法模型、垂直解決方案與應(yīng)用場景全鏈路打通,進(jìn)行有機(jī)結(jié)合

英特爾、谷歌、英偉達(dá)運(yùn)用人工智能推動(dòng)處理器設(shè)計(jì)與生產(chǎn)

兩家著名的芯片設(shè)計(jì)軟件企業(yè),Cadence和Synopsys,均利用人工智能強(qiáng)化設(shè)計(jì)工具。谷歌展示了使用人工智能開發(fā)AI加速度器的方法。英偉達(dá)亦在產(chǎn)品制造過程中運(yùn)用大量

AI大模型帶來改變,將加速通用人工智能的實(shí)現(xiàn)!

AI大模型帶來改變,將加速通用人工智能的實(shí)現(xiàn)!

評論