1 簡介?????????

在demonstration selection的方法中,其中有部分方法也考慮到demonstration內部示例之間的順序,雖然有的論文里提及他們的ICL方法對于demonstration內部示例順序不敏感,但這些實驗中考慮到的排列順序還是不夠全面,從而導致某些結論比較片面。毋庸置疑,如何對挑選出的demonstration示例進行排序是demonstration organization的重要部分。對于同樣樣本組成的demonstration,好的樣本順序可以讓LLM有接近于SOTA的性能,而糟糕的樣本順序會讓LLM的表現接近于隨機猜測。就跟打牌一樣,再好的手牌,不合理安排規劃出牌順序,很容易就會一敗涂地。

2 Demonstration ordering

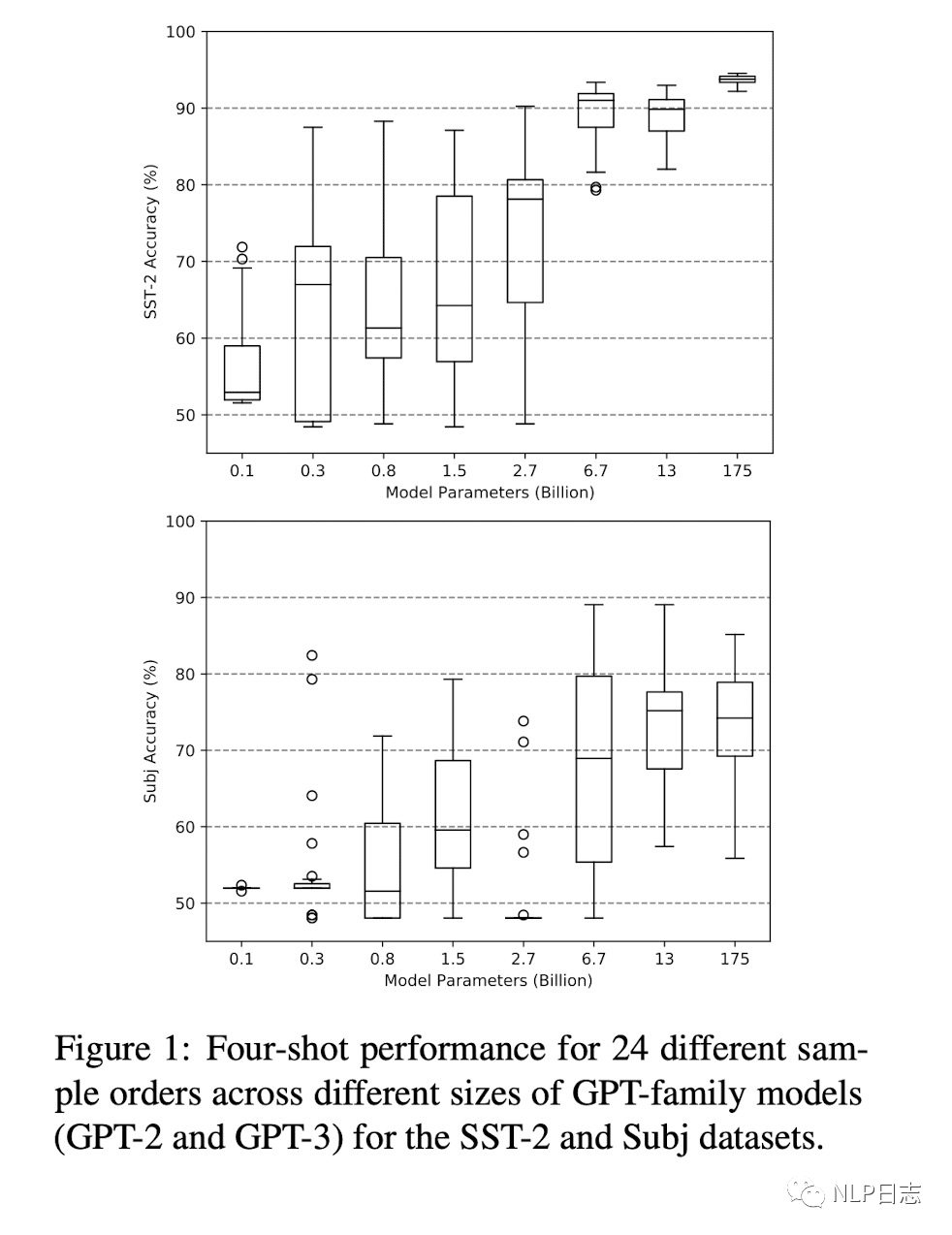

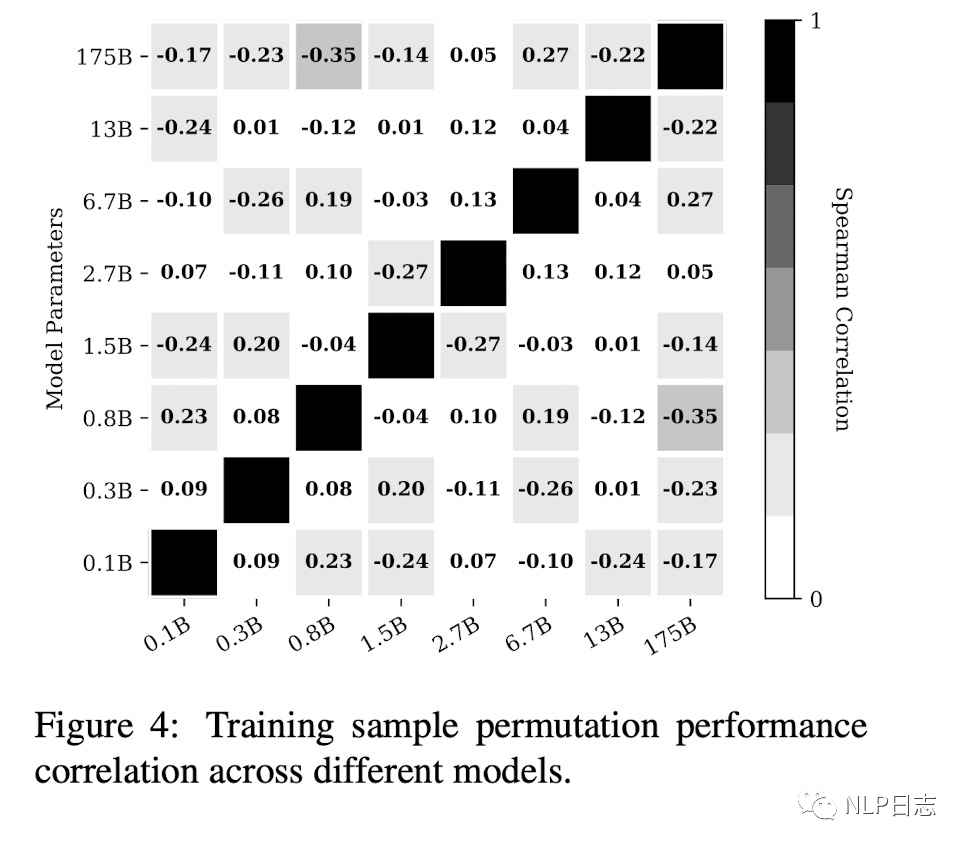

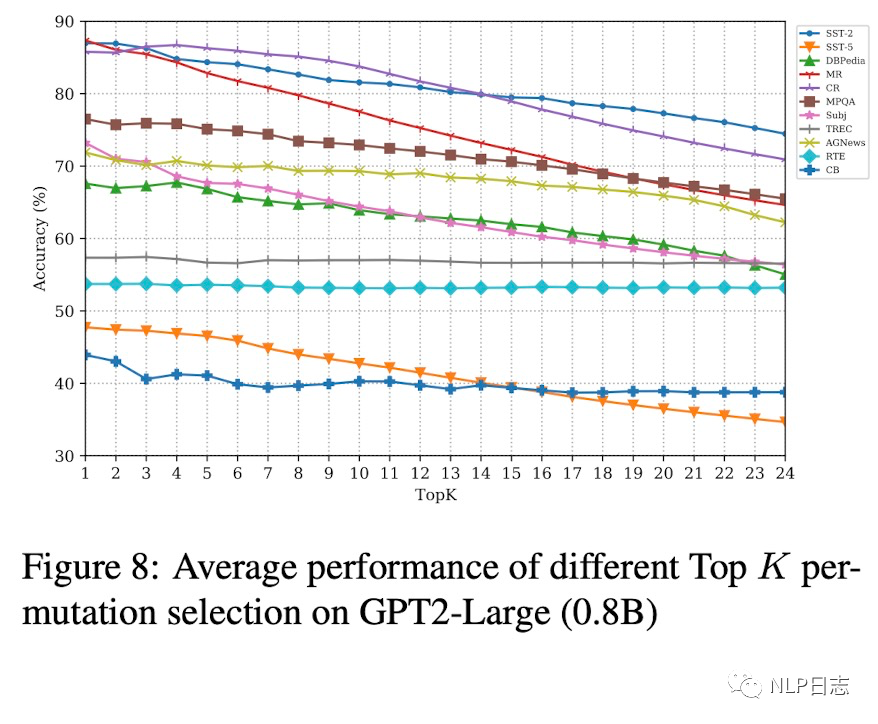

為了更好的研究demonstration樣本排列的影響,需要考慮在不同模型規模,樣本數量以及不同模型上的表現。研究發現,隨著模型規模的增加,demonstration不同樣本排列的效果的方差有所縮小,但是依舊差距明顯,即demonstration好的排列跟壞的排列之間的效果距離很大(見Subj數據集)。增加樣本數量,依舊不能顯著降低這其中的方差。另外,在A模型上表現良好的demonstration排列,在其他的模型效果往往不能得到保證,也就是好的demonstration排列并不能遷移到更多模型中去。

圖1:不同模型尺寸下demonstration ordering的影響

圖2: demonstration ordering在不同模型見的遷移能力

關于demonstration的排列,最簡單的方式就是按照跟當前問題x的關系來排序。由于in-context learning中模型的輸入都是demonstration+x(當前問題),在demonstration中越靠后的示例距離當前的問題x的距離就越近,于是可以通過示例跟當前問題x的相似程度來對示例進行排序,跟當前問題x越相似的示例就放在demonstration越靠后的位置。

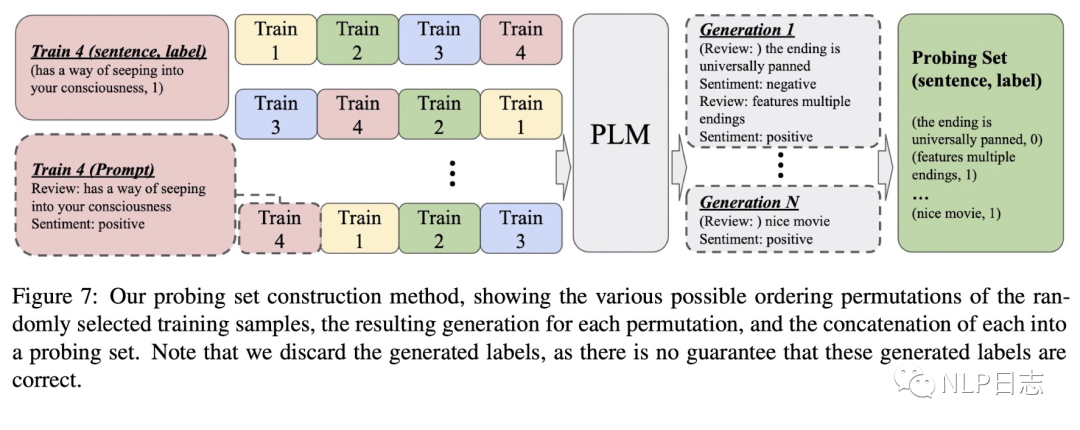

目前確實存在若干種demonstration ordering的方法,但是最大的問題是在缺乏監督驗證集的情況下自動選擇更優的demonstration排列。于是就有研究提出自動構建探測集(probing set),具體流程如下 a)給定一個訓練集S={xi, yi},i=1…n,利用一個模版轉換函數(將樣本數據轉換成某種自然語言)獲得一個自然語言數據集S’={ti}, ti=input:xi,type:yi。 b)定義n個訓練樣本的所有排列函數(也就是demonstration的所有排列),F={fm},cm=fm(S’),m=1,…,n!。每個cm都是n個t組成的一種排列。 c)對于每一個候選排列cm,利用語言模型生成后續的序列,生成新的樣本,對生成結果解析后得到模型生成測試集D。

圖3: probing set構造流程

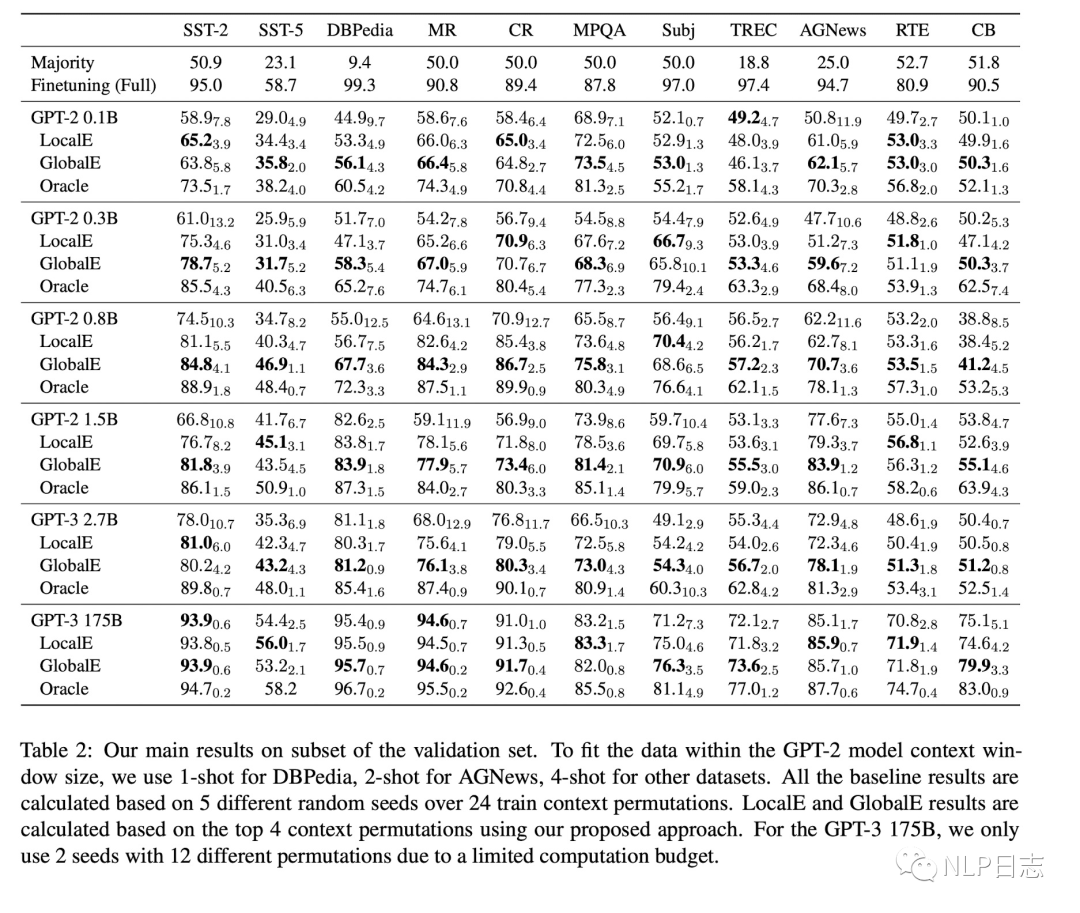

有了模型生成數據集后,研究者就提出了兩種用于選擇最佳demonstration排列的方法Global entropy(GlobalE)以及Local entropy(LocalE)。對于每個demonstration排列cm,在給定demonstration排列cm跟當前問題x的條件下,會預測所有標簽y的概率,將概率最大的標簽作為當前問題x的預測結果,從而計算整個探測集中所有預測標簽分布的交叉熵作為排列cm的GlobalE得分。而LocalE得分則是計算每個探測集數據的預測交叉熵的平均值。簡單的理解就是,如果在探測集上預測的標簽分布相對平衡,那么對應的得分就比較高,作者就認為是比較好的demonstration排列。

通過這兩種方式選擇的demonstration排列,效果上得到明顯提升,并且這種方法還是比較魯棒的,加入更多不好的demonstration排列只會讓效果越來越差。

圖4: 不同demonstration策略的效果對比

圖5:基于demonstration ordering選擇的demonstration排列的的平均效果

3 總結????????

Demonstration ordering目前看來還是一個值得進一步研究的問題,即便模型規模達到一定程度,依舊對此敏感。考慮到demonstration排列的數量跟訓練樣本庫之間是一個指數關系,而目前看到絕大多數Demonstration ordering都是針對每個排列進行的,即便可以自動構建探測集,計算成本還是比較高的,很難考慮所有demonstration排列,目前除了根據與當前問題的相似度進行排序以及上一篇文章提到的馬爾可夫決策過程可以處理,其他的方法都只停留在理論層面,很難在實際中大范圍使用。

-

模型

+關注

關注

1文章

3029瀏覽量

48344 -

icl

+關注

關注

0文章

28瀏覽量

17202 -

數據集

+關注

關注

4文章

1197瀏覽量

24526

原文標題:In-context系列之demonstration ordering

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

復合材料敲擊檢測儀數據分析與處理系統

3C認證檢測中EMC問題實例分析(129頁PPT精品)

怎樣在采集到的音頻信號生成的波形圖中挑選出幅值最大的五條??

復習c/c++之排序算法

CAD如何繪制房間排序

STM32F429的時鐘走向

開關電源工作頻率是依據什么挑選的

谷歌Play Music大更新!用深度學習挑選出最應景的BGM

如何從13個Kaggle比賽中挑選出的最好的Kaggle kernel

挑選開關電源的工作頻率是依據什么?

如何對挑選出的demonstration示例進行排序

如何對挑選出的demonstration示例進行排序

評論