為了促進開源LLMs的工具使用能力,作者引入了 ToolLLM,這是一個數據構建、模型訓練和評估的通用工具使用框架。

論文:ToolLLM: Facilitating Large Language Models to Master 16000+ Real-world APIs

地址:https://arxiv.org/abs/2307.16789

項目:https://github.com/OpenBMB/ToolBench

單位:清華、人大、耶魯、微信、騰訊、知乎

盡管開源大語言模型 (LLM) 及其變體(例如 LLaMA 和 Vicuna)取得了進步,但它們在執行更高級別的任務方面仍然受到很大限制,例如遵循人類指令使用外部工具 (API)。

這是因為當前的指令調優主要集中在基本語言任務而不是工具使用領域。

這與最先進 (SOTA) 的LLMs(例如 ChatGPT)形成鮮明對比,后者展示了出色的工具使用能力,但不幸的是閉源的。

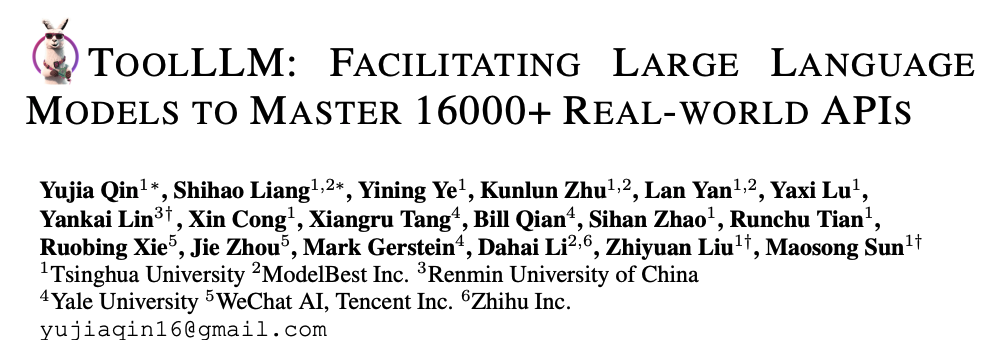

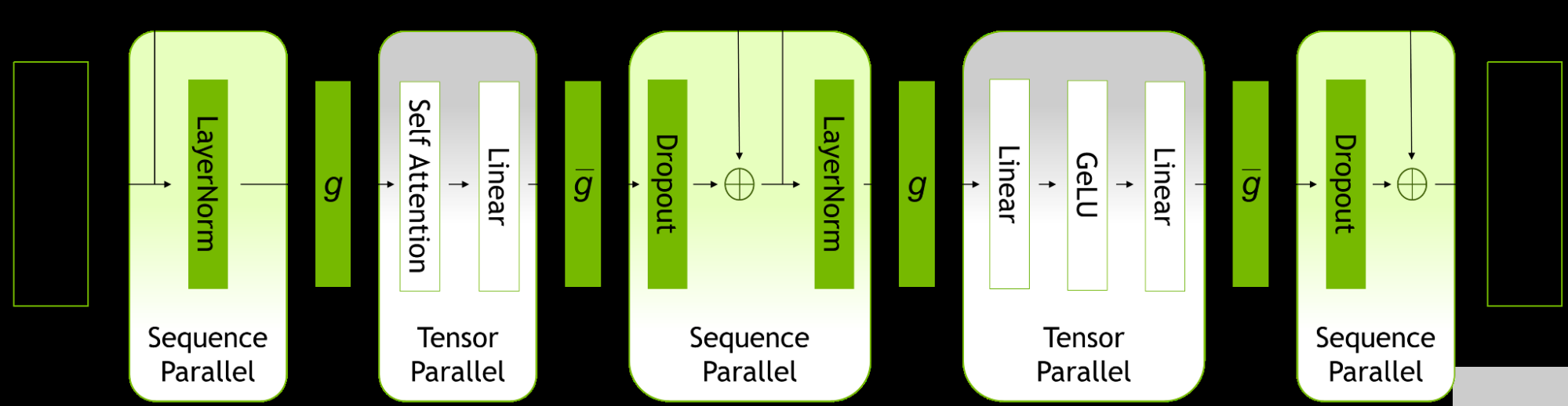

為了促進開源LLMs的工具使用能力,我們引入了 ToolLLM,這是一個數據構建、模型訓練和評估的通用工具使用框架。

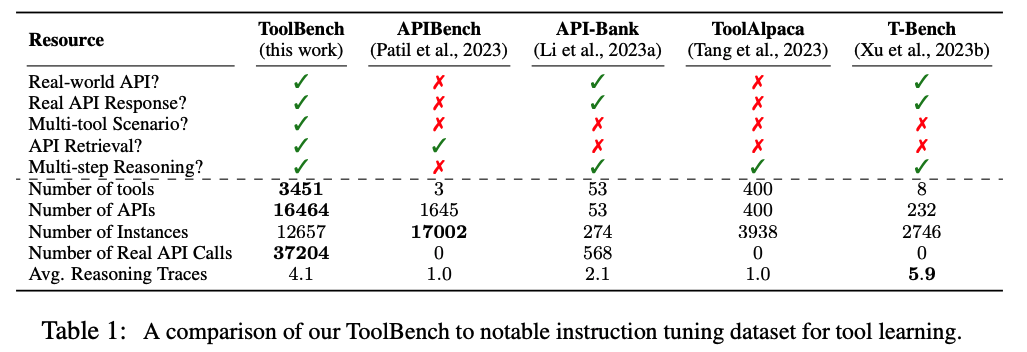

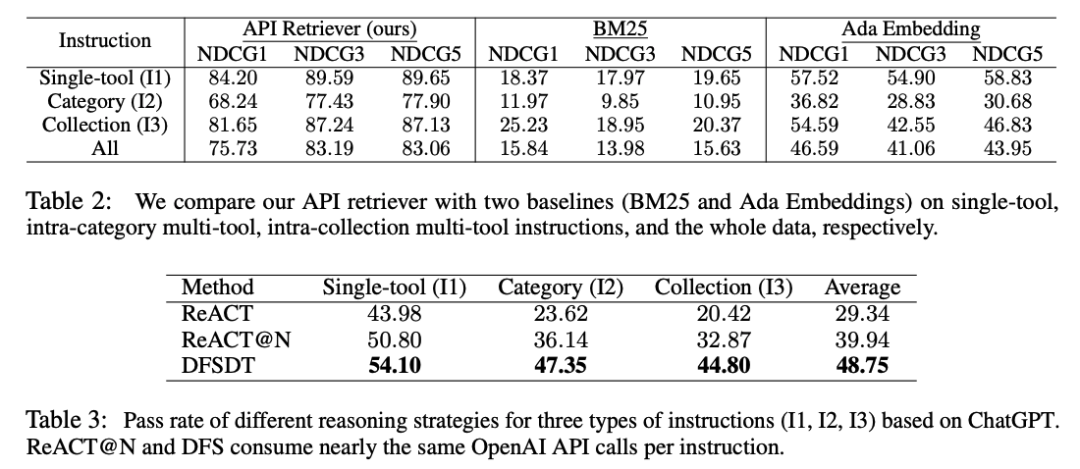

我們首先介紹 ToolBench,這是一個供工具使用的指令調整數據集,它是使用 ChatGPT 自動創建的。

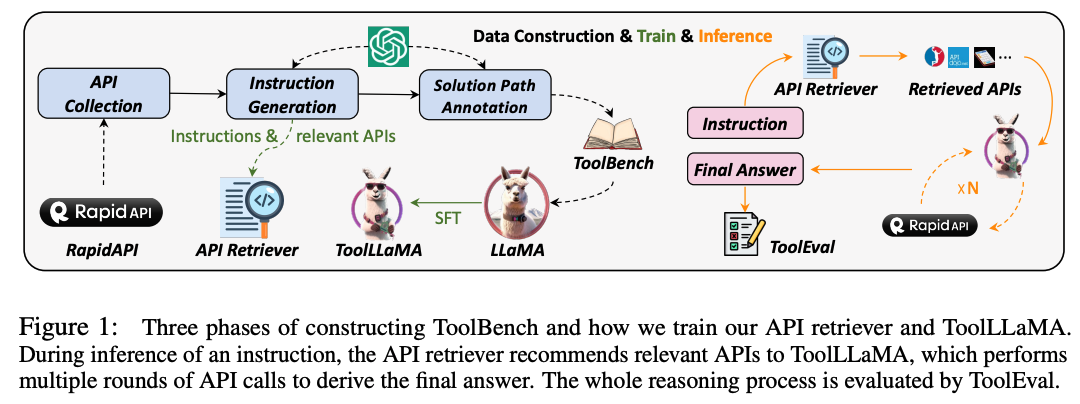

具體來說,我們從 RapidAPI Hub 收集了 16,464 個真實世界的 RESTful API,涵蓋 49 個類別,然后提示 ChatGPT 生成涉及這些 API 的各種人工指令,涵蓋單工具和多工具場景。

最后,我們使用 ChatGPT 為每條指令搜索有效的解決方案路徑(API 調用鏈)。

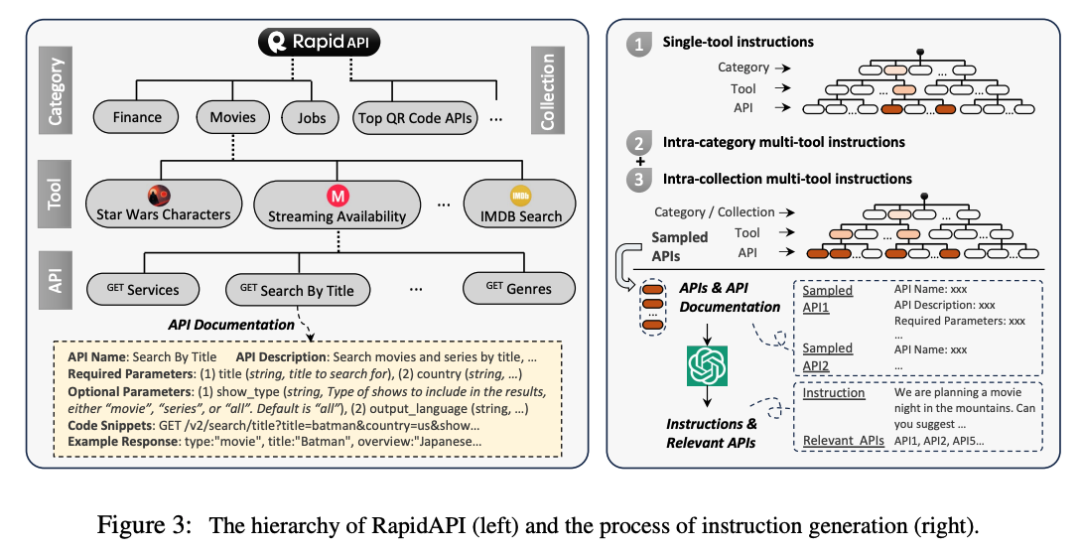

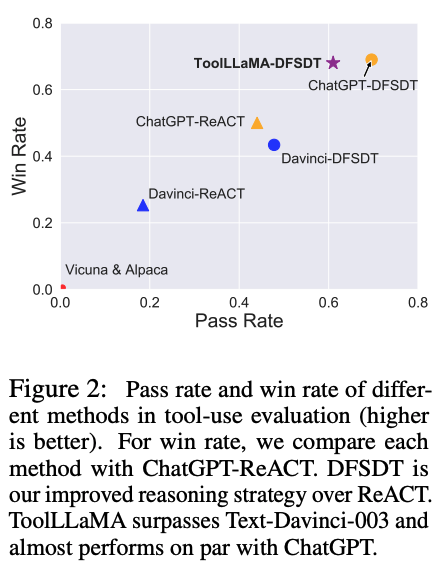

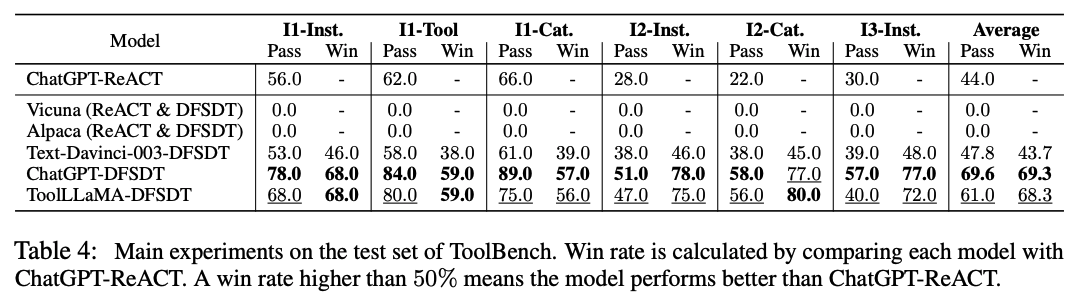

為了使搜索過程更加高效,我們開發了一種新穎的基于深度優先搜索的決策樹(DFSDT),使LLMs能夠評估多個推理軌跡并擴展搜索空間。我們證明 DFSDT 顯著增強了LLMs的規劃和推理能力。

為了有效評估工具使用情況,我們開發了一個自動評估器:ToolEval。

我們在ToolBench上微調LLaMA并獲得ToolLLaMA。

我們的 ToolEval 表明 ToolLLaMA 表現出執行復雜指令和泛化到未見過的 API 的卓越能力,并且表現出與 ChatGPT 相當的性能。

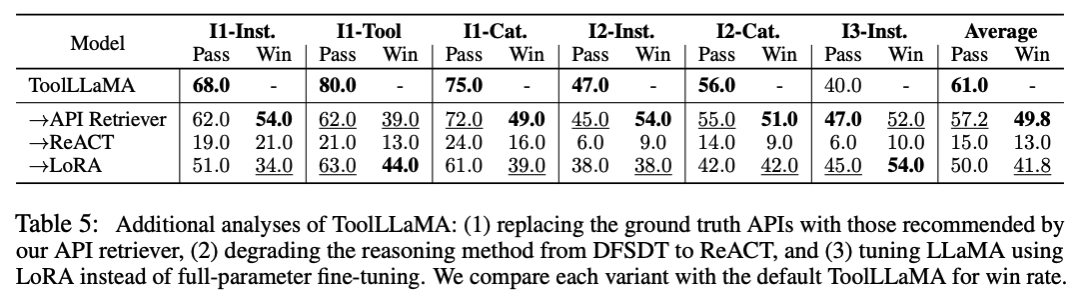

為了使管道更加實用,我們設計了一個神經 API 檢索器來為每條指令推薦合適的 API,從而無需手動選擇 API。

-

數據

+關注

關注

8文章

6892瀏覽量

88828 -

開源

+關注

關注

3文章

3251瀏覽量

42407 -

語言模型

+關注

關注

0文章

506瀏覽量

10245

原文標題:劉知遠等眾多機構提出ToolLLM:促進大型語言模型掌握16000+真實世界的APIs

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

探索高效的大型語言模型!大型語言模型的高效學習方法

【大語言模型:原理與工程實踐】揭開大語言模型的面紗

【大語言模型:原理與工程實踐】大語言模型的基礎技術

【大語言模型:原理與工程實踐】大語言模型的評測

【大語言模型:原理與工程實踐】大語言模型的應用

KT利用NVIDIA AI平臺訓練大型語言模型

淺析AI大型語言模型研究的發展歷程

大型語言模型的應用

如何利用大型語言模型驅動的搜索為公司創造價值

ToolLLM:促進大型語言模型掌握16000+真實世界的APIs

ToolLLM:促進大型語言模型掌握16000+真實世界的APIs

評論