英偉達h800和a100的區別

NVIDIA H800和A100是NVIDIA的兩種不同類型的GPU,具有不同的架構和特點。以下是它們之間的區別:

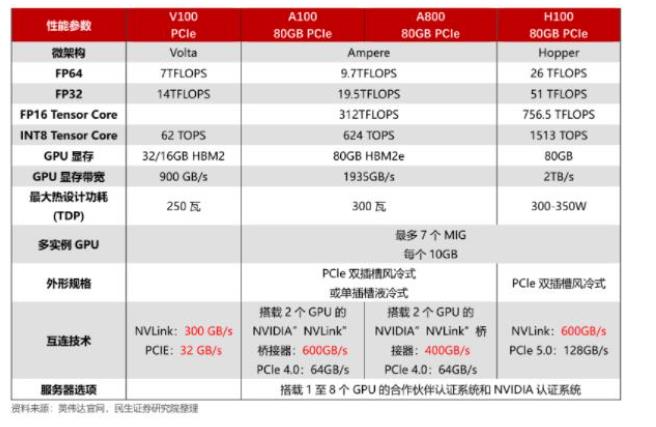

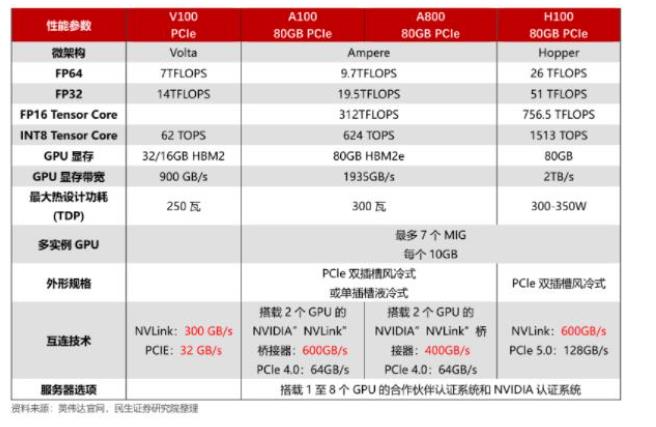

1. 架構:H800使用NVIDIA Volta架構,而A100使用NVIDIA Ampere架構。Ampere架構比Volta架構更先進。

2. 處理器:H800使用16個Volta GPU處理器,A100使用108個Ampere GPU處理器。A100處理器比H800處理器更多,因此更強大。

3. CUDA核心:H800每個處理器有5120個CUDA核心,A100每個處理器有6912個CUDA核心。A100具有比H800更多的CUDA核心,因此具有更高的計算性能。

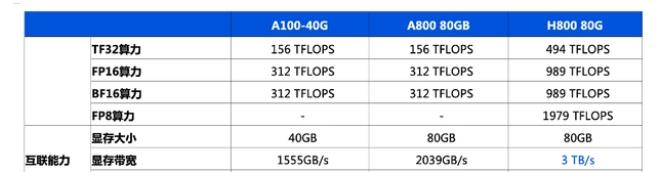

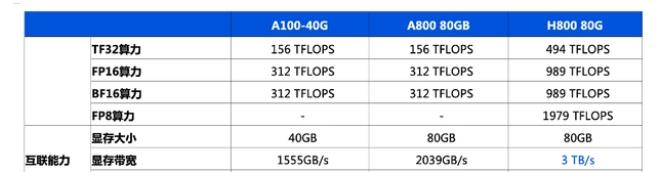

4. 計算性能:H800具有30.4 TFLOPS的雙精度計算性能和120.5 TFLOPS的單精度計算性能,而A100具有19.5 TFLOPS的雙精度計算性能和156 TFLOPS的單精度計算性能。雖然A100的雙精度性能較低,但其單精度性能比H800高。

5. 存儲容量:H800具有16GB HBM2內存,而A100具有40GB或80GB HBM2內存。因此,A100可用的存儲量比H800更大。

6. 適用領域:H800適用于深度學習訓練、科學計算和高性能計算等應用,而A100則專為AI訓練和推理、數據中心、HPC和科學計算等高性能計算應用而設計。

因此,如果您需要進行深度學習方面的應用程序等需要高計算性能的工作,您可以使用英偉達H800。如果您需要進行高性能計算方面的工作,例如AI訓練和推理、HPC和科學計算等方面的工作,則英偉達A100可能更適合您的需求。

NVIDIA H800和A100是NVIDIA的兩種不同類型的GPU,具有不同的架構和特點。以下是它們之間的區別:

1. 架構:H800使用NVIDIA Volta架構,而A100使用NVIDIA Ampere架構。Ampere架構比Volta架構更先進。

2. 處理器:H800使用16個Volta GPU處理器,A100使用108個Ampere GPU處理器。A100處理器比H800處理器更多,因此更強大。

3. CUDA核心:H800每個處理器有5120個CUDA核心,A100每個處理器有6912個CUDA核心。A100具有比H800更多的CUDA核心,因此具有更高的計算性能。

4. 計算性能:H800具有30.4 TFLOPS的雙精度計算性能和120.5 TFLOPS的單精度計算性能,而A100具有19.5 TFLOPS的雙精度計算性能和156 TFLOPS的單精度計算性能。雖然A100的雙精度性能較低,但其單精度性能比H800高。

5. 存儲容量:H800具有16GB HBM2內存,而A100具有40GB或80GB HBM2內存。因此,A100可用的存儲量比H800更大。

6. 適用領域:H800適用于深度學習訓練、科學計算和高性能計算等應用,而A100則專為AI訓練和推理、數據中心、HPC和科學計算等高性能計算應用而設計。

因此,如果您需要進行深度學習方面的應用程序等需要高計算性能的工作,您可以使用英偉達H800。如果您需要進行高性能計算方面的工作,例如AI訓練和推理、HPC和科學計算等方面的工作,則英偉達A100可能更適合您的需求。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

英偉達

+關注

關注

22文章

3743瀏覽量

90831 -

A100

+關注

關注

0文章

27瀏覽量

7784 -

高性能計算

+關注

關注

0文章

82瀏覽量

13374 -

H800

+關注

關注

0文章

9瀏覽量

246

發布評論請先 登錄

相關推薦

英偉達H100芯片市場降溫

隨著英偉達新一代AI芯片GB200需求的不斷攀升,其上一代明星產品H100芯片卻遭遇了市場的冷落。據業內人士透露,搭載H100的服務器通常以8卡的形式進行出售或出租,而在去年,這類服務

英偉達或取消B100轉用B200A代替

今年3月份,英偉達在美國加利福尼亞州圣何塞會議中心召開的GTC 2024大會上推出了Blackwell架構GPU。原定于今年底出貨的B100/B200被寄予厚望,將替代現行H100/

英偉達芯片“倒爺”風光不再,市場熱度降溫

中國的大模型業進入了“百模大戰”時間,英偉達面向中國客戶推出H800,這個版本被俗稱為H100的“閹割版”,英偉

英偉達H200帶寬狂飆

英偉達H200帶寬的顯著提升主要得益于其強大的硬件配置和先進的技術創新。H200配備了高達141GB的HBM3e顯存,與前代產品H100相比

英偉達H200顯卡價格

英偉達H200顯卡的具體價格尚未公布。根據上一代H100顯卡的價格范圍,預計H200的單片價格將超過40000美元。由于新芯片通常定價較高,

英偉達縮短AI GPU交付周期,持續推進算力產業鏈發展

與此同時,隨著人工智能的迅猛發展及其廣泛應用,對像H100和A100這類專為數據中心設計的高性能GPU的需求也大幅增長。而包括Yotta在內的多家公司因此紛紛加大向英偉達的采購力度,導

NVIDIA特供中國的芯片,AI性能大降10%售價依然高

目前NVIDIA最昂貴的A100、H100芯片無法對中國市場出售,此前為中國市場定制的A800、H800芯片也被限制對中國出售,可以對中國出售的為定制化的

英偉達和華為/海思主流GPU型號性能參考

一句話總結,H100 vs. A100:3 倍性能,2 倍價格 值得注意的是,HCCS vs. NVLINK的GPU 間帶寬。 對于 8 卡 A800 和 910B 模塊而言,910B HCCS 的總帶寬為392GB/s

發表于 12-29 11:43

?5429次閱讀

英偉達h800和a100的區別

英偉達h800和a100的區別

評論