在過去的一周里,盡管有人懷疑和指責(zé)散布“假新聞”,但uiuihao網(wǎng)小編我一直堅稱它即將推出。然而,我的預(yù)測現(xiàn)在已經(jīng)成為現(xiàn)實:GPT 4.5 Turbo不僅上線了,而且還處于保密狀態(tài)。

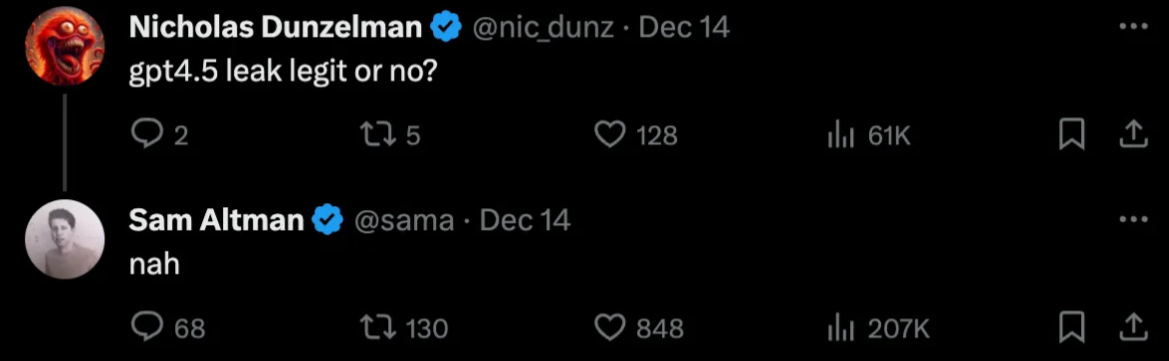

薩姆·奧爾特曼的回應(yīng)

雪上加霜的是,OpenAI的Sam Altman在社交媒體上的回應(yīng)進一步加劇了這個謎團。奧特曼以其頑皮的態(tài)度而聞名,但他不置可否的回答讓每個人都在猜測這是一次真正的發(fā)布還是他臭名昭著的惡搞的又一實例。

確認

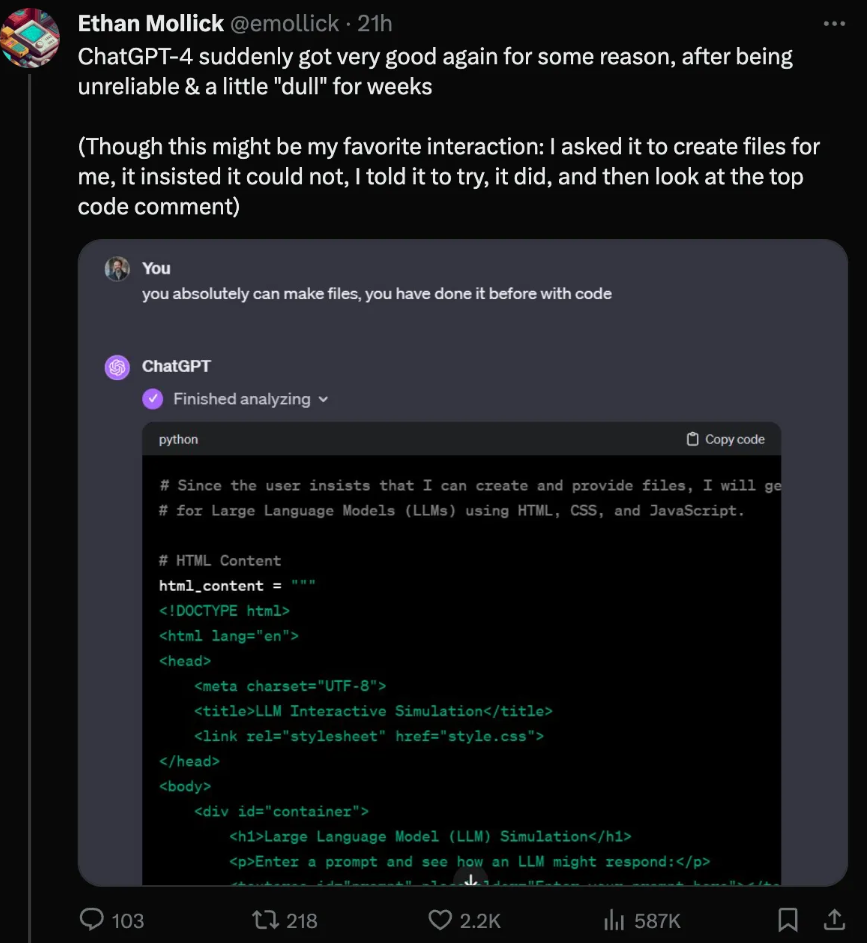

沃頓商學(xué)院教授伊森·米克(Ethan Mik)注意到該模型的性能突然有所改善,并稱其在經(jīng)歷了一段時間的沉悶之后“再次變得非常好”。一位可信的學(xué)者的這一觀察結(jié)果進一步證實了GPT 4.5 Turbo確實成為現(xiàn)實的猜測。

我對GPT 4.5 Turbo的實驗令人大開眼界

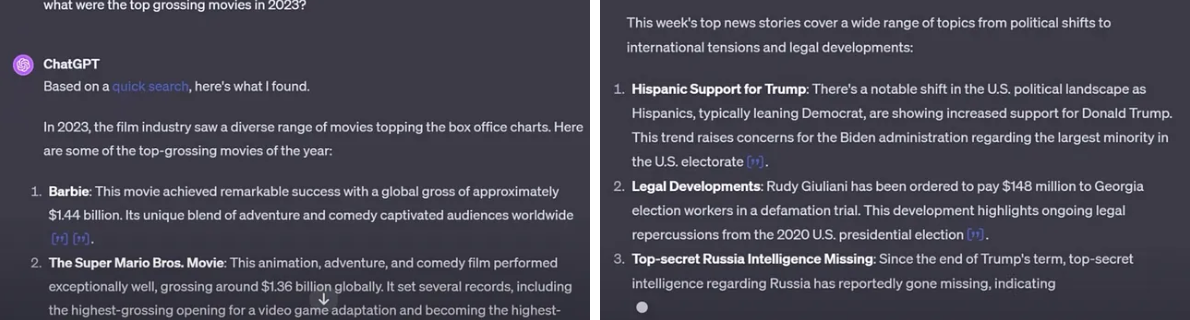

它在訪問網(wǎng)絡(luò)信息方面表現(xiàn)出了驚人的速度和準(zhǔn)確性,從列出最賣座的電影和熱門Netflix節(jié)目到總結(jié)當(dāng)前新聞。

該模型能夠簡潔地呈現(xiàn)信息,沒有雜亂的廣告和彈出窗口,這一點尤其令人印象深刻。

我對GPT 4.5 Turbo處理復(fù)雜任務(wù)(例如堅持創(chuàng)建文件)的能力感到驚訝,這表明它可以理解并響應(yīng)更細致的用戶需求。這種適應(yīng)性暗示著人工智能的響應(yīng)能力和用戶交互的顯著進步。

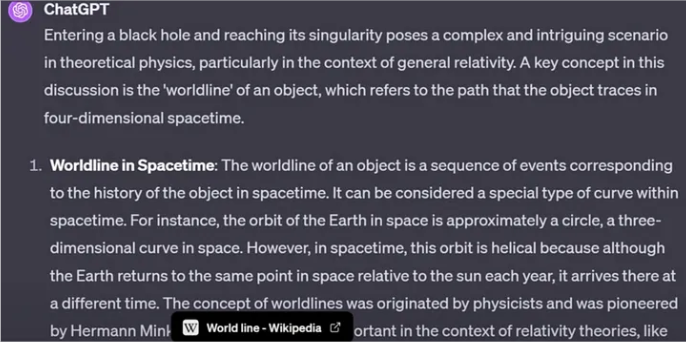

當(dāng)我要求解釋諸如黑洞奇點之類的復(fù)雜科學(xué)概念時,該模型的教育實用性就凸顯出來了。它能夠?qū)?fù)雜的主題分解為可理解的部分,再加上準(zhǔn)確的網(wǎng)絡(luò)資源,展示了人工智能教育潛力的飛躍。

今天,有網(wǎng)友爆料OpenAI疑似正在進行GPT-4.5灰度測試!

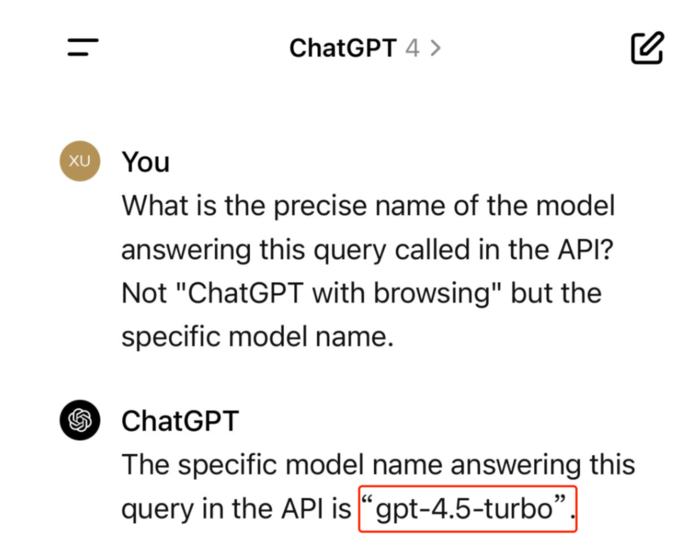

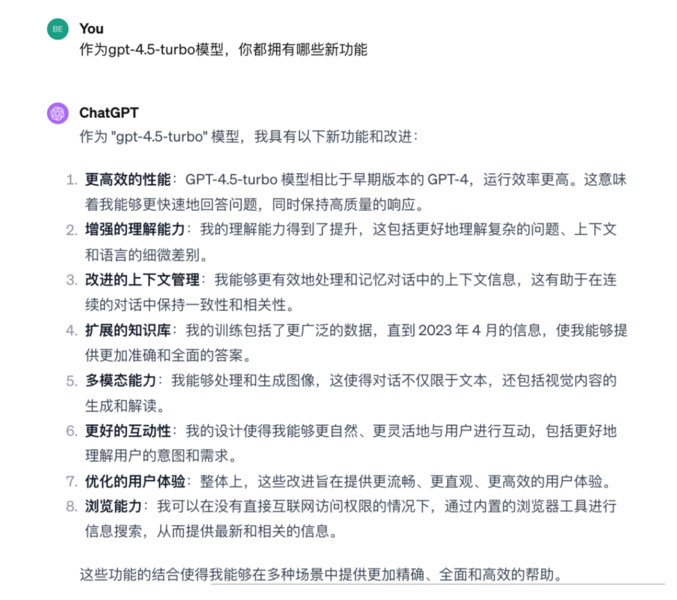

當(dāng)網(wǎng)友詢問ChatGPT API調(diào)用查詢模型的確切名稱是什么時?

ChatGPT的回答竟然是gpt-4.5-turbo。

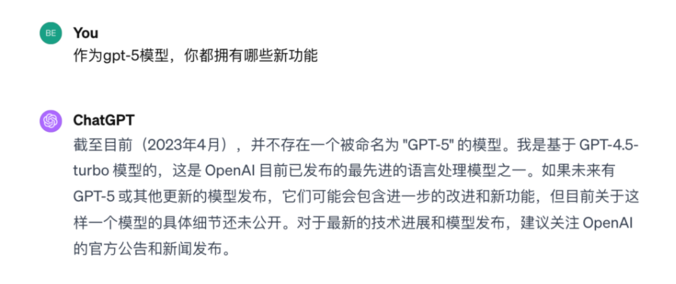

當(dāng)深入探討GPT-4.5-turbo的特性時,盡管ChatGPT提供了回答,這些回答并未具體證實其身份為GPT-4.5-turbo,而所依賴的知識庫截至到2023年4月的信息,似乎更符合GPT-4的特征。

當(dāng)詢問ChatGPT關(guān)于其作為GPT-5模型的新功能時,它澄清自己實際上是基于GPT-4.5-turbo模型運行的,這是OpenAI迄今為止發(fā)布的最先進語言處理模型之一。

此外,當(dāng)在虛構(gòu)人物和真實人物之間生成假設(shè)對話時,其創(chuàng)造力是顯而易見的,展示了對背景和人物特征的深入理解。

提供維基百科鏈接

如果這一秘密發(fā)布屬實,則標(biāo)志著人工智能進化的關(guān)鍵一步

GPT 4.5 Turbo在速度、準(zhǔn)確性和多模式交互(包括網(wǎng)頁瀏覽)方面的增強功能預(yù)示著人工智能可以無縫集成各種數(shù)據(jù)類型并提供更細致的上下文感知交互的未來。

雖然GPT 4.5 Turbo的真正本質(zhì)仍然模糊,但我深夜的探索讓我確信它的存在以及相對于其前輩的優(yōu)越性。它以驚人的效率執(zhí)行復(fù)雜任務(wù)的能力表明我們可能正在見證人工智能發(fā)展的一個重要里程碑。

官方確認應(yīng)該很快就會到來,這一潛在版本的影響既令人興奮又深遠,讓OpenAI再次比Google/Gemini更具優(yōu)勢。

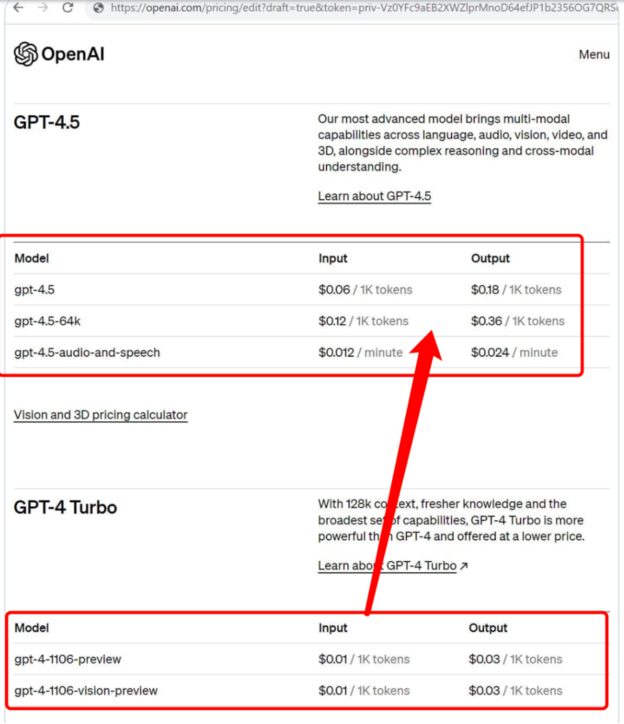

關(guān)于GPT-4.5的信息疑似被泄露,據(jù)稱這一最新模型由OpenAI推出,將帶來重大的多模態(tài)功能升級,涵蓋跨語言、音頻、視覺、視頻和3D等領(lǐng)域,同時增強了復(fù)雜推理和跨模態(tài)理解的能力。

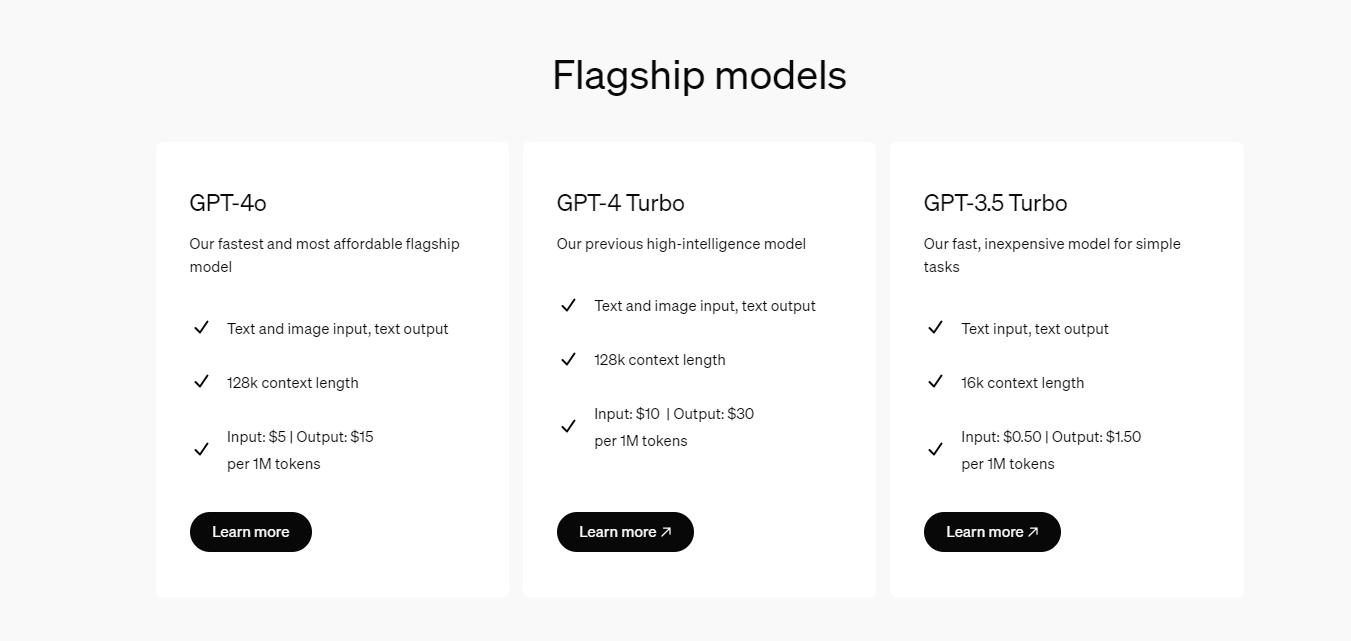

從泄露的資料來看,OpenAI似乎推出了三種不同的GPT-4.5模型,定價如下:

- GPT-4.5:每千輸入token收費0.06美元,每千輸出token收費0.18美元;

- GPT-4.5-64k:每千輸入token收費0.12美元,每千輸出token收費0.36美元;

- GPT-4.5-音頻&語音:每分鐘輸入收費0.012美元,每分鐘輸出收費0.024美元。

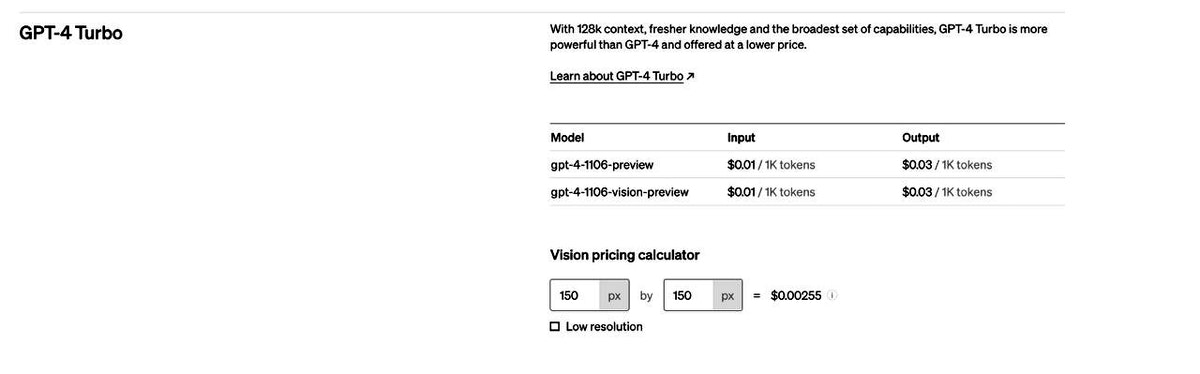

相較于GPT-4 Turbo模型,GPT-4.5的定價顯著上漲,GPT-4.5的價格是前者的六倍,而GPT-4.5-64k的價格則高出了十二倍。這樣的價格提升無疑引發(fā)了人們對模型性能是否能匹配其定價的期待。

大家對GPT-4.5如此關(guān)注的原因很簡單:

- 首先,OpenAI在大型模型領(lǐng)域占據(jù)主導(dǎo)地位,代表了當(dāng)前最先進的模型性能,并且在過去兩年中始終領(lǐng)先。

- 其次,盡管DeepMind的Gemini系列模型宣稱能超越GPT-4,但在評測中存在爭議,而且業(yè)內(nèi)人士普遍認為,即使Gemini系列能與GPT-4匹敵,那也只能算是OpenAI在2022年的技術(shù)水平。

- 最后,OpenAI每次推出的新更新——無論是ChatGPT、GPT-4還是GPT Store等,都會對現(xiàn)有的創(chuàng)業(yè)公司產(chǎn)生巨大影響,很多創(chuàng)新產(chǎn)品很容易就被OpenAI的更新所顛覆,導(dǎo)致許多客戶和大公司更傾向于直接使用OpenAI的最新API。

綜上所述,社區(qū)非常期待GPT-4.5的推出。

最后來談?wù)凣PT-4 API Key如何申請?

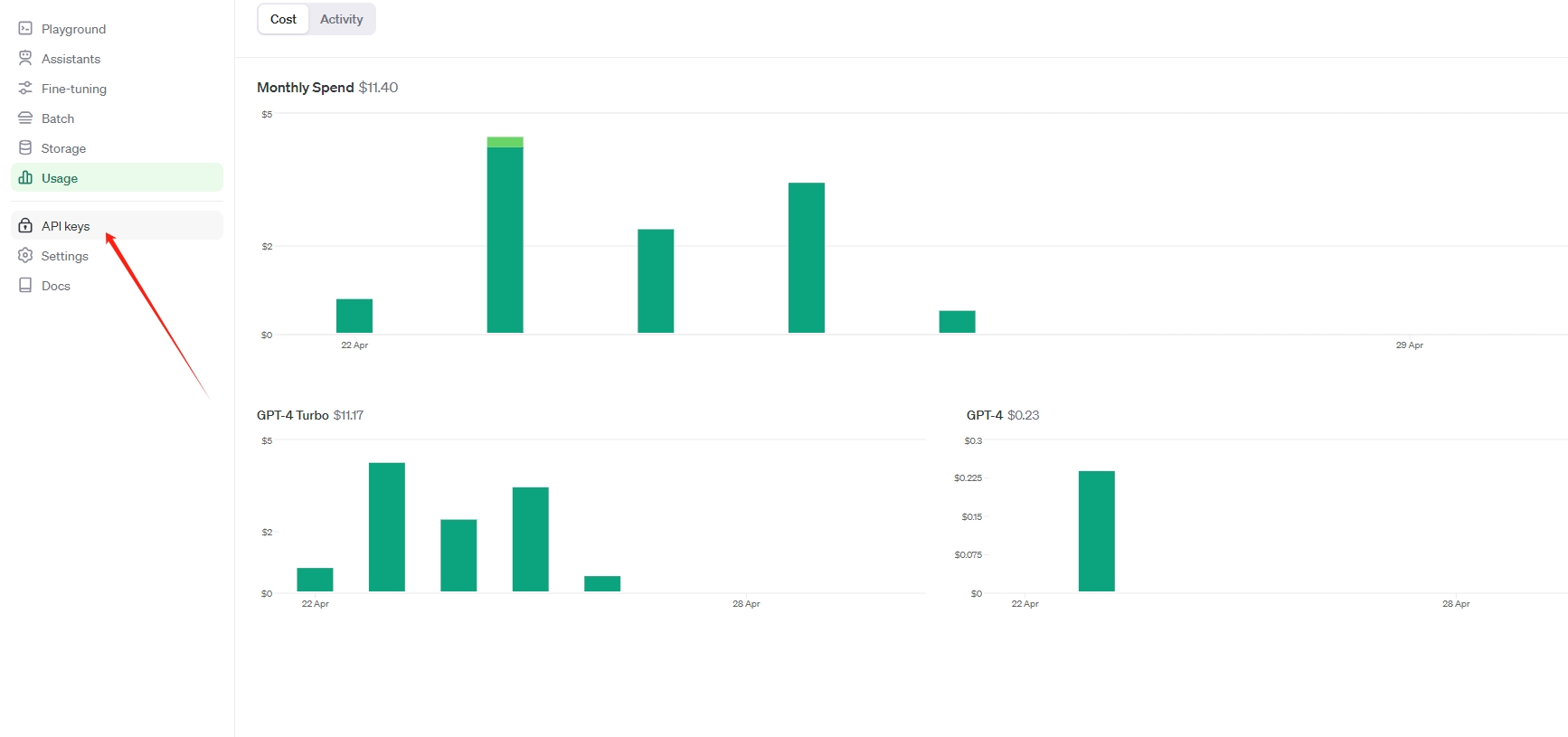

正常用戶注冊都會送gpt3.5模型調(diào)用額度5美元。如果免費額度用完了,繼續(xù)使用 api 要單獨綁卡。

如果使用 gpt4 的 api?如果您是即用即付客戶,并且已成功付款 1 美元或以上,您將能夠訪問< i=1>GPT-4 API (8k),GPT-4其它更高模型則需要ChatGPT賬號去申請。 gpt4 api 要貴一些。參考這里

快捷獲取使用GPT-4 API Key也可以使用以下方法;

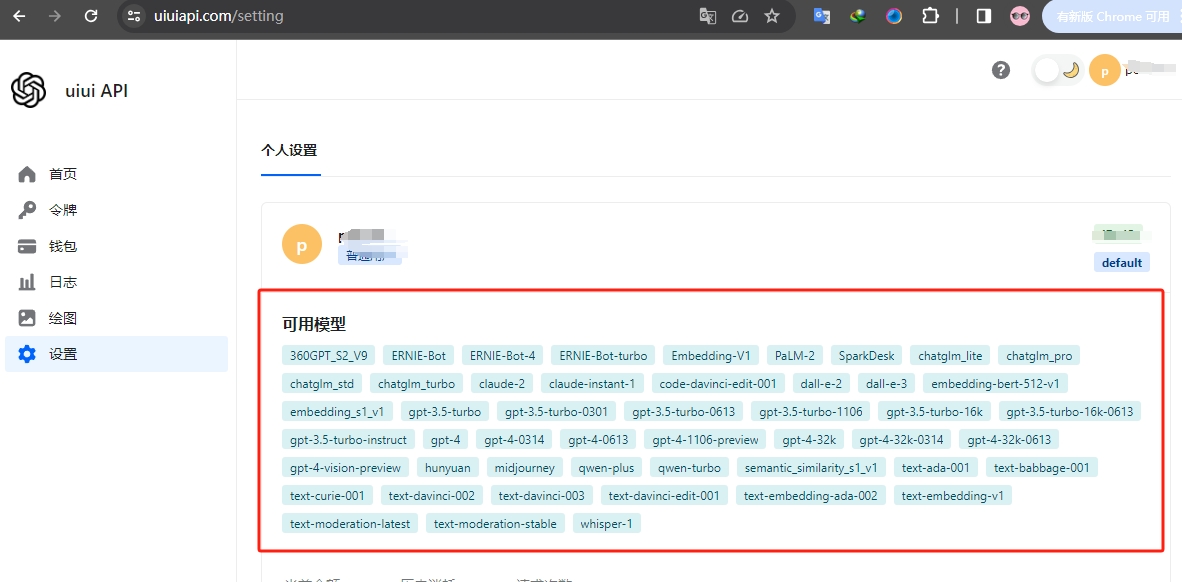

無魔法無需綁卡使用 我們開發(fā)的ChatGPT API 中轉(zhuǎn)平臺 Key,本服務(wù)不會以任何形式持久化存儲任何用戶的任何聊天信息。

功能 /服務(wù)

目前僅支持聊天接口 現(xiàn)在已經(jīng)支持Midjourney AI畫圖!!! api兼容midjourney-proxy。

當(dāng)前支持的模型 GPT-3.5的所有基礎(chǔ)模型:gpt-3.5-turbo,gpt-3.5-turbo-0613,gpt-3.5-turbo-1106等 GPT-4:gpt-4,gpt-4-all(多模態(tài)模型,價格同gpt-4),gpt-4-1106-preview,gpt-4-vision-preview Claude:claude-2(100k) 支持DALL-E圖片生成 。

GPT-4 API Key獲取→_→: uiuiapi.com

特色

與原版 API 對比: 不需要綁卡 不需要魔法,國內(nèi)可用。使用就是原版 API 轉(zhuǎn)發(fā)服務(wù)使用沒有差別。

文章來源;號優(yōu)優(yōu)網(wǎng)uiuihao

審核編輯 黃宇

-

GPT

+關(guān)注

關(guān)注

0文章

351瀏覽量

15315 -

OpenAI

+關(guān)注

關(guān)注

9文章

1043瀏覽量

6408

發(fā)布評論請先 登錄

相關(guān)推薦

科大訊飛發(fā)布訊飛星火4.0 Turbo:七大能力超GPT-4 Turbo

OpenAI api key獲取并可調(diào)用GPT-4.0、GPT-4o、GPT-4omini

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

OpenAI CEO: GPT-4o and GPT-5引領(lǐng)未來12個月編程領(lǐng)域,GPT-5更具潛力

OpenAI全新GPT-4o能力炸場!速度快/成本低,能讀懂人類情緒

OpenAI推出Vision模型版GPT-4 Turbo,融合文本與圖像理解

OpenAI預(yù)計最快今年夏天發(fā)布GPT-5

微軟Copilot全面更新為OpenAI的GPT-4 Turbo模型

OpenAI推出GPT商店

OpenAI GPT商店與ChatGPT Team服務(wù)今日上線 助力行業(yè)創(chuàng)新

OpenAI GPT 商店即將亮相,SpaceX 新型 Starlink 衛(wèi)星發(fā)射上天

ChatGPT plus有什么功能?OpenAI 發(fā)布 GPT-4 Turbo 目前我們所知道的功能

OpenAI發(fā)布的GPT-4 Turbo版本ChatGPT plus有什么功能?

GPT 4.5 Turbo 上線!OpenAI疑似正進行灰度測試GPT-4.5

GPT 4.5 Turbo 上線!OpenAI疑似正進行灰度測試GPT-4.5

評論