新年伊始,OpenAI Sora 橫空出世,聲稱是“作為世界模擬的視頻生成模型”(Video generation models as world simulators),讓“世界模型”這一概念再次進入人們的視野。那么什么是世界模型?Sora 到底是不是 world simulator 呢?南京大學人工智能學院教授俞揚近日撰文溯源了世界模型(world model)的概念,認為世界模型的核心作用是反事實推理,而 Sora 更多是視頻工具,難以作為反事實推理的工具準確回答 what if 問題。Sora沒有準確學到物理規律這一現象或許表明,簡單的堆砌數據并不是通向更高級智能技術的道路。

俞揚 | 作者

隨著媒體狂炒 Sora,OpenAI的介紹材料中稱Sora是 “world simulator”,世界模型這個詞又進入視野,但很少有文章來介紹世界模型。這里回顧一下什么是世界模型,以及討論 Sora 是不是 world simulator。

什么是世界模型

當AI領域中講到 世界/world、環境/environment 這個詞的時候,通常是為了與 智能體/agent 加以區分。研究智能體最多的領域,一個是強化學習,一個是機器人領域。因此可以看到,world models、world modeling 最早也最常出現在機器人領域的論文中。而今天world models這個詞影響最大的,可能是Jurgen 2018年放到arxiv的這篇以“world models”命名的文章,該文章最終以 “Recurrent World Models Facilitate Policy Evolution”的title發表在NeurIPS‘18。

論文題目:Recurrent World Models Facilitate Policy Evolution

論文地址:

https://worldmodels.github.io/

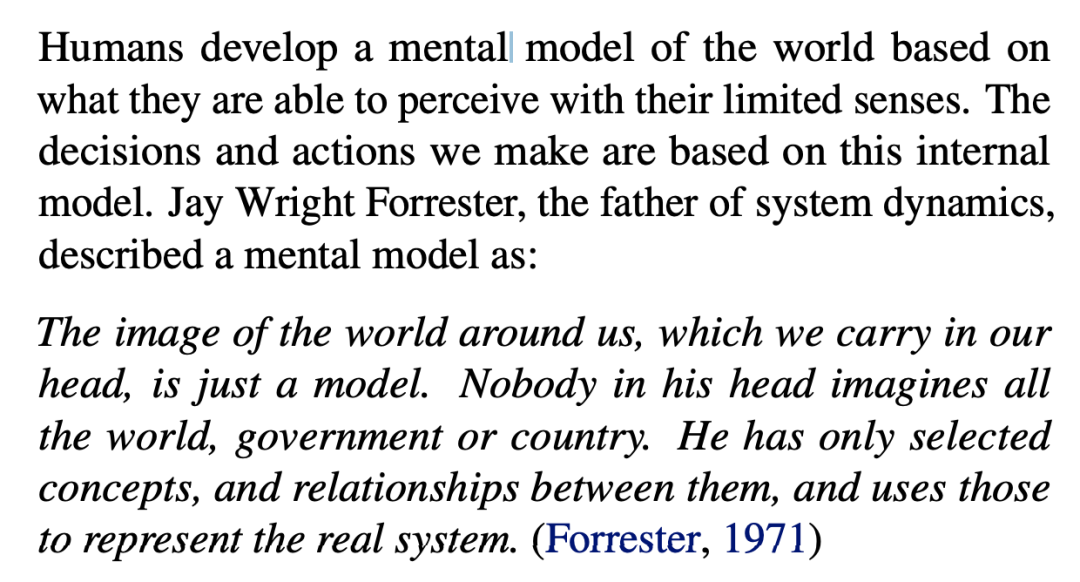

該論文中并沒有定義什么是World models,而是類比了認知科學中人腦的mental model,引用了1971年的文獻。

mental model是人腦對周邊世界的鏡像

Wikipedia 中介紹的 mental model,很明確的指出其可能參與認知、推理、決策過程。并且說到 mental model 主要包含 mental representations 和 mental simulation 兩部分。

an internal representation of external reality, hypothesized to play a major role incognition, reasoning and decision-making. The term was coined by Kenneth Craik in 1943 who suggested that the mind constructs "small-scale models" of reality that it uses to anticipate events.

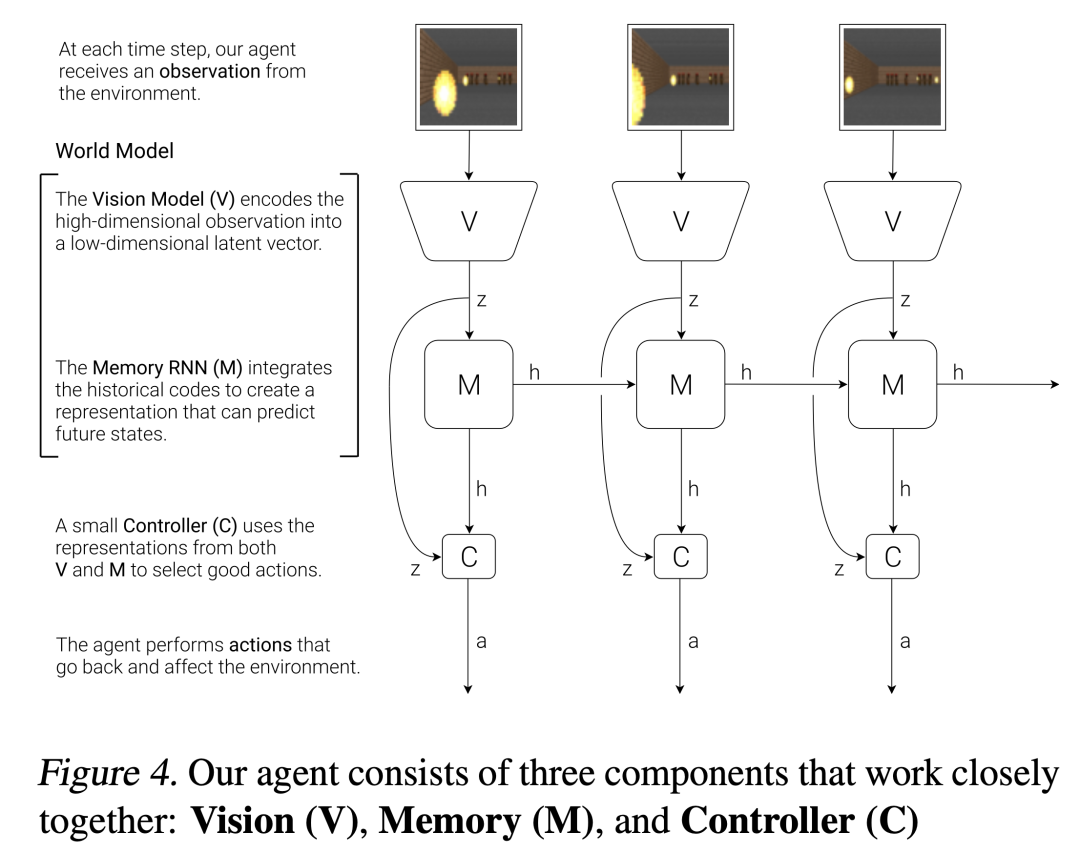

到這里還是說得云霧繚繞,那么論文中的結構圖一目了然的說明了什么是一個world model:

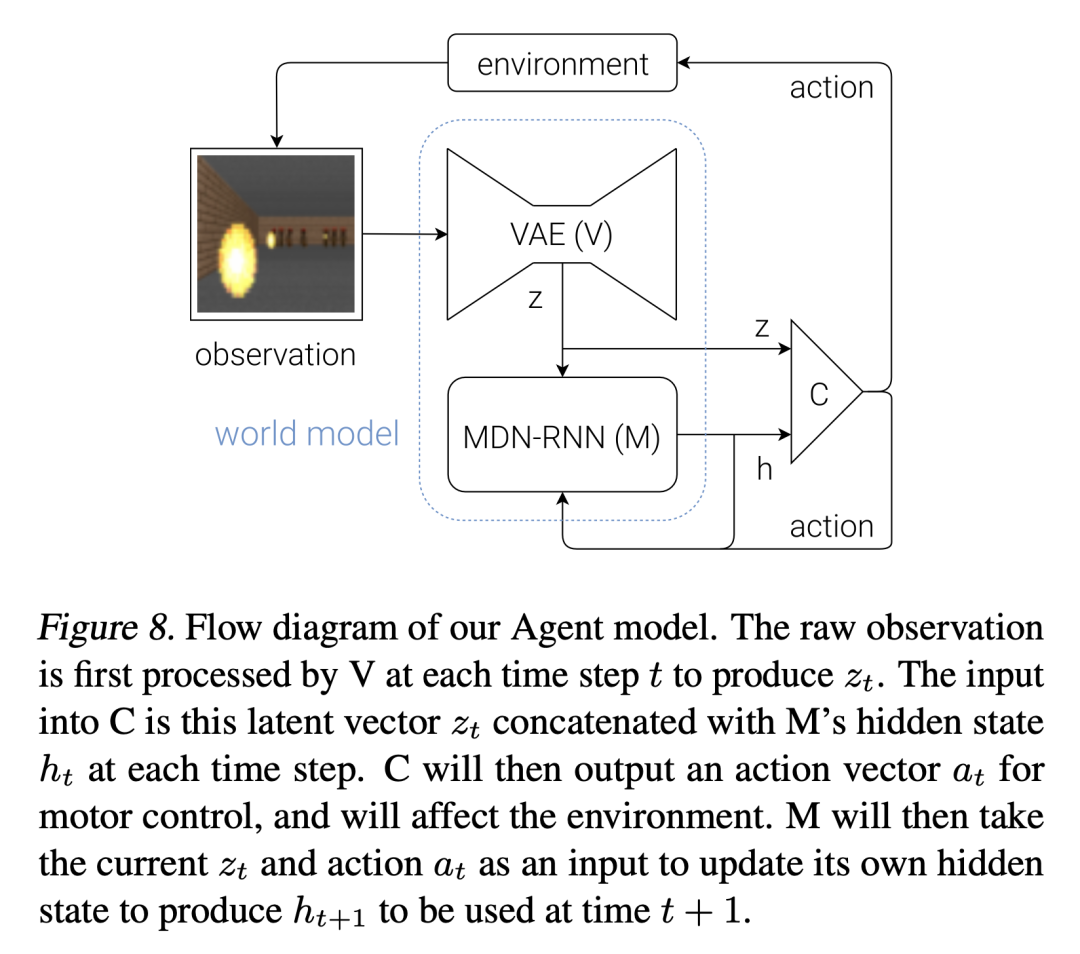

圖中縱向V->z是觀測的低維表征,用VAE實現,水平的M->h->M->h是序列的預測下一個時刻的表征,用RNN實現,這兩部分加起來就是World Model。

也就是說,World model 主要包含狀態表征和轉移模型,這也正好對應mental representations 和 mental simulation。

看到上面這張圖可能會想,這不是所有的序列預測都是world model了?其實熟悉強化學習的同學能一眼看出來,這張圖的結構是錯誤(不完整)的,而真正的結構是下面這張圖,RNN的輸入不僅是z,還有動作action,這就不是通常的序列預測了(加一個動作會很不一樣嗎?是的,加入動作可以讓數據分布自由變化,帶來巨大的挑戰)。

Jurgen的這篇論文屬于強化學習領域。那么,強化學習里不是有很多model-based RL嗎,其中的model跟world model有什么區別?答案是沒有區別,就是同一個東西。Jurgen先說了一段:

基本意思就是,不管有多少model-based RL工作,我是RNN先驅,RNN來做model是我發明的,我就是要搞。

在Jurgen文章的早期版本中,還說到很多 model-based RL,雖然學了model,但并沒有完全在model中訓練RL。

沒有完全在model中訓練RL,實際上并不是model-based RL的model有什么區別,而是model-based RL這個方向長久以來的無奈:model不夠準確,完全在model里訓練的RL效果很差。這一問題直到近幾年才得到解決。

編注:強化學習算法可以分為無模型(model-free)強化學習與有模型(model-based)強化學習,后者中的模型也被稱為世界模型(World model)。在基于世界模型的強化學習方法中,智能體首先學習一個關于環境的內嵌的模型,在內嵌的模型中學習行為決策,從而提高在真實環境中的表現。

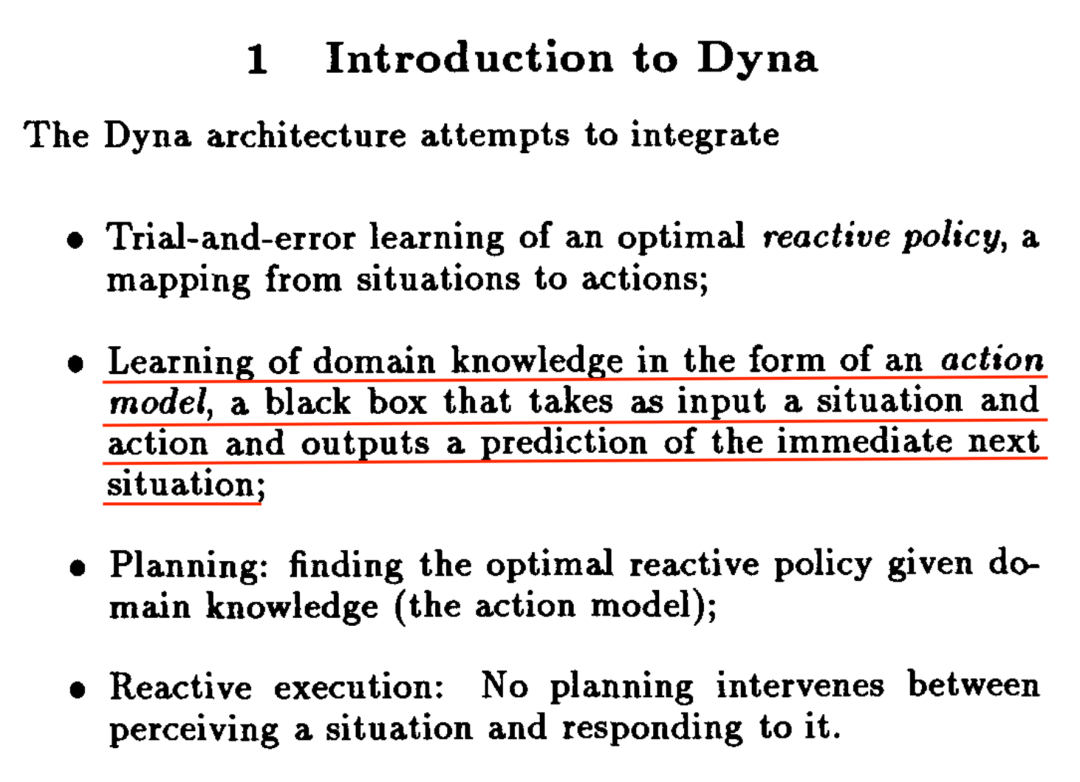

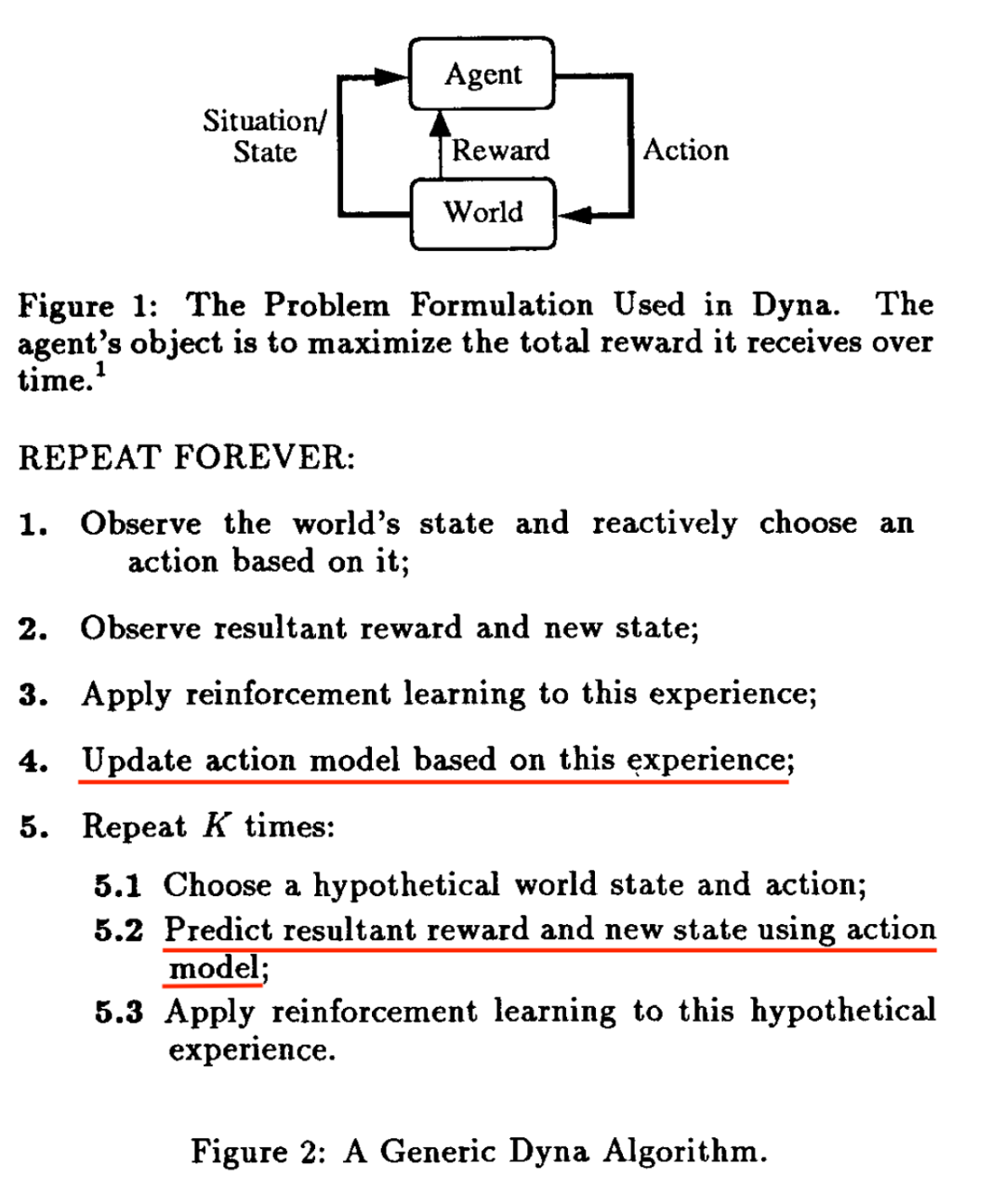

聰明的Sutton在很久以前就意識到model不夠準確的問題。在1990年提出Dyna框架的論文 Integrated Architectures for Learning, Planning and Reacting based on Dynamic Programming(發表在第一次從workshop變成conference的ICML上),管這個 model 叫 action model,強調預測action執行的結果。RL一邊從真實數據中學習(第3行),一邊從model中學習(第5行),以防model不準確造成策略學不好。

論文題目:Integrated Architectures for Learning, Planning and Reacting based on Dynamic Programming

論文地址:https://dl.acm.org/doi/10.1145/122344.122377

可以看到,world model對于決策十分重要。如果能獲得準確的world model,那就可以通過在world model中反復試錯,找到現實最優決策。

這就是 world model 的核心作用:反事實推理/Counterfactual reasoning, 也就是說,即便對于數據中沒有見過的決策,在world model中都能推理出決策的結果。

了解因果推理的同學會很熟悉反事實推理這個詞,在圖靈獎得主Judea Pearl的科普讀物The book of why中繪制了一副因果階梯:

最下層是“關聯”,也就是今天大部分預測模型主要在做的事;

中間層是“干預”,強化學習中的探索就是典型的干預;

最上層是“反事實”,通過想象回答 what if 問題。

Judea為反事實推理繪制的示意圖,是科學家在大腦中想象,這與Jurgen在論文中用的示意圖異曲同工。

上:Jurgen論文中的世界模型示意圖。下:Judea書中的因果階梯。

到這里我們可以總結,AI研究人員對world model的追求,是試圖超越數據,進行反事實推理,回答what if問題能力的追求。這是一種人類天然具備,而當前的AI還做得很差的能力。一旦產生突破,AI決策能力會大幅提升,實現全自動駕駛等場景應用。

Sora 是不是 world simulator

simulator這個詞更多出現在工程領域,其作用與world model一樣,嘗試那些難以在現實世界實施的高成本高風險試錯。OpenAI似乎希望重新組成一個詞組,但意思不變。

Sora生成的視頻,僅能通過模糊的提示詞引導,而難以進行準確的操控。因此它更多的是視頻工具,而難以作為反事實推理的工具去準確的回答what if問題。

甚至難以評價Sora的生成能力有多強,因為完全不清楚demo的視頻與訓練數據的差異有多大。

更讓人失望的是,這些demo呈現出Sora并沒有準確地學到物理規律。已經看到有人指出了Sora生成視頻中不符合物理規律之處。(OpenAI 發布文生視頻模型 Sora,AI 能理解運動中的物理世界,這是世界模型嗎?意味著什么?https://www.zhihu.com/question/644478663/answer/3398992400)

我猜測OpenAI放出這些demo,應該基于非常充足的訓練數據,甚至包括CG生成的數據。然而即便如此那些用幾個變量的方程就能描述的物理規律還是沒有掌握。OpenAI認為Sora證明了一條通往simulators of the physical world的路線,但看起來簡單的堆砌數據并不是通向更高級智能技術的道路。

審核編輯:黃飛

-

機器人

+關注

關注

210文章

28201瀏覽量

206517 -

AI

+關注

關注

87文章

30136瀏覽量

268411 -

Sora

+關注

關注

0文章

76瀏覽量

190

原文標題:Sora為什么不是世界模型?

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Sora與世界模型:為何它未能成為全面代表?

Sora與世界模型:為何它未能成為全面代表?

評論