趁著AI浪潮,手機廠商爭先搶灘AI手機領域,智能手機開始步入AI新時代。AI手機不需要借助第三方App,而是通過手機自身的算力,直接成為用戶的智能助手。但手機的AI應用能有多少,是否只是手機廠商為促進銷量的營銷噱頭,AI手機會不會重蹈折疊屏的覆轍目前還有待商榷。

各手機廠商發展AI的策略和產品

市場上已有AI手機在售,三星、華為、小米、OPPO、vivo、榮耀都推出了自家的旗艦AI手機,AI附加圍繞“AI芯片+AI智能系統+AI開放生態”三個賦能。

三星Galaxy S24:搭載了高通驍龍8 Gen3處理器,內置了強大的AI芯片,與谷歌合作搭載了Gemini AI大模型。其AI功能不僅限于拍照優化和語音識別,還深入到了系統層面,如智能管理電池壽命、優化應用程序性能等。Galaxy S24還引入了先進的AI攝影技術,如AI場景識別、AI超分辨率等,為用戶帶來出色的拍照體驗。

華為Mate60 Pro:使用了華為自研的麒麟系列芯片,內置了強大的AI處理能力,并搭載了盤古大模型,具備新一代NPU神經網絡處理器,可以直接連接華為云端的AI大模型,為本地的照片增強畫質,“AI云增強”功能。

小米手機14:小米自研AI大模型,可以在手機上離線使用“文生圖”、“AI擴圖”與“AI擦除”功能。小愛AI大模型同時深入融合小米澎湃OS系統,已經構建了多項AI賦能。搭載了高通驍龍處理器,內置了強大的AI芯片。小米14在拍照、語音識別、智能推薦等方面都有出色的表現。此外,小米還通過AI技術優化了手機的性能和續航,為用戶帶來更加流暢和持久的體驗。

還有其他本文不多加贅述,感興趣的朋友可以自行搜索。對比6款AI手機,可以發現手機的智能化應用比較單一和局限,更多的是體現在智能助手服務和圖片上,最常見的智能語音助手、AI攝影/拍照、AI翻譯、手機性能的AI智能優化。

手機AI多為端側AI,應用側重于推理運算

云是云計算,邊是邊緣計算,端是設備端也就是我們常說的終端。很多生成式AI應用都跑在云端,但如果應用場景是人們時常接觸的設備,那數據跑在端側會更高效。

用手機人臉識別舉個例子,手機攝像拍照之后把圖像傳到CPU,然后CPU調用本地AI做數據處理,從而實現人臉匹配,再根據結果進行開鎖、報警等動作執行。整個Al的過程都在設備端,不用連接云,也不用連接邊緣。

對于AI手機而言,端側AI有很多好處,因為不用聯網可以在本地運行,不到云上處理且不受網絡限制,所以速度快且低功耗。最重要的是數據不上傳到云端,就不用擔憂隱私問題,相對而言安全很多。

AMD CEO蘇姿豐說過,未來大模型推理市場的規模將遠遠大于模型訓練市場,把AI手機市場帶入進來就很好理解了。華米OV這些頭部手機廠商已然在AI大模型賽道集結,華為有盤古大模型,小米有AI大模型MiLM-6B,OPPO有安第斯大模型(AndesGPT),vivo也有藍心大模型BlueLM,榮耀有基本上這些已經訓練好的大模型會植入到每部手機上,每個用戶喂給手機的數據和習慣將基于手機廠商的大模型進行,因此用戶對于AI的應用大多側重于推理。

NPU在AI手機的異構處理器中更加普遍

蘋果在2017年率先在A11芯片組中引入NPU;華為于2018年將NPU嵌入到其麒麟970 SoC中;高通在800系列芯片組逐漸強化AI引擎;聯發科、三星也將NPU集成到產品中。

手機處理器SoC集成NPU變得普遍,并將NPU用于加速卷積神經網絡、循環神經網絡等深度學習運算,高效執行大規模并行矩陣乘法和向量運算,提高在圖像識別、語音識別、自然語言處理等方面的性能。

IDC資料顯示,下一代AI手機處理器SoC更快更高效運行生成式AI的模型,滿足Stable Diffusion和各種LLM用例,NPU性能至少要求30 TOPS。

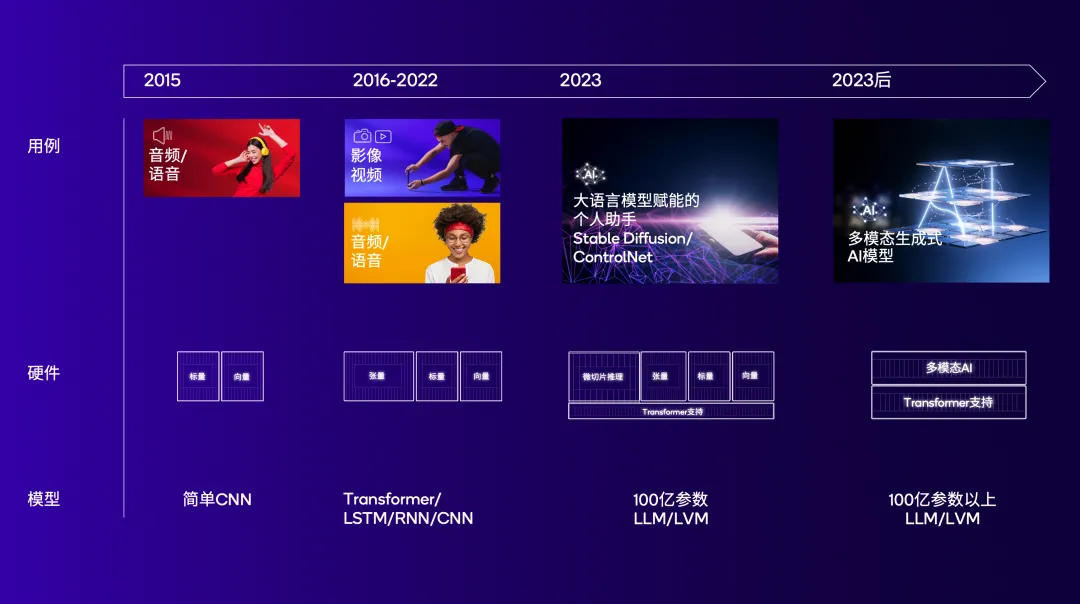

圖注:NPU隨著不斷變化的AI用例持續演進(圖源:高通)NPU結構、指令集和緩存針對高效運行神經網絡算法而優化,因此,在AI手機這樣的資源有限且對功耗敏感的平臺上,通常由NPU作為主要的AI計算單元,能夠更好地平衡性能與能耗之間的關系,并為用戶提供更佳AI體驗。

此外,許多AI應用需要快速響應用戶請求,進行實時推理和決策,NPU在處理小到中等規模的神經網絡模型時,通常能夠提供更低延遲的服務,滿足實時性要求。

集成NPU的處理器、NPU IP的例子包括:

高通Hexagon NPU,面向以低功耗實現持續穩定的高性能AI推理而設計,可通過定制設計NPU并控制指令集架構(ISA),快速進行設計演進和擴展,解決瓶頸問題并優化性能。驍龍8 Gen3采用的高通AI引擎就包含Hexagon NPU。

芯原VIP9000系列NPU IP,提供可擴展和高性能的處理能力,適用于Transformer和卷積神經網絡(CNN)。芯原聲稱,集成了芯原神經網絡處理器(NPU)IP的人工智能(AI)類芯片已在全球范圍內出貨已經超過1億顆。

瑞芯微在過去幾年已經迭代了4代NPU的IP,不斷提升對神經網絡模型的支持、效率,形成人工智能技術上良好的基礎。2023年半年報顯示,其自研的NPU已經滿足基于Transformer架構的大模型需求,形成人工智能技術上良好的基礎。

AI算力需求或推動手機存儲器件升級

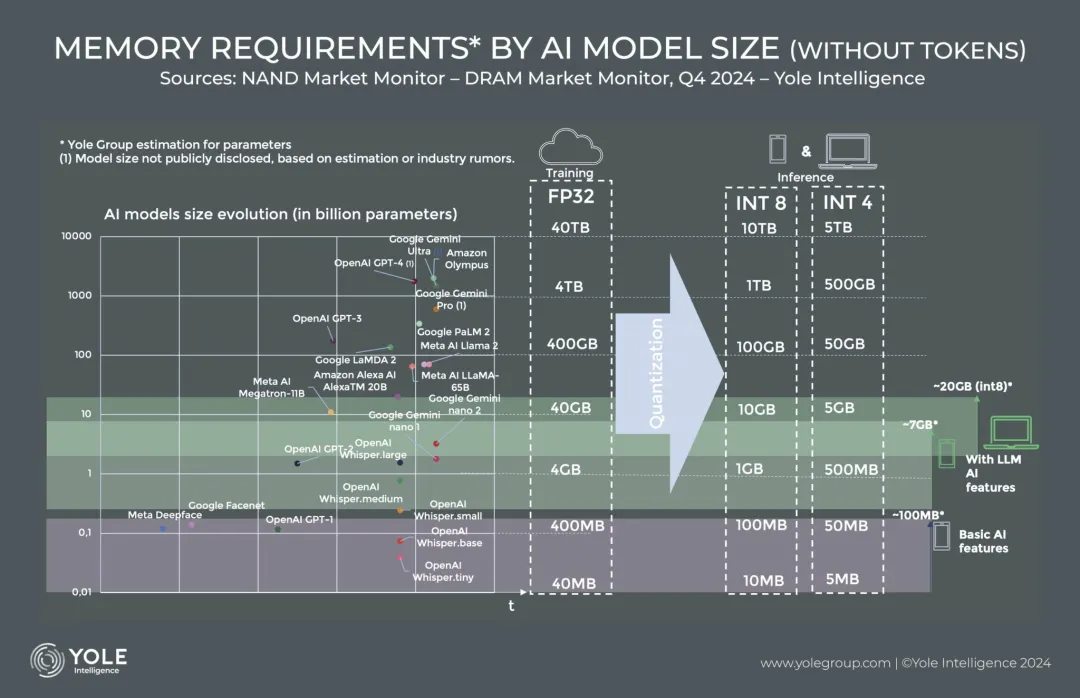

當前的基本AI功能在移動設備上使用大約100MB的內存,但基于LLM的功能可能需要高達7GB的額外DRAM。16GB DRAM被認為是下一代AI智能手機的最低要求。在擴大存儲容量的同時,減少內存占用的技術(比如參數量化)對于縮小在數據中心訓練的大型模型,使其適用于諸如手機的便攜設備是必要的。另一個減小LLM規模的方法是將數據類型遷移到INT8,雖然降低推理精度,但能解決硬件限制問題。手機制造商正在尋找更多實現LLM的方法,降低額外內存需求產生的成本。機構YOLE預計,高端Android機型和iPhone可能在2024年和2025年率先添加更多DRAM和AI功能。16GB的高端智能手機足以滿足7B參數LLM,較小的LLM可能能夠在12GB的設備上運行。然而,在人工智能采用周期的早期階段,LLM將在多大程度上增加內存需求還有待確定。

圖注:AI模型大小影響手機、PC存儲的容量和數據類型(圖源:YOLE)AI手機對NAND存儲器的影響預計相對有限。AI使用NAND存儲模型參數,以及與智能手機上所有文件相關的元數據。AI應用生成的內容所需的額外存儲量沒有確定的大小,但可能會加速低存儲容量配置手機的淘汰。還要指出的是,延遲是AI應用性能的關鍵,較大的模型需要更快的存儲接口,生成式AI在手機的應用可能會加速采用最先進的存儲器類型和接口標準。一個產品例子是,榮耀最新旗艦AI智能手機榮耀Magic6 Pro利用美光的UFS 4.0接口標準移動閃存、低功耗雙倍數據速率5X(LPDDR5X)內存,支持70億參數的MagicLM的大型語言模型。

小結

AI手機是智能手機產業技術進步與市場需求相結合的產物,AI技術將進一步融入到手機的拍照、語音識別、手勢控制、個性化推薦等功能中,用于提升用戶體驗,更精準理解和滿足用戶的個性化需求。圍繞AI手機的硬件軟件創新將持續,有望將AI技術延伸到電池管理、網絡連接、安全防護等更加廣泛的手機應用場景中。

審核編輯 黃宇

-

芯片

+關注

關注

453文章

50387瀏覽量

421783 -

AI

+關注

關注

87文章

30106瀏覽量

268399 -

ai手機

+關注

關注

0文章

43瀏覽量

3240

發布評論請先 登錄

相關推薦

探索智能手機上的生成式AI

手機行業AI競賽步入新階段:從顛覆到體驗提升

AI時代CMO的營銷困惑,迎刃而解

CeMeta森宇宙攜三大AI營銷產品亮相AWE 2024

三星手機AI功能將收費?AI手機是噱頭還是未來?

一加創始人內部講話曝光 劉作虎稱AI手機不是噱頭

NanoEdge AI的技術原理、應用場景及優勢

OPPO發布1+N 智能體生態戰略,聯發科攜手OPPO打造AI手機生態

OPPO公布全新AI戰略,AI 手機時代再提速

靈動AI與百度共拓生成式AI生態,共建行業營銷解決方案

智能硬件 | AI手機是營銷噱頭嗎?對哪些行業利好?

智能硬件 | AI手機是營銷噱頭嗎?對哪些行業利好?

評論