GPU在人工智能中相當于稀土金屬,甚至黃金,它們在當今生成式人工智能時代中的作用不可或缺。那么,為什么GPU在人工智能發展中如此重要呢?

什么是GPU

圖形處理器(GPU)是一種通常用于進行快速數學計算來渲染圖形和圖像的計算機芯片專業和個人計算。最初,GPU負責渲染2D和3D圖像、動畫和視頻,但現在它們的應用范圍更廣,尤其在人工智能領域。

GPU應用

具有嵌入式或離散GPU的電子設備能夠流暢地渲染3D圖形和視頻內容,非常適用于人工智能視覺應用。現代可編程GPU也適用于更廣泛的場景,一些常見應用包括:加速實時2D和3D圖形應用的渲染;視頻編輯和視頻內容創建,視頻游戲圖形,加速圖像識別、面部檢測和識別等機器學習應用,訓練深度學習神經網絡。

GPU如何工作

GPU通過使用并行處理的方法工作,多個處理器處理單個任務的不同部分。GPU還有單獨的內存用于存儲正在處理的數據。這種內存專門設計用于容納大量的信息,以應對高度密集的圖形使用情況。

對于圖形應用程序,CPU向GPU發送指令以在屏幕上繪制圖形內容。GPU以并行和高速的方式執行指令,將內容顯示在設備上,這個過程被稱為圖形或渲染流水線。

GPU與CPU:哪個更適合人工智能?

GPU包含數百個或數千個核心,其晶體管比CPU還多,可以進行并行計算和快速的圖形輸出。

由于其更快的時鐘速度和較少的核心,CPU更適合處理日常的單線程任務,而不是人工智能工作負載。而GPU則處理更復雜的數學和幾何計算。這意味著GPU在人工智能訓練和推理方面能夠提供更高的性能,同時也可以受益于各種加速計算負載。

為什么GPU對于當今的人工智能如此重要?

在人工智能領域,GPU發揮著重要作用,為人工智能的訓練和推理提供了出色的性能,在需要加速計算的各種應用中也提供了顯著的優勢。

GPU的關鍵功能有3個:

GPU并行處理

人工智能模型主要由層層疊加的線性代數方程組成。每個方程反映了一組數據與另一組數據之間的關聯可能性。GPU包含數千個核心,這些微小的計算器并行工作,分片處理構成人工智能模型的計算,為人工智能工作負載提供高效的計算能力。此外,GPU核心不斷升級以滿足人工智能模型的不斷變化需求。

模型復雜性和系統擴展

人工智能模型的復雜性以每年10倍的速度增長。前沿大型語言模型(LLM)GPT-4包含超過一萬億個參數,其數學密度令人矚目。GPU系統通過有效的協作巧妙地應對了這一挑戰。它們輕松擴展到超級計算級別,利用快速的NVLink互連和強大的Quantum InfiniBand網絡。

廣泛而深入的GPU軟件堆棧

自2007年以來,不斷擴大的英偉達(NVIDIA) GPU軟件已經涵蓋了人工智能的各個方面,從高級功能到高級應用。CUDA編程語言和cuDNN-X深度學習庫為開發人員構建軟件提供了基礎,例如NVIDIA NeMo。它使用戶能夠創建、配置和推理自己的生成式人工智能模型。其中許多元素都可作為開源軟件提供,這對軟件開發人員來說是必不可少的。

GPU對人工智能發展的貢獻

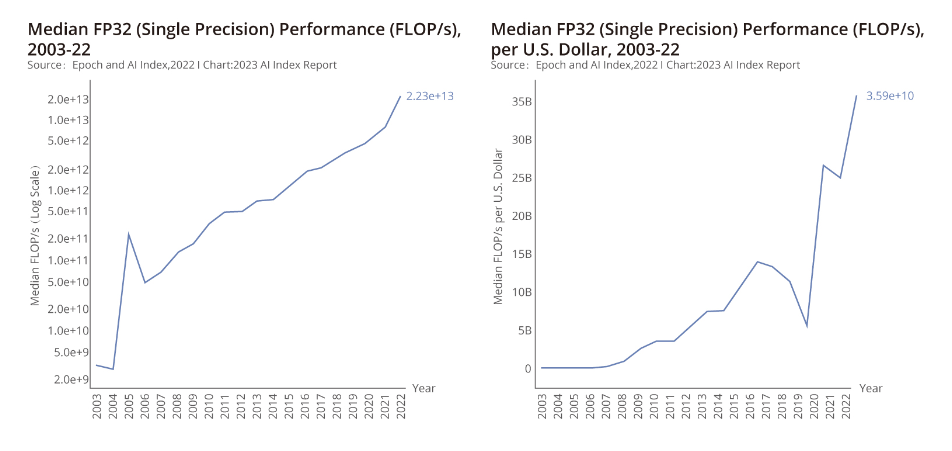

斯坦福大學人工智能小組的報告強調自2003年以來GPU性能的迅速提升,性能提高7000倍,而性價比提高5600倍。GPU已經成為加速機器學習工作負載的主要計算平臺,在近年來顯著促進了人工智能的進步。值得注意的是,在過去5年中,主要的人工智能模型都是在GPU上進行訓練的,例如ChatGPT的成功,它是一個為超過1億用戶提供服務的大型語言模型。

GPU在人工智能領域的廣闊前景

人工智能對全球經濟的預期影響巨大,麥肯錫預測生成式人工智能在各個領域每年可能貢獻18.7萬億至31.7萬億。在這個變革的背景下,GPU發揮著優化性能和推動創新的關鍵作用。

計算機處理器是任何計算系統中至關重要的組件。在這個數字時代,了解CPU、GPU、ASIC和FPGA之間的區別對于優化整體性能至關重要。飛速(FS)將深入探討CPU、GPU、ASIC和FPGA之間的區別,以增強您的技術知識,并決定如何選擇合適的處理器。

CPU, GPU,ASIC,和FPGA對比分析

CPU、GPU、ASIC和FPGA是四種計算機處理器類型,在任何計算系統中都起著至關重要的作用,并且對整體性能有著顯著影響。每種處理器類型(CPU、GPU、ASIC和FPGA)都具有其獨特的優勢,為提供高效和有效的計算解決方案做出了自己的貢獻。

CPU(中央處理器)

CPU是應用于設備(如計算機、手機、電視等)中的主要芯片。其主要功能是在集成到主板中的各個組件之間傳播指令。技術原理:通過協調和管理計算機系統中的各個元素,CPU執行指令并處理數據,完成各種復雜的計算和任務管理。應用場景:CPU專為各種電子設備設計,包括計算機和智能手機,作為核心計算單元負責執行各種軟件和應用任務。此外,它對外部外設(如鍵盤和鼠標)與設備的交互具有重要控制作用。

區別:CPU是一種通用處理器,能夠處理各種任務。然而,這種通用性其性能可能不如其他專用芯片那樣專業。

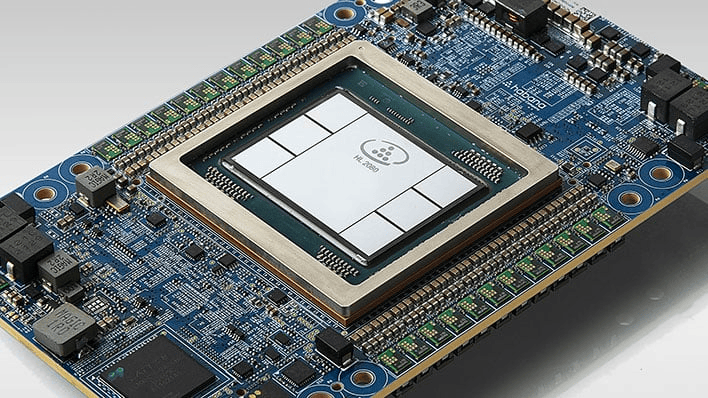

GPU(圖形處理器)

GPU,通常被稱為顯卡,旨在高效處理圖形并將其渲染到屏幕上。它是一種高度專業化的工具。隨著計算機能力的提升,GPU的應用范圍已經從圖形擴展到通用計算任務。技術原理:利用其強大的并行處理架構,能夠同時執行大量計算,處理大量圖像和圖形數據,實現快速渲染和處理圖形,提供更出色的視覺體驗。應用場景:適用于需要圖形加速的任務,如游戲、虛擬現實、3D建模等,以提供更流暢和逼真的視覺效果。近年來,GPU在人工智能、計算機視覺和超級計算等領域發揮著重要作用。

區別:GPU具有強大的圖形處理能力,能夠執行大量簡單的計算。由于其架構的限制,它無法取代CPU,但可以與CPU共同工作。

ASIC(專用集成電路)

ASIC是一種專為特定邏輯功能而設計的硅芯片,因此在性能和速度上相對于通用處理器具有優勢,但不能快速適應執行其他任務。

技術原理:通過將特定算法和功能轉化為硬件,實現高效、高性能、低功耗的計算加速,需要根據具體應用進行硬件設計和優化。

應用場景:適用于對性能和功耗有嚴格要求的應用,包括數據中心和人工智能推斷等領域。

區別:ASIC對于特定任務非常高效,但不能像CPU和GPU那樣用于通用計算。ASIC的計算能力消耗較少的功耗、體積較小,且易于安裝。

FPGA(現場可編程門陣列)

FPGA也是一種基于硅的半導體,但其架構與其他處理器不同,依靠一組可配置的邏輯塊(CLB)通過可編程互連,FPGA可以重新編程以執行多個任務,使同一硬件可以在不同的項目中使用。技術原理:FPGA可以通過可編程邏輯單元和互連實現多種邏輯功能和計算加速。它們具有根據特定要求進行配置和編程的能力,能夠適應實際需求。應用場景:FPGA適用于需要靈活性和可重配置性的場景,如通信設備和圖像處理,可以快速適應不同的算法和任務需求。

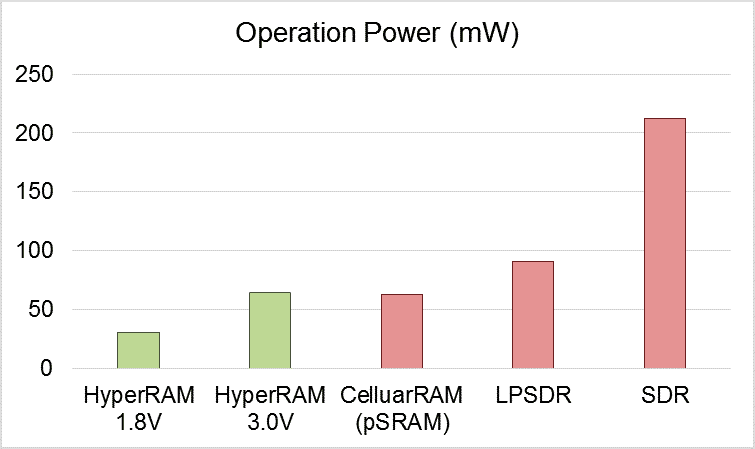

區別:與ASIC相比,FPGA在靈活性方面具有明顯優勢。然而,由于其增加的復雜性,FPGA通常需求功耗較高,因此不太適合對能源效率或極端便攜性要求嚴格的項目。

怎樣選擇CPU, GPU,ASIC,和FPGA

在選擇滿足計算需求的處理器時,有多種選擇:

CPU(通常在日常設備中使用的處理器)提供可靠的性能,功耗相對較低。

由于其出色的計算能力,GPU的應用主要集中在大規模擴展計算能力的高性能計算上,未來將深入到人工智能計算(AIGPU)領域。

ASIC表現出色,但專注于單一任務。ASIC在人工智能深度學習領域并沒有得到廣泛應用。在比特幣挖礦領域,它展現了其高計算能力,低功耗,低價格和強大的專用性。谷歌最近發布專門用于人工智能深度學習計算的TPU,實際上也是一種ASIC。

與ASIC相比,FPGA具有更大的靈活性,但需要更高的功耗。GPU專為圖形處理而設計,由于其強大的并行處理架構,在通用計算任務中表現出色。

來源:架構師技術聯盟

-

gpu

+關注

關注

28文章

4703瀏覽量

128725 -

AI

+關注

關注

87文章

30239瀏覽量

268474 -

人工智能

+關注

關注

1791文章

46896瀏覽量

237664

發布評論請先 登錄

相關推薦

《算力芯片 高性能 CPUGPUNPU 微架構分析》第3篇閱讀心得:GPU革命:從圖形引擎到AI加速器的蛻變

GPU服務器AI網絡架構設計

Inflection AI轉向英特爾Gaudi 3,放棄英偉達GPU

ai開發需要什么配置

AI訓練,為什么需要GPU?

國產GPU在AI大模型領域的應用案例一覽

FPGA在深度學習應用中或將取代GPU

CPU與GPU散熱器設計的異同及其重要性

英偉達用AI設計GPU算術電路有何優勢

ASIC和GPU,誰才是AI計算的最優解?

AI從GPU席卷至MCU,內存的重要性與算力等同

為什么GPU對AI如此重要?

為什么GPU對AI如此重要?

評論