微軟公司在最近的Build 2024開發(fā)者大會上宣布了一個重要更新。據(jù)微軟CEO薩提亞·納德拉介紹,Azure AI Studio現(xiàn)已支持OpenAI開發(fā)的最新旗艦?zāi)P虶PT-4o,并作為API提供。

GPT-4o作為一款多模態(tài)模型,集成了文本、圖像和音頻處理能力,為用戶帶來了全新的生成式和對話式AI體驗。這一更新無疑將極大地增強Azure AI Studio的功能和吸引力,為開發(fā)者和企業(yè)提供了更強大的AI工具。

Azure AI Studio作為微軟的云端AI開發(fā)平臺,一直致力于為用戶提供最先進、最便捷的AI服務(wù)。此次GPT-4o API的加入,將進一步鞏固其在AI領(lǐng)域的領(lǐng)先地位,推動AI技術(shù)的創(chuàng)新和應(yīng)用。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請聯(lián)系本站處理。

舉報投訴

相關(guān)推薦

Plus 的實際使用體驗,并提供國內(nèi)支付方案,助您做出明智的訂閱決策。 ChatGPT Plus 核心優(yōu)勢 最新 AI 模型: 體驗 GPT-4o、o1-preview 和

![的頭像]() 發(fā)表于

發(fā)表于 10-29 18:17

?456次閱讀

在8月21日的最新動態(tài)中,OpenAI 宣布了一項革命性的新功能,正式向企業(yè)用戶開放其頂尖AI模型GPT-4o的定制能力。這一舉措標志著OpenAI在激烈的企業(yè)級AI應(yīng)用市場中邁出了重要一步,旨在幫助企業(yè)客戶實現(xiàn)更精準、高效的

![的頭像]() 發(fā)表于

發(fā)表于 08-21 16:06

?438次閱讀

OpenAI近日宣布了一項令人振奮的消息:即日起,部分ChatGPT Plus用戶將率先體驗到GPT-4o的語音模式,這一創(chuàng)新功能標志著自然語言處理與人工智能交互技術(shù)邁出了重要一步。GPT-4o的高級語音模式以其卓越的實時對話能力和對用戶情緒的細膩感知,為用戶帶來了前所未

![的頭像]() 發(fā)表于

發(fā)表于 08-01 18:24

?1159次閱讀

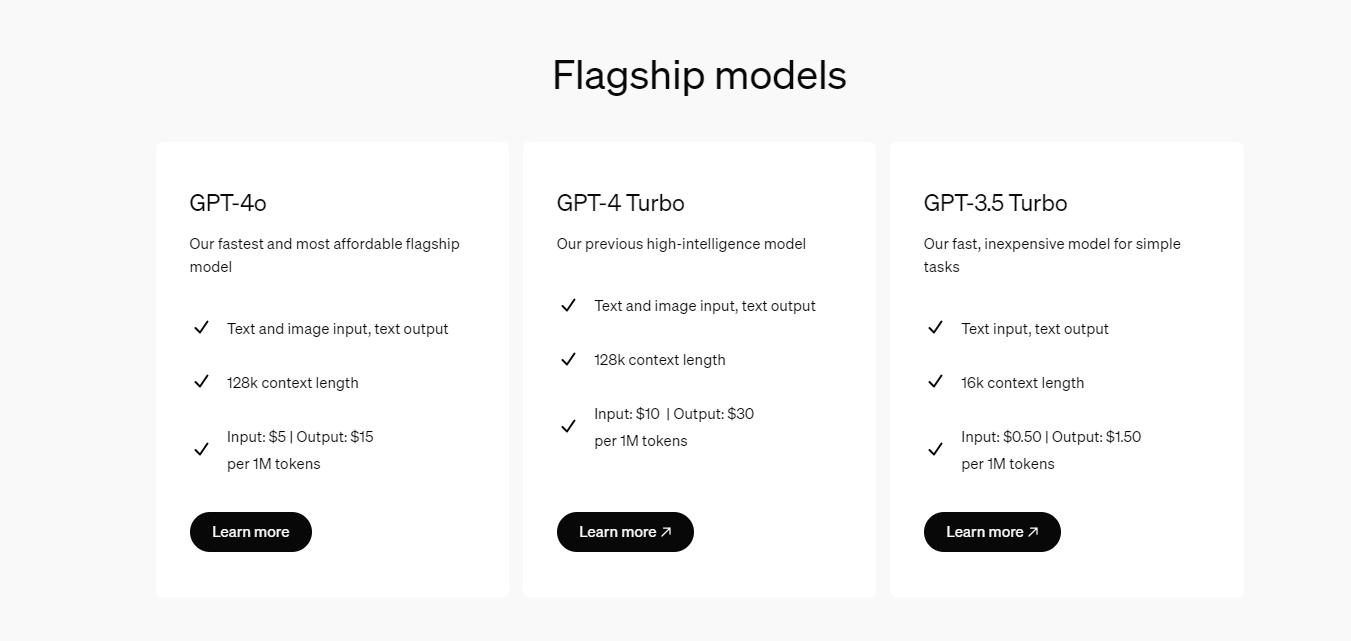

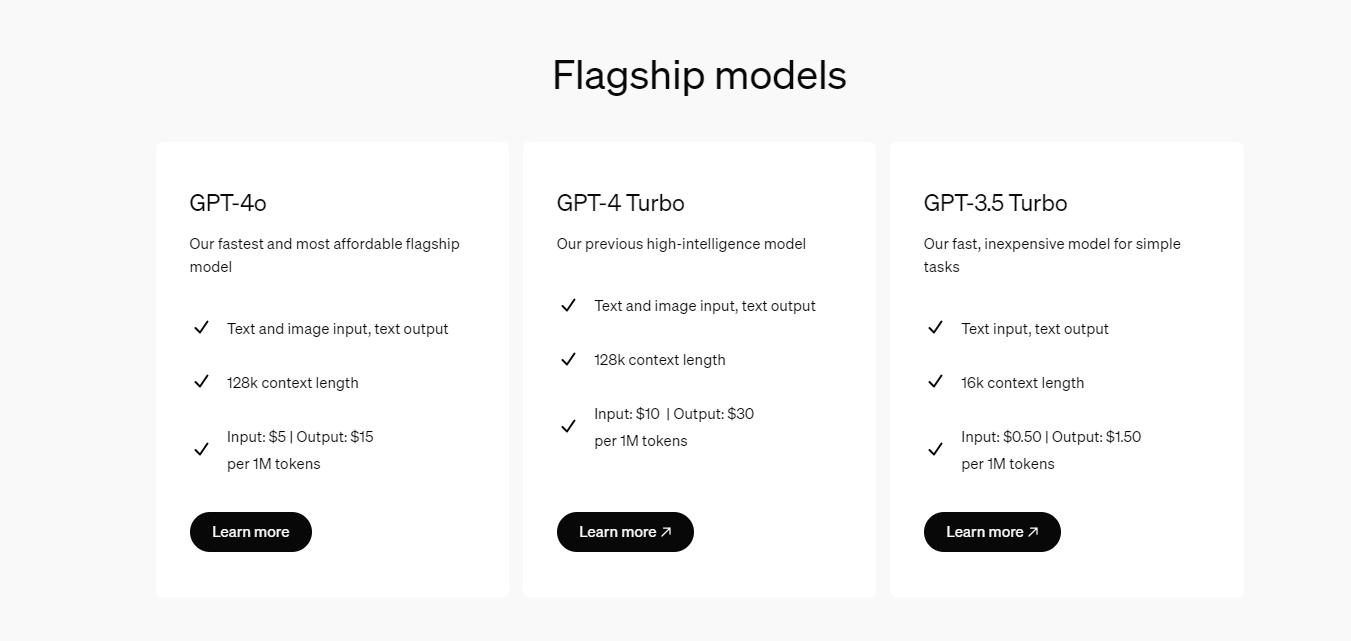

GPT-4. GPT-4o mini的定價為每百萬輸入標記15美分和每百萬輸出標記60美分,比之前的前沿模型便宜了一個數(shù)量級,比GPT-3.5 Turbo便宜了60%以上。 GPT-4o

![的頭像]() 發(fā)表于

發(fā)表于 07-21 10:20

?926次閱讀

在智能穿戴設(shè)備領(lǐng)域,美國創(chuàng)新公司Solos近日發(fā)布了其全新產(chǎn)品——AirGo Vision智能眼鏡,這款眼鏡不僅集成了前沿的AI技術(shù),還憑借其獨特的設(shè)計和功能,成為了全球首款支持GPT-4o的智能

![的頭像]() 發(fā)表于

發(fā)表于 07-01 10:24

?737次閱讀

1. 前言 ChatGPT-4o API 是 OpenAI 提供的強大工具,可用于自然語言處理和多模態(tài)任務(wù)。在國內(nèi)直聯(lián)使用這些服務(wù)需要一些配置和技巧。本文將詳細介紹GPT-4o模型以及

![的頭像]() 發(fā)表于

發(fā)表于 06-08 00:33

?4466次閱讀

,高達每分鐘1000萬字符。 速度 :GPT-4o的速度是GPT-4 Turbo的兩倍。 視覺能力 :在視覺能力相關(guān)的評估中,GPT-4o表現(xiàn)優(yōu)于GPT-4 Turbo。 多語言

![的頭像]() 發(fā)表于

發(fā)表于 05-29 16:00

?1w次閱讀

5 月 22 日,微軟Build 2024大會在美正式開幕。薩提亞·納德拉CEO、董事長宣布,OpenAI新款旗艦?zāi)P?b class='flag-5'>GPT-4o已經(jīng)在Azure AI Studio上線,并開放

![的頭像]() 發(fā)表于

發(fā)表于 05-22 11:18

?477次閱讀

)等。OpenAI的CEO奧特曼稱之為“人類級別的響應(yīng)”。GPT-4o一出,各企業(yè)開始紛紛再度亮出“家伙什”了,微軟宣布投資40億歐元加碼AI領(lǐng)域、谷歌一夜發(fā)布十幾

![的頭像]() 發(fā)表于

發(fā)表于 05-22 08:04

?497次閱讀

近日,OpenAI宣布推出全新的GPT-4o模型,標志著人工智能領(lǐng)域的一大技術(shù)飛躍。這款模型不僅具備強大的生成能力,還能精準理解用戶意圖,提供智能化的回答。

![的頭像]() 發(fā)表于

發(fā)表于 05-17 11:48

?621次閱讀

緊接著,OpenAI總裁暨聯(lián)合創(chuàng)始人Greg Brockman發(fā)布了詳細演示,展示了兩部搭載GPT-4o的設(shè)備如何實現(xiàn)語音或視頻交互。

![的頭像]() 發(fā)表于

發(fā)表于 05-15 10:26

?468次閱讀

在周一的直播盛會上,OpenAI揭開了其最新的人工智能模型GPT-4o的神秘面紗。這款新模型旨在為其著名的聊天機器人ChatGPT提供更強大、更經(jīng)濟的支持。GPT-4o是此前備受矚目的

![的頭像]() 發(fā)表于

發(fā)表于 05-15 09:23

?369次閱讀

電子發(fā)燒友網(wǎng)報道(文/李彎彎)當(dāng)?shù)貢r間5月13日,OpenAI舉行春季發(fā)布會,宣布將推出桌面版ChatGPT,并發(fā)布全新旗艦AI模型GPT-4o

![的頭像]() 發(fā)表于

發(fā)表于 05-15 00:15

?7778次閱讀

此外,該模型還具備128K的上下文記憶能力,知識截止日期設(shè)定為2023年10月。微軟方面也宣布,已通過Azure OpenAI服務(wù)提供GPT-4o的預(yù)覽版。

![的頭像]() 發(fā)表于

發(fā)表于 05-14 17:12

?824次閱讀

OpenAI首席技術(shù)官穆里·穆拉蒂(Muri Murati)指出,GPT-4o具備與GPT-4相同的智能水平,且在文本、圖像及語音處理方面有顯著進步。

![的頭像]() 發(fā)表于

發(fā)表于 05-14 11:17

?458次閱讀

Azure AI Studio現(xiàn)已支持提供GPT-4o API

Azure AI Studio現(xiàn)已支持提供GPT-4o API

評論