人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Networks,簡(jiǎn)稱ANNs)是一種模擬人腦神經(jīng)網(wǎng)絡(luò)的計(jì)算模型,它通過(guò)大量的簡(jiǎn)單計(jì)算單元(神經(jīng)元)和它們之間的連接(突觸)來(lái)實(shí)現(xiàn)對(duì)復(fù)雜數(shù)據(jù)的處理和學(xué)習(xí)。本文將詳細(xì)介紹人工神經(jīng)網(wǎng)絡(luò)的工作原理,包括其基本概念、結(jié)構(gòu)、學(xué)習(xí)算法和應(yīng)用領(lǐng)域。

- 基本概念

1.1 神經(jīng)元

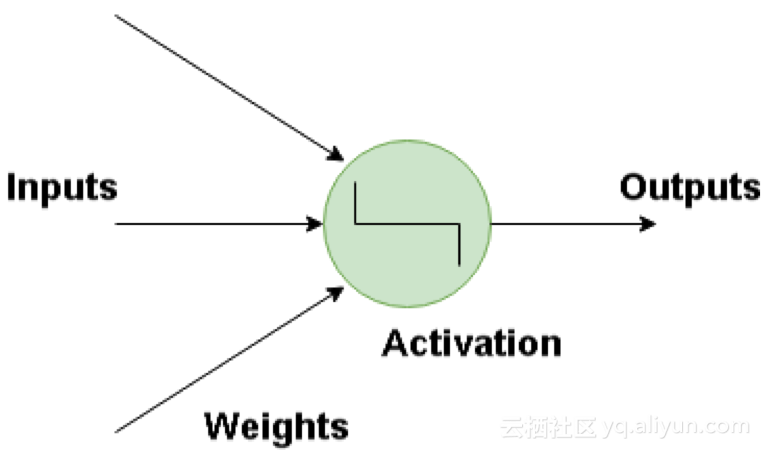

神經(jīng)元是人工神經(jīng)網(wǎng)絡(luò)的基本計(jì)算單元,它接收輸入信號(hào),進(jìn)行加權(quán)求和,然后通過(guò)激活函數(shù)進(jìn)行非線性變換,生成輸出信號(hào)。神經(jīng)元的結(jié)構(gòu)如圖1所示。

圖1 神經(jīng)元結(jié)構(gòu)示意圖

1.2 突觸

突觸是神經(jīng)元之間的連接,它負(fù)責(zé)傳遞信號(hào)。每個(gè)突觸都有一個(gè)權(quán)重,用于調(diào)整信號(hào)的強(qiáng)度。權(quán)重的大小決定了突觸對(duì)信號(hào)的貢獻(xiàn)程度。

1.3 激活函數(shù)

激活函數(shù)是一種非線性函數(shù),用于將神經(jīng)元的輸入信號(hào)轉(zhuǎn)換為輸出信號(hào)。常見(jiàn)的激活函數(shù)有Sigmoid函數(shù)、Tanh函數(shù)、ReLU函數(shù)等。

1.4 損失函數(shù)

損失函數(shù)用于衡量神經(jīng)網(wǎng)絡(luò)的預(yù)測(cè)結(jié)果與真實(shí)結(jié)果之間的差異。常見(jiàn)的損失函數(shù)有均方誤差(MSE)、交叉熵(Cross-Entropy)等。

1.5 優(yōu)化算法

優(yōu)化算法用于調(diào)整神經(jīng)網(wǎng)絡(luò)的參數(shù),以最小化損失函數(shù)。常見(jiàn)的優(yōu)化算法有梯度下降(Gradient Descent)、隨機(jī)梯度下降(Stochastic Gradient Descent,SGD)、Adam等。

- 網(wǎng)絡(luò)結(jié)構(gòu)

2.1 感知機(jī)

感知機(jī)是一種最簡(jiǎn)單的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),由輸入層、輸出層和權(quán)重組成。感知機(jī)可以解決線性可分問(wèn)題,如圖2所示。

圖2 感知機(jī)結(jié)構(gòu)示意圖

2.2 多層感知機(jī)(MLP)

多層感知機(jī)是一種包含多個(gè)隱藏層的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),它可以解決非線性問(wèn)題。MLP的結(jié)構(gòu)如圖3所示。

圖3 多層感知機(jī)結(jié)構(gòu)示意圖

2.3 卷積神經(jīng)網(wǎng)絡(luò)(CNN)

卷積神經(jīng)網(wǎng)絡(luò)是一種適用于圖像處理的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),它通過(guò)卷積層、池化層和全連接層來(lái)提取圖像特征。CNN的結(jié)構(gòu)如圖4所示。

圖4 卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)示意圖

2.4 循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)

循環(huán)神經(jīng)網(wǎng)絡(luò)是一種適用于序列數(shù)據(jù)的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),它通過(guò)循環(huán)連接來(lái)處理時(shí)間序列數(shù)據(jù)。RNN的結(jié)構(gòu)如圖5所示。

圖5 循環(huán)神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)示意圖

2.5 生成對(duì)抗網(wǎng)絡(luò)(GAN)

生成對(duì)抗網(wǎng)絡(luò)是一種由生成器和判別器組成的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),用于生成新的數(shù)據(jù)樣本。GAN的結(jié)構(gòu)如圖6所示。

圖6 生成對(duì)抗網(wǎng)絡(luò)結(jié)構(gòu)示意圖

- 學(xué)習(xí)算法

3.1 前向傳播

前向傳播是神經(jīng)網(wǎng)絡(luò)從輸入層到輸出層的信號(hào)傳遞過(guò)程。在前向傳播過(guò)程中,每個(gè)神經(jīng)元接收輸入信號(hào),通過(guò)加權(quán)求和和激活函數(shù)生成輸出信號(hào)。

3.2 反向傳播

反向傳播是神經(jīng)網(wǎng)絡(luò)從輸出層到輸入層的誤差傳遞過(guò)程。在反向傳播過(guò)程中,通過(guò)計(jì)算損失函數(shù)的梯度,更新網(wǎng)絡(luò)的權(quán)重。

3.3 梯度下降

梯度下降是一種優(yōu)化算法,用于最小化損失函數(shù)。在梯度下降過(guò)程中,通過(guò)不斷更新權(quán)重,使損失函數(shù)的值逐漸減小。

3.4 隨機(jī)梯度下降

隨機(jī)梯度下降是一種梯度下降的變體,它在每次迭代中只使用一個(gè)樣本來(lái)更新權(quán)重,從而加快學(xué)習(xí)速度。

3.5 Adam優(yōu)化算法

Adam是一種自適應(yīng)學(xué)習(xí)率的優(yōu)化算法,它結(jié)合了動(dòng)量(Momentum)和RMSProp的優(yōu)點(diǎn),能夠在不同的參數(shù)上使用不同的學(xué)習(xí)率。

- 應(yīng)用領(lǐng)域

4.1 圖像識(shí)別

人工神經(jīng)網(wǎng)絡(luò)在圖像識(shí)別領(lǐng)域取得了顯著的成果,如卷積神經(jīng)網(wǎng)絡(luò)(CNN)在圖像分類、目標(biāo)檢測(cè)和圖像分割等任務(wù)上表現(xiàn)出色。

4.2 語(yǔ)音識(shí)別

人工神經(jīng)網(wǎng)絡(luò)在語(yǔ)音識(shí)別領(lǐng)域也取得了很好的效果,如循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)和長(zhǎng)短時(shí)記憶網(wǎng)絡(luò)(LSTM)在語(yǔ)音識(shí)別和語(yǔ)音合成等任務(wù)上具有優(yōu)勢(shì)。

4.3 自然語(yǔ)言處理

人工神經(jīng)網(wǎng)絡(luò)在自然語(yǔ)言處理領(lǐng)域有著廣泛的應(yīng)用,如循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)和長(zhǎng)短時(shí)記憶網(wǎng)絡(luò)(LSTM)在文本分類、情感分析和機(jī)器翻譯等任務(wù)上取得了顯著的成果。

4.4 推薦系統(tǒng)

人工神經(jīng)網(wǎng)絡(luò)在推薦系統(tǒng)領(lǐng)域也取得了很好的效果,如矩陣分解和深度學(xué)習(xí)推薦模型在個(gè)性化推薦和廣告投放等任務(wù)上具有優(yōu)勢(shì)。

4.5 游戲AI

人工神經(jīng)網(wǎng)絡(luò)在游戲AI領(lǐng)域也取得了突破性進(jìn)展,如AlphaGo和AlphaZero等基于深度學(xué)習(xí)的AI在圍棋、國(guó)際象棋等游戲中戰(zhàn)勝了人類頂級(jí)選手。

-

人工神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

1文章

119瀏覽量

14602 -

神經(jīng)元

+關(guān)注

關(guān)注

1文章

363瀏覽量

18441 -

計(jì)算模型

+關(guān)注

關(guān)注

0文章

29瀏覽量

9824 -

輸入信號(hào)

+關(guān)注

關(guān)注

0文章

447瀏覽量

12542

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

基于Python 的人工神經(jīng)網(wǎng)絡(luò)的工作原理

人工神經(jīng)網(wǎng)絡(luò)原理及下載

神經(jīng)網(wǎng)絡(luò)教程(李亞非)

【PYNQ-Z2試用體驗(yàn)】神經(jīng)網(wǎng)絡(luò)基礎(chǔ)知識(shí)

人工神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)方法有哪些?

【AI學(xué)習(xí)】第3篇--人工神經(jīng)網(wǎng)絡(luò)

怎么解決人工神經(jīng)網(wǎng)絡(luò)并行數(shù)據(jù)處理的問(wèn)題

BP神經(jīng)網(wǎng)絡(luò)編碼樣例及工作原理

人工神經(jīng)網(wǎng)絡(luò)的工作原理是什么

人工神經(jīng)網(wǎng)絡(luò)的工作原理是什么

評(píng)論