卷積神經網絡(Convolutional Neural Network,CNN)是深度學習領域中一種重要的神經網絡結構,廣泛應用于圖像識別、語音識別、自然語言處理等領域。在CNN中,池化層(Pooling Layer)是一個關鍵的組成部分,它對卷積層的輸出進行下采樣,降低特征圖(Feature Map)的空間維度,從而減少計算量和參數數量,提高模型的泛化能力。

池化層是一種非線性降維操作,它對卷積層的輸出進行局部區域的聚合,生成一個較小的特征圖。池化層通常位于卷積層之后,其目的是減少特征圖的空間尺寸,降低模型的計算復雜度,同時保留重要的特征信息。

池化層的操作可以表示為:

Pooling(X) = f(X, k, s)

其中,X是輸入的特征圖,k是池化窗口的大小,s是步長(Stride)。f是池化函數,常用的池化函數有最大池化(Max Pooling)和平均池化(Average Pooling)。

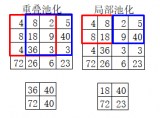

1.1 最大池化(Max Pooling)

最大池化是一種常用的池化方法,它在每個池化窗口內取最大值作為輸出。最大池化可以表示為:

MaxPooling(X) = max(X[i:i+k, j:j+k])

其中,i和j分別是池化窗口在特征圖上的行和列索引。

1.2 平均池化(Average Pooling)

平均池化是另一種常用的池化方法,它在每個池化窗口內取所有元素的平均值作為輸出。平均池化可以表示為:

AveragePooling(X) = mean(X[i:i+k, j:j+k])

1.3 其他池化方法

除了最大池化和平均池化之外,還有一些其他的池化方法,如L2池化(L2 Pooling)、隨機池化(Stochastic Pooling)等。這些池化方法在特定場景下可能具有更好的性能。

- 池化層的作用

2.1 降低特征圖的空間維度

池化層通過下采樣操作,降低特征圖的空間維度,從而減少模型的參數數量和計算量。這對于訓練大型神經網絡和處理高分辨率圖像尤為重要。

2.2 提高模型的泛化能力

池化層通過聚合局部區域的特征,使模型對輸入數據的局部變化更加魯棒。這有助于提高模型的泛化能力,使其在面對新的、未見過的數據時,仍能保持較高的識別準確率。

2.3 保留重要的特征信息

池化層在降低特征圖維度的同時,盡量保留重要的特征信息。例如,最大池化可以保留局部區域的最大響應值,這通常對應于圖像中的重要特征點。

2.4 減少過擬合

池化層可以減少模型的參數數量,從而降低過擬合的風險。過擬合是指模型在訓練數據上表現良好,但在新的、未見過的數據上表現較差的現象。

- 池化層與其他層的協同作用

3.1 與卷積層的協同作用

卷積層和池化層通常在CNN中交替出現。卷積層負責提取局部特征,而池化層則對這些特征進行聚合和降維。這種結構有助于模型在不同層次上捕捉圖像的特征。

3.2 與全連接層的協同作用

在CNN的最后幾層,通常會使用全連接層進行分類或回歸任務。池化層可以減少全連接層的輸入維度,從而降低模型的計算量和過擬合風險。

3.3 與激活函數的協同作用

在CNN中,激活函數(如ReLU)通常與卷積層和池化層結合使用。激活函數可以引入非線性,使模型能夠學習更復雜的特征表示。池化層可以進一步增強這種非線性特性。

- 池化層在不同領域的應用

4.1 圖像識別

在圖像識別任務中,池化層可以有效地降低特征圖的維度,同時保留重要的視覺特征。這使得CNN能夠處理高分辨率的圖像,并在多個尺度上捕捉圖像的特征。

4.2 語音識別

在語音識別任務中,池化層可以降低特征圖的維度,同時保留語音信號中的關鍵信息。這有助于提高模型的泛化能力。

-

圖像識別

+關注

關注

9文章

519瀏覽量

38238 -

深度學習

+關注

關注

73文章

5492瀏覽量

120977 -

cnn

+關注

關注

3文章

351瀏覽量

22169 -

卷積神經網絡

+關注

關注

4文章

366瀏覽量

11851

發布評論請先 登錄

相關推薦

卷積神經網絡cnn中池化層的主要作用

卷積神經網絡cnn中池化層的主要作用

評論