近日,地平線兩篇論文入選國際計算機視覺頂會ECCV 2024,自動駕駛算法技術再有新突破。

ECCV(European Conference on Computer Vision,即歐洲計算機視覺國際會議),是計算機視覺領域中最頂級的會議之一,與ICCV(International Conference on Computer Vision)和CVPR(Conference on Computer Vision and Pattern Recognition)并稱為計算機視覺領域的“三大頂會”。ECCV每兩年舉行一次,吸引了全球頂尖的研究人員、學者和業界專家,分享最新的研究成果與技術創新。

聚創新之力 答智駕課題

本次地平線被錄用的2篇論文是:

1、Lane Graph as Path: Continuity-preserving Path-wise Modeling for Online Lane Graph Construction

(《LaneGAP:用于在線車道圖構建的連續性路徑建模》)

論文鏈接:https://arxiv.org/abs/2303.08815

2、Occupancy as Set of Points

(《OSP:基于點集表征的占據網格預測》)

論文鏈接:https://arxiv.org/abs/2407.04049

車道圖構建新方案:

端到端學習路徑,大幅提升預測規劃性能

在線車道圖構建是自動駕駛領域一項有前途但具有挑戰性的任務。LaneGAP 是一種車道圖構建新方法,將端到端矢量地圖在線構建方法 MapTR(入選深度學習頂會ICLR spotlight論文)拓展到道路拓撲建模,能夠大幅提升預測規劃性能,應對各種復雜交通狀況。LaneGAP 和 MapTR 相關工作已經在地平線高階智駕系統SuperDrive中落地應用。

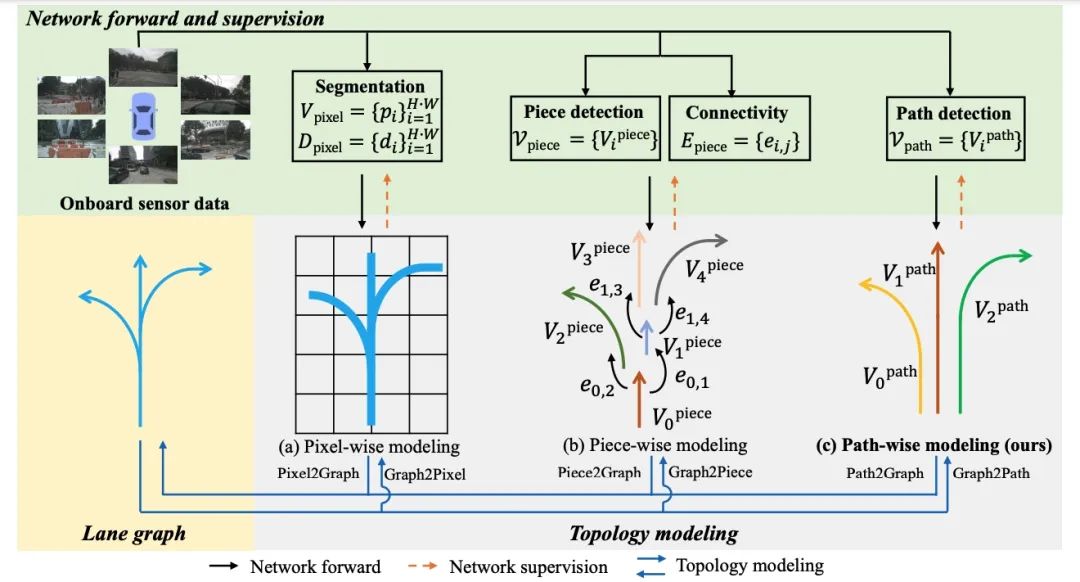

具體而言,以前的方法通常在像素或片段級別對車道圖進行建模,并通過逐像素或分段連接恢復車道圖,這會破壞車道的連續性。作者提出一種基于路徑的在線車道圖構建方法—— LaneGAP,它采用了端到端學習路徑,并通過 Path2Graph 算法恢復車道圖。LaneGAP在具有挑戰性的 nuScenes 和 Argoverse2 數據集上定性和定量地證明了 LaneGAP 優于傳統的基于像素和基于片段的方法。豐富的可視化效果顯示 LaneGAP 可以應對各種復雜交通狀況。

Occupancy新突破:

全新視角,性能更強大,計算更靈活

OSP提出了全新視角下的自動駕駛場景建模算法——稀疏點集占據網格預測方法,通過與2D圖像特征交互的點查詢,建立了一種新的基于點的占用表示,可以全面理解3D場景,并且框架更靈活,性能更強大。

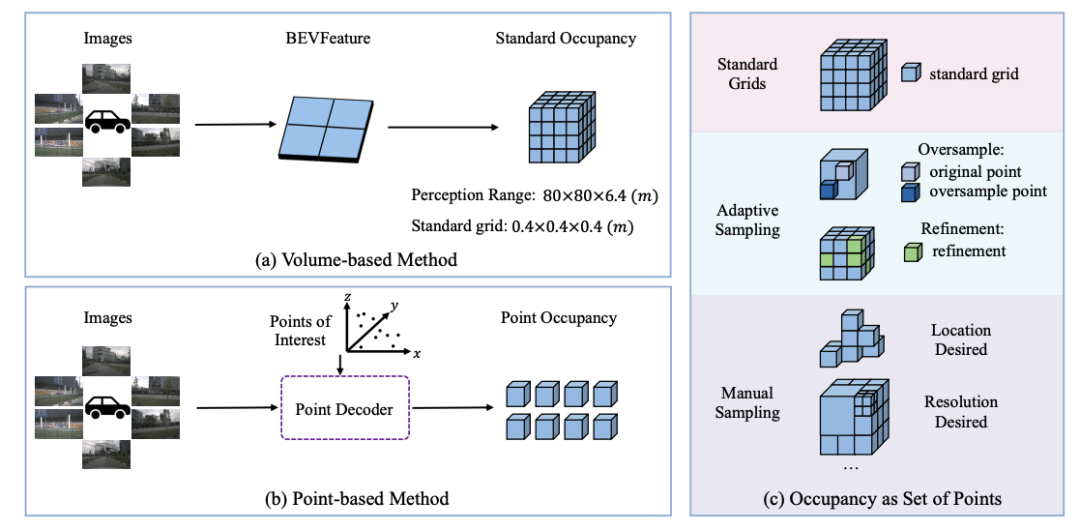

本文探索了利用多視角圖像進行3D占據網格預測的新方法,稱為“點集占據網格”。現有方法傾向于利用BEV表征進行占據網格預測,因此很難將注意力集中在特殊區域或感知范圍之外的區域。相比之下,本文提出了Points of Interest (PoIs) 來表示場景,并提出了 OSP,一種基于點的 3D 占用預測的新框架。得益于點集表征的靈活性,OSP 與現有方法相比實現了強大的性能,并且在訓練和推理適應性方面表現出色:可以預測感知邊界外的范圍;可以與基于體特征的方法集成以提升性能。在Occ3D nuScenes占用基準上的實驗表明,OSP具有強大的性能和靈活性。

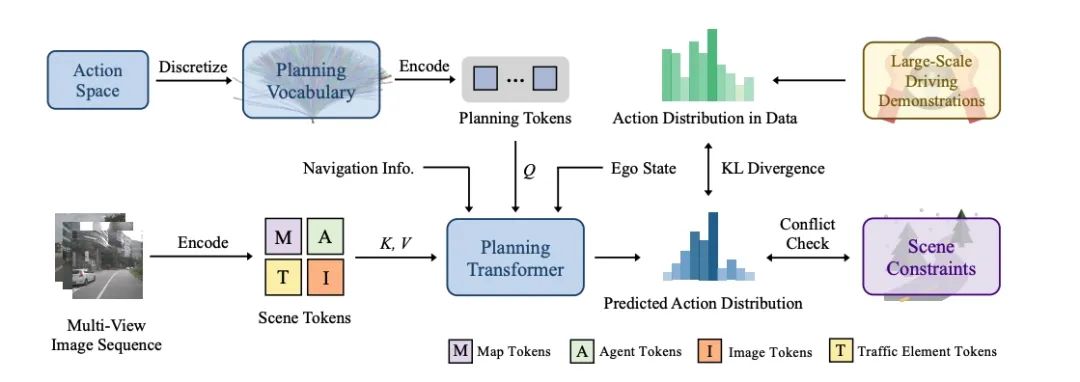

除了這兩篇斬獲ECCV 2024的最新成果,地平線在ICCV 2023上提出的VAD也有創新進展。VADv2首次提出基于概率建模的多模態決策端到端自動駕駛大模型,在閉環榜單Carla Town05 Benchmark上達到SOTA的端到端自動駕駛規劃性能。

此前,VAD初步探索了基于矢量化場景表征的端到端自動駕駛算法框架,在此基礎上,VADv2首次將多模態概率規劃引入端到端自動駕駛,用于解決判決式模型無法建模決策的天然多模態特性的問題,從而有效提升決策的準確率。VADv2以數據驅動的范式從大量駕駛數據中端到端學習駕駛策略,在Carla閉環榜單上,相比于此前的方案,VADv2大幅提升駕駛評分,實現SOTA性能,在無需規則后處理的情況下也能有良好的駕駛表現。

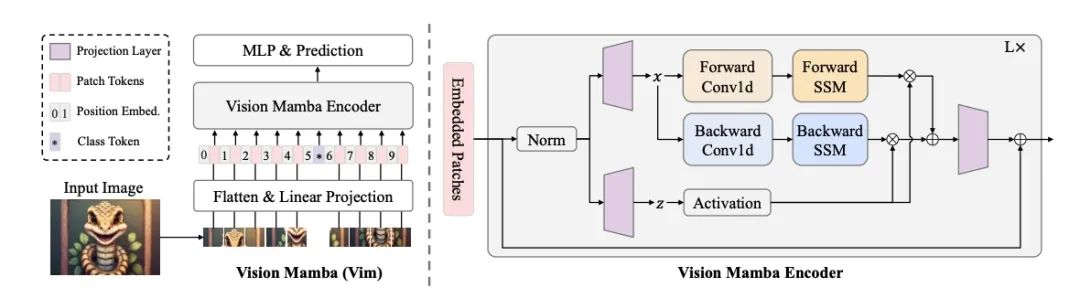

于7月21日-27日,正在奧地利維也納舉辦的2024國際機器學習大會(ICML 2024)上,地平線被ICML 2024接收的最新工作Vision Mamba(簡稱Vim)也受邀做了分享。Vision Mamba是一種新的通用視覺主干模型,相比現有的視覺Transformer,在性能上有顯著提升,是接替Transformer的下一代視覺基礎模型。

Vision Mamba使用雙向狀態空間模型(SSM)對圖像序列進行位置嵌入,并利用雙向SSM壓縮視覺表示。在ImageNet分類、COCO目標檢測和ADE20k語義分割任務中,Vim相比現有的視覺Transformer(如DeiT)在性能上有大幅提升,同時在計算和內存效率上也有顯著改進。例如,在進行分辨率為1248×1248的批量推理時,Vim比DeiT快2.8倍,GPU內存節省86.8%。這些結果表明,Vim能夠克服在高分辨率圖像理解中執行Transformer樣式的計算和內存限制,具有成為下一代視覺基礎模型主干的潛力。

地平線「你好,開發者」直播預告

為了讓智駕開發者更深入地了解這些最新的研究成果與算法創新,地平線策劃推出2024年「你好,開發者」自動駕駛技術專場,邀請到地平線各位技術專家進行直播分享。敬請關注!

-

計算機視覺

+關注

關注

8文章

1675瀏覽量

45784 -

自動駕駛

+關注

關注

780文章

13386瀏覽量

164838 -

地平線

+關注

關注

0文章

317瀏覽量

14786

原文標題:地平線自動駕駛算法新突破,科研論文入選學術頂會 ECCV 2024

文章出處:【微信號:horizonrobotics,微信公眾號:地平線HorizonRobotics】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

地平線征程家族出貨量破600萬,智駕計算方案領跑市場

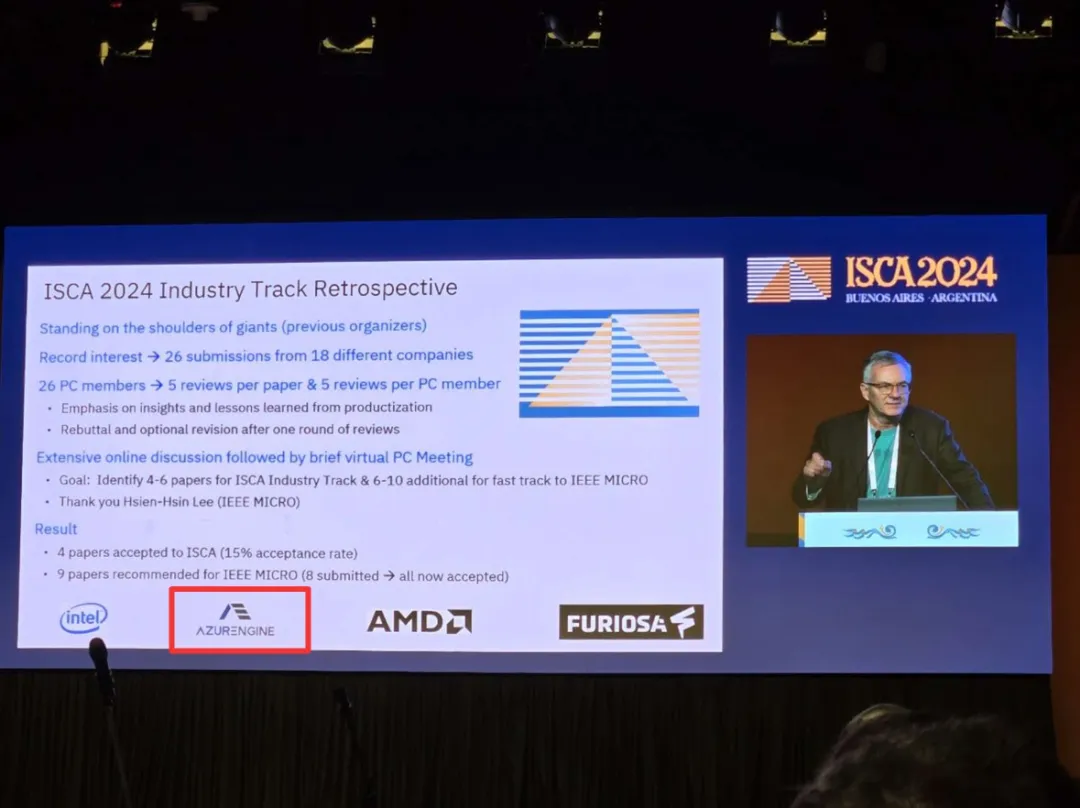

芯動力科技論文入選ISCA 2024,與國際巨頭同臺交流研究成果

計算機視覺的工作原理和應用

計算機視覺的主要研究方向

地平線發布新一代Horizon SuperDrive?全場景智能駕駛解決方案

地平線科研論文入選國際計算機視覺頂會ECCV 2024

地平線科研論文入選國際計算機視覺頂會ECCV 2024

評論