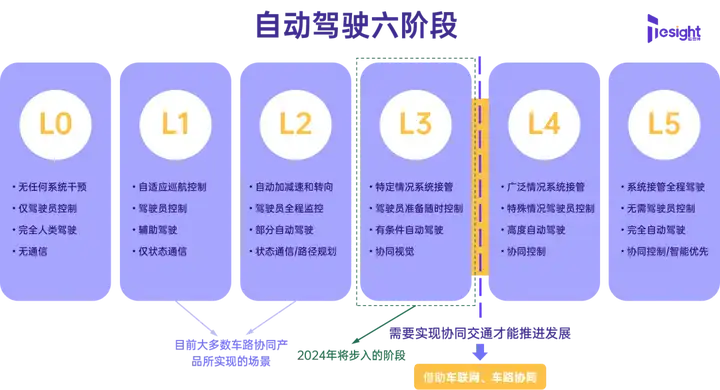

隨著春節(jié)臨近,漫漫回家路上的路況和天氣都變化多端,長途駕駛難免使人身心俱疲,若不久的將來能將真正的L3/L4級自動駕駛落地應(yīng)用,那將大大減輕長途駕車回家的辛苦。即便車外風(fēng)雨交加,人們依舊可以在溫暖的車內(nèi)放松小憩,從容地喝口熱茶吃塊點(diǎn)心,刷刷老家又開了什么新館子,帶上家人或約上老友一起去嘗鮮。若是節(jié)日駕車旅游,可以安然自若地欣賞路過的美景,隨手就拿起手機(jī)記錄美好的一瞬,這樣的長途駕駛體驗是不是讓人身心愉悅了許多呢?

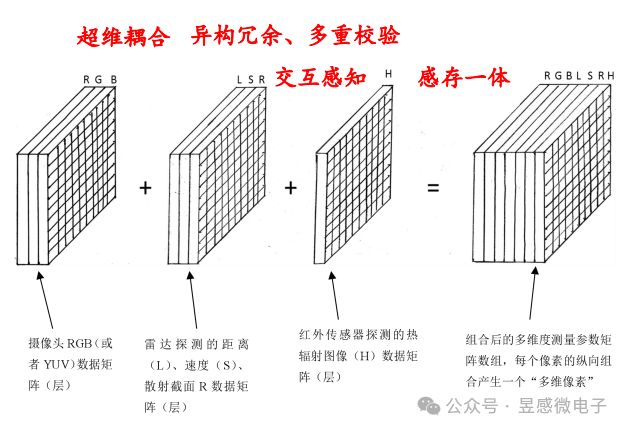

昱感微電子的“多傳感器多維像素融合感知芯片”就能助力汽車自動駕駛系統(tǒng)來實現(xiàn)這樣的體驗,讓駕車回家之旅變得輕松愜意。智能感知是L3/L4級自動駕駛的技術(shù)難點(diǎn),而單一的傳感器始終存在自身的局限性,無法做到對環(huán)境全面精確的感知。昱感微的融合感知芯片創(chuàng)新性地將可見光攝像頭、紅外攝像頭以及4D毫米波雷達(dá)的探測數(shù)據(jù)融合到一起并以“多維像素”的格式輸出。多維像素是指在可見光攝像頭像素信息上加上其他傳感器對于目標(biāo)感知的信息,將感知系統(tǒng)的感知維度擴(kuò)展以實現(xiàn)多維度感知目標(biāo)的完整信息。如下圖示例,芯片將攝像頭RGB數(shù)據(jù)矩陣層,和雷達(dá)探測目標(biāo)的距離、速度、散射截面R數(shù)據(jù)矩陣層,以及紅外傳感器探測的熱輻射圖像數(shù)據(jù)矩陣層疊加組合到一起,以攝像頭的像素為顆粒度,每個像素不僅有圖像數(shù)據(jù),縱向組合上還包含了毫米波雷達(dá)和紅外傳感器的探測數(shù)據(jù),形成多維度測量參數(shù)矩陣數(shù)組。

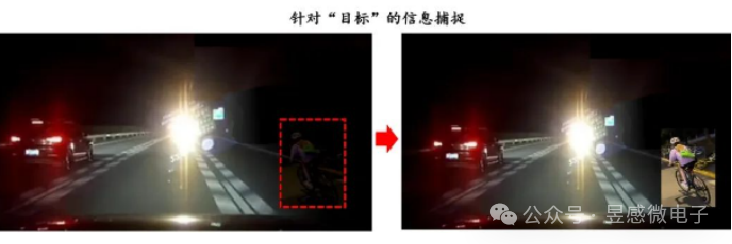

多維像素就好比賦予了自動駕駛系統(tǒng)比人類更敏銳的眼睛,看到的不僅是一幅幅二維的圖像,還有在圖像之上更多維的信息。就像在霧中穿行,人眼只能看到白茫茫的霧氣下物體隱約的輪廓,但昱感微的融合感知芯片可以利用毫米波雷達(dá)和紅外攝像頭的探測數(shù)據(jù)讓自動駕駛系統(tǒng)感知到霧氣中的物體的方位、距離、速度、溫度等信息,確保安全行駛。不僅如此,昱感微的融合感知芯片采用最前沿的多傳感器前融合技術(shù),攝像頭和雷達(dá)等多傳感器的探測數(shù)據(jù)在前端(數(shù)據(jù)獲取時)交互驗證,讓自動駕駛系統(tǒng)能感知到“看不見”的危險。例如,當(dāng)反向車道有強(qiáng)遠(yuǎn)光燈干擾下,視覺無法清晰地看到行車周圍的狀況,容易引發(fā)危險。但昱感微的融合感知芯片可以解決強(qiáng)光對視覺的干擾:當(dāng)雷達(dá)子系統(tǒng)探測到潛在運(yùn)動目標(biāo)時,融合感知芯片可以引導(dǎo)本車的攝像頭針對運(yùn)動目標(biāo)做快速局部修正曝光(見下圖),以此實時獲取運(yùn)動目標(biāo)的分辨細(xì)節(jié)特征,并將局部修正曝光的圖像融合雷達(dá)數(shù)據(jù)傳輸至自動駕駛系統(tǒng),避免撞擊危險發(fā)生。

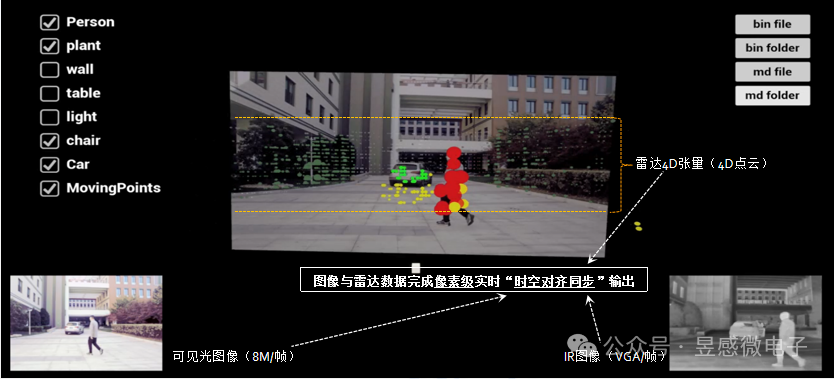

多傳感器前融合可以發(fā)揮各個傳感器在不同應(yīng)用場景下的優(yōu)勢,取長補(bǔ)短來達(dá)到1+1>2的效果。4D毫米波雷達(dá)可以幫助可見光攝像頭克服天氣光線的影響,可見光攝像頭的圖像又為毫米波雷達(dá)增添了語義信息,進(jìn)一步提高雷達(dá)點(diǎn)云的置信度;而紅外不僅賦予了自動駕駛夜視能力,還可以清楚地辨別行人。如下圖所示,基于可見光攝像頭的感知系統(tǒng)可能會忽略遠(yuǎn)處較暗的兩個人(在可見光圖像的陰影區(qū)域),紅外攝像頭可以輕松地通過人體測溫辨別出來。此外,在夜間高速行駛狀態(tài)下,紅外可以對遇到突然躥出來的人或動物進(jìn)行判別,如果是行人則必須避讓,動物可根據(jù)行駛狀態(tài)引導(dǎo)自動駕駛系統(tǒng)采取不同的決策。

除了天氣和光線外,基于純視覺網(wǎng)絡(luò)的算法仍存在corner cases的問題,樣本的長尾效應(yīng)影響著自動駕駛系統(tǒng)的表現(xiàn)。而昱感微的融合感知芯片是基于物理數(shù)據(jù)的感知,可以很好地解決這個問題。芯片將多個傳感器的探測數(shù)據(jù)融合,并將各傳感器的探測數(shù)據(jù)的坐標(biāo)統(tǒng)一、時序?qū)R,圖像與雷達(dá)數(shù)據(jù)完成像素級實時“時空對齊同步”輸出。這是業(yè)界公認(rèn)的多傳感器前融合的技術(shù)難點(diǎn)之一,不過得益于團(tuán)隊成員多年相關(guān)領(lǐng)域的技術(shù)積累和眾多技術(shù)創(chuàng)新,昱感微的融合感知芯片內(nèi)嵌功能可以支持客戶完全滿足系統(tǒng)對目標(biāo)感知“坐標(biāo)統(tǒng)一,時序?qū)R,數(shù)據(jù)同質(zhì) ,突出事件感知”的要求,能夠解決目前車廠在自動駕駛鄰域的技術(shù)痛點(diǎn)。

并且,昱感微融合感知芯片輸出的“多維像素”與現(xiàn)有的AI計算平臺兼容,可以復(fù)用已有的圖像數(shù)據(jù)樣本。對于目前流行的神經(jīng)網(wǎng)絡(luò)框架(比如,Yolo V8,BEV +Transformer等等)只需小幅修改就可適用多維像素。多維像素還可以快速提升AI網(wǎng)絡(luò)的訓(xùn)練收斂率以及目標(biāo)識別率,并且可以大幅降低系統(tǒng)算力要求。

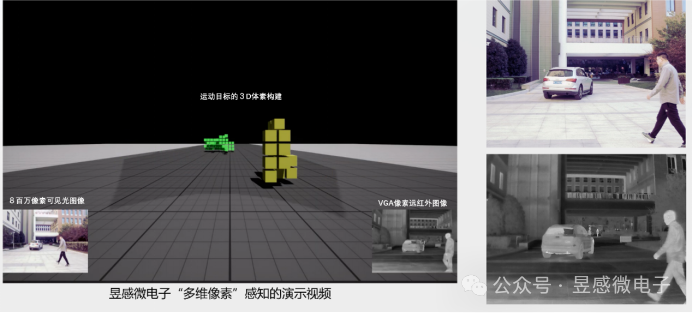

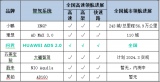

多維像素還可以直接高效支持“占用網(wǎng)絡(luò)” (Occupancy Network)算法。占用網(wǎng)格是指將感知空間劃分為一個個立體網(wǎng)格(體素),而多維像素包含了目標(biāo)的3D空間位置信息、目標(biāo)的速度信息和材質(zhì)信息,可以直接高效實時支持占用網(wǎng)格中的體素算法。Tesla目前在主推“BEV +Transformer+占用網(wǎng)絡(luò)”,國內(nèi)華為GOD2.0也采用相同的架構(gòu),預(yù)計未來許多智能駕駛團(tuán)隊都會引入“占用網(wǎng)絡(luò)”來提升系統(tǒng)能力。多維像素的應(yīng)用前景非常廣闊。昱感微的融合感知芯片+BEV +Transformer+占用網(wǎng)格有望成為L3/L4級自動駕駛最優(yōu)的落地方案,不久的將來人們就可以輕松愉快地享受長途自駕之旅了。

多維像素“占用網(wǎng)格”3D體素算法精準(zhǔn)探測運(yùn)動目標(biāo)空間位置

-

芯片

+關(guān)注

關(guān)注

454文章

50460瀏覽量

421968 -

多傳感器

+關(guān)注

關(guān)注

0文章

80瀏覽量

15348 -

自動駕駛

+關(guān)注

關(guān)注

783文章

13694瀏覽量

166166

發(fā)布評論請先 登錄

相關(guān)推薦

通用汽車正全力推進(jìn)L3級自動駕駛系統(tǒng)的開發(fā)

經(jīng)緯恒潤全冗余R-EPS助力L4級自動駕駛落地

Mobileye引領(lǐng)自動駕駛新紀(jì)元:L4級無人駕駛系統(tǒng)在德國成功路測

百度發(fā)布全球首個L4級自動駕駛大模型

百度發(fā)布全球首個L4級自動駕駛大模型Apollo ADFM

2025量產(chǎn)L4 RoboTaxi,滴滴自動駕駛再進(jìn)一步

文遠(yuǎn)知行與聯(lián)想車計算共同推出L4級別自動駕駛解決方案

百舸爭流之勢!L3級自動駕駛進(jìn)入路測階段

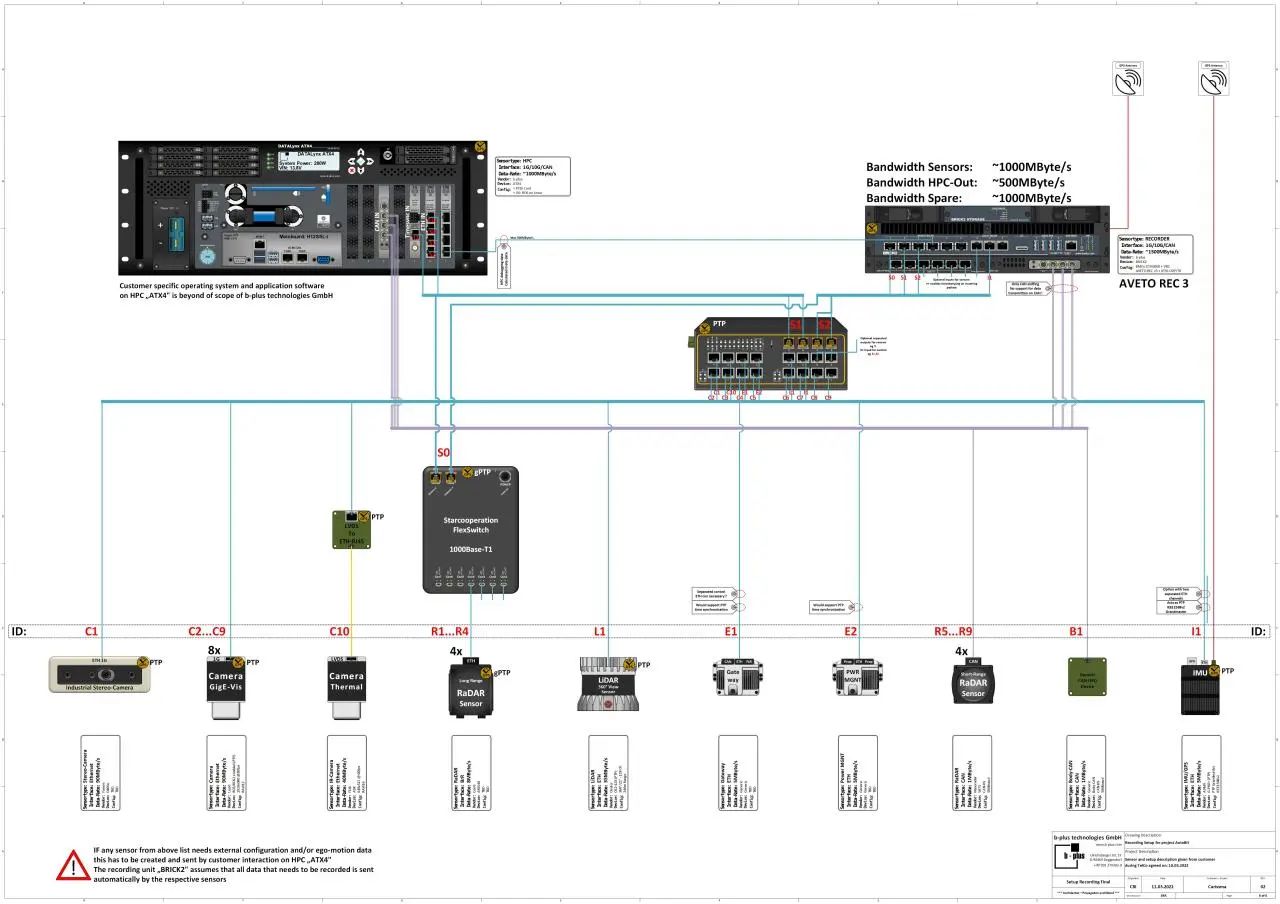

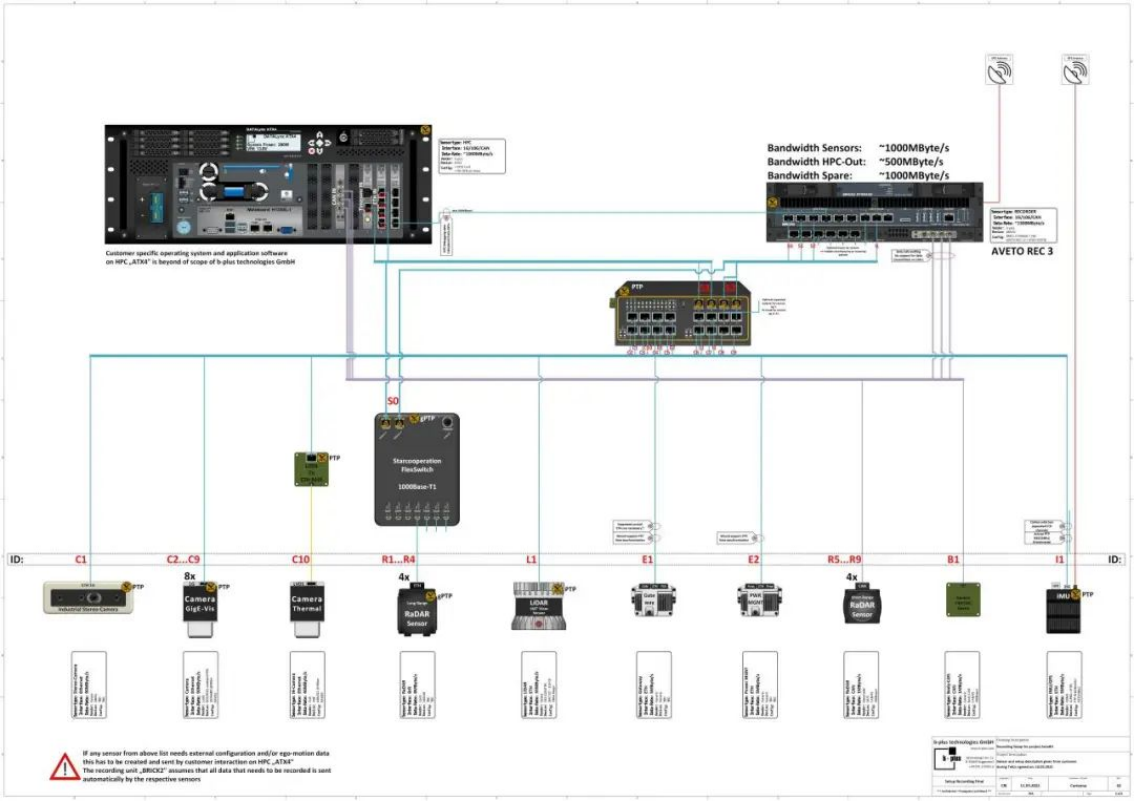

康謀方案 | L2進(jìn)階L3,數(shù)據(jù)采集如何助力自動駕駛

廣汽集團(tuán)獲得L3自動駕駛路測牌照

自動駕駛產(chǎn)業(yè)鏈爆發(fā)前夜?多家車企宣布已獲得L3級自動駕駛路測牌照

虹科方案丨L2進(jìn)階L3,數(shù)據(jù)采集如何助力自動駕駛

當(dāng)春節(jié)駕車返鄉(xiāng)擁有了L3/L4級自動駕駛

當(dāng)春節(jié)駕車返鄉(xiāng)擁有了L3/L4級自動駕駛

評論