摘要:車牌識別作為現代化智能交通系統中重要的環節,對提升路網效率以及緩解城市交通壓力等問題具有重要的社會意義,然而弱光照車牌圖像識別仍然具有重大的挑戰。構建了一個基于差分卷積神經網絡的弱光照車牌圖像增強網絡,將車牌的紋理信息解耦為水平垂直和對角線兩個方向,對不同尺度空間的低照度圖像進行紋理增強。為了避免增強結果局部過曝或低曝,該方法使用YCbCr顏色空間的損失函數來優化模型。

圖像增強實驗結果表明,所提出的方法較傳統的低照度圖像增強方法相比,圖像客觀質量結果峰值信噪比提升了0.47 dB。同時,在仿真車牌和真實場景的車牌識別實驗結果也證明了所提算法對于低照度圖像感知質量提升的有效性。

引言

隨著現代化進程的推進,中國的汽車數量大幅增加,相關的社會問題也日益突出,如交通阻塞、交通安全事故、能源消耗以及尾氣造成的環境污染等,因此面向城市公共交通規劃和管理的現代化智能交通系統應運而生。通過基于人工智能的算法對攝像頭等采集設備獲取的車輛圖像進行拍照,并進行車牌和型號等信息識別,應用于車輛監控和電子警察等場景,實現對車輛的智能化管理,有效提升路網的效率,減少車輛尾氣排放,實現對行人、車輛、道路和外部環境等四大交通因素進行合理規劃。

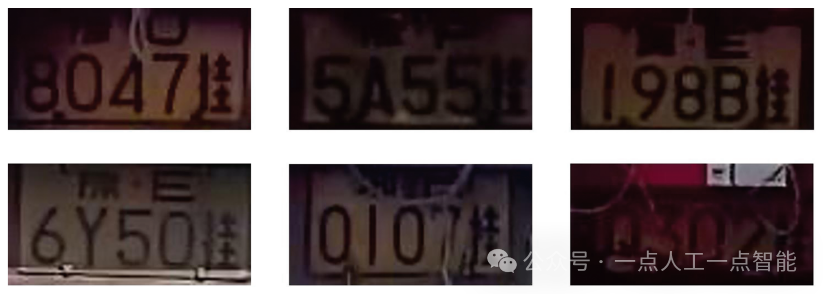

車牌識別技術是智能交通系統中最基礎也是最關鍵的技術之一,通過對車輛的車牌進行監管進而實現對汽車的監管,該技術也是近年來的研究熱點之一。然而中國的車牌主要由代表省份縮寫的中文、字母和數字組成,同時存在雙車牌和三車牌,相較于只由圖像和數字組成的車牌識別難度更高。且實際的車輛圖像采集場景較為復雜,如夜間或惡劣天氣下光線不足,圖像無法正常曝光,導致圖像中字符模糊難以精準識別,即低照度/弱光照圖像場景,真實成像場景下的弱光照車牌圖像如圖1所示,人眼亦無法準確識別車牌中的字符。

圖1弱光照車牌圖像

圖像增強技術能通過一種或者多種數據增強的方式來調整圖像的整體或局部特征[1],進而實現圖像的顏色、亮度、對比度和飽和度等增強,提升圖像的視覺質量。早期的低照度圖像增強方法主要分為基于直方圖均衡化的方法和基于Retinex理論的方法兩大類[2]。前者通過使用不同的先驗約束信息來提升圖像的對比度,如上下文信息[3]、差分信息[4],但無法有效去除圖像噪聲。后者模擬了人眼成像原理,提出圖像由不受光照影像的反射分量和代表像素動態范圍的照明分量組成假設,在保持反射分量不變的前提下增強照明分量,反推重建圖像,實現低照度圖像的增強,包括單一尺度Retinex[5]和多尺度Retinex[6-7]等框架。

近年來,隨著硬件設備以及深度學習理論的發展,卷積神經網絡憑借其強大的特征提取能力,在諸如動作檢測[8-9]、圖像融合[10]和目標檢測[11]等圖像視覺任務中取得了卓越的性能。考慮到高性能的深度學習模型依賴于大量訓練樣本,Lore等[12]提出了低照度圖像成像模型生成模擬數據,即低照度圖像由伽馬變換和圖像噪聲兩部分組成,并首次將卷積神經網絡引入到低照度圖像增強任務中,通過構建堆疊稀疏自編碼網絡,對低照度圖像進行增強和去噪,算法性能較傳統算法提升顯著。Wei等[13]基于Retinex理論構建了分解-修正卷積神經網絡,通過分解網絡將圖像分解為光照分量和反射分量,并使用修正網絡對光照分量進行修正,再與反射分量重建得到增強后的圖像。Lü等[14]提出了多分支網絡結構,分別從圖像的背景、結構和區域信息層面進行優化,進而提升重建圖像質量。Ren等[15]構建了內容和邊緣兩個分支,分別學習低光照圖像的內容和顯著性結構,使用感知損失優化生成令人愉悅的細節。Jiang等[16]首次將生成對抗網絡引入到非成對的低照度圖像增強任務中,通過構建全局-局部判決網絡,確保生成網絡生成更加真實的自然光,避免結果中出現局部過曝或低曝現象。

不同于通用的低照度圖像,車牌圖像由深色背景和字符組成,為了服務于后續車牌識別的感知應用,低照度車牌圖像增強任務應在光照恢復的基礎上增強字符的邊緣信息。本文以低照度的車牌圖像為研究對象,提出了一種基于差分卷積神經網絡的車牌圖像增強算法。與主流的圖像增強方法進行比較,在合成數據試驗中的主客觀結果均證明了所提方法的有效性,同時在真實的低照度增強車牌識別實驗中也證明了該算法的魯棒性和泛化性。

差分卷積神經網絡

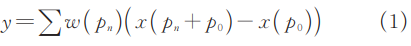

局部二值模式是一種傳統的手工特征提取算子,其原理為以局部某一像素為閾值,將鄰域像素與該像素進行差分比較,進而反映出細膩度的區域紋理信息,且該特征具有一定的魯棒性。Yu等[17]基于此思想提出了中心差分卷積應用于人臉活體檢測應用中,通過圖像的梯度來反映目標本質的細節信息。相較于普通的卷積模塊,差分特征具有更強的光照不變性以及細粒度。對于3×3的鄰域空間,差分卷積公式如下:

式中,y為輸出特征;x為輸入特征; 表示當前的空間位置;

表示當前的空間位置; 表示鄰域空間中其他的位置。

表示鄰域空間中其他的位置。

車牌圖像中的紋理信息相對簡單,而中心差分卷積的計算涉及了所有領域,因此存在較大的信息冗余。為了更好地優化網絡結構與效率,本文使用交叉的差分卷積模塊,將差分信息解耦為水平垂直方向和對角線方向,結構如圖2所示。其中,水平垂直方向的算子由中心像素點的相鄰點組成,對角線方向的算子則由鄰域空間中與中心像素點不相鄰的點組成。隨后,不同方向的差分信息以連接的形式進行特征融合。

圖2差分卷積

基于差分卷積的增強網絡

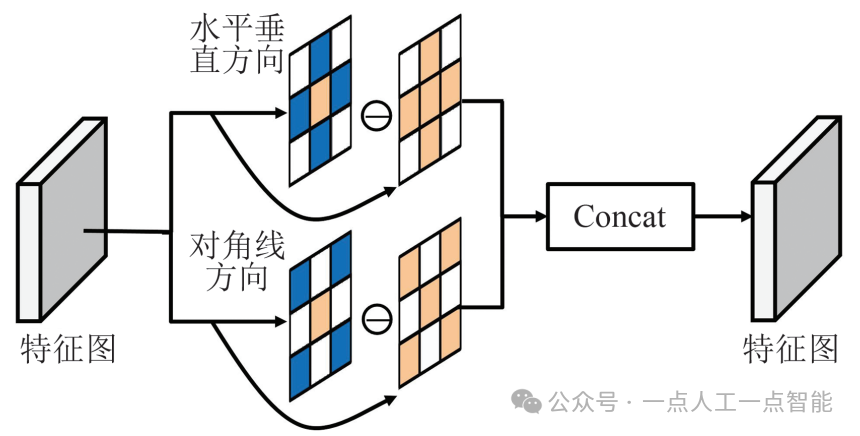

本文提出的基于差分卷積的增強網絡結構如圖3所示,該模型網絡由編碼網絡和解碼組成。對于訓練車牌圖像對{ },網絡目標生成增強車牌圖像

},網絡目標生成增強車牌圖像 ,其中

,其中 為低照度圖像,

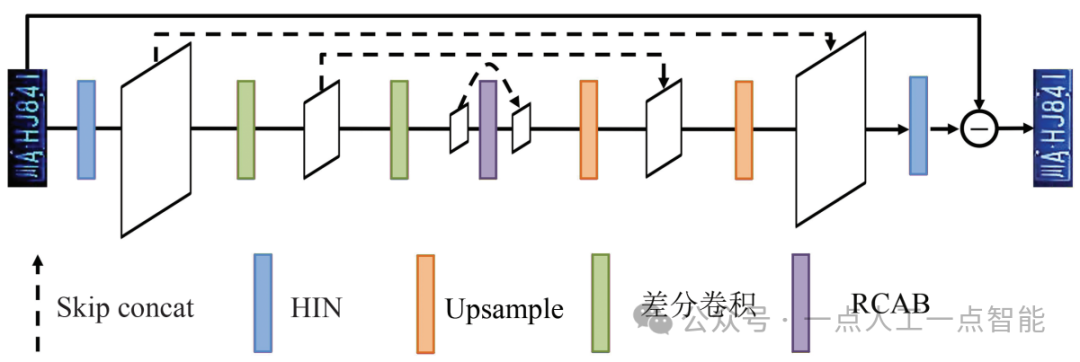

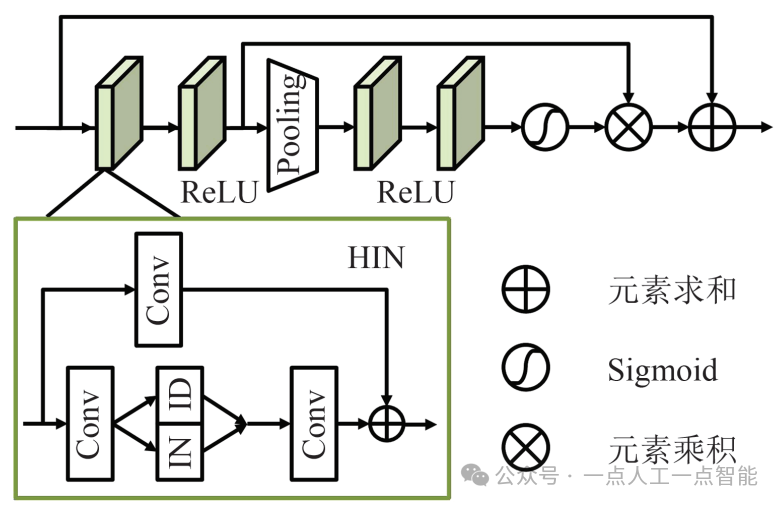

為低照度圖像, 為原始真值圖像。低照度圖像經由半實例歸一化模塊(half instance normalization,HIN)進行淺層特征提取,隨后輸入由兩個具有下采樣功能的差分卷積模塊組成的編碼網絡中,且所有的卷積核大小均為3×3×64。經過上述操作,輸出的特征分辨率降低了4倍。為進一步提取深度特征,下采樣后的特征被輸入至殘差通道注意力機制模塊(residual channel attention block,RCAB)中,網絡結構如圖4所示。

為原始真值圖像。低照度圖像經由半實例歸一化模塊(half instance normalization,HIN)進行淺層特征提取,隨后輸入由兩個具有下采樣功能的差分卷積模塊組成的編碼網絡中,且所有的卷積核大小均為3×3×64。經過上述操作,輸出的特征分辨率降低了4倍。為進一步提取深度特征,下采樣后的特征被輸入至殘差通道注意力機制模塊(residual channel attention block,RCAB)中,網絡結構如圖4所示。

圖3基于差分卷積的圖像增強網絡

圖4通道注意力機制模塊

不同于傳統的殘差模塊[18],半實例歸一化模塊使用3×3的卷積對輸入特征進行中間特征提取,隨后將中間特征劃分為均等的兩個部分。一部分使用實例歸一化方法進行歸一化處理,此操作不僅可以加速模型的收斂,還能保證不同特征之間的獨立性以及更多的尺度信息,而另一部分則不進行任何操作以保持內容信息,直接與歸一化的特征沿通道維度進行連接。然后使用3×3的卷積提取殘差特征與輸入特征的跳躍特征(經由1×1的卷積處理)相加得到最終輸出圖像特征。

普通卷積操作對于所有的特征通道和像素點賦予相同的權重,為了讓特征集中于感興趣的區域,本文使用了通道注意力機制模塊,通過全局池化層對圖像特征壓縮,并使用Sigmoid函數對注意力機制權重歸一化到0~1,并將特征圖與輸入特征相乘,實現通道層的特征縮放。

解碼網絡則由具有上采樣功能的卷積組成,且所有的卷積核大小均為3×3×64。為了避免網絡中信息的傳輸損失,編碼網絡和解碼網絡的多尺度特征直接進行跳躍連接,實現多尺度淺層特征和多尺度語義特征融合,從而盡可能恢復出車牌中的特征細節信息。

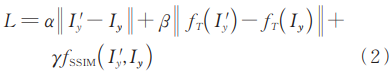

為了優化提出的深度學習模型,本文使用像素域、亮度域和結構域聯合損失函數,總體的損失函數公式如下:

式中, 為結構相似性(structural similarity,SSIM)損失函數;

為結構相似性(structural similarity,SSIM)損失函數; 、

、 和

和 為不同損失函數項之間的平衡參數,且

為不同損失函數項之間的平衡參數,且 =

= =1,

=1, =0.001。不同于RGB顏色空間,

=0.001。不同于RGB顏色空間, 表示將圖像從RGB顏色空間轉換到YCbCr顏色空間,并在亮度分量進行監督學習,促進亮度增強結果亮度更加自然。

表示將圖像從RGB顏色空間轉換到YCbCr顏色空間,并在亮度分量進行監督學習,促進亮度增強結果亮度更加自然。

實驗

4.1數據集

在本文中,數據集的訓練樣本包括高質量藍底和黃底的合成車牌圖像各10 000張,數量共計20 000張,合成車牌分辨率為800×280像素。同時為了提升算法的數據魯棒性,合成數據并非完全對齊。本文使用的驗證車牌數據集來自于真實場景監控視頻低照度圖像,主要包括雙行7字符的車牌和單行車牌兩類數據,其中單行車牌由7字符組成的藍色普通機動車車牌和8字符組成的綠色新能源汽車車牌。

真實數據集由于拍攝角度和距離的問題,圖像質量較合成數據差,主要由分辨率分別為96×32、96×48和96×64像素的圖像組成。考慮到真實場景圖像缺乏原始圖像,為了定量評估圖像增強算法的客觀性能,使用200張合成車牌圖像作為測試數據集,其中藍底和黃底各100張,測試圖像均被歸一化到96×48像素大小以模擬真實的拍攝場景。本文使用峰值信噪比(peak signal-to-noise ratio,PSNR)、SSIM和特征相似性(feature similarity,FSIM)來定量評估重建圖像的客觀結果。

為了增加低照度數據樣本數量,本文使用合成的車牌圖像作為真值,將圖像從RGB顏色空間轉換到YCbCr顏色空間,通過伽馬變換對Y顏色通道 的像素進行非線性變化得到

的像素進行非線性變化得到 ,隨后還原至RGB顏色空間,上述過程可以表示為:

,隨后還原至RGB顏色空間,上述過程可以表示為:

式中,A為常數;指數 為隨機圖像對比度控制參數,本文中取值范圍為[2,5]。生成的弱光照圖像如圖5所示。

為隨機圖像對比度控制參數,本文中取值范圍為[2,5]。生成的弱光照圖像如圖5所示。

圖5生成的弱光照圖像效果圖

4.2實現細節

本文的低照度增強方法均基于PyTorch框架,同時采用自適應矩估計(adaptive moment estimation,Adam)對模型進行優化,超參數設置為 =0.9,

=0.9, =0.999,訓練的批尺寸為16,初始學習率設置為1×10-4。模型的總迭代數設置為1 000個周期,學習率在第500個周期衰減為1×10-5。所有算法均運行于兩張顯存為12 GB的NVIDIA 2080ti,Intel(R)Core(TM)i7-7820X CPU@3.60 GHz,軟件配置為CUDA 10.2,CUDNN 7.5的Ubuntu 18.04服務器。圖像隨機裁剪41×41大小的圖像塊用于模型訓練。

=0.999,訓練的批尺寸為16,初始學習率設置為1×10-4。模型的總迭代數設置為1 000個周期,學習率在第500個周期衰減為1×10-5。所有算法均運行于兩張顯存為12 GB的NVIDIA 2080ti,Intel(R)Core(TM)i7-7820X CPU@3.60 GHz,軟件配置為CUDA 10.2,CUDNN 7.5的Ubuntu 18.04服務器。圖像隨機裁剪41×41大小的圖像塊用于模型訓練。

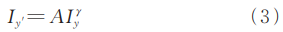

4.3圖像增強實驗結果

為了直觀地評估圖像增強結果,使用PSNR、SSIM和FSIM分別從像素、結構和特征三個層面進行定量分析,并與幾種具有代表性的基于深度學習圖像增強和圖像修復方法進行對比,包括LLCNN[19]、RDN[20]和SCI[21],結果如表1所示。可以看出,本文方法取得了最優的PSNR、SSIM和FSIM結果,相較于SCI[21]方法,客觀結果分別提升0.47 dB、0.000 1、0.000 8,表明了本文方法的有效性。

表1低照度圖像增強網絡的實驗結果對比

為了進一步驗證算法的性能,圖6展示了不同算法的低照度圖像增強主觀結果圖。從圖6可以看出,所有方法都能較好地恢復出車牌圖像的背景顏色,但本文方法能重建出更令人愉悅的視覺效果以及更清晰的字符紋理信息,如第一行車牌中的“渝A”和第二行車牌中的“8”,這也說明本文使用的差分卷積對于圖像紋理信息恢復的有效性。

圖6低照度增強結果圖

車牌處理應用任務對于模型和運行時間要求較高,本文方法在輸入96×48像素大小的車牌圖像時,使用NVIDIA 2080ti,算法的測試時間為0.009 4 s,滿足實時視頻處理對于幀數的要求。

4.4車牌識別實驗結果

§3.3從定量和定性兩個角度驗證了本文方法在圖像照度增強任務的有效性,本節使用由卷積遞歸神經網絡組成的飛槳PaddleHub中文字符識別網絡,通過車牌識別任務進一步驗證低照度增強對于車牌感知質量的提升。

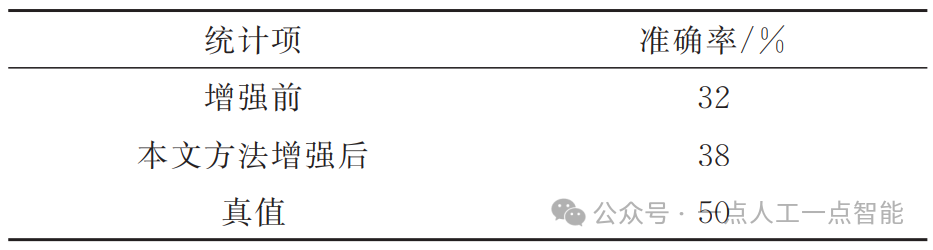

表2為圖像增強前后測試數據集下的車牌識別率結果,其中準確率為正確識別車牌數量與總車牌數量(共200張)之比。由表2中可知,增強后的車牌圖像相較于低照度車牌圖像的文字識別率提升了6%,這進一步證明本文方法對于圖像感知質量的提升。

表2圖像增強對車牌識別準確率的影響

為進一步對識別進行定性分析并探究數據的魯棒性,表3展示了PaddleHub對于車牌識別結果,其中圖片結果為合成車牌數據,預測結果為真實場景的車牌數據。代表省份縮寫的漢字相較于數字和英文字母更為復雜,如鄂、粵和藏等,這也導致低照度圖像中的漢字更容易錯分為其他字符,如“川”被錯識別為“H”,“鄂”被錯識別為“U”。置信度越大,表示預測的結果更可信,從表3中結果可以發現,低照度圖像的預測結果均獲得較大的置信度,這也說明低照度字符中具有判決性的特征被污染,導致錯分時置信度仍然較大。而增強后的圖像亮度顯著提升,無論是合成數據還是真實數據集,識別結果都更為準確,這也意味著圖像感知質量顯著提升,證明了本文提出的低照度增強網絡的有效性。

表3車牌識別結果

結語

車牌識別是智慧交通系統中的一個關鍵技術點,本文針對低照度環境下車牌識別難度較大的問題,提出了一種基于差分卷積神經網絡的低照度車牌圖像增強網絡。采用差分卷積將圖像中的差分信息解耦為水平垂直和對角線兩個方向,實現高效的邊緣信息提取。同時在通道注意力機制模塊和多尺度框架中引入半實例歸一化模塊,提升模塊的特征表達能力。

實驗從主觀、客觀和感知質量3個層面證明了本文方法在低照度車牌圖像增強任務中的有效性。未來希望面向更復雜的低照度交通場景,如運動模糊和噪聲,提出更具魯棒性和泛化能力的圖像修復模型。

-

神經網絡

+關注

關注

42文章

4765瀏覽量

100561 -

圖像增強

+關注

關注

0文章

54瀏覽量

10026

原文標題:基于差分卷積的弱光照車牌圖像增強

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

卷積神經網絡如何使用

卷積神經網絡模型發展及應用

卷積神經網絡簡介:什么是機器學習?

基于卷積神經網絡的圖像標注模型

基于差分卷積神經網絡的低照度車牌圖像增強網絡

基于差分卷積神經網絡的低照度車牌圖像增強網絡

評論