人工智能也許已經(jīng)破解了某些通常需要人類智慧的任務(wù)代碼,但是為了學(xué)習(xí),這些算法需要海量人類產(chǎn)生的數(shù)據(jù)。

算法根據(jù)數(shù)據(jù)中發(fā)現(xiàn)的模式來進(jìn)行分類或者做出預(yù)測。但這些算法的聰明程度只能跟訓(xùn)練它的數(shù)據(jù)相比。這也就意味著我們的限制——我們的偏見,我們的盲點(diǎn),我們的疏忽也會變成那些算法的。Danielle Groen詳細(xì)解釋了算法是如何產(chǎn)生偏見的,并且介紹了一些可能的解決方案。

算法的歧視

2010年秋天的一個早晨,Safiya Umoja Noble正坐在伊利諾斯州家中的餐桌上往Google里面輸入了幾個詞。她正準(zhǔn)備給自己14歲的繼女以及5位侄女準(zhǔn)備一次sleepover(在朋友家過夜的晚會)。既不想讓孩子們碰手機(jī),又擔(dān)心女孩們會直奔她的筆記本,Noble決定自己先查查看她們會發(fā)現(xiàn)些什么。她說:“我原先想搜搜‘黑人女孩’,因?yàn)檫@是我喜歡一群黑人小女孩。”

但這次無傷大雅的搜索出來的東西令人警醒:結(jié)果網(wǎng)頁整整一頁都是明顯色情的網(wǎng)頁。當(dāng)時(shí)任何人搜索黑人女孩都會得到一樣的東西。Noble說:“幾乎所有有色人種女孩的搜索結(jié)果都是超級色情的內(nèi)容,哪怕退一步說這也非常的令人失望。”現(xiàn)在是南加州大學(xué)傳播學(xué)教授的Noble說:“我只好把計(jì)算機(jī)也收起來,希望女孩子們不會提出要玩電腦的要求。”

大概與此同時(shí),在另一個地方,Joy Buolamwini也發(fā)現(xiàn)了另一個表示問題。這位父母來自加納、在加拿大出生的女計(jì)算機(jī)科學(xué)家意識到一些先進(jìn)的熱戀識別系統(tǒng),比如微軟使用的那些系統(tǒng),在檢測她的黑皮膚方面有很大的困難。有時(shí)候程序根本就不知道她的存在。當(dāng)時(shí)是喬治亞理工學(xué)院一名學(xué)生的她正在做一個機(jī)器人項(xiàng)目,結(jié)果發(fā)現(xiàn)本該要跟人類用戶玩躲貓貓的那個機(jī)器人沒法把她給辨認(rèn)出來。后來她只有靠室友的淺膚色的臉才完成了項(xiàng)目。

2011年,在香港的一家初創(chuàng)企業(yè)那里,她又用另一個機(jī)器人去試試自己的運(yùn)氣——結(jié)果還是一樣。4年后,身為MIT碩士研究生的她發(fā)現(xiàn)最新的計(jì)算機(jī)軟件仍然看不到她。不過當(dāng)Buolamwini敷上一種萬圣節(jié)用的白色面具時(shí),技術(shù)識別就很順利了。她靠化裝才完成了自己的項(xiàng)目。

臉部識別和搜索引擎只是人工智能的兩個應(yīng)用而已。這是一個訓(xùn)練計(jì)算機(jī)執(zhí)行通常只有人腦才能處理的任務(wù)的學(xué)科,牽涉到數(shù)學(xué)、邏輯、語言、視覺以及運(yùn)動技能等。(就像色情一樣,智能這東西很難定義,但是當(dāng)你看到時(shí)你就會知道。)無人車可能還沒那么快可以上路,但虛擬助手,比如Alexa等已經(jīng)可以幫你在喜歡的咖啡廳預(yù)定中午會議了。語言處理的改進(jìn)意味著你可以在手機(jī)用英語看一張翻譯過的俄羅斯報(bào)紙。推薦系統(tǒng)極其擅長根據(jù)你的品味選擇音樂或者建議Netflix系列片供你度過周末。

這些評估會影響我們的生活,但這并不是AI系統(tǒng)介入的唯一領(lǐng)域。在某些情況下,要緊的只是我們的時(shí)間:比方說,當(dāng)你打電話給銀行請求支持時(shí),你在等待列表中的位置未必是順序的,而是要取決于你作為客戶對銀行的價(jià)值如何。(如果銀行認(rèn)為你的投資組合更有前途的話,你的等待時(shí)間也許就只有3分鐘而不是11分鐘)但是AI也日益影響到我們的就業(yè)、我們對資源的使用以及我們的健康。

申請跟蹤系統(tǒng)掃描簡歷,尋找關(guān)鍵字以便為招聘經(jīng)理排出一個短名單。算法還在評估誰有資格拿到貸款,數(shù)倍追究欺詐責(zé)任。風(fēng)險(xiǎn)預(yù)測模型識別哪一位病人更有可能在45天內(nèi)再次入院并且能從免費(fèi)照顧與延續(xù)服務(wù)中受益最大。

AI還告訴當(dāng)?shù)鼐胶桶踩块T該去哪里。2017年3月,加拿大邊境服務(wù)局宣布將在最繁忙的國際機(jī)場實(shí)現(xiàn)人臉識別軟件;好幾個地方的報(bào)攤現(xiàn)在開始用這套系統(tǒng)來確認(rèn)護(hù)照身份,“提供自動化的旅行者風(fēng)險(xiǎn)評估”。自2014年開始卡爾加里警方已經(jīng)運(yùn)用人臉識別將視頻監(jiān)控與面部照片進(jìn)行比對,去年秋天,多倫多警察服務(wù)局宣布將用部分撥款實(shí)現(xiàn)類似技術(shù)。

跟傳統(tǒng)警方僅對已發(fā)生事件作出反應(yīng)不同,預(yù)測性治安維護(hù)會依靠歷史模式和統(tǒng)計(jì)建模在某種程度上預(yù)測哪一個街區(qū)的犯罪風(fēng)險(xiǎn)更高,然后引導(dǎo)巡邏車去到那些熱點(diǎn)。美國的主要轄區(qū)已經(jīng)推出了這一軟件,去年夏天,溫哥華成為加拿大推出類似舉措的首座城市。

這些技術(shù)因其效能、成本效益、可伸縮性以及有望帶來中立性而受到重視。AI初創(chuàng)企業(yè)Integrate.ai的產(chǎn)品副總裁Kathryn Hume說:“統(tǒng)計(jì)系統(tǒng)有一層客觀性與權(quán)威性的光環(huán)。”人類決策有可能會混亂、不可預(yù)測,并且受到情緒或者午飯過去多少小時(shí)的影響,而“數(shù)據(jù)驅(qū)動算法卻展現(xiàn)了一個不受主觀性或者偏見影響的未來。但情況其實(shí)沒那么簡單。”

人工智能可能已經(jīng)破解了通常需要人類智慧的某些任務(wù)的代碼,但為了能學(xué)習(xí),這些算法需要人類產(chǎn)生的大量數(shù)據(jù)。它們大量吸收各種信息,仔細(xì)搜查以便找出其中的共性和關(guān)聯(lián),然后基于檢測出的模式提供分類或預(yù)測(是否癌癥,是否會拖欠還款)。但是AI的聰明程度智能跟訓(xùn)練它們的數(shù)據(jù)一樣,這就意味著我們的限制——我們的偏見、盲點(diǎn)以及疏忽,也會變成它們的。

今年早些時(shí)候,Buolamwini跟一位同事一起發(fā)表了對三項(xiàng)領(lǐng)先的臉部識別程序(分別由微軟、IBM和Face++開發(fā))進(jìn)行測試的結(jié)果。測試要驗(yàn)證的是識別不同膚色種族性別的能力。超過99%的時(shí)間內(nèi),系統(tǒng)哦歐能都能正確識別出淺膚色的人。但是考慮到數(shù)據(jù)集嚴(yán)重向白人男性傾斜,這個成績就不算什么了。

在另一個受到廣泛使用的數(shù)據(jù)集里,那個用于訓(xùn)練識別的照片是一個78%為男性,84%為白人的照片集。當(dāng)Buolamwini用黑人女性的照片測試這些程序時(shí),算法的出錯率接近34%。而且膚色越黑,程序的表現(xiàn)越差,錯誤率一直都在47%左右——這幾乎跟拋硬幣差不多了。系統(tǒng)看到一位黑人女性時(shí)并不能死別出來。

因?yàn)檫@些程序都是公開的,所以Buolamwini可以計(jì)算出這些結(jié)果,然后她可以用自己的1270張照片去測試他們。她的照片集由非洲政治家和辦公室女性占比很高的北歐國家組成,為的是看看程序表現(xiàn)如何。這是一個評估某些情況下為什么技術(shù)會預(yù)測失敗的難得機(jī)會。

但是透明性是例外,不是規(guī)則。商用應(yīng)用(我們用來找工作、評信用和貸款等服務(wù))使用的絕大部分AI系統(tǒng)都是專有的,其算法和訓(xùn)練數(shù)據(jù)是公眾看不到的。所以個人要想質(zhì)詢機(jī)器的決定或者想了解用帶人類偏見的歷史例子訓(xùn)練出來的算法何時(shí)不利于自己是極其困難的。想證明AI系統(tǒng)違反了人權(quán)?研究倫理、法律及技術(shù)的加拿大首席研究員Ian Kerr說:“大多數(shù)算法都是黑箱。”因?yàn)?a target="_blank">公司會利用政府或商業(yè)機(jī)密法律來保守算法的模糊。但他補(bǔ)充道“即便組織提供完全透明,算法或AI本身也是不可解釋或者不可理解的。”

最近出版了新書《壓迫的算法》的Noble說,大家過去也主張過自身權(quán)利,反對歧視性的貸款行為。“現(xiàn)在我們又遇到了類似歧視性的決策,只不過它是由難以理解的算法做出的——而且你還沒法呈堂證供。我們正日益陷入到那些系統(tǒng)的包圍之中——它們做出決定,給我們打分,但其實(shí)他們也是人類的產(chǎn)品,只不過我們越來越看不清楚那背后的人。”

從專家系統(tǒng)到深度學(xué)習(xí)

如果你想造一臺智能機(jī)器的話,從挖掘一位聰明人的知識開始不算壞主意。1980年代,開發(fā)者在AI方面就取得了一些早期突破,也就是所謂的專家系統(tǒng),由有經(jīng)驗(yàn)的診斷醫(yī)生或者機(jī)械工程師幫助設(shè)計(jì)代碼去解決特定問題。可以想想看恒溫器是如何工作的:它可以按照一系列的規(guī)則將房子保持在恒定的溫度或者當(dāng)有人進(jìn)入時(shí)排出暖氣。聽起來似乎很不錯,但其實(shí)這只是規(guī)則和傳感器的小花招罷了——如果[溫度低于X]則[加熱到Y(jié)]。恒溫器既不識天象也也不知道你下班后的安排,它沒法適配自己的行為。

機(jī)器學(xué)習(xí)則是人工智能的另一個分支,它通過分析模式而不是系統(tǒng)應(yīng)用規(guī)則來教計(jì)算機(jī)執(zhí)行任務(wù)。這通常是通過所謂的有監(jiān)督學(xué)習(xí)實(shí)現(xiàn)的。這個過程還需要人類的參與:程序員必須整理數(shù)據(jù),也就是輸入,給它分配標(biāo)簽,也就是輸出,這樣一來系統(tǒng)就知道要找什么了。

比方說我們的計(jì)算機(jī)科學(xué)家想開發(fā)一套能夠區(qū)分草莓和香蕉的水果沙拉對象識別系統(tǒng)。那么他就得選擇特征——姑且定為顏色和形狀——這跟水果是高度關(guān)聯(lián)的,靠這兩個機(jī)器就能識別水果。他給紅色圓形的對象的圖片打上草莓的標(biāo)簽,把黃色長條的圖片打上香蕉的標(biāo)簽,然后他寫了一些代碼分配一個值來表征顏色,另一個來歸納形狀。他把大量的草莓和香蕉圖片喂給機(jī)器,后者從而建立起對這些特征關(guān)系的理解,從而可以對自己要找什么樣的水果做出有根據(jù)的猜測。

一開始的時(shí)候系統(tǒng)表現(xiàn)不會太好;它需要通過一組有力的例子去學(xué)習(xí)。我們的監(jiān)督者計(jì)算機(jī)科學(xué)家知道,這個特別的輸入是草莓,所以如果程序選擇了香蕉的輸出,他會因?yàn)榻o出錯誤答案而懲罰計(jì)算機(jī)。根據(jù)這個新信息,系統(tǒng)會調(diào)整自己做出的特征之間的連接從而下次改進(jìn)預(yù)測。由于一對輸出并不是什么難事,很快機(jī)器就能夠正確識別出自己從未見過的草莓和香蕉了。

貴湖大學(xué)機(jī)器學(xué)習(xí)研究小組負(fù)責(zé)人GrahamTaylor說:“一些東西很容易概念化并且編程實(shí)現(xiàn)。”但是你可能希望系統(tǒng)能夠識別比水果更復(fù)雜的對象。也許你希望在海量的面孔中識別出一張臉。Taylor說:“于是就引出了深度學(xué)習(xí)。它擴(kuò)展到非常龐大的數(shù)據(jù)集,迅速解決問題,并且不受定義規(guī)則的專家知識的限制。”

深度學(xué)習(xí)時(shí)機(jī)器學(xué)習(xí)的一個極其熱門的分支,它的出現(xiàn)其實(shí)是受到了我們?nèi)四X機(jī)制的啟發(fā)。簡而言之,大腦是一個數(shù)十億神經(jīng)元用數(shù)萬億突觸連接起來的集合,而那些連接的相對強(qiáng)度——比如紅色與紅色水果之間,以及紅色水果與草莓之間的連接——都是通過逐漸的學(xué)習(xí)過程進(jìn)行調(diào)整的。

深度學(xué)習(xí)系統(tǒng)依靠的是這種神經(jīng)網(wǎng)絡(luò)的電子模型。深度學(xué)習(xí)領(lǐng)域的先驅(qū)之一Yoshua Bengio說:“在你的大腦里,神經(jīng)元會發(fā)送信息給其他神經(jīng)元。”一對神經(jīng)元之間的信號強(qiáng)弱叫做突觸權(quán)重:當(dāng)權(quán)重很大時(shí),一個神經(jīng)元就會對另一個神經(jīng)元產(chǎn)生強(qiáng)大影響;而當(dāng)它很小時(shí),影響力也會很小。他說:“通過改變這些權(quán)重,不同神經(jīng)元之間的連接強(qiáng)度也會改變。這就是AI研究人員想到的用來訓(xùn)練這些人工智能網(wǎng)絡(luò)的點(diǎn)子。”

這就是AI能夠從對草莓香蕉分類進(jìn)展到識別面部的辦法之一。一位計(jì)算機(jī)科學(xué)家提供標(biāo)簽化的數(shù)據(jù)——所有那些跟正確名字掛鉤的臉部。但是他不是要求也是告訴機(jī)器照片中哪些特征對識別很重要,計(jì)算機(jī)就會完全靠自己來析取出那些信息。Taylor說:“在這里你的輸入是面部的照片,然后輸出就是關(guān)于這個人是誰的決定。”

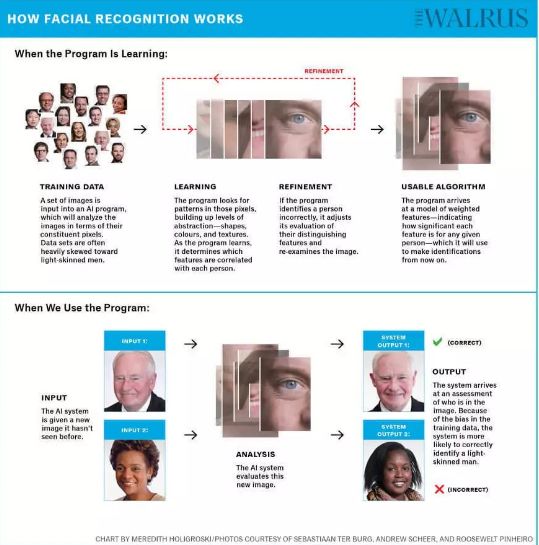

人臉識別的機(jī)制:1)機(jī)器學(xué)習(xí)時(shí):訓(xùn)練數(shù)據(jù)——學(xué)習(xí)——調(diào)整——形成有用的算法;2)使用程序時(shí):輸入——分析——輸出

為了從輸入走到輸出,圖像要經(jīng)過幾次轉(zhuǎn)換。他說:“圖像首先要轉(zhuǎn)換成非常低級的表征,只是枚舉邊的類型和位置。”接下來可能是那些邊線的邊角和交叉點(diǎn),再就是形成形狀的邊線的模式。幾個圓圈可能最后會成為一只眼睛。Taylor解釋說:“在特征方面每一層的表示都是不同程度的抽象,這樣一直到你得到非常高級的特征,那些開始看起來代表著身份的東西——比如發(fā)型和下巴輪廓——或者像面部勻稱性這樣的屬性。”

這整個過程是怎么發(fā)生的呢?數(shù)字。數(shù)量多到令人難以置信的數(shù)字。比方說,一套人臉識別系統(tǒng)會按照像素級別來分析一張圖像。(百萬像素級攝像頭使用1000x1000像素的網(wǎng)格,每一個像素都有紅綠藍(lán)三基色的值,每個值的范圍在0到255之間,所以這里面的信息量有多大可想而知)系統(tǒng)通過這些表示層分析像素,構(gòu)建抽象,直到最后自己做出識別。

不過請等一下,盡管這張臉很顯然是Christopher Plummer,但機(jī)器卻以為它是Margaret Trudeau。Taylor說:“模型一開始的時(shí)候表現(xiàn)非常糟糕。我們可以從給它看圖片然后問誰在里面開始,但在經(jīng)過訓(xùn)練或者完成任何學(xué)習(xí)之前,機(jī)器會一直給出錯誤的答案。”這是因?yàn)樵谒惴ㄒ娦е埃W(wǎng)絡(luò)上人工神經(jīng)元之間的權(quán)重是隨機(jī)設(shè)定的。

經(jīng)過一個逐步試錯的過程之后,系統(tǒng)調(diào)整了不同層之間的連接的強(qiáng)度,所以當(dāng)它看到另一幅Christopher Plummer的圖片時(shí),它表現(xiàn)得稍微好點(diǎn)了。小的調(diào)整稍微改善了一下連接,把錯誤率稍微降低了一點(diǎn),直到最后系統(tǒng)可以用很高的準(zhǔn)確率識別出臉部。正是因?yàn)檫@項(xiàng)技術(shù),F(xiàn)acebook會在一張圖片中有你時(shí)向你發(fā)出提醒,哪怕你還沒有被打上標(biāo)簽。Taylor說:“深度學(xué)習(xí)很酷的一點(diǎn)是,我們不需要在有人說‘哦,這些特征對識別特定的臉很有用’的情況下析取出一切。這都是自動發(fā)生的,這就是它的神奇之處。”

帶偏見的數(shù)據(jù)

這里有個小花招:往Google Images里面輸入CEO你會變出一堆幾乎難以分辨的白人男性面孔。如果你是在加拿大,你會看到剩下起到點(diǎn)綴作用的大部分都是白人女性,以及少數(shù)有色人種,還有神奇女俠的蓋爾·加朵。去年在加州舉行的一場機(jī)器學(xué)習(xí)會議上,一名演講者必須在一堆穿著深色西裝的白人男性中向下翻滾了很久之后才找到了第一位女俠。CEO芭比。

數(shù)據(jù)對于AI系統(tǒng)的運(yùn)作必不可少。系統(tǒng)越復(fù)雜——神經(jīng)網(wǎng)絡(luò)的層數(shù)就越多,要想翻譯語音或者識別面部或者計(jì)算某人拖欠貸款的可能性——需要收集的數(shù)據(jù)就越多。程序員可能要依靠圖庫或者危機(jī)百科條目、歸檔的新聞文章或者音頻記錄。他們可能會看大學(xué)招生的歷史和假釋記錄。它們想要臨床研究和信用評分。McGill計(jì)算機(jī)科學(xué)學(xué)院的Doina Precup教授說:“數(shù)據(jù)非常非常重要,(數(shù)據(jù)越多,)解決方案越好。”

但并不是每個人都能夠公平地得到那些數(shù)據(jù)的表示。有時(shí)候,這是由來已久的排斥的結(jié)果:2017年,女性在財(cái)富500強(qiáng)中的占比僅為6.4%,但這已經(jīng)比上一年的數(shù)字增長了52%。

直到1997年之前加拿大衛(wèi)生部都沒有明確要求女性納入到臨床試驗(yàn)里面;據(jù)中風(fēng)基金會的《2018心臟報(bào)告》,2/3的心臟病臨床研究仍然以男性為主,這幫助解釋了為什么最近的一項(xiàng)研究發(fā)現(xiàn)超過一半女性并沒有那些心臟病的癥狀。既然我們知道女性被排除在那些高層和試驗(yàn)之外,說她們的缺席會令任何用這些數(shù)據(jù)訓(xùn)練的系統(tǒng)的結(jié)果產(chǎn)生扭曲就是安全的假設(shè)了。

有時(shí)候,就算有充足的數(shù)據(jù),那些建立訓(xùn)練集的人仍然不會采取審慎的舉措去保證多樣性,這導(dǎo)致了人臉識別程序在面對不同人群時(shí)會出現(xiàn)差異很大的錯誤率。其結(jié)果就是所謂的取樣偏差,這是由于缺乏代表性數(shù)據(jù)導(dǎo)致的。算法優(yōu)化是為了盡可能少犯錯;其目標(biāo)是降低錯誤數(shù)。但是數(shù)據(jù)的構(gòu)成決定了算法將注意力引導(dǎo)到哪里去。

多倫多大學(xué)計(jì)算機(jī)科學(xué)教授Toniann Pitassi的研究重點(diǎn)是機(jī)器學(xué)習(xí)的公平性,他提供了一個招生計(jì)劃的例子。Pitassi說:“比方說你有5%的黑人申請,如果這所大學(xué)95%的申請都是白人的話,則幾乎你所有的數(shù)據(jù)都將是白人的。在決定誰應(yīng)該進(jìn)入大學(xué)這件事情上算法試圖在整體上考慮將自己的錯誤最小化。但是它不會投入太多的努力到那5%上面,因?yàn)檫@對總體錯誤率的影響很小。”

猶他大學(xué)計(jì)算學(xué)院的Suresh Venkatasubramanian教授解釋說:“很多算法是通過看在訓(xùn)練數(shù)據(jù)中自己得到了多少正確答案來進(jìn)行訓(xùn)練的。這很好,但如果你只是把答案累計(jì)的話,就會有一部分小群體總是會有問題。這么做對你的傷害不太大,但是因?yàn)槟阆到y(tǒng)性的對那一小群人的全體犯錯,錯誤決定的影響就要比你的錯誤分散到多個群體的影響嚴(yán)重多了。”

正是因?yàn)檫@個原因,Buolamwini人肉干發(fā)現(xiàn)IBM的臉部識別技術(shù)準(zhǔn)確率為87.9%。當(dāng)一個系統(tǒng)識別淺膚色女性的準(zhǔn)確率為92.9%,識別淺膚色男性的準(zhǔn)確率為99.7%時(shí),黑人女性的識別率僅為35%就無關(guān)緊要了。微軟的算法也一樣,她發(fā)現(xiàn)其預(yù)測性別的準(zhǔn)確率為93.7%。但Buolamwini發(fā)現(xiàn),那些性別錯誤中幾乎有同樣的比例——93.6%是發(fā)生在深膚色受試者的臉上。但是算法并不需要關(guān)心這個。

垃圾進(jìn),垃圾出

在跟人工智能專家花費(fèi)了足夠多的時(shí)間進(jìn)行了足夠深入的對話之后,到了一定時(shí)候,他們都會得出一條公理:垃圾進(jìn),垃圾出。繞開樣本偏差確保系統(tǒng)基于豐富的均衡數(shù)據(jù)而進(jìn)行訓(xùn)練是有可能的,但如果數(shù)據(jù)受到我們社會的偏見和歧視困擾的話,則算法也好不到哪里去。Precup說:“我們想要的是忠于現(xiàn)實(shí)的數(shù)據(jù)。”而當(dāng)現(xiàn)實(shí)存在偏見時(shí),“算法別無選擇,只有反映那種偏見。算法就是這么做出來的。”

偶爾,所反映出來的偏見在預(yù)測性方面幾乎是很滑稽的。Web搜索,聊天機(jī)器人,給圖像加字幕程序,機(jī)器翻譯等日益依賴于一種叫做詞嵌入的技術(shù)。這是通過把單詞之間的關(guān)系變成數(shù)值,然后讓系統(tǒng)已數(shù)學(xué)的方式表示語言的社會背景。通過這項(xiàng)技術(shù),AI系統(tǒng)了解到了巴黎和法國之間的關(guān)系,以及東京與日本之間的關(guān)系;它能覺察到東京與巴黎之間的不同聯(lián)系。

2016年,波士頓大學(xué)和微軟研究院的研究人員把來自于Google News文字的超過300萬個英語單詞提供給一個算法,他們先是提供一段使用得最多的話,然后讓算法填空。他們問道:“男人之于計(jì)算機(jī)程序員正如女人之于什么?”機(jī)器在那堆單詞里面折騰了半天之后給出的答案是家庭主婦。

這些統(tǒng)計(jì)關(guān)聯(lián)就是所謂的隱含偏差:這就是為什么一所人工智能研究機(jī)構(gòu)的圖像收集將烹飪與女性招聘關(guān)聯(lián)起來的可能性會增加68%的原因,這也解釋了Google Translate在使用性別中立的代詞的語言時(shí)為什么會遇到麻煩。

土耳其語的句子不會指明醫(yī)生是男性還是女性,但是英語翻譯會假定,如果屋子里有個醫(yī)生的話,那他一定是個男的。這種推測延伸到了網(wǎng)上到處跟蹤我們的廣告身上。2015年,研究人員發(fā)現(xiàn),在許諾薪水高于20萬美元的Google工作崗位廣告里面,男性出現(xiàn)的機(jī)率比女性高6倍。

Kathryn Hume說,系統(tǒng)的威力在于其“識別性別與職業(yè)之間的關(guān)聯(lián)的能力。其不好之處在于系統(tǒng)背后是沒有目的性的——只是由數(shù)學(xué)來選擇關(guān)聯(lián)。它并不知道這是個敏感問題。”這種技術(shù)存在著未來主義和陳舊作風(fēng)的沖突。AI的演進(jìn)速度要比它要處理的數(shù)據(jù)的演進(jìn)快得多,所以這注定了它不僅折射和反映出過去的偏見,而且還延長并加強(qiáng)了它們。

因此,當(dāng)判斷被移交給機(jī)器之后,那些曾經(jīng)是包括警察、法院在內(nèi)的機(jī)構(gòu)系統(tǒng)性歧視目標(biāo)的群體并不能得到更好的對待。多倫多大學(xué)犯罪學(xué)和社會法學(xué)研究中心的Kelly Hannah-Moffat教授說:“那種認(rèn)為可以制造出公平客觀的AI工具的看法是有問題的,因?yàn)槟銜逊缸锇l(fā)生的背景簡化成是或否的二元性。

我們都知道種族跟盤查政策、梳理以及更嚴(yán)格的警方檢查相關(guān),所以如果你正在研究跟警察的接觸或者之前的逮捕率時(shí),其實(shí)你看的已經(jīng)是一個帶偏見的變量。”一旦那個變量被納入到機(jī)器學(xué)習(xí)系統(tǒng)里面,偏見就被嵌入到算法評估之中。

兩年前,美國調(diào)查新聞機(jī)構(gòu)ProPublica仔細(xì)審查了一個使用廣泛的程序,其名字叫做COMPAS,這個程序被用來確定被告再犯的風(fēng)險(xiǎn)。記著收集了超過7000名在佛羅里達(dá)州被捕的人的分?jǐn)?shù),然后評估其中有多少人在隨后2年實(shí)施了犯罪——使用的是跟COMPAS一樣的基準(zhǔn)。他們發(fā)現(xiàn),算法存在很大的缺陷:黑人被告被錯誤地標(biāo)記為存在再犯的高風(fēng)險(xiǎn)的機(jī)率是實(shí)際的2倍多。相反,被標(biāo)記為低風(fēng)險(xiǎn)的白人被告在隨后被指控犯罪的情況是其估計(jì)的2倍。

美國已經(jīng)有5個州靠COMPAS來進(jìn)行刑事司法判決,其他轄區(qū)也已經(jīng)有其他的風(fēng)險(xiǎn)評估程序就位。加拿大因?yàn)槿匀谎赜眠^時(shí)的體系,所以還沒有受到有問題的算法之影響。

實(shí)現(xiàn)算法公平

要想實(shí)現(xiàn)算法的公平性,程序員可以簡單地摒棄種族和性別這樣的屬性。但根深蒂固的歷史關(guān)聯(lián)——那種將女性與廚房關(guān)聯(lián),或者將一部分人口跟特定郵編關(guān)聯(lián)的做法,使得系統(tǒng)很容易就能弄清楚這些屬性,哪怕這些屬性已經(jīng)被移除了。所以計(jì)算機(jī)科學(xué)家弄出的這種解決方案令人想到管弦樂世界的盲聽:為了掩飾某人的身份,他們豎起了一道幕布。

深度學(xué)習(xí)先驅(qū)Yoshua Bengio說:“假設(shè)我們考慮到種族是歧視的因素之一,如果我們在數(shù)據(jù)里面看到這個的話,我們就可以衡量它。”可以往神經(jīng)網(wǎng)絡(luò)里面添加另一個約束,強(qiáng)迫它忽視有關(guān)種族的信息,不管這種信息是不是隱含的(比如郵編)。Bengio說,這種方案無法對這些受保護(hù)的特征建立完全的不敏感性,但是還是做了相當(dāng)好的工作。

其實(shí)現(xiàn)在已經(jīng)有越來越多的研究在設(shè)法用算法性解決方案來解決算法性偏見問題。其中反設(shè)事實(shí)可能是手段之一——讓算法分析如果女性獲得貸款的話會發(fā)生什么,而不是簡單地去梳理過去發(fā)生的事情。這可能意味著要給算法它增加約束,確保它在犯錯時(shí)這些錯誤是均勻分布到每一種代表群體里面的。給算法增加不同的約束來降低閾值是有可能的,比方說對特定群體的大學(xué)錄取率,從而保證達(dá)到代表性的百分比——姑且稱之為算法性平權(quán)行動。

盡管如此,算法干預(yù)也只能到此為止;解決偏見還需要訓(xùn)練機(jī)器的程序員的多樣性。McGill教授Doina Precup說:“這甚至還不是說意圖不好,只是那些沒有來自特定背景的人完全就沒意識到那種背景會是什么樣的,也不了解這會如何影響著一切。”如果數(shù)據(jù)集匯編進(jìn)來的時(shí)候Joy Buolamwini在場的話,她當(dāng)場就能發(fā)現(xiàn)那尖端的臉部識別技術(shù)在黑膚色的表現(xiàn)太過糟糕。

《壓迫的算法》作者Safiya Noble補(bǔ)充說:“我們對種族主義和性別歧視的理解不夠深入時(shí)可能會出現(xiàn)的風(fēng)險(xiǎn)遠(yuǎn)不止是公關(guān)混亂以及偶爾的新聞頭條。這不僅意味著公司失去了更深入更多元化的消費(fèi)者參與的可能性,而且有可能他們也沒有意識到自己的產(chǎn)品和服務(wù)已經(jīng)成為了會對社會造成破壞的權(quán)力體系的一部分。”

對算法性偏見認(rèn)知的增強(qiáng)不僅是干預(yù)我們AI系統(tǒng)開發(fā)方式的一個機(jī)會。這也是一個質(zhì)詢的好機(jī)會,質(zhì)詢?yōu)槭裁次覀儎?chuàng)建的數(shù)據(jù)會像這樣,質(zhì)詢還有哪些偏見在繼續(xù)塑造一個允許這些模式在數(shù)據(jù)中出現(xiàn)的社會。畢竟,算法只是一組指令罷了。Bengio強(qiáng)調(diào):“我們使用的算法是中立的。不中立的是(神經(jīng))網(wǎng)絡(luò),只要用帶偏見的數(shù)據(jù)對它進(jìn)行過訓(xùn)練之后,渦輪就不再中立了。我們充滿著各種偏見。”

這正是為什么我們要非常非常當(dāng)心自己收集的數(shù)據(jù)的原因。今年3月,微軟領(lǐng)導(dǎo)的一群研究人員參加在舊金山舉行的一場會議時(shí)提出了一個可能的解決方案。因?yàn)樽R別數(shù)據(jù)集創(chuàng)建方式缺乏標(biāo)準(zhǔn),也沒有警示可能存在偏見的警告標(biāo)簽,他們提出做一張包含有公共數(shù)據(jù)集和商用軟件的數(shù)據(jù)表。文檔將明確說明訓(xùn)練數(shù)據(jù)集是什么時(shí)候在哪里以及如何匯編出來的,并且提供使用的受試者的人口統(tǒng)計(jì)信息,提供必要的信息給研究人員和組織,從而確定如何利用數(shù)據(jù)集以及在和背景下加以使用。

在歐洲,已經(jīng)出臺了一部全新的隱私法律,General Data Protection Regulation(GDPR,通用數(shù)據(jù)保護(hù)條例)規(guī)定要限制對敏感數(shù)據(jù)的手機(jī),要求對算法決策進(jìn)行解釋,并且保護(hù)個人不會被機(jī)器唯一來決定。

當(dāng)然,還有一種優(yōu)雅簡潔且公平公正的解決方案:獲得更好的數(shù)據(jù)。這就是Joy Buolamwin的發(fā)現(xiàn)指責(zé)IBM的人臉識別系統(tǒng)在性別和膚色平衡上做的不夠之后發(fā)生的事情。這家公司目前正在提高用于訓(xùn)練的圖片集的廣泛性。后來拿瑞典、芬蘭、南非、塞內(nèi)加爾等過議員的照片去測試這套新系統(tǒng)時(shí),算法執(zhí)行得很好,這一點(diǎn)并不奇怪。可喜的是對所有人都是。

雖然不夠完美:深膚色的女性錯誤率依然是最高的,3.46%。但這比之前已經(jīng)改進(jìn)了10倍——這已經(jīng)遠(yuǎn)遠(yuǎn)足以證明改變是有可能的,只要你把它當(dāng)作優(yōu)先事項(xiàng)。哪怕是不徹底的智能機(jī)器都知道這一點(diǎn)。

-

人工智能

+關(guān)注

關(guān)注

1791文章

46859瀏覽量

237579 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5492瀏覽量

120977

原文標(biāo)題:本應(yīng)公平公正的 AI,從數(shù)據(jù)中學(xué)會了人類的偏見

文章出處:【微信號:AItists,微信公眾號:人工智能學(xué)家】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

人類智慧水平AI即將到來,AI芯片已提前布局

AI大模型的倫理與社會影響

AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第4章-AI與生命科學(xué)讀后感

《AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第二章AI for Science的技術(shù)支撐學(xué)習(xí)心得

《AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第一章人工智能驅(qū)動的科學(xué)創(chuàng)新學(xué)習(xí)心得

平衡創(chuàng)新與倫理:AI時(shí)代的隱私保護(hù)和算法公平

智謀紀(jì) AI+Multi LED 打開人類健康新寶藏

Netflix CEO:搶你飯碗的不是AI,而是熟練使用AI的人

水庫大壩安全監(jiān)測系統(tǒng)的組成與功能

通過增強(qiáng)一致性訓(xùn)練,有效緩解CoT中的偏見問題

富士通發(fā)布最新的人工智能(AI)戰(zhàn)略,聚焦深化人類與AI之間的協(xié)作

沒有10年工作經(jīng)驗(yàn),我猜你都不會用電磁場來分析高速問題吧?

公平公正的AI也學(xué)會了人類的偏見

公平公正的AI也學(xué)會了人類的偏見

評論