詞嵌入方法在眾多自然語(yǔ)言處理任務(wù)中得到了廣泛的應(yīng)用。然而,詞嵌入方法將多義詞合并為單一表示,因此并不精確。為了更好地區(qū)分同一單詞的不同含義,人們轉(zhuǎn)而提出了含義嵌入(sense embeddings)。卡迪夫大學(xué)的Jose Camacho-Collados和劍橋大學(xué)的Mohammad Taher Pilehvar最近發(fā)表了論文(arXiv:1805.04032v2),概覽了含義向量表示的主要方法。

意義合并缺陷

詞嵌入方法的主要缺陷是無(wú)法很好地處理多義詞。由于在詞嵌入方法中,每個(gè)單詞表示為語(yǔ)義空間中的一個(gè)向量,因此它將多義詞的不同義項(xiàng)合并為單一表示,這就導(dǎo)致了意義合并缺陷(meaning conflation deficiency):

詞嵌入無(wú)法有效捕捉同一單詞的不同義項(xiàng),即使這些義項(xiàng)都在訓(xùn)練語(yǔ)料中出現(xiàn)過(guò)。

語(yǔ)義上無(wú)關(guān)的單詞,被多義詞拉扯到一起(見(jiàn)下圖)。

合并缺陷違反了歐幾里得空間的三角不等性,削弱了單詞空間模型的有效性。

語(yǔ)義上無(wú)關(guān)的rabbit(兔)和computer(計(jì)算機(jī))因mouse(老鼠/鼠標(biāo))牽扯到一起

因此,人們開(kāi)始尋找直接建模詞義的方法。最早的建模方法,依賴于人工編制的意義清單(例如WordNet)。近年來(lái),通過(guò)分析文本語(yǔ)料推導(dǎo)詞義差別的無(wú)監(jiān)督表示模型漸漸流行。下面我們將分別介紹這兩種范式。

基于知識(shí)的語(yǔ)義表示

這一范式利用外部資源中的知識(shí)建模語(yǔ)義。首先,我們將概覽主要的外部資源。接著,我們將簡(jiǎn)要介紹一些使用外部資源改進(jìn)詞向量的方法。最后我們重點(diǎn)介紹構(gòu)建基于知識(shí)的含義表示的方法。

知識(shí)資源

WordNet是NLP和語(yǔ)義表示學(xué)習(xí)中使用最為廣泛的資源之一。WordNet可以看成一個(gè)語(yǔ)義網(wǎng)絡(luò)。其中的節(jié)點(diǎn)為synset(同義詞集),例如,表示“脊柱”這一概念的synset包括spinal column、vertebral column、spine、backbone、back、rachis六個(gè)詞匯。synset之間的聯(lián)系(例如上位關(guān)系和部分整體關(guān)系)則為節(jié)點(diǎn)的邊。Open Multilingual Wordnet等項(xiàng)目則致力于將WordNet擴(kuò)展到其他語(yǔ)言。

Wikipedia(維基百科)是最著名的協(xié)同構(gòu)建資源。它是世界上最大的多語(yǔ)言百科,支持超過(guò)250種語(yǔ)言。而且,它還在持續(xù)更新之中,例如,英語(yǔ)維基百科每天新增將近750篇新文章。另外,Wikimedia基金會(huì)還運(yùn)營(yíng)Wikidata項(xiàng)目,一個(gè)面向文檔的語(yǔ)義數(shù)據(jù)庫(kù),為維基百科和其他wikimedia項(xiàng)目提供共享數(shù)據(jù)。類似的項(xiàng)目有DBpedia,致力于結(jié)構(gòu)化維基百科的內(nèi)容。

BabelNet將WordNet連接到包括維基百科在內(nèi)的協(xié)作構(gòu)建的資源。BabelNet的結(jié)構(gòu)和WordNet類似,只不過(guò)synset包含多個(gè)語(yǔ)種。synset間的聯(lián)系來(lái)自WordNet及其他資源(例如維基百科的超鏈接和Wikidata)。

ConceptNet結(jié)合了WordNet、Wiktionary、DBpedia等資源的語(yǔ)義信息。和WordNet、BabelNet不同,ConceptNet的主要語(yǔ)義單元是詞匯而不是synset。

PPDB(Paraphrase Database)基于圖結(jié)構(gòu),以詞組為節(jié)點(diǎn),以詞組間的相互關(guān)系為邊。

知識(shí)增強(qiáng)詞向量方法

知識(shí)增強(qiáng)詞表示(knowledge-enhanced word representation)利用知識(shí)資源改進(jìn)現(xiàn)有的詞向量表示,加上文本語(yǔ)料中未包含的信息。

知識(shí)增強(qiáng)詞表示,主要有兩種思路,一為修改模型的目標(biāo)函數(shù),以便在學(xué)習(xí)過(guò)程中納入知識(shí)資源的信息,一為在后處理階段改進(jìn)預(yù)訓(xùn)練的詞嵌入。

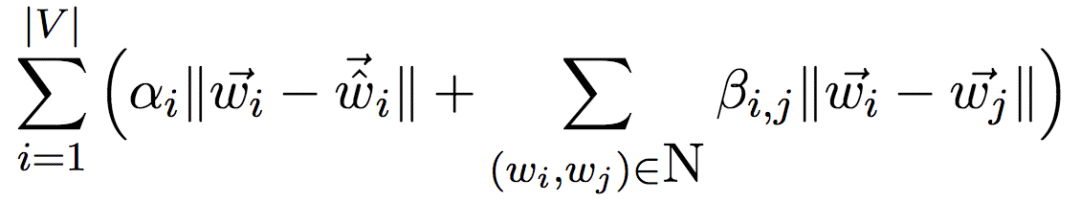

后者通常稱為retrofitting(改裝)。其直覺(jué)為,在詞向量空間中,移動(dòng)知識(shí)資源中聯(lián)系密切的單詞對(duì)應(yīng)的向量表示,使其更為接近。retrofitting模型的主要目標(biāo)函數(shù)為最小化下式:

上式中,|V|表示詞匯量,N是給定的語(yǔ)義網(wǎng)絡(luò)(知識(shí)資源),語(yǔ)義網(wǎng)絡(luò)的形式為單詞對(duì)的集合,wi和wj為預(yù)訓(xùn)練模型的詞嵌入,戴帽wi為輸出詞嵌入,αi、βi,j為可調(diào)整的控制系數(shù)。

基于知識(shí)的含義表示

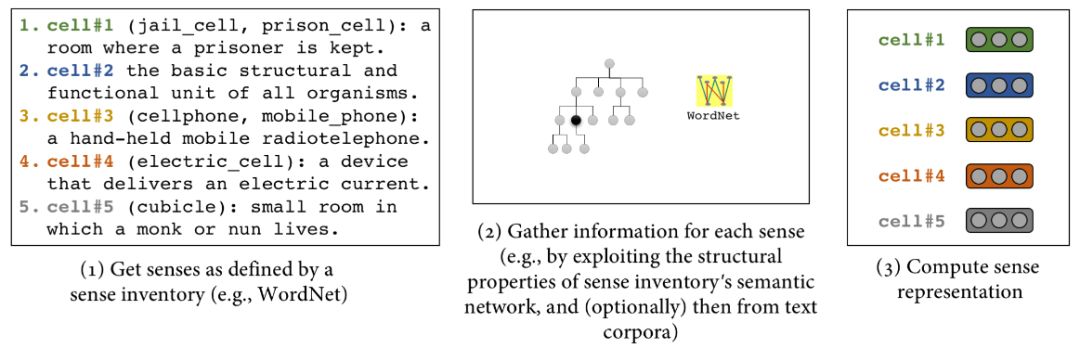

基于知識(shí)的含義表示(knowledge-based sense representations)的基本思路是利用知識(shí)資源的信息拆分(de-conflating)詞表示為含義表示。

知識(shí)資源的信息主要有兩種表示形式,文本定義和語(yǔ)義網(wǎng)絡(luò)。

在很多方法中,文本定義作為初始化含義表示的主要信號(hào)使用。例如,根據(jù)文本定義,對(duì)含義相近的預(yù)訓(xùn)練詞嵌入取均值,作為初始化含義嵌入(Chen等,2014,A Unified Model for Word Sense Representation and Disambiguation)。再如,基于文本定義,利用卷積神經(jīng)網(wǎng)絡(luò)架構(gòu)初始化含義嵌入(aclweb/P15-2003)。

和之前知識(shí)增強(qiáng)詞向量方法類似,基于語(yǔ)義網(wǎng)絡(luò),通過(guò)修改目標(biāo)函數(shù)或后處理詞嵌入,可以從詞嵌入拆分出含義嵌入。

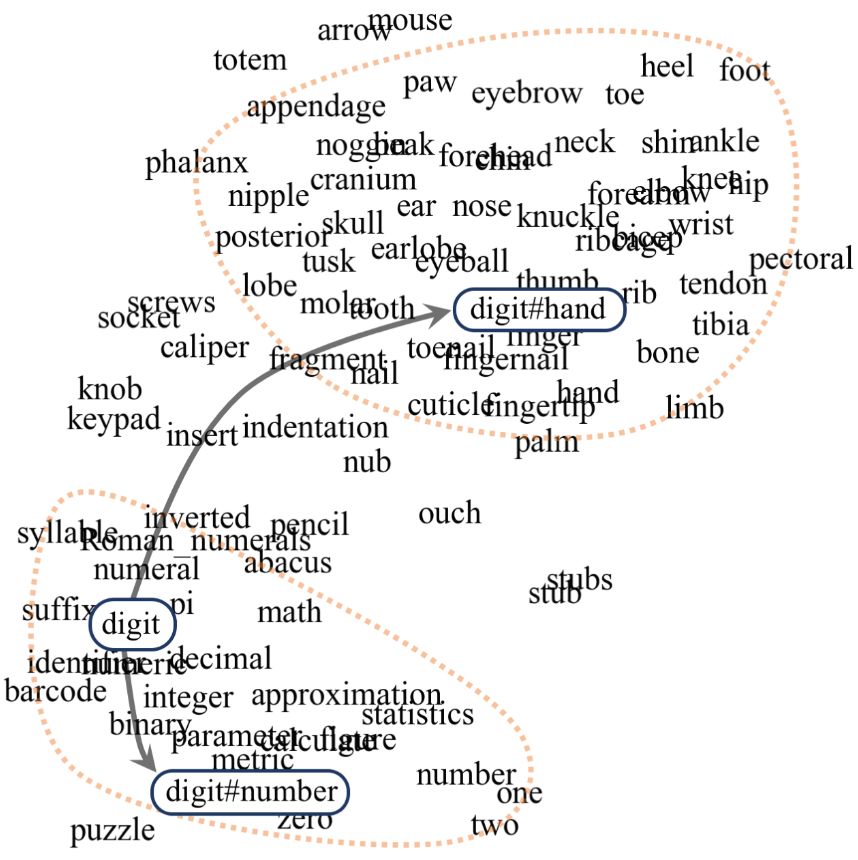

digit既可以指手指(digit#hand),也可以指數(shù)字(digit#number)

前者的例子有Mancini等在2016年底的工作(arXiv:1612.02703),修改了Word2Vec的目標(biāo)函數(shù),在同一向量空間中同時(shí)學(xué)習(xí)詞嵌入和含義嵌入。

后者的例子包括:

Jauhar等在2015年對(duì)retrofitting方法的擴(kuò)展(Ontologically Grounded Multi-sense Representation Learning for Semantic Vector Space Models)

Johansson和Pina在2015年提出,后處理預(yù)訓(xùn)練詞嵌入可以看起一個(gè)優(yōu)化問(wèn)題:多義詞嵌入可以分解為其含義嵌入的組合,同時(shí)含義嵌入應(yīng)該靠近其語(yǔ)義網(wǎng)絡(luò)中的鄰居。(aclweb/N15-1164)他們使用了SALDO語(yǔ)義網(wǎng)絡(luò)(一個(gè)瑞典語(yǔ)語(yǔ)義網(wǎng)絡(luò)),不過(guò)他們的方法可以直接擴(kuò)展到其他語(yǔ)義網(wǎng)絡(luò)。

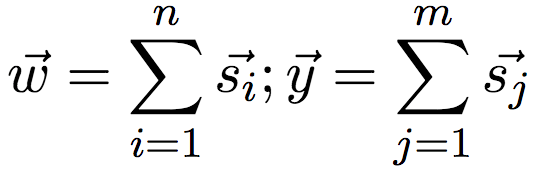

Rothe和Schütze在2015年提出的AutoExtend,一個(gè)自動(dòng)編碼器架構(gòu),該架構(gòu)主要基于以下兩個(gè)限制:詞向量對(duì)應(yīng)于其含義向量之和,synset向量對(duì)應(yīng)于其詞匯/含義之和。例如,詞向量digit對(duì)應(yīng)于digit(手指)和digit(數(shù)字)兩個(gè)含義向量之和,synset向量“預(yù)訂”對(duì)應(yīng)于含義向量reserve、hold、book之和。即:

其中,s表示含義,w表示詞,y表示synset。

無(wú)監(jiān)督含義表示

基于知識(shí)的含義表示依賴人工編制的意義清單,因此在某些場(chǎng)景下受到限制,例如,語(yǔ)料缺乏相應(yīng)的外部知識(shí)資源。近年來(lái),隨著算力的提升和機(jī)器學(xué)習(xí)技術(shù)的發(fā)展,無(wú)監(jiān)督含義表示漸漸流行。

無(wú)監(jiān)督含義表示方法的核心是詞義推導(dǎo),也就是基于文本語(yǔ)料自動(dòng)識(shí)別單詞的可能含義。其背后的直覺(jué)為,既然我們可以通過(guò)上下文學(xué)習(xí)單詞的表示,那么我們同樣可以通過(guò)上下文學(xué)習(xí)單詞的不同含義。

這一方向早期的工作是雙階段模型(two-stage model),即首先推導(dǎo)出含義,然后學(xué)習(xí)其表示。

雙階段模型

這方面的先鋒之一是Schütze在1998提出的上下文分組識(shí)別(context-group discrimination)。其基本的思路是,聚類多義詞出現(xiàn)的上下文,然后基于上下文相似性自動(dòng)推斷其含義。(aclweb/J98-1004)

后續(xù)這個(gè)方向的研究大多沿襲Schütze這一工作的思路,只不過(guò)改變了上下文表示形式和聚類算法(Schütze使用了最大期望算法)。

2010年,Reisinger和Moone直接聚類上下文,也就是將上下文表示為一元語(yǔ)法的特征向量,而不是詞向量,大大降低了計(jì)算負(fù)擔(dān),使這一基于聚類的方法能夠用于較大的語(yǔ)料。另外,他們還使用了movMF聚類算法,這是一種和k-均值類似的算法,不過(guò)它允許使用聚類特定的聚集參數(shù)控制語(yǔ)義的廣度,以更好地建模聚類尺寸的偏斜分布。(dl.acm/1858012)

類似地,Huang等在2012年改進(jìn)了基于聚類的含義表示技術(shù),通過(guò)idf加權(quán)平均詞向量得到上下文向量,并使用球形k均值聚類。然后根據(jù)聚類標(biāo)注單詞的用例,并基于此學(xué)習(xí)含義表示。(aclweb/P12-1092)

雙階段模型的問(wèn)題在于,聚類和含義表示學(xué)習(xí)均基于上下文,這兩者有潛在的相似性,分兩個(gè)階段單獨(dú)進(jìn)行浪費(fèi)了這一潛在的相似性,也浪費(fèi)了算力。因此,最近的研究大部分轉(zhuǎn)向了聯(lián)合訓(xùn)練(joint training),即同時(shí)進(jìn)行推斷和表示學(xué)習(xí)。

聯(lián)合模型

Neelakantan等在2014年提出了MSSG(Multiple-Sense Skip-Gram)模型,擴(kuò)展了Skip-gram嵌入模型。和前面提到的工作類似,MSSG也通過(guò)聚類形成單詞的含義表示。不過(guò),聚類和含義表示學(xué)習(xí)是同時(shí)進(jìn)行的。在訓(xùn)練階段,每個(gè)單詞的預(yù)期含義是動(dòng)態(tài)選擇的,選擇和上下文最接近的含義。與此同時(shí),Tian等在2014年提出了一個(gè)基于Skip-gram的含義表示技術(shù),將Skip-gram模型中的詞嵌入替換為有限混合模型,其中每個(gè)模型對(duì)應(yīng)單詞的一個(gè)原型(prototype)。(aclweb/C14-1016)

Yang Liu等主張上面的技術(shù)在推斷含義表示時(shí)僅僅使用了單詞的局部上下文,因此是有局限的。為了應(yīng)對(duì)這一問(wèn)題,他們?cè)?015年提出了TWE模型(Topical Word Embeddings)。其中,每個(gè)單詞在不同主題下可能有不同的詞嵌入,主題則通過(guò)基于全局計(jì)算的潛主題建模。Pengfei Liu等提出的NTSG模型( Neural Tensor Skip-gram)應(yīng)用了同樣的想法,只不過(guò)引入了張量以更好地學(xué)習(xí)單詞和主題之間的關(guān)系。Nguyen等在2017年提出了TWE的一個(gè)擴(kuò)展,MSWE模型,TWE在給定上下文中會(huì)選取最合適的含義,而MSWE則使用權(quán)重混合表示給定上下文中單詞和不同含義的關(guān)聯(lián)程度。

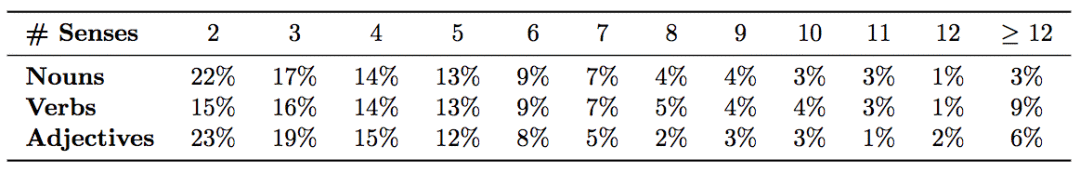

出于實(shí)現(xiàn)的簡(jiǎn)單性,聯(lián)合模型往往假定每個(gè)單詞有固定數(shù)目的含義(使用啟發(fā)式算法猜測(cè)數(shù)目)。然而這一假定和實(shí)際情況并不相符,單詞的含義數(shù)量可能差別很大。雖然在WordNet 3.0中,大約80%的單詞為單義詞,不到5%的單詞有3個(gè)以上含義。然而,如果我們重點(diǎn)關(guān)注常用詞,則情況大不相同。常用詞大都是多義詞,而且其含義數(shù)量分布比較分散。

SemCor數(shù)據(jù)集中常用詞的含義數(shù)量分布

之前提到的MSSG模型考慮了這一點(diǎn),使用的是一種實(shí)時(shí)非參數(shù)聚類算法,對(duì)某個(gè)單詞而言,僅僅在與現(xiàn)有含義的相似性低于某個(gè)閾值時(shí)才創(chuàng)建新含義。Bartunov等在2015年提出的AdaGram模型(Adaptive Skip-gram,自適應(yīng)Skip-gram模型),則基于非參數(shù)貝葉斯方法實(shí)現(xiàn)了動(dòng)態(tài)多義(dynamic polysemy)。

另外,以上的聯(lián)合模型都有一個(gè)缺陷,推斷含義所用的上下文仍然為可能有歧義的詞向量,而不是含義向量。換句話說(shuō),這些聯(lián)合模型都不是純粹的基于含義的模型。

有鑒于此,Qiu等在2016年提出了一個(gè)純含義模型(aclweb/D16-1018),同時(shí),這一模型也將去歧義上下文從之前的小窗口擴(kuò)展至整個(gè)句子。Lee和Chen在2017年提出的MUSE模型則是另一個(gè)Skip-gram的純含義擴(kuò)展,MUSE使用了強(qiáng)化學(xué)習(xí)方法。

多語(yǔ)語(yǔ)料

由于歧義通常并不跨語(yǔ)言,比如中文分別使用“老鼠”和“鼠標(biāo)”,沒(méi)有英文中mouse的歧義問(wèn)題。因此我們可以利用多語(yǔ)語(yǔ)料對(duì)單詞的翻譯進(jìn)行聚類,然后基于翻譯聚類構(gòu)建含義嵌入表示。這一方法在機(jī)器翻譯(Machine Translation)領(lǐng)域尤為常用。

與下游應(yīng)用的集成

文本的表示通常只是第一步,要完成NLP任務(wù),通常還需要后續(xù)處理。目前而言,詞嵌入可以很方便地集成到下游應(yīng)用中,而含義嵌入在這方面還處于嬰兒期。

Pilehvar等在2017年的研究(aclweb/E17-2062)表明,當(dāng)輸入文本足夠龐大的時(shí)候,基于知識(shí)的含義嵌入能夠提升文本分類的效果,但在大多數(shù)數(shù)據(jù)集上,使用預(yù)訓(xùn)練的含義嵌入相比詞嵌入,表現(xiàn)沒(méi)有明顯的提升。

2015年,Li和Jurafsky提出了一個(gè)框架(arXiv:1506.01070),可以將無(wú)監(jiān)督含義嵌入集成到多項(xiàng)自然語(yǔ)言處理任務(wù)中。然而,他們發(fā)現(xiàn)無(wú)監(jiān)督含義嵌入并沒(méi)有顯著優(yōu)勢(shì),增加詞嵌入的維度可以取得相近的效果。

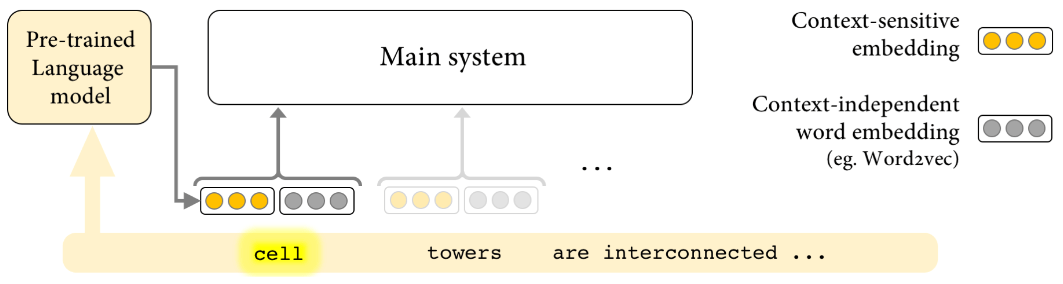

2018年,Peters等提出了學(xué)習(xí)深度雙向語(yǔ)言模型(LSTM)的內(nèi)部狀態(tài)所得的詞向量。(arXiv:1802.05365)他們發(fā)現(xiàn),這一上下文詞表示(contextualized word representations)可以很容易地加入現(xiàn)有的模型,并顯著提升問(wèn)答(question answering)、文本蘊(yùn)涵(textual entailment)、情感分析(sentiment analysis)等6個(gè)NLP問(wèn)題上當(dāng)前最先進(jìn)模型的表現(xiàn)。

黃色表示上下文敏感嵌入,灰色表示上下文無(wú)關(guān)嵌入

和(上下文無(wú)關(guān))詞嵌入不同,上下文詞表示是動(dòng)態(tài)的,其表示因所出現(xiàn)的上下文環(huán)境的不同而不同。上下文詞表示的直覺(jué)是,語(yǔ)言模型單元隱式地根據(jù)上下文區(qū)分了多義詞的具體含義。

結(jié)語(yǔ)

本文概覽了直接基于文本語(yǔ)料推斷含義(無(wú)監(jiān)督)及使用外部含義清單(基于知識(shí))的含義表示模型。其中一些模型已經(jīng)在實(shí)踐中取得了不錯(cuò)的效果,但含義表示模型仍有很大的提升空間。例如,大部分模型只在英語(yǔ)語(yǔ)料上測(cè)試過(guò),只有少數(shù)模型涉及英語(yǔ)以外的語(yǔ)料。再如,含義表示模型集成到下游應(yīng)用的最佳策略尚不明確,同時(shí)預(yù)先去歧義是否必要也不確定。

含義的定義和正確的范式仍然是一個(gè)開(kāi)放問(wèn)題。含義需要是離散的嗎?含義需要依賴知識(shí)資源或含義清單嗎?含義可以根據(jù)上下文動(dòng)態(tài)學(xué)習(xí)嗎?這些問(wèn)題仍有待探索。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4765瀏覽量

100568 -

函數(shù)

+關(guān)注

關(guān)注

3文章

4308瀏覽量

62445 -

自然語(yǔ)言

+關(guān)注

關(guān)注

1文章

287瀏覽量

13335

原文標(biāo)題:從詞嵌入到含義嵌入:概覽含義向量表示方法

文章出處:【微信號(hào):jqr_AI,微信公眾號(hào):論智】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

基于文本語(yǔ)料推斷含義及使用外部含義清單的含義表示模型

基于文本語(yǔ)料推斷含義及使用外部含義清單的含義表示模型

評(píng)論