前幾天,論智曾報道了這么一個項目:Uber提出CoordConv:解決了普通CNN的坐標(biāo)變換問題。文中講到,Uber AI的工程師們發(fā)現(xiàn)卷積神經(jīng)網(wǎng)絡(luò)無法將空間表示轉(zhuǎn)換成笛卡爾空間中的坐標(biāo)和獨熱像素空間中的坐標(biāo)。更重要的是,他們還對這一限制提出了解決方法,即CoordConv。

論文一經(jīng)推出,就收獲了不少點贊,連我們的編譯版本閱讀量也很可觀,小編甚是欣慰。可是沒過幾天,一位名叫Filip Piekniewski的朋友在他的個人博客上寫道:“這種微不足道的進(jìn)步也值得這樣贊美……”這位計算機(jī)視覺工程師用52行代碼就做出了和論文同樣的結(jié)果,讓我們看看他是如何剖析CoordConv的吧。以下是論智的編譯。

簡介

關(guān)于深度學(xué)習(xí)的論文,我讀的很多,經(jīng)常一個星期讀好幾篇的樣子,所以目前為止可能讀了幾千份論文。機(jī)器學(xué)習(xí)或深度學(xué)習(xí)有一個基本的問題,即這些論文總是處在科學(xué)和工程之間的“無人之境”上,我將它成為“學(xué)術(shù)工程(academic engineering)”,具體解釋如下:

我個人認(rèn)為,一篇科學(xué)論文應(yīng)該傳遞一種觀點,使其有能力解釋某種東西。例如一篇證明一個數(shù)學(xué)定理的論文或者表示某些物理現(xiàn)象的模型。另外,科學(xué)論文應(yīng)該以實驗為基礎(chǔ),實驗的結(jié)果能告訴我們有關(guān)顯示的基本情況。雖然如此,科學(xué)論文的中心仍是對自然事實的普遍性和觀察進(jìn)行總結(jié)。

一篇工程類論文應(yīng)該展示解決某一特殊問題的方法。在不同的應(yīng)用上,問題的類型也不相同,有時可能很無聊,但是對某些人是很有價值的。對一篇工程論文來說,重點和科學(xué)論文有所不同:解決方案的普遍性也許不是最重要的,重要的是這一方案能夠?qū)嶋H運(yùn)用。也就是說,給定可用條件,該解決方案比之前的方法更便宜、更高效。所以說工程類論文的重點是應(yīng)用,其余的部分都是用于支撐該方法能解決問題的觀點。

而機(jī)器學(xué)習(xí)介于兩者之間,這一領(lǐng)域既有科學(xué)類論文(例如介紹反向傳播的那篇),也有明顯的工程類論文,其中描述了很實用的解決方法。但是大部分論文都更偏向工程一點,為了顯示優(yōu)越性,其中取消了特別的技巧,經(jīng)過一些不重要的數(shù)據(jù)測試之后就宣布這種方法的成功。

除此之外還有第四種論文,它們的確包含某種觀點,這種想法可能是有用的,但卻是不值一提的。為了掩蓋這令人尷尬的事實,作者們美名其曰這是“學(xué)術(shù)工程”,從而讓論文看上去“高大上”了許多。

好巧不巧,Uber最近就發(fā)表了這樣一篇論文——An Intriguing Failing of Convolutional Neural Networks and CoordConv Solution,下面我就要好好剖(shou)析(si)這一成果。

解剖開始

讓我們直接進(jìn)入正題

現(xiàn)在我們知道,這篇論文的中心是,研究者發(fā)現(xiàn)卷積神經(jīng)網(wǎng)絡(luò)在需要坐標(biāo)的任務(wù)中表現(xiàn)得不是很好,詳細(xì)地說,即輸出標(biāo)簽或多或少的是輸入元素坐標(biāo)的正函數(shù),并不表示輸入的其他屬性。

卷積網(wǎng)絡(luò)確實在此類問題上表現(xiàn)的不好,因為特征映射的結(jié)構(gòu),從福島邦彥提出新認(rèn)知機(jī)(Neocognitron)后,在設(shè)計時就忽略了這些坐標(biāo)的位置。所以Uber AI的作者提出了一種解決方法:在卷積層中加入坐標(biāo),將其當(dāng)做額外的輸入映射。

聽起來這個方法很好,但是作者實際上提出的方法,也是很多從業(yè)者經(jīng)常會想當(dāng)然的方法——他們添加的特征更適合對想要的輸出進(jìn)行解碼。任何從事計算機(jī)視覺的專家都不會對加入特征感到陌生,雖然這只是深度學(xué)習(xí)圈子里一個小話題。現(xiàn)如今,深度學(xué)習(xí)中的研究者們已然脫離了實際應(yīng)用,聲稱我們應(yīng)該只使用學(xué)到的特征,因為“這種方法更好”。這么說深度學(xué)習(xí)圈里的人們也開始認(rèn)同特征工程了啊……

訓(xùn)練

不管怎樣,這篇論文加入了一個特征,明確表示出了坐標(biāo)的值。接著作者在一個名為“Not-so-Clevr”的數(shù)據(jù)集上進(jìn)行測試(這個數(shù)據(jù)集的名字很皮),那么他們的試驗是不是真的聰明呢?讓我們進(jìn)一步分析。

其中一個任務(wù)是基于坐標(biāo)生成獨熱圖像,或者從獨熱圖像中生成坐標(biāo)。他們表示在卷積網(wǎng)絡(luò)中加入坐標(biāo)的確可以大大提高性能。

等等,冷靜一下,如果他們不直接上手TensorFlow,而是直接創(chuàng)建一個神經(jīng)網(wǎng)絡(luò)來解決獨熱編碼到坐標(biāo)的變換問題的話……就不用任何訓(xùn)練啊。對于這個問題我會進(jìn)行三種操作:卷積、非線性激勵和求和。好在這些都是卷積神經(jīng)網(wǎng)絡(luò)的基礎(chǔ)組成部分:

import scipy.signal as sp

import numpy as np

# Fix some image dimensions

I_width = 100

I_height = 70

# Generate input image

A=np.zeros((I_height,I_width))

# Generate random test position

pos_x = np.random.randint(0, I_width-1)

pos_y = np.random.randint(0, I_height-1)

# Put a pixel in a random test position

A[pos_y, pos_x]=1

# Create what will be the coordinate features

X=np.zeros_like(A)

Y=np.zeros_like(A)

# Fill the X-coordinate value

for x in range(I_width):

X[:,x] = x

# Fill the Y-coordinate value

for y in range(I_height):

Y[y,:] = y

# Define the convolutional operators

op1 = np.array([[0, 0, 0],

[0, -1, 0],

[0, 0, 0]])

opx = np.array([[0, 0, 0],

[0, I_width, 0],

[0, 0, 0]])

opy = np.array([[0, 0, 0],

[0, I_height, 0],

[0, 0, 0]])

# Convolve to get the first feature map DY

CA0 = sp.convolve2d(A, opy, mode='same')

CY0 = sp.convolve2d(Y, op1, mode='same')

DY=CA0+CY0

# Convolve to get the second feature map DX

CA1 = sp.convolve2d(A, opx, mode='same')

CX0 = sp.convolve2d(X, op1, mode='same')

DX=CA1+CX0

# Apply half rectifying nonlinearity

DX[np.where(DX<0)]=0

DY[np.where(DY<0)]=0

# Subtract from a constant (extra layer with a bias unit)

result_y=I_height-DY.sum()

result_x=I_width-DX.sum()

# Check the result

assert(pos_x == int(result_x))

assert(pos_y == int(result_y))

print result_x

print result_y

一個熱點位圖進(jìn)行坐標(biāo)轉(zhuǎn)換、一個卷積層、一個非線性激勵、一個求和以及最后從一個減法,無需學(xué)習(xí),50多行Python代碼,搞定。

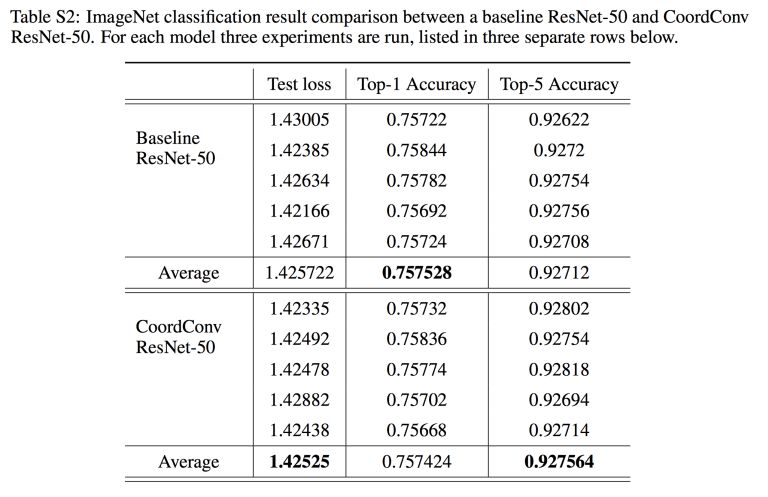

接下來讓我們試試在GAN上進(jìn)行合成生成任務(wù),其中一個還有坐標(biāo)特征,另一個沒有。在論文的附錄中有這么一個表格:

他們嘗試在ImageNet上將坐標(biāo)特征添加到ResNet-50網(wǎng)絡(luò)的第一個圖層上。我猜作者希望在這里看到較大的提升,因為ImageNet的類別讀數(shù)并不是位置的函數(shù)(如果這里存在偏差,那么訓(xùn)練時的數(shù)據(jù)增強(qiáng)過程就應(yīng)該完全清除)。

所以他們用100個GPU進(jìn)行了測試(100個啊!),但是直到小數(shù)點后第三位,結(jié)果才有些許提升。100個GPU就提高了這么一點兒,要不然讓谷歌或者Facebook的人用10000個GPU試試,說不定能在小數(shù)點后第二位就看到變化了呢(逃)。

總結(jié)

這篇論文的確吸引人,它在當(dāng)下“一切向計算力看齊”的大背景下還能揭露深度學(xué)習(xí)的缺陷實屬不易。但為什么是Uber提出這個問題?如果是一些學(xué)生做出這樣的成績也就罷了,但是Uber AI不是搞自動駕駛的嗎?

更有意思的是這篇論文在推特上受到很多人,甚至深度學(xué)習(xí)專家的表揚(yáng)。他們太過于看重GPU的表現(xiàn)力了,殊不知這明明只需要幾行Python就能解決……

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4762瀏覽量

100537 -

計算機(jī)視覺

+關(guān)注

關(guān)注

8文章

1696瀏覽量

45927 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5492瀏覽量

120977

原文標(biāo)題:Uber成果CoordConv被diss,深度學(xué)習(xí)上演“皇帝的新衣”

文章出處:【微信號:jqr_AI,微信公眾號:論智】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

C語言深度剖析

linux內(nèi)核深度剖析,另附有光盤資料

學(xué)習(xí)上位機(jī)的福音,傻瓜式項目教程。

剖析AI芯片市場:為什么要加強(qiáng)深度學(xué)習(xí)

剖析深度學(xué)習(xí)與傳統(tǒng)計算機(jī)視覺之間的關(guān)系

先學(xué)習(xí)上位機(jī)編程還是PLC編程

深度學(xué)習(xí)上演“皇帝的新衣”如何剖析CoordConv?

深度學(xué)習(xí)上演“皇帝的新衣”如何剖析CoordConv?

評論