還記得“殺馬特教授”黎顥嗎?他將率領團隊在下周召開的SIGGRAPH中展示一項黑科技“paGAN”:每秒1000幀掃描,用單幅照片實時生成超逼真動畫人物頭像。連GAN發明人Ian Goodfellow也忍俊不禁,殺馬特教授和他的新技術究竟如何?

還記得此前新智元報道過的“殺馬特教授”黎顥(Hao Li)嗎?

看到這張照片,應該能夠喚起你的記憶了吧?

是的,黎顥目前正身陷法律訴訟,他被自己成立的計算機視覺創業公司Pinscreen的前CTO起訴,后者指控黎顥學術造假,向計算機圖形頂會SIGGRAPH 2017提交人為篡改的圖像和結果。

黎顥否認指控,現在案件正在進行中。

不過,我們今天要講的主題,是關于下周即將召開的最新一屆SIGGRAPH 2018,黎顥的團隊提交了一項命名獨特且效果驚人的工作,連GAN的發明人Ian Goodfellow今天都發推表示,“最受期待的一個GAN命名已經被人用了:paGAN(有“異教徒”之意)”。

實際上,早在2014年SIGGRAPH Asia,新智元創始人兼CEO楊靜就曾采訪黎顥。黎顥從2013年起在美國南加大計算機系擔任助理教授,從事計算機圖形學和計算機視覺相關領域的研究。2010年在蘇黎世聯邦理工學院獲取博士學位,2011年在哥倫比亞大學和普林斯頓大學從事博士后研究,隨后在工業光魔(Industrial Light & Magic)擔任研發主管,并于2014年在維塔數碼(Weta Digital)任訪問教授。

黎顥曾在喬治盧卡斯工作室工作,為電影《星球大戰》提供特效技術。后來他與人聯合創辦了計算機視覺創業公司Pinscreen,并擔任CEO。

在下周SIGGRAPH 2018的Real Time Live活動中,黎顥率領的Pinscreen團隊將展示“革命性”的新機器學習技術,“打破了傳統的模型、紋理、光線和渲染管道”,日前科技作者Mike Seymour一篇發表在 fxguide.com 的文章如此介紹。

“重要的是,Pinscreen的研究工作既適合高端(基于PC)又適合移動端(基于手機/移動電話)……通過在這兩個層面開展工作,團隊提供即時應用程序,同時還致力于重要的長期基礎研究”,Mike Seymour如此寫道,并且親自進行了測試。

接下來,我們就來看看殺馬特教授和他的團隊即將提交的最新成果吧。

每秒1000幀:根據普通照片實時生成高清逼真動畫人臉

下面就是 fxguide 的Mike Seymour,左邊是蘋果iPhone手機拍攝的短視頻,右邊則是實時渲染的CGI,在原視頻人臉上蓋了一層數碼生成的3D數碼人臉(hockey mask)。這個過程中只涉及邊緣修飾的少量微調,其他全部自動生成。

Pinscreen的團隊正在使用單幅jpeg圖像構建他們的3D臉部模型,而且采用端到端的方法。

首先,模型識別照片中的人臉,然后生成一個合理的3D網格。

不僅如此,模型能以1000 fps的速度對人臉進行跟蹤。手機攝像頭的速度一般只有30或60 fp,但黎顥解釋說:“這讓我們有足夠的時間在同一幀中追蹤多個面孔。”

這個追蹤器名為VGPT,代表“Veli Goodo Pace Tracka”,由Pinscreen的Shunsuke Saito領導開發。在搭載英偉達1080P GPU的PC上,VGPT以1000 fps的速度運行。在iPhone X上,它的運行速度接近60~90 fps。

“我們的解決方案的另一個巨大優勢是它占用的內存非常少,沒有I/O的核心只有5M,而且完全基于深度學習。”黎顥表示。

該解決方案基于直接推理,不像傳統的面部跟蹤器那樣,后者是直接跟蹤特征或標記。較舊的跟蹤器會使用基于AAM模型的面部標記檢測器,速度慢很多。而這個新的解決方案,根據黎顥的說法,提供了“相對于相機的3D精確頭部模型,以及微表情測量工具和所有重要的東西”。

VGPT使用一組ML工具進行非常快速的無標記跟蹤。不僅跟蹤效果好,魯棒性也高。如果一個人在攝像頭前移動,部分遮擋了相機,程序將很快重新獲得面部信息并繼續工作。

VGPT將是Pinscreen下周在SIGGRAPH實時現場演示中最強大的新工具。

Pinscreen拍攝了《洛杉磯時報》記者David Pierson的一張照片作為輸入(左),并制作了他的3D頭像(右)。 這個生成的3D人臉通過黎顥的動作(中)生成表情。這個視頻是6個月前制作的,Pinscreen團隊稱其內部早就超越了上述結果。

paGAN:逼真動畫人物生成對抗網絡

那么,再來看關鍵的“paGAN”,這個縮寫代表“Photoreal Avatar Generative Adversarial Network”,逼真動畫人物生成對抗網絡,這就是Pinscreen系統的“渲染器”。

到目前為止,對動畫頭像或數字人物進行傳統建模、紋理、燈光和渲染的方式都需要構建非常高質量的數據集。這通常需要很多高質量的掃描圖像。多個圖像開始,以構建攝影測量樣式解決方案,具有非常多高質量、符合攝影測量法的人臉掃描圖像。

為了解決這個問題,黎顥和Pinscreen團隊跳過了傳統的管道方法,他們認為“用ML采用”不等于“用CGI模擬”。

Pinscreen團隊的目標是將采樣的面部重新點亮,生成動畫,旋轉,然后放置在模擬的3D環境中,就像3D CGI頭像一樣。但是,整個過程沒有使用正常的建模/紋理/照明和渲染管道。

結果看起來很真實,就像照片投影在與之匹配的幾何體之上,但它僅在靜態時才起作用。

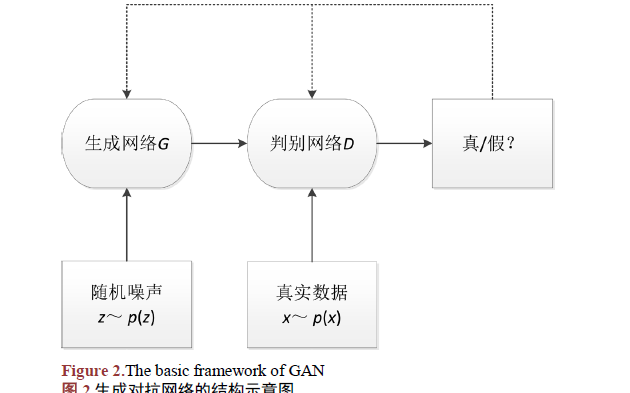

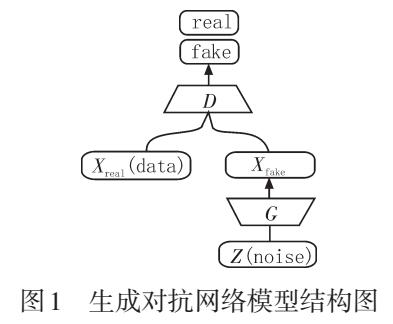

Pinscreen想要看看他們是否可以使用最先進的深度生成模型來實現一個通用的解決方案。“這是一種非常特殊的深度學習網絡,它包含了生成對抗網絡。它們具有生成逼真的2D圖像的能力。我們知道GAN可以生成逼真的2D圖像,許多其他研究人員已經證明了這一點,”黎顥解釋道。

“在Ian Goodfellow的開創性工作和NVIDIA的大量精彩工作的基礎上,已經證明可以訓練神經網絡來合成高質量的面部圖像。”黎顥和他的團隊想知道他們是否可以將這項新技術轉變為一種面部渲染引擎(facial render engine),從而跳過建模,紋理和光照的pineline。它不只是從正確的角度來“渲染”臉部,而是使用GAN ML。

paGAN是一個ML GAN網絡,它基于簡單模型的輸入(具有少量紋理)來呈現照片級真實的面部,這個簡單模型來自他們的VGPT。

paGAN擅長處理眼睛和嘴巴。

當用于面部處理時,GAN的問題在于輸出是2D的,并且“vanilla GAN”非常難以控制。“用GAN會得到任意的斑點,這些斑點很難控制。我們用paGAN能夠確保輸出看起來是照片級真實的,特別是口腔和眼睛區域,”黎顥說。早期的研究也做了類似的工作,但沒有包括眼睛或嘴巴。

“嘴巴,以及舌頭在嘴巴里的移動方式,這是paGAN做得非常好。”

徹底解析神奇技術:重新定向

由于人臉可以由單個的Jpeg制成,并且所有表情都來自新的表情源,所以這種技術非常適合以一種可信的、合理的方式將別人的臉制成動畫。

在查看結果時,要注意被操作的臉(右邊)是由一張jpeg圖像(頂部)僅由一個靜止的jpeg圖像(頂部)制成,而沒有其他FACS輸入或特殊掃描。所有的表情都是從expression source轉移到目標人物。

混合方案和光照問題

由于黎顥的背景和在ILM、Weta Digital等公司的經歷,他知道自己的面部工具需要在有V-Ray、Manuka或RenderMan的pipeline上工作。“目前我們的解決方案是一種混合方案,效果非常好。我們將在SIGGRAPH的Real Time Live上演示的解決方案就是這樣的。”

黎顥補充說:“照片真實級別的人臉是很好的技術演示,但是在Pinscreen,我們想讓人們使用它……如果你有3D的臉或頭像,你需要有一個環境,否則就沒有意義了。”

出于這個原因,paGAN面不僅能夠從任何角度“渲染”,而且還能夠任何光照場景中“渲染”。 “在環境中,意味著可以從任意方向和該環境的任何照明條件下渲染”。

Pinscreen目前通過解決面部的照片級反照率來解決這個問題(不是100%的反照率,但很接近)。“使用這種反照率紋理,再加上其他使用傳統計算機圖形的pipeline,可以獲得令人信服的結果。”黎顥說。

在用戶測試中部署時,CGI人臉的得分接近完美。在相似的背景下以相同方式和真實面部一起呈現時,CGI人臉幾乎能夠完美地欺騙用戶。

手機級別

下圖是以單張Jpeg作為輸入,到最終在iPhone上呈現角色輸出的過程。下面是Mike Seymour的源圖像。 雖然Pinscreen團隊可以使用深度相機,但這款iphone實時制作出來的Mike最終效果是使用單個Jpeg圖像而不是深度相機傳感器數據制作的。 圖像是在iPhone X上拍攝的,但使用的是非深度感應相機。

“在Pinscreen公司,我們有兩個團隊,一個團隊專注于制作人們喜歡玩的東西,同時我們有一個非常強大的研究小組。這個小組關注的是基本問題。”

Pinscreen想讓3D avatar大眾化,但是人們為什么需要它呢?

黎顥說:“首先,大多數游戲都是3D游戲,而且大部分游戲中都涉及到人類的形象或造型,但我認為它可以走得更遠。”

他看到的應用是3D通信(Skype的3D版本),“在某種程度上,我覺得你就在我們辦公室。這是人們真正合作,共同完全解決問題,交流思想和情感的唯一途徑。這是建立信任的關鍵。”

他說,他期待有一天我們真的覺得在使用3D頭像的時候會有人在房間里,但“要做到這一點,你不能依靠游戲或電影研究工作室來捕捉你的面部數據,它必須是足夠聰明的,能夠基于有限的知識來構建所有這些復雜性。”這就是為什么Pinscreen對于先進的ML和專業的GAN如此看重的原因。

輸入Charlie的單張圖片,并在iPhone上生成3D人臉的過程

Pinscreen的策略是先構建“游戲”級的移動平臺,“但這是我們能夠用來部署我們正在開發的所有新研究技術的平臺”。

團隊訓練一個GAN,可以在不同的視點中產生表情,給出一個中性的jpeg臉部圖像。 在右側,來自訓練網絡的提取紋理用于在手機上實時驅動動態avatar

我們使用大量的人臉圖像數據集來訓練網絡,該數據集可以捕獲各種目標和表情。由于移動端的硬件限制,paGAN無法以令人滿意的幀速率在當前的iPhone硬件上運行。網絡被訓練好之后,可用于生成一小組固定關鍵表情的紋理,然后可以將這一固定或稀疏的集合擴展為基于面部動作編碼系統(FACS)的一組混合形狀UV紋理圖。計算完成后,就可以用這些紋理來創建具有多種表情的頭像,所有這些都由跟蹤器在手機上以30幀的速率實時驅動的。它可以在線實時合成每幀紋理。這種移動“壓縮”是Pinscreen解決方案的重要組成部分,也將在SIGGRAPH上展示。

paGAN的效果非常好,不僅可以用于制作面部表情,還可以用于制作嘴巴和眼睛。該程序為生成頭像制作了300張嘴巴的紋理和20個預先計算出的眼睛紋理。然后利用paGAN的眼睛紋理來近似模擬所有觀察方向。利用移動設備(例如iPhoneX)上的視線跟蹤器,程序可以選擇最接近真實的視線,并以此選擇合適的眼睛,組合到面部。

頭發

最后一部分是頭像的頭發。上面的示例框架使用Pinscreen的數據驅動毛發解決方案。這個方案是黎顥及其團隊之前發布的。現在,該團隊正在研究一種新型頭發模擬器,但由于這種新方法剛剛提交發表,因此不會出現在今年的實時現場演示中。新的系統屬于另一種端到端神經學習解決方案,將始終根據訓練數據生成合理的頭發模型。

2014年SIGGRAPH Asia訪談:特立獨行的殺馬特教授

正如前文所說,實際上,在2014年SIGGRAPH Asia上,新智元創始人兼CEO楊靜就對黎顥進行了采訪。

視效藝術家通常通過粘在人臉或身體上的3D感應球進行表情捕捉,黎顥的技術突破在于使用了深度傳感器(微軟的Xbox體感游戲使用了同樣的技術)簡化了這一過程,當裝有深度傳感器的攝像機對準演員的臉時,黎顥的軟件會自動分析其面部表情的變化,并立刻將這些表情套用到動畫人物上。

黎教授于2013年發表的SIGGRAPH論文所提出的技術,在皮克斯和工業光魔進行過一些實驗測試,用于前期的pre-visualization。技術結合利用了深度相機(Kinect)和視頻攝像頭捕捉到的信息,也就是同時使用了深度和顏色信息。

在光影工業,黎顥主要是針對幾部《星球大戰》(Star Wars)臉部捕捉技術的研發。主要工作是提供臉部和身體捕捉和重建技術的效率,希望能夠在拍攝的同時能盡可能看到最后合成的效果,也就是盡可能做到實時。

-

3D

+關注

關注

9文章

2863瀏覽量

107331 -

神經網絡

+關注

關注

42文章

4764瀏覽量

100548 -

計算機視覺

+關注

關注

8文章

1696瀏覽量

45928

原文標題:被控造假、打人之后要一雪前恥!“殺馬特”華裔教授推出paGAN,GoodFellow也點贊

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

圖像生成對抗生成網絡gan_GAN生成汽車圖像 精選資料推薦

圖像生成對抗生成網絡

生成對抗網絡在計算機視覺領域有什么應用

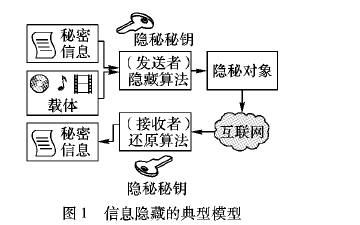

如何使用生成對抗網絡進行信息隱藏方案資料說明

殺馬特教授和他的新技術究竟如何?paGAN:逼真動畫人物生成對抗網絡

殺馬特教授和他的新技術究竟如何?paGAN:逼真動畫人物生成對抗網絡

評論