本文來自影譜科技創新研發中心負責人吉長江在8月舉行的LiveVideoStack Meet武漢站的分享,并由LiveVideoStack整理而成。吉長江詳細介紹了視頻植入的流程、典型方法、難點及技術趨勢,他認為,基于學習的視頻植入將是未來的發展趨勢。

大家好,我是來自北京影譜科技的吉長江,今天與大家分享的是影譜科技的視頻植入技術。

1. 背景介紹

或許此前大家對影譜科技還不是特別了解,但是隨著近期備受矚目的商湯對影譜科技的投資以及一同開拓大文娛市場等一系列活動,影譜科技逐漸走入大眾的視野。影譜科技在互聯網行業已耕耘數年,從開始參與的移動互聯網到現在專注于To B方向的視頻植入,我們致力于優化原生廣告的用戶體驗,努力將其打造為一個良好的互聯網變現方式,這也堅定了我們沿著To B方向走下去的決心,接下來將與大家分享其中的相關技術重點。

2. 原生視頻廣告

我們認為網絡視頻生態環境可以簡單描述為一個三體系統,不僅僅是一個視頻與觀眾之間形成的簡單關系,還應考慮在其中扮演重要角色的廣告。我們在設計廣告這一網絡視頻中最重要的變現手段時,必須要照顧到內容制片方與視頻平臺方的變現訴求,還應照顧到用戶的觀看體驗。過于生硬的貼片廣告勢必會讓用戶的觀看視頻體驗大打折扣,因而如何實現良好的原生視頻廣告效果就變得非常重要。當然這里還有最重要的一點:我們通過視頻植入技術實現原生視頻廣告,可以有效降低廣告主的盲投風險,原生視頻廣告允許廣告主看到此視頻廣告的拍攝小樣或在此視頻上線后再決定是否投資,相對于傳統貼片廣告而言有效降低了招商階段的風險。

2.1 視頻植入技術

上圖是我們與芒果臺合作,借助視頻植入技術實現的原生廣告效果,大家可以看到通過此項技術我們可以將廣告比較完美地植入到視頻畫面中。也許有人會將其簡單地理解為P圖,但是在視頻當中實現此效果的復雜程度遠高于簡單的圖像處理,我們需要處理攝像機的運動軌跡、景深、遮擋關系等等,并非簡單的后期效果疊加。

2.1.1 視頻植入的定義

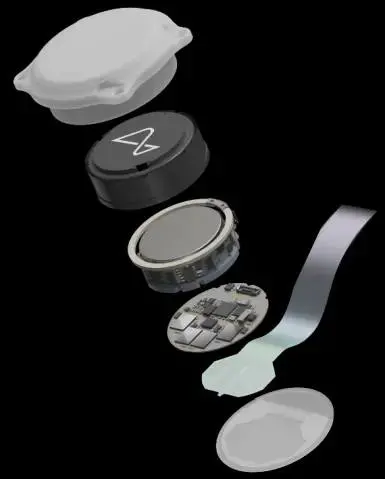

如果對視頻植入技術做出一個準確的定義,我認為視頻植入就是在視頻中自動化完成各類視覺元素融合的過程。首先“視覺元素”包括圖片、3D模型,甚至包括視頻中的視頻等等;此外,必須要做到的是精準而自然地“融合”,也就是必須要體現真實感。因此我們需要通過精準掌握攝像機的運動軌跡,妥善處理多個物體的遮擋關系,準確估算光照等操作,讓植入的視頻元素自然地出現在視頻畫面中而不顯得突兀生硬。為了實現以上效果,我們不僅要解決一系列技術細節問題,還需要將整個視頻植入過程完全自動化、標準化、流程化、規模化。

通過以上描述大家可以看出,視頻植入是一個全新的視覺任務。與傳統的幾種視覺任務相比,視頻植入也許在技術與困難上有諸多相似之處,但總體上來說還是有很大差異。例如大家非常熟悉的強調實時性的AR,其植入對象是比較虛擬化的,用戶很容易分辨出植入對象并非真實的視頻元素;但對視頻植入廣告來說需要完成的是影視級別的植入,也就是需要實現讓植入廣告成為原生拍攝的真實元素,使觀眾無法準確分辨廣告的后期植入效果。達成這種以假亂真的效果需要的基礎技術與SFM、視覺SLAM技術有相通之處。

2.1.2 視頻植入過程

那么實現影視級別的視頻植入需要經過哪些步驟呢?首先需要的是視頻鏡頭定位,而后進行包括平面檢測與攝像機運動深度恢復在內的3D恢復;隨后經過一系列的質量評估后就可確定比較適合的植入廣告位置,接下來進行光照估計,完成最終的渲染。大家不難看出這是一個從解構到重構的過程,解構主要是運用計算機視覺技術從語義和幾何兩個角度進行處理;重構則運用CG技術實現光照估計與渲染視覺元素的處理。

1)語義解構

首先讓我們來看一下語義解構。所謂語義解構,換句話說就是視頻內容的結構化。我們認為視頻本質上是一個多模態信息,在此多模態信息中最重要的是圖像,也是觀眾最關心的,其次是字幕與聲音;如果從維度上考慮,視頻可分為人物、場景、行為三個維度。其中我們會特別關注的是人物,因為無論是視頻方還是廣告方都會格外重視人物的明星效應與其背后的商業價值,這也是我們確定的一個能夠良好實現人臉識別商業化落地的關鍵點。上圖是我們的AI處理系統識別視頻中明星的效果圖,通過基于人物的檢測追蹤和識別技術,我們可以檢測識別出影視劇、綜藝節目等視頻畫面中出現的大大小小的明星,準確標注他們出現的時間點與位置并將這些數據整理入庫。這得益于與自動化所和商湯的合作,現在這套系統已支持超過一千位明星的識別并可實現從正臉到側臉的檢測,同時我們自己也進行了包括場景優化在內的各項技術提升。

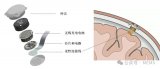

2)幾何解構

上圖的Demo是為了更好地說明如何進行幾何解構。所謂的幾何解構需要處理的是從2D畫面到3D場景的重建過程,大致過程是估算攝像機的運動并通過算法從2D點中生成3D點,從而實現3D的重建與人物的遮罩,為后續妥善處理視頻中元素的遮擋問題進行技術鋪墊。

3)3D重建的典型過程

對SLAM有所了解的同學可能比較熟悉接下來的內容——3D重建的典型過程。之所以將其稱為一個典型的過程,是因為除此之外還有其它的解決方法,但目前來說這套方法是最成熟的,可被稱為“典型”,主要由以下步驟組成:首先進行的是特征點的計算和匹配;接下來,基于特征點匹配的結果系統會估算攝像機的位姿并跟蹤其運動得出其運動軌跡,之后經過一系列優化處理,生成稀疏點云或稠密深度圖。

4)面臨的問題

此典型過程與傳統方法一樣面臨著很多問題,使之無法處理所有鏡頭與畫面。比較典型的問題包括復雜的場景和遮擋,例如難以在一個人頭攢動的場景中實現準確的3D重建。而最重要的問題則是紋理缺乏,一旦目標缺乏紋理就無法從中準確提取特征點。特征點偵測在整條Pipeline中處于基礎位置,無法準確提取特征點意味著后面的所有處理都無法進行。之后會講到如何用深度學習技術解決此項問題,這也是現在的一個技術發展前沿。除了以上描述的問題,我們還面臨諸如攝像機運動軌跡退化(攝像機靜止或純旋轉)、非剛性(攝像機與目標同時運動)等不利于我們進行三維結構還原的情景與Pipeline過長造成魯棒性降低等問題,這就要求我們尋求更穩定而有效的解決方案。

2.2 基于學習的方法

針對以上問題,我們提出的方案是基于學習的方法。大家可以思考這個問題:人類是如何通過視覺感知周圍環境的?有人會說是不是因為人類有兩只眼睛,可利用雙目進行三維場景的視覺重構?其實單目視覺也可實現類似效果,通過大量學習收獲的海量信息,即使一只眼睛的小黃人也可以理解三維世界,例如杯子與桌面的位置可通過杯子一般放在桌面上方的常識確定,人與車的相對位置可通過兩者的大小來確定等。這些經驗知識指導人們還原與認知自己所處的環境,而我們日常觀看的視頻都是基于單目攝像機拍攝形成的一個圖像幀序列,那么單目+學習能否還原3D結構?事實證明這個思路是正確的。

2.2.1 卷積神經網絡——替代深度估計模塊

接下來先看一個比較典型的例子,上圖是用深度卷積網絡替代深度估計模塊進行深度偵測的示意圖。我們可以看到,整個網絡的結構類似于一個包括編碼器與解碼器在內的自編碼器;首先我們輸入一個立體視覺的兩張圖片,通過深度網絡估算出相應深度圖。當然這里的兩張圖片并不隨機,圖片的采集有一定要求,我們可以在KITTI開源數據庫中得到采集照片需要的數據集;拍攝時用相對距離已知且固定,焦距相同的兩臺照相機同時對同一個場景進行拍攝,采集符合要求的照片并得到深度圖;成功輸出深度圖后,我們可根據此雙目系統的基礎數學公式:

D(x)=f*B/d(x)

利用深度圖估算并預測出原圖所展示的空間深度信息,產生的預測值與實際的真實值之間存在差異值;我們將這個所有像素的光度差異值作為損失函數進行基于WARP的反向傳播并借此訓練神經網絡,經過大量訓練就可得到這樣一個可對于單視圖進行深度估計的卷積神經網絡。輸入一張圖片,此卷積神經網絡就可生成一張我們所需要的深度圖,這樣采用深度學習技術完全替代傳統的深度估計的過程是比較典型的。

2.2.2 卷積神經網絡——替代多個模塊

不僅如此,我們還可實現同時進行深度和攝像機運動的估計。此方法與之前提到的利用幾何原理與雙目相機模型的方法類似,但這里用來訓練CNN的素材是一段視頻,其原理是利用相鄰幀之間的微小差異進行反算,使用針孔相機模型公式:

可同時訓練兩個獨立的神經網絡,分別用來輸出深度圖與估算攝像機的旋轉平移等運動。這與前一個神經網絡的訓練類似,都是致力于實現無監督的全自動化學習過程。對于視頻而言由于其幀間存在很多關聯信息,這些關聯信息可作為神經網絡的學習數據,因此我們可在這里實現無監督學習。無監督學習的好處在于節省了大量的高成本的人工標記工作。因此在視頻分析領域,無監督學習會扮演著越來越重要的角色,值得大家去關注。當然這里并不是說傳統的有監督學習一無是處,在諸多專業細分領域例如視頻觀眾識別等還需要依賴人工標注的有監督學習。鑒于視頻幀間存在可以被利用的豐富信息,雖然與傳統圖像處理相比難度更大,但我們可以利用無監督學習實現更高效的視頻處理效果。

2.2.3 2D語義分割結合點云

深度學習還能幫助我們做更多的事情。除了估算深度與攝像機運動,我們還可以利用語義分割的結果進行平面檢測。由于在植入廣告時我們會對墻面桌面等平面元素給予更多的關注,而如果只是從點云中簡單粗暴地進行擬合,其過程的處理復雜程度很高,效率十分低下。因此,可以結合語義信息用深度學習進行2D語義分割,將分割結果與3D重建的結果結合即可得到了一個含有語義信息的深度圖或點云,在此基礎上進行的平面檢測,其算法復雜程度會大大降低,準確度會顯著提高,這些就是深度學習帶給我們的便利。

2.2.4 深度學習助力幾何解構

深度學習在幾何解構方面的應用還有很多,其不僅能替換現有方法中的一個或多個模塊,也能在傳統幾何方法的基礎上加入語義信息。這里需要注意的是,單獨依靠深度學習的方法完成視頻植入的效果與傳統方法還是存在一定差距,不過這不妨礙我們將其作為未來的發展方向不斷探索。從之前的例子我們可以看出,盡管傳統方法依舊不可被替代,但深度學習的確有助于克服傳統方法的諸多不足,例如應對缺乏紋理的對象時傳統方法會明顯力不從心,而利用經過訓練的深度神經網絡進行深度估算與攝像機軌跡追蹤會明顯改善處理效果。

3. 展望未來

3.1 基于學習的視頻植入

從長遠來看,我認為基于無監督訓練的深度學習處理視頻植入是一個不可否認的趨勢。隨著海量的學習與其背后數據的不斷積累,系統可在不更新訓練模型的條件下持續提高模型的識別能力,也就是我們常說的“學無止境”。“學無止境”意味著持續不斷地獲得新數據與提升能力,我想無論是對技術人員還是計算機網絡而言,這一點都是十分關鍵的。

3.2 智能影像生產

也許大家從我的分享中感受到了視頻植入的神奇,但視頻植入是一個針對特定領域的問題。我們往往關注的是如何將一個海報貼在墻上或把一個3D模型放在桌面上。如果我們將視頻植入技術發展到批量的智能影像生產則需要面臨更大的挑戰,也就是借助技術實現更通用、精確、真實的視頻植入效果,才能收獲符合智能影像生產要求的產品。相信隨著深度學習的發展,我們期待的智能影像生產將獲得矚目的進步,這也是我們與用戶共同的目標。

隨著近年短視頻行業的蓬勃發展,除了關注長視頻領域,我們也越來越關注包括短視頻平臺、直播平臺在內的短視頻領域。我們期待利用基于視頻植入技術的原生視頻廣告將廣告主的一些想法自然添加在直播畫面里的桌面或墻上并隨著攝像機的運動實現自然變化,這種后期植入式海報是我們的優勢產品之一。我相信,借助科技的力量,利用場景的關聯性優化廣告投放效果能讓廣告成為互聯網視頻的錦上之花。

-

視頻

+關注

關注

6文章

1933瀏覽量

72811 -

互聯網

+關注

關注

54文章

11105瀏覽量

103016

原文標題:吉長江:基于學習的視頻植入技術是未來趨勢

文章出處:【微信號:livevideostack,微信公眾號:LiveVideoStack】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

智譜視頻生成大模型清影升級,開啟有聲電影新時代

德國進口蔡司工業CT去散射偽影技術

智譜AI正在研發國產文生視頻模型,對標OpenAI Sora

智譜AI正研發對標Sora的國產文生視頻模型

南科大海高院與吉方工控共建“吉方智能感知實驗室”

南科大海高院與吉方工控共建“吉方智能感知實驗室”,推動海洋智能感知技術創新

音視頻解碼生成:打造極致觀影體驗的關鍵技術

吉營菁英 潮Ai泰汕

馬斯克:人類首次接受腦機接口芯片植入,植入者恢復良好

吉長江:影譜科技的視頻植入技術

吉長江:影譜科技的視頻植入技術

評論