UDP成為低延時(shí)流媒體關(guān)鍵 選SRT還是QUIC?

無(wú)論是SRT還是QUIC,UDP都成為實(shí)現(xiàn)低延遲視頻流傳輸?shù)谋剡x項(xiàng)。在剛剛結(jié)束的俄羅斯世界杯,以及即將到來(lái)的重大體育賽事中,SRT與QUIC還將有一番較量。LiveVideoStack對(duì)原文進(jìn)行了摘譯。

英特爾QSV技術(shù)在FFmpeg中的實(shí)現(xiàn)與使用

本文來(lái)自英特爾資深軟件工程師張華在LiveVideoStackCon 2018講師熱身分享,并由LiveVideoStack整理而成。在分享中張華介紹了英特爾GPU硬件架構(gòu),并詳細(xì)解析了英特爾QSV技術(shù)在FFmpeg中的具體實(shí)現(xiàn)與使用。

劉文峰:讓科技成就藝術(shù)創(chuàng)意

日前,LiveVideoStack采訪了愛(ài)奇藝CTO劉文峰,他分享了自己的成長(zhǎng)經(jīng)歷,以及最近閱讀的書(shū)籍——《孵化皮克斯:從藝術(shù)烏托邦到創(chuàng)意帝國(guó)的非凡之旅》,他表示,作為愛(ài)奇藝的CTO,要幫助公司將科技創(chuàng)新與藝術(shù)創(chuàng)意結(jié)合,為用戶(hù)提供極致的體驗(yàn)。

Uber的一鍵式聊天智能回復(fù)系統(tǒng)

通過(guò)機(jī)器學(xué)習(xí)和自然語(yǔ)言理解結(jié)束,Uber實(shí)現(xiàn)了一套智能的聊天系統(tǒng),從而有效的提升司機(jī)和乘客之間的溝通效率,減少對(duì)司機(jī)的打擾。

張霖峰:AV1和VVC的格局將在2023年后明朗

本文是MSU評(píng)測(cè)解讀的系列文章之一。不過(guò)Ucodec CEO張霖峰還講述了Video Codec的機(jī)會(huì),VVC與AV1的競(jìng)爭(zhēng)格局,蘋(píng)果公司在Video Codec格局中扮演的重要角色等等。

Safari上使用WebRTC指南

盡管Apple在2017年的WWDC上宣布加入WebRTC支持,但仍然沒(méi)有看到Apple在支持WebRTC上更深入的舉動(dòng),尤其是其不只支持VP8更加強(qiáng)了這種擔(dān)憂(yōu)。

CMAF將在2019年得到快速發(fā)展

按照J(rèn)W Player技術(shù)高級(jí)副總裁John Luther的說(shuō)法,CMAF將在2019年快速發(fā)展,盡管這項(xiàng)技術(shù)在國(guó)內(nèi)還不怎么流行。蘋(píng)果、微軟以及Akamai都在支持CMAF。在下周舉行的LiveVideoStackCon 2018上,Akamai 首席架構(gòu)師William Robert Law將會(huì)分享如何通過(guò)CMAF提供海量并發(fā)的低延遲流媒體服務(wù)的。

蘭華峰:商業(yè)模式驅(qū)動(dòng)企業(yè)參與MSU評(píng)測(cè)

本文是MSU年度評(píng)測(cè)解讀的第四篇。LiveVideoStack采訪了Hulu技術(shù)總監(jiān)蘭華峰,由于Hulu內(nèi)部自成一套Codec評(píng)測(cè)方法和測(cè)試序列,他給出了如何正確使用MSU報(bào)告的建議。同時(shí)他表示,與傳統(tǒng)的Codec服務(wù)商不同,今年獲得前四的3家本土服務(wù)商,都提供的是視頻云服務(wù),這也導(dǎo)致他們格外重視MSU的評(píng)測(cè)結(jié)果。

Netflix:通過(guò)可視化和統(tǒng)計(jì)學(xué)改進(jìn)用戶(hù)QoE

本文來(lái)自Netflix的技術(shù)博客,文章介紹了如何通過(guò)統(tǒng)計(jì)學(xué)的方法來(lái)減少播放緩沖時(shí)間或減少碼率。LiveVideoStack對(duì)原文進(jìn)行了摘譯。

音頻/視頻技術(shù)

為 janus-pp-rec 增加視頻旋正功能

Janus Gateway 支持 server 端錄制,保存的文件格式是對(duì) RTP 報(bào)文的一種自定義封裝格式(MJR),音視頻數(shù)據(jù)單獨(dú)存儲(chǔ),官方提供了一個(gè) janus-pp-rec 的程序,可以把 MJR 格式的文件轉(zhuǎn)換為其他封裝格式的文件,然后我們可以利用 FFmpeg 把音視頻文件合并為一個(gè)文件。

定義和測(cè)量延遲

想要優(yōu)化延遲,可Latency到底是多少?延遲始終是媒體內(nèi)容傳輸?shù)囊粋€(gè)重要關(guān)注點(diǎn),人們也在不斷嘗試用新的方法來(lái)優(yōu)化延遲,本文參考AWS的一些新技術(shù),介紹了延遲的定義,以及如何具體測(cè)量延遲,給出了延遲的量化概念。

FFmpeg:Android利用Filter進(jìn)行音頻數(shù)據(jù)預(yù)處理

本文簡(jiǎn)單介紹了移動(dòng)端Android系統(tǒng)下利用FFmpeg的Filter進(jìn)行音頻數(shù)據(jù)預(yù)處理的方法。按照慣例先上一份源碼 AndroidFFmpegFilter。

Android音視頻指南-媒體應(yīng)用架構(gòu)概述

本節(jié)將解釋如何將媒體播放器應(yīng)用程序分離為媒體控制器(用于UI)和媒體會(huì)話(huà)(用于實(shí)際播放器)。它描述了兩種媒體應(yīng)用程序架構(gòu):一種客戶(hù)端/服務(wù)器設(shè)計(jì),適用于音頻應(yīng)用程序,另一種是視頻播放器的單活動(dòng)設(shè)計(jì)。它還展示了如何使媒體應(yīng)用程序響應(yīng)硬件控制并與使用音頻輸出流的其他應(yīng)用程序合作。

視頻直播技術(shù)之iOS端推流

隨著網(wǎng)絡(luò)基礎(chǔ)建設(shè)的發(fā)展和資費(fèi)的下降,在這個(gè)內(nèi)容消費(fèi)升級(jí)的時(shí)代,文字、圖片無(wú)法滿(mǎn)足人們對(duì)視覺(jué)的需求,因此視頻直播應(yīng)運(yùn)而生。承載了實(shí)時(shí)性Real-Time和交互性的直播云服務(wù)是直播覆蓋各行各業(yè)的新動(dòng)力。本篇文章將向大家介紹iOS端的推流技術(shù)。

編解碼

宋利:許多高手并未參加MSU評(píng)測(cè)

眾多本土和華人公司積極的參與MSU視頻編碼大賽,上海交通大學(xué)教授宋利接受LiveVideoStack采訪時(shí)表示,華人在整個(gè)編解碼領(lǐng)域有舉足輕重的影響力。但也要看到,許多國(guó)外高手并未參與MSU評(píng)測(cè),不能盲目樂(lè)觀。本文是解讀MSU評(píng)測(cè)的第二篇。

王豪:HW265到“HW266”

每年的MSU的視頻壓縮評(píng)比報(bào)告都是多媒體的熱點(diǎn)話(huà)題之一,在MSU 2018評(píng)比中,華為HW265在多項(xiàng)測(cè)試中排名第一。LiveVideoStack采訪了華為媒體技術(shù)院視頻編碼團(tuán)隊(duì)負(fù)責(zé)人王豪,在參賽之前,HW265已經(jīng)在多領(lǐng)域商用。未來(lái)華為將投入到VVC的研發(fā),并看好AV1的下一代AV2。

H264、AAC、RTMP解析

H264碼流文件分為兩層:(1) VCL(Video Coding Layer)視頻編碼層:負(fù)責(zé)高效的視頻內(nèi)容表示,VCL 數(shù)據(jù)即編碼處理的輸出,它表示被壓縮編碼后的視頻數(shù)據(jù)序列。(2) NAL(Network Abstraction Layer)網(wǎng)絡(luò)提取層:負(fù)責(zé)以網(wǎng)絡(luò)所要求的恰當(dāng)?shù)姆绞綄?duì)數(shù)據(jù)進(jìn)行打包和傳送,是傳輸層,不管是在本地播放還是在網(wǎng)絡(luò)播放的傳輸,都要通過(guò)這一層來(lái)傳輸。

AV1編碼持續(xù)優(yōu)化

AV1比HEVC有30%以上的編碼效率提升,但編碼復(fù)雜度高的離譜。好在AOM聯(lián)盟不斷對(duì)AV1進(jìn)行優(yōu)化,預(yù)計(jì)今年內(nèi)AV1的編碼復(fù)雜度將降到VP9的10倍以?xún)?nèi)。

FFmpeg 是如何實(shí)現(xiàn)多態(tài)的?

眾所周知,F(xiàn)Fmpeg 在解碼的時(shí)候,無(wú)論輸入文件是 MP4 文件還是 FLV 文件,或者其它文件格式,都能正確解封裝、解碼,而代碼不需要針對(duì)不同的格式做出任何改變,這是面向?qū)ο笾泻艹R?jiàn)的多態(tài)特性,但 FFmpeg 是用 C 語(yǔ)言編寫(xiě)的,那么它是如何使用 C 語(yǔ)言實(shí)現(xiàn)了多態(tài)特性的呢?

AI智能

AI驅(qū)動(dòng)智能媒體生產(chǎn)

本文總結(jié)了發(fā)表在IBC2018上的由日本NHK的Hiroyuki Kaneko等撰寫(xiě)的“AI-DRIVEN SMART PRODUCTION”,介紹了NHK在智能媒體生產(chǎn)方面取得的成就以及今后的發(fā)展方向。

AI如何用于現(xiàn)場(chǎng)直播場(chǎng)景

與許多產(chǎn)業(yè)一樣,通過(guò)軟件和算法輔助,電視與視頻制作很可能被人工智能和機(jī)器學(xué)習(xí)所改造,而當(dāng)前這些制作任務(wù)都是由人來(lái)執(zhí)行。隨著現(xiàn)場(chǎng)直播報(bào)道涉及的范圍越來(lái)越廣,而相關(guān)專(zhuān)業(yè)人士的數(shù)量稀缺,基于AI的影視制作技術(shù)應(yīng)運(yùn)而生。

利用人工智能提升足球直播效果

人工智能技術(shù)代表著未來(lái)無(wú)限的可能性,已經(jīng)在很多領(lǐng)域帶來(lái)巨大的沖擊。在足球直播這一領(lǐng)域,版權(quán)方需要提供更多更優(yōu)質(zhì)的內(nèi)容以應(yīng)對(duì)日益增長(zhǎng)的多元化需求,因此急需提高運(yùn)營(yíng)效率的新方式。

在對(duì)抗中學(xué)習(xí)網(wǎng)絡(luò)結(jié)構(gòu)——87頁(yè)P(yáng)PT帶你學(xué)習(xí)Graph中的GAN

近期,圖卷積研究大神Petar Veli?kovi?在蒙特利爾作了一場(chǎng)關(guān)于Graph+GAN的報(bào)告,詳細(xì)講解了圖卷積網(wǎng)絡(luò)的基本概念以及最前沿的方法 GCN、GAT (Petar的代表作),以及基于圖的生成式方法,如何使用GAN進(jìn)行基于圖的學(xué)習(xí),并強(qiáng)調(diào)需要使用強(qiáng)化學(xué)習(xí)或Gumbel softmax來(lái)進(jìn)行反向傳播,也指出盡管圖的生成式模型效果很好,但未來(lái)還需要在這個(gè)方面需要更多的研究者一起探索。

自動(dòng)生成高效DNN,適用于邊緣設(shè)備的生成合成工具FermiNets

來(lái)自滑鐵盧大學(xué)滑鐵盧 AI 研究所和 DarwinAI 公司的研究者提出一種新思路:生成合成(generative synthesis),利用生成機(jī)器來(lái)自動(dòng)生成具備高效網(wǎng)絡(luò)架構(gòu)的深度神經(jīng)網(wǎng)絡(luò)。

圖像

Metal圖像處理——顏色查找表(Color Lookup Table)

一張1024x1024的普通圖片,是由1024 * 1024=1048576個(gè)像素點(diǎn)組成,每個(gè)像素點(diǎn)包括RGBA共32bit,常見(jiàn)的圖像處理是對(duì)相鄰像素點(diǎn)顏色、像素點(diǎn)本身顏色做處理。在對(duì)像素點(diǎn)本身顏色做處理的情況下,需要把某個(gè)顏色映射成另外一個(gè)顏色。

-

英特爾

+關(guān)注

關(guān)注

60文章

9886瀏覽量

171528 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8377瀏覽量

132411 -

Uber

+關(guān)注

關(guān)注

0文章

410瀏覽量

36209

原文標(biāo)題:音視頻技術(shù)開(kāi)發(fā)周刊 70期

文章出處:【微信號(hào):livevideostack,微信公眾號(hào):LiveVideoStack】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

盤(pán)點(diǎn)那些常見(jiàn)音視頻接口

常見(jiàn)音視頻接口的靜電浪涌防護(hù)和濾波方案

音視頻IP化浪潮全面來(lái)襲,分布式系統(tǒng)開(kāi)創(chuàng)音視頻行業(yè)新時(shí)代!

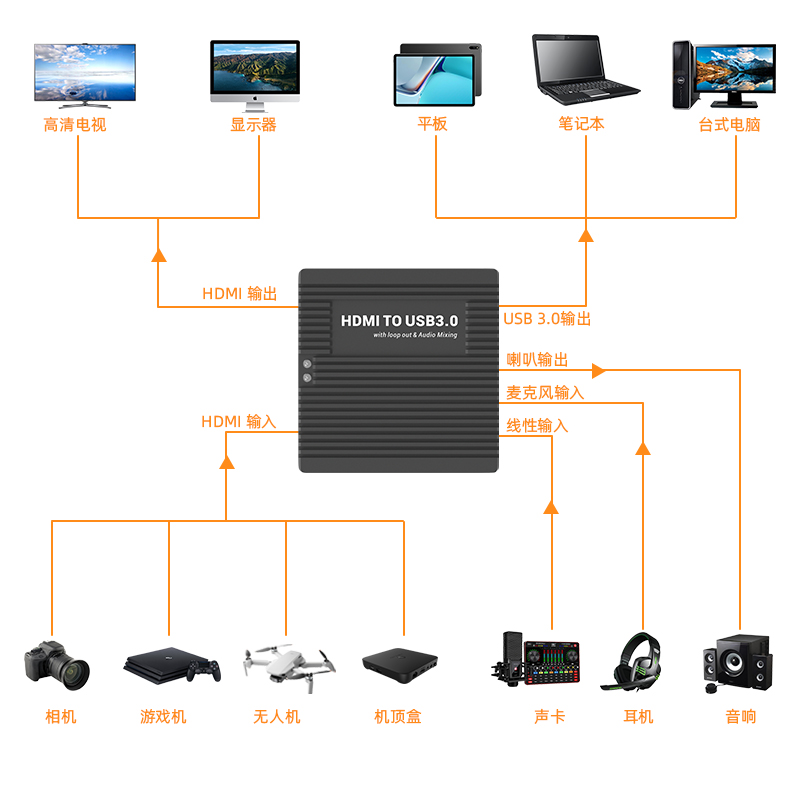

高清HDMI轉(zhuǎn)USB 3.0音視頻多功能音采集卡-測(cè)評(píng)

每周一期,縱覽音視頻技術(shù)領(lǐng)域的干貨和新聞投稿

每周一期,縱覽音視頻技術(shù)領(lǐng)域的干貨和新聞投稿

評(píng)論