“計算機領域其實沒有歧視,只是存在性別比例的差異罷了……”如果這種事件不放在臺面上說,可能大家就這么想當然的認為了。

或許當你津津有味閱讀某篇論文時,你可能很少會關注論文背后是否潛藏著的種族、女性歧視等話題,甚至會做出“何不食肉糜”的疑問。

近日,當美國多數商業公司員工開始盡情享受難得的圣誕節假休息日時,Twitter 上卻迎來了人工智能界的“扛把子”Anima Anandkumar 的連篇炮轟。她在其最新的推文中指出 Yann LeCun 存在性別歧視,Moshe Vardi 取關她并且涉嫌種族主義。

編譯:@Yan LeCun 自從你對我惡語相向后,它直接致使很多人在Twitter上甚至是發郵件罵我。對你鼓勵性別歧視、性騷擾的做法表示非常失望。

@Moshe Vardi 在 Facebook上表現地對我很不友好,我在一條帖子上對他發表的種族主義言論做出評論,認為非常可恥。相反,他非但刪除了我的評論,還繼續為其他人進行辯護。“Black in AI”組織為此做出了很多努力,她們不為種族主義做辯護。

要知道,Yann LeCun 不僅是 Facebook 人工智能研究院院長兼紐約大學教授,他同樣還被譽為“卷積神經網絡之父”、深度學習運動的領軍人物;而作為 Netta 首席科學家的 Moshe Vardi,同時還是美國科學院院士、美國工程院、歐洲科學院等五院院士。

除了怒懟兩位計算機領域赫赫有名的教授外,我們再來看看Anima Anandkumar之前的一些戰績:

人工智能領域的年度活動——神經信息處理系統會議的英文縮寫 NIPS 于今年改名為 NeurlPS,而這次更名的改變恰恰源自于她。資料顯示,多年以來原先的英文縮寫名稱引發了許多有關性別歧視和冒犯的爭議:“NIPS 既是對日本人的貶低性誹謗,也是對女性乳頭的性俚語。”

2017 年 NIPS 大會剛剛閉幕,就有人爆出明尼蘇達州大學生物統計系主任 Brad Carlin 公然談論性騷擾話題的不當言論。受此影響,一位學術圈的女性勇敢地站出來指出了該大牛對其進行進行性騷擾的事件,并呼吁女性科研工作者拒絕沉默。

甚至 Google AI 負責人 Jeff Dean 也發推文說,“現在這個名字讓人感到不舒服。”當他們發布了一項針對 2000 多名與會者(大多數是男性)的調查,結果發現大多數人都對此有所了解。

于是當 Anandkumar 看到該會議的名稱作為性別歧視笑料的話題愈演愈烈時,便開始了 ProtestNIPS 活動希望更改大會名稱,并起草了一份有超過 200 個簽名的請愿書。最終,會議組委會做出了退步。

盡管從目前來看只是包容性的小舉措,但足以證明在很長一段時間內女性在計算機尤其是人工智能學術圈的地位正逐步得到提升。

也或許正因如此,2018 NeurlPS 會議現場,不少參會者特意提到:“機器學習領域的女性從業者開始逐漸增多。”

2018 年 9 月,在辭去亞馬遜 AWS 首席科學家的職位之后,Anandkumar 以 NVIDIA 機器學習主任的身份公開亮相,與此同時她還是加州理工學院的教授。

性別歧視的物化——算法

人工智能無疑將成為未來幾年計算機科學最重要的研究領域之一。但上述挑戰反映出來的是科技行業更加缺乏多元化。

在主要的科技公司,女性占工程和計算機崗位的 20% 甚至不到。而這種性別失衡的現象放在人工智能領域則更為嚴重,據創業孵化器 Element AI 的一項估計顯示,在美國的人工智能領域,僅有 13%為女性研究人員,而且該領域的黑人和拉丁裔的高管數量正在逐漸減少。

當然,這種問題可能不只是在人類本身,算法作為智能學習的一種“物化”,將性別歧視的問題以技術的方式進行了放大。

今年 10 月,亞馬遜 AI 招聘工具被曝出性別歧視,檢測到女性就打低分的問題。盡管后來工程師發現了算法在數據源上存在的漏洞問題并修改了算法,不再通過檢索關鍵詞來推斷應聘者的性別。但這還是沒能解決實際問題,AI 算法已經形成了這樣的認知,而且更確切的來講,男多女少,是目前整個科技行業的現實情況。

據了解,麻省理工學院媒體實驗室的研究員 Joy Buolamwini,同樣也是 Algorithmic Justice League 的發起人,該組織致力于抗爭具備算法偏見的“編碼注釋”(coded gaze)。她和谷歌研究員、Black in AI 組織聯合發起人 Timnit Gebru,共同發布了一項研究,該研究顯示:三種領先的面部識別算法在識別較暗的面部時要比較亮的面部準確率要差得多,同時,在識別女性與男性面部特征時,前者的準確率也更差些。

該項研究敲響了試圖構建算法模型的頂尖科技公司的警鐘,這也被認為是人工智能領域需要具備多樣化元素的證據。

為 AI 與責任作出貢獻的百位女性

“盲目相信算法的一個主要問題是,我們可以在不承認具備任何意圖的情況下傳播這種帶有歧視性的模型。”

在這樣一個充滿挑戰性的人工智能時代,AI 算法和殺手機器人的偏見普遍存在,所有這些問題都需要公開討論并立即采取行動進行解決。這也同時誕生了一門叫做“AI 倫理與責任”的學科,涉及了當今人類面臨的從種族/性別不平等的算法到機器人是否應該擁有權利的關鍵問題。學術研究人員、倫理學家、政策制定者、法律專家、數據科學家、隱私倡導者、遺傳學家以及非技術學科人員都為此提供了有意義的見解。

人工智能領域的女性研究員本來就稀缺,專門推出“AI 倫理與責任”的女性更是寥寥無幾。因此,我們也專門找到了 Lighthouse 創始人 Mia Dand 為這個領域做出過杰出貢獻的 100 位女性。

標準:

A)自我認同為女性。

B)主要關注人工智能的倫理學,特別是涉及機器人和其他人工生物/系統。

C)作為個人或大型組織的一部分,以個人或專業身份積極推動道德/責任人工智能事業。

查看完整榜單請移步:https://becominghuman.ai/100-brilliant-women-in-ai-ethics-to-follow-in-2019-and-beyond-92f467aa6232

寫在最后

研究人工智能只需要了解算法模型嗎?是的這很重要,但并不代表你僅需要關注這一點。正如上學時老師會灌輸給你知識,但你畢業后才發現原來你更需要的是課堂之外的人文教育。不然,你不會懂得研發的這套算法是否傷害到了別人。

再需要提一句的是,目前在科技行業男多女少的現象或許根本無法避免,為什么理工科的女性就偏少,而從事傳媒、教育、藝術等領域的女性工作者會更多?這是值得我們思考的問題。

-

神經網絡

+關注

關注

42文章

4762瀏覽量

100541 -

Facebook

+關注

關注

3文章

1429瀏覽量

54650 -

人工智能

+關注

關注

1791文章

46859瀏覽量

237584

原文標題:AI女性界的“扛把子”,憑一己之力迫使NIPS改名

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

理想汽車榮獲汽車安全產品應用最佳實踐獎

潤和軟件出席中華預防醫學會環境衛生分會2024年學術會議

圓滿收官| Aigtek參展第二屆波動力學前沿與應用學術會議載譽歸來!

Nullmax視覺感知能力再獲國際頂級學術會議認可

邀請函| Aigtek安泰電子攜經典產品,亮相第二屆波動力學前沿與應用學術會議!

銳思智芯展示融合視覺感知技術創新與產品應用

中微公司受邀出席第十八屆全國MOCVD學術會議

CET中電技術邀您參加第八屆全國電能質量學術會議暨電能質量行業發展論壇

美能光伏亮相土耳其 PVCON 2024 學術會議

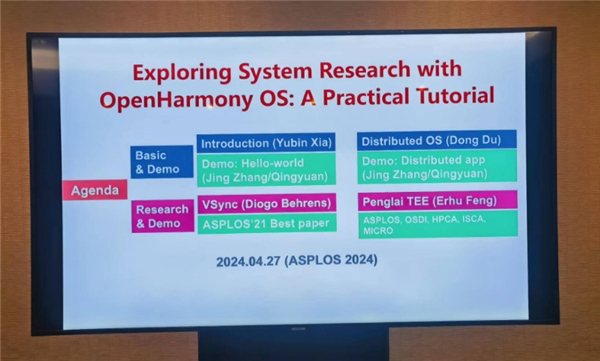

OpenHarmony 成功亮相國際學術會議 ASPLOS 2024

國科微即將出席國際頂級學術會議CPS-IoT Week2024

OpenHarmony即將首次亮相國際頂級學術會議

Aigtek安泰電子第一屆全國等離子體生物醫學學術會議圓滿結束!

3月15-17日 與Aigtek相約第一屆全國等離子體生物醫學學術會議!

那些潛藏在高大上的學術會議背后的種族與性別歧視

那些潛藏在高大上的學術會議背后的種族與性別歧視

評論