近日,來自SAP(全球第一大商業(yè)軟件公司)的梁勁(Jim Liang)公開了自己所寫的一份 520 頁的學(xué)習(xí)教程(英文版),詳細(xì)、明了地介紹了機(jī)器學(xué)習(xí)中的相關(guān)概念、數(shù)學(xué)知識和各種經(jīng)典算法。機(jī)器之心看到后,也迫不及待的推廣給更多的讀者。完整的 PDF 請從文后作者公開的鏈接下載。

在介紹中,Jim Liang寫到:

人工智能是這兩年風(fēng)頭正勁的領(lǐng)域,也是未來具有顛覆性可能的新領(lǐng)域。不少人嘗試去學(xué)習(xí)機(jī)器學(xué)習(xí)相關(guān)的知識。然而,一旦越過最初的 overview 階段,很多人就開始打退堂鼓了,然后迅速放棄。

為什么會這樣?

極 高 的 學(xué) 習(xí) 曲 線

首當(dāng)其沖就是數(shù)學(xué),涉及統(tǒng)計學(xué)、微積分、概率、線性代數(shù)等,大家雖然都學(xué)過高等數(shù)學(xué),但如果你還記得里面的細(xì)節(jié),算你牛。更可能的情況是,多數(shù)人都對高等數(shù)學(xué)忘記了,面對各種算法里的大量公式,感到厭惡,甚至恐懼。

其次因為機(jī)器學(xué)習(xí)本身是一個綜合性學(xué)科,而且是一個快速發(fā)展的學(xué)科,知識點散亂,缺乏系統(tǒng)性。

市面上的機(jī)器學(xué)習(xí)/深度學(xué)習(xí)書籍、文章、教程,遍地開花,但能以清晰的方式表達(dá)、循序漸進(jìn)地講解的教程,其實不多,大量的教程沒有考慮到學(xué)習(xí)者的基礎(chǔ),使得初學(xué)者感到挫敗和困惑。

圖 解 機(jī) 器 學(xué) 習(xí)

正是對機(jī)器學(xué)習(xí)的過程中的痛苦有切身體會,我希望能做一份教程,以淺顯易懂的方式去講解它,降低大家的學(xué)習(xí)門檻。我為此花費(fèi)了數(shù)月時間,經(jīng)常做到深夜,把自己的學(xué)習(xí)筆記整理成了這份教程。

從結(jié)構(gòu)來看,全部教程包含兩部分:

Part 1 介紹了基本概念,包括:

機(jī)器學(xué)習(xí)的流程

數(shù)據(jù)處理

建模

評估指標(biāo)(如 MSE、ROC 曲線)

模型部署

過度擬合

正則化等

在第一部分,作者先介紹了如今應(yīng)用普遍的機(jī)器學(xué)習(xí):從自動駕駛、語音助手到機(jī)器人。其中有些思想,也是眾多讀者們了解過的,例如:為何機(jī)器學(xué)習(xí)在這個時候會火(大數(shù)據(jù)、計算力、更好的算法);機(jī)器學(xué)習(xí)、人工智能、深度學(xué)習(xí)三者的關(guān)系等。

除了這些基礎(chǔ)概念,這份教程也對機(jī)器學(xué)習(xí)模型的開發(fā)流程做了圖像化展示(如下圖),即使對此不太了解的讀者,也能通過這種流程展示有所學(xué)習(xí)。

建立機(jī)器學(xué)習(xí)解決方案的步驟

在 Part1 的其他小節(jié),作者以類似的圖像展示,對數(shù)據(jù)、建模、模型部署等內(nèi)容做了詳細(xì)介紹,這里就不一一列舉,可以從原報告查看。

在 Part2,作者介紹了 常用的算法,包括:

線性回歸

邏輯回歸

SVM

Knn

K-Means

決策樹

隨機(jī)森林

AdaBoost

樸素貝葉斯

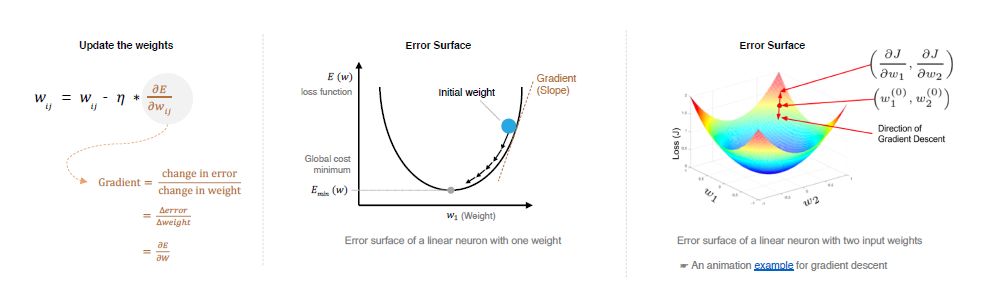

梯度下降

主成分分析

這部分包含了大量的數(shù)學(xué)公式,但作者盡力注解了其中的每個公式,從而充分、清晰地表達(dá)了眾多數(shù)學(xué)概念。

例如在「神經(jīng)網(wǎng)絡(luò)」部分,作者整理了 59 頁的筆記(從 311 頁到 369 頁)。作者從人腦中的神經(jīng)元架構(gòu)說起,介紹了人工神經(jīng)網(wǎng)絡(luò)(ANN)、人工神經(jīng)元工作的原理。這份筆記非常注重圖像化的概念解釋,理解起來非常直觀。

例如,下圖中的概念解釋很形象地展現(xiàn)了生物神經(jīng)元和人工神經(jīng)元工作方式的相似性。

生物神經(jīng)元的樹突輸入-軸突輸出模式和人工神經(jīng)元的輸入輸出模式對比。

過擬合的解釋。

人工神經(jīng)元的基礎(chǔ)結(jié)構(gòu)。

在涉及到數(shù)學(xué)公式時,作者會在旁邊有詳細(xì)的注解,如下圖所示:

對于并列的可選項(如激活函數(shù)、常用神經(jīng)網(wǎng)絡(luò)架構(gòu)等),也會有全面的列表:

常用的激活函數(shù)。

然后會有每個激活函數(shù)的單獨介紹:

Sigmoid 激活函數(shù)。

用神經(jīng)網(wǎng)絡(luò)分類手寫數(shù)字的前向傳播示例(softmax 激活函數(shù))。

對于神經(jīng)網(wǎng)絡(luò)中較為復(fù)雜的概念(如求導(dǎo)、反向傳播),幾張圖就能解釋清楚:

關(guān)于神經(jīng)網(wǎng)絡(luò)的完整訓(xùn)練過程,作者用簡略流程圖+計算細(xì)節(jié)展開的方式呈現(xiàn):

反向傳播算法完整流程。

前向傳播部分的計算細(xì)節(jié)。

就像前面提到的,這部分除了「神經(jīng)網(wǎng)絡(luò)」的介紹,還包括隨機(jī)森林、梯度下降等概念的介紹,讀者們可查看原教程。

總結(jié)

看完這份教程之后,小編覺得這是一份包羅萬象的學(xué)習(xí)筆記,既適合非專業(yè)人士了解有關(guān)機(jī)器學(xué)習(xí)的基礎(chǔ)概念,又適合有專業(yè)背景的學(xué)生進(jìn)一步學(xué)習(xí)。

寫教程是為了自己持續(xù)學(xué)習(xí),分享教程是為了幫助更多人學(xué)習(xí)。就像作者所說,「Learning by doing/teaching, 寫這個教程主要是強(qiáng)迫自己持續(xù)學(xué)習(xí),另外,也想分享給他人,希望能幫助到更多想學(xué)習(xí) Machine Learning 的人,降低大家的學(xué)習(xí)痛苦。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4762瀏覽量

100541 -

人工智能

+關(guān)注

關(guān)注

1791文章

46859瀏覽量

237580 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8377瀏覽量

132410

原文標(biāo)題:520頁的機(jī)器學(xué)習(xí)筆記

文章出處:【微信號:machine_vision_1,微信公眾號:機(jī)器視覺智能檢測】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

NPU與機(jī)器學(xué)習(xí)算法的關(guān)系

【「時間序列與機(jī)器學(xué)習(xí)」閱讀體驗】時間序列的信息提取

【「時間序列與機(jī)器學(xué)習(xí)」閱讀體驗】+ 鳥瞰這本書

【「時間序列與機(jī)器學(xué)習(xí)」閱讀體驗】全書概覽與時間序列概述

【《大語言模型應(yīng)用指南》閱讀體驗】+ 基礎(chǔ)篇

如何理解機(jī)器學(xué)習(xí)中的訓(xùn)練集、驗證集和測試集

機(jī)器學(xué)習(xí)中的數(shù)據(jù)預(yù)處理與特征工程

遷移學(xué)習(xí)的基本概念和實現(xiàn)方法

機(jī)器學(xué)習(xí)算法原理詳解

機(jī)器學(xué)習(xí)在數(shù)據(jù)分析中的應(yīng)用

機(jī)器學(xué)習(xí)的經(jīng)典算法與應(yīng)用

機(jī)器學(xué)習(xí)中的相關(guān)概念、數(shù)學(xué)知識和各種經(jīng)典算法

機(jī)器學(xué)習(xí)中的相關(guān)概念、數(shù)學(xué)知識和各種經(jīng)典算法

評論