SLAM是Simultaneous Localization and Mapping的縮寫,意為“同時定位與建圖”。它是指運動物體根據傳感器的信息,一邊計算自身位置,一邊構建環境地圖的過程。目前,SLAM的應用領域主要有機器人、虛擬現實和增強現實。其用途包括傳感器自身的定位,以及后續的路徑規劃、場景理解。

1、SLAM(同步定位與建圖)

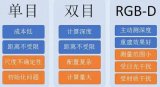

隨著傳感器種類和安裝方式的不同,SLAM的實現方式和難度會有很大差異。按傳感器來分,SLAM主要分為激光、視覺兩大類。其中,激光SLAM研究較早,理論和工程均比較成熟。視覺方案目前大部分實驗室研究階段,實際產品應用很少。SLAM研究自1988年提出以來,已經過了近三十年。早期SLAM研究側重于使用濾波器理論,最小化運動體位姿和地圖的路標點的噪聲。21世紀之后,學者們開始借鑒SfM(Structure from Motion)中的方式,以優化理論為基礎求解SLAM問題。這種方式取得了一定的成就,并且在視覺SLAM領域中取得了主導地位。

激光傳感器:激光傳感器可以直接獲得相對于環境的直接距離信息,從而實現直接相對定位,對于激光傳感器的絕對定位及軌跡優化可以在相對定位的基礎上進行。

視覺傳感器:視覺傳感器很難直接獲得相對于環境的直接距離信息,而必須通過兩幀或多幀圖像來估計自身的位姿變化,再通過累積位姿變化計算當前位置。這種方法更類似于直接用里程計進行定位,即視覺里程計(Visual Odometry)。里程計的測量積分后才相當于激光傳感器直接獲得的定位信息,這就是圖優化SLAM框架中的前端。而后端對定位和位姿軌跡的優化本質上與激光傳感器的優化相同,都基于最優估計的理論框架進行。

2、視覺SLAM發展

視覺定位

機器人運動過程中構建環境模型和地標,打造室內“視覺GPS”系統

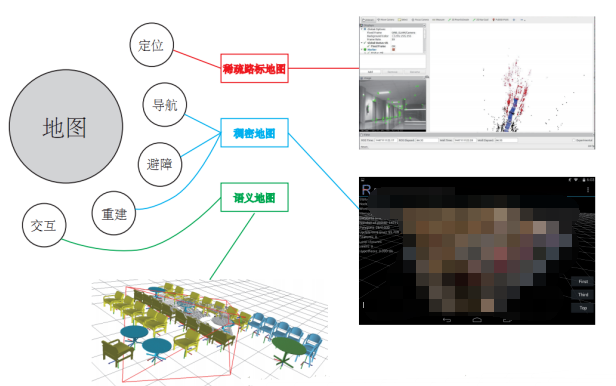

地圖構建

通過多傳感器融合技術實時構建高精度,可持久使用的室內地圖

語義地圖

使用深度神經網絡對地圖信息進行分割理解,形成具有豐富語義信息的室內地圖

應用場景

AR、機器人、無人機、無人駕駛等領域, 就像移動互聯網時代的手機定位一樣。

有理解力的SLAM:語義SLAM,精準感知并適應環境。將語義分析與SLAM有效融合,增強機器對環境中相互作用的理解能力,為機器人賦予了復雜環境感知力和動態場景適應力。

有廣度的SLAM:100萬平米強大建圖能力。借助高效的環境識別、智能分析技術,室內外全場景范圍高達100萬平米的地圖構建能力。

有精度的SLAM:高精度定位領先算法。可在任何地點進行開機識別、全局定位,精準度高達±2cm。

有時效的SLAM:動態地圖實時更新。根據傳感器回傳數據,與原有地圖進行分析比對,完成動態實時更新,實現life-long SLAM。

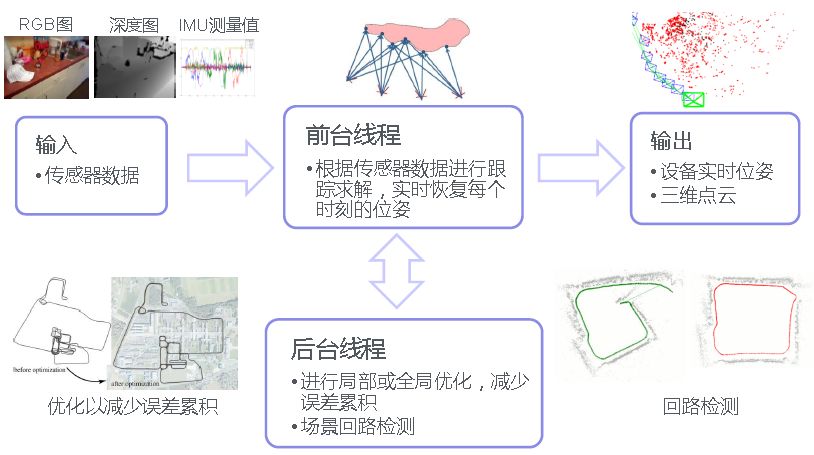

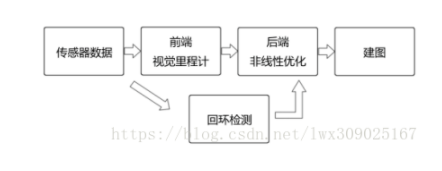

視覺SLAM系統分為五個模塊:傳感器數據、視覺里程計、后端、建圖、回環檢測。

3、視覺SLAM未來趨勢

導航定位與建圖

視覺SLAM

SLAM快速識別地圖坐標, 實現設備、特定目標長時間、高精度定位

高精度SLAM

基于視覺+慣性傳感器的高精度SLAM算法,媲美激光雷達的定位精度

實時稠密地圖構建

通過攝像頭獲取場景中的稠密點云信息,建立場景的柵格占用地圖

路徑規劃

基于實時構建的場景地圖,讓機器感知現實場景,實現自主最優路徑規劃

導航避障

通過攝像頭獲取場景中的稠密點云信息,建立場景的柵格占用地圖,基于智能避障算法,滿足機器人精準避障的需求

高精度語義地圖

深度學習圖像語義

輕量化模型精準識別百余類物體

稠密地圖語義分割及匹配

將稠密地圖按照物體的語義信息進行分割及匹配,幫助機器理解圖像內容,以實現通行區域感知及避障

語義SLAM

SLAM結合深度學習,實現精準的場景環境語義分析,提升SLAM系統精度

物體識別及環境語義

基于輕量化深度學習模型的物體識別,并結合場景地圖提供環境語義

多傳感器融合及標定

多傳感器融合

視覺、慣性、里程計、GNSS等多傳感器融合,滿足不同場景信息需求,優勢互補,提高系統精度

傳感器誤差建模

分析傳感器誤差源,對傳感器進行高精度誤差建模

快速、低成本傳感器標定

大幅降低傳感器標定成本,實現快速高精度傳感器標定

高性能低成本硬件

消費級傳感器及低成本計算單元即可滿足高精度前端解算

4、SLAM與視覺里程計(Visual Odometry)

人們有時候會混淆SLAM和視覺里程計的概念。應該說,視覺里程計是SLAM的一個模塊,其目的在于增量式地估計相機運動。然而,完整的SLAM還包括添加回環檢測和全局優化,以獲得精確的、全局一致的地圖。

視覺里程計通常作為SLAM系統的前端。它增量式的計算方法能估計鄰近幀間的相機運動,但這也意味著鄰近幀間的誤差會影響之后的軌跡估計,意味著它會隨著時間推移,產生漂移。同時,視覺里程計也不含有建圖模塊。一個完整的SLAM系統會關心相機軌跡和地圖的全局一致性,但這也意味著需要更多的計算資源來計算全局的優化。在資源有限、不關心全局路徑的場合(如無人機的著陸、短時間控制中),可以考慮只使用視覺里程計,而不必使用完整的SLAM。

5、SLAM和SFM

視覺SLAM中大量使用了SFM中的方法,如特征點跟蹤、捆集優化(Bundle Adjustment)等,以至于許多研究者把它們視為同一個研究領域。然而,盡管方法上很相似,SLAM和SFM的側重點是不同的。SLAM的應用場合主要在機器人和VR/AR,計算資源有限,需要很強的實時性,故側重點在于,如何在有限的資源里快速地對相機進行定位。而SFM方法通常是離線的,可以調用大量計算資源進行長時間的計算,側重于重建出更精確、美觀的場景。

6、開源SLAM方案

視覺傳感器

稀疏法(特征點):

ORB-SLAM(單目,雙目,RGBD)

Stereo DSO

ProSLAM

PTAM(單目)

MonoSLAM(單目)

半稠密法:

LSD-SLAM(單目,雙目,RGBD)

DSO(單目)

SVO(單目, 僅VO)

稠密法:

DTAM(RGBD)

Elastic Fusion(RGBD)

BundleFusion

Kintinous(RGBD)

DVO

RGBD-SLAM-V2

RTAB-MAP

MLM:(單目)

激光傳感器

HectorSLAM

Gmapping

KartoSLAM

CoreSLAM

LagoSLAM

cartographer

視覺與IMU融合:

OKVIS

VINS

VINS-Fusion

回環檢測:

DBoW2

DLoopDetector

Dlib

后端:

Ceres-solver

G2o

Gtasm

Vertigo

構圖:

Grid_map

Octomap

常用數據集:

1、TUM RGB-D SLAM Dataset and Benchmark

德國慕尼黑理工大學計算機視覺組制作的數據集,使用Kinect相機采集的數據集,包括IMU數據,并且用高精度運動采集系統提供了groundtruth(真值)。提供測試腳本,可以方便的實現量化評估。

2、KITTI Vision Benchmark Suite

德國卡爾斯魯厄理工學院和豐田工業大學芝加哥分校一起合作制作的用于自動駕駛的數據集。

3、EuRoC MAV Dataset

世聯邦理工大學制作的數據集,采用裝備了雙目相機和IMU的四旋翼無人機采集數據。

-

傳感器

+關注

關注

2548文章

50664瀏覽量

751939 -

機器人

+關注

關注

210文章

28191瀏覽量

206505 -

SLAM

+關注

關注

23文章

419瀏覽量

31786

原文標題:視覺SLAM的技術總結

文章出處:【微信號:IV_Technology,微信公眾號:智車科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

什么是SLAM?視覺SLAM怎么實現?

激光SLAM與視覺SLAM有什么區別?

基于視覺的slam自動駕駛

視覺SLAM技術以及其應用詳解

科普|視覺SLAM是什么——三種視覺SLAM方案

機器人主流定位技術:激光SLAM與視覺SLAM誰更勝一籌

視覺SLAM方案和硬件選型調研的總結

視覺SLAM開源方案匯總 視覺SLAM設備選型

視覺SLAM的技術資料總結

視覺SLAM的技術資料總結

評論