圖網(wǎng)絡領域的大牛、斯坦福大學Jure Leskovec教授在ICLR 2019就圖深度生成模型做了演講,闡述了圖生成模型的方法和應用,并詳細介紹了他的最新成果

斯坦福大學教授Jure Leskovec是圖網(wǎng)絡領域的專家,圖表示學習方法 node2vec 和 GraphSAGE 作者之一。

Jure Leskovec

在今年 ICLR,Jure Leskovec 教授及斯坦福、MIT 的多名研究者發(fā)表論文How Powerful Are Graph Neural Networks?(https://cs.stanford.edu/people/jure/pubs/gin-iclr19.pdf),詳細闡述了圖神經(jīng)網(wǎng)絡背后的原理和其強大的表征能力,認為圖神經(jīng)網(wǎng)絡在因果推理方面有巨大的潛力,有望成為 AI 的下一個拐點。

此外,在 ICLR 受邀演講上,Jure Leskovec 教授還就圖深度生成模型做了演講。在這次演講中,Jure 闡述了圖生成模型的方法和應用,并詳細介紹了他的最新成果,GraphRNN 和 Graph Convolutional Policy Network。

本文帶來該演講的 PPT。

下載鏈接 (或點擊閱讀原文下載):

http://i.stanford.edu/~jure/pub/talks2/graph_gen-iclr-may19-long.pdf

主要內(nèi)容:

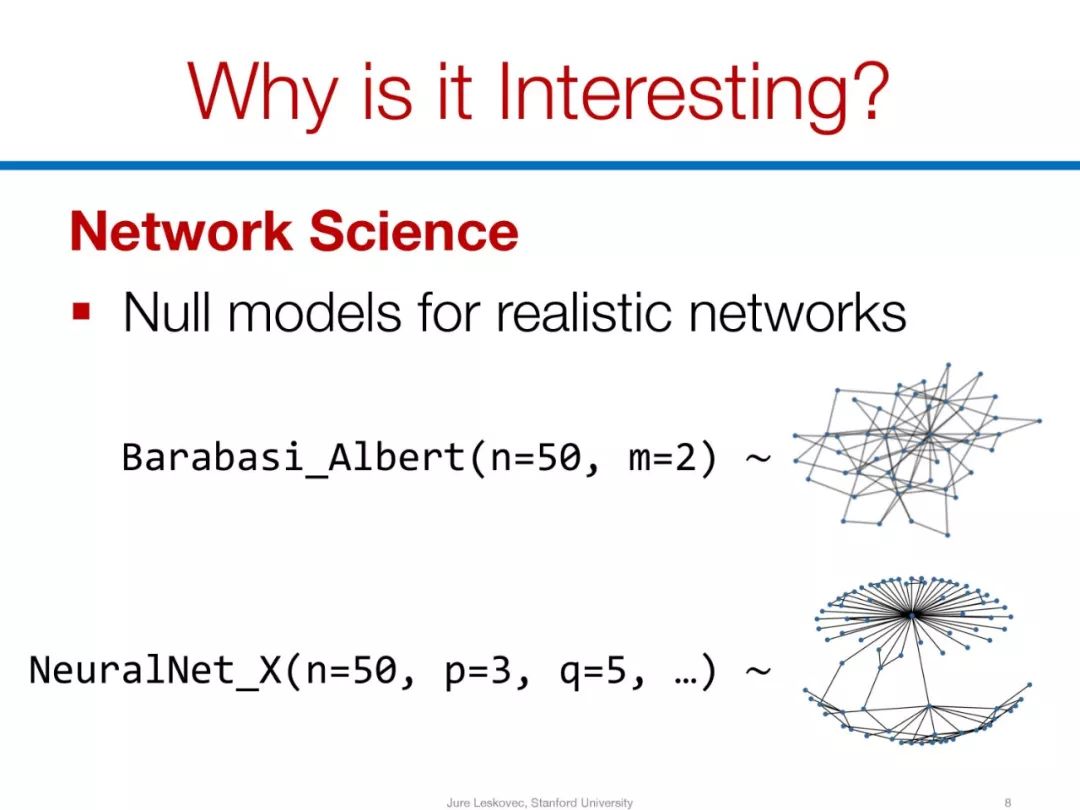

為什么圖網(wǎng)絡很重要?

圖生成任務

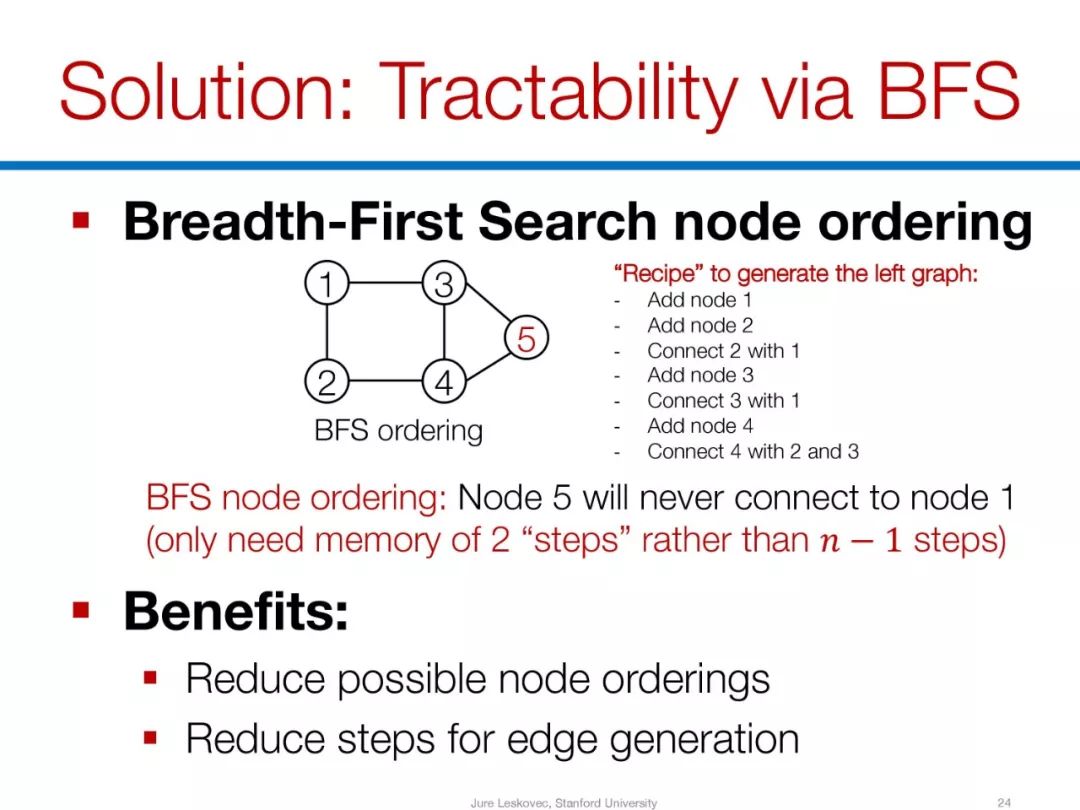

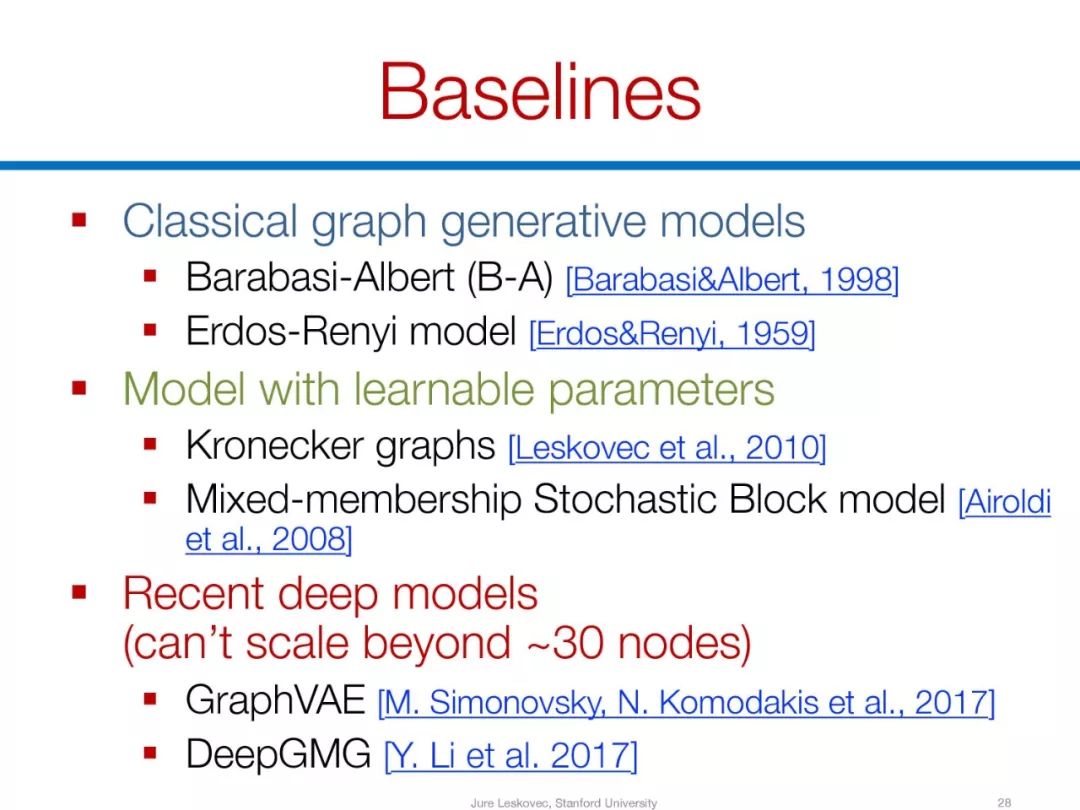

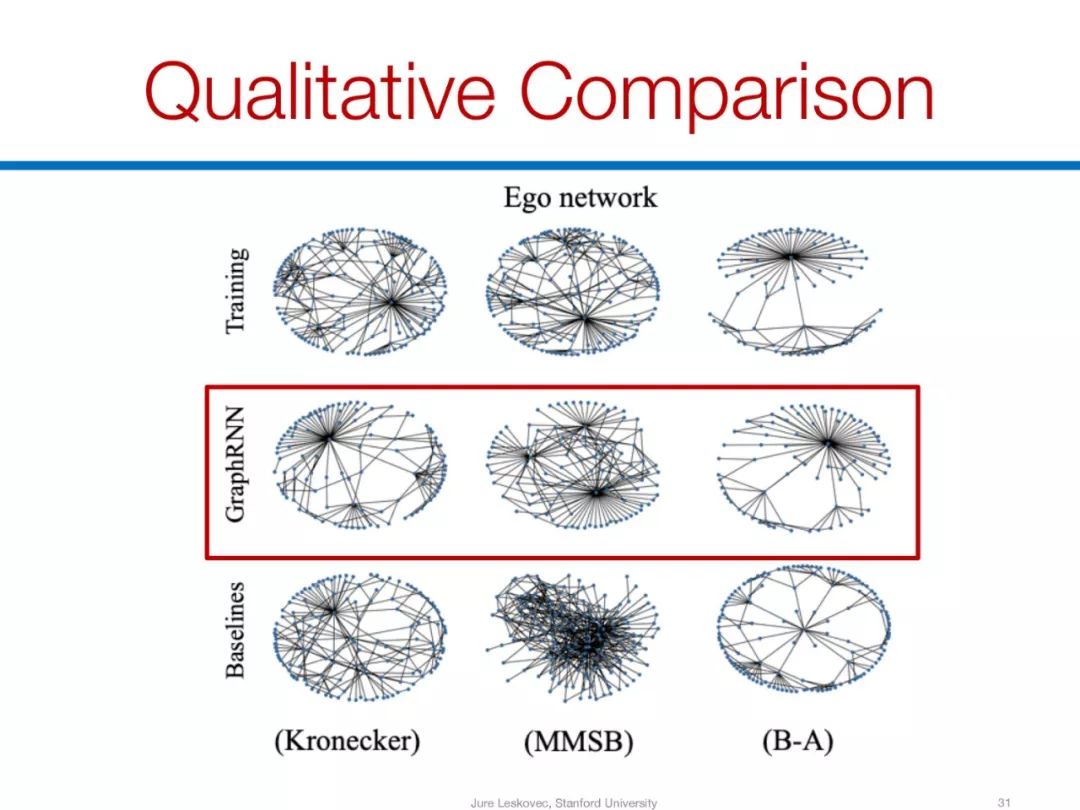

GraphRNN:RNN 的兩個層次

圖卷積策略網(wǎng)絡:將圖表示和強化學習結合起來

為什么圖網(wǎng)絡很重要?

為什么圖網(wǎng)絡很重要?

深入了解圖的形成過程

異常檢測 - 異常行為,進化

預測 —— 根據(jù)過去預測未來

新的圖結構的模擬

圖補全 - 很多圖都是部分可觀察的

“如果” 場景

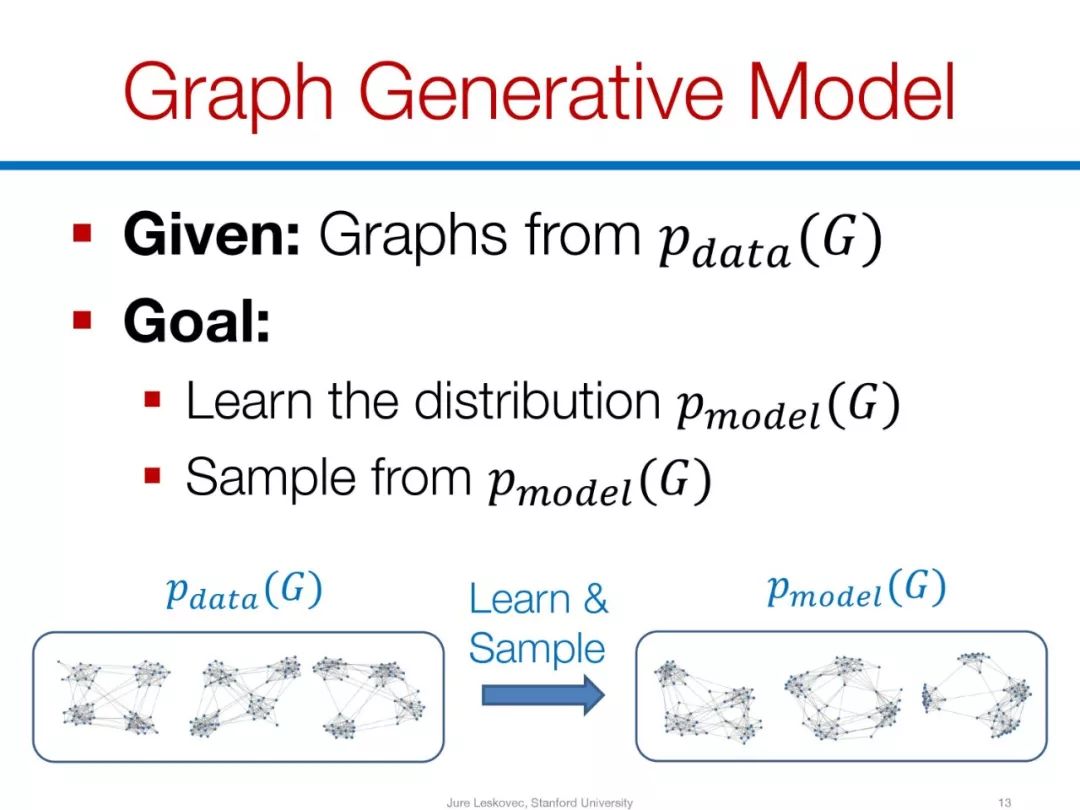

圖生成任務

任務 1:生成逼真的圖

生成與給定數(shù)據(jù)集相似的圖

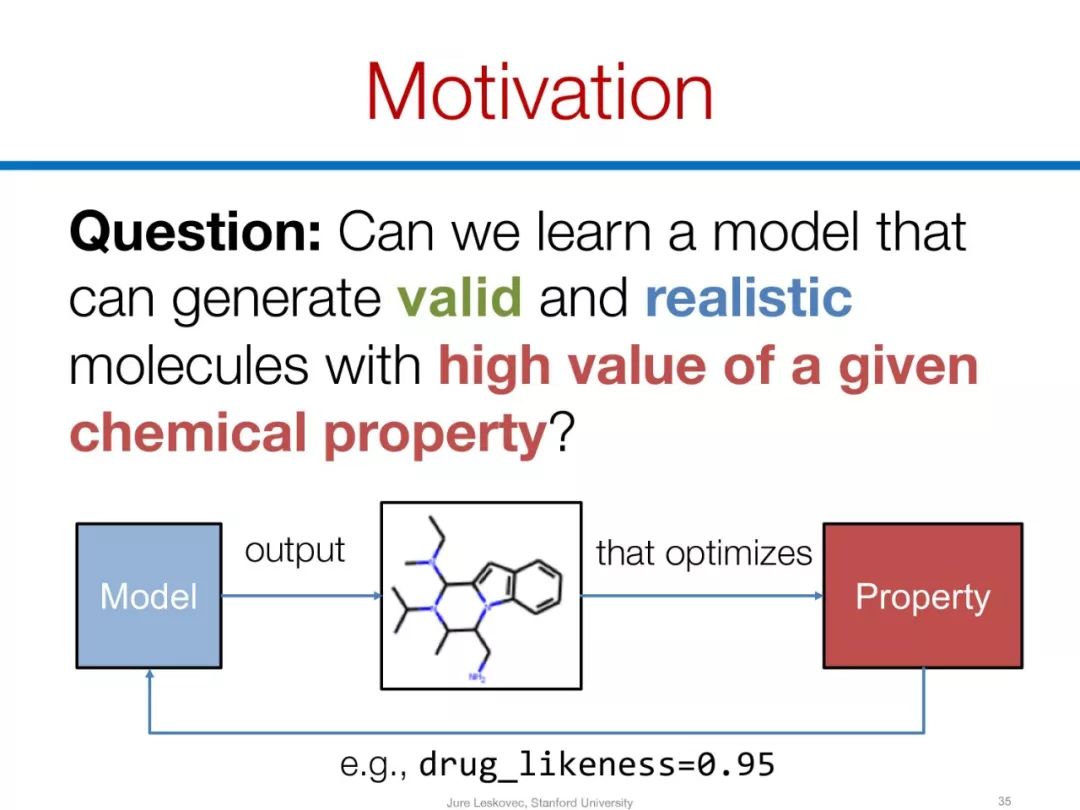

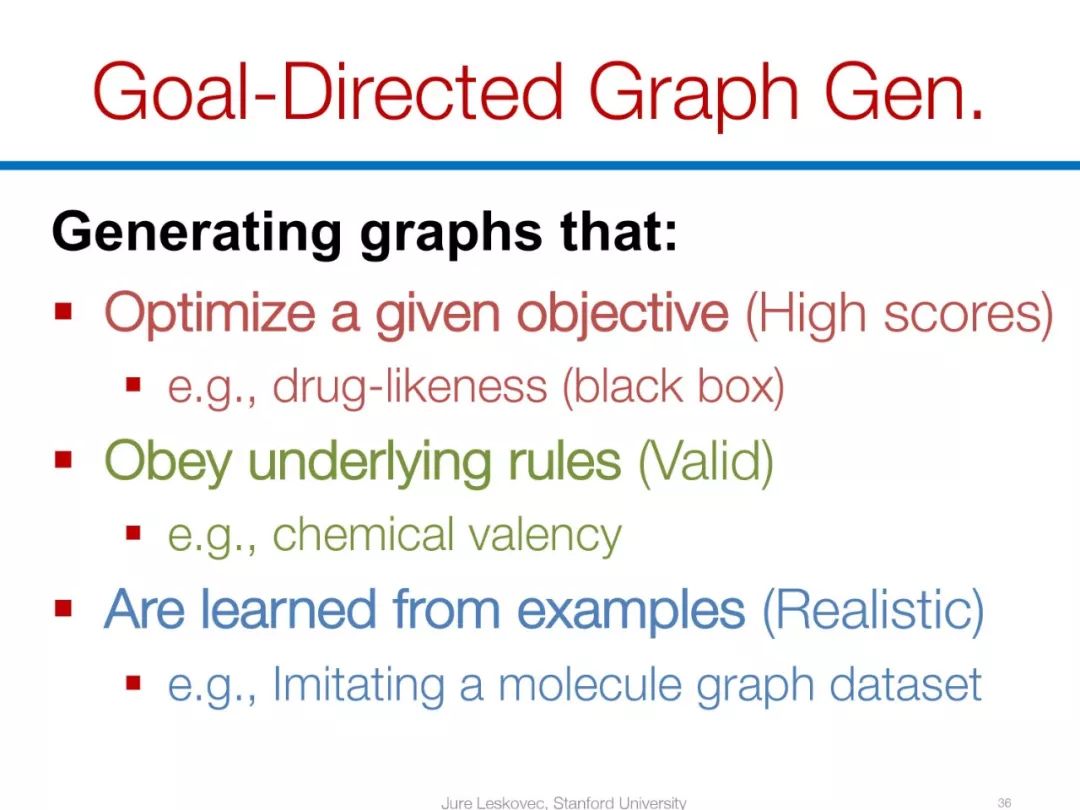

任務 2:目標導向的圖生成

生成優(yōu)化給定目標 / 約束的圖

藥物分子生成 / 優(yōu)化

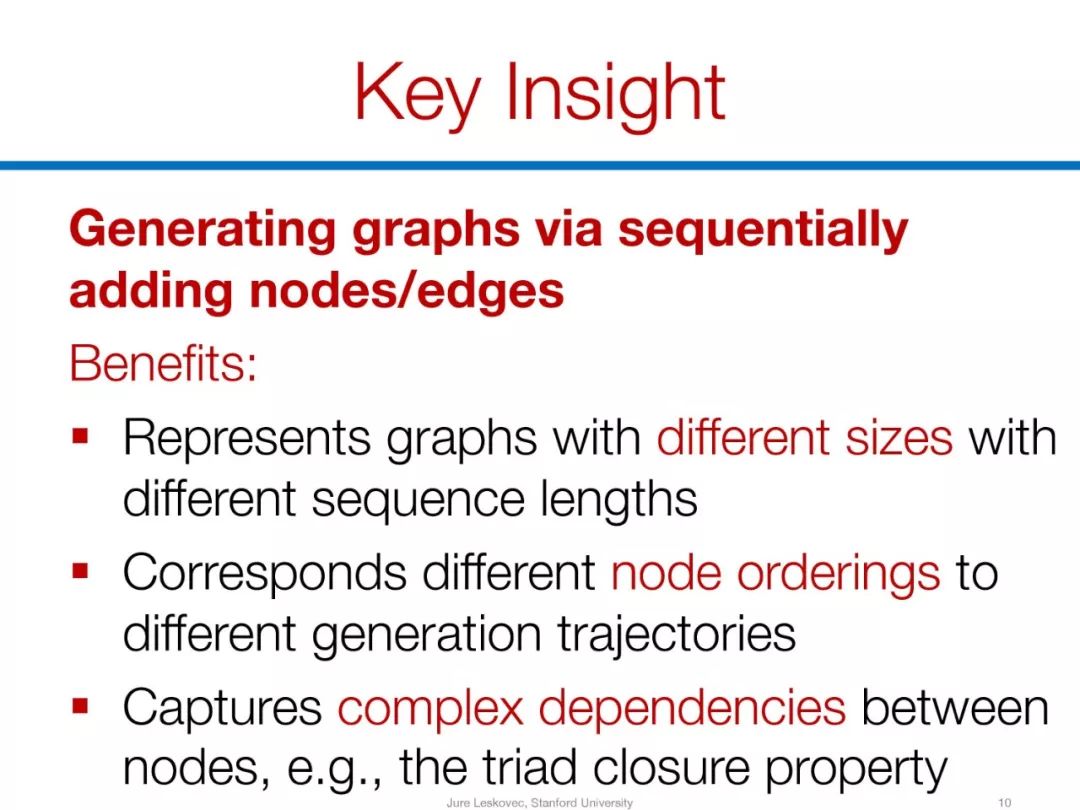

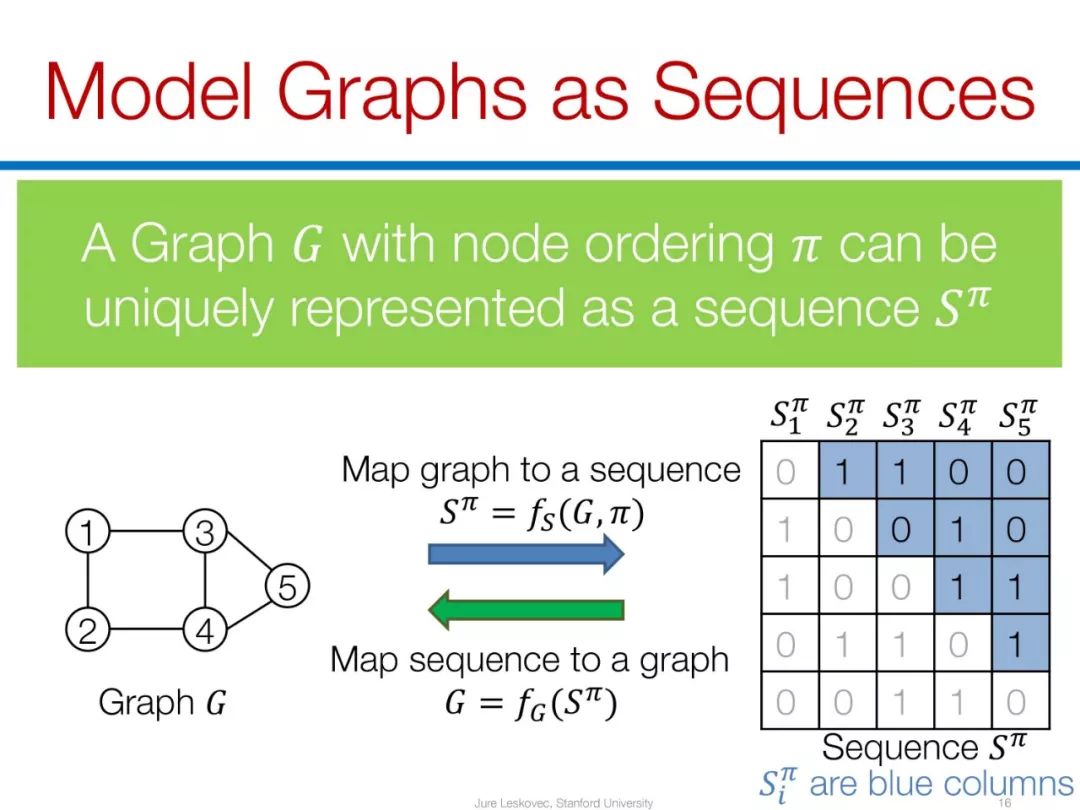

關鍵的見解

通過順序添加節(jié)點 / 邊來生成圖

好處:

表示具有不同大小、不同序列長度的圖

將不同的節(jié)點順序?qū)诓煌纳绍壽E

捕獲節(jié)點之間的復雜依賴關系

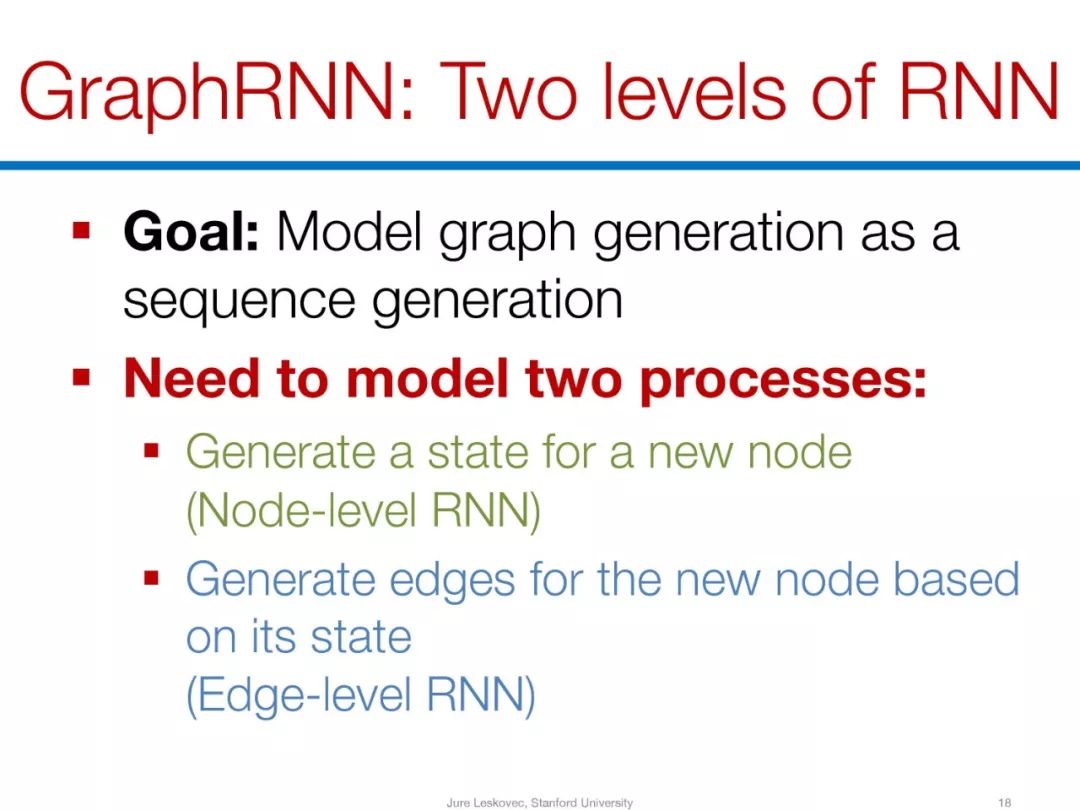

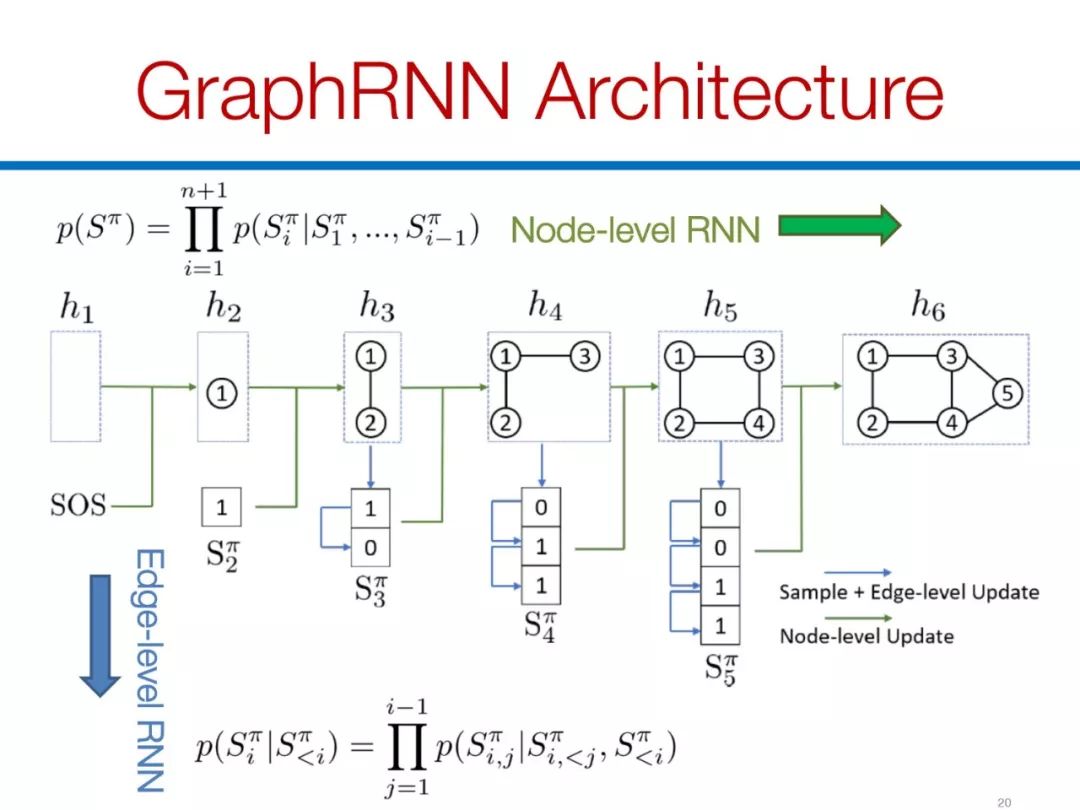

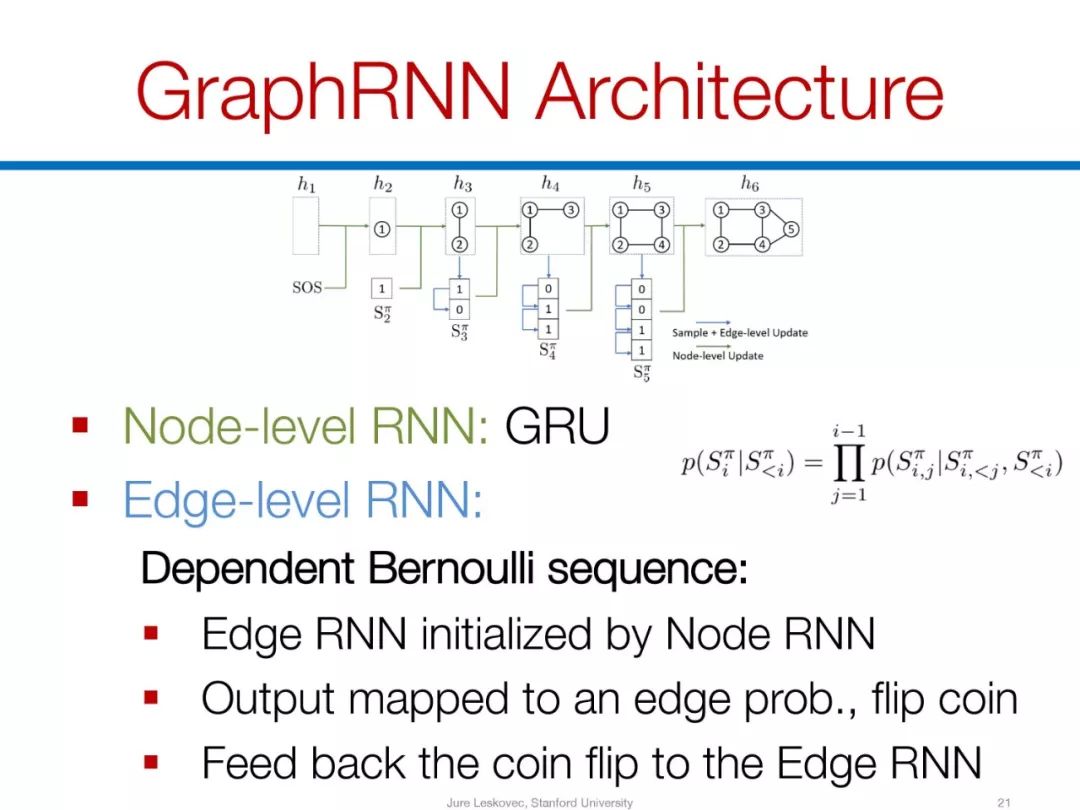

GraphRNN:RNN 的兩個層次

GraphRNN:RNN 的兩個層次

目標:將模型圖生成作為序列生成

需要對兩個流程建模:

為新節(jié)點生成狀態(tài) (節(jié) Node-level RNN)

根據(jù)新節(jié)點的狀態(tài)生成新節(jié)點的邊 (Edge-level RNN)

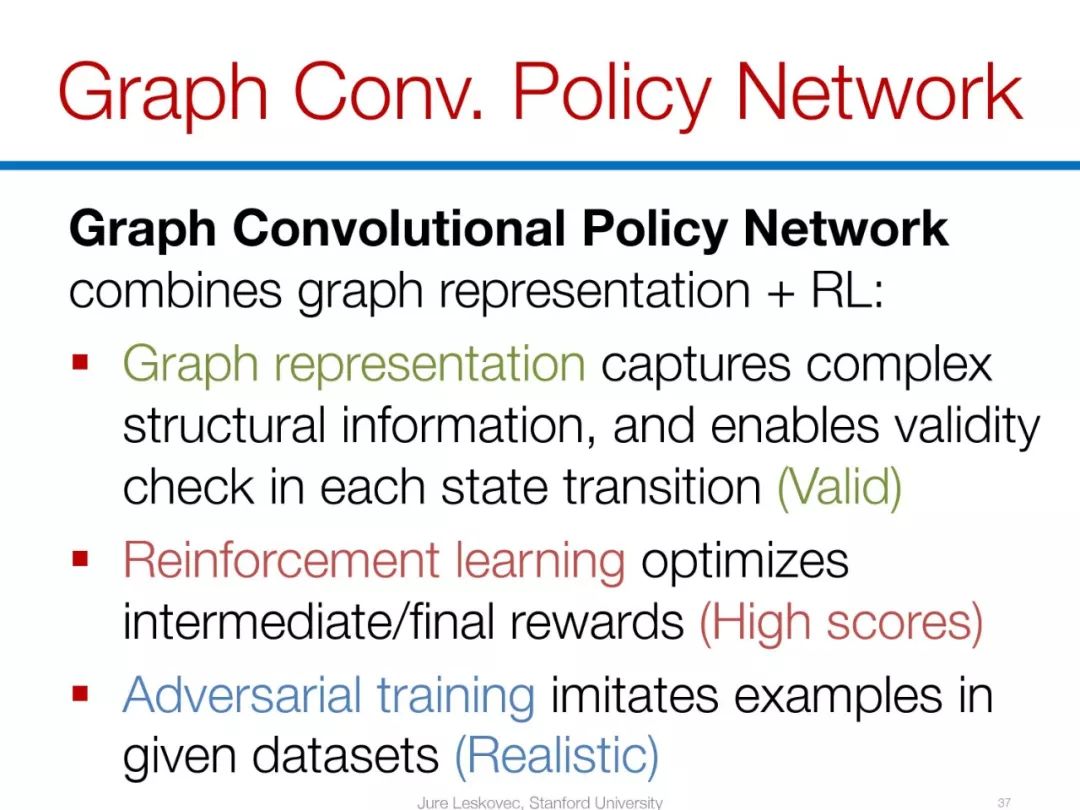

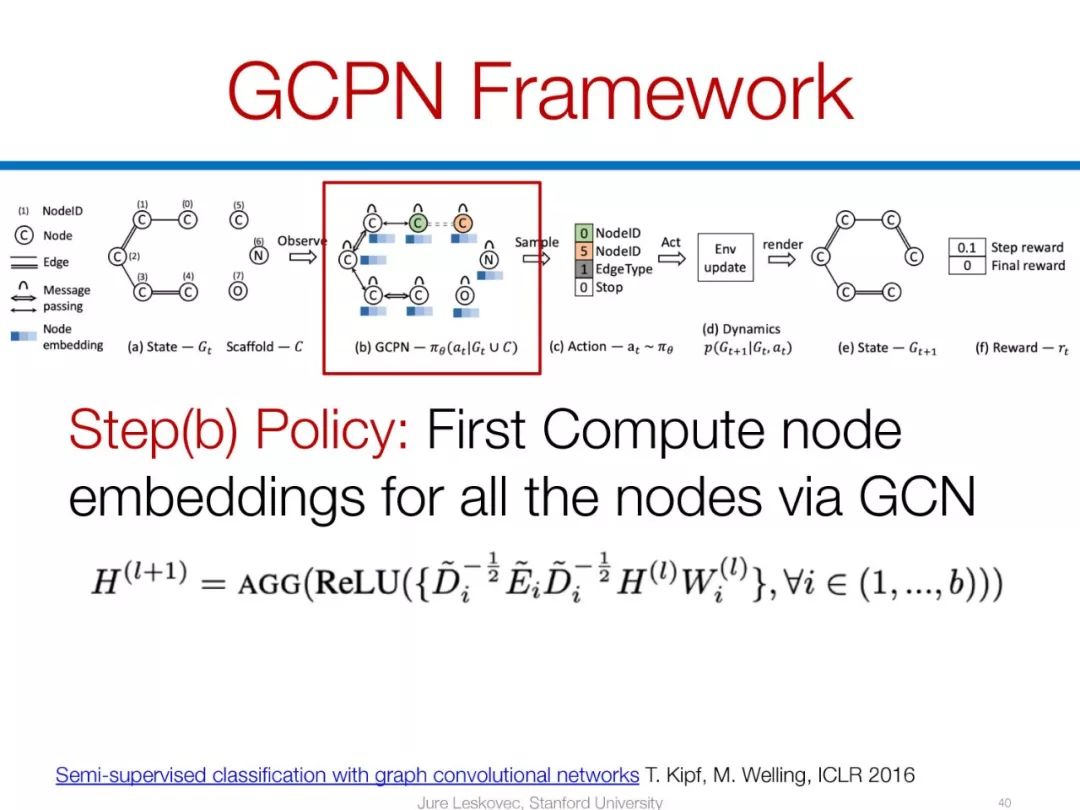

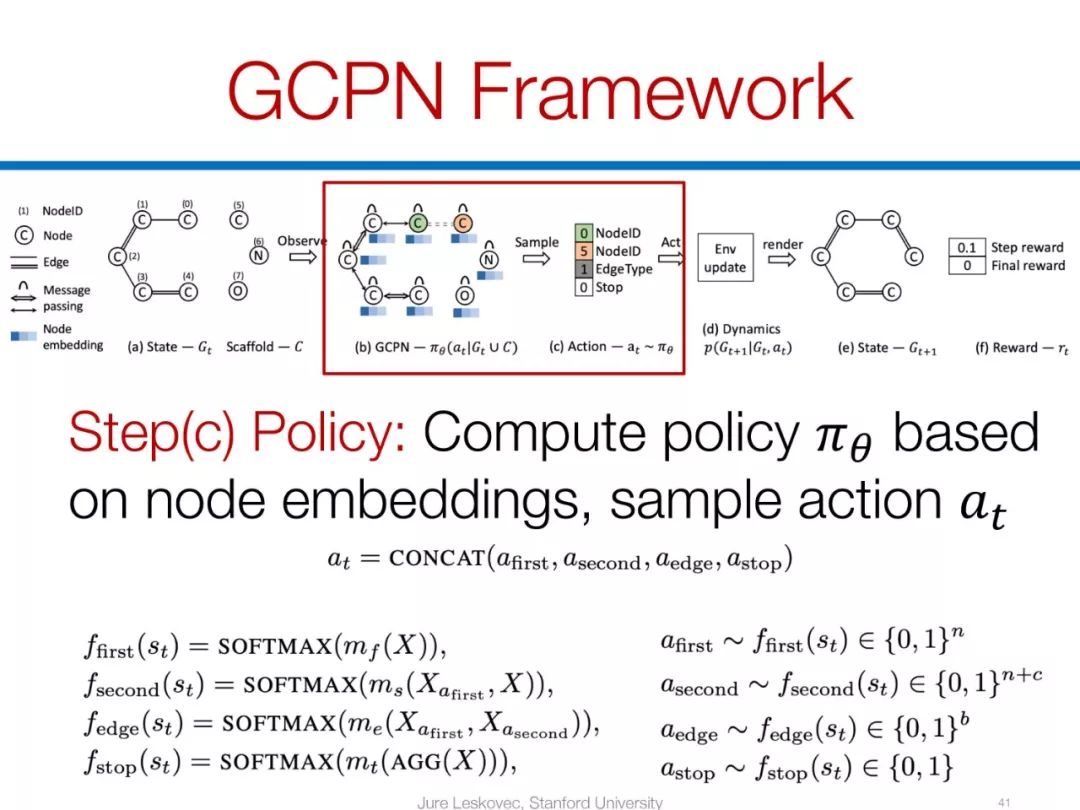

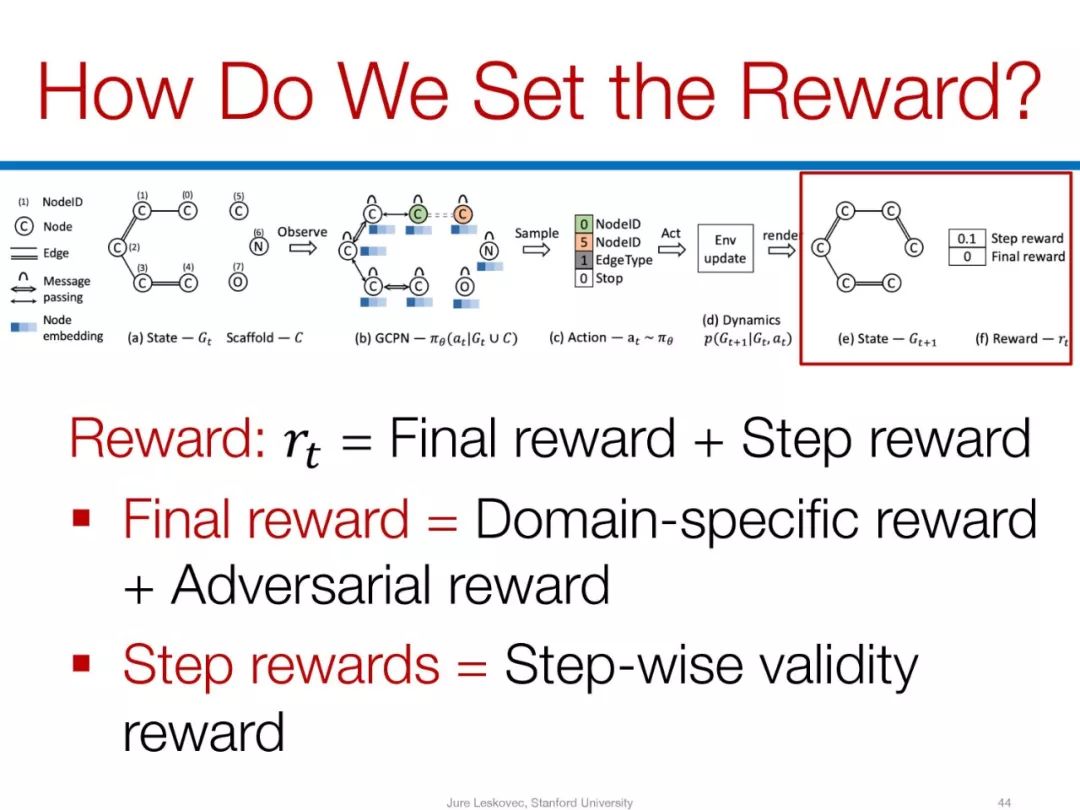

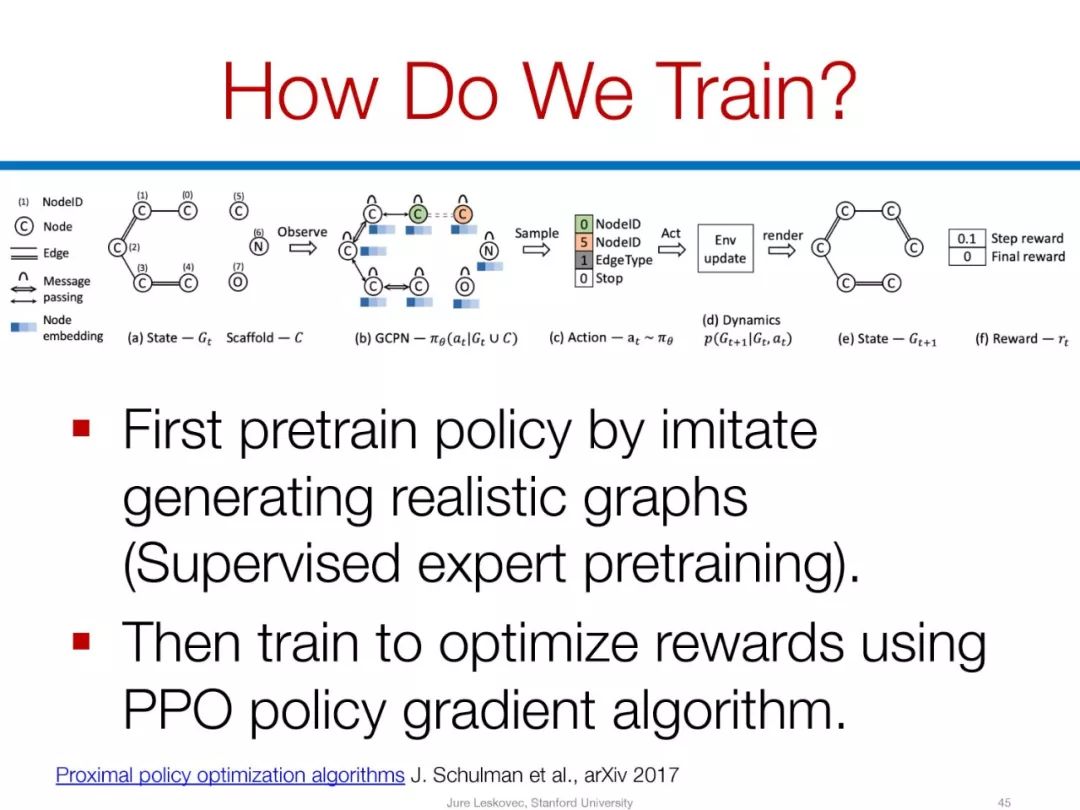

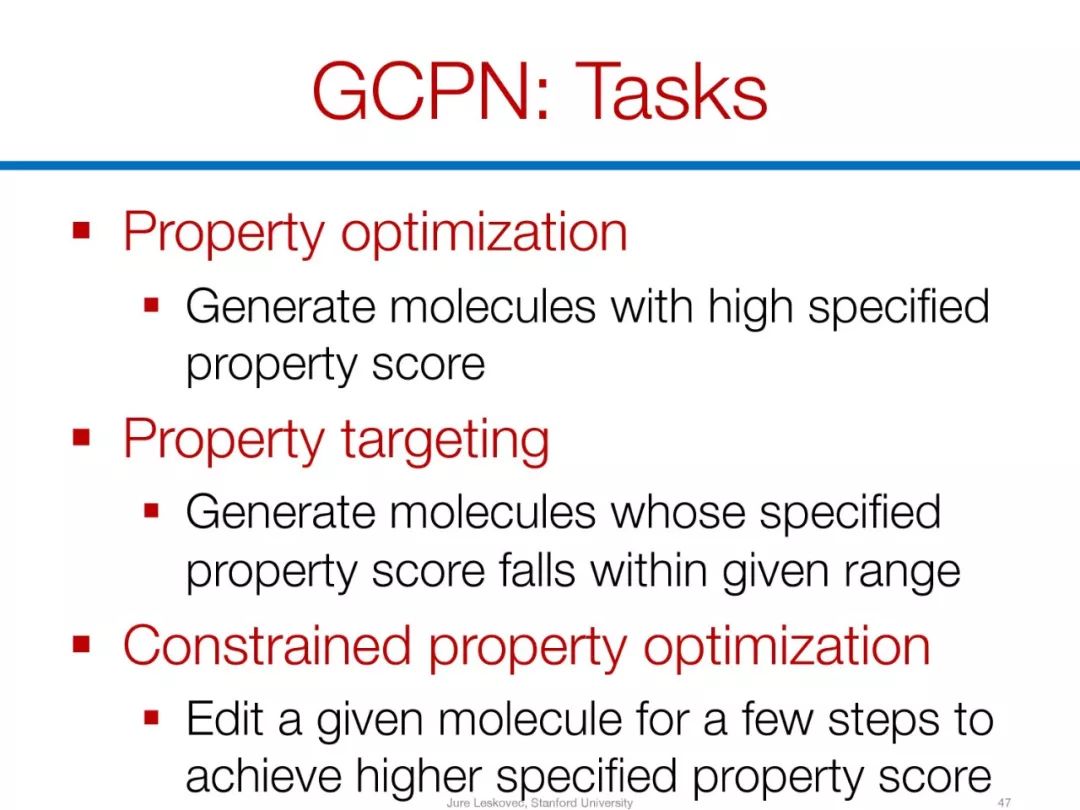

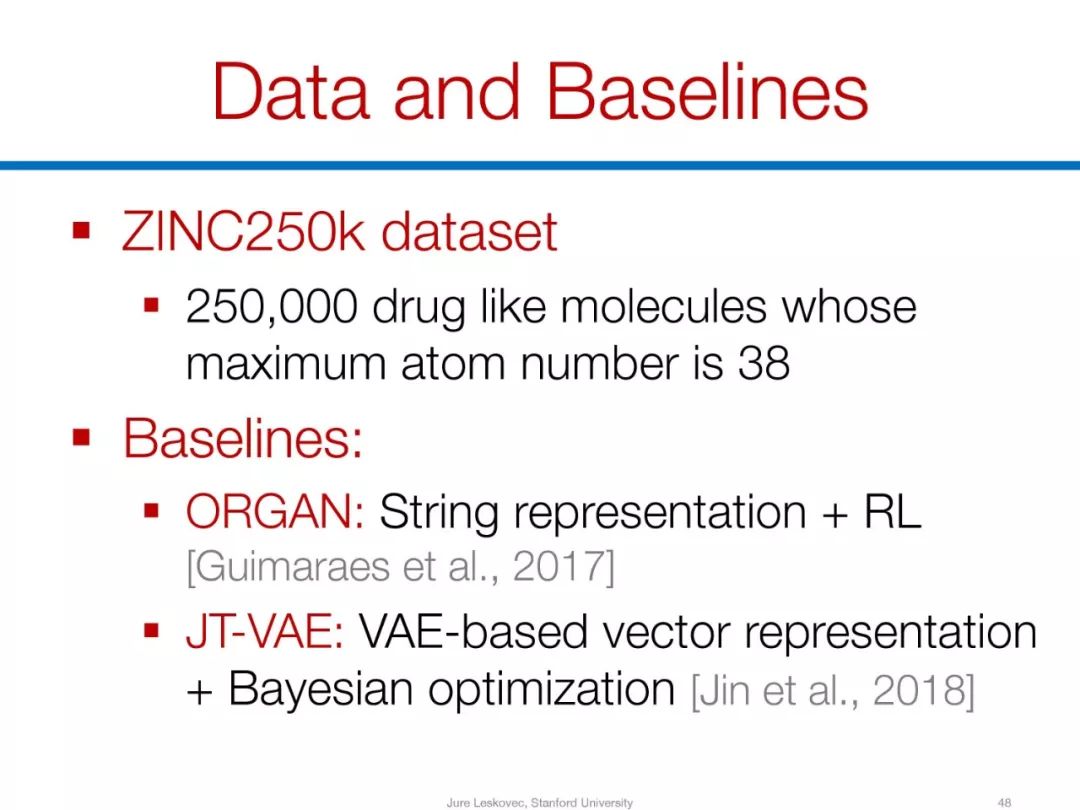

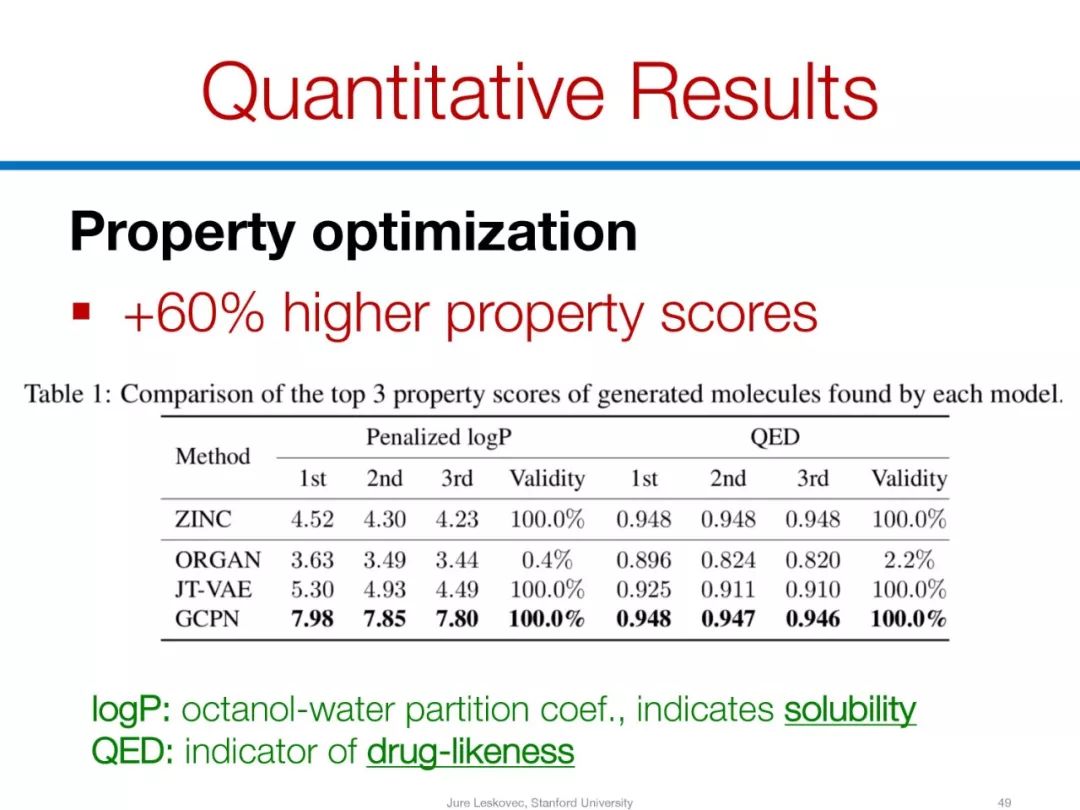

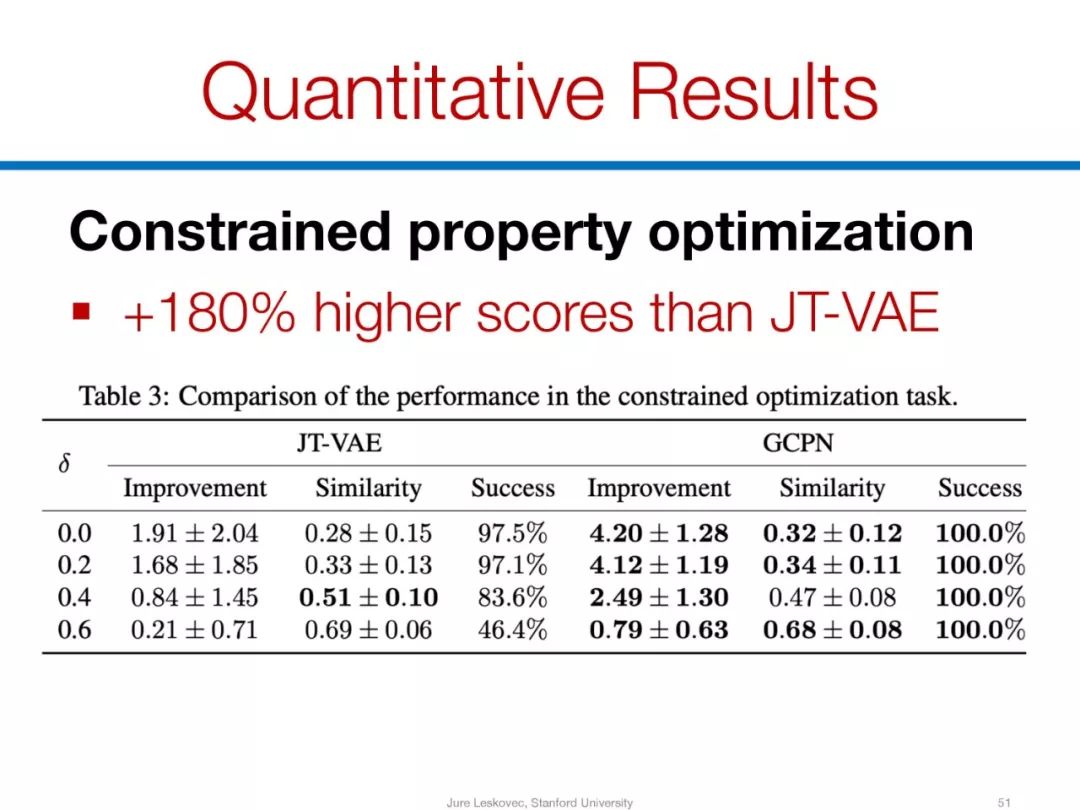

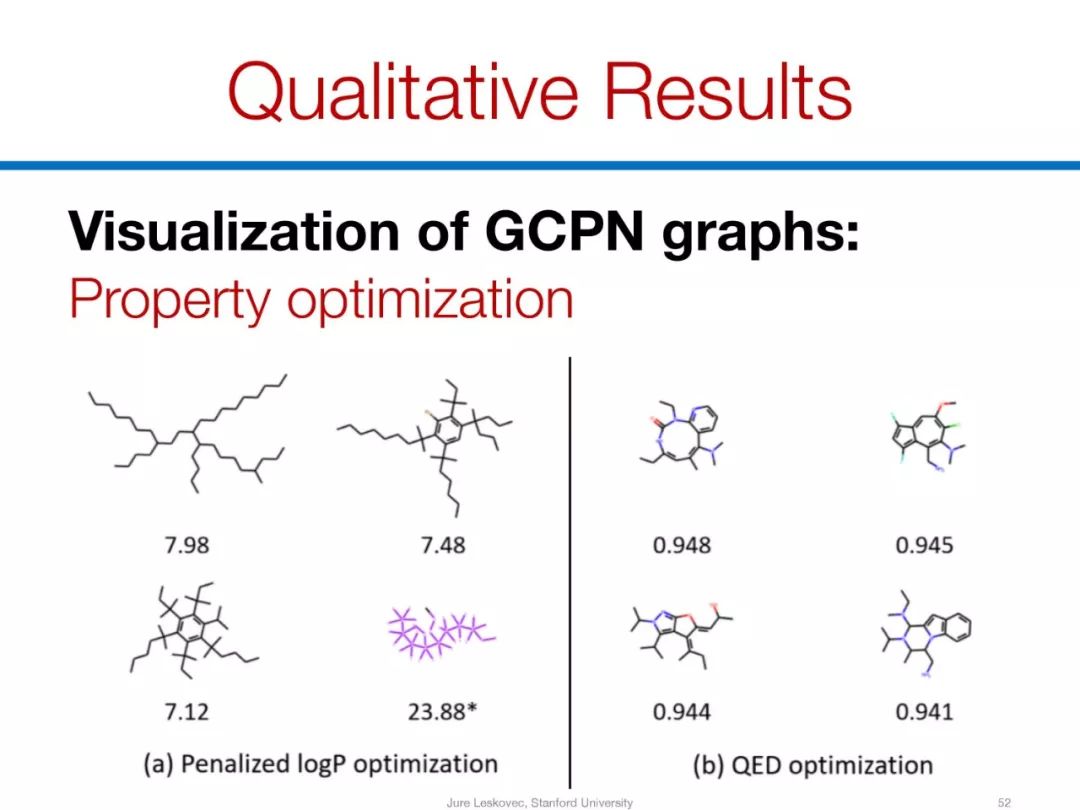

圖卷積策略網(wǎng)絡

圖卷積策略網(wǎng)絡:目標導向的圖生成 (GCPN)

將圖表示 + RL 結合起來

圖表示 (Graph representation) 捕獲復雜的結構信息,并在每個狀態(tài)轉(zhuǎn)換中啟用有效性檢查 (Valid)

強化學習 (RL) 優(yōu)化中間 / 最終獎勵 (High scores)

對抗性訓練 (Adversarial training) 模仿給定數(shù)據(jù)集中的例子 (Realistic)

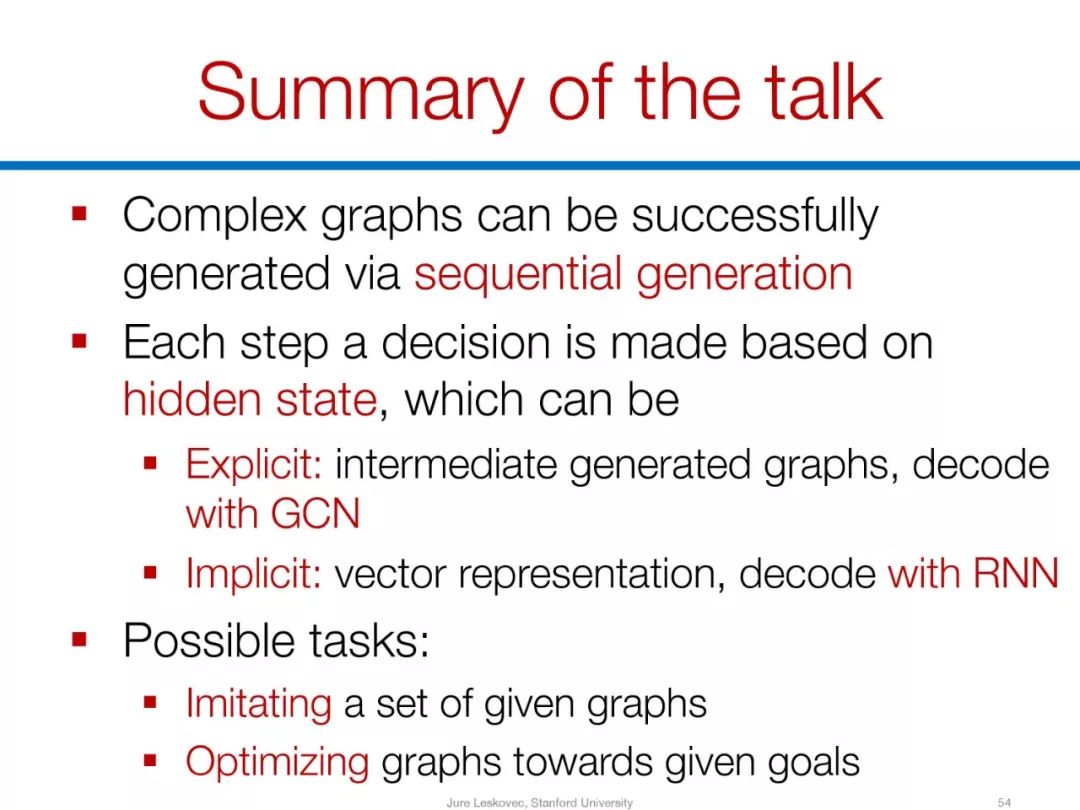

總結

通過序列生成,可以成功生成復雜的圖

每一步?jīng)Q策都是基于隱藏狀態(tài)做出的

顯式:中間生成圖,用 GCN 解碼

隱式:向量表示,RNN 解碼

任務:

模仿一組給定的圖

按照既定目標優(yōu)化圖

-

神經(jīng)網(wǎng)絡

+關注

關注

42文章

4762瀏覽量

100541 -

AI

+關注

關注

87文章

30146瀏覽量

268421 -

論文

+關注

關注

1文章

103瀏覽量

14950

原文標題:斯坦福教授ICLR演講:圖網(wǎng)絡最新進展GraphRNN和GCPN(附PPT下載)

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關推薦

【PYNQ-Z2試用體驗】神經(jīng)網(wǎng)絡基礎知識

卷積神經(jīng)網(wǎng)絡如何使用

【案例分享】基于BP算法的前饋神經(jīng)網(wǎng)絡

【案例分享】ART神經(jīng)網(wǎng)絡與SOM神經(jīng)網(wǎng)絡

如何設計BP神經(jīng)網(wǎng)絡圖像壓縮算法?

如何構建神經(jīng)網(wǎng)絡?

基于BP神經(jīng)網(wǎng)絡的PID控制

卷積神經(jīng)網(wǎng)絡模型發(fā)展及應用

卷積神經(jīng)網(wǎng)絡簡介:什么是機器學習?

深入了解圖神經(jīng)網(wǎng)絡背后的原理和其強大的表征能力

淺談圖神經(jīng)網(wǎng)絡在自然語言處理中的應用簡述

圖神經(jīng)網(wǎng)絡背后的原理和其強大的表征能力

圖神經(jīng)網(wǎng)絡背后的原理和其強大的表征能力

評論