繼去年“AI寒冬論”一文引燃AI圈,作者再次重磅發文總結了這一年來人工智能的總體情況,并將AI圈形容為馬戲團。吳恩達生寶寶被調侃,OpenAI和特斯遭猛懟,MIT網紅研究員成年度“小丑”候選人。并發出勸告:所有AI人士趕緊尋找過冬的棉衣,或者干脆換一份工作吧!

去年,一篇AI寒冬論的文章在人工智能圈內成為爆款,文章鮮明的指出:深度學習到頂,AI寒冬將至!隨即,便在AI圈引發熱議。

而時隔一年,AI寒冬論作者Piekniewski如約而至,再次發布文章總結了這一年來關于人工智能的總體情況。

而此次作者拋出的觀點是——AI圈就是個馬戲團。

Piekniewski在這篇火力全開的文章中槽點如下:

AI大咖們依舊非常安靜;

AI圈內年度兩大騙局:OpenAI、特斯拉;

AI年度“小丑”候選人:MIT網紅研究員 Lex Fridman。

最后,作者依舊保持“AI寒冬論”的觀點:

這真的只是即將到來的AI寒冬的第一次凜冽寒風,我建議所有AI人士趕緊尋找過冬的棉衣,或者干脆換一份工作吧。

以下是文章全文。

“AI馬戲團”:序

自我發布《AI寒冬將至》已經過去一年的時間了,就像我承諾的那樣,我將定期發布一個關于人工智能的總體情況的更新。現在是時候發布另一篇文章了。

最近在AI圈發生了許多事情,但都沒有改變我的想法——人工智能泡沫正在破裂。正如每一次泡沫破滅一樣,AI正處于井噴階段,那些最有可能一敗涂地的人正拿出他們最荒唐的自信,上演一出讓更天真的人為他們掏腰包的最后把戲。

且讓我們看一下這段時間都發生了什么。

“AI馬戲團”開場節目:大咖們都很安靜

首先,讓我們看看那些看似并不滑稽的事情。

深度學習三位創始人,Geoffrey Hinton、Yoshua Bengio 和 Yann Lecun獲得了圖靈獎。如果你認為我會以某種方式質疑這件事情,那么不好意思,讓你失望了,我認為深度學習獲得圖靈獎是實至名歸。

但在我個人看來,有一件事給人留下了不好的印象,那就是Jürgen Schmidhuber缺席了此次獎項。我同意他有時候會讓人感到尷尬,但他對于深度學習領域的貢獻是不可否認的。

順便說一下,所有這些家伙都很“安靜”。Hinton最終確實有了自己Twitter賬號,但是他屬于謙虛的風格,沒有發布任何我認為不真實或過于熱情的推文。 Yann Lecun偶爾在FAIR推廣他的研究,但這也沒什么不尋常的。 同樣,Bengio在社交媒體上也并不活躍。

而我最為欣賞和喜歡的一群人也比較安靜。李飛飛去年秋天離開了谷歌云回到斯坦福;吳恩達異常的安靜,也許是因為他最近有了一個孩子(我真誠祝賀他和他的妻子)。

我非常理解擁有孩子的幸福,因為我前兩個月也有了自己的寶寶,但同時我也意識到,孩子的誕生可能或多或少的影響他每周90小時的工作時間,不可避免的延遲了人工智能奇點。

在過去幾個月里,人工智能領域中最搞笑的一系列事件是圍繞著Open AI和特斯拉展開的。

“AI馬戲團”精彩騙局一:OpenAI不open

OpenAI,一個非營利性組織,其使命是解決通用人工智能(AGI)問題并確保他們的研究成果對公眾開放,而不是被一些心存惡意的公司利用。

OpenAI于今年2月發布的文本生成模型GPT-2。令所有人驚訝的是,他們并沒有對此開源,理由是擔心可能存在濫用,或者在研究人員和人工智能人群中引發了明顯的爭議。

我不確定這些家伙怎么能聲稱他們是“open”的,但是他們確實沒有發布模型的關鍵部分。盡管GPT-2生成的文本看起來很合理,但我不確定人們如何能夠濫用它來生成假新聞或垃圾郵件,或者真正地將其用于娛樂之外的任何事情。

無論如何,最近 OpenAI 顯然已經不再開源你了,它提出了一個盈利的想法。

沒錯,這個組織曾被認為是十九世紀的普羅米修斯,這個由公正無私的研究人員組成的修道院正努力為整個人類提供人工智能的火焰,但現在它已經不再開放,實際上卻是為了盈利。

但是,他們仍然堅持這個宏偉的使命,因為利潤將受到限制——每個投資者最多只能獲得成本 100 倍的回報。我能想到的唯一幕后原因是他們不能再以非營利組織的身份籌集資金了。

讓我們暫時把這樣一個事實放在一邊,即該公司迄今為止的利潤為零,而且它的結構不像任何想象中的初創企業(而是像一個研究實驗室)。在采訪 OpenAI 現任首席執行官Sam Altman的一篇文章中,我們發現了一些有關“炒作周期”的言論。我截取了這篇采訪文章中較為精彩的部分:

例如,當被問及OpenAI計劃如何賺錢(我們想知道它是否可能授權其部分工作)時,Altman回答說,“誠實的答案是,我們不知道。我們從來沒有賺過錢。我們目前沒有創收的計劃。我們不知道有一天我們將如何產生收入。”

Altman繼續說道:“我們已經向投資者做出了一個溫和的承諾,‘一旦我們建立了一個通用智能系統,我們基本上會要求它為你找到一種投資回報的方式。”當觀眾爆發出一陣笑聲(并不能馬上看出他是認真的)時,Altman自己說,這聽起來像是《硅谷》(Silicon Valley)中的一集,但他補充說,“你可以笑。沒關系。但這是我真正相信的。”

是的。我不知道該補充些什么。我確信,計算出如何產生收入應該比計算出AGI要容易得多,但不是按照炒作泡沫的扭曲邏輯。簡而言之,我的主張是:我相信我們可以建立AGI,盡管我真的沒有任何證據,但我確實堅信,如果你給我們數十億美元,我們可以做到。

我希望我也能相信這一點,但不幸的是,我不相信,我認為 OpenAI 已經變成了一個徹頭徹尾的騙局。

“AI馬戲團”精彩騙局二:特斯拉依舊沒戲

通過觀察一些公開的人工智能相關用戶的推文,這種判斷得到了進一步的證實,例如:

Wojciech Zaremba在紐約大學(NYU)讀書時是一個非常理性的人(我在2015年與他交換了幾封電子郵件),現在他成了一個“信徒”。

上面的這條推文有很多錯誤,甚至很難想象一個對數據和現實有一定理解并且作為科學家的人都可以這樣說。但這正是這些看似聰明的人在舊金山灣區回音室(echo chamber)里所相信的,而該領域成千上萬的年輕大一新生也盲目追隨。

具體來說:上面描述的方法(我甚至不確定“方法”到底是什么意思)可能有數百萬種方法不起作用(有大量證據表明它確實不起作用)。

一個潛在的原因是:即使他們擁有所有的數據,它也很可能是有偏見的,因為人們明確地避免了邊緣情況。另一個潛在的原因是:邊緣情況是一個非常稀疏的集合,統計上被“非邊緣情況”淹沒。

在對所有數據點進行全面損失優化的同時進行深度學習,這可能會徹底消除極端情況,而且每個極端情況可能需要自己的數據再平衡/損失函數調優。

第三個原因是,假設路上有50萬臺特斯拉,即使他們收集了所有的駕駛數據(他們沒有),如果邊緣情況是長尾的話,這很可能不足以覆蓋所有的邊緣情況。

第四個原因是,人類在路上的一組邊緣案例與AV在路上的一組邊緣案例不同,而且確實在不斷變化。

還有一個最不明顯的原因是,他們使用的特定深度網絡可能沒有表達它所需要表達的東西的能力(即使假設他們擁有訓練它所需的所有數據)。感知器從80年代開始就為人所知,是通用的近似器,但是它需要非常特殊的微調結構,稱為convnet,以及一些技巧來提高收斂性和足夠數量的可訓練參數來求解ImageNet。

即使在今天,你也不能隨便拿一個通用的,所有連接的多層感知器,然后期望它能學習你要求它做的任何任務。即使你有大量的數據,也需要進行大量的調優和元參數搜索才能找到解決問題的方法。

最后,即使在原則上這一切都是可行的,我們也不清楚在特斯拉內置的電腦的限制下是否可行。

其他人在AV空間塞滿了汽車激光雷達,它雖然貴,但是解決了大多數的特斯拉試圖通過AI解決的大部分問題(例如避障和可穿越性),完整的游戲GPU提供了比最新的Tesla硬件更多的計算能力然而根據我們的數據,很明顯沒有人接近完全自治。

這就是為什么特斯拉的自動駕駛方法“不一定要奏效”的幾個原因。每一位稱職的數據科學家在喝完一瓶伏特加后,都應該能夠一口氣說出這些理由。

在特斯拉“自駕日”上,有一些非常大膽的預測,比如說特斯拉將在2020年擁有100萬輛自動駕駛出租車,我認為這是不可能的。我在之前曾表達過對馬斯克以及他瘋狂的承諾和想法的觀點,我不想在這篇文章中花太多篇幅再說一遍(坦白講,這篇文章無意吸引特斯拉的粉絲,讓他們繼續留在自己的幻想世界里吧)。

“AI馬戲團”壓軸節目:MIT網紅研究員Lex Fridman榮獲“年度小丑”封號

但我想從另一個角度關注特斯拉,因為今年早些時候發生了一些趣事:麻省理工學院的研究科學家萊克斯·弗里德曼發表了一項研究,稱使用自動駕駛儀的駕駛員仍然可以保持警惕和專心度,這一結論與之前大量研究文獻的觀點相悖。

該研究的發表本身就伴隨著爭議:首先,弗里德曼一開始找記者報道這個成果,作為新聞稿發布。一些科學家,如Nvidia的研究主管Anima Anandkumar建議他先把這項研究提交同行評審,為此,她在Twitter上被弗里德曼拉黑,而且還將每個對此研究提出批評的人都拉黑了(這個弗里德曼還真是敏感。

這個研究上了新聞后(強調一下:這是一個未經同行評審的研究),弗里德曼(其特斯拉腦殘粉的身份已經公開)立即發Twitter表示,這項研究與特斯拉和馬斯克本人都無關,隨后他刪掉了這些Twitter,又發布了一些關于研究誠信的內容(也許是因為他理所當然地認為這項研究正被質疑),而兩周后,他受邀與馬斯克一起上了播客,而后他自己受邀參加Joe Rogan播客。他在這兩次節目上無恥地推銷自己,他一直都是這么干的。

我不會在這里詳細介紹論文本身的細節,但推薦各位去看看Duke Cummings的一個很棒的播客采訪,他是杜克大學的人機交互教授,他詳細介紹了麻省理工學院研究的多種方式,這項研究完全是有缺陷的。

盡管如此,鑒于上述所有事情,我正式將萊克斯·弗里德曼列為2019年AI領域最可笑的小丑的候選人。即使現在2019年剛剛過去不到一半,這個“小丑評選”比賽仍然開放,我覺得他的獲勝機會非常大。

說到特斯拉,不久前,NTSB發布了佛羅里達州致命事故的初步報告,報告表明(毫無意外)事故確實與Autopilot有關。這至少是第四次有記錄的與特斯拉自動駕駛系統相關的死亡事件,與著名的約書亞·布朗事故情況驚人相似。雖然4次這個數字從宏觀角度看可能不多,但值得注意的是,凱迪拉克與特斯拉自動駕駛系統類似的ADAS系統(超級巡航系統)此文寫作時還是零死亡記錄(甚至沒有一起事故看起來像是自駕系統故障引起的)。二者微妙的區別在于“超級巡航系統”設有駕駛員監控系統,可以確保駕駛員保持警惕,而特斯拉則沒有,這一切都說明,弗里德曼的研究就是一團......那什么。

從其他新聞來看,自從我之前的關于AI的文章更新后,又有兩家AI /機器人公司倒閉了,分別是Jibo和Anki。對我個人而言,Jibo是一個特別有趣的案例,因為我知道在看到他們的Indiegogo活動時,就知道這家公司最終的結局了。Jibo由MIT研究員Cynthia Breazeal創立,該項目立即獲得了追捧,當時承諾實現的功能,甚至到現在根本不可能實現,最終白白燒掉了約7200萬美元。

我不知道MIT到底怎么了,先是Cynthia Breazea,一位自稱的機器人技術專家承諾Jibo公司能實現那些奇跡,實際上這些“奇跡”甚至在圖紙上都沒法實現。然后是Lex Fridman,他未經同行評議的研究把自己變成了一個小丑(雖然他以MIT的名義發表研究,但實際上他只是一名受聘的研究科學家,而不是MIT的畢業生)。

除此之外,據報道,安大略政府決定削減對AI的支出,其中包括Hinton的矢量研究所,這引起了AI界的極大憤怒。這真的只是即將到來的AI寒冬的第一次凜冽寒風,我建議所有AI人士趕緊尋找過冬的棉衣,或者干脆換一份工作吧。

寫在最后:AI泡沫最終只是一個笑話

如我所料,2019年年中人工智能正變得越來越荒謬,基本上成了一場小丑秀。我想我們很快就會知道,所有的AI泡沫最終只是一個笑話,這一點我從一開始就多次說過。

-

特斯拉

+關注

關注

66文章

6292瀏覽量

126461 -

AI

+關注

關注

87文章

30146瀏覽量

268414

原文標題:AI圈就是個馬戲團?寒冬論作者再發文:OpenAI、特斯拉遭猛懟

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

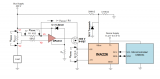

使用LME49600做一個耳機功放,下圖中紅色圈部分運放的作用是什么?是否可以不用?

搭建一個 AI 問答機器人,需要幾步?

看下噪聲分析過程,一個是干擾,一個是電化學

關于音圈電機一些參數的解析

AI圈就是個馬戲團?最終只是一個笑話?

AI圈就是個馬戲團?最終只是一個笑話?

評論